搜索到

21

篇与

AIGC

的结果

-

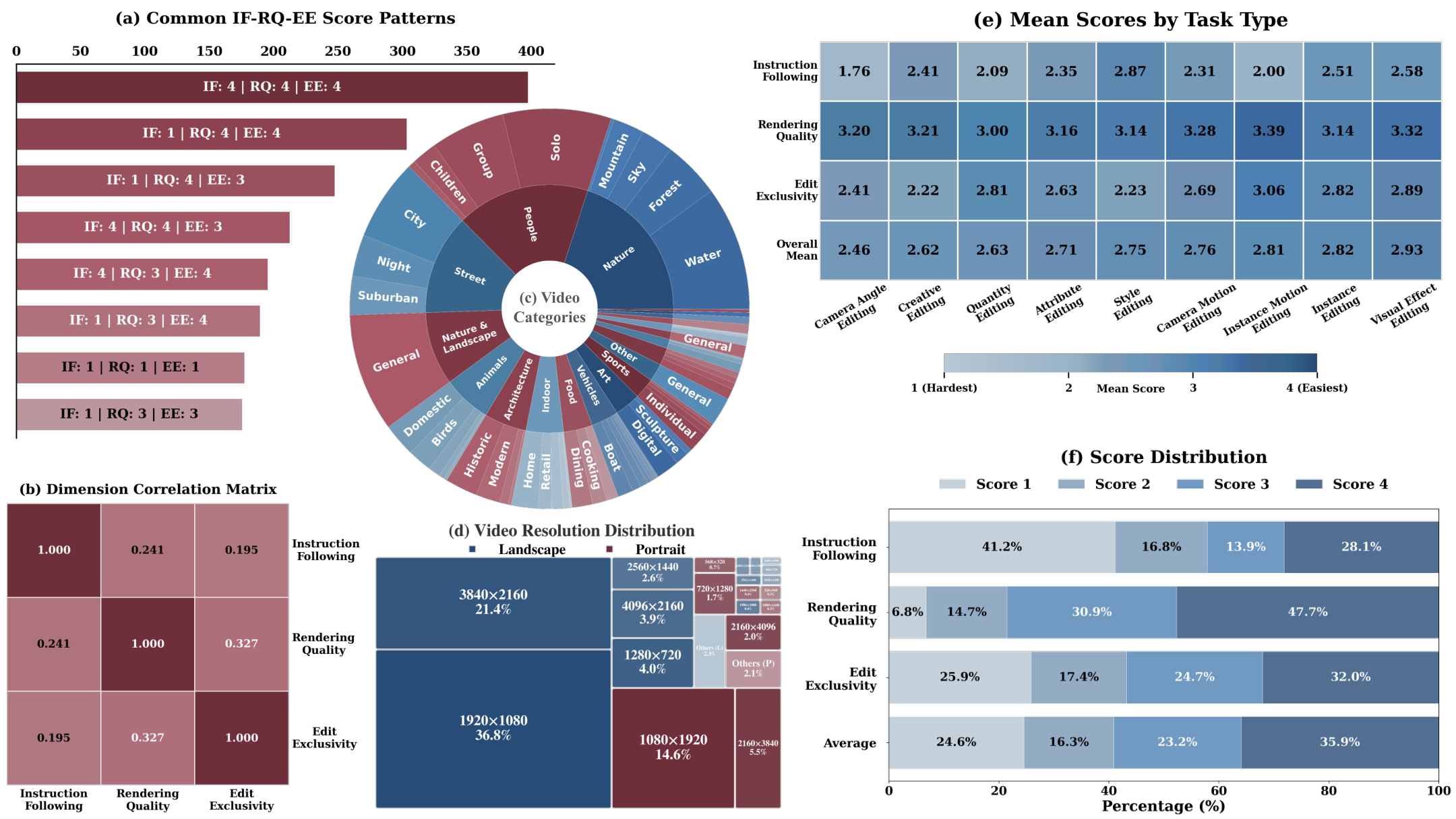

AIGC 周末专题|2026-04-25|视频编辑评测方法全景:从传统指标到 Reward Mo… AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 技术路线与时间线 1. 传统指标时代(2018-2023) 描述:依赖手工设计的指标(CLIP-Score、LPIPS、FVD),与人类感知相关性低,无法捕捉编辑任务的语义一致性。 关键节点: 2018:LPIPS 提出,感知相似度指标 2019:FVD 提出,基于 I3D 特征的视频质量评估 2021:CLIP-Score 成为图像-文本相似度标准 2. 通用视频基准崛起(2024 年初) 描述:通用视频生成评测基准出现,覆盖多个维度,但尚未针对编辑任务设计。 关键节点: 2024:VBench 发布(CVPR 2024),16 维度视频生成评测 2024:VideoScore 发布(EMNLP 2024),视频质量评估模型 3. 编辑专用评测爆发(2024 下半年) 描述:针对视频/图像编辑任务设计的评测基准集中涌现,覆盖多维度、多任务、多编辑类型。 关键节点: 2024.08:I2EBench 发布(NeurIPS 2024),图像编辑 16 维度评测 2024.09:EditBoard 发布(AAAI 2025),视频编辑综合评测基准 2024.10:VE-Bench 发布,首个视频编辑专用 VQA 数据集 2024.11:FiVE-Bench 发布,细粒度视频编辑评测 4. Reward Model 范式确立(2025-2026) 描述:从手工指标和通用 VLM 评审,演进到编辑专用 Reward Model,人类相关性大幅提升(SRCC 从 0.214 提升到 0.780)。 关键节点: 2025:EditReward 发布,200K 偏好对训练 Reward Model 2026.04:VEFX-Bench 发布,三维解耦 + 序数回归 Reward Model(SRCC=0.780) 5. 未来方向(2026+) 描述:多模态 Reward Model、测试时计算缩放、标准化竞赛平台是三大重点方向,评测将与训练深度融合(RLHF/DPO)。 关键节点: 2026+:多模态 Reward Model(视频+音频+字幕联合评估) 2026+:测试时计算缩放(Reward-guided iterative refinement) 2026+:跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 其余论文速览 1. EditBoard:提出 EditBoard 综合评测基准 EditBoard: Towards A Comprehensive Evaluation Benchmark for Text-Based Video Editing Models | Cornell University / Nanjing University / University of Oxford | arXiv:2409.09668 关键词: 综合评测基准·多维度指标·文本视频编辑 前序工作问题: 当前视频编辑模型评估缺乏全面基准,现有方法仅用单一分数概括性能,无法细致分析模型在不同编辑任务中的表现。 贡献: 提出 EditBoard 综合评测基准,设计 4 个维度 9 个自动评估指标的评估框架,覆盖 4 个任务类别,标准化视频编辑评估流程。 效果: 为视频编辑模型提供了标准化评估工具,能够细致分析模型在不同编辑任务中的表现,推动视频编辑技术的标准化和进一步发展。 批判点评: 优势:填补了视频编辑模型评估基准的空白,多维度评估框架设计合理。局限:数据集规模未明确说明;评估维度未充分考虑时序一致性这一视频特有挑战。 2. I2EBench:构建 I2EBench 基准 I2EBench: A Comprehensive Benchmark for Instruction-based Image Editing | Xiamen University / 鹏城实验室 / 北京大学 | arXiv:2408.14180 关键词: 图像编辑评测·16维度·人类感知对齐·NeurIPS 2024 前序工作问题: 指令驱动的图像编辑(IIE)模型缺乏综合评测基准,现有指标无法全面覆盖高层次语义理解和低层次图像质量。 贡献: 构建 I2EBench 基准,包含 2000+ 待编辑图像和 4000+ 条指令,设计 16 个评估维度,并通过大量用户研究确保基准与人类感知高度一致。 效果: 为图像编辑模型提供了首个综合评测基准,16 个维度覆盖语义理解和图像质量,分析方法为视频编辑评测提供了可迁移方法论。 批判点评: 优势:16 维度设计全面,人类感知对齐做得好。局限:针对图像编辑而非视频编辑;部分维度(如时序一致性)在图像场景中不存在,迁移到视频需要适配。 3. T2VEval-Bench:构建 T2VEval-Bench 多维度评测基准数据集 T2VEval: Benchmark Dataset and Objective Evaluation Method for T2V-generated Videos | 中国传媒大学 信息与通信工程学院 | arXiv:2501.08545 关键词: 文本生成视频·多维度评测·主观客观融合·中国传媒大学 前序工作问题: 文本生成视频(T2V)模型缺乏统一的多维度评测基准,主观评价和客观评价方法各自存在局限性,无法全面评估生成视频质量。 贡献: 构建 T2VEval-Bench 多维度评测基准数据集,包含 148 个文本提示和 1783 个生成视频;提出 T2VEval 评估模型,从质量、真实感、一致性三个分支进行客观评估,达到 SOTA 人类相关性。 效果: 为文本生成视频提供了大规模评测基准,三分支评估模型可部分迁移到视频编辑评测场景,尤其是一致性评估维度与编辑排他性高度相关。 批判点评: 优势:主观+客观融合评估思路先进,数据集规模较大。局限:针对文本生成视频而非编辑场景;一致性分支主要评估生成稳定性,与编辑场景的源视频保真度存在差异。 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC 周末专题|2026-04-25|视频编辑评测方法全景:从传统指标到 Reward Mo… AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 技术路线与时间线 1. 传统指标时代(2018-2023) 描述:依赖手工设计的指标(CLIP-Score、LPIPS、FVD),与人类感知相关性低,无法捕捉编辑任务的语义一致性。 关键节点: 2018:LPIPS 提出,感知相似度指标 2019:FVD 提出,基于 I3D 特征的视频质量评估 2021:CLIP-Score 成为图像-文本相似度标准 2. 通用视频基准崛起(2024 年初) 描述:通用视频生成评测基准出现,覆盖多个维度,但尚未针对编辑任务设计。 关键节点: 2024:VBench 发布(CVPR 2024),16 维度视频生成评测 2024:VideoScore 发布(EMNLP 2024),视频质量评估模型 3. 编辑专用评测爆发(2024 下半年) 描述:针对视频/图像编辑任务设计的评测基准集中涌现,覆盖多维度、多任务、多编辑类型。 关键节点: 2024.08:I2EBench 发布(NeurIPS 2024),图像编辑 16 维度评测 2024.09:EditBoard 发布(AAAI 2025),视频编辑综合评测基准 2024.10:VE-Bench 发布,首个视频编辑专用 VQA 数据集 2024.11:FiVE-Bench 发布,细粒度视频编辑评测 4. Reward Model 范式确立(2025-2026) 描述:从手工指标和通用 VLM 评审,演进到编辑专用 Reward Model,人类相关性大幅提升(SRCC 从 0.214 提升到 0.780)。 关键节点: 2025:EditReward 发布,200K 偏好对训练 Reward Model 2026.04:VEFX-Bench 发布,三维解耦 + 序数回归 Reward Model(SRCC=0.780) 5. 未来方向(2026+) 描述:多模态 Reward Model、测试时计算缩放、标准化竞赛平台是三大重点方向,评测将与训练深度融合(RLHF/DPO)。 关键节点: 2026+:多模态 Reward Model(视频+音频+字幕联合评估) 2026+:测试时计算缩放(Reward-guided iterative refinement) 2026+:跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 其余论文速览 1. EditBoard:提出 EditBoard 综合评测基准 EditBoard: Towards A Comprehensive Evaluation Benchmark for Text-Based Video Editing Models | Cornell University / Nanjing University / University of Oxford | arXiv:2409.09668 关键词: 综合评测基准·多维度指标·文本视频编辑 前序工作问题: 当前视频编辑模型评估缺乏全面基准,现有方法仅用单一分数概括性能,无法细致分析模型在不同编辑任务中的表现。 贡献: 提出 EditBoard 综合评测基准,设计 4 个维度 9 个自动评估指标的评估框架,覆盖 4 个任务类别,标准化视频编辑评估流程。 效果: 为视频编辑模型提供了标准化评估工具,能够细致分析模型在不同编辑任务中的表现,推动视频编辑技术的标准化和进一步发展。 批判点评: 优势:填补了视频编辑模型评估基准的空白,多维度评估框架设计合理。局限:数据集规模未明确说明;评估维度未充分考虑时序一致性这一视频特有挑战。 2. I2EBench:构建 I2EBench 基准 I2EBench: A Comprehensive Benchmark for Instruction-based Image Editing | Xiamen University / 鹏城实验室 / 北京大学 | arXiv:2408.14180 关键词: 图像编辑评测·16维度·人类感知对齐·NeurIPS 2024 前序工作问题: 指令驱动的图像编辑(IIE)模型缺乏综合评测基准,现有指标无法全面覆盖高层次语义理解和低层次图像质量。 贡献: 构建 I2EBench 基准,包含 2000+ 待编辑图像和 4000+ 条指令,设计 16 个评估维度,并通过大量用户研究确保基准与人类感知高度一致。 效果: 为图像编辑模型提供了首个综合评测基准,16 个维度覆盖语义理解和图像质量,分析方法为视频编辑评测提供了可迁移方法论。 批判点评: 优势:16 维度设计全面,人类感知对齐做得好。局限:针对图像编辑而非视频编辑;部分维度(如时序一致性)在图像场景中不存在,迁移到视频需要适配。 3. T2VEval-Bench:构建 T2VEval-Bench 多维度评测基准数据集 T2VEval: Benchmark Dataset and Objective Evaluation Method for T2V-generated Videos | 中国传媒大学 信息与通信工程学院 | arXiv:2501.08545 关键词: 文本生成视频·多维度评测·主观客观融合·中国传媒大学 前序工作问题: 文本生成视频(T2V)模型缺乏统一的多维度评测基准,主观评价和客观评价方法各自存在局限性,无法全面评估生成视频质量。 贡献: 构建 T2VEval-Bench 多维度评测基准数据集,包含 148 个文本提示和 1783 个生成视频;提出 T2VEval 评估模型,从质量、真实感、一致性三个分支进行客观评估,达到 SOTA 人类相关性。 效果: 为文本生成视频提供了大规模评测基准,三分支评估模型可部分迁移到视频编辑评测场景,尤其是一致性评估维度与编辑排他性高度相关。 批判点评: 优势:主观+客观融合评估思路先进,数据集规模较大。局限:针对文本生成视频而非编辑场景;一致性分支主要评估生成稳定性,与编辑场景的源视频保真度存在差异。 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -

AIGC周末专题|2026.04.25|视频编辑评测全景:Reward Model终结CLIP时代 AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 VEFX-Bench 未披露(2026 年 4 月最新工作) 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 2604.16272 2 IVEBench 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 首个专为指令引导视频编辑设计的现代化综合基准 2510.11647 3 FiVE-Bench HKUST / 其他合作机构 首个细粒度物体级视频编辑基准 2503.13684 4 EditReward TIGER-AI Lab (Waterloo) 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 2509.26346 5 VE-Bench 北京大学 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 2408.11481 6 SST-EM 未披露 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 2501.07554 7 VEditBench NUS / Intel / UC Berkeley 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 其余论文速览 1. EditBoard:提出 EditBoard 综合评测基准 EditBoard: Towards A Comprehensive Evaluation Benchmark for Text-Based Video Editing Models | Cornell University / Nanjing University / University of Oxford | arXiv:2409.09668 关键词: 综合评测基准·多维度指标·文本视频编辑 前序工作问题: 当前视频编辑模型评估缺乏全面基准,现有方法仅用单一分数概括性能,无法细致分析模型在不同编辑任务中的表现。 贡献: 提出 EditBoard 综合评测基准,设计 4 个维度 9 个自动评估指标的评估框架,覆盖 4 个任务类别,标准化视频编辑评估流程。 效果: 为视频编辑模型提供了标准化评估工具,能够细致分析模型在不同编辑任务中的表现,推动视频编辑技术的标准化和进一步发展。 批判点评: 优势:填补了视频编辑模型评估基准的空白,多维度评估框架设计合理。局限:数据集规模未明确说明;评估维度未充分考虑时序一致性这一视频特有挑战。 2. I2EBench:构建 I2EBench 基准 I2EBench: A Comprehensive Benchmark for Instruction-based Image Editing | Xiamen University / 鹏城实验室 / 北京大学 | arXiv:2408.14180 关键词: 图像编辑评测·16维度·人类感知对齐·NeurIPS 2024 前序工作问题: 指令驱动的图像编辑(IIE)模型缺乏综合评测基准,现有指标无法全面覆盖高层次语义理解和低层次图像质量。 贡献: 构建 I2EBench 基准,包含 2000+ 待编辑图像和 4000+ 条指令,设计 16 个评估维度,并通过大量用户研究确保基准与人类感知高度一致。 效果: 为图像编辑模型提供了首个综合评测基准,16 个维度覆盖语义理解和图像质量,分析方法为视频编辑评测提供了可迁移方法论。 批判点评: 优势:16 维度设计全面,人类感知对齐做得好。局限:针对图像编辑而非视频编辑;部分维度(如时序一致性)在图像场景中不存在,迁移到视频需要适配。 3. T2VEval-Bench:构建 T2VEval-Bench 多维度评测基准数据集 T2VEval: Benchmark Dataset and Objective Evaluation Method for T2V-generated Videos | 中国传媒大学 信息与通信工程学院 | arXiv:2501.08545 关键词: 文本生成视频·多维度评测·主观客观融合·中国传媒大学 前序工作问题: 文本生成视频(T2V)模型缺乏统一的多维度评测基准,主观评价和客观评价方法各自存在局限性,无法全面评估生成视频质量。 贡献: 构建 T2VEval-Bench 多维度评测基准数据集,包含 148 个文本提示和 1783 个生成视频;提出 T2VEval 评估模型,从质量、真实感、一致性三个分支进行客观评估,达到 SOTA 人类相关性。 效果: 为文本生成视频提供了大规模评测基准,三分支评估模型可部分迁移到视频编辑评测场景,尤其是一致性评估维度与编辑排他性高度相关。 批判点评: 优势:主观+客观融合评估思路先进,数据集规模较大。局限:针对文本生成视频而非编辑场景;一致性分支主要评估生成稳定性,与编辑场景的源视频保真度存在差异。 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC周末专题|2026.04.25|视频编辑评测全景:Reward Model终结CLIP时代 AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 VEFX-Bench 未披露(2026 年 4 月最新工作) 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 2604.16272 2 IVEBench 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 首个专为指令引导视频编辑设计的现代化综合基准 2510.11647 3 FiVE-Bench HKUST / 其他合作机构 首个细粒度物体级视频编辑基准 2503.13684 4 EditReward TIGER-AI Lab (Waterloo) 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 2509.26346 5 VE-Bench 北京大学 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 2408.11481 6 SST-EM 未披露 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 2501.07554 7 VEditBench NUS / Intel / UC Berkeley 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 其余论文速览 1. EditBoard:提出 EditBoard 综合评测基准 EditBoard: Towards A Comprehensive Evaluation Benchmark for Text-Based Video Editing Models | Cornell University / Nanjing University / University of Oxford | arXiv:2409.09668 关键词: 综合评测基准·多维度指标·文本视频编辑 前序工作问题: 当前视频编辑模型评估缺乏全面基准,现有方法仅用单一分数概括性能,无法细致分析模型在不同编辑任务中的表现。 贡献: 提出 EditBoard 综合评测基准,设计 4 个维度 9 个自动评估指标的评估框架,覆盖 4 个任务类别,标准化视频编辑评估流程。 效果: 为视频编辑模型提供了标准化评估工具,能够细致分析模型在不同编辑任务中的表现,推动视频编辑技术的标准化和进一步发展。 批判点评: 优势:填补了视频编辑模型评估基准的空白,多维度评估框架设计合理。局限:数据集规模未明确说明;评估维度未充分考虑时序一致性这一视频特有挑战。 2. I2EBench:构建 I2EBench 基准 I2EBench: A Comprehensive Benchmark for Instruction-based Image Editing | Xiamen University / 鹏城实验室 / 北京大学 | arXiv:2408.14180 关键词: 图像编辑评测·16维度·人类感知对齐·NeurIPS 2024 前序工作问题: 指令驱动的图像编辑(IIE)模型缺乏综合评测基准,现有指标无法全面覆盖高层次语义理解和低层次图像质量。 贡献: 构建 I2EBench 基准,包含 2000+ 待编辑图像和 4000+ 条指令,设计 16 个评估维度,并通过大量用户研究确保基准与人类感知高度一致。 效果: 为图像编辑模型提供了首个综合评测基准,16 个维度覆盖语义理解和图像质量,分析方法为视频编辑评测提供了可迁移方法论。 批判点评: 优势:16 维度设计全面,人类感知对齐做得好。局限:针对图像编辑而非视频编辑;部分维度(如时序一致性)在图像场景中不存在,迁移到视频需要适配。 3. T2VEval-Bench:构建 T2VEval-Bench 多维度评测基准数据集 T2VEval: Benchmark Dataset and Objective Evaluation Method for T2V-generated Videos | 中国传媒大学 信息与通信工程学院 | arXiv:2501.08545 关键词: 文本生成视频·多维度评测·主观客观融合·中国传媒大学 前序工作问题: 文本生成视频(T2V)模型缺乏统一的多维度评测基准,主观评价和客观评价方法各自存在局限性,无法全面评估生成视频质量。 贡献: 构建 T2VEval-Bench 多维度评测基准数据集,包含 148 个文本提示和 1783 个生成视频;提出 T2VEval 评估模型,从质量、真实感、一致性三个分支进行客观评估,达到 SOTA 人类相关性。 效果: 为文本生成视频提供了大规模评测基准,三分支评估模型可部分迁移到视频编辑评测场景,尤其是一致性评估维度与编辑排他性高度相关。 批判点评: 优势:主观+客观融合评估思路先进,数据集规模较大。局限:针对文本生成视频而非编辑场景;一致性分支主要评估生成稳定性,与编辑场景的源视频保真度存在差异。 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -

AIGC周末专题|2026.04.25|视频编辑评测全景:Reward Model三维解耦终结C… AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 VEFX-Bench 未披露(2026 年 4 月最新工作) 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 2604.16272 2 IVEBench 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 首个专为指令引导视频编辑设计的现代化综合基准 2510.11647 3 FiVE-Bench HKUST / 其他合作机构 首个细粒度物体级视频编辑基准 2503.13684 4 EditReward TIGER-AI Lab (Waterloo) 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 2509.26346 5 VE-Bench 北京大学 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 2408.11481 6 SST-EM 未披露 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 2501.07554 7 VEditBench NUS / Intel / UC Berkeley 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC周末专题|2026.04.25|视频编辑评测全景:Reward Model三维解耦终结C… AIGC 周末专题深度解读:视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁 人工智能炼丹君 整理 | 2026年4月25日(周六) 覆盖时间:2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 本期概述 本期 AIGC 周末专题聚焦视频编辑评测方法全景:从传统指标到 Reward Model 的范式跃迁方向,精选 7 篇代表性论文进行深度解读。 方向分布: 评测基准设计 3 篇(VEFX-Bench、IVEBench、VEditBench) 自动评估指标 2 篇(FiVE-Bench、SST-EM) Reward Model 2 篇(EditReward、VEFX-Reward) 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 VEFX-Bench 未披露(2026 年 4 月最新工作) 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 2604.16272 2 IVEBench 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 首个专为指令引导视频编辑设计的现代化综合基准 2510.11647 3 FiVE-Bench HKUST / 其他合作机构 首个细粒度物体级视频编辑基准 2503.13684 4 EditReward TIGER-AI Lab (Waterloo) 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 2509.26346 5 VE-Bench 北京大学 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 2408.11481 6 SST-EM 未披露 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 2501.07554 7 VEditBench NUS / Intel / UC Berkeley 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 1. VEFX-Bench:5049 样本 + 三维解耦标注 + 序数回归 Reward Model——迄今最全面的视频编辑评测体系 论文: VEFX-Bench arXiv: 2604.16272 机构: 未披露(2026 年 4 月最新工作) 1.1 研究动机 核心问题: 视频编辑模型缺乏统一评测标准,不同论文使用不同指标和数据集导致结论不可比 现有评测数据集规模小、缺少编辑输出或人工质量标签,通用 VLM 评审器未针对编辑质量优化,导致无法公正对比不同编辑系统。 前序工作及局限: CLIP-Score (Hessel et al. 2021):图像-文本相似度指标,广泛但粗粒度 LPIPS (Zhang et al. 2018):感知相似度指标,仅衡量像素级差异 FVD (Unterthiner et al. 2019):视频生成质量指标,基于 I3D 特征 VBench (Huang et al. 2024):视频生成综合基准,CVPR 2024,16 维度但不针对编辑 与前序工作的本质区别: 从单一指标到多维度评测框架,从通用视频质量到编辑特异性评估(指令遵循+编辑排他性+渲染质量三维解耦) 1.2 方法原理 数据集:5049 个视频编辑样本,9 大类(相机角度/实例运动/数量/相机运动/属性/创意/实例/视觉特效/风格)32 子类,每个样本由 3 个解耦维度独立标注(4 分制)。Reward Model:基于 Qwen3-VL-Instruct(4B/32B),联合处理原始视频+编辑指令+编辑视频,3 个可学习特殊 token 查询各维度分数,采用序数回归(ordinal regression)而非标量回归,训练时条件二值交叉熵保持有序约束。两阶段训练:Stage 1 冻结预训练权重仅训练 reward head,Stage 2 解冻语言骨干微调。推理时将有序概率转换为 [1,4] 连续分数。 1.3 核心创新 首个同时包含编辑输出+人工标注+多维标签的大规模视频编辑数据集 三维解耦质量标注(指令遵循 IF / 渲染质量 RQ / 编辑排他性 EE) 基于 Qwen3-VL 的序数回归 Reward Model(VEFX-Reward-4B/32B) 对标准化 VEFX-Bench 基准,覆盖 9 大类 32 子类编辑任务 1.4 实验结果 VEFX-Reward-32B SRCC=0.780 远超 EditReward(0.558) 和 VE-Bench(0.214)。配对偏好准确率:IF 93.66%、RQ 91.11%、EE 91.96%。系统评测显示 Kling o3 omni 综合第一(3.057),Runway Gen-4.5 第三(2.912),开源 UniVideo(2.516)可与部分商业系统竞争。所有系统在 IF 维度差异最大,RQ 相对稳定。 1.5 关键洞察 优势:三维解耦设计精准捕捉不同失败模式,序数回归比标量回归更适合有序评分。局限:数据集仅来自少量编辑系统,可能存在偏差;标注者间 IF 完全一致率仅 75.2%,说明指令遵循评估本身存在歧义。 技术演进定位: 2024 下半年 VE-Bench 开创编辑专用 VQA,2025 年 FiVE-Bench/IVEBench/VEditBench 细化任务分类,2026 年 VEFX-Bench 引入 Reward Model 实现自动+人类对齐评估。 可能的后续方向: 多模态 Reward Model(视频+音频+字幕联合评估) 测试时计算缩放(Reward-guided iterative refinement) 跨系统可复现的标准化竞赛平台(类似 ImageNet Challenge) 2. IVEBench:600 视频 + 8 类 35 子类 + MLLM 三维评估协议——指令引导视频编辑的现代基准套件 论文: IVEBench arXiv: 2510.11647 机构: 浙江大学 / 腾讯优图 / 上海交通大学 / 新加坡国立大学 2.1 研究动机 核心问题: 传统手工指标(CLIP/LPIPS/FVD)与人类感知严重偏离 现有视频编辑基准无法支撑指令引导编辑的评估需求:数据来源单一、任务覆盖面窄、评估指标不完整。 前序工作及局限: CLIP-T Score:文本-图像余弦相似度,无法捕捉细粒度编辑差异 PickScore (Kirstain et al. 2023):人类偏好训练的图像质量分数 VideoScore (He et al. 2024):视频生成专用质量评估模型,EMNLP 2024 与前序工作的本质区别: 从手工指标到学习型评估器,从单一分数到多维度解耦评分,从通用质量到编辑专用 2.2 方法原理 数据集构建:600 高质量源视频,覆盖 7 个语义维度和 30 个主题,帧长从 32 到 1024 帧。编辑任务:8 大类(风格/特效/主体/相机角度/主体运动/相机运动/属性/视觉特效)35 子类,通过 LLM 生成+专家审核获取提示对(源/编辑/目标三元组)。评估协议三维度:(1) 视频质量(主体一致性、背景一致性、时间闪烁、运动平滑度、VTSS);(2) 指令遵循(整体/短语语义一致性、指令满足度、数量准确性);(3) 视频保真度(语义/运动/内容保真度)。 2.3 核心创新 首个专为指令引导视频编辑设计的现代化综合基准 高质量视频覆盖 7 语义维度、32-1024 帧长度 大类 35 子类编辑任务分类法 三维评估协议融合传统指标和 MLLM 评估 2.4 实验结果 评测 8 个方法:Ditto 在短视频上总分 0.667 领先,InsV2V 在长视频上 0.657 领先。所有方法的指令遵循维度得分最低(0.25-0.49),视频质量最高(0.69-0.82),说明语义编辑仍是主要瓶颈。VACE 保真度最强(0.826)但指令遵循最弱(0.254)。 2.5 关键洞察 优势:任务覆盖面最广(8 类 35 子类),MLLM + 传统指标双通道评估提升可靠性。局限:评估依赖特定 MLLM(如 Qwen3-VL),模型版本变化可能影响复现性;缺少人工标注的 ground truth 偏好数据。 技术演进定位: EditReward 和 VEFX-Reward 代表 Reward Model 范式在编辑评测中的应用,可能成为未来 RLHF/DPO 后训练的核心组件。 可能的后续方向: 编辑 Reward Model 用于 DPO/RLHF 后训练 在线学习持续更新 Reward Model 多 Reward Model 集成投票机制 3. FiVE-Bench:细粒度视频编辑基准——14 指标 + VLM 成功率 + RF vs 扩散方法系统对比 论文: FiVE-Bench arXiv: 2503.13684 机构: HKUST / 其他合作机构 3.1 研究动机 核心问题: 评测维度设计如何平衡全面性和可操作性 缺乏标准化细粒度基准导致方法间无法公平比较,也无法评估模型对超参数的敏感度。 前序工作及局限: VBench 16 维度:最全面但维度间相关性高,难以解读 VE-Bench 单一分数:操作简便但无法区分失败模式 与前序工作的本质区别: VEFX-Bench 的三维解耦(IF/RQ/EE)是目前最佳平衡点:维度足够区分失败模式(相关性 0.19-0.33),又不至于过多导致标注困难。 3.2 方法原理 数据集:74 真实视频 + 26 生成视频,6 类细粒度编辑(物体替换/添加/删除/属性修改/背景替换/动作修改),420 组源-目标提示对含精确 Mask。评估指标 14 项覆盖 5 维度:(1) 背景保留(PSNR/SSIM/LPIPS);(2) 文本-视频相似度(CLIP-T/PickScore);(3) 时间一致性(Warp Error/CLIP-I);(4) 视频质量(FVD/FID/MUSIQ);(5) 运行时间。新指标 FiVE-Acc 利用 VLM 判定编辑是否成功。FlowEdit 方法:将注入噪声视为 ODE 反向过程,在 RF 模型上无需 DDIM 反转。 3.3 核心创新 首个细粒度物体级视频编辑基准 视频 + 420 编辑对 + 对应 Mask 指标 + 新指标 FiVE-Acc(VLM 评估编辑成功率) 首次系统对比扩散 vs 整流流(RF)编辑方法 提出 FlowEdit 无训练无反转编辑方法 3.4 实验结果 RF 方法(Wan-Edit/Pyramid-Edit)全面优于扩散方法:Wan-Edit 在 FiVE-Acc 上 72.4% vs 最佳扩散方法 51.3%。Wan-Edit 对超参数最不敏感。扩散方法中 SDEdit 背景保留最佳但编辑成功率低,ControlVideo 时间一致性较好。 3.5 关键洞察 优势:Mask 标注使评估更精确,FiVE-Acc 利用 VLM 判定成功率是有意义的创新。局限:100 视频规模偏小;FlowEdit 同时是基准作者提出的方法,存在裁判-运动员角色冲突。 技术演进定位: 三维解耦已成为新的共识范式(IVEBench 的三维评估协议与之高度一致)。 可能的后续方向: 动态维度权重(根据编辑类型自动调整) 用户偏好个性化评估 4. EditReward:200K 人类偏好对 + VLM 奖励模型——指令引导图像/视频编辑的质量裁判 论文: EditReward arXiv: 2509.26346 机构: TIGER-AI Lab (Waterloo) 4.1 研究动机 核心问题: 评测数据集如何兼顾规模、多样性和标注质量 开源编辑模型落后于闭源的核心瓶颈在于缺乏可靠的 Reward Model 来规模化高质量合成训练数据。 前序工作及局限: DAVIS (Caelles et al. 2017):视频分割基准,50 视频,被大量视频编辑论文借用 TGVE (Wu et al. 2023):文本引导视频编辑数据集,规模有限 与前序工作的本质区别: 从几十个视频到数千标注样本,从单一来源到多系统输出收集。 4.2 方法原理 数据集构建:200K+ 偏好对,由训练有素的专家按严格标注协议标注。Reward Model 基于 VLM 架构,输入为编辑指令+源图+编辑图,输出人类偏好对齐的质量分数。下游验证:用 EditReward 从有噪声的 ShareGPT-4o-Image 数据集中筛选高质量子集,在该子集上训练 Step1X-Edit 显著优于在完整数据集上的训练效果。 4.3 核心创新 首个大规模人类偏好数据集 EditReward-Data(200K+ 偏好对) 基于 VLM 的专用编辑质量 Reward Model 在 GenAI-Bench、AURORA-Bench、ImagenHub 等基准上 SOTA 人类相关性 验证 Reward Model 可作为数据筛选器提升下游模型训练 4.4 实验结果 在 GenAI-Bench、AURORA-Bench、ImagenHub 和自建 EditReward-Bench 上均达到 SOTA 人类相关性,全面超越 VLM-as-judge 基线(包括 GPT-4o 评审)。Step1X-Edit 在筛选子集上训练后编辑质量显著提升。 4.5 关键洞察 优势:规模最大的专家标注偏好数据集,验证了 Reward Model 作为数据筛选器的实用价值(闭环验证)。局限:主要聚焦图像编辑,视频编辑的适用性需进一步验证;VEFX-Bench 的对比显示其在 RQ 维度相关性为负值(-0.211),暴露图-视频 domain gap。 技术演进定位: VEFX-Dataset(5049 样本)和 EditReward-Data(200K 偏好对)代表当前规模的上限。 可能的后续方向: 众包+AI 混合标注扩大规模 持续更新的活跃基准(每季度纳入新系统) 合成数据增强标注多样性 5. VE-Bench:首个视频编辑质量评估数据集 + 主观对齐的自动评估网络 论文: VE-Bench arXiv: 2408.11481 机构: 北京大学 5.1 研究动机 核心问题: VLM-as-Judge 范式的可靠性和一致性 传统 VQA 方法只关注画面质量,忽略编辑特有的文本对齐和源视频关联性,导致评估结果与人类感知严重偏离。 前序工作及局限: GPT-4V/GPT-4o 评审:零样本评估,成本高且不稳定 LLaVA-Critic (Sun et al. 2024):开源 VLM 评审器 与前序工作的本质区别: 从通用 VLM 零样本评审到编辑专用微调 Reward Model,人类相关性大幅提升。 5.2 方法原理 VE-Bench DB:收集多样化源视频(不同运动模式和主题),为每个视频设计多种编辑提示,收集 8 个模型的编辑输出,24 名标注者给出 MOS(Mean Opinion Score)。VE-Bench QA 评估网络:在传统 VQA 的美学/失真维度之上,新增文本-视频对齐建模和源-编辑视频关联建模两个分支,输出综合质量分数。编辑任务覆盖 3 类:风格编辑、语义编辑、结构编辑。 5.3 核心创新 首个专为视频编辑设计的 VQA 数据集(VE-Bench DB) 个编辑模型结果 + 24 名标注者 MOS 评分 主观对齐的视频编辑评估网络 VE-Bench QA 同时建模文本-视频对齐和源-编辑视频关联 5.4 实验结果 VE-Bench QA 在与人类偏好的对齐性上显著优于 CLIP-Score、LPIPS、FVD 等传统指标,以及通用 VQA 模型。但在 VEFX-Bench 后续对比中,VE-Bench 单维度设计(SRCC=0.214)明显落后于多维度方法。 5.5 关键洞察 优势:首个视频编辑专用 VQA 数据集,为后续研究奠定了基础。局限:单一综合分数无法区分不同失败模式(如指令遵循好但渲染差);8 个模型均为 SD 系列(2024 年),缺乏最新系统评测。 技术演进定位: VEFX-Reward 证明专用 Reward Model > 通用 VLM Judge > 传统手工指标。 可能的后续方向: 轻量化蒸馏(4B→1B 保持性能) 多 VLM 集成降低偏差 对抗样本鲁棒性评估 6. SST-EM:语义-空间-时序三维评估框架——VLM + 目标检测 + ViT 组合式视频编辑评测 论文: SST-EM arXiv: 2501.07554 机构: 未披露 6.1 研究动机 核心问题: 编辑任务分类法如何标准化 CLIP 文本分数受训练数据和层级依赖限制,图像分数无法评估时间一致性,需要一个同时覆盖语义、空间和时间维度的综合指标。 前序工作及局限: InstructPix2Pix 3 类:风格/对象/背景,过于粗糙 TGVE 4 类:风格/语义/结构/混合 与前序工作的本质区别: IVEBench 8 类 35 子类和 VEFX-Bench 9 类 32 子类代表当前最细化的分类。 6.2 方法原理 四组件管线:(1) VLM 提取每帧语义信息;(2) 目标检测追踪主要物体位置;(3) LLM Agent 精炼物体识别和上下文理解;(4) ViT 评估帧间时间一致性。统一指标权重通过人类评估数据 + 回归分析标定。最终输出语义保真度和时间平滑度的综合分数。 6.3 核心创新 首个组合 VLM + 目标检测 + ViT 的视频编辑评估框架 四阶段管线:语义提取→目标跟踪→LLM 精炼→时间一致性评估 人类评估回归权重标定 超越 CLIP 文本/图像分数的多维评估 6.4 实验结果 在多个视频编辑场景下,SST-EM 与人类评估的相关性显著优于 CLIP-T、CLIP-I 等传统指标,尤其在时间一致性评估上优势明显。代码已开源。 6.5 关键洞察 优势:管线式设计模块化程度高,每个组件可独立替换升级。局限:四阶段串行推理速度慢;依赖多个外部模型(VLM + 检测器 + LLM + ViT),部署成本高;权重标定依赖特定人类评估数据集,泛化性存疑。 技术演进定位: 分类法正在趋向收敛:相机控制、实例操作、属性修改、风格变换、视觉特效已成为公认的核心类别。 可能的后续方向: 统一编辑 ontology 标准 按难度分层的自适应评测 7. VEditBench:420 视频 + 6 编辑任务 + 9 评估维度——文本引导视频编辑的整体基准 论文: VEditBench arXiv: []() 机构: NUS / Intel / UC Berkeley 7.1 研究动机 核心问题: 长视频编辑的评测挑战 缺乏一个在通用视频编辑框架下同时覆盖多种编辑任务和时长范围的标准化基准。 前序工作及局限: VEditBench 短+长:首次覆盖 10-20s 长视频 IVEBench 32-1024 帧:覆盖最大帧数范围 与前序工作的本质区别: 发现长视频编辑性能普遍下降 5-15%,但现有指标未充分捕捉时序退化模式。 7.2 方法原理 数据集:420 真实视频(300 短 2-4s + 120 长 10-20s),覆盖多种场景和内容类别。任务设计 6 类:物体插入、物体删除、物体替换、场景替换、运动变化、风格转换。评估 9 维度覆盖:语义对齐(编辑语义/原始语义)、视觉质量(美学/失真/时间一致性)、额外维度(编辑精度/背景保留等)。 7.3 核心创新 真实世界视频覆盖短(2-4s)和长(10-20s)两种时长 种核心编辑任务分类(插入/删除/替换/场景/运动/风格) 维度评估全面覆盖语义保真度和视觉质量 个 SOTA 方法系统对比 7.4 实验结果 评测 10 个方法,发现长视频编辑性能普遍下降 5-15%;物体插入和运动变化是最困难的任务;风格转换相对容易。所有方法在语义对齐上差异较大,但视觉质量差异较小——与后续 VEFX-Bench 结论一致。 7.5 关键洞察 优势:短+长视频双覆盖设计实用,6 类任务分类简洁清晰。局限:420 视频规模中等;评估维度未明确区分编辑特有 vs 通用画质指标;缺少人工标注偏好数据。 技术演进定位: 长视频评测仍是开放挑战,需要新的时间维度指标。 可能的后续方向: 分段评估+全局一致性联合指标 时间维度上的退化曲线分析 横向对比与技术脉络总结 7 大视频编辑评测方法横向对比 论文 发表 数据规模 评测维度 自动指标类型 人工标注 任务分类 核心创新 VEFX-Bench 2026.04 5049 样本 3 维解耦 Reward Model 三维 4 分制 9 类 32 子类 序数回归 RM IVEBench ICLR 2026 600 视频 3 维评估 传统+MLLM 无 8 类 35 子类 MLLM 融合 FiVE-Bench ICCV 2025 100 视频 5 维 14 指标 传统+VLM 无 6 类 FiVE-Acc EditReward ICLR 2026 200K 偏好对 综合 Reward Model 专家偏好 通用 200K 数据 VE-Bench AAAI 2025 ~170 视频 综合 评估网络 MOS 24人 3 类 首个 VQA SST-EM WACV 2025 - 3 维管线 VLM+检测+ViT 权重标定 - 组合式评估 VEditBench ICLR 2025 420 视频 9 维 传统 无 6 类 短+长视频 核心技术趋势 三维解耦评测成为共识 IF(指令遵循)/ RQ(渲染质量)/ EE(编辑排他性)三维独立评估已成为 VEFX-Bench 和 IVEBench 的共同设计,正在取代单一综合分数。 Reward Model 取代手工指标 从 CLIP-Score/LPIPS/FVD 到学习型 Reward Model(VEFX-Reward/EditReward),评测精度大幅提升,且可直接用于下游 RLHF/DPO 训练。 MLLM 深度融入评测管线 IVEBench 和 SST-EM 将 MLLM 评估融入标准管线,FiVE-Acc 用 VLM 判定编辑成功率。但 MLLM 版本变化导致的结果漂移是待解决的风险。 评测任务分类趋向精细化 从 3-4 类到 8-9 大类 32-35 子类,相机控制、实例操作、属性修改、风格变换、视觉特效成为公认核心类别。 长视频评测成为开放挑战 VEditBench 首次发现长视频编辑性能下降 5-15%,但现有指标未充分捕捉时序退化模式,需要新的时间维度评估方法。 人工智能炼丹君 整理 | 数据来源:arXiv 2024年8月 — 2026年4月(涵盖 AAAI/WACV/ICLR/ICCV 2025-2026 评测基准爆发期) 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -

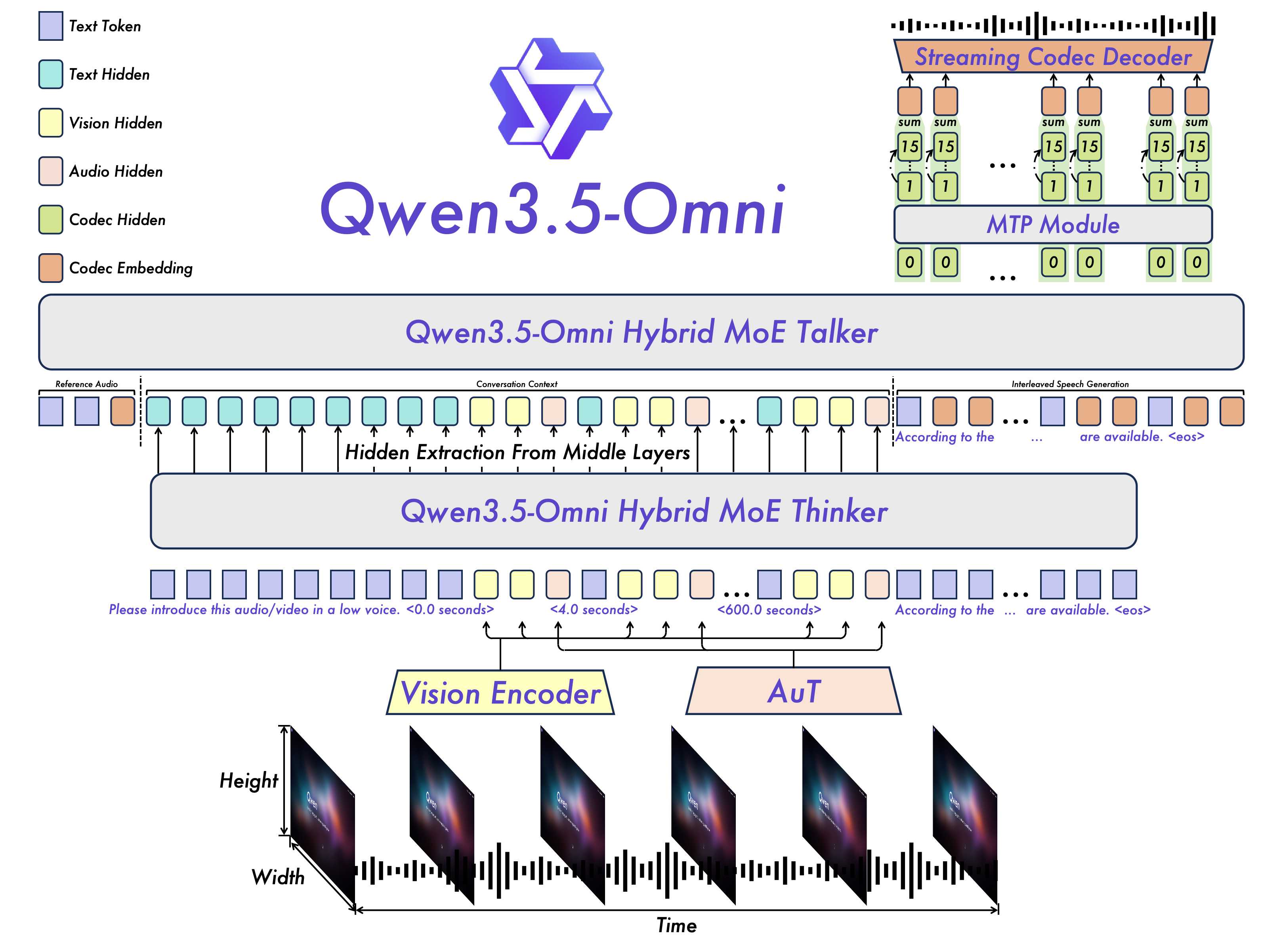

AIGC 每日速读|2026-04-24|Wan-Image 今日核心看点 阿里 Wan-Image 统一视觉生成 Google Vision Banana 生成即理解 LLaDA2.0 离散扩散统一多模态 DynamicRad 视频扩散 2.5x 加速 字节 MMCORE 轻量统一框架 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇。 方向分布: 生成理解一体化 — 3 篇(LLaDA2.0-Uni、Vision Banana、MMCORE) 图像生成与编辑 — 4 篇(万象图像系统、编辑定位、扩散幻觉检测、空间智能基准) 视频生成 — 1 篇(长视频稀疏注意力加速) 音频与语音 — 1 篇(流式目标说话人提取) 生成模型训练与优化 — 1 篇(半监督流匹配遥感融合) 涵盖 arXiv 最新 127 篇候选中精选 今日论文速览 1. Wan-Image:提出 Wan-Image 统一视觉生成系统 Wan-Image: Pushing the Boundaries of Generative Visual Intelligence | Alibaba Group (Tongyi Lab) | arXiv:2604.19858 关键词: 统一视觉生成·文字渲染·多主体保持·4K合成 前序工作问题: 当前扩散模型在专业设计场景中缺乏绝对可控性,尤其在复杂排版渲染、多主体身份保持和精细交互编辑方面力不从心 贡献: 提出 Wan-Image 统一视觉生成系统,融合 LLM 认知能力与 DiT 像素合成,通过大规模多模态数据扩展和强化学习训练,解锁超长文本渲染、调色板引导、多主体保持、原生 Alpha 通道等专业功能 效果: 在多项人类评估中超越 Seedream 5.0 Lite 和 GPT Image 1.5,在高难度任务中与 Nano Banana Pro 持平,支持原生 4K 高效合成 批判点评: 模型参数量和训练成本未公开,「专业级生产力工具」的定位缺少与 Adobe Firefly 等商业工具的定量用户研究;多主体保持在相似外观角色间的区分能力未充分测试 2. LLaDA2.0-Uni:提出基于离散扩散的统一大语言模型 LLaDA2.0-Uni LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model | Inclusion AI, Westlake University, Zhejiang University | arXiv:2604.20796 关键词: 离散扩散LLM·多模态统一·MoE·交错生成 前序工作问题: 现有多模态模型难以在统一框架内同时实现高质量的视觉理解和图像生成,自回归与扩散范式各有局限 贡献: 提出基于离散扩散的统一大语言模型 LLaDA2.0-Uni,结合语义离散分词器 SigLIP-VQ、MoE 主干和扩散解码器,支持块级掩码扩散同时处理文本和视觉输入,并通过前缀感知优化和少步蒸馏提速 效果: 在多模态理解上匹配专用 VLM 水平,图像生成和编辑表现出色,原生支持交错生成和推理,代码和模型已开源 批判点评: 离散扩散 LLM 的并行解码虽然快但牺牲了自回归模型的逐步纠错能力;SigLIP-VQ 的量化损失对精细纹理和小物体的影响需要更多消融实验 3. Vision Banana:证明图像生成预训练可以学到强大通用视觉表征 Image Generators are Generalist Vision Learners | Google DeepMind | arXiv:2604.20329 关键词: 生成预训练·视觉理解·统一模型·指令微调 前序工作问题: 图像生成模型是否真正学会了视觉理解一直缺乏有力证据,生成与理解的关系尚不明确 贡献: 证明图像生成预训练可以学到强大通用视觉表征,通过将视觉任务输出参数化为 RGB 图像实现感知即生成,在 Nano Banana Pro 基础上指令微调得到 Vision Banana 通才模型 效果: 在分割(超越 SAM3)、深度估计(超越 Depth Anything)等 2D 和 3D 视觉任务上达到 SOTA,且不牺牲图像生成能力 批判点评: 将所有视觉任务输出编码为 RGB 图像是一种巧妙但有局限的参数化方式,对检测框回归等需要精确数值的任务可能力不从心;实验依赖 Nano Banana Pro 这一未开源的强基座,可复现性受限 4. MMCORE:提出 MMCORE 轻量统一框架 MMCORE: MultiModal COnnection with Representation Aligned Latent Embeddings | ByteDance | arXiv:2604.19902 关键词: 多模态统一·VLM引导·轻量连接·表征对齐 前序工作问题: 现有统一多模态生成模型要么需要从头训练自回归+扩散深度融合架构,要么计算成本极高 贡献: 提出 MMCORE 轻量统一框架,利用预训练 VLM 通过可学习查询 token 预测语义视觉嵌入,再作为扩散模型的条件信号,无需深度融合或从头训练即可将 VLM 的理解推理能力迁移至视觉生成 效果: 在文生图、交错图像生成和单/多图编辑基准上全面超越 SOTA 基线,空间推理和视觉定位等复杂场景表现突出 批判点评: 「轻量连接」本质上限制了 VLM 与扩散模型之间的信息传递带宽,对需要精细像素级控制的任务(如 inpainting 边界)可能成为瓶颈;多图编辑的一致性在长序列交错场景下未充分验证 5. DynamicRad:提出 DynamicRad 统一稀疏注意力范式 DynamicRad: Content-Adaptive Sparse Attention for Long Video Diffusion | UESTC, Michigan State University | arXiv:2604.20470 关键词: 视频扩散加速·稀疏注意力·贝叶斯优化·自适应 前序工作问题: 视频扩散模型的全注意力计算随序列长度二次增长,静态稀疏掩码在复杂动态场景中丢失关键长程信息 贡献: 提出 DynamicRad 统一稀疏注意力范式,基于径向局部性先验实现自适应稀疏选择,双模式策略(静态比率+动态阈值)配合离线贝叶斯优化和语义运动路由器,零运行时开销实现内容自适应 效果: 在 HunyuanVideo 和 Wan2.1-14B 上实现 1.7-2.5 倍推理加速,有效稀疏度超 80%,动态模式在部分长序列设置中甚至匹配或超越全注意力基线 批判点评: 离线贝叶斯优化虽避免了在线开销,但优化的超参可能对分布外视频内容泛化不佳;语义运动路由器仅依赖 prompt 嵌入,忽略了视觉内容本身的复杂度信号 6. TAL-Edit:提出无需训练的任务感知编辑定位框架 Rethinking Where to Edit: Task-Aware Localization for Instruction-Based Image Editing | University of Sydney | arXiv:2604.20258 关键词: 图像编辑·任务感知·编辑定位·无需训练 前序工作问题: 指令驱动的图像编辑模型缺乏显式编辑定位机制,不同编辑操作(添加、移除、替换)的空间模式差异被忽略,导致频繁过度编辑 贡献: 提出无需训练的任务感知编辑定位框架,利用 IIE 模型内在的源图和目标图双流注意力构建编辑线索和特征质心,将 token 划分为编辑区和非编辑区,并按任务类型选择性融合双流信息 效果: 在 EdiVal-Bench 上持续提升非编辑区域一致性,同时保持强指令跟随性能,可即插即用于多种强图像编辑骨干 批判点评: 无需训练的优势以牺牲精度为代价,注意力图质心分割在精细边界处可能不够准确;任务类型的自动识别依赖启发式规则,对模糊指令(如「让这张图更好看」)的任务分类可能出错 7. HEaD+:提出 HEaD+ 幻觉早期检测框架 Hallucination Early Detection in Diffusion Models | University of Modena, University of Trento | arXiv:2604.20354 关键词: 扩散幻觉·早期检测·跨注意力·种子筛选 前序工作问题: 扩散模型在多物体生成时频繁出现物体遗漏幻觉,现有方法聚焦于优化潜空间,忽略了初始种子的决定性影响 贡献: 提出 HEaD+ 幻觉早期检测框架,融合跨注意力图、文本信息和预测最终图像三重信号,在去噪早期阶段判断当前种子是否会产生完整生成,决定是否切换种子重启 效果: 4 个物体场景下完整生成成功率提升 6-8%,生成时间最多减少 32%,在 45K 图像的 InsideGen 数据集上训练和验证 批判点评: 6-8% 的成功率提升幅度有限,随着物体数量增加效果可能递减;早期检测阈值的选择依赖经验调参,缺乏自适应机制;与 Attend-and-Excite 等注意力引导方法的组合效果未探索 8. CISAR:提出首个面向流式场景的自回归目标说话人提取模型 Towards Streaming Target Speaker Extraction via Chunk-wise Interleaved Splicing of Autoregressive Language Model | Tencent AI Lab, Tsinghua University | arXiv:2604.19635 关键词: 流式语音·目标说话人·自回归·块间拼接 前序工作问题: 生成式目标说话人提取模型依赖全局上下文,直接适配流式场景会导致灾难性推理性能退化 贡献: 提出首个面向流式场景的自回归目标说话人提取模型,核心创新为块间交错拼接范式(CISAR),配合历史上下文精炼机制消除边界不连续性 效果: 在 Libri2Mix 上保持 100% 推理稳定性和优越可懂度,流式结果媲美甚至超越离线基线,消费级 GPU 上 RTF 仅 0.248 批判点评: Libri2Mix 是干净的朗读语音混合数据集,在噪声环境和远场麦克风等真实场景下的表现需要验证;块大小的选择对延迟-质量的权衡影响未充分分析 9. SSFM-Fusion:提出半监督流匹配框架 Semi-Supervised Flow Matching for Mosaiced and Panchromatic Fusion Imaging | Harbin Institute of Technology (Shenzhen) | arXiv:2604.20128 关键词: 流匹配·半监督·图像融合·高光谱 前序工作问题: 低分辨率马赛克高光谱图像与高分辨率全色图像的融合是严重病态问题,现有扩散方法受限于特定协议和人工假设 贡献: 提出半监督流匹配框架,将无监督先验网络与条件流匹配模型两阶段结合,引入随机投票机制迭代精炼和无冲突梯度引导策略,实现光谱和空间一致的高分辨率重建 效果: 在多个基准数据集上大幅超越代表性基线方法,生成质量和效率显著提升 批判点评: 遥感融合是相对小众的应用场景,流匹配在此领域的优势相比传统方法的边际增益需要实际部署验证;两阶段训练管线增加了工程复杂度 10. GSI-Bench:提出首个生成式空间智能基准 GSI-Bench Exploring Spatial Intelligence from a Generative Perspective | Zhejiang University | arXiv:2604.20570 关键词: 空间智能·生成式评测·3D约束·图像编辑 前序工作问题: 现有多模态模型基准仅从理解角度评估空间智能,忽略了生成模型在 3D 空间约束下的图像生成能力 贡献: 提出首个生成式空间智能基准 GSI-Bench,包含真实数据集 GSI-Real(3D 先验引导过滤)和合成数据集 GSI-Syn(可控空间操作+自动标注),统一评估空间合规性和编辑保真度 效果: 在 GSI-Syn 上微调统一多模态模型后,合成和真实任务均显著提升,且首次证明生成式训练能增强空间理解能力 批判点评: GSI-Syn 的合成数据与真实场景仍存在域差距,微调增益能否泛化到 GSI-Real 之外的开放场景未充分验证;评估协议的「空间合规性」指标定义偏简化,难以覆盖复杂多物体遮挡场景 趋势观察 生成与理解的统一正在加速 — LLaDA2.0-Uni、Vision Banana、MMCORE 三篇论文从不同路径(离散扩散、生成预训练、轻量连接)推进生成-理解统一,「生成即理解」成为新共识 视觉生成从「能用」走向「专业级」 — Wan-Image 瞄准专业设计场景(文字渲染、4K 合成、Alpha 通道),标志着生成模型从展示性 demo 向生产力工具转型 视频扩散推理加速的新范式 — DynamicRad 用自适应稀疏注意力在 HunyuanVideo 上实现 2.5x 加速且不损质量,离线 BO+语义路由的思路值得关注 图像编辑的精细化控制 — TAL-Edit 从任务感知定位角度推动编辑精度提升,HEaD+ 从幻觉检测角度减少多物体遗漏,GSI-Bench 建立生成式空间智能评测基准 流式音频生成的突破 — CISAR 首次将自回归生成模型应用于流式目标说话人提取,证明 AR 骨干在低延迟场景的可行性 人工智能炼丹君 整理 | 2026-04-24 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC 每日速读|2026-04-24|Wan-Image 今日核心看点 阿里 Wan-Image 统一视觉生成 Google Vision Banana 生成即理解 LLaDA2.0 离散扩散统一多模态 DynamicRad 视频扩散 2.5x 加速 字节 MMCORE 轻量统一框架 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇。 方向分布: 生成理解一体化 — 3 篇(LLaDA2.0-Uni、Vision Banana、MMCORE) 图像生成与编辑 — 4 篇(万象图像系统、编辑定位、扩散幻觉检测、空间智能基准) 视频生成 — 1 篇(长视频稀疏注意力加速) 音频与语音 — 1 篇(流式目标说话人提取) 生成模型训练与优化 — 1 篇(半监督流匹配遥感融合) 涵盖 arXiv 最新 127 篇候选中精选 今日论文速览 1. Wan-Image:提出 Wan-Image 统一视觉生成系统 Wan-Image: Pushing the Boundaries of Generative Visual Intelligence | Alibaba Group (Tongyi Lab) | arXiv:2604.19858 关键词: 统一视觉生成·文字渲染·多主体保持·4K合成 前序工作问题: 当前扩散模型在专业设计场景中缺乏绝对可控性,尤其在复杂排版渲染、多主体身份保持和精细交互编辑方面力不从心 贡献: 提出 Wan-Image 统一视觉生成系统,融合 LLM 认知能力与 DiT 像素合成,通过大规模多模态数据扩展和强化学习训练,解锁超长文本渲染、调色板引导、多主体保持、原生 Alpha 通道等专业功能 效果: 在多项人类评估中超越 Seedream 5.0 Lite 和 GPT Image 1.5,在高难度任务中与 Nano Banana Pro 持平,支持原生 4K 高效合成 批判点评: 模型参数量和训练成本未公开,「专业级生产力工具」的定位缺少与 Adobe Firefly 等商业工具的定量用户研究;多主体保持在相似外观角色间的区分能力未充分测试 2. LLaDA2.0-Uni:提出基于离散扩散的统一大语言模型 LLaDA2.0-Uni LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model | Inclusion AI, Westlake University, Zhejiang University | arXiv:2604.20796 关键词: 离散扩散LLM·多模态统一·MoE·交错生成 前序工作问题: 现有多模态模型难以在统一框架内同时实现高质量的视觉理解和图像生成,自回归与扩散范式各有局限 贡献: 提出基于离散扩散的统一大语言模型 LLaDA2.0-Uni,结合语义离散分词器 SigLIP-VQ、MoE 主干和扩散解码器,支持块级掩码扩散同时处理文本和视觉输入,并通过前缀感知优化和少步蒸馏提速 效果: 在多模态理解上匹配专用 VLM 水平,图像生成和编辑表现出色,原生支持交错生成和推理,代码和模型已开源 批判点评: 离散扩散 LLM 的并行解码虽然快但牺牲了自回归模型的逐步纠错能力;SigLIP-VQ 的量化损失对精细纹理和小物体的影响需要更多消融实验 3. Vision Banana:证明图像生成预训练可以学到强大通用视觉表征 Image Generators are Generalist Vision Learners | Google DeepMind | arXiv:2604.20329 关键词: 生成预训练·视觉理解·统一模型·指令微调 前序工作问题: 图像生成模型是否真正学会了视觉理解一直缺乏有力证据,生成与理解的关系尚不明确 贡献: 证明图像生成预训练可以学到强大通用视觉表征,通过将视觉任务输出参数化为 RGB 图像实现感知即生成,在 Nano Banana Pro 基础上指令微调得到 Vision Banana 通才模型 效果: 在分割(超越 SAM3)、深度估计(超越 Depth Anything)等 2D 和 3D 视觉任务上达到 SOTA,且不牺牲图像生成能力 批判点评: 将所有视觉任务输出编码为 RGB 图像是一种巧妙但有局限的参数化方式,对检测框回归等需要精确数值的任务可能力不从心;实验依赖 Nano Banana Pro 这一未开源的强基座,可复现性受限 4. MMCORE:提出 MMCORE 轻量统一框架 MMCORE: MultiModal COnnection with Representation Aligned Latent Embeddings | ByteDance | arXiv:2604.19902 关键词: 多模态统一·VLM引导·轻量连接·表征对齐 前序工作问题: 现有统一多模态生成模型要么需要从头训练自回归+扩散深度融合架构,要么计算成本极高 贡献: 提出 MMCORE 轻量统一框架,利用预训练 VLM 通过可学习查询 token 预测语义视觉嵌入,再作为扩散模型的条件信号,无需深度融合或从头训练即可将 VLM 的理解推理能力迁移至视觉生成 效果: 在文生图、交错图像生成和单/多图编辑基准上全面超越 SOTA 基线,空间推理和视觉定位等复杂场景表现突出 批判点评: 「轻量连接」本质上限制了 VLM 与扩散模型之间的信息传递带宽,对需要精细像素级控制的任务(如 inpainting 边界)可能成为瓶颈;多图编辑的一致性在长序列交错场景下未充分验证 5. DynamicRad:提出 DynamicRad 统一稀疏注意力范式 DynamicRad: Content-Adaptive Sparse Attention for Long Video Diffusion | UESTC, Michigan State University | arXiv:2604.20470 关键词: 视频扩散加速·稀疏注意力·贝叶斯优化·自适应 前序工作问题: 视频扩散模型的全注意力计算随序列长度二次增长,静态稀疏掩码在复杂动态场景中丢失关键长程信息 贡献: 提出 DynamicRad 统一稀疏注意力范式,基于径向局部性先验实现自适应稀疏选择,双模式策略(静态比率+动态阈值)配合离线贝叶斯优化和语义运动路由器,零运行时开销实现内容自适应 效果: 在 HunyuanVideo 和 Wan2.1-14B 上实现 1.7-2.5 倍推理加速,有效稀疏度超 80%,动态模式在部分长序列设置中甚至匹配或超越全注意力基线 批判点评: 离线贝叶斯优化虽避免了在线开销,但优化的超参可能对分布外视频内容泛化不佳;语义运动路由器仅依赖 prompt 嵌入,忽略了视觉内容本身的复杂度信号 6. TAL-Edit:提出无需训练的任务感知编辑定位框架 Rethinking Where to Edit: Task-Aware Localization for Instruction-Based Image Editing | University of Sydney | arXiv:2604.20258 关键词: 图像编辑·任务感知·编辑定位·无需训练 前序工作问题: 指令驱动的图像编辑模型缺乏显式编辑定位机制,不同编辑操作(添加、移除、替换)的空间模式差异被忽略,导致频繁过度编辑 贡献: 提出无需训练的任务感知编辑定位框架,利用 IIE 模型内在的源图和目标图双流注意力构建编辑线索和特征质心,将 token 划分为编辑区和非编辑区,并按任务类型选择性融合双流信息 效果: 在 EdiVal-Bench 上持续提升非编辑区域一致性,同时保持强指令跟随性能,可即插即用于多种强图像编辑骨干 批判点评: 无需训练的优势以牺牲精度为代价,注意力图质心分割在精细边界处可能不够准确;任务类型的自动识别依赖启发式规则,对模糊指令(如「让这张图更好看」)的任务分类可能出错 7. HEaD+:提出 HEaD+ 幻觉早期检测框架 Hallucination Early Detection in Diffusion Models | University of Modena, University of Trento | arXiv:2604.20354 关键词: 扩散幻觉·早期检测·跨注意力·种子筛选 前序工作问题: 扩散模型在多物体生成时频繁出现物体遗漏幻觉,现有方法聚焦于优化潜空间,忽略了初始种子的决定性影响 贡献: 提出 HEaD+ 幻觉早期检测框架,融合跨注意力图、文本信息和预测最终图像三重信号,在去噪早期阶段判断当前种子是否会产生完整生成,决定是否切换种子重启 效果: 4 个物体场景下完整生成成功率提升 6-8%,生成时间最多减少 32%,在 45K 图像的 InsideGen 数据集上训练和验证 批判点评: 6-8% 的成功率提升幅度有限,随着物体数量增加效果可能递减;早期检测阈值的选择依赖经验调参,缺乏自适应机制;与 Attend-and-Excite 等注意力引导方法的组合效果未探索 8. CISAR:提出首个面向流式场景的自回归目标说话人提取模型 Towards Streaming Target Speaker Extraction via Chunk-wise Interleaved Splicing of Autoregressive Language Model | Tencent AI Lab, Tsinghua University | arXiv:2604.19635 关键词: 流式语音·目标说话人·自回归·块间拼接 前序工作问题: 生成式目标说话人提取模型依赖全局上下文,直接适配流式场景会导致灾难性推理性能退化 贡献: 提出首个面向流式场景的自回归目标说话人提取模型,核心创新为块间交错拼接范式(CISAR),配合历史上下文精炼机制消除边界不连续性 效果: 在 Libri2Mix 上保持 100% 推理稳定性和优越可懂度,流式结果媲美甚至超越离线基线,消费级 GPU 上 RTF 仅 0.248 批判点评: Libri2Mix 是干净的朗读语音混合数据集,在噪声环境和远场麦克风等真实场景下的表现需要验证;块大小的选择对延迟-质量的权衡影响未充分分析 9. SSFM-Fusion:提出半监督流匹配框架 Semi-Supervised Flow Matching for Mosaiced and Panchromatic Fusion Imaging | Harbin Institute of Technology (Shenzhen) | arXiv:2604.20128 关键词: 流匹配·半监督·图像融合·高光谱 前序工作问题: 低分辨率马赛克高光谱图像与高分辨率全色图像的融合是严重病态问题,现有扩散方法受限于特定协议和人工假设 贡献: 提出半监督流匹配框架,将无监督先验网络与条件流匹配模型两阶段结合,引入随机投票机制迭代精炼和无冲突梯度引导策略,实现光谱和空间一致的高分辨率重建 效果: 在多个基准数据集上大幅超越代表性基线方法,生成质量和效率显著提升 批判点评: 遥感融合是相对小众的应用场景,流匹配在此领域的优势相比传统方法的边际增益需要实际部署验证;两阶段训练管线增加了工程复杂度 10. GSI-Bench:提出首个生成式空间智能基准 GSI-Bench Exploring Spatial Intelligence from a Generative Perspective | Zhejiang University | arXiv:2604.20570 关键词: 空间智能·生成式评测·3D约束·图像编辑 前序工作问题: 现有多模态模型基准仅从理解角度评估空间智能,忽略了生成模型在 3D 空间约束下的图像生成能力 贡献: 提出首个生成式空间智能基准 GSI-Bench,包含真实数据集 GSI-Real(3D 先验引导过滤)和合成数据集 GSI-Syn(可控空间操作+自动标注),统一评估空间合规性和编辑保真度 效果: 在 GSI-Syn 上微调统一多模态模型后,合成和真实任务均显著提升,且首次证明生成式训练能增强空间理解能力 批判点评: GSI-Syn 的合成数据与真实场景仍存在域差距,微调增益能否泛化到 GSI-Real 之外的开放场景未充分验证;评估协议的「空间合规性」指标定义偏简化,难以覆盖复杂多物体遮挡场景 趋势观察 生成与理解的统一正在加速 — LLaDA2.0-Uni、Vision Banana、MMCORE 三篇论文从不同路径(离散扩散、生成预训练、轻量连接)推进生成-理解统一,「生成即理解」成为新共识 视觉生成从「能用」走向「专业级」 — Wan-Image 瞄准专业设计场景(文字渲染、4K 合成、Alpha 通道),标志着生成模型从展示性 demo 向生产力工具转型 视频扩散推理加速的新范式 — DynamicRad 用自适应稀疏注意力在 HunyuanVideo 上实现 2.5x 加速且不损质量,离线 BO+语义路由的思路值得关注 图像编辑的精细化控制 — TAL-Edit 从任务感知定位角度推动编辑精度提升,HEaD+ 从幻觉检测角度减少多物体遗漏,GSI-Bench 建立生成式空间智能评测基准 流式音频生成的突破 — CISAR 首次将自回归生成模型应用于流式目标说话人提取,证明 AR 骨干在低延迟场景的可行性 人工智能炼丹君 整理 | 2026-04-24 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -