AIGC 每日速读|2026-04-06|

AIGC 视觉生成领域 · 每日论文解读 (2026-04-06)

人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇

今日核心看点

- VOID: 因果视频编辑

- 反事实推理

- 物理一致性

- 免训练图像编辑

- 统一模型

- TTS进展

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。

方向分布:

- 视频生成与编辑: 4 篇 (VOID, DynaVid, ActionParty, BidirInterp)

- 图像生成与编辑: 3 篇 (SteerFlow, FlowSlider, ReflectGen)

- 统一/多模态模型: 1 篇 (LatentUM)

- 音频/语音合成: 1 篇 (PFluxTTS)

- 评测方法: 1 篇 (CLPIPS)

顶会收录: CVPR 2026 (DynaVid)

重点论文深度解读

1. VOID

因果推理驱动的视频对象与交互删除:物理一致性视频编辑新范式 | Netflix, INSAIT (Sofia University) | arXiv:2604.02296

关键词: 视频编辑, 对象删除, 因果推理, 物理一致性, 反事实生成

研究动机

核心问题: 视频对象移除后如何保持物理一致性?现有方法只能修复外观伪影,无法重写因果交互。

现有视频对象移除方法只能修复外观层面的伪影(如阴影和反射),当被移除对象与场景存在物理交互(如碰撞、支撑)时,无法推理并重写下游物理动态,导致结果不合物理常识。VOID 提出用因果推理指导视频扩散模型,在对象移除后生成物理一致的反事实场景。

前序工作及局限:

- ProPainter (2023):基于光流传播的视频修复,擅长空间填充但无物理推理能力

- Generative Omnimatte (2024):分层视频效果分离,三色掩码条件引导,但仅支持阴影/反射等外观效果

- ROSE (2025):基于扩散的视频对象移除,改善了时序一致性但仍限于外观修复

- Go-with-the-Flow (2025):Flow-Warped Noise 提升视频扩散的时序连贯性,启发 VOID 的第二遍方案

与前序工作的本质区别: VOID 首次引入因果推理:通过反事实数据监督 + VLM 空间推理 + 四色掩码编码,让视频扩散模型学会重写下游物理交互,而非简单填充。

方法原理

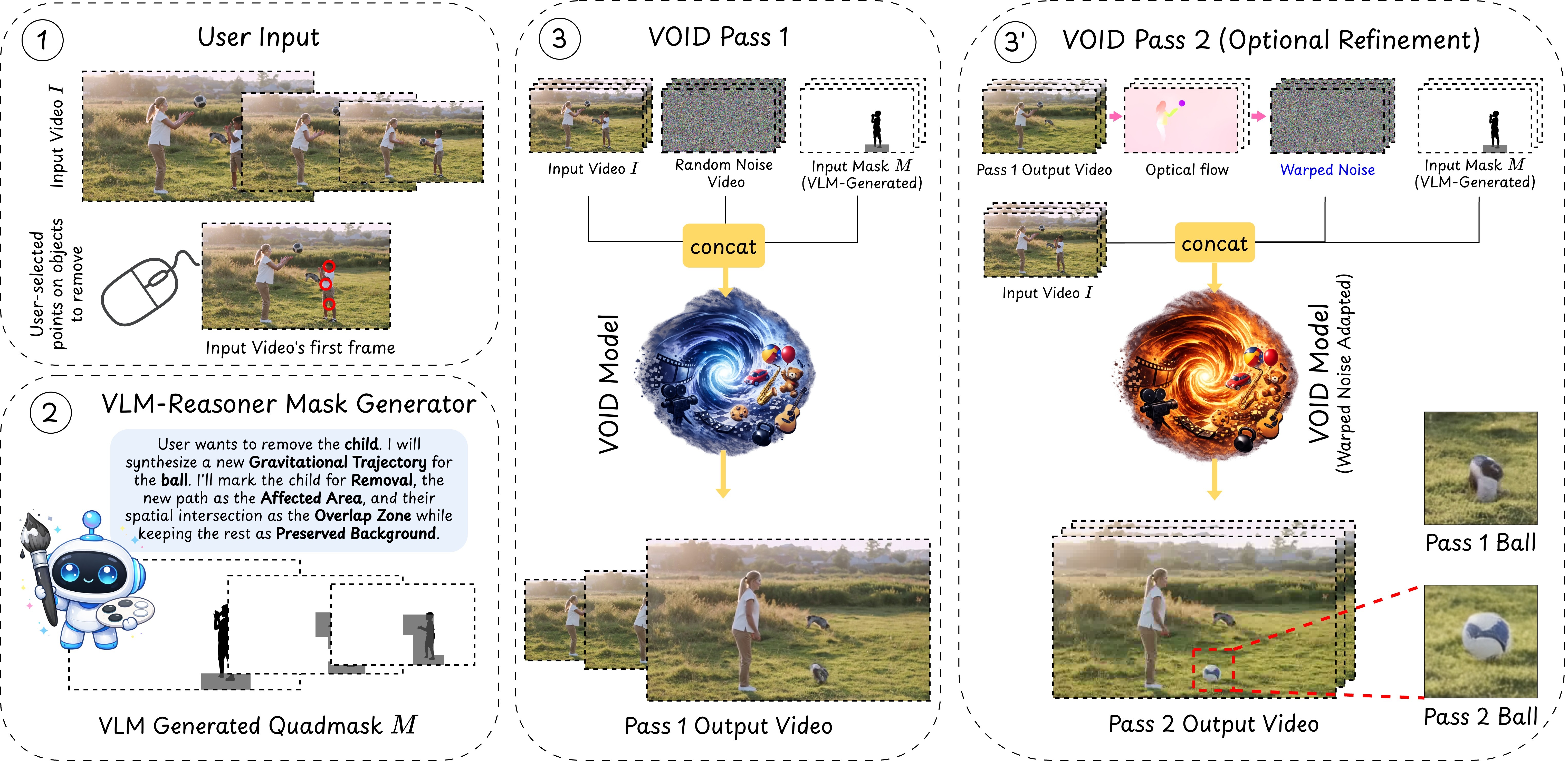

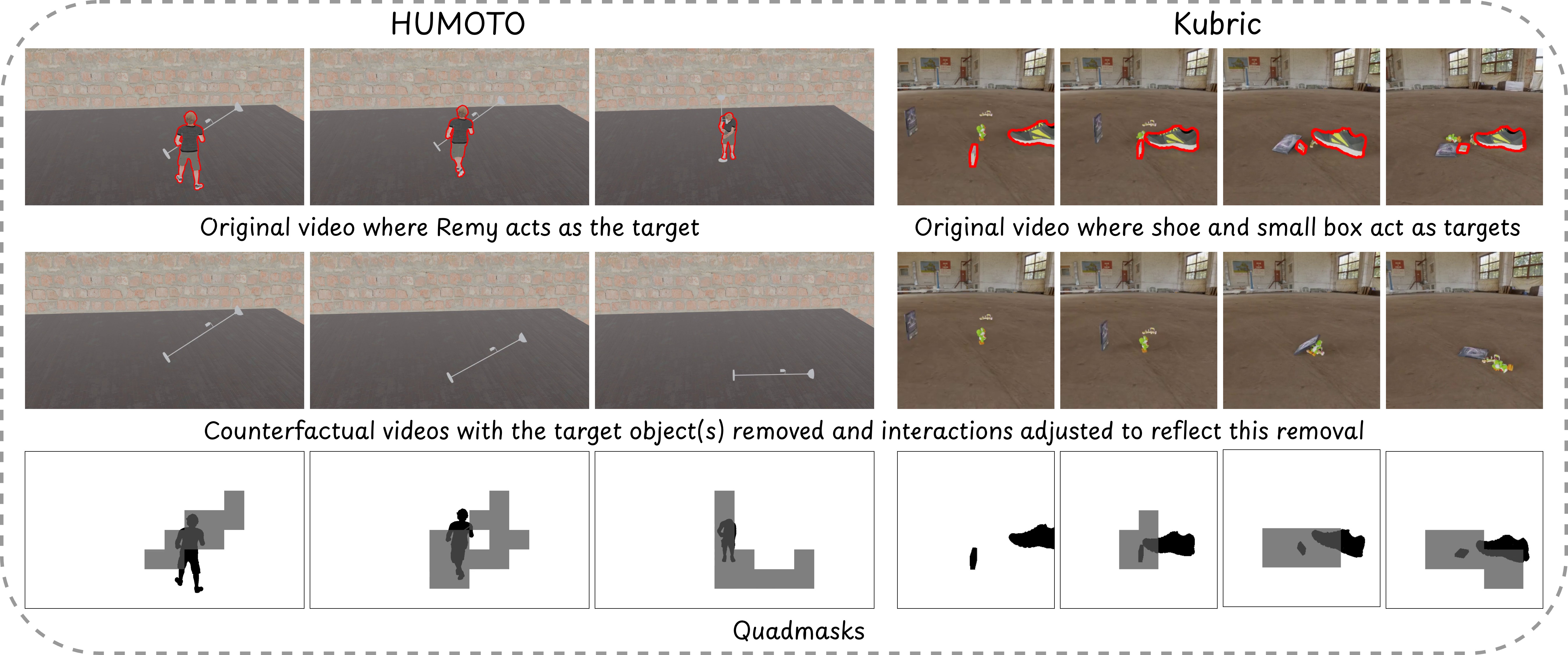

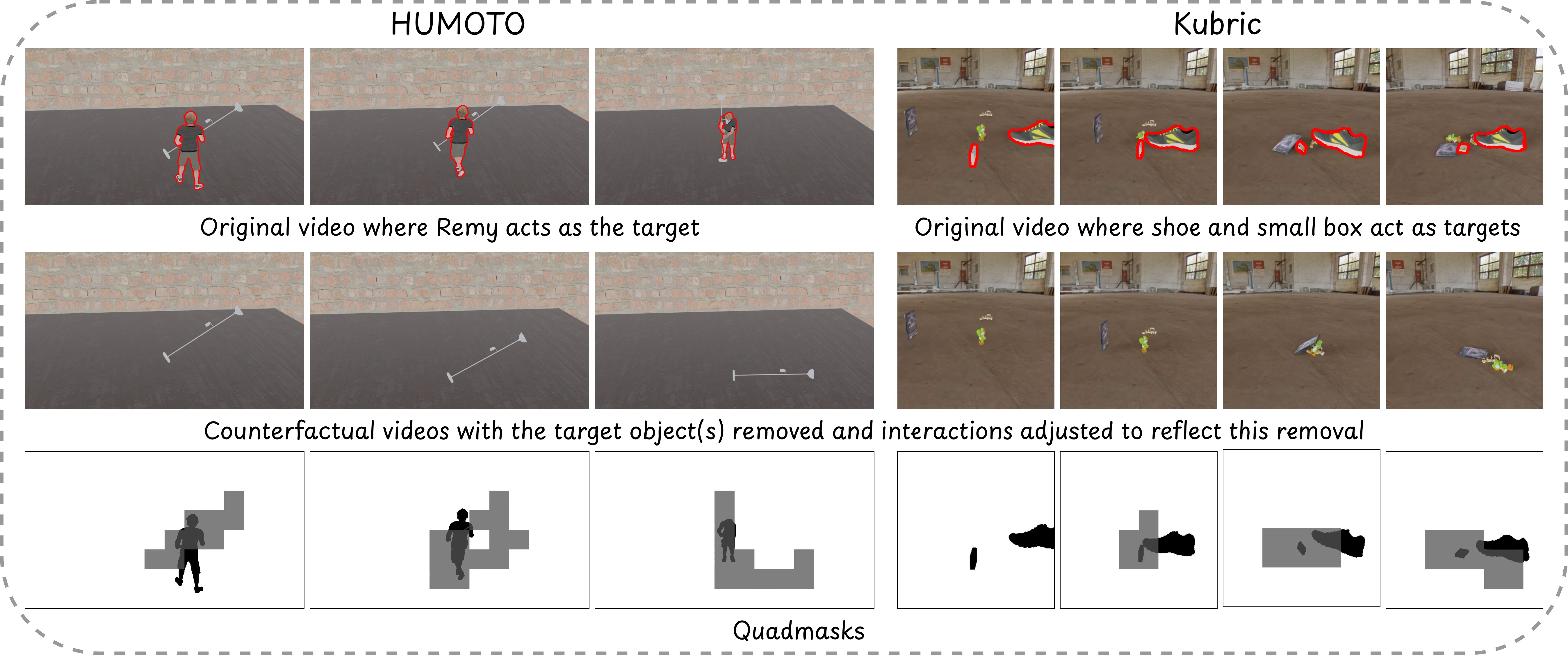

VOID 基于 CogVideoX 扩散 Transformer 构建,采用两遍生成策略。核心创新包括:(1) 反事实数据集监督——使用 Kubric 刚体动力学和 HUMOTO 人体运动捕捉数据,生成约 6400 组配对反事实视频(有/无目标对象),提供物理一致的训练监督。(2) 四色掩码(Quadmask)条件——扩展传统三色掩码为四色:黑色(待移除对象)、深灰(对象与受影响区域重叠)、浅灰(受影响区域)、白色(保持不变),消除掩码歧义。(3) VLM 引导推理——推理时使用视觉语言模型(Gemini 3 Pro)识别受移除对象影响的区域,结合 SAM3 分割,预测反事实轨迹并生成四色掩码。(4) 第二遍 Flow-Warped Noise 稳定——第一遍生成正确的反事实轨迹但可能出现变形,第二遍使用光流对齐噪声保持物体刚性。VLM 自动判断是否需要第二遍。

核心创新

- 首个因果推理驱动的视频对象删除框架,移除对象后能重写下游物理交互(碰撞停止、支撑消失后自由落体等)

- 四色掩码(Quadmask)条件机制,解决对象移除与受影响区域重叠时的歧义问题

- 反事实数据集监督:Kubric 刚体动力学 + HUMOTO 人体运动捕捉,合成 6400+ 配对视频

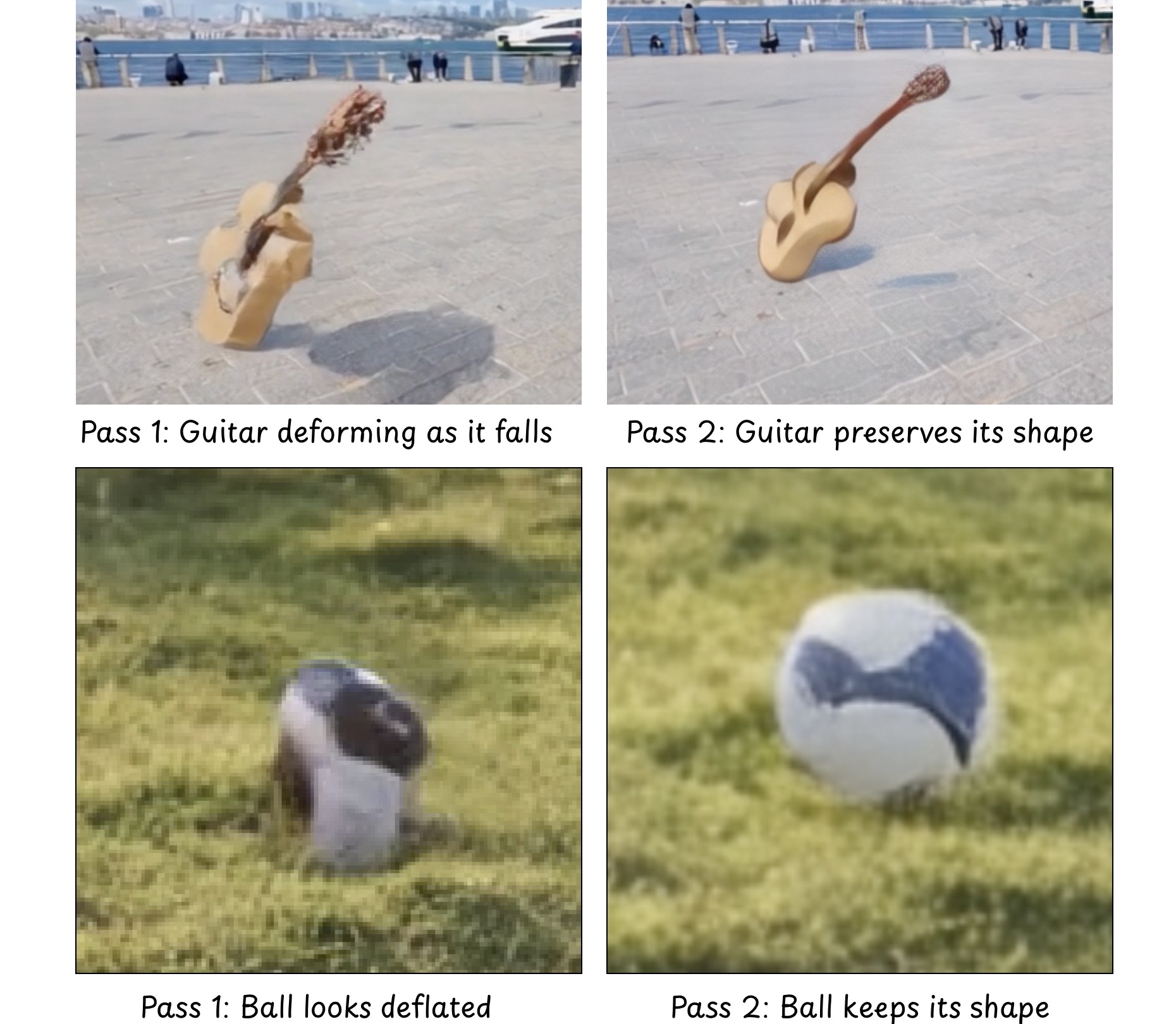

- 双遍生成策略:第一遍合成反事实轨迹,第二遍 Flow-Warped Noise 修复变形

- VLM 引导空间推理:Gemini 3 Pro + SAM3 自动生成推理时四色掩码

- 人类偏好 64.8% 胜率大幅超越 Runway 等商业系统

实验结果

- 人类偏好研究(25人/125组比较):VOID 64.8% 胜率,远超 Runway 18.4%、Gen-Omnimatte 11.2%、DiffuEraser 4.0%。VLM-as-Judge 评估(Gemini 3 Pro/GPT-5.2/Qwen 3.5 三组)全部排名第一,Interaction & Physics 维度提升最显著(3.66 vs Runway 2.61)。合成数据集指标:PSNR 31.49(最佳)、DreamSim 0.0658(最佳)、DINOv2 0.9222(最佳)、FVD 260.31(最佳,vs 第二名 437.88 降低 40%)。消融实验证明:混合 Kubric+HUMOTO 数据优于单一数据集,四色掩码优于三色掩码(26.12 vs 23.39 总分)。

图表详解

反事实数据集样例

Kubric 刚体碰撞和 HUMOTO 人体运动捕捉的配对反事实视频。上排为原始视频(红色标注目标对象),下排为移除对象后的反事实模拟,展示物理交互如何被正确重写。

双遍生成效果对比

左列第一遍生成正确的反事实轨迹但出现结构变形(吉他弯曲、球体拉伸),右列第二遍使用光流对齐噪声后保持了物体刚性,细节显著改善。

真实场景定性比较

与 Runway/Gen-Omnimatte/ProPainter 的对比:壶铃移除后枕头应弹回、浮标移除后无碰撞、双车相撞移除后正确还原。VOID 在物理一致性和伪影消除上全面领先。

多场景泛化结果

VOID 泛化到训练数据未涵盖的真实场景:积木多米诺骨牌停止、气球浮起、保龄球碰撞、搅拌机不启动等,展示强大的物理推理能力。

批判性点评

- 新颖性: 核心创新在于将因果推理引入视频编辑,从外观修复升级为世界模拟。四色掩码和反事实数据监督都是扎实的工程创新。但每个单独技术(VLM 推理、Flow-Warped Noise、扩散微调)都有前置工作,贡献在于系统整合。

- 可复现性: 依赖 CogVideoX 5B + Gemini 3 Pro + SAM3 三个外部模型,推理成本高。Kubric 和 HUMOTO 数据集可复现。代码和项目页面已公开。

- 影响力: 短期:将推动视频编辑工具从简单修复走向物理一致性编辑。中期:反事实推理数据集构建方法可迁移到其他世界模型训练。长期:为视频生成模型成为世界模拟器开辟路径。

深度点评:

- 因果推理驱动的视频编辑新范式 — VOID 首次证明:结合 VLM 因果推理 + 物理模拟反事实数据,可以让视频扩散模型学会重写下游物理交互。64.8% 人类偏好胜率大幅超越 Runway 等商业系统。但依赖 Gemini 3 Pro 推理能力,VLM 质量是系统瓶颈。

- 合成数据泛化到真实世界 — 仅用 6400 组 Kubric+HUMOTO 合成视频训练,就能泛化到真实世界的积木、保龄球、气球等多种未见过的物理交互。证明合成物理模拟作为训练监督的巨大潜力。

- 从外观修复到世界模拟 — 传统视频修复只做空间填充,VOID 要求模型理解因果关系:移除碰撞发起者后下游碰撞应停止,移除支撑后物体应自由落体。这是视频编辑从工具走向智能的关键一步。

技术演进定位: 开创视频编辑从外观修复到世界模拟的新方向。证明合成物理模拟数据可以让模型泛化到真实世界的因果推理。

可能的后续方向:

- 扩展到更复杂的物理场景(流体、柔体、多阶因果链)

- 与更强的世界模型结合,实现物理动力学的精确预测

- 无需 VLM 的端到端因果推理

其余论文速览

1. DynaVid

DynaVid: Learning to Generate Highly Dynamic Videos using Synthetic Motion Data

关键词: 视频生成·合成运动数据·光流·运动解耦·CVPR 2026

贡献: 合成光流数据→运动-外观解耦→高动态视频生成,两阶段框架(运动生成+视频渲染),CVPR 2026

效果: 利用 CG 管线渲染光流训练运动生成器,保留真实视频视觉真实感。在剧烈人体运动和极端相机运动场景验证有效

2. SteerFlow

SteerFlow: Steering Rectified Flows for Faithful Inversion-Based Image Editing

关键词: 图像编辑·Rectified Flow·免训练·保真度·多轮编辑

贡献: 基于 Rectified Flow 的免训练图像编辑框架,摊销定点求解器+轨迹插值+自适应掩码,理论保证源保真度

效果: 在 FLUX.1-dev 和 SD 3.5 Medium 上超越现有方法。支持多轮编辑不累积漂移

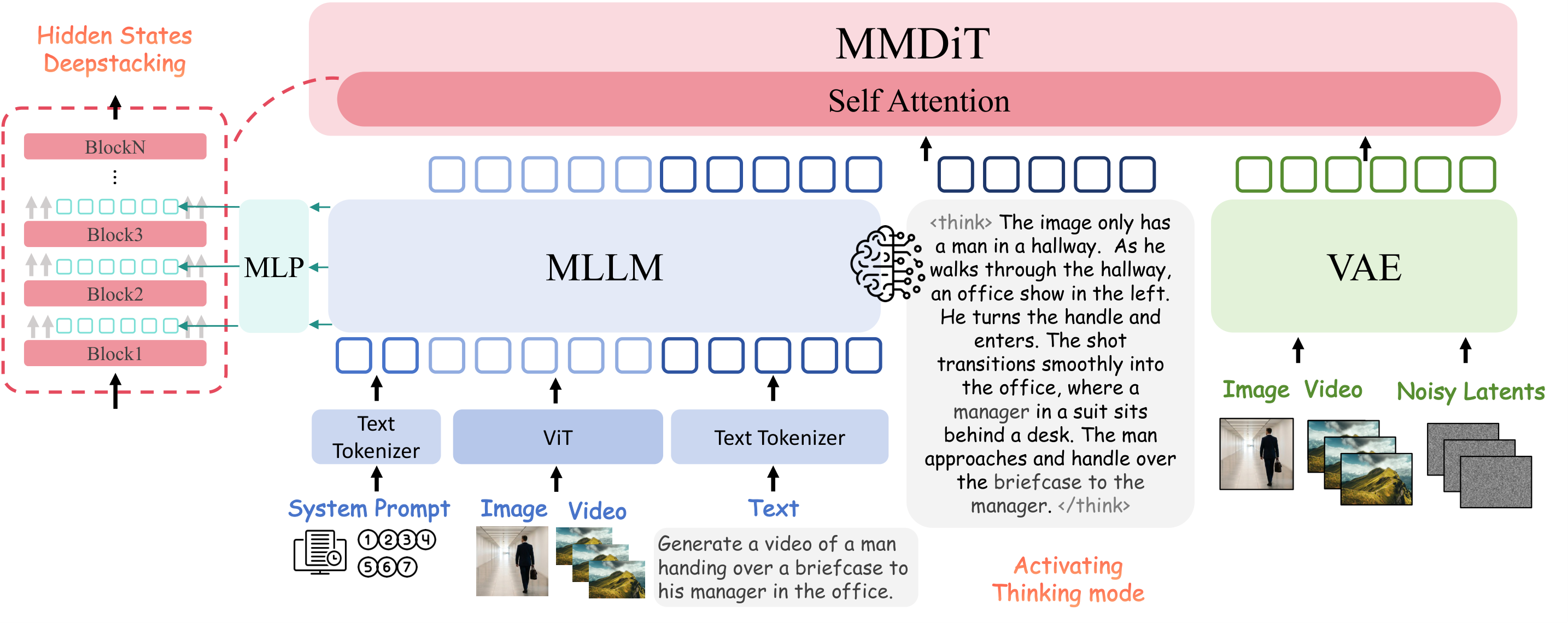

3. LatentUM

LatentUM: Unleashing the Potential of Interleaved Cross-Modal Reasoning via a Latent-Space Unified Model

关键词: 统一模型·潜在空间·跨模态推理·视觉生成·世界建模

贡献: 潜在空间统一多模态模型,消除视觉理解和生成之间的像素空间中介,支持交错跨模态推理

效果: 视觉空间规划 SOTA,自我反思改进视觉生成,支持世界建模预测未来视觉状态

4. FlowSlider

FlowSlider: Training-Free Continuous Image Editing via Fidelity-Steering Decomposition

关键词: 图像编辑·连续控制·正交分解·免训练·Rectified Flow

贡献: 将编辑更新分解为正交的保真度项+导向项,实现滑块式连续强度控制的免训练图像编辑

效果: 基于 Rectified Flow 模型无需后训练,保真度项保持身份结构,导向项驱动语义编辑,平滑可靠

5. ActionParty

ActionParty: Multi-Subject Action Binding in Generative Video Games

关键词: 世界模型·多主体控制·动作绑定·视频游戏·状态token

贡献: 首个可同时控制多达 7 名玩家的视频世界模型,引入主体状态 token + 空间偏置解耦全局渲染与动作控制

效果: 在 Melting Pot 46 个环境中验证,动作跟随准确性和身份一致性显著提升,Snap Research

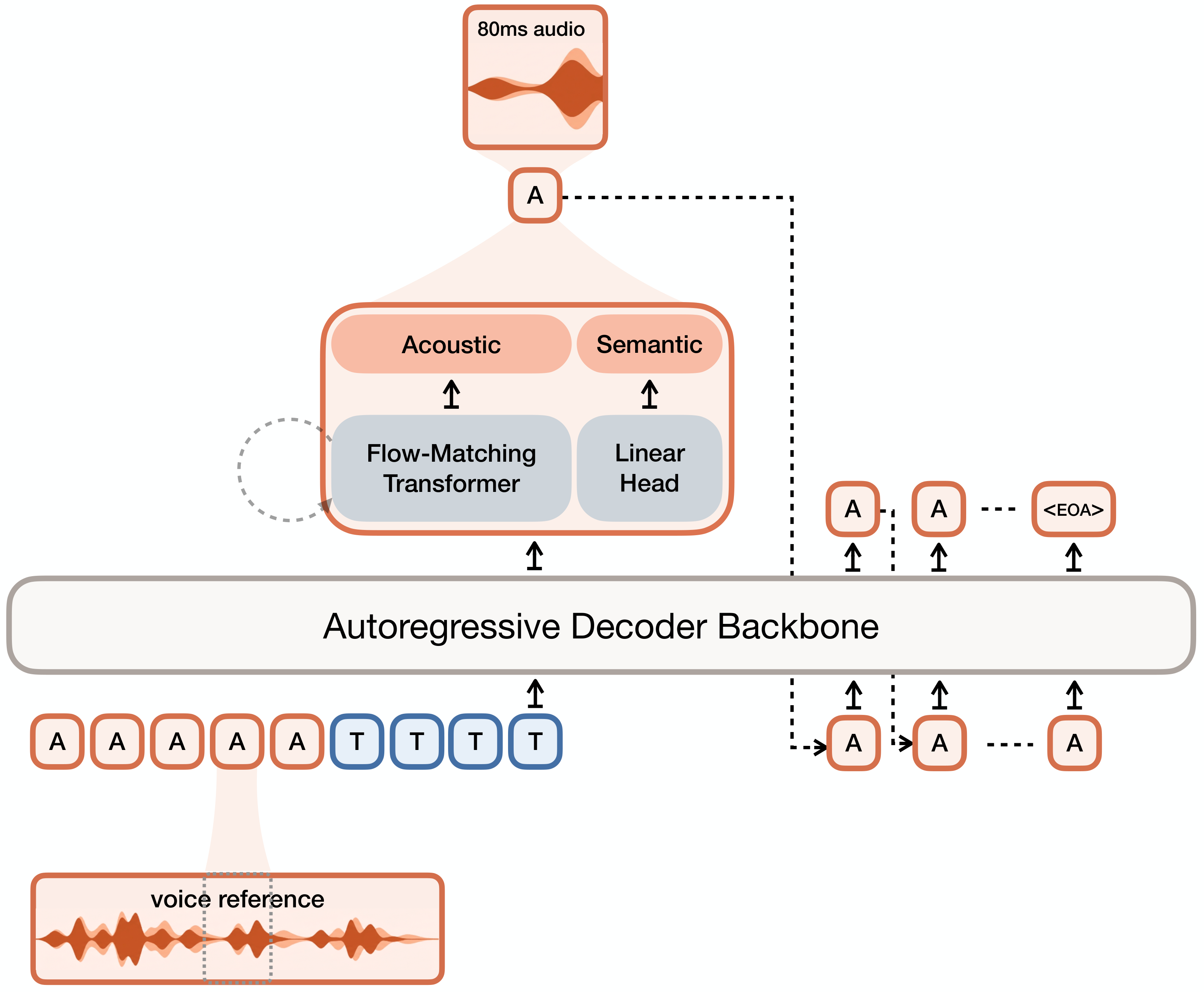

6. PFluxTTS

PFluxTTS: Hybrid Flow-Matching TTS with Robust Cross-Lingual Voice Cloning and Inference-Time Model Fusion

关键词: TTS·Flow Matching·跨语言克隆·双解码器·48kHz

贡献: 双解码器混合流匹配 TTS,推理时向量场融合+FLUX 解码器跨语言克隆+48kHz PeriodWave 声码器

效果: MOS 4.11 持平 ChatterBox,WER 降低 23%(6.9% vs 9.0%),说话人相似度超越 ElevenLabs(+0.32 SMOS)

7. BidirInterp

Can Video Diffusion Models Predict Past Frames? Bidirectional Cycle Consistency for Reversible Interpolation

关键词: 视频插值·循环一致性·双向扩散·方向token·课程学习

贡献: 视频扩散双向循环一致性框架,可学习方向 token 统一前向合成和后向重建,课程学习从短到长

效果: 37帧和73帧插值任务均 SOTA,推理无额外开销(循环约束仅训练时),运动平滑度和动态控制大幅提升

8. CLPIPS

CLPIPS: A Personalized Metric for AI-Generated Image Similarity

关键词: 评测指标·图像相似度·个性化·LPIPS·人类对齐

贡献: LPIPS 的个性化扩展,通过人类排序数据微调层组合权重,对齐 AI 生成图像评估与人类判断

效果: Spearman 等级相关和 ICC 均优于原始 LPIPS,证明有限人类数据微调即可显著提升感知对齐

9. ReflectGen

Reflection Generation for Composite Image Using Diffusion Model

关键词: 反射生成·合成图像·扩散模型·DEROBA数据集·类型感知

贡献: 首个大规模物体反射数据集 DEROBA + 扩散模型反射生成方法,注入反射位置和外观先验,类型感知设计

效果: 生成物理一致、视觉逼真的反射效果,为合成图像反射生成建立新基准

趋势观察

- 视频编辑从外观修复升级为因果推理 — VOID 用 VLM 推理物理交互,移除对象后重写下游动态,FVD 降低 40%

- 免训练编辑方法持续深化 — SteerFlow/FlowSlider 均基于 Rectified Flow 的免训练方案,数学保证源保真度

- 统一模型走向潜在空间融合 — LatentUM 消除像素中介,在共享语义潜空间内实现理解-生成-推理闭环

- 合成运动数据突破动态视频瓶颈 — DynaVid 用 CG 渲染光流解耦运动与外观,CVPR 2026 证明合成数据可学到真实世界动态

- 混合架构成为 TTS 新标准 — PFluxTTS 双解码器+向量场融合,跨语言克隆超越 ElevenLabs,MOS 达 4.11

人工智能炼丹师 整理 | 2026-04-06

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描文末二维码关注

评论 (0)