AIGC 每日速读|2026-04-02|MacTok 64-token SOTA

AIGC 视觉生成领域 · 每日论文解读 (2026-04-02)

人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇

今日核心看点

- MacTok 64-token SOTA图像生成

- LongCat-Next 美团统一多模态

- VecAttention 2.65x视频加速

- GEMS 6B超越SOTA Agent生成

- OmniRoam 全景长视频漫游

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。

方向分布:

- 图像Tokenizer: MacTok (64-token SOTA, CVPR 2026)

- 统一多模态: LongCat-Next (美团,离散原生自回归)

- 视频生成: VGGRPO (4D几何一致), OmniRoam (全景漫游)

- 视频编辑: CutClaw (长视频剪辑), TokenDial (属性控制)

- 推理加速: VecAttention (CVPR 2026), MPDiT (多Patch高效DiT)

- Agent生成: GEMS (6B超越SOTA) | 评测: SLVMEval (CVPR 2026)

重点论文深度解读

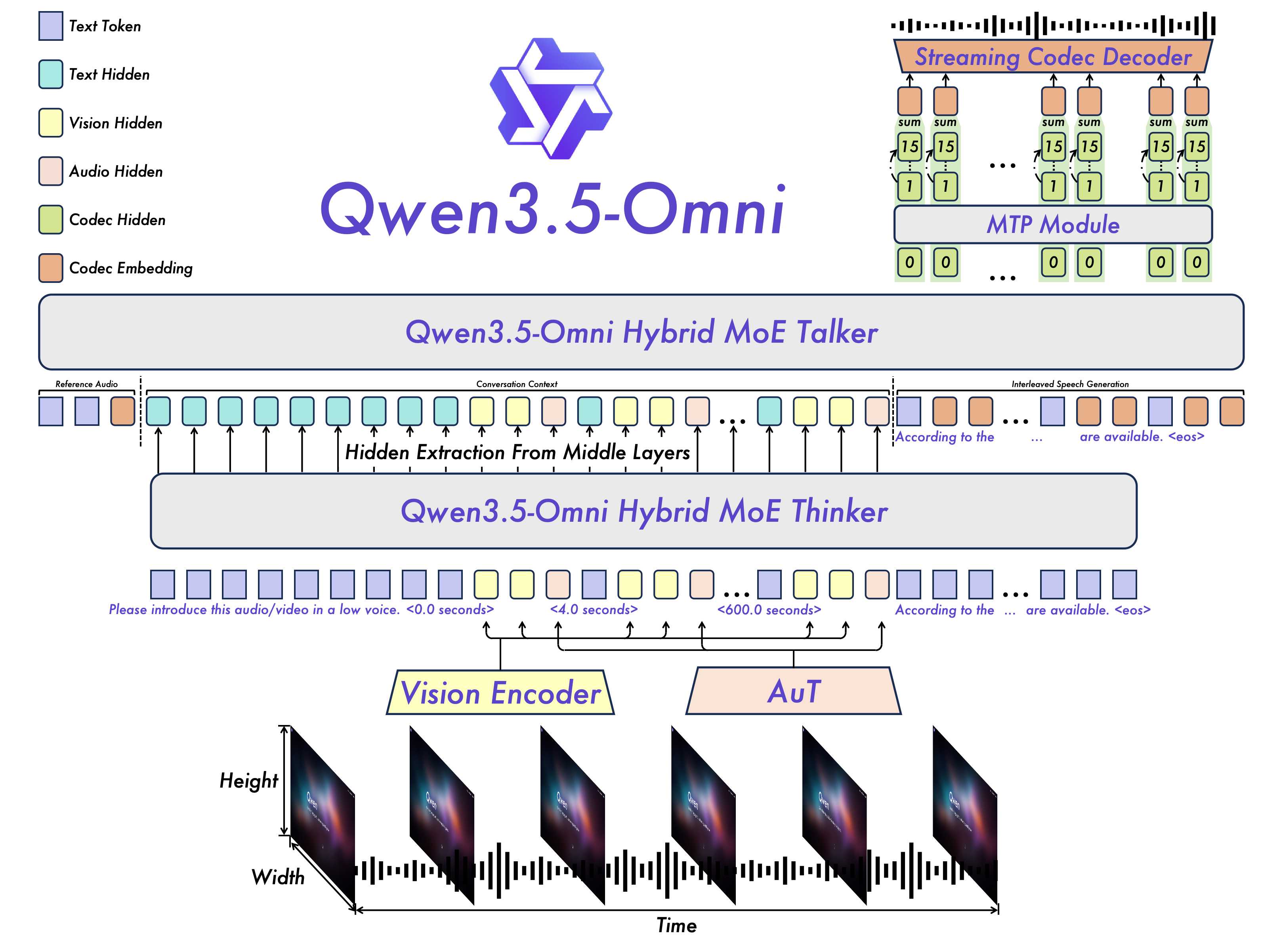

1. MacTok: Robust Continuous Tokenization for Image Generation

掩码增强1D连续Tokenizer——仅64/128 tokens实现SOTA图像生成, CVPR 2026 | East China Normal University / Shanghai AI Lab | arXiv:2603.29634

关键词: 连续Tokenizer, 后验崩溃, 掩码增强, DINO语义引导, 图像生成

研究动机

核心问题: 连续图像Tokenizer在极少token(64/128个)下发生后验崩溃,编码器无法有效编码信息到高度压缩的潜在空间

连续图像Tokenizer通过变分框架学习平滑结构化的潜在表示,是高效视觉生成的核心组件。然而,当使用极少量token(如64或128个)时,基于KL正则化的变分方法普遍面临后验崩溃(posterior collapse)问题——编码器无法将有意义的信息编码进高度压缩的潜在空间,导致所有输入映射到近似相同的潜在分布。这意味着token数量与生成质量之间存在一个痛苦的权衡:要么使用大量token保证质量(如256/512个),要么接受极低token数带来的严重质量下降。MacTok旨在打破这一权衡,实现仅用64/128 tokens就达到甚至超越高token数方案的生成质量。

前序工作及局限:

- VQ-VAE / VQGAN (2020-22):离散图像Tokenizer,通常需要数百到上千个token,码本利用率和生成质量受限

- SD-VAE (2022-23):连续变分编码器,质量优于离散方案,但潜在空间维度仍较高(256-4096 tokens)

- TiTok (2024):尝试将连续token数压缩到128个,但在更低token数时面临后验崩溃

- REPA (2025):引入表示对齐思路增强Tokenizer,但未系统解决极低token数下的崩溃问题

与前序工作的本质区别: MacTok系统性组合双重掩码策略(随机+DINO语义)和全局-局部表示对齐,首次在64 tokens这一极端压缩级别实现SOTA图像生成质量(gFID 1.44)

方法原理

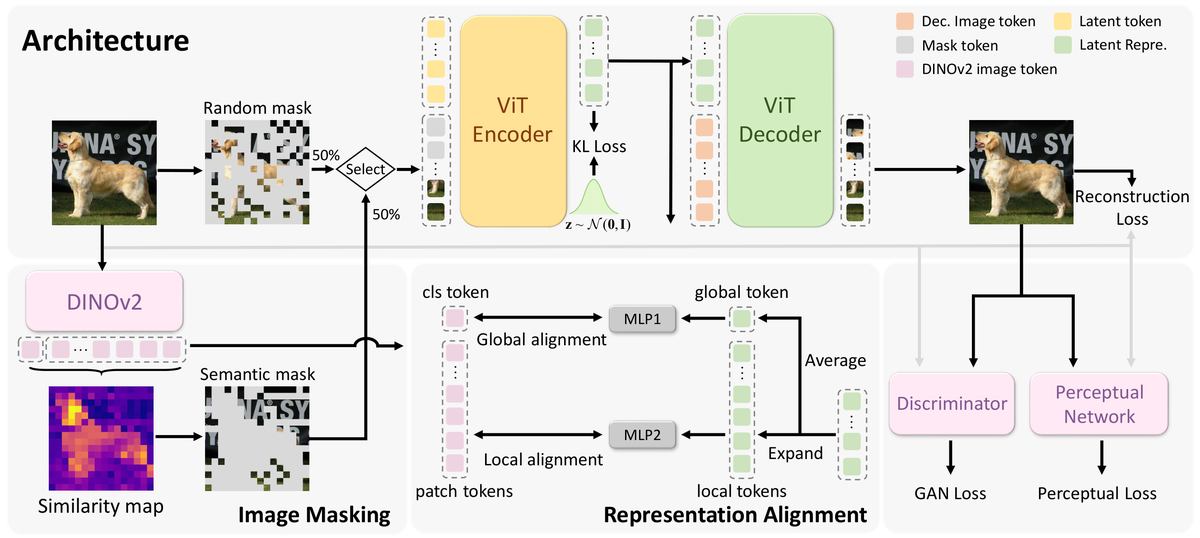

MacTok(Masked Augmenting 1D Continuous Tokenizer)通过三个核心机制解决后验崩溃问题:(1) 双重掩码策略:随机掩码(Random Masking)作为正则化手段防止编码器走捷径,DINO引导的语义掩码(Semantic Masking)强调图像中信息量最高的区域——利用预训练DINO模型的注意力图识别语义重要区域,迫使编码器从不完整的视觉输入中提取鲁棒语义。(2) 全局-局部表示对齐(Global-Local Representation Alignment):全局对齐确保整体语义保留,局部对齐保证细粒度判别信息不丢失,两者协同在高度压缩的1D潜在空间中维持丰富的表征能力。(3) 1D连续潜在空间设计:将图像压缩为极紧凑的1D token序列(仅64或128个token),配合上述掩码和对齐机制确保信息密度。MacTok与SiT-XL(Scalable Interpolant Transformer)配合使用进行图像生成。

核心创新

- 首次系统解决连续图像Tokenizer在极低token数下的后验崩溃问题

- 双重掩码策略创新:随机掩码正则化+DINO引导语义掩码,迫使编码器学习鲁棒表征

- 全局-局部表示对齐机制,在1D高压缩潜在空间中保留判别信息

- 仅用64 tokens实现256x256 gFID 1.44,128 tokens在512x512达到SOTA gFID 1.52

- token使用量减少高达64倍,大幅降低生成模型的计算和内存开销

实验结果

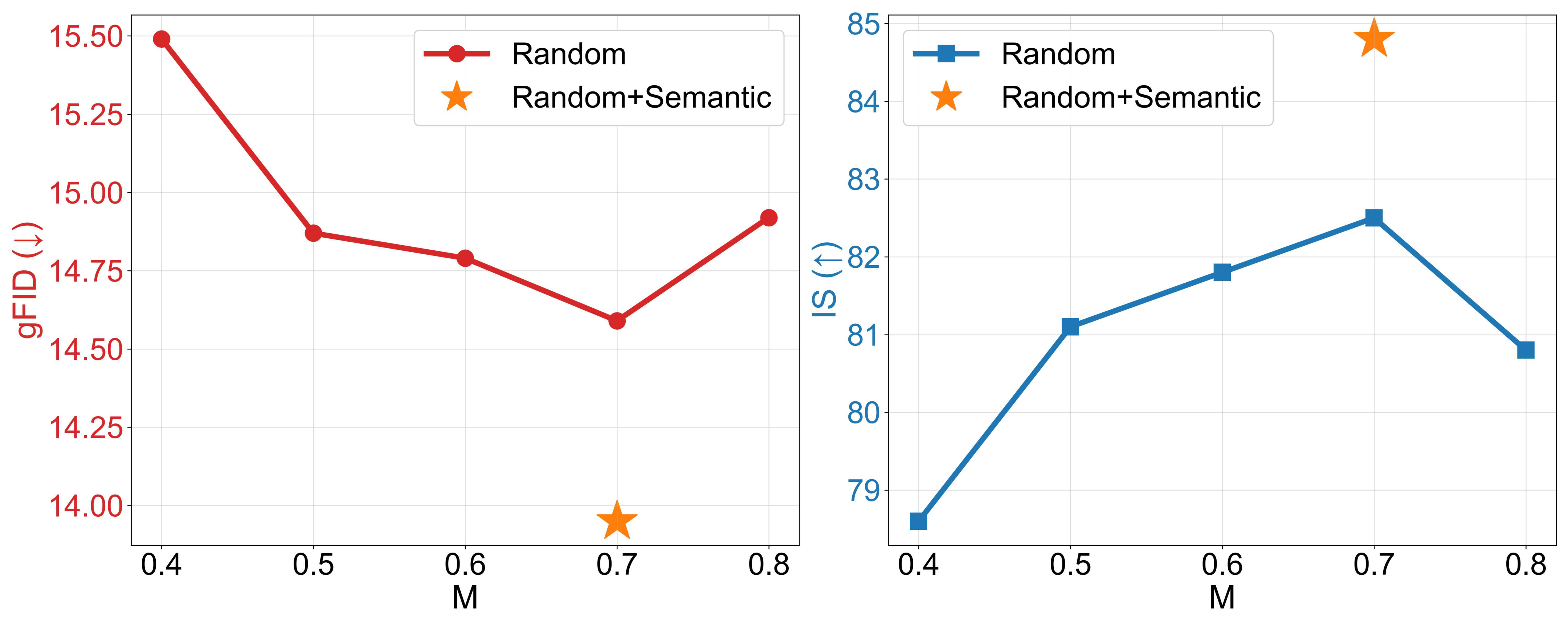

- 在ImageNet上配合SiT-XL模型评测:256x256分辨率下,MacTok仅用64 tokens即达到gFID 1.44,具有强竞争力。512x512分辨率下,MacTok用128 tokens达到gFID 1.52,为当时的SOTA水平。token使用量相比传统方案减少高达64倍(传统方案通常需要256-4096个tokens)。消融实验验证了双重掩码策略和表示对齐的各自贡献:去除语义掩码后gFID显著下降,去除全局对齐后判别信息损失明显。与TiTok、REPA等连续Tokenizer基线相比,MacTok在相同token预算下全面领先。

图表详解

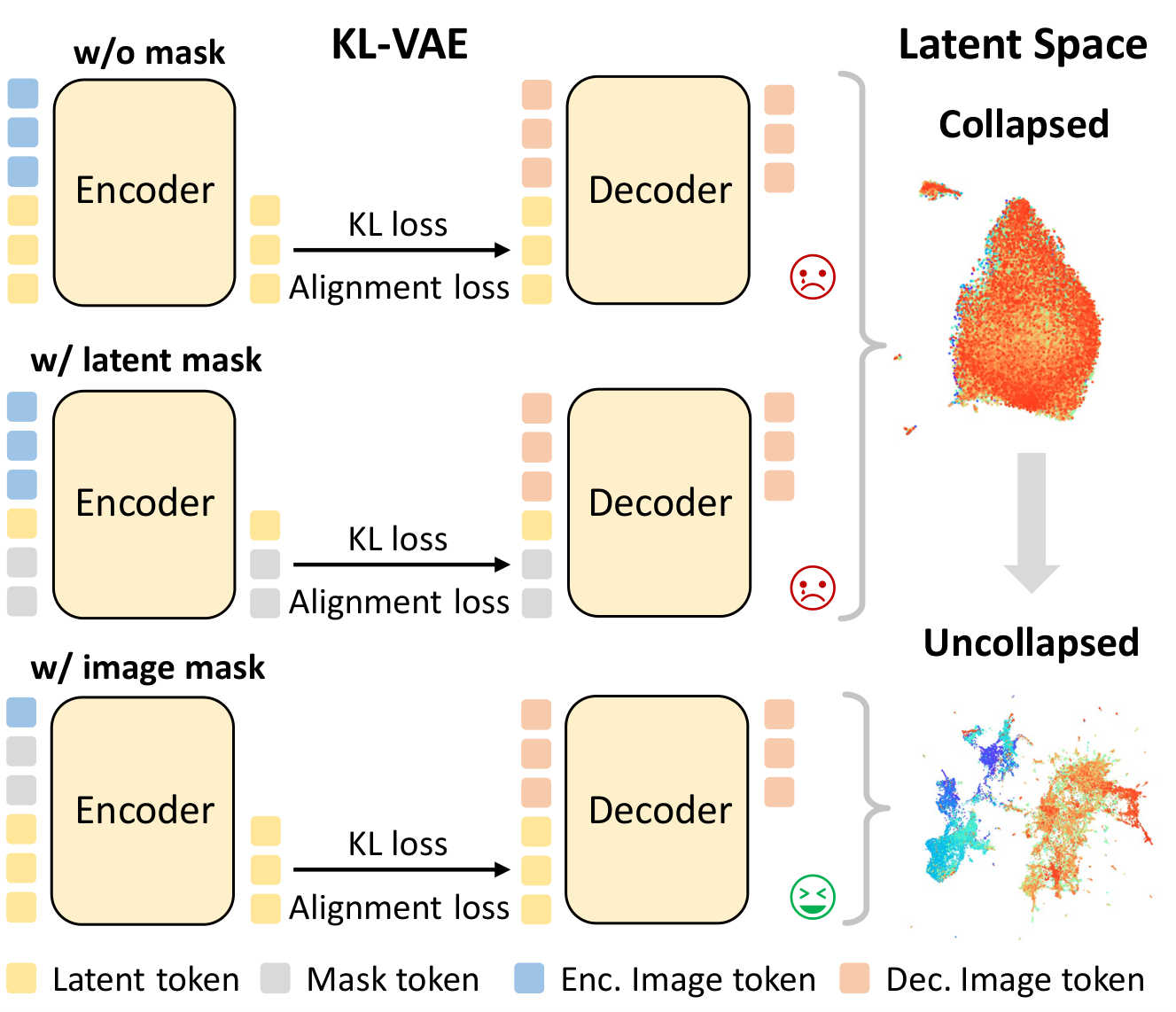

掩码策略对比——从后验崩溃到有效编码

这张图直观展示了掩码策略如何解决后验崩溃问题。图中对比了三种设置:上方是无掩码的KL-VAE,中间是潜在空间掩码,下方是MacTok的图像空间掩码。右侧是对应的潜在空间t-SNE可视化。无掩码时(上方),潜在空间严重崩溃——所有图像被映射到近似相同的区域(红色团簇),编码器完全放弃了编码有意义的信息。潜在空间掩码(中间)虽然有改善但仍不理想。MacTok的图像空间掩码(下方)成功解决了崩溃问题——潜在空间中不同类别的图像被映射到分散的、有区分度的区域(多色散布)。这证明了在图像输入端施加掩码是防止后验崩溃最有效的策略。绿色笑脸和红色哭脸直观标注了每种方案的效果好坏。

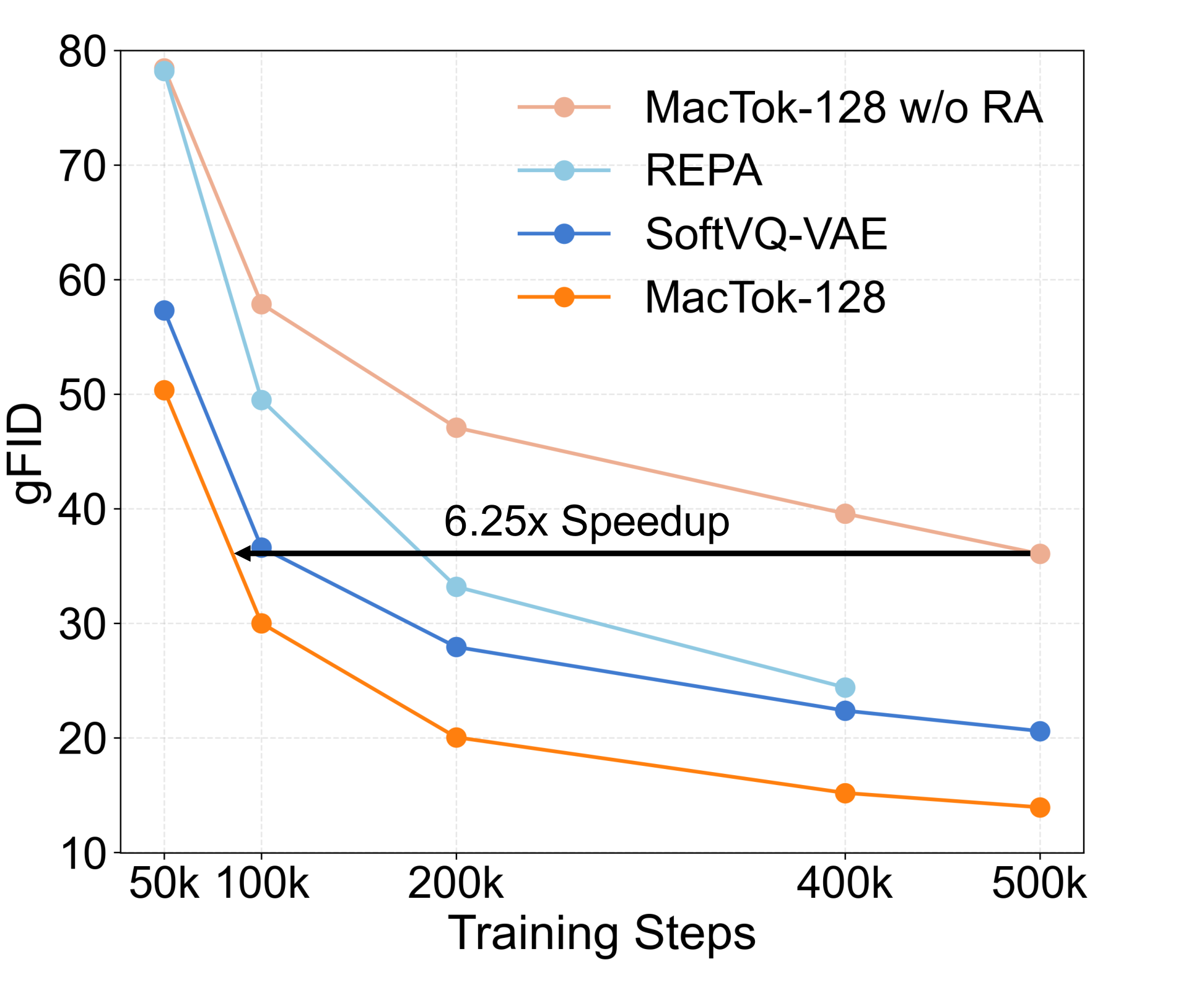

gFID训练曲线对比——MacTok收敛速度与最终质量领先

这张图展示了MacTok与REPA、SoftVQ-VAE等基线在ImageNet上的gFID随训练步数变化曲线。横轴是Training Steps(从50k到500k),纵轴是gFID(越低越好)。MacTok-128(橙色线)在所有训练阶段都保持最低的gFID,最终在500k步时达到约14的极低gFID。SoftVQ-VAE(深蓝线)和REPA(浅蓝线)虽然也在持续下降,但最终gFID分别约20和21。MacTok-128 w/o RA(去除表示对齐)则明显更差,约36,证明表示对齐的关键贡献。图中标注了6.25x Speedup——MacTok在100k步就达到了其他方法500k步的性能,训练效率提升了6.25倍。这对资源有限的团队来说意义重大。

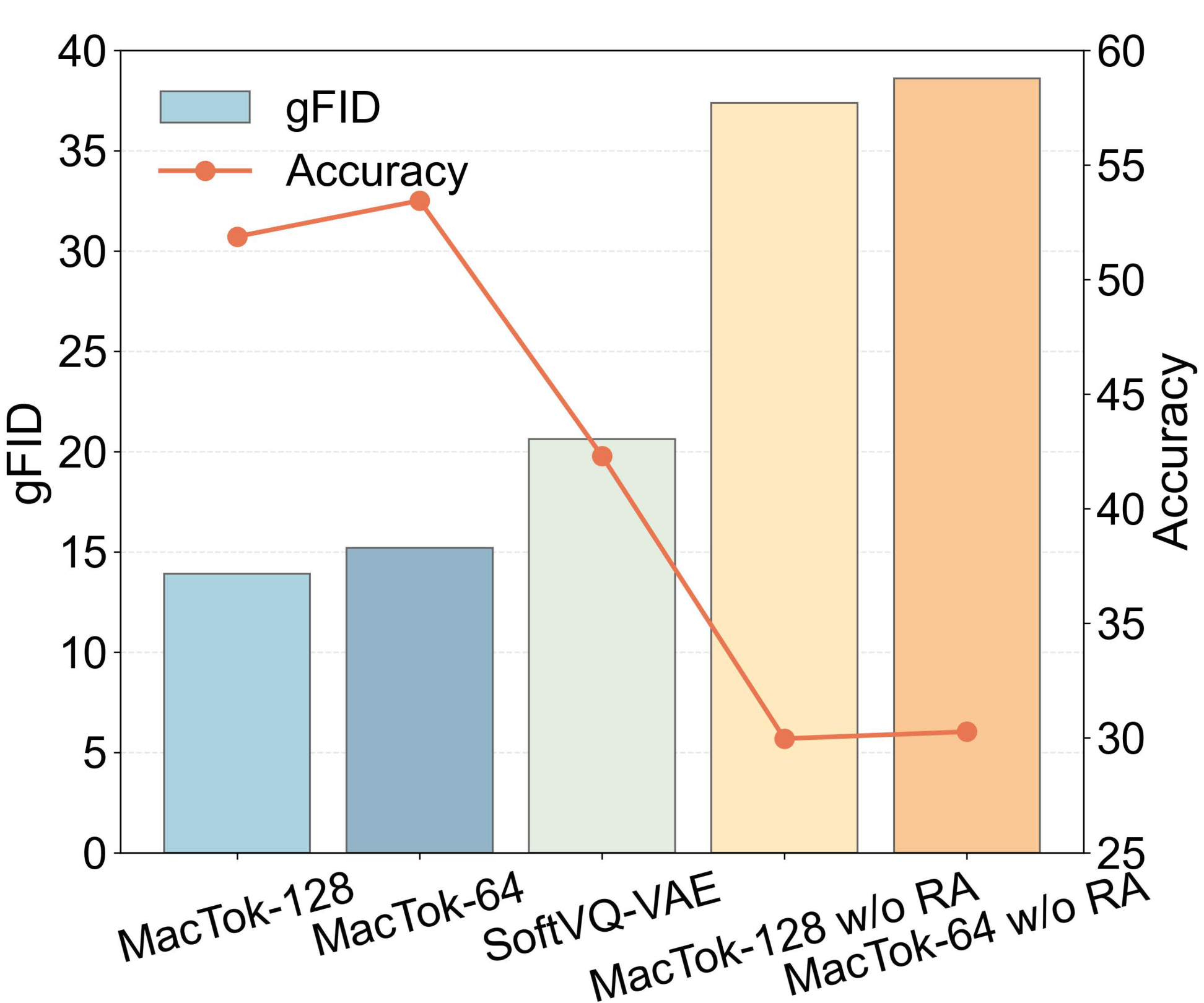

消融实验:gFID与分类准确率的权衡分析

这张消融实验柱状图展示了MacTok各配置的gFID(柱状)和分类准确率Accuracy(折线)对比。MacTok-128(最左)达到最低gFID约14和最高准确率约52%,是最优配置。MacTok-64紧随其后,gFID约15,准确率约53%,证明极低token数也能保持高质量。SoftVQ-VAE作为基线,gFID约21,准确率约44%,明显不如MacTok。关键对比:MacTok-128 w/o RA(去除表示对齐)的gFID骤升至37,准确率暴跌到约31%,MacTok-64 w/o RA更差,gFID接近39。这组数据明确证明了表示对齐(Representation Alignment)是MacTok成功的关键——没有全局-局部对齐,即使有掩码策略也无法在极低token数下保持质量。gFID和Accuracy的双重下降说明去除对齐后编码器不仅生成质量差,连语义判别能力也大幅退化。

MacTok生成样例展示(256x256 & 512x512)

这组图展示了MacTok配合SiT-XL在ImageNet各类别上的生成样例。可以看到仅用64个连续token,模型就能生成高度逼真的图像——动物(如金毛犬、猎豹)的毛发纹理细腻清晰,自然场景(如瀑布、花田)的光影层次丰富,人造物品(如跑车、教堂)的几何结构准确。这些样例视觉质量与使用数百个token的方案几乎无法区分,充分证明了MacTok在极高压缩比下保持生成质量的能力。特别值得注意的是细节部分——如动物眼睛的反光、建筑的对称性——这些在后验崩溃情况下通常最先丢失的细节都被很好地保留了。

批判性点评

- 新颖性: 核心贡献是首次系统解决连续Tokenizer在极低token数下的后验崩溃——双重掩码(随机+DINO语义)+全局-局部表示对齐的组合方案设计精巧。DINO语义引导是亮点——利用预训练模型知识优化Tokenizer训练。

- 可复现性: 方法组件清晰(两种掩码+两种对齐),超参数有详细消融。依赖预训练DINO模型但该模型公开可用。ImageNet实验可复现。主要不确定性在于DINO注意力图对非典型图像的适用性。

- 影响力: 64倍token压缩的工业价值极大——直接缩短扩散模型序列长度,大幅降低训练和推理成本。如能扩展到T2I和视频领域,将成为高效视觉生成的基础组件。CVPR 2026接收验证了学术影响力。

深度点评:

- MacTok: 64-token极限压缩 — 仅64个连续token达到SOTA图像生成(gFID 1.44),token量减少64倍。双重掩码+表示对齐解决后验崩溃。核心问题:缺少T2I验证和DINO依赖。

- Agent生成持续爆发 — GEMS让6B模型超越SOTA Nano Banana 2,CutClaw多智能体自动剪辑数小时视频。继Unify-Agent后,Agent范式全面进入生成领域。

- 视频推理加速:2.65x — VecAttention发现向量级稀疏模式实现2.65x加速(CVPR 2026),MPDiT多Patch设计降50% GFLOPs。高效化是视频生成落地的关键。

技术演进定位: 处于图像Tokenizer从高冗余向极致压缩演进的突破点——64倍token压缩使得高效视觉生成从理论走向实践

可能的后续方向:

- 将极低token方案扩展到T2I(文本到图像)等复杂生成任务

- 探索更灵活的语义引导机制替代固定的DINO模型

- 将1D连续token方案应用于视频生成的时序建模

- 研究MacTok与自回归视觉模型(如LlamaGen)的集成

其余论文速览

1. VGGRPO

Towards World-Consistent Video Generation with 4D Latent Reward

Unknown (Multi-institution)

关键词: 视频生成·几何一致·GRPO·4D奖励·潜在空间

贡献: 提出VGGRPO框架,通过潜在几何模型(LGM)连接视频扩散潜在空间与几何基础模型,直接从潜在空间解码场景几何实现4D几何一致的视频后训练,克服先前方法仅限静态场景的局限

效果: 消除昂贵的VAE解码,相机稳定性和几何一致性显著提升,首次支持动态场景几何引导

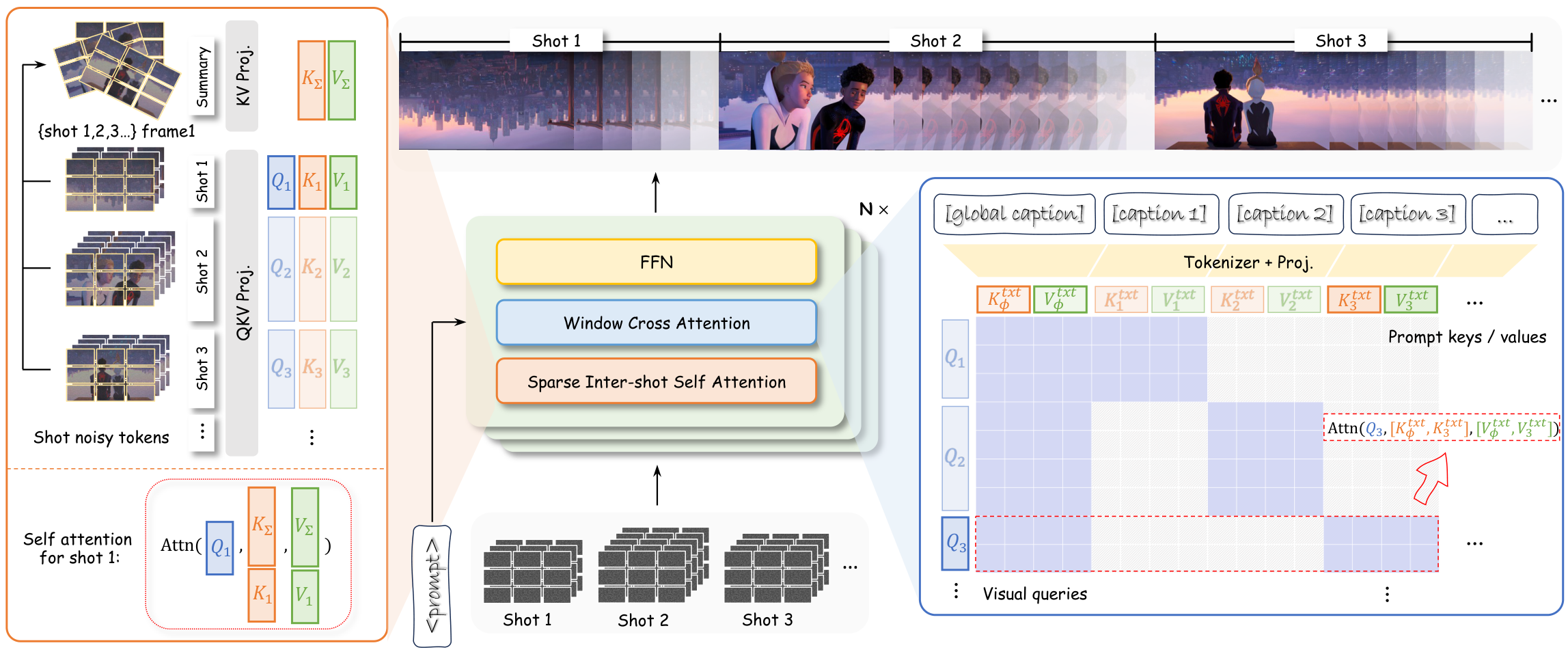

2. LongCat-Next

Lexicalizing Modalities as Discrete Tokens — Meituan Unified Multimodal Model

Meituan (美团)

关键词: 离散自回归·多模态统一·任意分辨率·美团·开源

贡献: 提出离散原生自回归框架,在共享离散空间表示文本/视觉/音频多模态,核心创新是离散原生任意分辨率ViT实现任意分辨率分词/解词,解决离散视觉建模在理解任务上的性能天花板

效果: 单一自回归目标统一观察/绘画/对话,多模态基准全面强劲,已开源模型和Tokenizer

3. GEMS

Agent-Native Multimodal Generation with Memory and Skills

Unknown

关键词: Agent生成·闭环优化·记忆系统·技能扩展·6B超越SOTA

贡献: 提出Agent-Native多模态生成框架,包含Agent Loop(闭环迭代优化)、Agent Memory(轨迹级持久记忆)和Agent Skill(可扩展领域专业知识),突破基础模型固有局限

效果: 6B模型Z-Image-Turbo在GenEval2上超越SOTA Nano Banana 2,证明智能体控制可大幅扩展模型能力

4. OmniRoam

World Wandering via Long-Horizon Panoramic Video Generation

Unknown (Multi-institution)

关键词: 全景视频·长距生成·轨迹控制·场景漫游·3D重建

贡献: 提出可控全景视频生成框架,利用全景表示的丰富场景覆盖和固有时空一致性,通过预览-精炼两阶段实现长距场景漫游,支持实时视频生成和3D重建扩展

效果: 在视觉质量/可控性/长期场景一致性上全面优于SOTA,支持实时生成和3D重建

5. CutClaw

Agentic Hours-Long Video Editing via Music Synchronization

GVC Lab

关键词: 视频编辑·音乐同步·多智能体·长视频·自动剪辑

贡献: 提出多智能体框架自动将数小时原始素材剪辑为音乐同步短视频,包含分层多模态分解、编剧Agent(叙事一致性)、编辑Agent+审查Agent(美学/语义标准协作优化)

效果: 在节奏对齐和视频质量上显著超越SOTA基线,大幅减少视频编辑人工时间

6. VecAttention

Vector-wise Sparse Attention for Accelerating Long Context Inference

Unknown

关键词: 稀疏注意力·向量选择·视频加速·CVPR 2026·2.65x加速

贡献: 发现视频注意力图存在强垂直向量稀疏模式,提出逐向量稀疏注意力框架,通过轻量级重要向量选择+优化稀疏注意力内核动态处理信息向量,CVPR 2026

效果: 比全注意力加速2.65倍,比SOTA稀疏方法加速1.83倍,精度与全注意力相当

7. MPDiT

Multi-Patch Global-to-Local Transformer for Efficient Flow Matching and Diffusion

Rutgers University

关键词: 高效DiT·多Patch·全局到局部·50%加速·开源

贡献: 提出多Patch DiT设计:早期模块用大Patch捕获全局上下文,后期模块用小Patch精炼局部细节,打破DiT各向同性设计的计算冗余,另提出改进的时间和类别嵌入加速收敛

效果: GFLOPs计算成本降低50%,生成性能保持良好,已开源代码

8. TokenDial

Continuous Attribute Control in Text-to-Video via Spatiotemporal Token Offsets

Adobe Research / CMU

关键词: 视频属性控制·token偏移·滑块式编辑·免训练·Adobe

贡献: 提出通过时空token偏移实现T2V模型的连续滑块式属性控制,发现中间token空间中的加性偏移形成语义控制方向,无需重训练即可调节外观和运动属性

效果: 比SOTA基线实现更强可控性和更高编辑质量,人类研究验证有效性

9. SLVMEval

Synthetic Meta Evaluation Benchmark for Text-to-Long Video Generation

Unknown

关键词: 长视频评测·元评估·合成降质·CVPR 2026·3小时视频

贡献: 提出长视频生成元评估基准(最长10486秒约3小时),通过合成降质创建控制的质量对比视频对,覆盖10个评估维度,用众包筛选建立可靠测试平台,CVPR 2026

效果: 人类准确率84.7%-96.8%,揭示9/10维度现有评估系统不及人类,暴露长视频评估短板

趋势观察

- Token压缩极限突破 — MacTok用仅64个连续token达到SOTA图像生成质量(gFID 1.44),token使用量减少64倍。双重掩码+表示对齐的组合策略有效解决了后验崩溃,为高效生成打开新空间。

- Agent范式在生成领域全面铺开 — GEMS的Agent-Native框架让6B模型超越SOTA,CutClaw的多智能体将数小时素材自动剪辑。继昨天的Unify-Agent后,Agent正在从理解领域向生成领域快速渗透。

- 视频模型推理加速竞赛升温 — VecAttention发现向量级稀疏模式实现2.65x加速(CVPR 2026),MPDiT用多Patch设计降低50% GFLOPs。高效化是视频生成落地的关键瓶颈。

- 统一多模态模型持续进化 — 美团LongCat-Next在共享离散空间统一文本/视觉/音频,解决离散视觉建模的理解性能天花板。88位作者的工业级投入标志着统一模型走向成熟。

- 视频生成评测走向严格化 — SLVMEval首次系统评测长达3小时的视频生成质量,揭示现有自动评估在9/10维度不及人类。VGGRPO则将4D几何一致性引入视频后训练。

人工智能炼丹师 整理 | 2026-04-02

评论 (0)