AIGC论文速读|2026-05-07|腾讯AniMatrix动漫视频生成重定义艺术正确,SCD…

今日核心看点

- AniMatrix

- PV-VAE

- UniReasoner

- Stream-R1

- SCD

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇。

方向分布:

- 视频生成模型 4 篇 (AniMatrix, PV-VAE, Stream-R1, Geometry Forcing)

- 推理与训练加速 3 篇 (SCD, AHPA, Ortho-Hydra)

- 文生图与多模态生成 1 篇 (UniReasoner)

- 评测基准 2 篇 (VEBench, WorldJen)

今日论文速览

1. AniMatrix:面向艺术而非物理的动漫视频生成模型

AniMatrix: An Anime Video Generation Model that Thinks in Art, Not Physics | Tencent | 2605.03652

关键词: 动漫视频生成·生产知识系统·风格-运动课程·变形感知偏好优化

前序工作问题: 现有视频生成模型以物理真实为先验,无法处理动漫的夸张表现(涂抹帧、冲击帧、Q版变形等艺术性违反物理规则的表达),导致生成结果要么丢失动漫艺术性,要么在风格方差下崩溃

贡献: 提出 AniMatrix,通过生产知识系统(PKS)将动漫编码为可控的结构化分类法(Style/Motion/Camera/VFX),双通道注入机制+风格-运动-变形三阶段课程训练,配合变形感知偏好优化区分有意艺术表达与病理性崩溃

效果: 在专业动画师评估的5个维度中4个排名第一,Prompt理解比Seedance-Pro 1.0高22.4%,艺术动作高16.9%,将开源模型权重和代码

批判点评: 仅与 Seedance-Pro 1.0 比较,缺少与 Wan、CogVideo 等开源基线的对比;"艺术正确"的评估高度主观,需要更大规模的动画师评审验证泛化性

2. PV-VAE:用预测式潜空间提升视频生成质量

Video Generation with Predictive Latents | ByteDance Seed | 2605.02134

关键词: 视频VAE·预测式学习·潜空间可扩散性·世界建模

前序工作问题: 现有视频 VAE 虽然重建质量不断提升,但重建优化并不直接转化为更好的生成性能,如何增强视频潜空间的"可扩散性"仍是未解问题

贡献: 提出 PV-VAE,引入预测式重建目标:随机丢弃未来帧,仅编码部分观测,训练解码器同时重建已观测帧并预测未来帧,使潜空间编码时序预测结构,构建更连贯的视频动态理解

效果: 在 UCF101 上比 Wan2.2 VAE 收敛快 52%、FVD 提升 34.42,且下游视频理解任务也一致受益,验证了潜空间有效捕获时序连贯性和运动先验

批判点评: 仅在 UCF101 上验证,该数据集分辨率和复杂度有限;预测式训练增加了训练复杂度,实际大规模部署的收益-代价比有待验证

3. UniReasoner:LLM推理引导弥合文生图理解-生成鸿沟

Large Language Models are Universal Reasoners for Visual Generation | Johns Hopkins / Apple | 2605.04040

关键词: LLM推理·理解-生成鸿沟·视觉草稿·自我批判·扩散模型

前序工作问题: 统一 LLM 骨干的文生图系统在理解提示词时准确率很高,但在生成时却频繁出现不对齐问题(遗漏、幻觉、关系错误),存在"理解-生成鸿沟"

贡献: 提出 UniReasoner,让 LLM 先生成粗糙视觉草稿,再自我批判评估提示一致性,最终扩散模型同时以提示、草稿和修正信号为条件生成,将理解能力转化为生成引导

效果: 在同一扩散骨干下提升了组合对齐和语义忠实度,同时保持图像质量,展示了利用 LLM 推理闭合理解-生成鸿沟的实用路径

批判点评: 增加了推理链路(草稿→批判→生成),推理延迟增加;自我批判的可靠性取决于 LLM 本身的视觉理解能力上限

4. Stream-R1:奖励感知蒸馏加速流式视频生成

Stream-R1: Reliability-Perplexity Aware Reward Distillation for Streaming Video Generation | USTC | 2605.03849

关键词: 流式视频生成·分布匹配蒸馏·奖励引导·自适应加权·视频质量

前序工作问题: 分布匹配蒸馏(DMD)是流式视频扩散模型加速的主流方案,但现有方法对教师输出无差别学习,忽略了不同 rollout 的可靠性差异和不同时空区域的困惑度差异,限制了蒸馏质量上限

贡献: 提出 Stream-R1 框架,在 rollout 级别用视频奖励分数指数加权(高可靠性主导优化),在时空元素级别用奖励梯度显著性分配优化压力(聚焦改进收益最大的区域和帧),自适应平衡三个质量维度

效果: 在视觉质量、运动质量和文本对齐三个维度上均一致优于蒸馏基线,无需架构修改或额外推理开销

批判点评: 依赖预训练视频奖励模型的质量,奖励模型偏差会传导到蒸馏结果;自适应平衡机制的超参数敏感性未充分分析

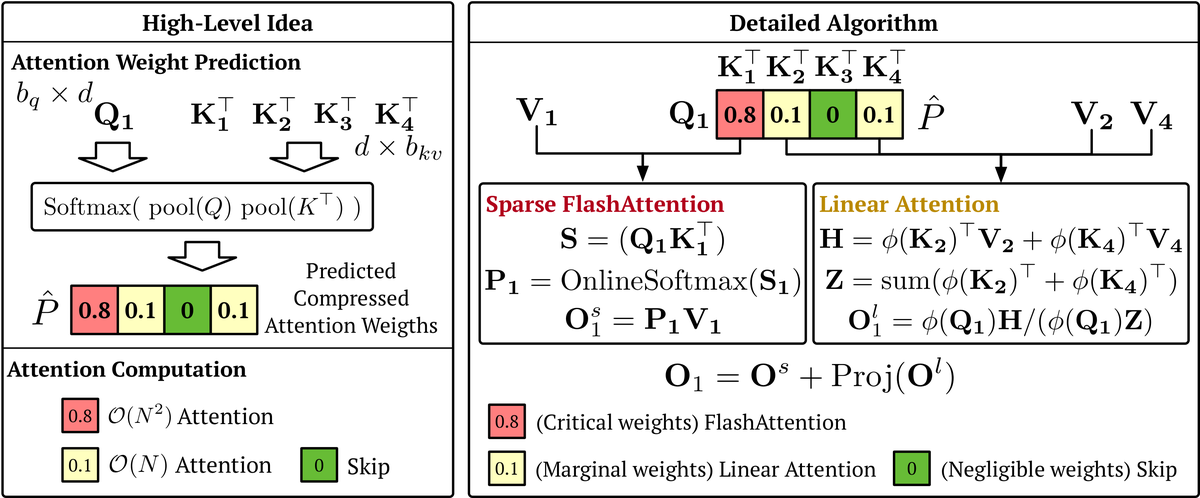

5. SCD:无训练无损加速自回归视频生成13.6x

Speculative Coupled Decoding for Training-Free Lossless Acceleration of Autoregressive Visual Generation | Yonsei University / POSTECH | 2510.24211

关键词: 自回归视觉生成·推测解码·耦合采样·无损加速·无需训练

前序工作问题: 自回归视觉生成每次只生成一个 token,推理极慢(单样本需数千步);现有推测解码方法受限于低接受率、质量退化或需训练草稿模型

贡献: 提出 SCD(Speculative Coupled Decoding),通过信息论耦合方法最大化连续迭代间草稿 token 的采样一致性,稳定 Jacobi 迭代轨迹大幅提升接受率,仅需一行代码修改且几乎零开销

效果: 图像生成加速 4.2x,视频生成加速 13.6x,完全无损无需额外训练,代码已开源

批判点评: 加速倍率高度依赖序列长度和模型结构,在更大规模模型上的泛化性有待验证;Jacobi 迭代的收敛条件在复杂场景下可能不稳定

6. AHPA:自适应层级先验对齐加速DiT训练

AHPA: Adaptive Hierarchical Prior Alignment for Diffusion Transformers | Unknown | 2605.03317

关键词: DiT训练加速·表示对齐·VAE层级特征·动态路由·无推理开销

前序工作问题: 现有 DiT 表示对齐方法使用固定粒度的监督目标,但去噪轨迹中不同时间步需要不同粒度的对齐——高噪声时需粗语义锚定,低噪声时需精细结构细化,静态单级监督造成表示不匹配

贡献: 提出 AHPA,利用冻结 VAE 编码器的多层级特征作为层级先验(从局部几何到粗语义布局),通过时间步条件动态路由器自适应选择和加权这些先验,使对齐粒度与模型训练需求同步

效果: 加速 DiT 收敛并提升生成质量,无额外推理开销,训练时也不依赖外部编码器

批判点评: 多层级特征的有效性取决于 VAE 编码器本身的表示质量;动态路由器增加训练复杂度,超参数调优成本需评估

7. Ortho-Hydra:正交化专家解决DiT多风格LoRA冲突

Ortho-Hydra: Orthogonalized Experts for DiT LoRA | Independent | 2605.03252

关键词: DiT LoRA·MoE·正交化·风格渗透·冷启动

前序工作问题: DiT 的 LoRA 微调在多风格数据上出现"风格渗透":单个低秩残差无法表示多种风格,优化器收敛到均值;HydraLoRA 的零初始化导致路由器梯度退化,专家对称演化

贡献: 提出 Ortho-Hydra 重参数化:OFT 风格 Cayley 正交共享基底+每专家从预训练权重前 Er 个左奇异向量中划分不相交输出子空间,使路由器在 step 0 就获得非退化梯度信号

效果: HydraLoRA 基线在 1k 步内未脱离均匀先验,Ortho-Hydra 在前几百步即开始去均匀化,成功实现多风格专门化

批判点评: 仅验证了多风格场景,未评估在单风格或大规模数据下是否仍有优势;奇异值分解和正交化增加了初始化计算量

8. Geometry Forcing:视频扩散与3D表示联姻实现一致世界建模

Geometry Forcing: Marrying Video Diffusion and 3D Representation for Consistent World Modeling | Tsinghua / Microsoft | 2507.07982

关键词: 视频扩散·3D一致性·几何对齐·世界模型·角度-尺度对齐

前序工作问题: 视频扩散模型仅在原始视频上训练,其学到的表示往往缺乏有意义的几何感知结构,无法捕获物理世界的3D本质

贡献: 提出 Geometry Forcing,通过角度对齐(Angular Alignment,余弦相似度方向一致性)和尺度对齐(Scale Alignment,几何特征回归)两个互补目标,引导扩散模型中间表示对齐几何基础模型特征

效果: 在相机视角条件和动作条件视频生成任务上,视觉质量和3D一致性均显著优于基线方法

批判点评: 依赖外部几何基础模型的质量,该模型本身的误差会传播到对齐目标;额外的对齐损失增加训练复杂度

9. VEBench:首个面向真实世界视频编辑的大模型基准

VEBench: Benchmarking Large Multimodal Models for Real-World Video Editing | Multiple | 2605.03276

关键词: 视频编辑评测·大多模态模型·编辑技术识别·操作推理·CVPR'26

前序工作问题: 大多模态模型在通用视频理解上进展显著,但在多视频推理和实际编辑操作工作流上的能力几乎未被探索,缺乏专门的评测基准

贡献: 提出 VEBench,含 3.9K 高质量编辑视频(257+小时)和 3,080 个人工验证 QA 对,通过三轮人机协作标注构建,评估编辑技术识别和编辑操作模拟两项任务

效果: 测试显示即使 Gemini-2.5-Pro 也与人类编辑认知存在巨大差距,突显了桥接视频理解与创意操作推理的紧迫需求。已被CVPR 2026接收

批判点评: 3.9K 视频虽覆盖面广但对每种编辑类型的深度可能不足;评估偏重识别和选择,未涵盖生成式视频编辑的质量评测

10. WorldJen:生成视频模型端到端多维评测基准

WorldJen: An End-to-End Multi-Dimensional Benchmark for Generative Video Models | Unknown | 2605.03475

关键词: 视频生成评测·Likert量表·VLM评审·对抗性Prompt·人类偏好

前序工作问题: 现有视频生成评测依赖 SSIM/PSNR/FVD 等参考指标偏重像素保真而非语义正确,二值 VQA 评测受 yes-bias 和低分辨率审查限制,且每次仅测单维度效率极低

贡献: 提出 WorldJen:用 Likert 量表替代二值 VQA,VLM 以原生分辨率评审,对抗性 Prompt 同时测试16个质量维度;建立2,696个人工偏好标注的 Bradley-Terry 评分作为人类基准

效果: VLM 评审的 Spearman ρ=1.000 完美复现人类三级评分结构,六项消融实验验证框架鲁棒性

批判点评: 仅50个 Prompt×6个模型的人类偏好规模偏小,三级评分结构信息粗糙;VLM 评审能力上限决定基准天花板

趋势观察

- 动漫风格视频生成 — 物理先验不适用于动漫,腾讯 AniMatrix 重新定义了"正确性"——从物理真实转向艺术正确,这一范式转变值得关注

- 视频 VAE 的可扩散性 — PV-VAE 揭示了一个关键洞察:重建质量≠生成质量,预测式学习才是提升视频潜空间质量的关键

- 自回归视频生成加速 — SCD 通过耦合采样实现 13.6x 无损加速,一行代码修改即可部署,工程价值极高

人工智能炼丹君 整理 | 2026-05-07

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描下方二维码关注

评论 (0)