搜索到

5

篇与

对齐

的结果

-

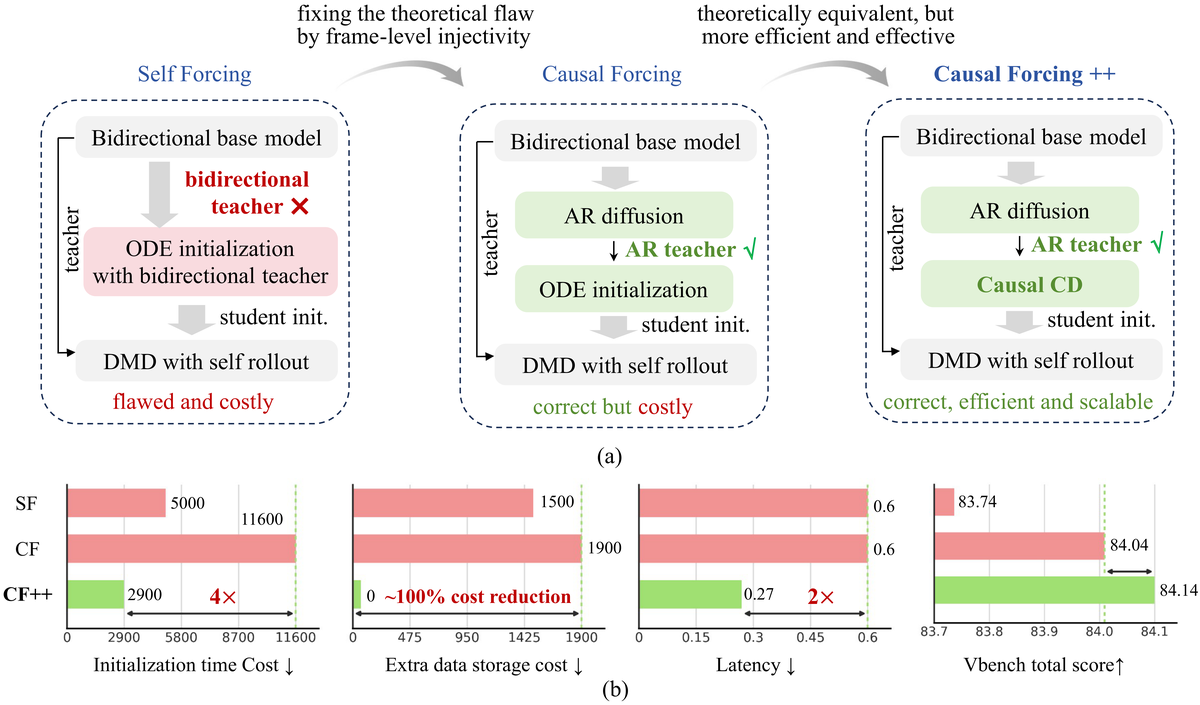

AIGC 每日速读|2026-05-29|生数科技minWM开源实时交互视频世界模型 今日 AIGC 论文速览 今日共 8 篇 · 视频世界模型 3 篇 · 流式视频生成 1 篇 · 音视频联合生成 1 篇 · 可控图像生成与数据 2 篇 · 大模型记忆与微调 1 篇 重点论文标题列表 minWM:实时交互视频世界模型全栈开源 NAVA:原生音视频对齐联合生成6.3B Gamma-World:多智能体生成式世界模型 AdaState:流式视频生成自演化锚点 YoCausal:视频生成因果性认知基准 今日论文速览 1. minWM:实时交互视频世界模型全栈开源 minWM: A Full-Stack Open-Source Framework for Real-Time Interactive Video World Models | 生数科技, 清华大学 | arXiv:2605.30263 关键词:视频世界模型·实时交互·自回归蒸馏·开源·生数科技 前序问题:视频扩散基础模型已能高质量出片,但把它变成实时交互视频世界模型仍然难:交互世界模型需要可控、因果、低延迟的 rollout,实践上要打通数据构造、可控微调、自回归训练、少步蒸馏、流式推理整条链路,而开源社区一直缺一套能跑通的端到端 recipe 本文贡献:minWM:全栈开源框架,把现成的双向 T2V/TI2V 视频基础模型转成「相机可控 + 少步自回归」的世界模型。先对双向扩散做相机控制微调,再用 Causal Forcing / Causal Forcing++ 流程(AR diffusion 训练 + causal ODE/consistency 蒸馏 + 非对称 DMD)蒸成少步自回归生成器做低延迟 rollout。框架模块化、架构可扩展:在 Wan2.1-T2V-1.3B(cross-attention 条件注入)和 HY1.5-TI2V-8B(MMDiT)上分别实例化,还能把 HY-WorldPlay 等已有世界模型适配到新数据分布、训练配方与延迟目标 实验效果:不止放出可运行脚本、checkpoint、文档和推理代码,还给出相机轨迹质量、可控性训练步数、最小 batch size 等实战 ablation——是这个方向少见的「能跑起来、可复现、可扩展」的实时交互视频世界模型配方 (github.com/shengshu-ai/minWM) 批判点评:「全栈开源 + 跨两种主流架构(Wan2.1 cross-attn / HY1.5 MMDiT)实例化 + 可适配已有世界模型」三点让它成为这个方向稀缺的工程基建,对想做实时交互视频的团队意义重大。但框架 / recipe 类工作的核心价值在工程完整度而非单点创新;Causal Forcing++ 与非对称 DMD 联训的稳定性、长 rollout 的累积漂移控制还可以披露更多 2. NAVA:原生音视频对齐联合生成6.3B Native Audio-Visual Alignment for Generation | 百度 ERNIE | arXiv:2605.30073 关键词:音视频联合生成·原生对齐·MMDiT·音色可控·百度 前序问题:联合音视频生成要做到时序同步 + 语义连贯,但现有开源方案要么走「双塔 + 后验对齐」(弱化细粒度音视频协同演化),要么走「三模态全统一」(把语义条件和底层同步耦死在一起)——两条路线都有结构性缺陷 本文贡献:NAVA:context-conditioned 的原生音视频对齐框架。先在专用交互空间建立音视频对应关系,再用外部 context 条件化联合去噪。用 Align-then-Fuse MMDiT 架构实例化,从「模态感知的音视频对齐」平滑过渡到「模态共享的联合去噪」;并提出 Timbre-in-Context Conditioning,把参考音色线索关联到对应语音片段,实现可控语音音色 实验效果:在 Verse-Bench 和 Seed-TTS 上配合用户研究表明:仅用 6.3B 参数即取得更优视频质量、精确的音视频同步、有竞争力的音频质量,以及更强的参考音色可控性 批判点评:「先对齐后融合」而非「一上来全统一」的设计直击双塔 / 三模态两条路线的痛点,6.3B 拿下多项指标性价比很高;Timbre-in-Context 把音色可控做进 context 是干净的设计。但「专用交互空间 + 联合去噪」的两阶段是否引入额外训练复杂度、对更长音视频的扩展性仍需观察 3. Gamma-World:多智能体生成式世界模型 Gamma-World: Generative Multi-Agent World Modeling Beyond Two Players | NVIDIA, 清华大学 | arXiv:2605.28816 关键词:多智能体·世界模型·RoPE·稀疏注意力·NVIDIA 前序问题:交互式视频世界模型大多聚焦单 agent(从单一控制信号生成未来观测),但很多生成环境需要多 agent 同时在共享空间行动(多玩家 / 机器人 / 具身体)。扩到多 agent 需要原则性设计:各 agent 独立可控、排列对称、推理高效,同时跨时间和视角保持一致 本文贡献:生成式多智能体世界模型。提出 Simplex Rotary Agent Encoding:3D RoPE 的无参扩展,把 agent 表示成旋转角空间里正单纯形的顶点,给每个 agent 不同相位又保持排列等价——无需学习 per-slot 身份或固定排序即可扩展 agent 身份;提出 Sparse Hub Attention:用可学习 hub token 中介跨 agent 交互,把跨 agent 注意力从二次降到线性。再把全上下文扩散 teacher 蒸成因果 student,带 KV cache 顺序生成时间块,实现 24FPS 的动作响应生成 实验效果:多人虚拟环境实验中,在视频保真度、动作可控性、agent 间一致性上超越 slot-based 和 dense-attention 基线,且无需额外训练即可从 2 玩家泛化到 4 玩家 批判点评:「用正单纯形顶点的旋转相位编码 agent 身份」是极优雅的无参设计——天然排列对称又可扩展;Sparse Hub Attention 把多 agent 注意力线性化是务实工程;从 2 人零样本泛化到 4 人很有说服力。但 hub token 数量与 agent 数的可扩展上限、长时序多 agent 一致性的退化曲线需要更大规模验证 4. AdaState:流式视频生成自演化锚点 AdaState: Self-Evolving Anchors for Streaming Video Generation | 弗吉尼亚理工 Virginia Tech | arXiv:2605.30349 关键词:流式视频生成·自回归扩散·自演化锚点·KV cache·时间相对 前序问题:自回归视频扩散逐块生成、每块条件于已生成内容,但模型结构性地「锚定在第一帧」:首帧 KV 占据注意力 cache 的特权位置、作为整段主场景参考。作为最干净无误差的位置,这个锚点吸走过多注意力,压制视频动态、把场景构图锁死在初始视角,结果是「时间上很浅」的视频——运动、镜头、场景推进都被静态一致性压制 本文贡献:用「自适应 state」替换静态锚点——一个隐 latent,模型每块和内容一起去噪但从不渲染。模型不再参考冻结的首帧,而是每步通过同时关注「前一 state + 当前内容」自己生成场景锚点,产出随生成内容演化的参考。不同于编码绝对时间的标准视频生成,本方法把时间当相对量:每个生成步看到相同的位置结构、state transition 每块都相同。这给生成过程引入了递归——去噪即 transition 函数,KV cache 即载体,无需任何外部模块 实验效果:实验表明自适应 state 大幅改善视频动态,让生成视频内出现更丰富的运动和更自然的场景推进 批判点评:「首帧 KV 锚点偷走注意力 → 视频时间上变浅」的诊断非常精准,用「可去噪但不渲染的隐 state」做自演化锚点是优雅的零外部模块方案,把时间从绝对改成相对的视角很有启发。但「丰富运动」与「时序一致性」本就是 trade-off,自演化锚点会不会牺牲长程一致性需要定量;缺与显式 memory / anchor 方法的正面对比 5. YoCausal:视频生成因果性认知基准 YoCausal: How Far is Video Generation from World Model? A Causality Perspective | 上海 AI Lab, 阳明交大 NYCU | arXiv:2605.30346 关键词:视频生成·世界模型·因果性·评测基准·上海AILab 前序问题:视频扩散模型(VDM)正走向世界模型,关键问题是:它们真懂因果,还是只过拟合统计时序模式?现有基准大多依赖合成数据,受 sim-to-real gap 限制真实世界泛化 本文贡献:YoCausal:受认知科学「违反预期(VoE)」范式启发的两级基准。零成本地把真实世界视频时序反转,作为天然反事实样本,建立可任意扩展的评测协议。Level 1 提出 Reverse Surprise Index (RSI),用去噪 loss 量化「时间箭头」感知;Level 2 提出 Causality Cognition Index (CCI),用 VLM 把数据分层成因果 / 非因果子集,把真正的因果推理从时序偏置中解耦 实验效果:评测 13 个 SOTA VDM 发现:感知到时间箭头并不意味着理解因果,且相对人类级因果认知仍存在显著差距 批判点评:「时序反转真实视频做零成本反事实」是极聪明的基准构造,RSI / CCI 两级指标把「时间感知」与「因果认知」分层解耦的思路很清晰,给「视频生成→世界模型」泼了必要的冷水。但用去噪 loss 衡量「惊讶度」是否完全等价于因果理解仍可争议;VLM 分层本身的可靠性会传导到 CCI 的结论 6. GenClaw:代码驱动的智能体图像生成 GenClaw: Code-Driven Agentic Image Generation | 中山大学 | arXiv:2605.30248 关键词:图像生成·智能体·代码驱动·可控生成·中山大学 前序问题:图像生成已从「文本条件像素合成」走向「具备视觉理解 + 工具调用的多模态 agent」,但现有 agent 仍受制于底层黑盒图像模型——工作流困在「为优化生成反复改 prompt」的循环里,没有直接操控画布的机制。LLM 作为精确视觉构建「画笔」的潜力基本未被开发 本文贡献:GenClaw:代码驱动的智能体图像生成范式,让 agent 像人类艺术家一样创作——先构思、再起草、最后上色。agent 先通过搜索和推理构建概念知识与上下文;再用代码(SVG / HTML / Three.js)渲染可执行的视觉草图;最后用图像生成模型补充纹理、材质、真实感。代码在此作为可控的中间画布,桥接语言推理与像素合成,把程序逻辑与生成模型的视觉表现力无缝整合 实验效果:把图像生成从黑盒范式转成类似真实人类创作的分阶段过程,朝着高度可控、可解释的视觉生成系统迈出一步 批判点评:「代码作中间画布」是把可控性问题转译成「可执行草图」的聪明思路——SVG / HTML / Three.js 草图天然结构化、可精确编辑,比反复改 prompt 强太多;构思-起草-上色的拟人流程也很有叙事性。但代码草图能表达的视觉复杂度有上限(精细写实场景难用 SVG 起草),最终仍依赖底层生成模型的「上色」能力;端到端延迟和失败率需要量化 7. GPIC:28万亿像素许可级图像语料 GPIC: A Giant Permissive Image Corpus for Visual Generation | 斯坦福 李飞飞团队 | arXiv:2605.30341 关键词:图像语料·视觉生成·许可数据集·flow matching·斯坦福 前序问题:研究可扩展的视觉生成方法需要大、可获取、稳定的数据集,但开放且许可清晰的大规模图像语料长期稀缺 本文贡献:GPIC:约 28 万亿像素的巨型许可图像语料。由 SOTA 视觉语言模型为多样互联网图像生成 caption,含 1 亿训练 + 20 万验证 + 100 万测试样本。所有图像均「研究 + 商用」许可宽松,经安全过滤、去重,集中托管于 Hugging Face。提供生成建模的 benchmark 协议,并给出像素空间 flow matching 的参考 baseline 实验效果:数据集、benchmark、模型全部开放(stanford-vision-lab/gpic);为视觉生成提供「大规模 + 许可清晰 + 稳定可复现」的公共底座 批判点评:「许可宽松 + 商用可用 + 安全去重 + 集中托管」直击当前生成数据集的版权 / 可复现痛点——这种基础设施工作对整个社区的长尾价值很高,28 万亿像素 + 完整 benchmark + baseline 让它即插即用。但「VLM 自动 caption」的质量上限会限制可训出的文本对齐能力;与 LAION 类已有大语料的去重重叠和质量差异需要更透明 8. Parametric Memory Law:LoRA参数记忆的幂律定律 How LoRA Remembers? A Parametric Memory Law for LLM Finetuning | 浙江大学, 阿里 | arXiv:2605.30260 关键词:LoRA·参数记忆·幂律·LLM微调·浙大 前序问题:LLM 需持续学习更新知识,LoRA 被广泛用于记忆更新,但现有研究多靠定性下游评测,对「精确参数记忆」的定量容量极限和底层动力学几乎没探索 本文贡献:用 LoRA 作为受控的记忆容量探针,在 latent 空间系统量化精确参数记忆。提出 Parametric Memory Law:把 loss 下降 ΔL 与有效参数量、序列长度联系起来的稳健幂律。token 级细粒度分析揭示确定性相变——证明预测概率 p>0.5 是 greedy decoding 下逐字召回的充分条件。据此提出 MemFT:阈值引导的优化策略,把训练预算动态重分配到次阈值 token 实验效果:实证表明 MemFT 能提升记忆保真度和效率;为「LoRA 到底记住多少、怎么记」给出可量化的定律而非定性结论 (github.com/zjunlp/ParametricMemoryLaw) 批判点评:「用 LoRA 当记忆容量探针 + 找出幂律 + p>0.5 相变的充分条件」是把模糊的「记忆能力」做成可量化科学定律的扎实工作,MemFT 把定律反哺成实际训练策略形成漂亮闭环。但幂律的普适性需要跨更多模型规模 / 任务验证;「逐字召回」的记忆与「泛化知识」的记忆是两回事,定律对后者的适用边界要谨慎 趋势观察 视频生成正在「世界模型化」:从出片段走向实时交互、多智能体、可因果 — minWM 把双向 T2V/TI2V 蒸成相机可控的少步自回归世界模型并全栈开源;Gamma-World 用单纯形旋转编码 + 稀疏 hub 注意力把世界模型从单 agent 扩到多 agent(2→4 人零样本泛化、24FPS);YoCausal 用时序反转真实视频做反事实基准,量出 13 个 SOTA VDM 距离「真懂因果」仍有显著差距——视频生成的下一站从「画面好」转向「能交互、有因果、多主体」 自回归流式视频生成开始解决「时间太浅」的结构病 — AdaState 诊断出首帧 KV 锚点偷走注意力、把场景锁死在初始视角,改用「可去噪但不渲染的自演化隐 state」做相对时间锚点,显著改善运动和场景推进——流式视频生成从「保一致」转向「敢动起来」 音视频联合生成走向「先对齐后融合」的原生范式 — NAVA 指出双塔后验对齐弱化协同、三模态全统一耦合语义与同步两条路都有缺陷,提出 Align-then-Fuse MMDiT 先在交互空间建音视频对应、再 context 条件化联合去噪,6.3B 拿下多项 SOTA + 可控音色——音视频生成的架构共识正在形成 图像生成的可控性升级:代码做中间画布、许可数据做底座 — GenClaw 用 SVG/HTML/Three.js 可执行草图作中间画布,把「反复改 prompt」换成「构思-起草-上色」的拟人可控流程;GPIC 放出 28 万亿像素、研究+商用许可宽松、安全去重的图像语料 + benchmark + flow matching baseline——可控生成的「方法」和「数据底座」被同时推进 大模型记忆与微调走向「可量化定律」 — How LoRA Remembers 用 LoRA 当记忆探针,给出 loss 下降 ΔL 与有效参数 / 序列长度的 Parametric Memory Law,发现 p>0.5 是逐字召回的充分条件,并据此提出阈值引导的 MemFT——把「LoRA 记多少」从定性评测推到可解析的幂律 人工智能炼丹君 整理 | 2026-05-29 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描下方二维码关注

AIGC 每日速读|2026-05-29|生数科技minWM开源实时交互视频世界模型 今日 AIGC 论文速览 今日共 8 篇 · 视频世界模型 3 篇 · 流式视频生成 1 篇 · 音视频联合生成 1 篇 · 可控图像生成与数据 2 篇 · 大模型记忆与微调 1 篇 重点论文标题列表 minWM:实时交互视频世界模型全栈开源 NAVA:原生音视频对齐联合生成6.3B Gamma-World:多智能体生成式世界模型 AdaState:流式视频生成自演化锚点 YoCausal:视频生成因果性认知基准 今日论文速览 1. minWM:实时交互视频世界模型全栈开源 minWM: A Full-Stack Open-Source Framework for Real-Time Interactive Video World Models | 生数科技, 清华大学 | arXiv:2605.30263 关键词:视频世界模型·实时交互·自回归蒸馏·开源·生数科技 前序问题:视频扩散基础模型已能高质量出片,但把它变成实时交互视频世界模型仍然难:交互世界模型需要可控、因果、低延迟的 rollout,实践上要打通数据构造、可控微调、自回归训练、少步蒸馏、流式推理整条链路,而开源社区一直缺一套能跑通的端到端 recipe 本文贡献:minWM:全栈开源框架,把现成的双向 T2V/TI2V 视频基础模型转成「相机可控 + 少步自回归」的世界模型。先对双向扩散做相机控制微调,再用 Causal Forcing / Causal Forcing++ 流程(AR diffusion 训练 + causal ODE/consistency 蒸馏 + 非对称 DMD)蒸成少步自回归生成器做低延迟 rollout。框架模块化、架构可扩展:在 Wan2.1-T2V-1.3B(cross-attention 条件注入)和 HY1.5-TI2V-8B(MMDiT)上分别实例化,还能把 HY-WorldPlay 等已有世界模型适配到新数据分布、训练配方与延迟目标 实验效果:不止放出可运行脚本、checkpoint、文档和推理代码,还给出相机轨迹质量、可控性训练步数、最小 batch size 等实战 ablation——是这个方向少见的「能跑起来、可复现、可扩展」的实时交互视频世界模型配方 (github.com/shengshu-ai/minWM) 批判点评:「全栈开源 + 跨两种主流架构(Wan2.1 cross-attn / HY1.5 MMDiT)实例化 + 可适配已有世界模型」三点让它成为这个方向稀缺的工程基建,对想做实时交互视频的团队意义重大。但框架 / recipe 类工作的核心价值在工程完整度而非单点创新;Causal Forcing++ 与非对称 DMD 联训的稳定性、长 rollout 的累积漂移控制还可以披露更多 2. NAVA:原生音视频对齐联合生成6.3B Native Audio-Visual Alignment for Generation | 百度 ERNIE | arXiv:2605.30073 关键词:音视频联合生成·原生对齐·MMDiT·音色可控·百度 前序问题:联合音视频生成要做到时序同步 + 语义连贯,但现有开源方案要么走「双塔 + 后验对齐」(弱化细粒度音视频协同演化),要么走「三模态全统一」(把语义条件和底层同步耦死在一起)——两条路线都有结构性缺陷 本文贡献:NAVA:context-conditioned 的原生音视频对齐框架。先在专用交互空间建立音视频对应关系,再用外部 context 条件化联合去噪。用 Align-then-Fuse MMDiT 架构实例化,从「模态感知的音视频对齐」平滑过渡到「模态共享的联合去噪」;并提出 Timbre-in-Context Conditioning,把参考音色线索关联到对应语音片段,实现可控语音音色 实验效果:在 Verse-Bench 和 Seed-TTS 上配合用户研究表明:仅用 6.3B 参数即取得更优视频质量、精确的音视频同步、有竞争力的音频质量,以及更强的参考音色可控性 批判点评:「先对齐后融合」而非「一上来全统一」的设计直击双塔 / 三模态两条路线的痛点,6.3B 拿下多项指标性价比很高;Timbre-in-Context 把音色可控做进 context 是干净的设计。但「专用交互空间 + 联合去噪」的两阶段是否引入额外训练复杂度、对更长音视频的扩展性仍需观察 3. Gamma-World:多智能体生成式世界模型 Gamma-World: Generative Multi-Agent World Modeling Beyond Two Players | NVIDIA, 清华大学 | arXiv:2605.28816 关键词:多智能体·世界模型·RoPE·稀疏注意力·NVIDIA 前序问题:交互式视频世界模型大多聚焦单 agent(从单一控制信号生成未来观测),但很多生成环境需要多 agent 同时在共享空间行动(多玩家 / 机器人 / 具身体)。扩到多 agent 需要原则性设计:各 agent 独立可控、排列对称、推理高效,同时跨时间和视角保持一致 本文贡献:生成式多智能体世界模型。提出 Simplex Rotary Agent Encoding:3D RoPE 的无参扩展,把 agent 表示成旋转角空间里正单纯形的顶点,给每个 agent 不同相位又保持排列等价——无需学习 per-slot 身份或固定排序即可扩展 agent 身份;提出 Sparse Hub Attention:用可学习 hub token 中介跨 agent 交互,把跨 agent 注意力从二次降到线性。再把全上下文扩散 teacher 蒸成因果 student,带 KV cache 顺序生成时间块,实现 24FPS 的动作响应生成 实验效果:多人虚拟环境实验中,在视频保真度、动作可控性、agent 间一致性上超越 slot-based 和 dense-attention 基线,且无需额外训练即可从 2 玩家泛化到 4 玩家 批判点评:「用正单纯形顶点的旋转相位编码 agent 身份」是极优雅的无参设计——天然排列对称又可扩展;Sparse Hub Attention 把多 agent 注意力线性化是务实工程;从 2 人零样本泛化到 4 人很有说服力。但 hub token 数量与 agent 数的可扩展上限、长时序多 agent 一致性的退化曲线需要更大规模验证 4. AdaState:流式视频生成自演化锚点 AdaState: Self-Evolving Anchors for Streaming Video Generation | 弗吉尼亚理工 Virginia Tech | arXiv:2605.30349 关键词:流式视频生成·自回归扩散·自演化锚点·KV cache·时间相对 前序问题:自回归视频扩散逐块生成、每块条件于已生成内容,但模型结构性地「锚定在第一帧」:首帧 KV 占据注意力 cache 的特权位置、作为整段主场景参考。作为最干净无误差的位置,这个锚点吸走过多注意力,压制视频动态、把场景构图锁死在初始视角,结果是「时间上很浅」的视频——运动、镜头、场景推进都被静态一致性压制 本文贡献:用「自适应 state」替换静态锚点——一个隐 latent,模型每块和内容一起去噪但从不渲染。模型不再参考冻结的首帧,而是每步通过同时关注「前一 state + 当前内容」自己生成场景锚点,产出随生成内容演化的参考。不同于编码绝对时间的标准视频生成,本方法把时间当相对量:每个生成步看到相同的位置结构、state transition 每块都相同。这给生成过程引入了递归——去噪即 transition 函数,KV cache 即载体,无需任何外部模块 实验效果:实验表明自适应 state 大幅改善视频动态,让生成视频内出现更丰富的运动和更自然的场景推进 批判点评:「首帧 KV 锚点偷走注意力 → 视频时间上变浅」的诊断非常精准,用「可去噪但不渲染的隐 state」做自演化锚点是优雅的零外部模块方案,把时间从绝对改成相对的视角很有启发。但「丰富运动」与「时序一致性」本就是 trade-off,自演化锚点会不会牺牲长程一致性需要定量;缺与显式 memory / anchor 方法的正面对比 5. YoCausal:视频生成因果性认知基准 YoCausal: How Far is Video Generation from World Model? A Causality Perspective | 上海 AI Lab, 阳明交大 NYCU | arXiv:2605.30346 关键词:视频生成·世界模型·因果性·评测基准·上海AILab 前序问题:视频扩散模型(VDM)正走向世界模型,关键问题是:它们真懂因果,还是只过拟合统计时序模式?现有基准大多依赖合成数据,受 sim-to-real gap 限制真实世界泛化 本文贡献:YoCausal:受认知科学「违反预期(VoE)」范式启发的两级基准。零成本地把真实世界视频时序反转,作为天然反事实样本,建立可任意扩展的评测协议。Level 1 提出 Reverse Surprise Index (RSI),用去噪 loss 量化「时间箭头」感知;Level 2 提出 Causality Cognition Index (CCI),用 VLM 把数据分层成因果 / 非因果子集,把真正的因果推理从时序偏置中解耦 实验效果:评测 13 个 SOTA VDM 发现:感知到时间箭头并不意味着理解因果,且相对人类级因果认知仍存在显著差距 批判点评:「时序反转真实视频做零成本反事实」是极聪明的基准构造,RSI / CCI 两级指标把「时间感知」与「因果认知」分层解耦的思路很清晰,给「视频生成→世界模型」泼了必要的冷水。但用去噪 loss 衡量「惊讶度」是否完全等价于因果理解仍可争议;VLM 分层本身的可靠性会传导到 CCI 的结论 6. GenClaw:代码驱动的智能体图像生成 GenClaw: Code-Driven Agentic Image Generation | 中山大学 | arXiv:2605.30248 关键词:图像生成·智能体·代码驱动·可控生成·中山大学 前序问题:图像生成已从「文本条件像素合成」走向「具备视觉理解 + 工具调用的多模态 agent」,但现有 agent 仍受制于底层黑盒图像模型——工作流困在「为优化生成反复改 prompt」的循环里,没有直接操控画布的机制。LLM 作为精确视觉构建「画笔」的潜力基本未被开发 本文贡献:GenClaw:代码驱动的智能体图像生成范式,让 agent 像人类艺术家一样创作——先构思、再起草、最后上色。agent 先通过搜索和推理构建概念知识与上下文;再用代码(SVG / HTML / Three.js)渲染可执行的视觉草图;最后用图像生成模型补充纹理、材质、真实感。代码在此作为可控的中间画布,桥接语言推理与像素合成,把程序逻辑与生成模型的视觉表现力无缝整合 实验效果:把图像生成从黑盒范式转成类似真实人类创作的分阶段过程,朝着高度可控、可解释的视觉生成系统迈出一步 批判点评:「代码作中间画布」是把可控性问题转译成「可执行草图」的聪明思路——SVG / HTML / Three.js 草图天然结构化、可精确编辑,比反复改 prompt 强太多;构思-起草-上色的拟人流程也很有叙事性。但代码草图能表达的视觉复杂度有上限(精细写实场景难用 SVG 起草),最终仍依赖底层生成模型的「上色」能力;端到端延迟和失败率需要量化 7. GPIC:28万亿像素许可级图像语料 GPIC: A Giant Permissive Image Corpus for Visual Generation | 斯坦福 李飞飞团队 | arXiv:2605.30341 关键词:图像语料·视觉生成·许可数据集·flow matching·斯坦福 前序问题:研究可扩展的视觉生成方法需要大、可获取、稳定的数据集,但开放且许可清晰的大规模图像语料长期稀缺 本文贡献:GPIC:约 28 万亿像素的巨型许可图像语料。由 SOTA 视觉语言模型为多样互联网图像生成 caption,含 1 亿训练 + 20 万验证 + 100 万测试样本。所有图像均「研究 + 商用」许可宽松,经安全过滤、去重,集中托管于 Hugging Face。提供生成建模的 benchmark 协议,并给出像素空间 flow matching 的参考 baseline 实验效果:数据集、benchmark、模型全部开放(stanford-vision-lab/gpic);为视觉生成提供「大规模 + 许可清晰 + 稳定可复现」的公共底座 批判点评:「许可宽松 + 商用可用 + 安全去重 + 集中托管」直击当前生成数据集的版权 / 可复现痛点——这种基础设施工作对整个社区的长尾价值很高,28 万亿像素 + 完整 benchmark + baseline 让它即插即用。但「VLM 自动 caption」的质量上限会限制可训出的文本对齐能力;与 LAION 类已有大语料的去重重叠和质量差异需要更透明 8. Parametric Memory Law:LoRA参数记忆的幂律定律 How LoRA Remembers? A Parametric Memory Law for LLM Finetuning | 浙江大学, 阿里 | arXiv:2605.30260 关键词:LoRA·参数记忆·幂律·LLM微调·浙大 前序问题:LLM 需持续学习更新知识,LoRA 被广泛用于记忆更新,但现有研究多靠定性下游评测,对「精确参数记忆」的定量容量极限和底层动力学几乎没探索 本文贡献:用 LoRA 作为受控的记忆容量探针,在 latent 空间系统量化精确参数记忆。提出 Parametric Memory Law:把 loss 下降 ΔL 与有效参数量、序列长度联系起来的稳健幂律。token 级细粒度分析揭示确定性相变——证明预测概率 p>0.5 是 greedy decoding 下逐字召回的充分条件。据此提出 MemFT:阈值引导的优化策略,把训练预算动态重分配到次阈值 token 实验效果:实证表明 MemFT 能提升记忆保真度和效率;为「LoRA 到底记住多少、怎么记」给出可量化的定律而非定性结论 (github.com/zjunlp/ParametricMemoryLaw) 批判点评:「用 LoRA 当记忆容量探针 + 找出幂律 + p>0.5 相变的充分条件」是把模糊的「记忆能力」做成可量化科学定律的扎实工作,MemFT 把定律反哺成实际训练策略形成漂亮闭环。但幂律的普适性需要跨更多模型规模 / 任务验证;「逐字召回」的记忆与「泛化知识」的记忆是两回事,定律对后者的适用边界要谨慎 趋势观察 视频生成正在「世界模型化」:从出片段走向实时交互、多智能体、可因果 — minWM 把双向 T2V/TI2V 蒸成相机可控的少步自回归世界模型并全栈开源;Gamma-World 用单纯形旋转编码 + 稀疏 hub 注意力把世界模型从单 agent 扩到多 agent(2→4 人零样本泛化、24FPS);YoCausal 用时序反转真实视频做反事实基准,量出 13 个 SOTA VDM 距离「真懂因果」仍有显著差距——视频生成的下一站从「画面好」转向「能交互、有因果、多主体」 自回归流式视频生成开始解决「时间太浅」的结构病 — AdaState 诊断出首帧 KV 锚点偷走注意力、把场景锁死在初始视角,改用「可去噪但不渲染的自演化隐 state」做相对时间锚点,显著改善运动和场景推进——流式视频生成从「保一致」转向「敢动起来」 音视频联合生成走向「先对齐后融合」的原生范式 — NAVA 指出双塔后验对齐弱化协同、三模态全统一耦合语义与同步两条路都有缺陷,提出 Align-then-Fuse MMDiT 先在交互空间建音视频对应、再 context 条件化联合去噪,6.3B 拿下多项 SOTA + 可控音色——音视频生成的架构共识正在形成 图像生成的可控性升级:代码做中间画布、许可数据做底座 — GenClaw 用 SVG/HTML/Three.js 可执行草图作中间画布,把「反复改 prompt」换成「构思-起草-上色」的拟人可控流程;GPIC 放出 28 万亿像素、研究+商用许可宽松、安全去重的图像语料 + benchmark + flow matching baseline——可控生成的「方法」和「数据底座」被同时推进 大模型记忆与微调走向「可量化定律」 — How LoRA Remembers 用 LoRA 当记忆探针,给出 loss 下降 ΔL 与有效参数 / 序列长度的 Parametric Memory Law,发现 p>0.5 是逐字召回的充分条件,并据此提出阈值引导的 MemFT——把「LoRA 记多少」从定性评测推到可解析的幂律 人工智能炼丹君 整理 | 2026-05-29 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描下方二维码关注 -

AIGC 每日速读|2026-05-28|北大OSP-Next视频生成跨硬件加速 今日 AIGC 论文速览 今日共 11 篇 · 视频生成全栈加速 4 篇 · 视频生成新能力 2 篇 · 音频统一生成 2 篇 · 语音合成与编辑 2 篇 · 扩散模型对齐 1 篇 重点论文标题列表 OSP-Next:稀疏+量化+RL全栈视频生成1.64x PARE:视频DiT结构剪枝+动态路由 ⚡ Quantized Keys Steal Attention:KV缓存量化的Jensen偏差校正 SVDQuant-GPTQ:W4A4量化Wan2.2-I2V省内存59.3% Dasheng AudioGen:首个文生混合音频场景统一模型 今日论文速览 1. OSP-Next:稀疏+量化+RL全栈视频生成1.64x OSP-Next: Efficient High-Quality Video Generation with Sparse Sequence Parallelism, HiF8 Quantization, and Reinforcement Learning | 北大袁粒组, 华为 | arXiv:2605.28691 关键词:视频生成·稀疏注意力·序列并行·HiF8·北大袁粒组 ⚠️ 前序问题:Diffusion Transformer 在视频生成上已经能出好东西,但 full attention 二次开销死死压住效率。前人方案各做一段(稀疏 / 量化 / 蒸馏),缺一套能同时打通通信、计算、精度的端到端方案——尤其在「多卡序列并行」上和「跨国产硬件」上 本文贡献:OSP-Next:把稀疏注意力 + 序列并行 + 量化 + RL 后训练全栈打通的高效 T2V 框架。Skiparse-2D Attention 在空间维做 token-wise + group-wise 稀疏并保留 FlashAttention 兼容;提出 Sparse Sequence Parallelism (SSP) 用一次 All-to-All 切换稀疏模式,相比 Ulysses SP 通信量降低 75%;HiF8 量化支持 8-bit 联合训练 + 稀疏 fine-tune;Mix-GRPO 后训练弥补稀疏模型的质量回退 实验效果:VBench 总分 83.73% 超越 Wan2.1 基线;5 秒 720P/768P 设置下,H200 单 GPU 加速 1.64×,8 GPU 加速 1.52×;OSP-Next-HiF8 仅掉 0.4% 分数即可在国产昇腾 Ascend 950PR 上拿到 1.69× 和 2.27× 加速——是少见的同时验证国际/国产硬件的视频生成加速方案 批判点评:「稀疏注意力 + 序列并行 + 量化 + RL」四件套全栈打通,每一件单独不算新,但 SSP 把通信量直接打掉 75% 是非常硬的工程数字;跨 H200 + 昇腾的双硬件验证为国产硬件视频生成提供了稀缺的实证。但 Skiparse-2D 是 fixed pattern,对极复杂运动场景的可适配性需要看;Mix-GRPO 与 SSP 联训的稳定性细节披露还可以更多 2. PARE:视频DiT结构剪枝+动态路由 PARE: Pruning and Adaptive Routing for Efficient Video Generation | 港中文 CUHK, 上海 AI Lab, 悉尼大学 | arXiv:2605.27336 关键词:视频 DiT·结构剪枝·动态路由·Wan2.1-14B·上海 AI Lab ⚠️ 前序问题:Video DiT 又宽(block 宽)又深(架构深)又要多步采样,部署成本极高。前人通过压宽/压深/压步数减成本,但都 commit 到固定架构——不能针对单个输入或不同去噪阶段动态调整 本文贡献:PARE:把宽度剪枝和深度自适应路由联合做。宽度上观察到 attention head 自然分化为空间 vs 时序角色,设计区分两类的 importance scoring 避免「运动关键的 temporal head」被过早剪掉;深度上训轻量 router 以 denoising timestep + 视觉内容为条件,动态选择每步执行哪些 block——实现「按输入动态计算」而非静态删除。两阶段 progressive pipeline 先用蒸馏修复宽度剪枝的质量损失,再联合优化 student + router 解耦学习目标 实验效果:在 Wan2.1-14B 上对 I2V 和 T2V 都大幅降低每步算力且保住 VBench 各维度质量;与 step 蒸馏天然可组合进一步加速——把「静态剪枝」时代翻篇成「动态路由按需算」 批判点评:「区分空间/时序 head 重要性 + denoising-step 条件的 block router」两个洞察都直击 Video DiT 的结构性冗余。动态路由实现「按输入按 timestep 算」是 efficient video gen 的下一阶段方向。但 router 本身的训练稳定性、推理时的额外 overhead、以及与 OSP-Next 类静态稀疏组合后的边际收益需要更细 ablation 3. Quantized Keys Steal Attention:KV缓存量化的Jensen偏差校正 Quantized Keys Steal Attention: Bias Correction for KV-Cache Compression in Video Diffusion | 慕尼黑工大 TUM, Tensordyne | arXiv:2605.26266 关键词:视频扩散·KV cache·INT2 量化·Jensen 偏差·长视频 ⚠️ 前序问题:chunk-wise 自回归视频扩散依赖前序 chunk 的 KV cache 避免重复计算,但视频越长 cache 越大,量化 KV 到低 bit 又会显著掉画质。掉画质的根因是什么?以前没人说清楚 本文贡献:首次明确指出根因:softmax 注意力中 exp 的凸性让量化噪声系统性放大「被 cache 的 keys」对注意力的贡献——作者命名为 Jensen bias(量化的 keys 会偷走当前 chunk 的注意力质量)。给出 per-attention-score 的解析修正项,在 expectation 上消除该 bias,只用量化 step size 和 query norm 即可在线算;用二阶 Taylor 近似让额外计算开销可忽略、无需额外显存 实验效果:在 MAGI-1 / SkyReels-V2 / HY-WorldPlay 三个长视频模型上 INT2 量化即可恢复大部分掉的质量、接近 BF16;用 50% 更少显存的 INT2 反而能超过 INT4——长视频 KV cache 压缩拿到新的帕累托前沿 批判点评:把「量化掉画质」从经验问题改写成「Jensen 偏差」这一可解析的统计现象是真正的科学贡献——一行公式校正、零额外显存就拿到 INT2 ≈ BF16 的质量。这种「找根因 + 闭式解」的工作含金量高。但局限在 chunk-wise AR 视频扩散,对非 AR 的全局扩散 KV 压缩不直接适用;与 SmoothQuant 等激活/权重路线的组合策略还可探索 4. SVDQuant-GPTQ:W4A4量化Wan2.2-I2V省内存59.3% Timestep-Aware SVDQuant-GPTQ for W4A4 Quantization of Wan2.2-I2V | 华中科技大学 HUST | arXiv:2605.27003 关键词:W4A4 量化·Wan2.2·MoE DiT·SVDQuant·华中科大 ⚠️ 前序问题:把大型视频 DiT 推到 W4A4 量化可以省一大块显存,但两道坎卡死:(1) 稀疏的「大幅激活 outlier」;(2) 不同去噪 timestep 的激活分布漂移很大。这两个问题在 Wan2.2-I2V 双专家 MoE DiT(高噪/低噪两个 expert 量化敏感度完全不同)下被进一步放大——单一全局校准策略根本拿不下 本文贡献:Timestep-Aware SVDQuant-GPTQ:(1) SVDQuant-based 低秩 outlier 补偿处理激活大幅 outlier;(2) GPTQ 重建感知残差权重量化;(3) timestep-bin-wise 逐层激活 clipping-ratio 搜索,对每个 MoE expert 独立完成。三件套合起来就是「按 expert + 按 timestep」精细化校准的 PTQ 框架 实验效果:在 OpenS2V-Eval 上相对 BF16 把峰值 GPU 内存降 59.3%,VBench 平均分仅掉 0.9%,Imaging Quality 仅掉 2.3%——证明「expert + timestep 双感知校准」是 MoE 视频 DiT 量化高保真的必要条件 批判点评:把 MoE DiT 量化从「全局校准」拉到「按 expert + 按 timestep」是正确的颗粒度切分——双专家的量化敏感度本来就不同,强行全局必然掉点。59.3% 内存降 + <1% 质量损是漂亮的工业数字。但 PTQ 路线天然依赖 calibration set 质量,长视频/复杂运动的覆盖度需要追踪;与昨天 RT-Lynx 类激活稀疏的组合潜力值得探索 5. Dasheng AudioGen:首个文生混合音频场景统一模型 Dasheng AudioGen: A Unified Model for Generating Coherent Audio Scenes from Text | 小米, 上海交大 | arXiv:2605.27838 关键词:音频场景生成·multi-view caption·flow matching·小米·DiT ⚠️ 前序问题:音频生成长期被「按域切分」——语音、音乐、音效各有独立模型——做不到从一句描述生成「同时包含人声 + 背景音乐 + 环境音效」的连贯混合音频场景。两大障碍:缺真实混合音频的细粒度监督;声学表示难以同时承载多个并发音频组件 本文贡献:Dasheng AudioGen:首个统一生成混合音频场景的端到端框架。两个核心:(i) structured multi-view captions——把复杂声学场景显式解耦成互补的描述视图,让每个音频层都有细粒度控制;(ii) 高维统一「语义-声学」表示作为共享 latent,注入语义先验加速跨模态训练收敛,同时高维特征空间提供解耦并发声音组件的容量。在此基础上一个简单的 flow-matching DiT 就能跑出端到端高质量音频场景生成 实验效果:在混合音频类别接近真实录音质量,单类型生成(speech/music/SFX)也与专用模型打平——首次把「视觉生成里图文统一」的思路真正落到音频场景上;配套建立音频场景生成的综合评测 pipeline 批判点评:「structured multi-view captions + 高维语义-声学统一 latent」是非常对症的两个设计——把音频域的「描述粒度」和「表示容量」都拉到能容纳混合场景的层次。flow-matching DiT 的工程极简性也很好。但 multi-view caption 的自动构造成本/质量、高维 latent 增加的 DiT 训练开销,以及与商用 ElevenLabs Sound Effect / Stable Audio 2 的端到端对比都需要更细评测 6. HarmoVid:视频肖像重打光和谐化稳定不闪烁 HarmoVid: Relightful Video Portrait Harmonization | Adobe Research, UNC | arXiv:2605.28811 关键词:视频肖像·relight 和谐化·deflicker·alpha mask·Adobe ⚠️ 前序问题:把人物前景视频和谐到目标背景场景(同步阴影、色调、光照强度——relightful harmonization)的硬伤是:视频域没法采集「同一动作不同光照」的成对标注数据。最直接的方案——「按帧调用图像和谐模型」——会带来严重时序抖动(flicker) 本文贡献:HarmoVid 给出整套视频和谐化方案:(i) 全新的 lighting deflickering 模型稳定全局和局部光照 flicker,把「逐帧 image-harmonization」的输出升级成可监督的 paired 视频数据;(ii) 视频扩散模型在 deflickered 真实 + 合成视频上学习;(iii) asymmetric alpha mask conditioning 让模型从真实视频里学到干净的边界 实验效果:在时序连贯、自然度、边界干净度、物理合理光照行为多个维度超越此前所有 image-based 和 video-based 和谐化方法;relighting 表现力也保住——人物视频合成 / 后期合成的标准工业链路被显著升级 批判点评:用「先 deflicker 再训练」绕开「无成对数据」的死结是非常聪明的——deflicker 把单帧图像和谐输出转化成可用监督,是真正的杠杆点。asymmetric alpha mask 也很实用。但 deflicker 模型本身的失败模式(强光/复杂阴影)会传导到下游;与 Adobe 自家的商业级合成工具的真实对比需要更细评测 7. SmartDirector:多关键帧条件电影级视频叙事控制 SmartDirector: Keyframe-Conditioned Cinematic Video Generation with Narrative Pacing Control | 国内视频生成团队 | arXiv:2605.27891 关键词:电影级视频·多关键帧·叙事节奏·两阶段·Director-Gen/SR ⚠️ 前序问题:视频的「叙事质量」决定感知价值,但现有视频生成方法主要靠 text prompt 或首尾帧这类稀疏 condition——对叙事结构和时序节奏的精确控制非常有限,导出不了真正「有 pacing 的电影感视频」 本文贡献:SmartDirector:以多关键帧增强视频生成的叙事能力。支持单镜头、多镜头叙事合成、视频延展三类场景。两阶段:(i) Director-Gen 在低分辨率上以关键帧为条件生成;(ii) Director-SR 利用高分辨率关键帧作为语义锚点把细粒度细节补回来。配套数据管线从电影中精选单镜头/多镜头序列以支撑多关键帧训练 实验效果:在多个评测上大幅超越 SOTA,把视频生成从「按 prompt 出 5 秒片段」升级到「按多关键帧出有节奏的多镜头序列」——电影级视频生成的可控性接近真实创作工作流 批判点评:「多关键帧 + 两阶段先粗后细」直击「电影级叙事控制」的实际痛点——单 prompt / 首尾帧确实远远不够。两阶段把分辨率 vs 叙事控制解耦是合理设计。但「关键帧」的获取成本(人工/AI辅助)和叙事节奏的可量化评测仍是模糊地带;多镜头切换的时空一致性细节需要更深 ablation 8. LoSATok:1280维语义压缩到128维统一audio LoSATok: Low-dimensional Semantic-Acoustic Tokenizer for Cross-Domain Audio Understanding and Generation | 清华深圳, 面壁智能 | arXiv:2605.27840 关键词:audio tokenizer·128 维·语义瓶颈·清华深圳·面壁 ⚠️ 前序问题:音频 tokenizer 是统一「音频理解」和「音频生成」的根基。理解需要高层语义;生成需要语义 + 声学细节。现有统一 tokenizer 在高维连续 latent 里同时编码——这增加了 DiT 生成端的建模负担 本文贡献:LoSATok:观察到 1280 维语义 encoder 特征是可压缩的,引入 Semantic Bottleneck 压到 128 维,并用 time-relation loss 保时序特征一致性;再用「双层级语义监督」同时利用高维/低维语义信号——让 tokenizer 在紧凑 latent 空间里同时承载语义和声学细节 实验效果:在 speech / music / 通用 audio 上 SemBo 保住强低维语义容量,LoSATok 与多个语义表示比较 understanding 性能仍有竞争力;在 DiT 端的 speech / music / audio 生成上一致改进——证明「低维 audio 表示也能同时支撑理解与生成」 批判点评:把「audio 统一 tokenizer」的维度从 1280 砍到 128 是非常硬的容量压缩——若真的不掉理解还能提升生成,那就解掉了「audio 统一表示卡 DiT」的关键梗。time-relation loss + 双层级语义监督是合理工程。但 128 维下声学细节的极限(音乐复杂混音、长 reverb)需要更细测试;与 Dasheng AudioGen 高维路线的端到端比较是行业级议题 9. CosyEdit2:GRPO语音编辑反哺零样本TTS CosyEdit2: Speech-Editing-Oriented Reinforcement Learning Unlocks Better Zero-Shot TTS | 南开大学 | arXiv:2605.25930 关键词:语音编辑·GRPO·zero-shot TTS·南开大学·post-training ⚠️ 前序问题:语音编辑和 zero-shot TTS 同源于「prompt 驱动的语音生成」,但语音编辑对「与周围未编辑内容的局部声学一致性」要求严苛得多。SFT 让 TTS 模型获得编辑能力的路线被卡在「成对编辑数据不完美 + 优化信号粗粒度」 本文贡献:CosyEdit2:建立「先 SFT 初始化 → 再 editing-oriented GRPO 后训练」的两阶段框架。GRPO 阶段在「无目标语音」的数据上做,把语音编辑当作 RL 任务优化,让模型从粗粒度匹配走向精细局部声学一致 实验效果:不仅在语音编辑上显著提升,还反哺 zero-shot TTS 能力——揭示「编辑任务 ↔ 合成任务」之间隐藏的相互增益;GRPO 在 audio 域被验证是有效的 post-training 范式 批判点评:把 GRPO 引入 audio 域、并用「编辑反哺合成」这个新角度证明两个任务的深层互助,是非常聪明的科学故事。无目标语音的 RL 设计也比依赖成对数据更可扩展。但 GRPO 的 reward 设计细节、跨语种/多说话人鲁棒性、以及对 prosody 细节的影响需要更系统评测 10. PilotTTS:高德200K小时开源TTS竞品级 PilotTTS: A Disciplined Modular Recipe for Competitive Speech Synthesis | 高德 AMAP | arXiv:2605.27258 关键词:TTS·200K 小时·开源·Q-Former·高德 AMAP ⚠️ 前序问题:SOTA TTS 系统通常需要数百万小时专有数据 + 多阶段复杂架构——这对资源受限的研究团队是几乎跨不过去的门槛。开源社区想自己训出竞品级 TTS 一直缺成熟 recipe 本文贡献:PilotTTS:高德 AMAP 用「最小化架构 + 严格数据工程」做出竞品级轻量自回归 TTS。仅用 200K 小时数据 + 全开源工具处理。两大贡献:(i) 可复现的多阶段数据处理 pipeline(质量评估 + 标签标注 + 过滤);(ii) Q-Former conditioning 紧凑模型架构,通过 cross-sample paired training 解耦说话人身份与说话风格。统一框架支持 zero-shot voice cloning / 11 类情感合成 / 4 类副语言合成 / 14 种中文方言 实验效果:在 Seed-TTS Eval 上 test-en WER 1.50%(最低)、test-zh CER 0.87%;两个测试集说话人相似度都最高(0.862 / 0.815)——超越使用大得多数据集训出来的系统。完整 data pipeline + 预训练权重 + 代码全开源 (AMAPVOICE/PilotTTS) 批判点评:「200K 小时 + 开源工具 + 极简架构」做出超越百万小时专有数据系统的 TTS——是非常有信号量的开源胜利,对中小团队意义重大。Q-Former 解耦说话人/风格的设计也是 clean。但 PilotTTS 主打数据工程而非架构创新,复现门槛仍在「数据处理 pipeline 的工程细节」;与昨天 LongCat-Avatar 类「audio + 视频联合」的下一步集成是开放问题 11. LAIR:扩散模型从成对偏好升级到列表对齐 Beyond Pairwise Preferences: Listwise Reward-Aware Alignment for Diffusion Models | 斯坦福, 加州理工 Caltech | arXiv:2605.26491 关键词:diffusion 对齐·listwise preference·advantage-weighted·Stanford·Ermon ⚠️ 前序问题:preference optimization 已成 RLHF 之外对齐 T2I 扩散的高效替代,但现有方法基本都把监督降到 binary pairwise——这在「同 prompt 有多张候选 + 有连续 reward 分数」时严重浪费信息(一个 winner-loser 标签远远没用上 reward 分布) 本文贡献:Diffusion LAIR:reward-aware listwise preference optimization。每个 prompt 把候选组的 reward 分数转成中心化 advantage 权重,再优化「advantage-weighted regression」目标——目标定义在 implicit reward(当前模型 vs 固定参考模型的 denoising-loss 改进量)上,配二次惩罚正则隐式 reward 幅度。结果是同时用所有候选而非选 pair,并保持保守。LAIR 目标在 implicit-reward 空间有 bounded closed-form 最优解,把正则强度 → 偏好更新幅度的关系写清楚 实验效果:在 SD1.5 / SDXL 上对 T2I 生成 / 组合生成 / 图像编辑 benchmark 都超越 strong pairwise preference optimization baseline;为 diffusion 对齐提供「更接近 RLHF reward 信息密度但不需在线 RL」的中间路线 批判点评:把 DPO 类 pairwise 升级到 listwise + 给出 closed-form 最优解的清晰表述是教科书级的方法工作——既保留 offline 偏好优化的稳定性,又用上了 reward score 的全部信息。但 listwise 数据采集成本高于 pairwise(要 N 张同 prompt 候选 + reward 分),实际落地的数据可得性是隐藏成本;与 in-context 在线 RL(GRPO 类)的端到端比较略浅 趋势观察 视频生成进入「全栈加速」时代:稀疏 + 量化 + 并行 + 路由 + RL 多管齐下 — OSP-Next 把稀疏注意力 + Sparse Sequence Parallelism(通信 -75%)+ HiF8 量化 + Mix-GRPO 一锅端,跨 H200 / 昇腾双硬件分别 1.64× / 2.27× 加速;PARE 联合宽度剪枝 + 动态深度路由,在 Wan2.1-14B 上按输入按 timestep 动态算;SVDQuant-GPTQ 把 Wan2.2 双专家 MoE DiT 推到 W4A4 显存降 59.3%——视频生成的工业部署正在被「全栈加速」改写 长视频 KV cache 压缩出现「找根因 + 闭式解」类突破 — Quantized Keys Steal Attention 首次把「量化 KV 掉画质」从经验现象写成 Jensen bias(exp 凸性放大 cache key 贡献)的可解析统计现象,一行公式校正零额外显存,让 MAGI-1 / SkyReels-V2 / HY-WorldPlay 在 INT2 上接近 BF16——把 chunk-wise AR 长视频的 KV 压缩从「玄学调参」推到「有理论的工程」 音频生成统一化:从「按域切分」走向「一句描述出混合场景」 — Dasheng AudioGen 是首个能从一句描述同时生成 speech + music + SFX 混合连贯场景的统一模型,关键是 structured multi-view captions + 高维语义-声学统一 latent;LoSATok 反过来把 1280 维语义压到 128 维统一 tokenizer 反哺 DiT 生成;CosyEdit2 在 audio 域用 GRPO 把「编辑」反哺「TTS」——audio 正在重走视觉「统一模型」的同一条路 视频生成的「叙事控制」与「视频后期」继续拓宽到工业链路 — SmartDirector 把视频生成从「按 prompt 出 5 秒片段」升级到「多关键帧 + 两阶段先粗后细」做电影级叙事节奏控制;HarmoVid 用 deflicker 模型破解「视频和谐化无成对数据」的死结,把视频肖像 relight 和谐化做到工业级稳定——视频生成的可控性从「内容」深入到「节奏」和「后期合成」 开源 TTS / 对齐方法补齐 audio + diffusion 的「最后一公里」 — 高德 PilotTTS 用 200K 小时 + 开源工具 + Q-Former 极简架构做出超越百万小时专有系统的开源 TTS(Seed-TTS Eval 第一);Diffusion LAIR 把 T2I 对齐从 pairwise 升级到 listwise,给出 implicit-reward 的 closed-form 最优解——开源社区在 audio 合成 + diffusion 对齐这两个长期被闭源霸占的方向同时迈出了「竞品级 + 理论级」的双台阶 人工智能炼丹君 整理 | 2026-05-28

AIGC 每日速读|2026-05-28|北大OSP-Next视频生成跨硬件加速 今日 AIGC 论文速览 今日共 11 篇 · 视频生成全栈加速 4 篇 · 视频生成新能力 2 篇 · 音频统一生成 2 篇 · 语音合成与编辑 2 篇 · 扩散模型对齐 1 篇 重点论文标题列表 OSP-Next:稀疏+量化+RL全栈视频生成1.64x PARE:视频DiT结构剪枝+动态路由 ⚡ Quantized Keys Steal Attention:KV缓存量化的Jensen偏差校正 SVDQuant-GPTQ:W4A4量化Wan2.2-I2V省内存59.3% Dasheng AudioGen:首个文生混合音频场景统一模型 今日论文速览 1. OSP-Next:稀疏+量化+RL全栈视频生成1.64x OSP-Next: Efficient High-Quality Video Generation with Sparse Sequence Parallelism, HiF8 Quantization, and Reinforcement Learning | 北大袁粒组, 华为 | arXiv:2605.28691 关键词:视频生成·稀疏注意力·序列并行·HiF8·北大袁粒组 ⚠️ 前序问题:Diffusion Transformer 在视频生成上已经能出好东西,但 full attention 二次开销死死压住效率。前人方案各做一段(稀疏 / 量化 / 蒸馏),缺一套能同时打通通信、计算、精度的端到端方案——尤其在「多卡序列并行」上和「跨国产硬件」上 本文贡献:OSP-Next:把稀疏注意力 + 序列并行 + 量化 + RL 后训练全栈打通的高效 T2V 框架。Skiparse-2D Attention 在空间维做 token-wise + group-wise 稀疏并保留 FlashAttention 兼容;提出 Sparse Sequence Parallelism (SSP) 用一次 All-to-All 切换稀疏模式,相比 Ulysses SP 通信量降低 75%;HiF8 量化支持 8-bit 联合训练 + 稀疏 fine-tune;Mix-GRPO 后训练弥补稀疏模型的质量回退 实验效果:VBench 总分 83.73% 超越 Wan2.1 基线;5 秒 720P/768P 设置下,H200 单 GPU 加速 1.64×,8 GPU 加速 1.52×;OSP-Next-HiF8 仅掉 0.4% 分数即可在国产昇腾 Ascend 950PR 上拿到 1.69× 和 2.27× 加速——是少见的同时验证国际/国产硬件的视频生成加速方案 批判点评:「稀疏注意力 + 序列并行 + 量化 + RL」四件套全栈打通,每一件单独不算新,但 SSP 把通信量直接打掉 75% 是非常硬的工程数字;跨 H200 + 昇腾的双硬件验证为国产硬件视频生成提供了稀缺的实证。但 Skiparse-2D 是 fixed pattern,对极复杂运动场景的可适配性需要看;Mix-GRPO 与 SSP 联训的稳定性细节披露还可以更多 2. PARE:视频DiT结构剪枝+动态路由 PARE: Pruning and Adaptive Routing for Efficient Video Generation | 港中文 CUHK, 上海 AI Lab, 悉尼大学 | arXiv:2605.27336 关键词:视频 DiT·结构剪枝·动态路由·Wan2.1-14B·上海 AI Lab ⚠️ 前序问题:Video DiT 又宽(block 宽)又深(架构深)又要多步采样,部署成本极高。前人通过压宽/压深/压步数减成本,但都 commit 到固定架构——不能针对单个输入或不同去噪阶段动态调整 本文贡献:PARE:把宽度剪枝和深度自适应路由联合做。宽度上观察到 attention head 自然分化为空间 vs 时序角色,设计区分两类的 importance scoring 避免「运动关键的 temporal head」被过早剪掉;深度上训轻量 router 以 denoising timestep + 视觉内容为条件,动态选择每步执行哪些 block——实现「按输入动态计算」而非静态删除。两阶段 progressive pipeline 先用蒸馏修复宽度剪枝的质量损失,再联合优化 student + router 解耦学习目标 实验效果:在 Wan2.1-14B 上对 I2V 和 T2V 都大幅降低每步算力且保住 VBench 各维度质量;与 step 蒸馏天然可组合进一步加速——把「静态剪枝」时代翻篇成「动态路由按需算」 批判点评:「区分空间/时序 head 重要性 + denoising-step 条件的 block router」两个洞察都直击 Video DiT 的结构性冗余。动态路由实现「按输入按 timestep 算」是 efficient video gen 的下一阶段方向。但 router 本身的训练稳定性、推理时的额外 overhead、以及与 OSP-Next 类静态稀疏组合后的边际收益需要更细 ablation 3. Quantized Keys Steal Attention:KV缓存量化的Jensen偏差校正 Quantized Keys Steal Attention: Bias Correction for KV-Cache Compression in Video Diffusion | 慕尼黑工大 TUM, Tensordyne | arXiv:2605.26266 关键词:视频扩散·KV cache·INT2 量化·Jensen 偏差·长视频 ⚠️ 前序问题:chunk-wise 自回归视频扩散依赖前序 chunk 的 KV cache 避免重复计算,但视频越长 cache 越大,量化 KV 到低 bit 又会显著掉画质。掉画质的根因是什么?以前没人说清楚 本文贡献:首次明确指出根因:softmax 注意力中 exp 的凸性让量化噪声系统性放大「被 cache 的 keys」对注意力的贡献——作者命名为 Jensen bias(量化的 keys 会偷走当前 chunk 的注意力质量)。给出 per-attention-score 的解析修正项,在 expectation 上消除该 bias,只用量化 step size 和 query norm 即可在线算;用二阶 Taylor 近似让额外计算开销可忽略、无需额外显存 实验效果:在 MAGI-1 / SkyReels-V2 / HY-WorldPlay 三个长视频模型上 INT2 量化即可恢复大部分掉的质量、接近 BF16;用 50% 更少显存的 INT2 反而能超过 INT4——长视频 KV cache 压缩拿到新的帕累托前沿 批判点评:把「量化掉画质」从经验问题改写成「Jensen 偏差」这一可解析的统计现象是真正的科学贡献——一行公式校正、零额外显存就拿到 INT2 ≈ BF16 的质量。这种「找根因 + 闭式解」的工作含金量高。但局限在 chunk-wise AR 视频扩散,对非 AR 的全局扩散 KV 压缩不直接适用;与 SmoothQuant 等激活/权重路线的组合策略还可探索 4. SVDQuant-GPTQ:W4A4量化Wan2.2-I2V省内存59.3% Timestep-Aware SVDQuant-GPTQ for W4A4 Quantization of Wan2.2-I2V | 华中科技大学 HUST | arXiv:2605.27003 关键词:W4A4 量化·Wan2.2·MoE DiT·SVDQuant·华中科大 ⚠️ 前序问题:把大型视频 DiT 推到 W4A4 量化可以省一大块显存,但两道坎卡死:(1) 稀疏的「大幅激活 outlier」;(2) 不同去噪 timestep 的激活分布漂移很大。这两个问题在 Wan2.2-I2V 双专家 MoE DiT(高噪/低噪两个 expert 量化敏感度完全不同)下被进一步放大——单一全局校准策略根本拿不下 本文贡献:Timestep-Aware SVDQuant-GPTQ:(1) SVDQuant-based 低秩 outlier 补偿处理激活大幅 outlier;(2) GPTQ 重建感知残差权重量化;(3) timestep-bin-wise 逐层激活 clipping-ratio 搜索,对每个 MoE expert 独立完成。三件套合起来就是「按 expert + 按 timestep」精细化校准的 PTQ 框架 实验效果:在 OpenS2V-Eval 上相对 BF16 把峰值 GPU 内存降 59.3%,VBench 平均分仅掉 0.9%,Imaging Quality 仅掉 2.3%——证明「expert + timestep 双感知校准」是 MoE 视频 DiT 量化高保真的必要条件 批判点评:把 MoE DiT 量化从「全局校准」拉到「按 expert + 按 timestep」是正确的颗粒度切分——双专家的量化敏感度本来就不同,强行全局必然掉点。59.3% 内存降 + <1% 质量损是漂亮的工业数字。但 PTQ 路线天然依赖 calibration set 质量,长视频/复杂运动的覆盖度需要追踪;与昨天 RT-Lynx 类激活稀疏的组合潜力值得探索 5. Dasheng AudioGen:首个文生混合音频场景统一模型 Dasheng AudioGen: A Unified Model for Generating Coherent Audio Scenes from Text | 小米, 上海交大 | arXiv:2605.27838 关键词:音频场景生成·multi-view caption·flow matching·小米·DiT ⚠️ 前序问题:音频生成长期被「按域切分」——语音、音乐、音效各有独立模型——做不到从一句描述生成「同时包含人声 + 背景音乐 + 环境音效」的连贯混合音频场景。两大障碍:缺真实混合音频的细粒度监督;声学表示难以同时承载多个并发音频组件 本文贡献:Dasheng AudioGen:首个统一生成混合音频场景的端到端框架。两个核心:(i) structured multi-view captions——把复杂声学场景显式解耦成互补的描述视图,让每个音频层都有细粒度控制;(ii) 高维统一「语义-声学」表示作为共享 latent,注入语义先验加速跨模态训练收敛,同时高维特征空间提供解耦并发声音组件的容量。在此基础上一个简单的 flow-matching DiT 就能跑出端到端高质量音频场景生成 实验效果:在混合音频类别接近真实录音质量,单类型生成(speech/music/SFX)也与专用模型打平——首次把「视觉生成里图文统一」的思路真正落到音频场景上;配套建立音频场景生成的综合评测 pipeline 批判点评:「structured multi-view captions + 高维语义-声学统一 latent」是非常对症的两个设计——把音频域的「描述粒度」和「表示容量」都拉到能容纳混合场景的层次。flow-matching DiT 的工程极简性也很好。但 multi-view caption 的自动构造成本/质量、高维 latent 增加的 DiT 训练开销,以及与商用 ElevenLabs Sound Effect / Stable Audio 2 的端到端对比都需要更细评测 6. HarmoVid:视频肖像重打光和谐化稳定不闪烁 HarmoVid: Relightful Video Portrait Harmonization | Adobe Research, UNC | arXiv:2605.28811 关键词:视频肖像·relight 和谐化·deflicker·alpha mask·Adobe ⚠️ 前序问题:把人物前景视频和谐到目标背景场景(同步阴影、色调、光照强度——relightful harmonization)的硬伤是:视频域没法采集「同一动作不同光照」的成对标注数据。最直接的方案——「按帧调用图像和谐模型」——会带来严重时序抖动(flicker) 本文贡献:HarmoVid 给出整套视频和谐化方案:(i) 全新的 lighting deflickering 模型稳定全局和局部光照 flicker,把「逐帧 image-harmonization」的输出升级成可监督的 paired 视频数据;(ii) 视频扩散模型在 deflickered 真实 + 合成视频上学习;(iii) asymmetric alpha mask conditioning 让模型从真实视频里学到干净的边界 实验效果:在时序连贯、自然度、边界干净度、物理合理光照行为多个维度超越此前所有 image-based 和 video-based 和谐化方法;relighting 表现力也保住——人物视频合成 / 后期合成的标准工业链路被显著升级 批判点评:用「先 deflicker 再训练」绕开「无成对数据」的死结是非常聪明的——deflicker 把单帧图像和谐输出转化成可用监督,是真正的杠杆点。asymmetric alpha mask 也很实用。但 deflicker 模型本身的失败模式(强光/复杂阴影)会传导到下游;与 Adobe 自家的商业级合成工具的真实对比需要更细评测 7. SmartDirector:多关键帧条件电影级视频叙事控制 SmartDirector: Keyframe-Conditioned Cinematic Video Generation with Narrative Pacing Control | 国内视频生成团队 | arXiv:2605.27891 关键词:电影级视频·多关键帧·叙事节奏·两阶段·Director-Gen/SR ⚠️ 前序问题:视频的「叙事质量」决定感知价值,但现有视频生成方法主要靠 text prompt 或首尾帧这类稀疏 condition——对叙事结构和时序节奏的精确控制非常有限,导出不了真正「有 pacing 的电影感视频」 本文贡献:SmartDirector:以多关键帧增强视频生成的叙事能力。支持单镜头、多镜头叙事合成、视频延展三类场景。两阶段:(i) Director-Gen 在低分辨率上以关键帧为条件生成;(ii) Director-SR 利用高分辨率关键帧作为语义锚点把细粒度细节补回来。配套数据管线从电影中精选单镜头/多镜头序列以支撑多关键帧训练 实验效果:在多个评测上大幅超越 SOTA,把视频生成从「按 prompt 出 5 秒片段」升级到「按多关键帧出有节奏的多镜头序列」——电影级视频生成的可控性接近真实创作工作流 批判点评:「多关键帧 + 两阶段先粗后细」直击「电影级叙事控制」的实际痛点——单 prompt / 首尾帧确实远远不够。两阶段把分辨率 vs 叙事控制解耦是合理设计。但「关键帧」的获取成本(人工/AI辅助)和叙事节奏的可量化评测仍是模糊地带;多镜头切换的时空一致性细节需要更深 ablation 8. LoSATok:1280维语义压缩到128维统一audio LoSATok: Low-dimensional Semantic-Acoustic Tokenizer for Cross-Domain Audio Understanding and Generation | 清华深圳, 面壁智能 | arXiv:2605.27840 关键词:audio tokenizer·128 维·语义瓶颈·清华深圳·面壁 ⚠️ 前序问题:音频 tokenizer 是统一「音频理解」和「音频生成」的根基。理解需要高层语义;生成需要语义 + 声学细节。现有统一 tokenizer 在高维连续 latent 里同时编码——这增加了 DiT 生成端的建模负担 本文贡献:LoSATok:观察到 1280 维语义 encoder 特征是可压缩的,引入 Semantic Bottleneck 压到 128 维,并用 time-relation loss 保时序特征一致性;再用「双层级语义监督」同时利用高维/低维语义信号——让 tokenizer 在紧凑 latent 空间里同时承载语义和声学细节 实验效果:在 speech / music / 通用 audio 上 SemBo 保住强低维语义容量,LoSATok 与多个语义表示比较 understanding 性能仍有竞争力;在 DiT 端的 speech / music / audio 生成上一致改进——证明「低维 audio 表示也能同时支撑理解与生成」 批判点评:把「audio 统一 tokenizer」的维度从 1280 砍到 128 是非常硬的容量压缩——若真的不掉理解还能提升生成,那就解掉了「audio 统一表示卡 DiT」的关键梗。time-relation loss + 双层级语义监督是合理工程。但 128 维下声学细节的极限(音乐复杂混音、长 reverb)需要更细测试;与 Dasheng AudioGen 高维路线的端到端比较是行业级议题 9. CosyEdit2:GRPO语音编辑反哺零样本TTS CosyEdit2: Speech-Editing-Oriented Reinforcement Learning Unlocks Better Zero-Shot TTS | 南开大学 | arXiv:2605.25930 关键词:语音编辑·GRPO·zero-shot TTS·南开大学·post-training ⚠️ 前序问题:语音编辑和 zero-shot TTS 同源于「prompt 驱动的语音生成」,但语音编辑对「与周围未编辑内容的局部声学一致性」要求严苛得多。SFT 让 TTS 模型获得编辑能力的路线被卡在「成对编辑数据不完美 + 优化信号粗粒度」 本文贡献:CosyEdit2:建立「先 SFT 初始化 → 再 editing-oriented GRPO 后训练」的两阶段框架。GRPO 阶段在「无目标语音」的数据上做,把语音编辑当作 RL 任务优化,让模型从粗粒度匹配走向精细局部声学一致 实验效果:不仅在语音编辑上显著提升,还反哺 zero-shot TTS 能力——揭示「编辑任务 ↔ 合成任务」之间隐藏的相互增益;GRPO 在 audio 域被验证是有效的 post-training 范式 批判点评:把 GRPO 引入 audio 域、并用「编辑反哺合成」这个新角度证明两个任务的深层互助,是非常聪明的科学故事。无目标语音的 RL 设计也比依赖成对数据更可扩展。但 GRPO 的 reward 设计细节、跨语种/多说话人鲁棒性、以及对 prosody 细节的影响需要更系统评测 10. PilotTTS:高德200K小时开源TTS竞品级 PilotTTS: A Disciplined Modular Recipe for Competitive Speech Synthesis | 高德 AMAP | arXiv:2605.27258 关键词:TTS·200K 小时·开源·Q-Former·高德 AMAP ⚠️ 前序问题:SOTA TTS 系统通常需要数百万小时专有数据 + 多阶段复杂架构——这对资源受限的研究团队是几乎跨不过去的门槛。开源社区想自己训出竞品级 TTS 一直缺成熟 recipe 本文贡献:PilotTTS:高德 AMAP 用「最小化架构 + 严格数据工程」做出竞品级轻量自回归 TTS。仅用 200K 小时数据 + 全开源工具处理。两大贡献:(i) 可复现的多阶段数据处理 pipeline(质量评估 + 标签标注 + 过滤);(ii) Q-Former conditioning 紧凑模型架构,通过 cross-sample paired training 解耦说话人身份与说话风格。统一框架支持 zero-shot voice cloning / 11 类情感合成 / 4 类副语言合成 / 14 种中文方言 实验效果:在 Seed-TTS Eval 上 test-en WER 1.50%(最低)、test-zh CER 0.87%;两个测试集说话人相似度都最高(0.862 / 0.815)——超越使用大得多数据集训出来的系统。完整 data pipeline + 预训练权重 + 代码全开源 (AMAPVOICE/PilotTTS) 批判点评:「200K 小时 + 开源工具 + 极简架构」做出超越百万小时专有数据系统的 TTS——是非常有信号量的开源胜利,对中小团队意义重大。Q-Former 解耦说话人/风格的设计也是 clean。但 PilotTTS 主打数据工程而非架构创新,复现门槛仍在「数据处理 pipeline 的工程细节」;与昨天 LongCat-Avatar 类「audio + 视频联合」的下一步集成是开放问题 11. LAIR:扩散模型从成对偏好升级到列表对齐 Beyond Pairwise Preferences: Listwise Reward-Aware Alignment for Diffusion Models | 斯坦福, 加州理工 Caltech | arXiv:2605.26491 关键词:diffusion 对齐·listwise preference·advantage-weighted·Stanford·Ermon ⚠️ 前序问题:preference optimization 已成 RLHF 之外对齐 T2I 扩散的高效替代,但现有方法基本都把监督降到 binary pairwise——这在「同 prompt 有多张候选 + 有连续 reward 分数」时严重浪费信息(一个 winner-loser 标签远远没用上 reward 分布) 本文贡献:Diffusion LAIR:reward-aware listwise preference optimization。每个 prompt 把候选组的 reward 分数转成中心化 advantage 权重,再优化「advantage-weighted regression」目标——目标定义在 implicit reward(当前模型 vs 固定参考模型的 denoising-loss 改进量)上,配二次惩罚正则隐式 reward 幅度。结果是同时用所有候选而非选 pair,并保持保守。LAIR 目标在 implicit-reward 空间有 bounded closed-form 最优解,把正则强度 → 偏好更新幅度的关系写清楚 实验效果:在 SD1.5 / SDXL 上对 T2I 生成 / 组合生成 / 图像编辑 benchmark 都超越 strong pairwise preference optimization baseline;为 diffusion 对齐提供「更接近 RLHF reward 信息密度但不需在线 RL」的中间路线 批判点评:把 DPO 类 pairwise 升级到 listwise + 给出 closed-form 最优解的清晰表述是教科书级的方法工作——既保留 offline 偏好优化的稳定性,又用上了 reward score 的全部信息。但 listwise 数据采集成本高于 pairwise(要 N 张同 prompt 候选 + reward 分),实际落地的数据可得性是隐藏成本;与 in-context 在线 RL(GRPO 类)的端到端比较略浅 趋势观察 视频生成进入「全栈加速」时代:稀疏 + 量化 + 并行 + 路由 + RL 多管齐下 — OSP-Next 把稀疏注意力 + Sparse Sequence Parallelism(通信 -75%)+ HiF8 量化 + Mix-GRPO 一锅端,跨 H200 / 昇腾双硬件分别 1.64× / 2.27× 加速;PARE 联合宽度剪枝 + 动态深度路由,在 Wan2.1-14B 上按输入按 timestep 动态算;SVDQuant-GPTQ 把 Wan2.2 双专家 MoE DiT 推到 W4A4 显存降 59.3%——视频生成的工业部署正在被「全栈加速」改写 长视频 KV cache 压缩出现「找根因 + 闭式解」类突破 — Quantized Keys Steal Attention 首次把「量化 KV 掉画质」从经验现象写成 Jensen bias(exp 凸性放大 cache key 贡献)的可解析统计现象,一行公式校正零额外显存,让 MAGI-1 / SkyReels-V2 / HY-WorldPlay 在 INT2 上接近 BF16——把 chunk-wise AR 长视频的 KV 压缩从「玄学调参」推到「有理论的工程」 音频生成统一化:从「按域切分」走向「一句描述出混合场景」 — Dasheng AudioGen 是首个能从一句描述同时生成 speech + music + SFX 混合连贯场景的统一模型,关键是 structured multi-view captions + 高维语义-声学统一 latent;LoSATok 反过来把 1280 维语义压到 128 维统一 tokenizer 反哺 DiT 生成;CosyEdit2 在 audio 域用 GRPO 把「编辑」反哺「TTS」——audio 正在重走视觉「统一模型」的同一条路 视频生成的「叙事控制」与「视频后期」继续拓宽到工业链路 — SmartDirector 把视频生成从「按 prompt 出 5 秒片段」升级到「多关键帧 + 两阶段先粗后细」做电影级叙事节奏控制;HarmoVid 用 deflicker 模型破解「视频和谐化无成对数据」的死结,把视频肖像 relight 和谐化做到工业级稳定——视频生成的可控性从「内容」深入到「节奏」和「后期合成」 开源 TTS / 对齐方法补齐 audio + diffusion 的「最后一公里」 — 高德 PilotTTS 用 200K 小时 + 开源工具 + Q-Former 极简架构做出超越百万小时专有系统的开源 TTS(Seed-TTS Eval 第一);Diffusion LAIR 把 T2I 对齐从 pairwise 升级到 listwise,给出 implicit-reward 的 closed-form 最优解——开源社区在 audio 合成 + diffusion 对齐这两个长期被闭源霸占的方向同时迈出了「竞品级 + 理论级」的双台阶 人工智能炼丹君 整理 | 2026-05-28 -

AIGC 每日速读|2026-05-26|百度ERNIE-Image开源8B DiT追平闭源 今日 AIGC 论文速览 今日共 11 篇 · 国产开源文生图基础模型 1 篇 · 音视频联合生成与编辑 3 篇 · 视频生成训练范式革新 2 篇 · few-step 蒸馏与自回归视频蒸馏 2 篇 · 推理时自适应与视频编辑 3 篇 重点论文标题列表 ERNIE-Image:百度8B DiT开源逼近闭源SOTA Baton:首引语义蓝图驱动音视频联合生成 ⚡ SpongeBob:首个端到端音视频联合编辑Sync+30% StreamChar:长时流式角色音视频实时生成 PixelWizard:原生2K/4K视频生成10倍加速 今日论文速览 1. ERNIE-Image:百度8B DiT开源逼近闭源SOTA ERNIE-Image Technical Report | 百度 Baidu ERNIE Team | arXiv:2605.25347 关键词:ERNIE-Image·百度·8B DiT·MT-DMD 蒸馏·industrial-grade ⚠️ 前序问题:开源文生图模型与闭源顶级系统在指令跟随、文字渲染、美学质量上仍有明显差距。差距主要来自两件事:预训练数据噪声大且长尾概念覆盖差;后训练人类偏好对齐的稳定性不足,蒸馏期间还会出现 capability drift(蒸馏前能做的事,蒸馏后做不到了) 本文贡献:ERNIE-Image:8B 单流 DiT 架构开源文生图基础模型。预训练用 bottom-up 数据管线(细粒度分类 + 富 caption + 美学评估 + 分层采样)压噪同时保长尾;后训练 top-down 高需求场景 + 多样化 prompt + 稳定化 DPO;ERNIE-Image-Turbo 实现 8-NFE 高效生成,配套 MT-DMD 蒸馏算法缓解 capability drift。配套发布 industrial-grade ERNIE-Image-Aes 美学模型和 ERNIE-Image-Aes-1K benchmark(首个针对真实场景的美学评测基准) 实验效果:开源模型中达到 leading 表现,在指令跟随/文字渲染/美学三项接近顶级闭源商业模型;模型权重和美学评测资源全部开源,覆盖完整工业流水线(包括 Prompt Enhancer 把简短意图扩展为结构化视觉描述) 批判点评:「8B DiT + bottom-up 预训练 + top-down 后训练 + 稳定 DPO + Turbo 蒸馏」是教科书级的工业开源大模型训法,单独哪一项都不算新颖,但全部端到端打通、配套基础设施 + 评测开源是最大贡献。但闭源 SOTA(GPT-Image / Imagen 4 / Midjourney v7)的差距具体几何缺乏精确量化对比,且 industrial-grade aesthetic model 的偏好可能强烈反映中文用户审美,国际场景适用性需观察 2. Baton:首引语义蓝图驱动音视频联合生成 Baton: Explicit Semantic Blueprints for Joint Video-Audio Generation | 复旦大学, 腾讯混元 | arXiv:2605.25195 关键词:音视频联合生成·explicit planning·VA-Planner·腾讯混元·Relative RoPE ⚠️ 前序问题:开源扩散模型做音视频联合生成时,两个模态的去噪轨迹各自为政,导致音画不同步、长时一致性差。根因:现有方法用现成 encoder 的粗粒度 text embedding 引导音/视频去噪——这丢掉了细粒度语义,更关键的是缺少一个跨模态的「长 horizon 共享规划」 本文贡献:提出 Baton:首个引入 explicit semantic planning 的音视频联合生成框架。VA-Planner(带双语义对齐塔的多模态 LLM)让可学习 query 同时 cross-attend 视频和音频特征,吐出一对语义对齐的音/视频 planned token(关键帧级蓝图);这些 plan token 通过 cross-attention 注入扩散 backbone,与粗 text embedding 互补;进一步提出 Relative Semantic RoPE 把 planned token 和 latent 映射到共享时空坐标系,让 latent 准确 attend 到对应语义线索 实验效果:在标准音视频联合生成 benchmark 上定性定量都显著超过基线;首次把「先规划后渲染」的范式从单模态扩散扩展到跨模态联合扩散——和昨天 Bernini「MLLM 规划 + DiT 渲染」是同向延续 批判点评:「explicit semantic planning」做跨模态联合生成是非常对的方向——粗 text embedding 当指挥棒本来就太宽松。VA-Planner + Relative Semantic RoPE 解决了「plan 怎么对齐 latent」的工程关键。但 VA-Planner 多了一次 MLLM 推理,端到端时延和显存对比单 DiT 联合扩散需要进一步说明;planned token 颗粒度是 keyframe-level 而非 frame-level,复杂动作对齐上限仍受限 3. SpongeBob:首个端到端音视频联合编辑Sync+30% SpongeBob: Sync-Aware Harmonious Audio-Visual Generative Editing | 中科大 USTC | arXiv:2605.25193 关键词:音视频联合编辑·端到端·Sync-Aware·Context-Aware·USTC ⚠️ 前序问题:物理世界的视觉和声音本就耦合,但现有视频编辑全部是「视觉编完,再单独配音/换音」的解耦 pipeline,没有双向模态交互。结果是:(i) 音画不同步;(ii) 改动后的画面和保留下来的原音之间出现语义冲突(看到打字键盘却继续是说话声) 本文贡献:SpongeBob:首个端到端音视频联合编辑框架,带双向 cross-modal 交互。Sync-Aware Mechanism 通过双向注意力 + 时序对齐 + 空间约束让视觉编辑跟声音事件对齐;Context-Aware Module 用声/像 context attention 防止编辑后语义冲突;Sync-Preserving Training and Guidance(SPTG)在保持画质的同时强化对齐。配套构建可扩展数据管线 + subject-level 大规模数据集 + SpongeBob-Bench 评测 实验效果:Sync-C(音画同步指标)+30%、Ctx-F1(上下文一致性)+12.5%,显著超越现有 baseline;首次把「音视频编辑」推到 explicit joint 范式,让「改了画也改对应音」成为可能 批判点评:把音视频编辑从「解耦串行」改成「联合并行」是必要的下一步,Sync-Aware + Context-Aware 双模块设计简洁;但训练数据规模和评测集都依赖作者自建,第三方复现成本高;编辑场景的覆盖(替换/插入/删除)和真实创作工作流的对接深度还需后续验证 4. StreamChar:长时流式角色音视频实时生成 StreamChar: Long-Horizon Streaming Character Audio-Video Generation with Decoupled Orchestration | 阿里通义实验室 | arXiv:2605.25659 关键词:流式生成·角色动画·decoupled orchestration·阿里通义·sink-chunk memory ⚠️ 前序问题:实时流式的角色音视频联合生成要同时满足:(1) 说出指定 transcript;(2) 跨 chunk 保持视觉身份;(3) 严格的播放预算(低延迟)。三个目标相互掣肘——逐 chunk 的自回归生成会累积 transcript-audio 错位和视觉漂移;为低延迟而做的 few-step 蒸馏又会牺牲空间多样性和时序质量 本文贡献:StreamChar:把「长 horizon 规划」与「短窗音视频去噪」解耦的流式框架。LLM 编排器(orchestrator)用 transcript 和历史上下文产出帧对齐的音频条件;joint audio-video DiT 做局部双向去噪并带 reference + motion-frame conditioning;两阶段蒸馏先压缩 sampler 再用 online chunk rollout 微调 student;progress-aware pointer 在 rollout 训练时把部分 transcript 与生成音频对齐;sink-chunk memory 提供持久视觉 anchor 缓解长 horizon 漂移 实验效果:把流式 character animation 这个被低延迟严重压制的方向推到「长 horizon + 严格时延 + 身份稳定」可同时满足;解耦式架构让 LLM 做规划、扩散 backbone 做细节生成成为长视频流式生成的可行新范式 批判点评:把「orchestrator vs denoiser」解耦解决了流式 + 长时生成两难,sink-chunk memory + progress pointer 是非常针对性的工程设计。但 LLM orchestrator 引入额外推理路径,对端到端时延的真实贡献需要更细评测;joint audio-video DiT 蒸馏后的 student 与教师模型 audio-visual coherence 的差距上限值得跟踪 5. PixelWizard:原生2K/4K视频生成10倍加速 PixelWizard: Towards Efficient High-Fidelity Video Generation at Ultra-Large Spatial Resolution | 港科大广州, 小米 | arXiv:2605.25801 关键词:高分辨率视频·原生 2K/4K·10× 加速·分层 anchor·小米 ⚠️ 前序问题:高分辨率视频生成有两个相互耦合的瓶颈:(1) token 序列爆炸让优化偏向局部纹理而牺牲全局连贯(结构坍塌);(2) 训练成本巨大、推理延迟严重。简单堆分辨率根本不可持续 本文贡献:PixelWizard 把全局结构建模和细粒度细节合成分层解耦:先建立一个紧凑的时空 anchor 浓缩稠密结构先验,再以此引导高分辨率细节生成,缓解局部优化偏置;引入 Noise-Span Aligned Shortcut Training 让模型可以「大步」遍历生成轨迹(突破推理瓶颈);Exponential Index-Biased Sampling + Adaptive Noise-Span Calibration 把优化与高分辨率网格的偏移噪声 schedule 对齐,实现 robust few-step 推理且无需蒸馏的开销 实验效果:原生 2K/4K 视频生成加速 >10×,同时保证视觉质量;不依赖蒸馏(避免 capability drift),是高分辨率视频生成的「全栈式」效率优化方案 批判点评:分层 anchor + shortcut training 思路很正——直接面对「token 爆炸」根因。10× 加速 + 不蒸馏的组合非常吸引人;但与最新蒸馏路线(如 DMD2/Causal Distill)的端到端对比缺失,结构 anchor 是否能跨场景(人物运动/复杂相机)稳定泛化需要更细评测 6. Paris 2.0:首个去中心化预训练视频生成FVD减半 Paris 2.0: A Decentralized Diffusion Model for Video Generation | Bagel Network | arXiv:2605.26064 关键词:去中心化训练·DDM·视频生成预训练·FVD 2×·Bagel ⚠️ 前序问题:训视频生成模型几乎都要 monolithic GPU 大集群,开源社区无法独立完成时序连贯的视频生成预训练。前作 Paris 1.0 证明了图像生成可以分布式训练(去中心化扩散 DDM),但「时序连贯的视频生成」在 decentralized 训练范式下仍是 open problem 本文贡献:Paris 2.0:首个通过去中心化(decentralized)计算完成预训练的视频生成模型。训练 recipe 基于 Paris 1.0 的开源 DDM 扩展到视频领域,关闭了「分布式训视频」最后一块短板。同 compute budget 下与 monolithic 模型在相同数据上对照评估 实验效果:在 low-resolution 文生视频训练上,相同总算力预算下相比 monolithic baseline,FVD 从 561.04 降到 279.01(~2.0× 提升),CLIP 文本-视频相似度与美学分数双双提升。证明 decentralized 训练不仅可行而且能反超 monolithic——开源社区独立训视频基础模型门槛被显著拉低 批判点评:「分布式 GPU 也能训视频生成」是范式级的工程突破——把视频生成预训练的算力门槛从「必须有大集群」拉到「能聚起多组消费级 GPU」。同算力预算下反超 monolithic 是惊喜数字。但还停留在 low-resolution 段位,高分辨率长视频下分布式通信开销是否仍能 hold 住,是后续最大悬念 7. RTDMD:4步生成同时蒸馏对齐刷新SOTA Reinforcing Few-step Generators via Reward-Tilted Distribution Matching | Sea AI Lab, 港科大 | arXiv:2605.26108 关键词:few-step 扩散·蒸馏·RLHF·GRPO·FLUX.2 ⚠️ 前序问题:few-step 扩散蒸馏已能让图像生成又快又好,但和人类偏好对齐还是难——直接套 RLHF 会破坏蒸馏后的分布稳定性,难以兼得「步数少 + 画质高 + 对齐人类偏好」 本文贡献:RTDMD(Reward-Tilted Distribution Matching Distillation):两阶段统一蒸馏与 RL 对齐。理论上证明 minimizing KL 到「reward-tilted teacher」自然分解为分布匹配 + reward maximization 两项。Stage1:AC-DMD(Ambient-Consistent DMD)做子区间分布匹配 + consistency 正则化,让 fake score 模型追上漂移的 generator;Stage2:混合 policy gradient——GRPO-style estimator 处理随机中间步 + direct reward backprop 处理确定性 final step;进一步用 step-subset GRPO(SubGRPO)降方差 实验效果:在 SD3 / SD3.5 / FLUX.2 上仅 4 步推理就刷新 preference / aesthetic / compositional 三类指标 SOTA,超越此前所有 few-step 文生图方法,代码模型开源 批判点评:把蒸馏和 RL 对齐写成同一个 KL 优化问题在理论上很优雅,工程实现 AC-DMD + 混合 policy gradient + SubGRPO 三件套也都是合理设计;但 GRPO 在 4 步采样下的方差估计仍可能高,跨更多底模(SD3.5 / FLUX 之外)的稳定性需要更多验证 8. AFD:on-policy黑盒蒸馏自回归视频 On-Policy Adversarial Flow Distillation for Autoregressive Video Generation | 新加坡国立大学 NUS | arXiv:2605.26105 关键词:自回归视频·黑盒蒸馏·on-policy·flow-matching·Bradley-Terry ⚠️ 前序问题:自回归视频生成器对流式、长 horizon、交互应用非常有吸引力,但把强黑盒 teacher 蒸馏成 causal student 极其困难:student 必须在自己 rollout 分布下学习,而实际 teacher 通常只暴露 prompt-conditioned 完成的视频,结构/容量/时序设计/采样 schedule 都不同。这让 SFT 是 off-policy 的、score-based 蒸馏不适用、直接对抗模仿对去噪步级 credit assignment 又太稀疏 本文贡献:AFD(Adversarial Flow Distillation):异构黑盒视频蒸馏的 on-policy 框架。同 prompt 同时 query teacher 和 rollout 当前 student;训 prompt-paired Bradley-Terry discriminator 估计 clean-sample 教师-学生差异;把 on-policy advantage 转成 forward-process flow-matching 更新到 student 自己的 noised state 上。这套设计让 student 拿到稠密 velocity-field 监督,且无需 teacher score / latent / 去噪轨迹 / step alignment / reverse-chain RL 实验效果:把「自回归视频生成 + 黑盒强 teacher」蒸馏从死局拉到可行——这恰是流式视频 + 大闭源 teacher 时代的最关键工程问题。on-policy 学习避免分布漂移,flow-matching 转换提供稠密信号,是 RTDMD 在「自回归视频」侧的对偶贡献 批判点评:把「黑盒、异构、自回归视频」三个最难维度同时解决,思路非常对——on-policy + 对抗 + flow-matching 转换是当前最合理的组合。但 Bradley-Terry discriminator 在视频域的样本效率与训练稳定性、以及面对真正巨大闭源 teacher(如商用 Sora / Veo 级别)的 query 成本,是工程落地的真实门槛 9. TT-SAC:talking-head推理时自适应免训练 Test-Time Self-Adaptive Conditioning for Stable Audio-Driven Talking-Head Generation | 格里菲斯大学 Griffith | arXiv:2605.25488 关键词:talking-head·推理时自适应·免训练·feedback loop·身份保持 ⚠️ 前序问题:音频驱动 talking-head(AniTalker / FLOAT / Sonic 等)当前主流是:一张静态参考图条件整段视频生成。但静态身份条件 vs 动态面部运动天然错配,导致 identity drift、时序不一致、感知质量下降 本文贡献:TT-SAC(Test-Time Self-Adaptive Conditioning):完全 parameter-free 的推理时框架,让预训练 talking-head 模型在生成过程中自适应调整 conditioning,不需要重训、不需要梯度、不需要任何额外监督。把 generator 与 encoder 组成 feedback loop:generator 输出再被 encoder 编码,构造与时序动力学对齐的精修 conditioning;单步自适应即近似 self-consistent equilibrium,稳定跨时长的身份与运动 实验效果:把 talking-head 的「静态参考图」假设彻底打破——同一组预训练权重,仅靠推理时 feedback loop 即可显著缓解 identity drift 和时序退化;零训练成本即可升级现有 talking-head 模型,是非常实用的 plug-in 改造 批判点评:把 generator-encoder feedback 当作 implicit fixed-point 迭代是聪明的——既廉价又对预训练模型友好。但 single adaptation step 是否真能稳定逼近 self-consistent equilibrium 取决于具体模型,对发生面部大幅度运动或镜头切换时的鲁棒性需要更细评测;feedback 单步 vs 多步的边际收益曲线也值得展开 10. RVEDiT:MLLM注入Token让DiT分粒度推理编辑 Reasoning to Align: Implicit Reasoning in Diffusion Transformers for Video Editing | 华为 | arXiv:2605.24674 关键词:视频编辑·DiT·MLLM Token·分粒度路由·华为 ⚠️ 前序问题:指令视频编辑需要按自然语言改源视频,同时保留无关内容、保持时序一致。但现有 DiT 编辑器有两个结构性缺陷:(1) 条件信号不分粒度灌入所有 transformer block,单一 token 流既要编码全局意图又要编码细粒度证据;(2) cross-attention 模式只受 pixel-level 重建间接监督,内部推理过程完全不受约束 本文贡献:RVEDiT:implicit Reasoning Video Editing DiT。两个互补组件:(i) Granularity-Routed Token Conditioning——从 MLLM 蒸馏出 learnable editing token 路由到浅层 block,深层 block 留给原生视觉/文本 token,自然形成 coarse-to-fine 编辑过程;(ii) Reference-Anchored Attention Alignment——训练时用参数共享 reference 分支,最大化编辑/参考分支注意力特征的互信息,正则化内部推理但推理时零额外开销 实验效果:在标准指令视频编辑 benchmark 上一致超过 SOTA,对 localized 和 compositional 编辑提升最大;引入 MLLM 推理但部署时单分支,性价比高 批判点评:「分粒度路由 conditioning + reference 互信息对齐」两个手段都直击 DiT 编辑器的结构性病灶,思路非常清晰。但 MLLM 提供的 editing token 是离线蒸馏,可能不能捕捉新颖指令;reference 分支在训练时翻倍显存,长视频上的可扩展性需评测 11. Squeeze-MLLM:MLLM+VAE双条件根治主体生成贴图 Squeezing Capacity from Multimodal Large Language Models for Subject-driven Generation | 多伦多大学 U of T | arXiv:2605.26111 关键词:Subject-driven·MLLM·VAE 身份·DLA·copy-paste ⚠️ 前序问题:subject-driven 生成(保留参考主体身份 + 跟随文字指令)此前主流是 text 和 reference 各编各的——这天然削弱跨模态推理,并导致典型的 copy-paste artifact(参考图被原样贴上去)。最近 MLLM + diffusion 框架改善了指令跟随,但忽略了身份保持 本文贡献:把 diffusion model condition 在 MLLM 上(让 text 和 reference 联合编码),同时用 VAE 做 identity conditioning;新设 Dual Layer Aggregation (DLA) 模块聚合 MLLM 多层级特征做最优 conditioning;用多阶段去噪策略在推理时渐进式平衡 MLLM 提供的语义和 VAE 提供的细节身份 实验效果:把多模态理解和身份保持调和得很好,缓解了 copy-paste 问题,人类偏好评测上 subject-driven 生成超越现有方法;项目页面开放 批判点评:「MLLM 编联合语义 + VAE 守身份细节」的双通道是非常合理的分工——比纯 MLLM/纯 reference encoder 都更接近问题本质。DLA + 多阶段去噪是工程上的细致打磨;但 VAE 通道也可能引入贴图倾向(VAE 重建本身就有 identity 偏置),与最新 IP-Adapter / OmniGen 等的端到端对比是否在所有场景占优需要更细评测 趋势观察 国产开源文生图基础模型加速对标闭源 SOTA — 百度 ERNIE-Image 8B 单流 DiT 系统化打通预训练 bottom-up 数据 + 后训练 top-down + 稳定 DPO + Turbo 蒸馏 + 工业 aesthetic 评测全栈,且模型/数据全部开源——开源阵营在指令跟随/文字渲染/美学三项已逼近 GPT-Image/Imagen/Midjourney 等闭源顶级系统 音视频联合生成进入「规划 + 流式 + 编辑」三角范式 — Baton 用 VA-Planner(多模态 LLM)吐出音/视频共享语义蓝图驱动联合扩散;SpongeBob 通过双向 cross-modal 交互做端到端音视频联合编辑;StreamChar 用 LLM orchestrator 解耦长 horizon 规划与短窗去噪做流式角色音视频——音视频从「各编各的」彻底走向「联合规划 + 联合渲染」 视频生成同时突破两个壁垒:分辨率天花板与训练算力门槛 — PixelWizard 把全局 anchor 与细节合成分层解耦,加上 Noise-Span Aligned Shortcut Training,原生 2K/4K 视频生成提速 10× 且不蒸馏;Paris 2.0 首次完成 decentralized 视频生成预训练,同算力下 FVD 从 561→279(2×)反超 monolithic baseline——视频生成的「分辨率天花板」被工程化突破,「训练必须大集群」被打破 few-step 蒸馏从图像扩散扩展到自回归视频生成 — RTDMD 把蒸馏和 RL 对齐写成同一 KL 优化(4 步刷 SD3/FLUX.2 SOTA);AFD 把 on-policy 对抗 + flow-matching 转换组合用于黑盒异构 teacher 蒸馏 causal 视频 student——证明「步数少 + 画质高 + 对齐人类偏好 + 流式自回归」可以同时拿到,且不依赖白盒 teacher score / 轨迹访问 推理时自适应/编辑成为零训练能力升级标配 — TT-SAC 让 talking-head 模型在推理时通过 generator-encoder feedback loop 自适应 conditioning(免训练、免梯度);RVEDiT 把 MLLM 推理 token 路由到 DiT 浅层 block 形成 coarse-to-fine 编辑;Squeeze-MLLM 用 MLLM+VAE 双通道在推理时渐进平衡语义与身份——「不重训也能拿到新能力」正在成为生成模型的标准升级路径 人工智能炼丹君 整理 | 2026-05-26

AIGC 每日速读|2026-05-26|百度ERNIE-Image开源8B DiT追平闭源 今日 AIGC 论文速览 今日共 11 篇 · 国产开源文生图基础模型 1 篇 · 音视频联合生成与编辑 3 篇 · 视频生成训练范式革新 2 篇 · few-step 蒸馏与自回归视频蒸馏 2 篇 · 推理时自适应与视频编辑 3 篇 重点论文标题列表 ERNIE-Image:百度8B DiT开源逼近闭源SOTA Baton:首引语义蓝图驱动音视频联合生成 ⚡ SpongeBob:首个端到端音视频联合编辑Sync+30% StreamChar:长时流式角色音视频实时生成 PixelWizard:原生2K/4K视频生成10倍加速 今日论文速览 1. ERNIE-Image:百度8B DiT开源逼近闭源SOTA ERNIE-Image Technical Report | 百度 Baidu ERNIE Team | arXiv:2605.25347 关键词:ERNIE-Image·百度·8B DiT·MT-DMD 蒸馏·industrial-grade ⚠️ 前序问题:开源文生图模型与闭源顶级系统在指令跟随、文字渲染、美学质量上仍有明显差距。差距主要来自两件事:预训练数据噪声大且长尾概念覆盖差;后训练人类偏好对齐的稳定性不足,蒸馏期间还会出现 capability drift(蒸馏前能做的事,蒸馏后做不到了) 本文贡献:ERNIE-Image:8B 单流 DiT 架构开源文生图基础模型。预训练用 bottom-up 数据管线(细粒度分类 + 富 caption + 美学评估 + 分层采样)压噪同时保长尾;后训练 top-down 高需求场景 + 多样化 prompt + 稳定化 DPO;ERNIE-Image-Turbo 实现 8-NFE 高效生成,配套 MT-DMD 蒸馏算法缓解 capability drift。配套发布 industrial-grade ERNIE-Image-Aes 美学模型和 ERNIE-Image-Aes-1K benchmark(首个针对真实场景的美学评测基准) 实验效果:开源模型中达到 leading 表现,在指令跟随/文字渲染/美学三项接近顶级闭源商业模型;模型权重和美学评测资源全部开源,覆盖完整工业流水线(包括 Prompt Enhancer 把简短意图扩展为结构化视觉描述) 批判点评:「8B DiT + bottom-up 预训练 + top-down 后训练 + 稳定 DPO + Turbo 蒸馏」是教科书级的工业开源大模型训法,单独哪一项都不算新颖,但全部端到端打通、配套基础设施 + 评测开源是最大贡献。但闭源 SOTA(GPT-Image / Imagen 4 / Midjourney v7)的差距具体几何缺乏精确量化对比,且 industrial-grade aesthetic model 的偏好可能强烈反映中文用户审美,国际场景适用性需观察 2. Baton:首引语义蓝图驱动音视频联合生成 Baton: Explicit Semantic Blueprints for Joint Video-Audio Generation | 复旦大学, 腾讯混元 | arXiv:2605.25195 关键词:音视频联合生成·explicit planning·VA-Planner·腾讯混元·Relative RoPE ⚠️ 前序问题:开源扩散模型做音视频联合生成时,两个模态的去噪轨迹各自为政,导致音画不同步、长时一致性差。根因:现有方法用现成 encoder 的粗粒度 text embedding 引导音/视频去噪——这丢掉了细粒度语义,更关键的是缺少一个跨模态的「长 horizon 共享规划」 本文贡献:提出 Baton:首个引入 explicit semantic planning 的音视频联合生成框架。VA-Planner(带双语义对齐塔的多模态 LLM)让可学习 query 同时 cross-attend 视频和音频特征,吐出一对语义对齐的音/视频 planned token(关键帧级蓝图);这些 plan token 通过 cross-attention 注入扩散 backbone,与粗 text embedding 互补;进一步提出 Relative Semantic RoPE 把 planned token 和 latent 映射到共享时空坐标系,让 latent 准确 attend 到对应语义线索 实验效果:在标准音视频联合生成 benchmark 上定性定量都显著超过基线;首次把「先规划后渲染」的范式从单模态扩散扩展到跨模态联合扩散——和昨天 Bernini「MLLM 规划 + DiT 渲染」是同向延续 批判点评:「explicit semantic planning」做跨模态联合生成是非常对的方向——粗 text embedding 当指挥棒本来就太宽松。VA-Planner + Relative Semantic RoPE 解决了「plan 怎么对齐 latent」的工程关键。但 VA-Planner 多了一次 MLLM 推理,端到端时延和显存对比单 DiT 联合扩散需要进一步说明;planned token 颗粒度是 keyframe-level 而非 frame-level,复杂动作对齐上限仍受限 3. SpongeBob:首个端到端音视频联合编辑Sync+30% SpongeBob: Sync-Aware Harmonious Audio-Visual Generative Editing | 中科大 USTC | arXiv:2605.25193 关键词:音视频联合编辑·端到端·Sync-Aware·Context-Aware·USTC ⚠️ 前序问题:物理世界的视觉和声音本就耦合,但现有视频编辑全部是「视觉编完,再单独配音/换音」的解耦 pipeline,没有双向模态交互。结果是:(i) 音画不同步;(ii) 改动后的画面和保留下来的原音之间出现语义冲突(看到打字键盘却继续是说话声) 本文贡献:SpongeBob:首个端到端音视频联合编辑框架,带双向 cross-modal 交互。Sync-Aware Mechanism 通过双向注意力 + 时序对齐 + 空间约束让视觉编辑跟声音事件对齐;Context-Aware Module 用声/像 context attention 防止编辑后语义冲突;Sync-Preserving Training and Guidance(SPTG)在保持画质的同时强化对齐。配套构建可扩展数据管线 + subject-level 大规模数据集 + SpongeBob-Bench 评测 实验效果:Sync-C(音画同步指标)+30%、Ctx-F1(上下文一致性)+12.5%,显著超越现有 baseline;首次把「音视频编辑」推到 explicit joint 范式,让「改了画也改对应音」成为可能 批判点评:把音视频编辑从「解耦串行」改成「联合并行」是必要的下一步,Sync-Aware + Context-Aware 双模块设计简洁;但训练数据规模和评测集都依赖作者自建,第三方复现成本高;编辑场景的覆盖(替换/插入/删除)和真实创作工作流的对接深度还需后续验证 4. StreamChar:长时流式角色音视频实时生成 StreamChar: Long-Horizon Streaming Character Audio-Video Generation with Decoupled Orchestration | 阿里通义实验室 | arXiv:2605.25659 关键词:流式生成·角色动画·decoupled orchestration·阿里通义·sink-chunk memory ⚠️ 前序问题:实时流式的角色音视频联合生成要同时满足:(1) 说出指定 transcript;(2) 跨 chunk 保持视觉身份;(3) 严格的播放预算(低延迟)。三个目标相互掣肘——逐 chunk 的自回归生成会累积 transcript-audio 错位和视觉漂移;为低延迟而做的 few-step 蒸馏又会牺牲空间多样性和时序质量 本文贡献:StreamChar:把「长 horizon 规划」与「短窗音视频去噪」解耦的流式框架。LLM 编排器(orchestrator)用 transcript 和历史上下文产出帧对齐的音频条件;joint audio-video DiT 做局部双向去噪并带 reference + motion-frame conditioning;两阶段蒸馏先压缩 sampler 再用 online chunk rollout 微调 student;progress-aware pointer 在 rollout 训练时把部分 transcript 与生成音频对齐;sink-chunk memory 提供持久视觉 anchor 缓解长 horizon 漂移 实验效果:把流式 character animation 这个被低延迟严重压制的方向推到「长 horizon + 严格时延 + 身份稳定」可同时满足;解耦式架构让 LLM 做规划、扩散 backbone 做细节生成成为长视频流式生成的可行新范式 批判点评:把「orchestrator vs denoiser」解耦解决了流式 + 长时生成两难,sink-chunk memory + progress pointer 是非常针对性的工程设计。但 LLM orchestrator 引入额外推理路径,对端到端时延的真实贡献需要更细评测;joint audio-video DiT 蒸馏后的 student 与教师模型 audio-visual coherence 的差距上限值得跟踪 5. PixelWizard:原生2K/4K视频生成10倍加速 PixelWizard: Towards Efficient High-Fidelity Video Generation at Ultra-Large Spatial Resolution | 港科大广州, 小米 | arXiv:2605.25801 关键词:高分辨率视频·原生 2K/4K·10× 加速·分层 anchor·小米 ⚠️ 前序问题:高分辨率视频生成有两个相互耦合的瓶颈:(1) token 序列爆炸让优化偏向局部纹理而牺牲全局连贯(结构坍塌);(2) 训练成本巨大、推理延迟严重。简单堆分辨率根本不可持续 本文贡献:PixelWizard 把全局结构建模和细粒度细节合成分层解耦:先建立一个紧凑的时空 anchor 浓缩稠密结构先验,再以此引导高分辨率细节生成,缓解局部优化偏置;引入 Noise-Span Aligned Shortcut Training 让模型可以「大步」遍历生成轨迹(突破推理瓶颈);Exponential Index-Biased Sampling + Adaptive Noise-Span Calibration 把优化与高分辨率网格的偏移噪声 schedule 对齐,实现 robust few-step 推理且无需蒸馏的开销 实验效果:原生 2K/4K 视频生成加速 >10×,同时保证视觉质量;不依赖蒸馏(避免 capability drift),是高分辨率视频生成的「全栈式」效率优化方案 批判点评:分层 anchor + shortcut training 思路很正——直接面对「token 爆炸」根因。10× 加速 + 不蒸馏的组合非常吸引人;但与最新蒸馏路线(如 DMD2/Causal Distill)的端到端对比缺失,结构 anchor 是否能跨场景(人物运动/复杂相机)稳定泛化需要更细评测 6. Paris 2.0:首个去中心化预训练视频生成FVD减半 Paris 2.0: A Decentralized Diffusion Model for Video Generation | Bagel Network | arXiv:2605.26064 关键词:去中心化训练·DDM·视频生成预训练·FVD 2×·Bagel ⚠️ 前序问题:训视频生成模型几乎都要 monolithic GPU 大集群,开源社区无法独立完成时序连贯的视频生成预训练。前作 Paris 1.0 证明了图像生成可以分布式训练(去中心化扩散 DDM),但「时序连贯的视频生成」在 decentralized 训练范式下仍是 open problem 本文贡献:Paris 2.0:首个通过去中心化(decentralized)计算完成预训练的视频生成模型。训练 recipe 基于 Paris 1.0 的开源 DDM 扩展到视频领域,关闭了「分布式训视频」最后一块短板。同 compute budget 下与 monolithic 模型在相同数据上对照评估 实验效果:在 low-resolution 文生视频训练上,相同总算力预算下相比 monolithic baseline,FVD 从 561.04 降到 279.01(~2.0× 提升),CLIP 文本-视频相似度与美学分数双双提升。证明 decentralized 训练不仅可行而且能反超 monolithic——开源社区独立训视频基础模型门槛被显著拉低 批判点评:「分布式 GPU 也能训视频生成」是范式级的工程突破——把视频生成预训练的算力门槛从「必须有大集群」拉到「能聚起多组消费级 GPU」。同算力预算下反超 monolithic 是惊喜数字。但还停留在 low-resolution 段位,高分辨率长视频下分布式通信开销是否仍能 hold 住,是后续最大悬念 7. RTDMD:4步生成同时蒸馏对齐刷新SOTA Reinforcing Few-step Generators via Reward-Tilted Distribution Matching | Sea AI Lab, 港科大 | arXiv:2605.26108 关键词:few-step 扩散·蒸馏·RLHF·GRPO·FLUX.2 ⚠️ 前序问题:few-step 扩散蒸馏已能让图像生成又快又好,但和人类偏好对齐还是难——直接套 RLHF 会破坏蒸馏后的分布稳定性,难以兼得「步数少 + 画质高 + 对齐人类偏好」 本文贡献:RTDMD(Reward-Tilted Distribution Matching Distillation):两阶段统一蒸馏与 RL 对齐。理论上证明 minimizing KL 到「reward-tilted teacher」自然分解为分布匹配 + reward maximization 两项。Stage1:AC-DMD(Ambient-Consistent DMD)做子区间分布匹配 + consistency 正则化,让 fake score 模型追上漂移的 generator;Stage2:混合 policy gradient——GRPO-style estimator 处理随机中间步 + direct reward backprop 处理确定性 final step;进一步用 step-subset GRPO(SubGRPO)降方差 实验效果:在 SD3 / SD3.5 / FLUX.2 上仅 4 步推理就刷新 preference / aesthetic / compositional 三类指标 SOTA,超越此前所有 few-step 文生图方法,代码模型开源 批判点评:把蒸馏和 RL 对齐写成同一个 KL 优化问题在理论上很优雅,工程实现 AC-DMD + 混合 policy gradient + SubGRPO 三件套也都是合理设计;但 GRPO 在 4 步采样下的方差估计仍可能高,跨更多底模(SD3.5 / FLUX 之外)的稳定性需要更多验证 8. AFD:on-policy黑盒蒸馏自回归视频 On-Policy Adversarial Flow Distillation for Autoregressive Video Generation | 新加坡国立大学 NUS | arXiv:2605.26105 关键词:自回归视频·黑盒蒸馏·on-policy·flow-matching·Bradley-Terry ⚠️ 前序问题:自回归视频生成器对流式、长 horizon、交互应用非常有吸引力,但把强黑盒 teacher 蒸馏成 causal student 极其困难:student 必须在自己 rollout 分布下学习,而实际 teacher 通常只暴露 prompt-conditioned 完成的视频,结构/容量/时序设计/采样 schedule 都不同。这让 SFT 是 off-policy 的、score-based 蒸馏不适用、直接对抗模仿对去噪步级 credit assignment 又太稀疏 本文贡献:AFD(Adversarial Flow Distillation):异构黑盒视频蒸馏的 on-policy 框架。同 prompt 同时 query teacher 和 rollout 当前 student;训 prompt-paired Bradley-Terry discriminator 估计 clean-sample 教师-学生差异;把 on-policy advantage 转成 forward-process flow-matching 更新到 student 自己的 noised state 上。这套设计让 student 拿到稠密 velocity-field 监督,且无需 teacher score / latent / 去噪轨迹 / step alignment / reverse-chain RL 实验效果:把「自回归视频生成 + 黑盒强 teacher」蒸馏从死局拉到可行——这恰是流式视频 + 大闭源 teacher 时代的最关键工程问题。on-policy 学习避免分布漂移,flow-matching 转换提供稠密信号,是 RTDMD 在「自回归视频」侧的对偶贡献 批判点评:把「黑盒、异构、自回归视频」三个最难维度同时解决,思路非常对——on-policy + 对抗 + flow-matching 转换是当前最合理的组合。但 Bradley-Terry discriminator 在视频域的样本效率与训练稳定性、以及面对真正巨大闭源 teacher(如商用 Sora / Veo 级别)的 query 成本,是工程落地的真实门槛 9. TT-SAC:talking-head推理时自适应免训练 Test-Time Self-Adaptive Conditioning for Stable Audio-Driven Talking-Head Generation | 格里菲斯大学 Griffith | arXiv:2605.25488 关键词:talking-head·推理时自适应·免训练·feedback loop·身份保持 ⚠️ 前序问题:音频驱动 talking-head(AniTalker / FLOAT / Sonic 等)当前主流是:一张静态参考图条件整段视频生成。但静态身份条件 vs 动态面部运动天然错配,导致 identity drift、时序不一致、感知质量下降 本文贡献:TT-SAC(Test-Time Self-Adaptive Conditioning):完全 parameter-free 的推理时框架,让预训练 talking-head 模型在生成过程中自适应调整 conditioning,不需要重训、不需要梯度、不需要任何额外监督。把 generator 与 encoder 组成 feedback loop:generator 输出再被 encoder 编码,构造与时序动力学对齐的精修 conditioning;单步自适应即近似 self-consistent equilibrium,稳定跨时长的身份与运动 实验效果:把 talking-head 的「静态参考图」假设彻底打破——同一组预训练权重,仅靠推理时 feedback loop 即可显著缓解 identity drift 和时序退化;零训练成本即可升级现有 talking-head 模型,是非常实用的 plug-in 改造 批判点评:把 generator-encoder feedback 当作 implicit fixed-point 迭代是聪明的——既廉价又对预训练模型友好。但 single adaptation step 是否真能稳定逼近 self-consistent equilibrium 取决于具体模型,对发生面部大幅度运动或镜头切换时的鲁棒性需要更细评测;feedback 单步 vs 多步的边际收益曲线也值得展开 10. RVEDiT:MLLM注入Token让DiT分粒度推理编辑 Reasoning to Align: Implicit Reasoning in Diffusion Transformers for Video Editing | 华为 | arXiv:2605.24674 关键词:视频编辑·DiT·MLLM Token·分粒度路由·华为 ⚠️ 前序问题:指令视频编辑需要按自然语言改源视频,同时保留无关内容、保持时序一致。但现有 DiT 编辑器有两个结构性缺陷:(1) 条件信号不分粒度灌入所有 transformer block,单一 token 流既要编码全局意图又要编码细粒度证据;(2) cross-attention 模式只受 pixel-level 重建间接监督,内部推理过程完全不受约束 本文贡献:RVEDiT:implicit Reasoning Video Editing DiT。两个互补组件:(i) Granularity-Routed Token Conditioning——从 MLLM 蒸馏出 learnable editing token 路由到浅层 block,深层 block 留给原生视觉/文本 token,自然形成 coarse-to-fine 编辑过程;(ii) Reference-Anchored Attention Alignment——训练时用参数共享 reference 分支,最大化编辑/参考分支注意力特征的互信息,正则化内部推理但推理时零额外开销 实验效果:在标准指令视频编辑 benchmark 上一致超过 SOTA,对 localized 和 compositional 编辑提升最大;引入 MLLM 推理但部署时单分支,性价比高 批判点评:「分粒度路由 conditioning + reference 互信息对齐」两个手段都直击 DiT 编辑器的结构性病灶,思路非常清晰。但 MLLM 提供的 editing token 是离线蒸馏,可能不能捕捉新颖指令;reference 分支在训练时翻倍显存,长视频上的可扩展性需评测 11. Squeeze-MLLM:MLLM+VAE双条件根治主体生成贴图 Squeezing Capacity from Multimodal Large Language Models for Subject-driven Generation | 多伦多大学 U of T | arXiv:2605.26111 关键词:Subject-driven·MLLM·VAE 身份·DLA·copy-paste ⚠️ 前序问题:subject-driven 生成(保留参考主体身份 + 跟随文字指令)此前主流是 text 和 reference 各编各的——这天然削弱跨模态推理,并导致典型的 copy-paste artifact(参考图被原样贴上去)。最近 MLLM + diffusion 框架改善了指令跟随,但忽略了身份保持 本文贡献:把 diffusion model condition 在 MLLM 上(让 text 和 reference 联合编码),同时用 VAE 做 identity conditioning;新设 Dual Layer Aggregation (DLA) 模块聚合 MLLM 多层级特征做最优 conditioning;用多阶段去噪策略在推理时渐进式平衡 MLLM 提供的语义和 VAE 提供的细节身份 实验效果:把多模态理解和身份保持调和得很好,缓解了 copy-paste 问题,人类偏好评测上 subject-driven 生成超越现有方法;项目页面开放 批判点评:「MLLM 编联合语义 + VAE 守身份细节」的双通道是非常合理的分工——比纯 MLLM/纯 reference encoder 都更接近问题本质。DLA + 多阶段去噪是工程上的细致打磨;但 VAE 通道也可能引入贴图倾向(VAE 重建本身就有 identity 偏置),与最新 IP-Adapter / OmniGen 等的端到端对比是否在所有场景占优需要更细评测 趋势观察 国产开源文生图基础模型加速对标闭源 SOTA — 百度 ERNIE-Image 8B 单流 DiT 系统化打通预训练 bottom-up 数据 + 后训练 top-down + 稳定 DPO + Turbo 蒸馏 + 工业 aesthetic 评测全栈,且模型/数据全部开源——开源阵营在指令跟随/文字渲染/美学三项已逼近 GPT-Image/Imagen/Midjourney 等闭源顶级系统 音视频联合生成进入「规划 + 流式 + 编辑」三角范式 — Baton 用 VA-Planner(多模态 LLM)吐出音/视频共享语义蓝图驱动联合扩散;SpongeBob 通过双向 cross-modal 交互做端到端音视频联合编辑;StreamChar 用 LLM orchestrator 解耦长 horizon 规划与短窗去噪做流式角色音视频——音视频从「各编各的」彻底走向「联合规划 + 联合渲染」 视频生成同时突破两个壁垒:分辨率天花板与训练算力门槛 — PixelWizard 把全局 anchor 与细节合成分层解耦,加上 Noise-Span Aligned Shortcut Training,原生 2K/4K 视频生成提速 10× 且不蒸馏;Paris 2.0 首次完成 decentralized 视频生成预训练,同算力下 FVD 从 561→279(2×)反超 monolithic baseline——视频生成的「分辨率天花板」被工程化突破,「训练必须大集群」被打破 few-step 蒸馏从图像扩散扩展到自回归视频生成 — RTDMD 把蒸馏和 RL 对齐写成同一 KL 优化(4 步刷 SD3/FLUX.2 SOTA);AFD 把 on-policy 对抗 + flow-matching 转换组合用于黑盒异构 teacher 蒸馏 causal 视频 student——证明「步数少 + 画质高 + 对齐人类偏好 + 流式自回归」可以同时拿到,且不依赖白盒 teacher score / 轨迹访问 推理时自适应/编辑成为零训练能力升级标配 — TT-SAC 让 talking-head 模型在推理时通过 generator-encoder feedback loop 自适应 conditioning(免训练、免梯度);RVEDiT 把 MLLM 推理 token 路由到 DiT 浅层 block 形成 coarse-to-fine 编辑;Squeeze-MLLM 用 MLLM+VAE 双通道在推理时渐进平衡语义与身份——「不重训也能拿到新能力」正在成为生成模型的标准升级路径 人工智能炼丹君 整理 | 2026-05-26 -

AIGC 每日速读|2026-05-18|14B视频对齐单步训练Flash-GRPO 今日 AIGC 论文速览 今日共 7 篇 · 视频扩散对齐与定制 2 篇 · 图像生成几何与少步推理 2 篇 · 多镜头视频与实体一致性 1 篇 · 3D 重建与世界模型 2 篇 重点论文标题列表 Flash-GRPO:14B 视频对齐单步训练即超全轨迹 Spherical-FM:球面插值贴合潜空间路径 ⚡ Sphere-Latent-Enc:解耦图像编码器与球面去噪 EntityBench:多镜头视频实体一致性基准 FashionChameleon:单卡 23.8 FPS 实时换装 今日论文速览 1. Flash-GRPO:14B 视频对齐单步训练即超全轨迹 Flash-GRPO: Efficient Alignment for Video Diffusion via One-Step Policy Optimization | 浙江大学, 京东 | arXiv:2605.15980 关键词:视频扩散·GRPO 对齐·单步训练·时间步分组·14B 大模型 ⚠️ 前序问题:GRPO 已成为对齐视频扩散模型与人类偏好的关键工具,但训练 14B 视频扩散模型动辄需要数百 GPU 天;现有效率方法靠在时间步上做滑动窗口子采样,根本上破坏了优化稳定性,且无法逼近全轨迹训练的对齐质量 本文贡献:提出 Flash-GRPO 单步训练框架:(1) Iso-Temporal Grouping 通过 prompt 内部的时间一致性消除时间步混淆方差,把策略表现与时间步难度解耦;(2) Temporal Gradient Rectification 中和不同时间步的尺度因子,防止梯度幅值跨时间步剧烈漂移;最终单步 GRPO 即可超越全轨迹训练的对齐质量 实验效果:在 1.3B 到 14B 视频扩散模型上验证:训练显著加速、稳定性优于全轨迹基线,对齐质量达到 SOTA,让 14B 视频对齐从「数百 GPU 天」级实验变得可负担 批判点评:把视频 GRPO 的瓶颈精准定位到「时间步混淆 + 梯度尺度漂移」并各个击破,工程上极具实用性;但单步训练对教师 reward 噪声的鲁棒性、与 Causal Forcing 类少步 AR 视频的兼容性还需进一步验证 2. Spherical-FM:球面插值贴合潜空间路径 Aligning Latent Geometry for Spherical Flow Matching in Image Generation | Virginia Tech, fal | arXiv:2605.15193 关键词:Flow Matching·球面几何·潜空间·slerp·图像生成 ⚠️ 前序问题:潜空间 flow matching 通常在高斯噪声与 VAE 潜在变量之间走线性路径,但两端点都集中在薄薄的球壳上,欧式弦线在每一步都「离开了壳」——即使预处理对齐了半径,路径仍然不在真实的数据流形上 本文贡献:把每个潜在 token 分解为「径向 + 角度」两个分量,用 swap 探针证明感知和语义内容主要由方向承载、径向贡献远小于此;据此把数据潜变量投影到固定 token 半径,用高斯噪声的径向投影作为球面先验,冻结 encoder 微调 decoder,并把线性插值替换为球面插值(slerp)——测速目标因此在构造上变成纯角度,路径全程贴在球面上 实验效果:在多种图像 tokenizer 下一致改善 ImageNet-256 的类条件 FID;扩散网络结构无需改动、不引入辅助 encoder 或表征对齐目标,是一条极简但有效的几何修复路径 批判点评:回到流形几何本身解决「半径漂移」问题,理论清晰、实现极简——这是少有的「几乎零代码改动就涨点」的范式工作;但球面假设是否对所有 VAE 潜空间都成立、对 video latent 这种时空联合分布是否仍适用,还需更广验证 3. Sphere-Latent-Enc:解耦图像编码器与球面去噪 Efficient Image Synthesis with Sphere Latent Encoder | MBZUAI | arXiv:2605.15592 关键词:少步图像生成·球面潜空间·解耦训练·Sphere Encoder·推理加速 ⚠️ 前序问题:consistency 与 meanflow 类少步生成虽然推理便宜,但训练不稳定、可扩展性差;近期 Sphere Encoder 能少步出图,却需要在像素空间和潜空间间反复切换,重建与生成挤在同一架构里互相打架 本文贡献:把框架解耦为「固定预训练图像编码器 + 独立的球面潜在去噪模型」,完全在球面潜空间里训练去噪模型——训练和推理都不再需要反复跨像素/潜空间切换,重建和生成各自专精,互不掣肘 实验效果:在 Animal-Faces、Oxford-Flowers、ImageNet-1K 上同时显著超越 Sphere Encoder 的画质和推理速度,对比强力少步与多步基线也能取得有竞争力的结果,是一个高效少步图像合成的新基线 批判点评:「解耦」这个看似平凡的工程决策,反映出一个被忽略的事实:把重建和生成耦合在同一目标里很容易互相妥协;但跨数据集泛化、与扩散 Transformer 的兼容、以及球面潜空间的尺度上限仍需进一步研究 4. EntityBench:多镜头视频实体一致性基准 EntityBench: Towards Entity-Consistent Long-Range Multi-Shot Video Generation | ByteDance, Rice University | arXiv:2605.15199 关键词:多镜头视频·实体一致性·评测基准·记忆增强·叙事生成 ⚠️ 前序问题:多镜头视频生成把单镜头延伸到连贯叙事,但跨镜头维持角色、物体、地点的一致性长期是难题;现有评测用独立生成的 prompt 集,实体覆盖有限、一致性指标过于简单,难以做标准化比较 本文贡献:提出 EntityBench:从真实叙事媒体里抽取的 140 个 episode、2,491 个镜头,按易/中/难三档同时跟踪角色、物体、地点的实体调度(最长 50 镜头、13 跨镜头角色、22 跨镜头物体、回归间隔最长 48 镜头);配套三支柱评测套件解耦 intra-shot 质量、prompt 跟随、跨镜头一致性,并用保真度门控只让正确出现的实体进入跨镜头打分;另发布 EntityMem 基线:先把每实体的可信视觉参考存入持久记忆库,再生成 实验效果:实验显示现有方法的跨镜头实体一致性随回归距离急剧下降,显式 per-entity 记忆带来最高角色保真度(Cohen's d = +2.33)和实体出现率,为多镜头视频提供了能区分 SOTA 的标准评测 批判点评:把多镜头视频的「角色/物体/地点」标准化为可量化的 entity schedule 是社区一直缺的基础设施;但 140 个 episode 主要来自既有叙事媒体,对完全开放生成场景的覆盖度、评测自动化中视觉感知模型的偏差,仍是后续要补的环节 5. FashionChameleon:单卡 23.8 FPS 实时换装 FashionChameleon: Towards Real-Time and Interactive Human-Garment Video Customization | 厦门大学, 阿里巴巴 | arXiv:2605.15824 关键词:视频定制·实时交互·KV Cache·In-Context Learning·电商生成 ⚠️ 前序问题:服装级人物视频定制有巨大商业价值(电商、内容创作),但现有方法不支持低延迟交互式服装控制——用户无法在生成过程中实时切换服装,且多服装训练数据稀缺 本文贡献:提出 FashionChameleon 实时交互式自回归视频定制框架:(1) 不训多服装数据,用单参考-服装对配合 in-context learning 训练 Teacher Model,强制 reference/garment 失配迫使模型隐式保持单服装切换的连贯;(2) Streaming Distillation with In-Context Learning 用 in-context teacher forcing 微调,并用梯度重加权 distribution matching distillation 改善外推一致性;(3) Training-Free KV Cache Rescheduling 通过 garment KV refresh / historical KV withdraw / reference KV disentangle 实现切换时保留运动连贯 实验效果:支持长视频外推一致性 + 实时交互式服装切换,单 GPU 23.8 FPS 实时生成,比已有基线快 30-180 倍 批判点评:用「单服装数据 + KV 调度」绕过了多服装数据采集的瓶颈,是非常聪明的工程方案;但 KV 调度对极端切换(颜色/版型差异巨大)的视觉伪影、长时间交互后的累积漂移,仍是产品化的关键考验 6. VGGT-Ω:前馈 3D 重建首现 Scaling Law VGGT-Ω: Scaling Feed-Forward 3D Reconstruction | Meta FAIR, Oxford VGG | arXiv:2605.15195 关键词:前馈 3D 重建·register attention·scaling·动态场景·VLA ⚠️ 前序问题:VGGT 这类前馈式 3D 重建模型已经能与传统优化基线掰手腕,并提供几何感知特征服务下游任务;但要把这种模型 scale up 训练到更大的数据规模,原架构的显存占用与计算冗余成为最大障碍 本文贡献:提出 VGGT-Ω:(1) 用单一密集预测头 + 多任务监督简化原架构,去掉昂贵的高分辨率卷积层;(2) 用 register 把场景信息聚合为紧凑表示,并引入 register attention 把跨帧信息交换限定在 register 之间,部分替代全局 attention;(3) 配套高质量动态场景标注流水线 + 自监督协议;训练显存只需前代 30%,得以使用 15× 监督数据 + 大量无标注视频 实验效果:在静态与动态场景多个 benchmark 上一致刷 SOTA,例如 Sintel 上相机估计精度比之前最好结果提升 77%;学到的 register 还能改善 VLA 模型并支持语言对齐,证明重建可以作为空间理解的可扩展代理任务 批判点评:「重建模型也存在 scaling law」并通过架构精简一次性把训练规模拉满,是 VGGT 系列工作的关键里程碑;但 register 数量与表达能力的取舍、动态场景对真实开放视频的泛化,仍需在更复杂自由场景下追加验证 7. ReactiveGWM:解耦玩家与 NPC 跨游戏零样本 ReactiveGWM: Steering NPC in Reactive Game World Models | 腾讯, 新加坡国立大学, 港理工, 港科大广州 | arXiv:2605.15256 关键词:游戏世界模型·NPC 交互·零样本迁移·扩散主干·可控生成 ⚠️ 前序问题:现有游戏世界模型只从玩家主观视角模拟环境,把 NPC 当作背景像素,无法捕捉玩家与 NPC 的交互;本质上更像被动视频渲染器而非真正的仿真引擎,缺少建模动作引发的 NPC 反应所需的物理理解 本文贡献:提出 ReactiveGWM:显式解耦玩家控制与 NPC 行为——玩家动作通过轻量加性偏置注入扩散主干,NPC 高层响应(进攻/控制/防御)通过 cross-attention 模块 grounding;这些模块学到与游戏无关的交互逻辑表示,可零样本插入其他无标注游戏的世界模型,无需领域微调即可解锁可操控 NPC 交互 实验效果:在两款街头霸王上验证:保持精细玩家可控性的同时实现稳健、prompt 对齐的 NPC 策略遵循,为「策略丰富、可控的 NPC 交互」打开了零样本扩展的可能 批判点评:把「玩家 vs NPC」拆成两条解耦支路是非常优雅的设计,零样本迁移到其他游戏的能力让世界模型走出单一题材;但目前只验证了对战类游戏,开放世界 RPG 的多 NPC 协作、长时序情节一致性仍是开放问题 趋势观察 视频扩散对齐进入「单步训练」时代 — Flash-GRPO 把全轨迹 GRPO 压缩到单步训练,靠 iso-temporal grouping 与 temporal gradient rectification 修复时间步混淆与梯度漂移——14B 视频对齐从「数百 GPU 天」级实验降为可负担成本,视频扩散偏好对齐正在跨过工程化门槛 流匹配开始「修几何」而不是堆模型 — Spherical-FM 用径向/角度分解证明感知信息主要由方向承载,把线性插值改为球面插值即在多个 tokenizer 上一致涨点;Sphere Latent Encoder 进一步把生成完全搬到球面潜空间——少步图像生成的下一波收益来自「让路径贴上流形」 多镜头视频从「能拍」走向「记得住」 — EntityBench 把跨镜头角色/物体/地点一致性升级为可量化基础设施,配套 EntityMem 显式记忆库验证「记忆」是关键变量——多镜头视频生成的下一战场不是单镜头质量,而是叙事意义上的实体连续性 人物-服装视频生成走向实时交互 — FashionChameleon 用 in-context learning + KV cache 调度实现 23.8 FPS 单 GPU 实时换装,比基线快 30-180 倍——电商和内容创作的「实时交互式视频定制」从 demo 走向产品级 重建模型也存在 scaling law — VGGT-Ω 用 register attention 等架构精简把训练显存压到 30%,在 15× 数据上推到 77% Sintel 提升;ReactiveGWM 让世界模型零样本迁移到不同游戏——「重建+世界模型」开始从感知任务走向通用空间智能 人工智能炼丹君 整理 | 2026-05-18

AIGC 每日速读|2026-05-18|14B视频对齐单步训练Flash-GRPO 今日 AIGC 论文速览 今日共 7 篇 · 视频扩散对齐与定制 2 篇 · 图像生成几何与少步推理 2 篇 · 多镜头视频与实体一致性 1 篇 · 3D 重建与世界模型 2 篇 重点论文标题列表 Flash-GRPO:14B 视频对齐单步训练即超全轨迹 Spherical-FM:球面插值贴合潜空间路径 ⚡ Sphere-Latent-Enc:解耦图像编码器与球面去噪 EntityBench:多镜头视频实体一致性基准 FashionChameleon:单卡 23.8 FPS 实时换装 今日论文速览 1. Flash-GRPO:14B 视频对齐单步训练即超全轨迹 Flash-GRPO: Efficient Alignment for Video Diffusion via One-Step Policy Optimization | 浙江大学, 京东 | arXiv:2605.15980 关键词:视频扩散·GRPO 对齐·单步训练·时间步分组·14B 大模型 ⚠️ 前序问题:GRPO 已成为对齐视频扩散模型与人类偏好的关键工具,但训练 14B 视频扩散模型动辄需要数百 GPU 天;现有效率方法靠在时间步上做滑动窗口子采样,根本上破坏了优化稳定性,且无法逼近全轨迹训练的对齐质量 本文贡献:提出 Flash-GRPO 单步训练框架:(1) Iso-Temporal Grouping 通过 prompt 内部的时间一致性消除时间步混淆方差,把策略表现与时间步难度解耦;(2) Temporal Gradient Rectification 中和不同时间步的尺度因子,防止梯度幅值跨时间步剧烈漂移;最终单步 GRPO 即可超越全轨迹训练的对齐质量 实验效果:在 1.3B 到 14B 视频扩散模型上验证:训练显著加速、稳定性优于全轨迹基线,对齐质量达到 SOTA,让 14B 视频对齐从「数百 GPU 天」级实验变得可负担 批判点评:把视频 GRPO 的瓶颈精准定位到「时间步混淆 + 梯度尺度漂移」并各个击破,工程上极具实用性;但单步训练对教师 reward 噪声的鲁棒性、与 Causal Forcing 类少步 AR 视频的兼容性还需进一步验证 2. Spherical-FM:球面插值贴合潜空间路径 Aligning Latent Geometry for Spherical Flow Matching in Image Generation | Virginia Tech, fal | arXiv:2605.15193 关键词:Flow Matching·球面几何·潜空间·slerp·图像生成 ⚠️ 前序问题:潜空间 flow matching 通常在高斯噪声与 VAE 潜在变量之间走线性路径,但两端点都集中在薄薄的球壳上,欧式弦线在每一步都「离开了壳」——即使预处理对齐了半径,路径仍然不在真实的数据流形上 本文贡献:把每个潜在 token 分解为「径向 + 角度」两个分量,用 swap 探针证明感知和语义内容主要由方向承载、径向贡献远小于此;据此把数据潜变量投影到固定 token 半径,用高斯噪声的径向投影作为球面先验,冻结 encoder 微调 decoder,并把线性插值替换为球面插值(slerp)——测速目标因此在构造上变成纯角度,路径全程贴在球面上 实验效果:在多种图像 tokenizer 下一致改善 ImageNet-256 的类条件 FID;扩散网络结构无需改动、不引入辅助 encoder 或表征对齐目标,是一条极简但有效的几何修复路径 批判点评:回到流形几何本身解决「半径漂移」问题,理论清晰、实现极简——这是少有的「几乎零代码改动就涨点」的范式工作;但球面假设是否对所有 VAE 潜空间都成立、对 video latent 这种时空联合分布是否仍适用,还需更广验证 3. Sphere-Latent-Enc:解耦图像编码器与球面去噪 Efficient Image Synthesis with Sphere Latent Encoder | MBZUAI | arXiv:2605.15592 关键词:少步图像生成·球面潜空间·解耦训练·Sphere Encoder·推理加速 ⚠️ 前序问题:consistency 与 meanflow 类少步生成虽然推理便宜,但训练不稳定、可扩展性差;近期 Sphere Encoder 能少步出图,却需要在像素空间和潜空间间反复切换,重建与生成挤在同一架构里互相打架 本文贡献:把框架解耦为「固定预训练图像编码器 + 独立的球面潜在去噪模型」,完全在球面潜空间里训练去噪模型——训练和推理都不再需要反复跨像素/潜空间切换,重建和生成各自专精,互不掣肘 实验效果:在 Animal-Faces、Oxford-Flowers、ImageNet-1K 上同时显著超越 Sphere Encoder 的画质和推理速度,对比强力少步与多步基线也能取得有竞争力的结果,是一个高效少步图像合成的新基线 批判点评:「解耦」这个看似平凡的工程决策,反映出一个被忽略的事实:把重建和生成耦合在同一目标里很容易互相妥协;但跨数据集泛化、与扩散 Transformer 的兼容、以及球面潜空间的尺度上限仍需进一步研究 4. EntityBench:多镜头视频实体一致性基准 EntityBench: Towards Entity-Consistent Long-Range Multi-Shot Video Generation | ByteDance, Rice University | arXiv:2605.15199 关键词:多镜头视频·实体一致性·评测基准·记忆增强·叙事生成 ⚠️ 前序问题:多镜头视频生成把单镜头延伸到连贯叙事,但跨镜头维持角色、物体、地点的一致性长期是难题;现有评测用独立生成的 prompt 集,实体覆盖有限、一致性指标过于简单,难以做标准化比较 本文贡献:提出 EntityBench:从真实叙事媒体里抽取的 140 个 episode、2,491 个镜头,按易/中/难三档同时跟踪角色、物体、地点的实体调度(最长 50 镜头、13 跨镜头角色、22 跨镜头物体、回归间隔最长 48 镜头);配套三支柱评测套件解耦 intra-shot 质量、prompt 跟随、跨镜头一致性,并用保真度门控只让正确出现的实体进入跨镜头打分;另发布 EntityMem 基线:先把每实体的可信视觉参考存入持久记忆库,再生成 实验效果:实验显示现有方法的跨镜头实体一致性随回归距离急剧下降,显式 per-entity 记忆带来最高角色保真度(Cohen's d = +2.33)和实体出现率,为多镜头视频提供了能区分 SOTA 的标准评测 批判点评:把多镜头视频的「角色/物体/地点」标准化为可量化的 entity schedule 是社区一直缺的基础设施;但 140 个 episode 主要来自既有叙事媒体,对完全开放生成场景的覆盖度、评测自动化中视觉感知模型的偏差,仍是后续要补的环节 5. FashionChameleon:单卡 23.8 FPS 实时换装 FashionChameleon: Towards Real-Time and Interactive Human-Garment Video Customization | 厦门大学, 阿里巴巴 | arXiv:2605.15824 关键词:视频定制·实时交互·KV Cache·In-Context Learning·电商生成 ⚠️ 前序问题:服装级人物视频定制有巨大商业价值(电商、内容创作),但现有方法不支持低延迟交互式服装控制——用户无法在生成过程中实时切换服装,且多服装训练数据稀缺 本文贡献:提出 FashionChameleon 实时交互式自回归视频定制框架:(1) 不训多服装数据,用单参考-服装对配合 in-context learning 训练 Teacher Model,强制 reference/garment 失配迫使模型隐式保持单服装切换的连贯;(2) Streaming Distillation with In-Context Learning 用 in-context teacher forcing 微调,并用梯度重加权 distribution matching distillation 改善外推一致性;(3) Training-Free KV Cache Rescheduling 通过 garment KV refresh / historical KV withdraw / reference KV disentangle 实现切换时保留运动连贯 实验效果:支持长视频外推一致性 + 实时交互式服装切换,单 GPU 23.8 FPS 实时生成,比已有基线快 30-180 倍 批判点评:用「单服装数据 + KV 调度」绕过了多服装数据采集的瓶颈,是非常聪明的工程方案;但 KV 调度对极端切换(颜色/版型差异巨大)的视觉伪影、长时间交互后的累积漂移,仍是产品化的关键考验 6. VGGT-Ω:前馈 3D 重建首现 Scaling Law VGGT-Ω: Scaling Feed-Forward 3D Reconstruction | Meta FAIR, Oxford VGG | arXiv:2605.15195 关键词:前馈 3D 重建·register attention·scaling·动态场景·VLA ⚠️ 前序问题:VGGT 这类前馈式 3D 重建模型已经能与传统优化基线掰手腕,并提供几何感知特征服务下游任务;但要把这种模型 scale up 训练到更大的数据规模,原架构的显存占用与计算冗余成为最大障碍 本文贡献:提出 VGGT-Ω:(1) 用单一密集预测头 + 多任务监督简化原架构,去掉昂贵的高分辨率卷积层;(2) 用 register 把场景信息聚合为紧凑表示,并引入 register attention 把跨帧信息交换限定在 register 之间,部分替代全局 attention;(3) 配套高质量动态场景标注流水线 + 自监督协议;训练显存只需前代 30%,得以使用 15× 监督数据 + 大量无标注视频 实验效果:在静态与动态场景多个 benchmark 上一致刷 SOTA,例如 Sintel 上相机估计精度比之前最好结果提升 77%;学到的 register 还能改善 VLA 模型并支持语言对齐,证明重建可以作为空间理解的可扩展代理任务 批判点评:「重建模型也存在 scaling law」并通过架构精简一次性把训练规模拉满,是 VGGT 系列工作的关键里程碑;但 register 数量与表达能力的取舍、动态场景对真实开放视频的泛化,仍需在更复杂自由场景下追加验证 7. ReactiveGWM:解耦玩家与 NPC 跨游戏零样本 ReactiveGWM: Steering NPC in Reactive Game World Models | 腾讯, 新加坡国立大学, 港理工, 港科大广州 | arXiv:2605.15256 关键词:游戏世界模型·NPC 交互·零样本迁移·扩散主干·可控生成 ⚠️ 前序问题:现有游戏世界模型只从玩家主观视角模拟环境,把 NPC 当作背景像素,无法捕捉玩家与 NPC 的交互;本质上更像被动视频渲染器而非真正的仿真引擎,缺少建模动作引发的 NPC 反应所需的物理理解 本文贡献:提出 ReactiveGWM:显式解耦玩家控制与 NPC 行为——玩家动作通过轻量加性偏置注入扩散主干,NPC 高层响应(进攻/控制/防御)通过 cross-attention 模块 grounding;这些模块学到与游戏无关的交互逻辑表示,可零样本插入其他无标注游戏的世界模型,无需领域微调即可解锁可操控 NPC 交互 实验效果:在两款街头霸王上验证:保持精细玩家可控性的同时实现稳健、prompt 对齐的 NPC 策略遵循,为「策略丰富、可控的 NPC 交互」打开了零样本扩展的可能 批判点评:把「玩家 vs NPC」拆成两条解耦支路是非常优雅的设计,零样本迁移到其他游戏的能力让世界模型走出单一题材;但目前只验证了对战类游戏,开放世界 RPG 的多 NPC 协作、长时序情节一致性仍是开放问题 趋势观察 视频扩散对齐进入「单步训练」时代 — Flash-GRPO 把全轨迹 GRPO 压缩到单步训练,靠 iso-temporal grouping 与 temporal gradient rectification 修复时间步混淆与梯度漂移——14B 视频对齐从「数百 GPU 天」级实验降为可负担成本,视频扩散偏好对齐正在跨过工程化门槛 流匹配开始「修几何」而不是堆模型 — Spherical-FM 用径向/角度分解证明感知信息主要由方向承载,把线性插值改为球面插值即在多个 tokenizer 上一致涨点;Sphere Latent Encoder 进一步把生成完全搬到球面潜空间——少步图像生成的下一波收益来自「让路径贴上流形」 多镜头视频从「能拍」走向「记得住」 — EntityBench 把跨镜头角色/物体/地点一致性升级为可量化基础设施,配套 EntityMem 显式记忆库验证「记忆」是关键变量——多镜头视频生成的下一战场不是单镜头质量,而是叙事意义上的实体连续性 人物-服装视频生成走向实时交互 — FashionChameleon 用 in-context learning + KV cache 调度实现 23.8 FPS 单 GPU 实时换装,比基线快 30-180 倍——电商和内容创作的「实时交互式视频定制」从 demo 走向产品级 重建模型也存在 scaling law — VGGT-Ω 用 register attention 等架构精简把训练显存压到 30%,在 15× 数据上推到 77% Sintel 提升;ReactiveGWM 让世界模型零样本迁移到不同游戏——「重建+世界模型」开始从感知任务走向通用空间智能 人工智能炼丹君 整理 | 2026-05-18 -