搜索到

2

篇与

线性注意力

的结果

-

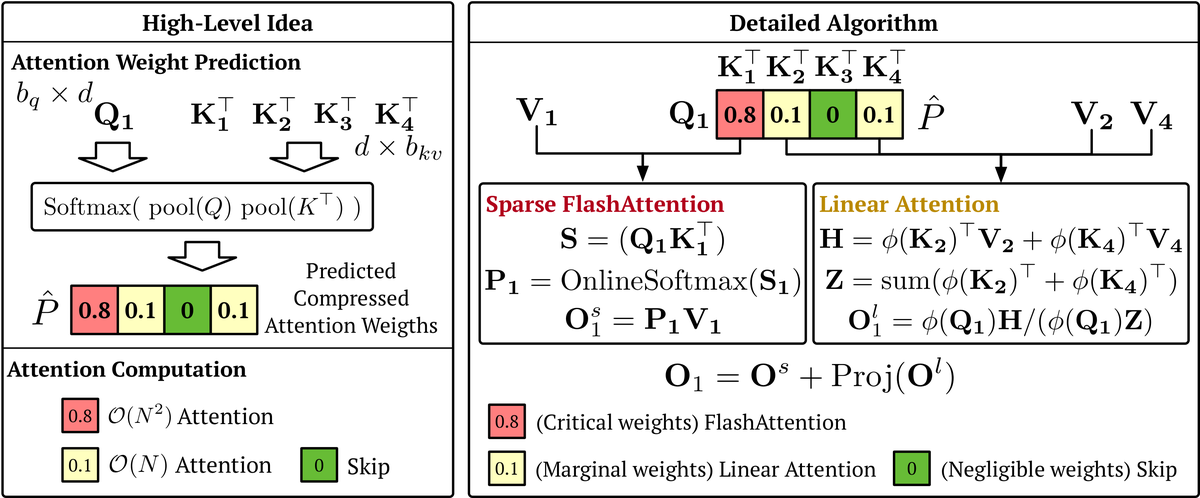

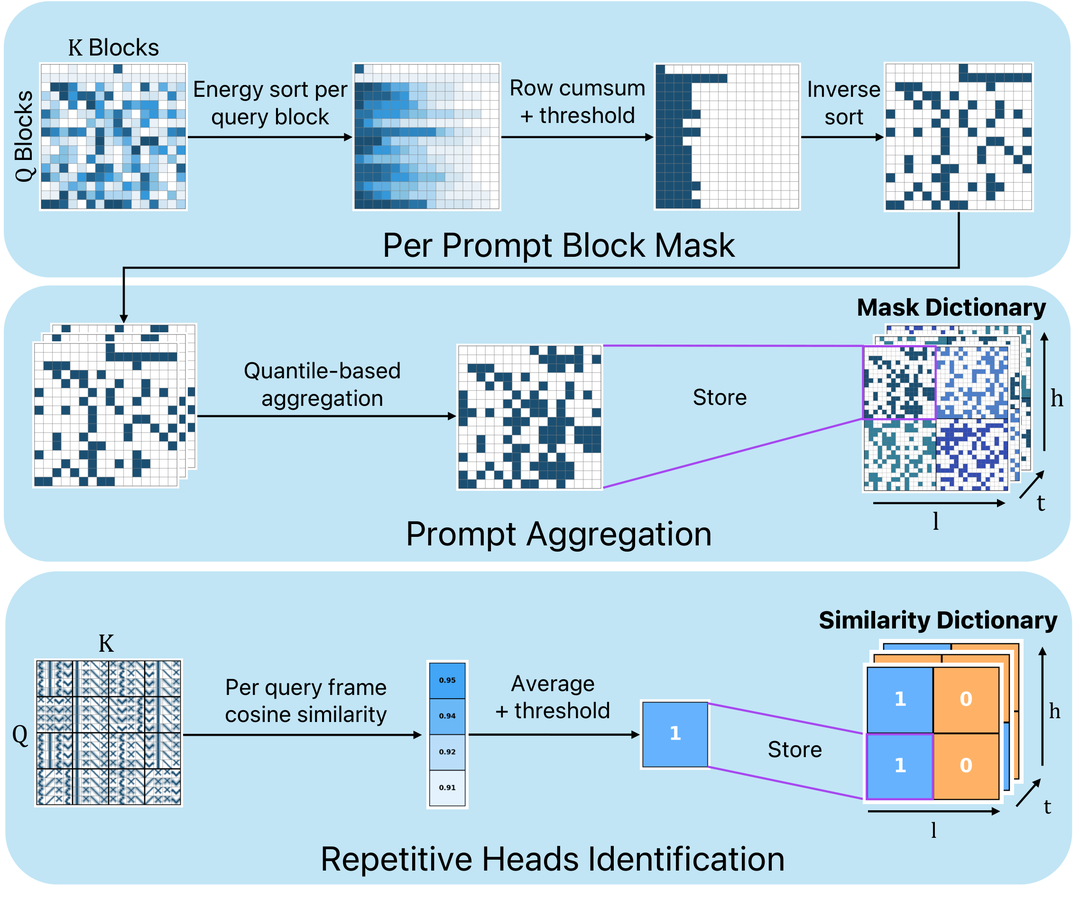

AIGC 周末专题|2026-05-02|稀疏注意力让视频生成快18倍 引言:为什么视频生成需要稀疏注意力? 视频扩散 Transformer(Video DiT)正在成为视频生成的主流架构。从 Wan 2.2、HunyuanVideo 到 CogVideoX,这些模型普遍采用 3D 全注意力(Full 3D Attention),让每个 token 都能与序列中所有其他 token 交互。这种设计虽然带来了出色的生成质量,但代价极为沉重——以 HunyuanVideo 生成一段 5 秒 720P 视频为例,总推理耗时约 945 秒,其中注意力运算就占了约 800 秒(84.7%)。O(N²) 的计算复杂度使注意力成为视频生成提速的首要瓶颈。 一个关键的观察是:视频 DiT 的注意力图天然是高度稀疏的。大量 token 之间的注意力权重可以忽略不计,真正重要的交互集中在时间相邻帧、空间局部区域和少量全局"锚点"之间。这一特性意味着,如果能精确识别并跳过无关计算,就能在几乎不损失质量的前提下获得数倍乃至十倍以上的加速。 过去一年(2025年5月—2026年4月),稀疏注意力在视频生成方向经历了爆发式发展:从最初的免训练启发式方法到精心设计的可训练替代方案,从纯稀疏到稀疏-线性融合,从双向扩散到自回归生成,技术路线日趋丰富。本专题系统梳理这一时期的 24 篇核心工作(深度解读 10 篇 + 速览 14 篇),涵盖 ICLR 2026 Oral、NeurIPS 2025、AAAI 2026、ICCV 2025、ICML 2025 等顶会成果,呈现该方向的完整技术演进脉络。 核心技术趋势 1. 从免训练到可训练,从推理到全程 稀疏注意力的演进路线清晰:免训练方法(CalibAtt / SVG-EAR / AdaSpa)天花板约 2x,轻量微调(SALAD / SLA)突破至 2-5x,全程可训练(VSA / BSA)则实现训练+推理双加速。三条路线并行发展,适用于不同部署场景。 2. 稀疏+线性融合成为最优范式 SLA(ICLR 2026 Oral)确立了"大权重用稀疏、小权重用线性"的分工模式。SLA2 通过可学习路由将其推向极致(18.6x),SALAD 用门控机制轻量化实现同一思路。这一范式的优势在于理论完备且工程可落地。 3. 注意力图的结构化利用 从统一稀疏策略到结构化利用:Sparse-vDiT 识别三种 Pattern(对角线/多对角线/竖条纹)、VMonarch 用 Monarch 矩阵表示时空结构、CalibAtt 发现跨输入稳定性。理解注意力图的内在结构是设计更好稀疏方案的关键。 4. 自回归视频扩散带来新挑战 Light Forcing 和 TempCache 分别面向 AR 视频扩散设计稀疏注意力和缓存压缩。随着 AR 范式(CogVideoX-AR / GameGen)兴起,因果注意力的稀疏化将成为新研究热点。 5. 多方法叠加走向实时部署 EasyCache + SVG 可叠加达 3x+;SLA + 步数蒸馏理论可达 5-10x 无损加速;稀疏注意力 + 量化(SLA2 QAT)+ 缓存三者联合,加之 SSTA 在 HunyuanVideo 1.5 中的工业级落地实践,正推动视频生成走向消费级设备实时部署。 方向分布与论文概览 本专题 24 篇论文按技术路线分为以下子方向: 稀疏+线性融合 3 篇(SLA, SLA2, SALAD) 免训练稀疏注意力 3 篇(SVG-EAR, CalibAtt, AdaSpa) 结构化 / Pattern 稀疏 2 篇(Sparse-vDiT, VMonarch) 可训练 / AR 稀疏 2 篇(VSA, Light Forcing) 其余工作 14 篇(SVG / SVG2 / STA / BSA / NABLA / SSTA / TempCache / SODA / EasyCache / FasterCache / FastLightGen / FrameDiT / DiagDist / Survey) 含 ICLR 2026 Oral × 1, ICLR 2026 × 1, NeurIPS 2025 × 1, AAAI 2026 × 1, ICCV 2025 × 1, ICML 2025 × 1, CVPR 2025 × 1 下面先梳理技术演进的时间脉络,再按重要度逐篇深入解读。 技术路线与时间线 基础探索(2024.6–2025.2) 描述:Sparse Attention 从 LLM 领域迁移到视频 DiT,研究者开始发现视频扩散 Transformer 3D 全注意力中天然存在的稀疏性。 关键节点: 2024.6–2025.2:LLM 稀疏注意力技术(Top-K / 局部窗口 / FlashAttention)向视频扩散模型迁移 免训练加速(2025.2–2025.5) 描述:Sparse VideoGen 系列开创免训练框架,系统性利用 3D 全注意力天然稀疏性实现视频 DiT 推理加速。 关键节点: 2025.2:Sparse VideoGen(SVG):首个系统性免训练稀疏注意力加速框架 2025.5:Sparse VideoGen2(SVG2):语义聚类驱动的稀疏模式发现 可训练突破(2025.5–2025.9) 描述:VSA 首次证明可训练稀疏注意力可在预训练阶段全程替代全注意力,实现训练+推理双加速。 关键节点: 2025.5:VSA(NeurIPS 2025):训练+推理全程稀疏注意力的里程碑 融合范式确立(2025.9–2026.1) 描述:SLA(ICLR 2026 Oral)确立"大权重稀疏+小权重线性"的融合范式,SALAD 和 VMonarch 从不同角度验证稀疏+线性混合设计。 关键节点: 2025.9:SLA(ICLR 2026 Oral):稀疏-线性注意力融合,13.7x 注意力加速 2026.1:SALAD:门控线性注意力并行分支,2000 样本微调达 90% 稀疏度 2026.1:VMonarch:Monarch 矩阵结构化注意力,17.5x FLOPs 减少 极致推进(2026.1–2026.4) 描述:SLA2 将加速比推向 18.6x,Light Forcing 首次面向自回归视频扩散设计稀疏方案,SVG-EAR 刷新免训练方法帕累托前沿,AdaSpa 以零开销搜索获得 ICCV 2025 接收。 关键节点: 2026.2:SLA2:可学习路由 + 量化感知训练,18.6x 注意力加速 2026.2:Light Forcing:首个 AR 视频扩散稀疏注意力 2026.3:SVG-EAR:误差感知路由 + 聚类质心补偿,1.93x 免训练加速 2026.2:AdaSpa(ICCV 2025):LSE 缓存搜索,免训练免数据最优解 以下按重要度排序,逐篇解读 10 篇核心论文。 1. SLA:稀疏-线性注意力融合——自定义GPU Kernel实现13.7倍注意力加速(ICLR 2026 Oral) 论文: SLA arXiv: 2509.24006 机构: 清华大学, UC Berkeley 研究动机 注意力权重可分为两部分:少量大权重(高秩)和大量小权重(低秩)。这天然暗示一种分工:对大权重用稀疏注意力(O(N²) 但只算少量),对小权重用线性注意力(O(N))。现有方法要么纯稀疏(丢失低秩信息)要么纯线性(无法捕捉局部关键依赖),SLA 首次将两者系统融合。 方法原理 三级权重分类:将注意力权重按大小分为 Critical(O(N²) 精确计算)、Marginal(O(N) 线性近似)、Negligible(跳过),95% 注意力计算被消除 融合 GPU Kernel:将稀疏和线性注意力的前向/反向计算融合到单个自定义 kernel 中,消除额外显存开销和 kernel launch 延迟 轻量微调:仅需少量步即可在目标视频 DiT 上完成适配 实验结果 注意力加速 13.7x,端到端加速 2.2x(Wan 2.1-1.3B),生成质量无损(VBench 指标保持),ICLR 2026 Oral 接收。 点评 优势:ICLR 2026 Oral 验证了学术价值;自定义 kernel 可直接工业落地;2.2x E2E 加速是质量无损方法中的最优数字。局限:仅在 1.3B 模型上验证,14B+ 效果未知;kernel 需针对不同硬件调优。后续方向包括更大模型验证和与蒸馏/缓存叠加。 2. SLA2:可学习路由+量化感知训练——97%稀疏度实现18.6倍注意力加速 论文: SLA2 arXiv: 2602.12675 机构: 清华大学, UC Berkeley 研究动机 SLA 采用固定的三级分类边界,无法适应不同层/头/时间步的动态变化。SLA2 提出两个改进方向:让模型自己学习最优的稀疏-线性分配比例,并利用量化技术进一步压缩计算。 方法原理 可学习路由器:每层每头配备轻量路由网络,动态预测每个注意力块应使用稀疏、线性还是跳过策略,突破 SLA 的固定边界 改进注意力公式:重新设计稀疏+线性混合公式,减少近似误差 量化感知训练(QAT):联合训练路由器和量化参数,在 INT4/INT8 精度下保持质量 实验结果 97% 注意力稀疏度(仅 3% 计算量),18.6x 注意力加速,视频生成质量与全注意力几乎无差距,支持 INT4 量化进一步压缩。 点评 优势:在 SLA 基础上加速比提升 35%,可学习路由实现层级自适应。局限:需要训练路由器(非免训练);QAT 引入额外训练复杂性。后续方向包括与蒸馏联合优化和消费级设备部署。 3. SVG-EAR:误差感知路由+无参数线性补偿——免训练1.93倍端到端加速 论文: SVG-EAR arXiv: 2603.08982 机构: UC Berkeley 研究动机 现有免训练稀疏注意力面临两难:直接丢弃被跳过块会丢失信息;用学习型预测器近似又引入训练开销。SVG-EAR 的关键洞察是:经过语义聚类后,同一块内的 K/V 具有高度相似性,可用少量聚类质心准确概括——这使得"补偿"取代"丢弃"成为可能。 方法原理 聚类质心补偿:对被跳过的注意力块,用 K/V 聚类质心做 O(N) 线性近似,无参数恢复其对输出的贡献 误差感知路由:颠覆"高注意力分数=重要"的传统假设,改为选择"近似误差最大"的块做精确计算 理论保证:提供注意力重建误差与聚类质量之间的理论上界 实验结果 Wan 2.2 上 1.77x 端到端加速(PSNR 29.76),HunyuanVideo 上 1.93x 端到端加速(PSNR 31.04),显著优于 SVG2 和 CalibAtt,完全免训练。 点评 优势:免训练、有理论保证、误差感知路由是本领域最具洞察的方法论创新。局限:聚类质心计算有额外开销;PSNR 不是视频生成的最佳指标;加速上限受限于免训练范式。 4. VSA:端到端可训练稀疏注意力——从预训练阶段替换全注意力(NeurIPS 2025) 论文: VSA arXiv: 2505.13389 机构: UC Berkeley, FastVideo 研究动机 现有稀疏注意力仅用于推理阶段,训练仍需全注意力,导致训练-推理不一致和训练成本居高不下。VSA 提出一个根本性问题:能否设计一种从预训练到推理全程使用的稀疏注意力,彻底替代全注意力? 方法原理 粗粒度预测:将 token 序列划分为 3D cubes 并池化,用低成本全注意力预测每个 cube 的重要性,选出关键区域 细粒度执行:仅在预测的关键区域执行 token 级精确注意力,形成块稀疏计算模式 硬件对齐:cube 和块大小均对齐 GPU warp/SM 执行粒度,最大化并行效率 实验结果 训练和推理同时加速,视频生成质量与全注意力基线持平,显著降低训练 GPU 小时数,NeurIPS 2025 接收。 点评 优势:训练+推理双加速是独特卖点;硬件对齐设计实用性强。局限:粗粒度预测可能丢失细粒度关键信息;需要从头预训练或大量微调,部署门槛较高。 5. Sparse-vDiT:三模式稀疏Pattern识别+定制Kernel——视频DiT注意力图的系统性利用(AAAI 2026) 论文: Sparse-vDiT arXiv: 2506.03065 机构: 多机构合作 研究动机 此前的稀疏注意力方法大多采用统一策略(Top-K 或块级稀疏),未充分利用视频 DiT 注意力图的结构特征。Sparse-vDiT 通过系统统计分析,发现三种反复出现的稀疏模式,并为每种模式定制高效计算方案。 方法原理 三种稀疏模式识别:对角线(diagonal,反映时间邻近性)、多对角线(multi-diagonal,反映空间局部性)、竖条纹(vertical-stripe,反映全局 anchor token) Pattern-Optimized Sparse Kernels:为每种模式设计专用 CUDA kernel,将稠密注意力替换为结构化稀疏计算 自适应模式选择:根据每层每头的注意力分布自动匹配最优模式 实验结果 在 HunyuanVideo 上理论 FLOPs 减少约 50-70%(因层/头而异),实际推理延迟降低,视觉质量保持(论文未报告统一的端到端加速倍数),AAAI 2026 接收。 点评 优势:对注意力图结构的分析深入,三种模式的发现为后续工作提供了理论基础。局限:固定三种模式可能无法覆盖所有场景;缺乏统一的端到端加速数字使得与其他方法定量比较困难。 6. SALAD:门控线性注意力并行分支——仅2000样本微调实现90%稀疏度 论文: SALAD arXiv: 2601.16515 机构: 清华大学, 腾讯 研究动机 免训练稀疏注意力的稀疏度通常受限于 50-70%,突破上限需要训练,但训练型方法(如 SLA)通常需要大量数据和计算。SALAD 探索一条中间路线:能否用极轻量的微调达到极高稀疏度? 方法原理 双分支并行:在稀疏注意力旁添加轻量线性注意力分支,捕捉被稀疏丢弃的低秩信息 输入依赖门控:可学习门控机制根据输入内容动态调节两分支的贡献权重 极轻量微调:仅新增线性层和门控参数,2000 个视频样本 + 1600 步即可完成训练 实验结果 90% 稀疏度,1.72x 推理加速,生成质量与全注意力基线相当,适配多种视频 DiT 模型。 点评 优势:微调效率极高(2000 样本),工程门槛最低的稀疏-线性融合方案。局限:1.72x 加速低于 SLA 的 2.2x;线性注意力的表达能力有限。 7. VMonarch:Monarch矩阵结构化注意力——17.5倍FLOPs减少的数学最优解 论文: VMonarch arXiv: 2601.22275 机构: 南京大学, 腾讯 研究动机 现有稀疏方法(Top-K / 局部窗口)缺乏数学最优性保证。VMonarch 发现 Monarch 矩阵——一类具有灵活稀疏性的结构化矩阵——可以优雅地表示视频 DiT 的时空注意力模式。 方法原理 时空 Monarch 分解:将全注意力矩阵分解为帧内(空间)和帧间(时间)两组 Monarch 因子,分别捕捉空间和时间相关性 交替最小化:通过交替优化两组因子逼近原始全注意力,配合重计算策略解决收敛不稳定问题 在线熵算法:融入 FlashAttention 的在线计算范式,支持长序列高效更新 实验结果 注意力 FLOPs 减少 17.5x,注意力计算加速 5x+,90% 稀疏度下超越所有 SOTA 稀疏方法,轻量微调后 VBench 质量与全注意力相当。 点评 优势:数学上最优雅的方案,FlashAttention 兼容,理论深度最强。局限:实际 wall-clock 加速(5x)远小于理论 FLOPs 减少(17.5x),存在工程实现瓶颈;交替最小化收敛依赖初始化。 8. Light Forcing:首个面向自回归视频扩散的稀疏注意力——Chunk-Aware Growth机制 论文: Light Forcing arXiv: 2602.04789 机构: 多机构合作 研究动机 现有稀疏注意力主要面向双向扩散模型(Wan / HunyuanVideo),而自回归视频扩散模型(GameGen / CogVideoX-AR)的因果结构截然不同——新帧只能看到历史帧,注意力范围随生成推进单调增长。Light Forcing 首次为 AR 视频扩散定制稀疏注意力方案。 方法原理 AR 注意力模式分析:发现 AR 视频扩散中注意力呈因果增长模式——新帧主要关注临近帧和少量关键锚帧 Chunk-Aware Growth:将序列划分为因果 chunk,稀疏注意力范围随 chunk 增长动态扩展,保持选择性历史回顾 锚帧保留策略:自动识别关键参考帧保持全注意力,确保长程一致性 实验结果 AR 视频生成质量和效率双赢(论文报告质量提升 + 推理加速,但未给出统一的端到端加速倍数),长视频一致性提升,代码开源。 点评 优势:AR 视频生成方向的首个稀疏注意力方案,填补空白;Chunk-Aware Growth 与 AR 范式天然匹配。局限:AR 视频生成模型本身尚未成为主流,方法的影响力取决于 AR 范式的普及速度。 9. CalibAtt:离线校准+在线高效推理——跨输入稳定的块级稀疏模式 论文: CalibAtt arXiv: 2603.05503 机构: 以色列理工 研究动机 已有免训练稀疏注意力要么在线动态判断 token 重要性(开销大),要么使用固定模式(不够灵活)。CalibAtt 发现一个关键洞察:稀疏模式在不同输入上惊人地稳定——大量 token 连接在任何视频上都产生可忽略的注意力分数,可以离线一次校准、在线直接复用。 方法原理 离线校准:在少量参考视频上运行全注意力,统计每一层、每个头、每个扩散时间步的块级稀疏模式 模式编译:将稳定模式编译为优化的注意力操作(类似 JIT 编译),在线推理时直接跳过非关键连接 块级粒度:兼顾近似精度和 GPU 硬件效率 实验结果 Wan 2.1 14B、Mochi 1 及其蒸馏版本上 1.58x 端到端加速,视频生成质量和文本对齐度优于已有免训练方法,完全免训练。 点评 优势:完全免训练、即插即用、离线校准成本极低。局限:1.58x 加速在近期方法中不突出(已被 SVG-EAR 的 1.93x 超越);对新架构需重新校准。 10. AdaSpa:动态模式+在线精确搜索——面向长视频的自适应稀疏注意力(ICCV 2025) 论文: AdaSpa arXiv: 2502.21079 机构: 字节跳动, 北京大学 研究动机 现有免训练稀疏方法面临二选一:固定模式(CalibAtt,无法动态适应)或在线搜索(开销大)。AdaSpa 提出:能否"免费"获得在线精确搜索能力? 方法原理 块化模式(Blockified Pattern):将注意力矩阵划分为层次化 block,高效表示 DiT 的多尺度稀疏性 LSE 缓存搜索:利用 FlashAttention 计算过程中的 LogSumExp 副产品作为 block 重要性信号——零额外开销即可精确定位关键区域 自适应稀疏决策:每步动态决定哪些 block 需要精确计算,免训练、免数据、即插即用 实验结果 在 OpenSora 等长视频模型上实现显著加速(论文报告视觉质量与原始模型几乎相同),免训练免数据,ICCV 2025 接收。 点评 优势:LSE 缓存搜索零开销,设计极其优雅,是免训练方法中工程最巧妙的方案。局限:依赖 FlashAttention 实现,对其他注意力后端不通用。 其余论文速览 免训练框架 & 稀疏注意力基础 附-1. Sparse VideoGen:首个系统性利用3D全注意力天然稀疏性的免训练加速框架 Sparse VideoGen: Accelerating Video Diffusion Transformers with Inherent Sparsity | arXiv:2502.01776 | UC Berkeley 关键词: 免训练, 空间/时间稀疏, 3D全注意力, 系列开山作 前序工作问题: 视频DiT的3D全注意力被视为黑盒,其内在稀疏性未被系统性利用。 贡献: 首个系统性利用3D全注意力天然稀疏性的免训练加速框架,在线3%样本分析识别空间/时间稀疏模式。 效果: 在Wan/HunyuanVideo/Mochi上实现高效免训练加速,开创Sparse VideoGen系列。 批判点评: 方向开创性强,但在线分析存在开销;后续SVG2和SVG-EAR在其基础上大幅改进。 附-2. Sparse VideoGen2:语义聚类驱动的稀疏注意力加速 Sparse VideoGen2: Accelerate Video Generation with Sparse Attention via Semantic-Aware Clustering | arXiv:2505.18875 | UC Berkeley 关键词: 语义聚类, K-Means, 空间/时间稀疏, SVG系列第二代 前序工作问题: SVG的在线稀疏模式分析精度有限,缺乏语义层面的理解。 贡献: 基于K-Means语义聚类的稀疏注意力加速,自动发现空间和时间两种稀疏模式并分别优化。 效果: 在SVG基础上进一步提升加速比,聚类质量直接影响加速效果。 批判点评: 语义聚类方向正确,但K-Means本身有计算开销;已被SVG-EAR的误差感知路由超越。 缓存与混合加速 附-3. TempCache:面向自回归视频扩散的时间缓存压缩+稀疏注意力联合加速 Fast Autoregressive Video Diffusion and World Models with Temporal Cache Compression and Sparse Attention | arXiv:2602.01801 | 多机构合作 关键词: KV缓存压缩, 自回归, 世界模型, AnnCA 前序工作问题: 自回归视频扩散模型的KV缓存随序列增长线性膨胀,导致长视频生成效率低下。 贡献: 面向自回归视频扩散的时间KV缓存压缩+稀疏注意力联合加速,AnnCA近似近邻注意力。 效果: 长视频流式生成效率大幅提升,支持视频世界模型。 批判点评: KV缓存压缩与稀疏注意力正交互补,联合使用前景广阔;AnnCA的近似精度需关注。 附-4. SODA:敏感度导向的缓存+剪枝统一框架 SODA: Sensitivity-Oriented Dynamic Acceleration for Diffusion Transformer | arXiv:2603.07057 | 多机构合作 关键词: 敏感度建模, 动态规划, 缓存+剪枝, 统一框架 前序工作问题: 缓存和剪枝分别独立设计,缺乏统一最优策略。 贡献: 敏感度导向的缓存+剪枝统一框架,通过动态规划求解最优缓存时间点。 效果: 在DiT-XL/PixArt-α/OpenSora上实现SOTA保真度-加速比权衡。 批判点评: 统一框架设计优雅,动态规划给出理论最优解;但离线分析和迁移成本需考虑。 附-5. EasyCache:免训练自适应缓存加速,与SVG稀疏注意力可叠加 Less is Enough: Training-Free Video Diffusion Acceleration via Adaptive Caching | arXiv:2507.03065 | 多机构合作 关键词: 免训练, 自适应缓存, 可叠加, 3x加速 前序工作问题: 缓存方法和稀疏注意力通常独立设计,能否叠加加速? 贡献: 无需训练的自适应缓存加速,运行时自适应决策何时复用何时重算,与SVG稀疏注意力可叠加。 效果: SVG+EasyCache在HunyuanVideo上实现3x以上加速。 批判点评: 叠加性是关键价值——稀疏注意力+缓存的联合使用开辟了组合加速新思路。 附-6. FasterCache:免训练视频扩散缓存加速(ICLR 2026) FasterCache: Training-Free Video Diffusion Model Acceleration with High Quality | ICLR 2026 | 多机构合作 关键词: 免训练缓存, 时间步复用, ICLR 2026, 全自注意力 前序工作问题: 视频扩散不同时间步之间的特征相似性未被充分利用。 贡献: 免训练视频扩散缓存加速,利用全自注意力层的时间步相关性进行特征复用。 效果: 在CogVideoX/Vchitect 2.0/Mochi上实现高质量免训练加速。 批判点评: ICLR 2026接收验证了方法的严谨性;缓存+稀疏注意力的协同将是未来主流。 滑动窗口与训练加速 附-7. STA:Tile级滑动窗口注意力——硬件友好设计实现2.8-17x注意力加速(ICML 2025) Fast Video Generation with Sliding Tile Attention | arXiv:2502.04507 | UC Berkeley (Hao AI Lab) 关键词: 滑动窗口, Tile级, 硬件友好, ICML 2025, 免训练 前序工作问题: Token级滑动窗口注意力(SWA)在GPU上硬件利用率低,无法充分利用视频DiT注意力的3D局部性。 贡献: 提出Tile级滑动窗口注意力替代Token级,利用视频DiT注意力在3D时空局部窗口内集中的特性,硬件友好设计。 效果: 注意力加速2.8-17x(vs FlashAttention-2),端到端1.36-3.53x加速,HunyuanVideo延迟从945s降至268s,ICML 2025接收。 批判点评: 与稀疏注意力正交互补——STA处理局部窗口、稀疏方法处理全局选择,二者可叠加;ICML 2025验证了学术质量。 附-8. BSA:双向稀疏注意力——首个同时稀疏化Query和KV的训练加速方法 Bidirectional Sparse Attention for Faster Video Diffusion Training | arXiv:2509.01085 | UC Berkeley (Hao AI Lab) 关键词: 训练加速, 双向稀疏, Query+KV稀疏, 动态阈值, 20x FLOPs 前序工作问题: 现有稀疏注意力仅稀疏化KV端,Query端仍完整计算;且使用固定稀疏模式无法适应DiT的动态注意力特性。 贡献: 首个同时动态稀疏化Query和KV对的训练加速方法,通过语义相似性选择Query+动态阈值保留关键KV块。 效果: 训练FLOPs减少20x,注意力训练加速17.79x,生成质量与全注意力持平或超越。 批判点评: 与VSA同属训练加速方向但策略不同——VSA替换注意力机制,BSA在全注意力内部做双向稀疏;二者思路互补。 附-9. NABLA:自适应块级注意力——CDF二值化+Flex Attention免自定义CUDA ∇NABLA: Neighborhood Adaptive Block-Level Attention | arXiv:2507.13546 | AI Forever 关键词: 块级注意力, CDF二值化, Flex Attention, 训练+推理, 开源权重 前序工作问题: 自定义CUDA kernel开发门槛高,限制了稀疏注意力方法的社区采用。 贡献: 自适应块级注意力:下采样Q/K后在压缩空间计算注意力,CDF二值化生成稀疏mask,集成PyTorch Flex Attention无需自定义CUDA。 效果: 训练和推理加速最高2.7x,可与STA叠加使用,Wan 2.1预微调权重已开源。 批判点评: 工程门槛最低——无需写CUDA即可使用稀疏注意力;与STA叠加使用的设计体现了模块化组合的趋势。 工业级落地 附-10. SSTA (HunyuanVideo 1.5):选择性+滑动Tile注意力——工业级视频生成模型的稀疏注意力实践 HunyuanVideo 1.5 Technical Report — Selective and Sliding Tile Attention | arXiv:2511.18870 | 腾讯混元 关键词: SSTA, 选择性注意力, 滑动Tile, 工业级, 消费级GPU, 开源 前序工作问题: 学术界的稀疏注意力方案多在研究模型上验证,缺乏工业级视频生成模型中的端到端集成和大规模验证。 贡献: 提出SSTA(Selective and Sliding Tile Attention):识别并剪除冗余时空KV块,仅对高信息区域执行全注意力,集成于8.3B参数的工业级视频生成模型。 效果: 10秒720p视频端到端1.87x加速(vs FlashAttention-3),消费级GPU可运行,开源模型权重。 批判点评: 稀疏注意力从学术论文走向工业产品的标志性案例——SSTA融合了STA的滑动窗口和选择性剪枝,验证了稀疏注意力在大规模模型中的实用性。 蒸馏与替代注意力 附-11. FastLightGen:步数+参数同时压缩的三阶段协同蒸馏 FastLightGen: Fast and Light Video Generation with Fewer Steps and Parameters | arXiv:2603.01685 | 香港科技大学(广州) 关键词: 步数蒸馏, 参数剪枝, 联合压缩, 35x加速 前序工作问题: 步数蒸馏和参数剪枝独立应用效果有限,联合优化缺乏系统方案。 贡献: 步数+参数同时压缩的三阶段协同蒸馏管线,将13B模型压缩至30%参数4步推理。 效果: 35x加速HunyuanVideo/WanX,5秒视频数秒内生成。 批判点评: 蒸馏+稀疏注意力理论上可达5-10x无损加速,FastLightGen展示了单路线的极限。 附-12. FrameDiT:帧级矩阵注意力替代token级全注意力 FrameDiT: Frame-level Matrix Attention for Video Diffusion Transformers | arXiv:2603.10200 | 多机构合作 关键词: 帧级注意力, 矩阵注意力, 结构化, 需训练 前序工作问题: Full 3D注意力过于精细(token级),而Local Factorized Attention过于粗略(帧内/帧间分离),缺乏中间粒度设计。 贡献: 帧级矩阵注意力替代token级全注意力,粒度介于Full 3D和Local Factorized之间。 效果: 效率与Local Factorized Attention相当,多个视频生成benchmark达到SOTA。 批判点评: 帧级粒度提供了token级和因子化之间的有趣折中,但需要训练限制了即插即用性。 附-13. CausVid:将双向扩散模型蒸馏为自回归生成器实现实时视频生成(CVPR 2025) From Slow Bidirectional to Fast Autoregressive Video Diffusion Models | arXiv:2412.07772 | Nvidia, Technion 关键词: 非对称蒸馏, CVPR 2025, 自回归, 实时生成, 9.4 FPS 前序工作问题: 双向扩散模型质量高但推理慢(128帧需约219秒),能否将其知识蒸馏到更快的自回归架构? 贡献: 将双向扩散模型蒸馏为因果自回归生成器,DMD视频蒸馏将50步压缩为4步,非对称蒸馏用双向教师监督因果学生。 效果: 9.4 FPS实时生成(初始延迟仅1.3秒),VBench-Long 84.27(超越前作),CVPR 2025接收。 批判点评: 代表了架构蒸馏(双向→自回归)+ 步数蒸馏的极端加速路线,与稀疏注意力方向正交但可互补。 社区资源 附-14. Awesome-Video-Attention:视频注意力加速方法系统性综述 Awesome-Video-Attention: A Curated Survey of Efficient Video Attention Methods | GitHub (hao-ai-lab) | UC Berkeley (Hao AI Lab) 关键词: 综述, 社区资源, 全技术栈, 持续更新 前序工作问题: 视频注意力加速方法论文爆发式增长,缺乏系统梳理。 贡献: 视频注意力加速方法的系统性综述列表,涵盖稀疏化/量化/缓存等全部技术路线。 效果: 社区标准参考,持续更新,按时间逆序排列。 批判点评: 入门和跟踪该方向的最佳起点;由SVG/VSA团队维护,权威性高。 横向对比:稀疏注意力技术路线 免训练方法 方法 核心思路 端到端加速 测试模型 SVG 在线3%样本分析稀疏模式 ~1.5x Wan / HunyuanVideo / Mochi CalibAtt 离线校准跨输入稳定模式 1.58x Wan 2.1 14B / Mochi SVG-EAR 聚类质心补偿 + 误差感知路由 1.93x Wan 2.2 / HunyuanVideo AdaSpa LSE缓存零开销搜索(ICCV 2025) — OpenSora Sparse-vDiT 三种Pattern定制kernel(AAAI 2026) 未报告 HunyuanVideo STA Tile级滑动窗口(ICML 2025) 1.36-3.53x HunyuanVideo 轻量微调方法 方法 核心思路 注意力加速 端到端加速 SLA 稀疏+线性融合kernel(ICLR 2026 Oral) 13.7x 2.2x SLA2 可学习路由 + QAT 18.6x — SALAD 门控线性分支(2000样本微调) — 1.72x VMonarch Monarch矩阵时空分解 5x — NABLA CDF二值化 + Flex Attention — ~2.7x 可训练 / 工业级方法 方法 核心思路 加速效果 备注 VSA 预训练阶段替换全注意力(NeurIPS 2025) 训练+推理双加速 需从头训练 BSA 双向稀疏化Query+KV(训练时) 17.8x训练注意力加速 训练专用 SSTA 选择性+滑动Tile(HunyuanVideo 1.5) 1.87x端到端 工业级产品集成 总结与展望 从本专题的 24 篇工作中,我们可以观察到几个值得深思的趋势变化: 从"能不能用"到"怎么用好"。一年前,稀疏注意力在视频 DiT 上还处于概念验证阶段(SVG 证明稀疏性存在)。如今,SLA 系列已达 18.6x 注意力加速且质量无损,SSTA 已集成于 HunyuanVideo 1.5 的工业级产品中。稀疏注意力正从学术探索快速过渡到工程标配。 理论-实际差距是核心挑战。VMonarch 的 17.5x FLOPs 减少仅转化为 5x 实际加速;多篇论文的"注意力加速"远高于"端到端加速"。Kernel 实现效率、显存带宽瓶颈、非注意力层开销等工程因素决定了最终用户体验,纯算法层面的 FLOPs 对比可能误导判断。 组合加速是终局方向。单一技术路线(稀疏 / 缓存 / 蒸馏 / 量化)各有天花板,但组合使用打开了巨大空间:EasyCache + SVG 已达 3x+,NABLA + STA 可叠加,SLA2 QAT 展示了稀疏 + 量化协同。未来的视频生成推理栈很可能是多技术协同的"加速全家桶"。 开放问题: 随着模型规模从 1.3B 增长到 14B+,稀疏注意力的加速收益是否线性扩展,还是会遇到新的瓶颈? 自回归视频生成范式(CogVideoX-AR / GameGen)的兴起将如何改变稀疏注意力的设计约束? 稀疏注意力的研究重心会从推理加速转向训练加速吗?VSA 和 BSA 已迈出第一步,但社区跟进程度仍有待观察。 今日讨论 路线之争:在视频 DiT 稀疏注意力的三条技术路线中,你更看好哪条? (A) 免训练方法(CalibAtt / SVG-EAR / AdaSpa)——零成本即插即用,天花板约 2x (B) 轻量微调融合(SLA / SALAD)——2000 样本即可达 5x+,工程门槛适中 (C) 全程可训练替换(VSA / BSA)——训练+推理双加速,但需要从头训练 延伸问题:稀疏注意力 + 缓存 + 蒸馏 + 量化的"四件套"叠加,能否在消费级 GPU(如 RTX 4090)上实现 720P 视频的秒级生成?如果可以,哪个环节最可能成为最后的瓶颈? 人工智能炼丹君 整理 | 数据来源:arXiv 2025年5月 — 2026年4月 含 ICLR 2026 Oral × 1, ICLR 2026 × 1, NeurIPS 2025 × 1, AAAI 2026 × 1, ICCV 2025 × 1, ICML 2025 × 1

AIGC 周末专题|2026-05-02|稀疏注意力让视频生成快18倍 引言:为什么视频生成需要稀疏注意力? 视频扩散 Transformer(Video DiT)正在成为视频生成的主流架构。从 Wan 2.2、HunyuanVideo 到 CogVideoX,这些模型普遍采用 3D 全注意力(Full 3D Attention),让每个 token 都能与序列中所有其他 token 交互。这种设计虽然带来了出色的生成质量,但代价极为沉重——以 HunyuanVideo 生成一段 5 秒 720P 视频为例,总推理耗时约 945 秒,其中注意力运算就占了约 800 秒(84.7%)。O(N²) 的计算复杂度使注意力成为视频生成提速的首要瓶颈。 一个关键的观察是:视频 DiT 的注意力图天然是高度稀疏的。大量 token 之间的注意力权重可以忽略不计,真正重要的交互集中在时间相邻帧、空间局部区域和少量全局"锚点"之间。这一特性意味着,如果能精确识别并跳过无关计算,就能在几乎不损失质量的前提下获得数倍乃至十倍以上的加速。 过去一年(2025年5月—2026年4月),稀疏注意力在视频生成方向经历了爆发式发展:从最初的免训练启发式方法到精心设计的可训练替代方案,从纯稀疏到稀疏-线性融合,从双向扩散到自回归生成,技术路线日趋丰富。本专题系统梳理这一时期的 24 篇核心工作(深度解读 10 篇 + 速览 14 篇),涵盖 ICLR 2026 Oral、NeurIPS 2025、AAAI 2026、ICCV 2025、ICML 2025 等顶会成果,呈现该方向的完整技术演进脉络。 核心技术趋势 1. 从免训练到可训练,从推理到全程 稀疏注意力的演进路线清晰:免训练方法(CalibAtt / SVG-EAR / AdaSpa)天花板约 2x,轻量微调(SALAD / SLA)突破至 2-5x,全程可训练(VSA / BSA)则实现训练+推理双加速。三条路线并行发展,适用于不同部署场景。 2. 稀疏+线性融合成为最优范式 SLA(ICLR 2026 Oral)确立了"大权重用稀疏、小权重用线性"的分工模式。SLA2 通过可学习路由将其推向极致(18.6x),SALAD 用门控机制轻量化实现同一思路。这一范式的优势在于理论完备且工程可落地。 3. 注意力图的结构化利用 从统一稀疏策略到结构化利用:Sparse-vDiT 识别三种 Pattern(对角线/多对角线/竖条纹)、VMonarch 用 Monarch 矩阵表示时空结构、CalibAtt 发现跨输入稳定性。理解注意力图的内在结构是设计更好稀疏方案的关键。 4. 自回归视频扩散带来新挑战 Light Forcing 和 TempCache 分别面向 AR 视频扩散设计稀疏注意力和缓存压缩。随着 AR 范式(CogVideoX-AR / GameGen)兴起,因果注意力的稀疏化将成为新研究热点。 5. 多方法叠加走向实时部署 EasyCache + SVG 可叠加达 3x+;SLA + 步数蒸馏理论可达 5-10x 无损加速;稀疏注意力 + 量化(SLA2 QAT)+ 缓存三者联合,加之 SSTA 在 HunyuanVideo 1.5 中的工业级落地实践,正推动视频生成走向消费级设备实时部署。 方向分布与论文概览 本专题 24 篇论文按技术路线分为以下子方向: 稀疏+线性融合 3 篇(SLA, SLA2, SALAD) 免训练稀疏注意力 3 篇(SVG-EAR, CalibAtt, AdaSpa) 结构化 / Pattern 稀疏 2 篇(Sparse-vDiT, VMonarch) 可训练 / AR 稀疏 2 篇(VSA, Light Forcing) 其余工作 14 篇(SVG / SVG2 / STA / BSA / NABLA / SSTA / TempCache / SODA / EasyCache / FasterCache / FastLightGen / FrameDiT / DiagDist / Survey) 含 ICLR 2026 Oral × 1, ICLR 2026 × 1, NeurIPS 2025 × 1, AAAI 2026 × 1, ICCV 2025 × 1, ICML 2025 × 1, CVPR 2025 × 1 下面先梳理技术演进的时间脉络,再按重要度逐篇深入解读。 技术路线与时间线 基础探索(2024.6–2025.2) 描述:Sparse Attention 从 LLM 领域迁移到视频 DiT,研究者开始发现视频扩散 Transformer 3D 全注意力中天然存在的稀疏性。 关键节点: 2024.6–2025.2:LLM 稀疏注意力技术(Top-K / 局部窗口 / FlashAttention)向视频扩散模型迁移 免训练加速(2025.2–2025.5) 描述:Sparse VideoGen 系列开创免训练框架,系统性利用 3D 全注意力天然稀疏性实现视频 DiT 推理加速。 关键节点: 2025.2:Sparse VideoGen(SVG):首个系统性免训练稀疏注意力加速框架 2025.5:Sparse VideoGen2(SVG2):语义聚类驱动的稀疏模式发现 可训练突破(2025.5–2025.9) 描述:VSA 首次证明可训练稀疏注意力可在预训练阶段全程替代全注意力,实现训练+推理双加速。 关键节点: 2025.5:VSA(NeurIPS 2025):训练+推理全程稀疏注意力的里程碑 融合范式确立(2025.9–2026.1) 描述:SLA(ICLR 2026 Oral)确立"大权重稀疏+小权重线性"的融合范式,SALAD 和 VMonarch 从不同角度验证稀疏+线性混合设计。 关键节点: 2025.9:SLA(ICLR 2026 Oral):稀疏-线性注意力融合,13.7x 注意力加速 2026.1:SALAD:门控线性注意力并行分支,2000 样本微调达 90% 稀疏度 2026.1:VMonarch:Monarch 矩阵结构化注意力,17.5x FLOPs 减少 极致推进(2026.1–2026.4) 描述:SLA2 将加速比推向 18.6x,Light Forcing 首次面向自回归视频扩散设计稀疏方案,SVG-EAR 刷新免训练方法帕累托前沿,AdaSpa 以零开销搜索获得 ICCV 2025 接收。 关键节点: 2026.2:SLA2:可学习路由 + 量化感知训练,18.6x 注意力加速 2026.2:Light Forcing:首个 AR 视频扩散稀疏注意力 2026.3:SVG-EAR:误差感知路由 + 聚类质心补偿,1.93x 免训练加速 2026.2:AdaSpa(ICCV 2025):LSE 缓存搜索,免训练免数据最优解 以下按重要度排序,逐篇解读 10 篇核心论文。 1. SLA:稀疏-线性注意力融合——自定义GPU Kernel实现13.7倍注意力加速(ICLR 2026 Oral) 论文: SLA arXiv: 2509.24006 机构: 清华大学, UC Berkeley 研究动机 注意力权重可分为两部分:少量大权重(高秩)和大量小权重(低秩)。这天然暗示一种分工:对大权重用稀疏注意力(O(N²) 但只算少量),对小权重用线性注意力(O(N))。现有方法要么纯稀疏(丢失低秩信息)要么纯线性(无法捕捉局部关键依赖),SLA 首次将两者系统融合。 方法原理 三级权重分类:将注意力权重按大小分为 Critical(O(N²) 精确计算)、Marginal(O(N) 线性近似)、Negligible(跳过),95% 注意力计算被消除 融合 GPU Kernel:将稀疏和线性注意力的前向/反向计算融合到单个自定义 kernel 中,消除额外显存开销和 kernel launch 延迟 轻量微调:仅需少量步即可在目标视频 DiT 上完成适配 实验结果 注意力加速 13.7x,端到端加速 2.2x(Wan 2.1-1.3B),生成质量无损(VBench 指标保持),ICLR 2026 Oral 接收。 点评 优势:ICLR 2026 Oral 验证了学术价值;自定义 kernel 可直接工业落地;2.2x E2E 加速是质量无损方法中的最优数字。局限:仅在 1.3B 模型上验证,14B+ 效果未知;kernel 需针对不同硬件调优。后续方向包括更大模型验证和与蒸馏/缓存叠加。 2. SLA2:可学习路由+量化感知训练——97%稀疏度实现18.6倍注意力加速 论文: SLA2 arXiv: 2602.12675 机构: 清华大学, UC Berkeley 研究动机 SLA 采用固定的三级分类边界,无法适应不同层/头/时间步的动态变化。SLA2 提出两个改进方向:让模型自己学习最优的稀疏-线性分配比例,并利用量化技术进一步压缩计算。 方法原理 可学习路由器:每层每头配备轻量路由网络,动态预测每个注意力块应使用稀疏、线性还是跳过策略,突破 SLA 的固定边界 改进注意力公式:重新设计稀疏+线性混合公式,减少近似误差 量化感知训练(QAT):联合训练路由器和量化参数,在 INT4/INT8 精度下保持质量 实验结果 97% 注意力稀疏度(仅 3% 计算量),18.6x 注意力加速,视频生成质量与全注意力几乎无差距,支持 INT4 量化进一步压缩。 点评 优势:在 SLA 基础上加速比提升 35%,可学习路由实现层级自适应。局限:需要训练路由器(非免训练);QAT 引入额外训练复杂性。后续方向包括与蒸馏联合优化和消费级设备部署。 3. SVG-EAR:误差感知路由+无参数线性补偿——免训练1.93倍端到端加速 论文: SVG-EAR arXiv: 2603.08982 机构: UC Berkeley 研究动机 现有免训练稀疏注意力面临两难:直接丢弃被跳过块会丢失信息;用学习型预测器近似又引入训练开销。SVG-EAR 的关键洞察是:经过语义聚类后,同一块内的 K/V 具有高度相似性,可用少量聚类质心准确概括——这使得"补偿"取代"丢弃"成为可能。 方法原理 聚类质心补偿:对被跳过的注意力块,用 K/V 聚类质心做 O(N) 线性近似,无参数恢复其对输出的贡献 误差感知路由:颠覆"高注意力分数=重要"的传统假设,改为选择"近似误差最大"的块做精确计算 理论保证:提供注意力重建误差与聚类质量之间的理论上界 实验结果 Wan 2.2 上 1.77x 端到端加速(PSNR 29.76),HunyuanVideo 上 1.93x 端到端加速(PSNR 31.04),显著优于 SVG2 和 CalibAtt,完全免训练。 点评 优势:免训练、有理论保证、误差感知路由是本领域最具洞察的方法论创新。局限:聚类质心计算有额外开销;PSNR 不是视频生成的最佳指标;加速上限受限于免训练范式。 4. VSA:端到端可训练稀疏注意力——从预训练阶段替换全注意力(NeurIPS 2025) 论文: VSA arXiv: 2505.13389 机构: UC Berkeley, FastVideo 研究动机 现有稀疏注意力仅用于推理阶段,训练仍需全注意力,导致训练-推理不一致和训练成本居高不下。VSA 提出一个根本性问题:能否设计一种从预训练到推理全程使用的稀疏注意力,彻底替代全注意力? 方法原理 粗粒度预测:将 token 序列划分为 3D cubes 并池化,用低成本全注意力预测每个 cube 的重要性,选出关键区域 细粒度执行:仅在预测的关键区域执行 token 级精确注意力,形成块稀疏计算模式 硬件对齐:cube 和块大小均对齐 GPU warp/SM 执行粒度,最大化并行效率 实验结果 训练和推理同时加速,视频生成质量与全注意力基线持平,显著降低训练 GPU 小时数,NeurIPS 2025 接收。 点评 优势:训练+推理双加速是独特卖点;硬件对齐设计实用性强。局限:粗粒度预测可能丢失细粒度关键信息;需要从头预训练或大量微调,部署门槛较高。 5. Sparse-vDiT:三模式稀疏Pattern识别+定制Kernel——视频DiT注意力图的系统性利用(AAAI 2026) 论文: Sparse-vDiT arXiv: 2506.03065 机构: 多机构合作 研究动机 此前的稀疏注意力方法大多采用统一策略(Top-K 或块级稀疏),未充分利用视频 DiT 注意力图的结构特征。Sparse-vDiT 通过系统统计分析,发现三种反复出现的稀疏模式,并为每种模式定制高效计算方案。 方法原理 三种稀疏模式识别:对角线(diagonal,反映时间邻近性)、多对角线(multi-diagonal,反映空间局部性)、竖条纹(vertical-stripe,反映全局 anchor token) Pattern-Optimized Sparse Kernels:为每种模式设计专用 CUDA kernel,将稠密注意力替换为结构化稀疏计算 自适应模式选择:根据每层每头的注意力分布自动匹配最优模式 实验结果 在 HunyuanVideo 上理论 FLOPs 减少约 50-70%(因层/头而异),实际推理延迟降低,视觉质量保持(论文未报告统一的端到端加速倍数),AAAI 2026 接收。 点评 优势:对注意力图结构的分析深入,三种模式的发现为后续工作提供了理论基础。局限:固定三种模式可能无法覆盖所有场景;缺乏统一的端到端加速数字使得与其他方法定量比较困难。 6. SALAD:门控线性注意力并行分支——仅2000样本微调实现90%稀疏度 论文: SALAD arXiv: 2601.16515 机构: 清华大学, 腾讯 研究动机 免训练稀疏注意力的稀疏度通常受限于 50-70%,突破上限需要训练,但训练型方法(如 SLA)通常需要大量数据和计算。SALAD 探索一条中间路线:能否用极轻量的微调达到极高稀疏度? 方法原理 双分支并行:在稀疏注意力旁添加轻量线性注意力分支,捕捉被稀疏丢弃的低秩信息 输入依赖门控:可学习门控机制根据输入内容动态调节两分支的贡献权重 极轻量微调:仅新增线性层和门控参数,2000 个视频样本 + 1600 步即可完成训练 实验结果 90% 稀疏度,1.72x 推理加速,生成质量与全注意力基线相当,适配多种视频 DiT 模型。 点评 优势:微调效率极高(2000 样本),工程门槛最低的稀疏-线性融合方案。局限:1.72x 加速低于 SLA 的 2.2x;线性注意力的表达能力有限。 7. VMonarch:Monarch矩阵结构化注意力——17.5倍FLOPs减少的数学最优解 论文: VMonarch arXiv: 2601.22275 机构: 南京大学, 腾讯 研究动机 现有稀疏方法(Top-K / 局部窗口)缺乏数学最优性保证。VMonarch 发现 Monarch 矩阵——一类具有灵活稀疏性的结构化矩阵——可以优雅地表示视频 DiT 的时空注意力模式。 方法原理 时空 Monarch 分解:将全注意力矩阵分解为帧内(空间)和帧间(时间)两组 Monarch 因子,分别捕捉空间和时间相关性 交替最小化:通过交替优化两组因子逼近原始全注意力,配合重计算策略解决收敛不稳定问题 在线熵算法:融入 FlashAttention 的在线计算范式,支持长序列高效更新 实验结果 注意力 FLOPs 减少 17.5x,注意力计算加速 5x+,90% 稀疏度下超越所有 SOTA 稀疏方法,轻量微调后 VBench 质量与全注意力相当。 点评 优势:数学上最优雅的方案,FlashAttention 兼容,理论深度最强。局限:实际 wall-clock 加速(5x)远小于理论 FLOPs 减少(17.5x),存在工程实现瓶颈;交替最小化收敛依赖初始化。 8. Light Forcing:首个面向自回归视频扩散的稀疏注意力——Chunk-Aware Growth机制 论文: Light Forcing arXiv: 2602.04789 机构: 多机构合作 研究动机 现有稀疏注意力主要面向双向扩散模型(Wan / HunyuanVideo),而自回归视频扩散模型(GameGen / CogVideoX-AR)的因果结构截然不同——新帧只能看到历史帧,注意力范围随生成推进单调增长。Light Forcing 首次为 AR 视频扩散定制稀疏注意力方案。 方法原理 AR 注意力模式分析:发现 AR 视频扩散中注意力呈因果增长模式——新帧主要关注临近帧和少量关键锚帧 Chunk-Aware Growth:将序列划分为因果 chunk,稀疏注意力范围随 chunk 增长动态扩展,保持选择性历史回顾 锚帧保留策略:自动识别关键参考帧保持全注意力,确保长程一致性 实验结果 AR 视频生成质量和效率双赢(论文报告质量提升 + 推理加速,但未给出统一的端到端加速倍数),长视频一致性提升,代码开源。 点评 优势:AR 视频生成方向的首个稀疏注意力方案,填补空白;Chunk-Aware Growth 与 AR 范式天然匹配。局限:AR 视频生成模型本身尚未成为主流,方法的影响力取决于 AR 范式的普及速度。 9. CalibAtt:离线校准+在线高效推理——跨输入稳定的块级稀疏模式 论文: CalibAtt arXiv: 2603.05503 机构: 以色列理工 研究动机 已有免训练稀疏注意力要么在线动态判断 token 重要性(开销大),要么使用固定模式(不够灵活)。CalibAtt 发现一个关键洞察:稀疏模式在不同输入上惊人地稳定——大量 token 连接在任何视频上都产生可忽略的注意力分数,可以离线一次校准、在线直接复用。 方法原理 离线校准:在少量参考视频上运行全注意力,统计每一层、每个头、每个扩散时间步的块级稀疏模式 模式编译:将稳定模式编译为优化的注意力操作(类似 JIT 编译),在线推理时直接跳过非关键连接 块级粒度:兼顾近似精度和 GPU 硬件效率 实验结果 Wan 2.1 14B、Mochi 1 及其蒸馏版本上 1.58x 端到端加速,视频生成质量和文本对齐度优于已有免训练方法,完全免训练。 点评 优势:完全免训练、即插即用、离线校准成本极低。局限:1.58x 加速在近期方法中不突出(已被 SVG-EAR 的 1.93x 超越);对新架构需重新校准。 10. AdaSpa:动态模式+在线精确搜索——面向长视频的自适应稀疏注意力(ICCV 2025) 论文: AdaSpa arXiv: 2502.21079 机构: 字节跳动, 北京大学 研究动机 现有免训练稀疏方法面临二选一:固定模式(CalibAtt,无法动态适应)或在线搜索(开销大)。AdaSpa 提出:能否"免费"获得在线精确搜索能力? 方法原理 块化模式(Blockified Pattern):将注意力矩阵划分为层次化 block,高效表示 DiT 的多尺度稀疏性 LSE 缓存搜索:利用 FlashAttention 计算过程中的 LogSumExp 副产品作为 block 重要性信号——零额外开销即可精确定位关键区域 自适应稀疏决策:每步动态决定哪些 block 需要精确计算,免训练、免数据、即插即用 实验结果 在 OpenSora 等长视频模型上实现显著加速(论文报告视觉质量与原始模型几乎相同),免训练免数据,ICCV 2025 接收。 点评 优势:LSE 缓存搜索零开销,设计极其优雅,是免训练方法中工程最巧妙的方案。局限:依赖 FlashAttention 实现,对其他注意力后端不通用。 其余论文速览 免训练框架 & 稀疏注意力基础 附-1. Sparse VideoGen:首个系统性利用3D全注意力天然稀疏性的免训练加速框架 Sparse VideoGen: Accelerating Video Diffusion Transformers with Inherent Sparsity | arXiv:2502.01776 | UC Berkeley 关键词: 免训练, 空间/时间稀疏, 3D全注意力, 系列开山作 前序工作问题: 视频DiT的3D全注意力被视为黑盒,其内在稀疏性未被系统性利用。 贡献: 首个系统性利用3D全注意力天然稀疏性的免训练加速框架,在线3%样本分析识别空间/时间稀疏模式。 效果: 在Wan/HunyuanVideo/Mochi上实现高效免训练加速,开创Sparse VideoGen系列。 批判点评: 方向开创性强,但在线分析存在开销;后续SVG2和SVG-EAR在其基础上大幅改进。 附-2. Sparse VideoGen2:语义聚类驱动的稀疏注意力加速 Sparse VideoGen2: Accelerate Video Generation with Sparse Attention via Semantic-Aware Clustering | arXiv:2505.18875 | UC Berkeley 关键词: 语义聚类, K-Means, 空间/时间稀疏, SVG系列第二代 前序工作问题: SVG的在线稀疏模式分析精度有限,缺乏语义层面的理解。 贡献: 基于K-Means语义聚类的稀疏注意力加速,自动发现空间和时间两种稀疏模式并分别优化。 效果: 在SVG基础上进一步提升加速比,聚类质量直接影响加速效果。 批判点评: 语义聚类方向正确,但K-Means本身有计算开销;已被SVG-EAR的误差感知路由超越。 缓存与混合加速 附-3. TempCache:面向自回归视频扩散的时间缓存压缩+稀疏注意力联合加速 Fast Autoregressive Video Diffusion and World Models with Temporal Cache Compression and Sparse Attention | arXiv:2602.01801 | 多机构合作 关键词: KV缓存压缩, 自回归, 世界模型, AnnCA 前序工作问题: 自回归视频扩散模型的KV缓存随序列增长线性膨胀,导致长视频生成效率低下。 贡献: 面向自回归视频扩散的时间KV缓存压缩+稀疏注意力联合加速,AnnCA近似近邻注意力。 效果: 长视频流式生成效率大幅提升,支持视频世界模型。 批判点评: KV缓存压缩与稀疏注意力正交互补,联合使用前景广阔;AnnCA的近似精度需关注。 附-4. SODA:敏感度导向的缓存+剪枝统一框架 SODA: Sensitivity-Oriented Dynamic Acceleration for Diffusion Transformer | arXiv:2603.07057 | 多机构合作 关键词: 敏感度建模, 动态规划, 缓存+剪枝, 统一框架 前序工作问题: 缓存和剪枝分别独立设计,缺乏统一最优策略。 贡献: 敏感度导向的缓存+剪枝统一框架,通过动态规划求解最优缓存时间点。 效果: 在DiT-XL/PixArt-α/OpenSora上实现SOTA保真度-加速比权衡。 批判点评: 统一框架设计优雅,动态规划给出理论最优解;但离线分析和迁移成本需考虑。 附-5. EasyCache:免训练自适应缓存加速,与SVG稀疏注意力可叠加 Less is Enough: Training-Free Video Diffusion Acceleration via Adaptive Caching | arXiv:2507.03065 | 多机构合作 关键词: 免训练, 自适应缓存, 可叠加, 3x加速 前序工作问题: 缓存方法和稀疏注意力通常独立设计,能否叠加加速? 贡献: 无需训练的自适应缓存加速,运行时自适应决策何时复用何时重算,与SVG稀疏注意力可叠加。 效果: SVG+EasyCache在HunyuanVideo上实现3x以上加速。 批判点评: 叠加性是关键价值——稀疏注意力+缓存的联合使用开辟了组合加速新思路。 附-6. FasterCache:免训练视频扩散缓存加速(ICLR 2026) FasterCache: Training-Free Video Diffusion Model Acceleration with High Quality | ICLR 2026 | 多机构合作 关键词: 免训练缓存, 时间步复用, ICLR 2026, 全自注意力 前序工作问题: 视频扩散不同时间步之间的特征相似性未被充分利用。 贡献: 免训练视频扩散缓存加速,利用全自注意力层的时间步相关性进行特征复用。 效果: 在CogVideoX/Vchitect 2.0/Mochi上实现高质量免训练加速。 批判点评: ICLR 2026接收验证了方法的严谨性;缓存+稀疏注意力的协同将是未来主流。 滑动窗口与训练加速 附-7. STA:Tile级滑动窗口注意力——硬件友好设计实现2.8-17x注意力加速(ICML 2025) Fast Video Generation with Sliding Tile Attention | arXiv:2502.04507 | UC Berkeley (Hao AI Lab) 关键词: 滑动窗口, Tile级, 硬件友好, ICML 2025, 免训练 前序工作问题: Token级滑动窗口注意力(SWA)在GPU上硬件利用率低,无法充分利用视频DiT注意力的3D局部性。 贡献: 提出Tile级滑动窗口注意力替代Token级,利用视频DiT注意力在3D时空局部窗口内集中的特性,硬件友好设计。 效果: 注意力加速2.8-17x(vs FlashAttention-2),端到端1.36-3.53x加速,HunyuanVideo延迟从945s降至268s,ICML 2025接收。 批判点评: 与稀疏注意力正交互补——STA处理局部窗口、稀疏方法处理全局选择,二者可叠加;ICML 2025验证了学术质量。 附-8. BSA:双向稀疏注意力——首个同时稀疏化Query和KV的训练加速方法 Bidirectional Sparse Attention for Faster Video Diffusion Training | arXiv:2509.01085 | UC Berkeley (Hao AI Lab) 关键词: 训练加速, 双向稀疏, Query+KV稀疏, 动态阈值, 20x FLOPs 前序工作问题: 现有稀疏注意力仅稀疏化KV端,Query端仍完整计算;且使用固定稀疏模式无法适应DiT的动态注意力特性。 贡献: 首个同时动态稀疏化Query和KV对的训练加速方法,通过语义相似性选择Query+动态阈值保留关键KV块。 效果: 训练FLOPs减少20x,注意力训练加速17.79x,生成质量与全注意力持平或超越。 批判点评: 与VSA同属训练加速方向但策略不同——VSA替换注意力机制,BSA在全注意力内部做双向稀疏;二者思路互补。 附-9. NABLA:自适应块级注意力——CDF二值化+Flex Attention免自定义CUDA ∇NABLA: Neighborhood Adaptive Block-Level Attention | arXiv:2507.13546 | AI Forever 关键词: 块级注意力, CDF二值化, Flex Attention, 训练+推理, 开源权重 前序工作问题: 自定义CUDA kernel开发门槛高,限制了稀疏注意力方法的社区采用。 贡献: 自适应块级注意力:下采样Q/K后在压缩空间计算注意力,CDF二值化生成稀疏mask,集成PyTorch Flex Attention无需自定义CUDA。 效果: 训练和推理加速最高2.7x,可与STA叠加使用,Wan 2.1预微调权重已开源。 批判点评: 工程门槛最低——无需写CUDA即可使用稀疏注意力;与STA叠加使用的设计体现了模块化组合的趋势。 工业级落地 附-10. SSTA (HunyuanVideo 1.5):选择性+滑动Tile注意力——工业级视频生成模型的稀疏注意力实践 HunyuanVideo 1.5 Technical Report — Selective and Sliding Tile Attention | arXiv:2511.18870 | 腾讯混元 关键词: SSTA, 选择性注意力, 滑动Tile, 工业级, 消费级GPU, 开源 前序工作问题: 学术界的稀疏注意力方案多在研究模型上验证,缺乏工业级视频生成模型中的端到端集成和大规模验证。 贡献: 提出SSTA(Selective and Sliding Tile Attention):识别并剪除冗余时空KV块,仅对高信息区域执行全注意力,集成于8.3B参数的工业级视频生成模型。 效果: 10秒720p视频端到端1.87x加速(vs FlashAttention-3),消费级GPU可运行,开源模型权重。 批判点评: 稀疏注意力从学术论文走向工业产品的标志性案例——SSTA融合了STA的滑动窗口和选择性剪枝,验证了稀疏注意力在大规模模型中的实用性。 蒸馏与替代注意力 附-11. FastLightGen:步数+参数同时压缩的三阶段协同蒸馏 FastLightGen: Fast and Light Video Generation with Fewer Steps and Parameters | arXiv:2603.01685 | 香港科技大学(广州) 关键词: 步数蒸馏, 参数剪枝, 联合压缩, 35x加速 前序工作问题: 步数蒸馏和参数剪枝独立应用效果有限,联合优化缺乏系统方案。 贡献: 步数+参数同时压缩的三阶段协同蒸馏管线,将13B模型压缩至30%参数4步推理。 效果: 35x加速HunyuanVideo/WanX,5秒视频数秒内生成。 批判点评: 蒸馏+稀疏注意力理论上可达5-10x无损加速,FastLightGen展示了单路线的极限。 附-12. FrameDiT:帧级矩阵注意力替代token级全注意力 FrameDiT: Frame-level Matrix Attention for Video Diffusion Transformers | arXiv:2603.10200 | 多机构合作 关键词: 帧级注意力, 矩阵注意力, 结构化, 需训练 前序工作问题: Full 3D注意力过于精细(token级),而Local Factorized Attention过于粗略(帧内/帧间分离),缺乏中间粒度设计。 贡献: 帧级矩阵注意力替代token级全注意力,粒度介于Full 3D和Local Factorized之间。 效果: 效率与Local Factorized Attention相当,多个视频生成benchmark达到SOTA。 批判点评: 帧级粒度提供了token级和因子化之间的有趣折中,但需要训练限制了即插即用性。 附-13. CausVid:将双向扩散模型蒸馏为自回归生成器实现实时视频生成(CVPR 2025) From Slow Bidirectional to Fast Autoregressive Video Diffusion Models | arXiv:2412.07772 | Nvidia, Technion 关键词: 非对称蒸馏, CVPR 2025, 自回归, 实时生成, 9.4 FPS 前序工作问题: 双向扩散模型质量高但推理慢(128帧需约219秒),能否将其知识蒸馏到更快的自回归架构? 贡献: 将双向扩散模型蒸馏为因果自回归生成器,DMD视频蒸馏将50步压缩为4步,非对称蒸馏用双向教师监督因果学生。 效果: 9.4 FPS实时生成(初始延迟仅1.3秒),VBench-Long 84.27(超越前作),CVPR 2025接收。 批判点评: 代表了架构蒸馏(双向→自回归)+ 步数蒸馏的极端加速路线,与稀疏注意力方向正交但可互补。 社区资源 附-14. Awesome-Video-Attention:视频注意力加速方法系统性综述 Awesome-Video-Attention: A Curated Survey of Efficient Video Attention Methods | GitHub (hao-ai-lab) | UC Berkeley (Hao AI Lab) 关键词: 综述, 社区资源, 全技术栈, 持续更新 前序工作问题: 视频注意力加速方法论文爆发式增长,缺乏系统梳理。 贡献: 视频注意力加速方法的系统性综述列表,涵盖稀疏化/量化/缓存等全部技术路线。 效果: 社区标准参考,持续更新,按时间逆序排列。 批判点评: 入门和跟踪该方向的最佳起点;由SVG/VSA团队维护,权威性高。 横向对比:稀疏注意力技术路线 免训练方法 方法 核心思路 端到端加速 测试模型 SVG 在线3%样本分析稀疏模式 ~1.5x Wan / HunyuanVideo / Mochi CalibAtt 离线校准跨输入稳定模式 1.58x Wan 2.1 14B / Mochi SVG-EAR 聚类质心补偿 + 误差感知路由 1.93x Wan 2.2 / HunyuanVideo AdaSpa LSE缓存零开销搜索(ICCV 2025) — OpenSora Sparse-vDiT 三种Pattern定制kernel(AAAI 2026) 未报告 HunyuanVideo STA Tile级滑动窗口(ICML 2025) 1.36-3.53x HunyuanVideo 轻量微调方法 方法 核心思路 注意力加速 端到端加速 SLA 稀疏+线性融合kernel(ICLR 2026 Oral) 13.7x 2.2x SLA2 可学习路由 + QAT 18.6x — SALAD 门控线性分支(2000样本微调) — 1.72x VMonarch Monarch矩阵时空分解 5x — NABLA CDF二值化 + Flex Attention — ~2.7x 可训练 / 工业级方法 方法 核心思路 加速效果 备注 VSA 预训练阶段替换全注意力(NeurIPS 2025) 训练+推理双加速 需从头训练 BSA 双向稀疏化Query+KV(训练时) 17.8x训练注意力加速 训练专用 SSTA 选择性+滑动Tile(HunyuanVideo 1.5) 1.87x端到端 工业级产品集成 总结与展望 从本专题的 24 篇工作中,我们可以观察到几个值得深思的趋势变化: 从"能不能用"到"怎么用好"。一年前,稀疏注意力在视频 DiT 上还处于概念验证阶段(SVG 证明稀疏性存在)。如今,SLA 系列已达 18.6x 注意力加速且质量无损,SSTA 已集成于 HunyuanVideo 1.5 的工业级产品中。稀疏注意力正从学术探索快速过渡到工程标配。 理论-实际差距是核心挑战。VMonarch 的 17.5x FLOPs 减少仅转化为 5x 实际加速;多篇论文的"注意力加速"远高于"端到端加速"。Kernel 实现效率、显存带宽瓶颈、非注意力层开销等工程因素决定了最终用户体验,纯算法层面的 FLOPs 对比可能误导判断。 组合加速是终局方向。单一技术路线(稀疏 / 缓存 / 蒸馏 / 量化)各有天花板,但组合使用打开了巨大空间:EasyCache + SVG 已达 3x+,NABLA + STA 可叠加,SLA2 QAT 展示了稀疏 + 量化协同。未来的视频生成推理栈很可能是多技术协同的"加速全家桶"。 开放问题: 随着模型规模从 1.3B 增长到 14B+,稀疏注意力的加速收益是否线性扩展,还是会遇到新的瓶颈? 自回归视频生成范式(CogVideoX-AR / GameGen)的兴起将如何改变稀疏注意力的设计约束? 稀疏注意力的研究重心会从推理加速转向训练加速吗?VSA 和 BSA 已迈出第一步,但社区跟进程度仍有待观察。 今日讨论 路线之争:在视频 DiT 稀疏注意力的三条技术路线中,你更看好哪条? (A) 免训练方法(CalibAtt / SVG-EAR / AdaSpa)——零成本即插即用,天花板约 2x (B) 轻量微调融合(SLA / SALAD)——2000 样本即可达 5x+,工程门槛适中 (C) 全程可训练替换(VSA / BSA)——训练+推理双加速,但需要从头训练 延伸问题:稀疏注意力 + 缓存 + 蒸馏 + 量化的"四件套"叠加,能否在消费级 GPU(如 RTX 4090)上实现 720P 视频的秒级生成?如果可以,哪个环节最可能成为最后的瓶颈? 人工智能炼丹君 整理 | 数据来源:arXiv 2025年5月 — 2026年4月 含 ICLR 2026 Oral × 1, ICLR 2026 × 1, NeurIPS 2025 × 1, AAAI 2026 × 1, ICCV 2025 × 1, ICML 2025 × 1 -

AIGC 周末专题深度解读:视频扩散 Transformer 高效推理 AIGC 周末专题深度解读:视频扩散 Transformer 高效推理 专题方向:视频 DiT 中的稀疏注意力、线性注意力与推理加速 覆盖时间:2026年3月2日 — 2026年3月13日 整理:人工智能炼丹师 日期:2026年3月14日(周六) 一、专题概览 本周是视频扩散 Transformer(Video DiT)高效推理方向的"论文爆发周"。短短一周内,arXiv 上出现了 9 篇 高度聚焦于视频 DiT 注意力加速与推理优化的论文,覆盖了从稀疏注意力、线性注意力、结构化注意力,到蒸馏压缩、缓存+剪枝、系统级并行优化的完整技术栈。 核心背景 当前主流视频生成模型(Wan 2.1/2.2、HunyuanVideo、Mochi 等)均采用 Diffusion Transformer(DiT)架构,其核心瓶颈在于 全注意力(Full 3D Attention)的 O(N²) 复杂度。一段 5 秒 720P 视频的 token 序列长度可达数十万,全注意力的计算量和显存占用极其惊人。因此,如何在保持生成质量的前提下大幅降低注意力计算成本,成为本周研究的核心主题。 本周论文全景 # 论文 方法类别 核心思路 加速比 提交日期 1 CalibAtt 稀疏注意力(免训练) 离线校准块级稀疏模式 1.58x E2E 3月5日 2 SVG-EAR 稀疏注意力 + 线性补偿(免训练) 误差感知路由 + 聚类质心补偿 1.77-1.93x 3月9日 3 SODA 缓存 + 剪枝(免训练) 敏感度导向的动态加速 SOTA fidelity 3月7日 4 FrameDiT 结构化注意力(需训练) 帧级矩阵注意力 ~Local FA 3月10日 5 VMonarch 结构化注意力(轻量微调) Monarch 矩阵分解 5x attn, 17.5x FLOPs↓ 1月29日 6 SALAD 稀疏 + 线性混合(轻量微调) 门控线性注意力并行分支 1.72x, 90%稀疏 1月23日 7 SLA 稀疏 + 线性融合(微调) 三级权重分类 + 自定义 kernel 2.2x E2E, 13.7x attn 2025.9 (ICLR'26) 8 FastLightGen 蒸馏 + 剪枝 步数+参数同时压缩 4步+30%剪枝 3月2日 9 Diagonal Distillation 自回归蒸馏 对角蒸馏 + 隐式光流 277.3x, 31 FPS 3月10日 二、重点论文深度解读 论文 1:CalibAtt — 校准稀疏注意力加速视频生成 标题:Accelerating Text-to-Video Generation with Calibrated Sparse Attention 作者:Shai Yehezkel, Shahar Yadin, Noam Elata 等 机构:以色列理工 日期:2026年3月5日 arXiv:2603.05503 关键词:稀疏注意力 免训练 离线校准 块级模式 Wan 2.1 Mochi 研究动机 视频 DiT 中的全注意力计算是推理速度的主要瓶颈。已有的稀疏注意力方法要么需要训练(如 SLA、SALAD),要么是在线动态判断每个 token 的重要性(开销大)。作者观察到一个关键现象:大量 token-to-token 连接在不同输入上一致地产生可忽略的注意力分数,且这些模式在不同查询间重复出现。 方法原理 CalibAtt 采用"离线校准 + 在线高效推理"的两阶段策略: 离线校准阶段:在少量参考视频上运行全注意力,统计每一层、每个注意力头、每个扩散时间步的块级(block-level)稀疏模式和重复模式 模式编译:将稳定的稀疏模式编译为优化的注意力操作(类似于"稀疏注意力的 JIT 编译") 在线推理:只计算被选中的输入相关连接,以硬件友好的方式跳过未选中的连接 核心创新 块级粒度:不做 token 级稀疏(开销大),而是以 token block 为单位,兼顾精度和效率 跨输入稳定性:发现稀疏模式对输入不敏感,可以离线固定 层-头-时间步三维校准:不同层/头/时间步的稀疏模式不同,细粒度适配 实验结果 在 Wan 2.1 14B、Mochi 1 及其蒸馏版本上测试 实现 1.58x 端到端加速 在视频生成质量和文本-视频对齐度上优于已有免训练方法 支持多种分辨率 技术脉络 Sparse VideoGen (2024) → Sparse VideoGen2 (2025.5) → CalibAtt (2026.3)。从在线动态稀疏 → 离线校准静态稀疏,核心洞察是"稀疏模式跨输入稳定"。 批判性点评 优势:完全免训练,直接即插即用;离线校准成本低;硬件友好 局限:1.58x 的加速比在本周论文中并不突出;块级粒度可能丢失细粒度信息;对新架构需要重新校准 创新性评分:3/5 — 洞察有价值但方法相对直接 论文 2:SVG-EAR — 无参数线性补偿的误差感知路由 标题:SVG-EAR: Parameter-Free Linear Compensation for Sparse Video Generation via Error-aware Routing 作者:Xuanyi Zhou, Qiuyang Mang, Shuo Yang 等 (UC Berkeley, Ion Stoica 组) 日期:2026年3月9日 arXiv:2603.08982 关键词:稀疏注意力 线性补偿 误差感知路由 聚类质心 免训练 Wan 2.2 HunyuanVideo 研究动机 现有稀疏注意力方法面临两难:(1) 直接丢弃被跳过的注意力块会丢失信息;(2) 用学习型预测器来近似它们又引入训练开销和分布偏移。能否在不训练的情况下恢复被跳过块的贡献? 方法原理 SVG-EAR 的核心洞察:经过语义聚类后,同一块内的 key 和 value 具有高度相似性,可以用少量聚类质心准确概括。 聚类质心补偿:对被跳过的注意力块,用 key/value 的聚类质心做线性(O(N))近似,恢复其对输出的贡献 误差感知路由:传统方法按注意力分数选择需要精确计算的块,但高注意力分数 ≠ 高近似误差。SVG-EAR 用一个轻量探测器估计每个块的补偿误差,选择"误差-成本比"最高的块做精确计算 理论保证:提供了注意力重建误差与聚类质量之间的理论上界 核心创新 误差感知 vs 分数感知:颠覆了传统"高注意力分数 = 重要"的假设,改为"高近似误差 = 需要精确计算" 无参数线性补偿:用聚类质心做 O(N) 补偿,不需要任何训练 帕累托最优:在所有免训练方法中建立了新的帕累托前沿 实验结果 Wan 2.2:1.77x 加速,PSNR 29.759 HunyuanVideo:1.93x 加速,PSNR 31.043 显著优于 Sparse VideoGen2 和 CalibAtt 技术脉络 Sparse VideoGen → SVG2 → SVG-EAR(同一系列的第三代,Ion Stoica / Berkeley 团队的持续推进) 批判性点评 优势:免训练、有理论保证、误差感知路由的思路很优雅 局限:聚类质心计算本身有开销;实际 wall-clock 加速受限于聚类效率;PSNR 不是视频生成的最佳指标 创新性评分:4/5 — 误差感知路由是本周最有洞察的方法论创新 论文 3:SODA — 敏感度导向的动态加速 标题:SODA: Sensitivity-Oriented Dynamic Acceleration for Diffusion Transformer 作者:Tong Shao, Yusen Fu 等 日期:2026年3月7日 arXiv:2603.07057 关键词:缓存 剪枝 敏感度分析 动态规划 免训练 DiT-XL PixArt-α OpenSora 研究动机 特征缓存(caching)和 token 剪枝(pruning)是两种互补的加速手段:缓存加速效率高但影响保真度,剪枝相反。现有方法用固定的启发式策略组合两者,无法捕捉模型对加速操作的细粒度敏感度变化。 方法原理 离线敏感度建模:构建跨时间步、层、模块的敏感度误差模型,量化每个计算单元对缓存/剪枝操作的敏感程度 动态规划优化缓存间隔:以敏感度误差为代价函数,用 DP 求解最优缓存时间点 自适应剪枝:在缓存复用阶段,根据 token 敏感度动态决定剪枝时机和比例 核心创新 敏感度误差建模:不是简单地均匀缓存/剪枝,而是"在最不敏感处缓存,在最不敏感的 token 处剪枝" DP 最优化:缓存间隔不再是超参数,而是通过动态规划自动求解 实验结果 在 DiT-XL/2、PixArt-α、OpenSora 上实现 SOTA 生成保真度 在可控加速比下保真度显著优于 PAB、∆-DiT 等基线 技术脉络 FasterCache (2024) → ∆-DiT (2024) → PAB → SODA (2026.3) 批判性点评 优势:缓存+剪枝的统一框架,敏感度建模理论扎实 局限:离线敏感度分析需要额外推理开销;DP 只优化缓存间隔,未联合优化剪枝策略;仅测试了较小的模型(DiT-XL/2),未在 Wan/HunyuanVideo 等大模型上验证 创新性评分:3.5/5 论文 4:VMonarch — Monarch 矩阵结构化注意力 标题:VMonarch: Efficient Video Diffusion Transformers with Structured Attention 作者:Cheng Liang, Haoxian Chen, Liang Hou 等 (南京大学 + 腾讯) 日期:2026年1月29日 arXiv:2601.22275 关键词:Monarch矩阵 结构化稀疏 交替最小化 FlashAttention 在线熵 5x加速 研究动机 视频 DiT 的注意力模式天然具有高度稀疏的时空结构,但现有稀疏方法(Top-K、局部窗口)要么不灵活,要么丢失全局信息。能否找到一种数学上优雅的方式来表示这些稀疏模式? 方法原理 VMonarch 将视频 DiT 的稀疏注意力模式建模为 Monarch 矩阵 —— 一类具有灵活稀疏性的结构化矩阵。 时空 Monarch 分解:将全注意力矩阵分解为帧内(空间)和帧间(时间)两组 Monarch 因子,分别捕捉空间和时间相关性 交替最小化:通过交替优化两组因子来逼近原始全注意力 重计算策略:解决交替最小化不稳定导致的伪影问题 在线熵算法:融入 FlashAttention 的在线熵计算,支持长序列高效更新 核心创新 Monarch 矩阵在视频 DiT 中的首次应用:优雅地统一了稀疏和结构化的优势 在线熵 + FlashAttention 融合:使得 Monarch 矩阵更新在长序列上也可行 实验结果 注意力 FLOPs 减少 17.5 倍 注意力计算加速 5 倍以上 在 VBench 上轻量微调后质量与全注意力相当 90% 稀疏度下超越所有 SOTA 稀疏注意力方法 技术脉络 Monarch Mixer (2023) → Monarch in LLM → VMonarch (视频 DiT 首次应用) 批判性点评 优势:数学上最优雅的方案;17.5x FLOPs 减少是本周最极端的数字;与 FlashAttention 兼容 局限:交替最小化的收敛性依赖初始化;需要轻量微调(非完全免训练);实际 wall-clock 加速(5x)远小于理论 FLOPs 减少(17.5x),说明实现上有瓶颈 创新性评分:4.5/5 — 本周最具理论深度的工作 论文 5:SLA — 稀疏-线性注意力融合 标题:SLA: Beyond Sparsity in Diffusion Transformers via Fine-Tunable Sparse-Linear Attention 作者:Jintao Zhang 等 (清华 + Berkeley) 日期:2025年9月28日(ICLR 2026 Oral) arXiv:2509.24006 关键词:稀疏注意力 线性注意力 融合 自定义GPU kernel 95%计算减少 ICLR 2026 研究动机 注意力权重可以分为两部分:少量大权重(高秩)和大量小权重(低秩)。这天然暗示:对大权重用稀疏注意力(O(N²) 但只算少量),对小权重用线性注意力(O(N))。 方法原理 三级分类:将注意力权重分为 Critical(O(N²) 精确计算)、Marginal(O(N) 线性注意力)、Negligible(跳过) 融合 GPU kernel:将稀疏和线性注意力的计算融合到单个 GPU kernel 中,支持前向和反向传播 轻量微调:仅需少量微调步就能适配 核心创新 稀疏+线性的系统性融合:不是简单的 fallback,而是基于权重分布的最优分配 自定义 GPU kernel:工程实现极其扎实,直接转化为实际加速 实验结果 注意力计算减少 95%(20 倍) 注意力加速 13.7 倍 端到端加速 2.2 倍(Wan 2.1-1.3B) 生成质量无损 技术脉络 稀疏注意力 + 线性注意力两条独立技术路线 → SLA 首次统一融合(ICLR 2026 Oral) 批判性点评 优势:ICLR 2026 Oral,学术认可度最高;2.2x E2E 加速是免训练之外的最佳实际数字;自定义 kernel 可直接落地 局限:需要微调(虽然很轻量);目前只在 1.3B 模型上测试,14B 模型的效果未知;kernel 需要针对不同硬件调优 创新性评分:4.5/5 论文 6:SALAD — 高稀疏度线性注意力微调 标题:SALAD: Achieve High-Sparsity Attention via Efficient Linear Attention Tuning for Video Diffusion Transformer 作者:Tongcheng Fang 等 (清华 + 腾讯) 日期:2026年1月23日 arXiv:2601.16515 关键词:线性注意力 门控机制 高稀疏度 轻量微调 2000样本 研究动机 免训练稀疏注意力受限于有限的稀疏度(通常 50-70%),而训练型方法需要大量数据和计算。能否用极轻量的微调达到极高稀疏度? 方法原理 双分支并行:在稀疏注意力旁边添加一个轻量线性注意力分支 输入依赖门控:用门控机制动态平衡两个分支的贡献 极轻量微调:仅需 2000 个视频样本和 1600 步训练 实验结果 90% 稀疏度,1.72x 推理加速 生成质量与全注意力基线相当 批判性点评 思路与 SLA 类似但更轻量;微调效率极高(2000 样本);但 1.72x 加速低于 SLA 的 2.2x 创新性评分:3.5/5 论文 7:FastLightGen — 步数 + 参数同时压缩 标题:FastLightGen: Fast and Light Video Generation with Fewer Steps and Parameters 作者:Shitong Shao, Yufei Gu, Zeke Xie 日期:2026年3月2日 arXiv:2603.01685 关键词:蒸馏 剪枝 步数压缩 参数压缩 HunyuanVideo WanX 研究动机 以往的加速研究要么减少采样步数(蒸馏),要么减少模型参数(剪枝),但从未同时压缩两者。 方法原理 FastLightGen 的核心:构建一个"最优教师模型",在协同框架中同时蒸馏步数和参数。 协同蒸馏框架:同时优化步数减少和参数剪枝 最优教师构建:教师模型本身经过优化,以最大化学生模型的性能 实验结果 4 步采样 + 30% 参数剪枝 = 最佳视觉质量(在约束推理预算下) 在 HunyuanVideo-ATI2V 和 WanX-TI2V 上优于所有竞争方法 批判性点评 首次探索步数+参数的联合压缩,填补了研究空白 但 30% 剪枝比较保守;缺少与纯蒸馏方法的详细对比 创新性评分:3.5/5 论文 8:Diagonal Distillation — 对角蒸馏实现流式视频生成 标题:Streaming Autoregressive Video Generation via Diagonal Distillation 作者:Jinxiu Liu 等 (HKUST, Ming-Hsuan Yang) 日期:2026年3月10日 arXiv:2603.09488 关键词:自回归 蒸馏 流式生成 光流建模 277x加速 31 FPS 研究动机 扩散蒸馏将多步模型压缩为少步变体,但现有方法主要针对图像设计,忽略了视频的时间依赖性,导致运动不连贯和长序列误差累积。 方法原理 对角蒸馏:不同于传统的逐 chunk 独立蒸馏,Diagonal Distillation 沿"视频 chunk × 去噪步"的对角线方向进行蒸馏 非对称生成策略:前面的 chunk 用更多步、后面的 chunk 用更少步。后面的 chunk 可以继承前面已充分处理的外观信息 隐式光流建模:在严格步数约束下保持运动质量 核心创新 对角蒸馏:沿时间-步数对角线操作,充分利用时间上下文 非对称步数分配:打破"每个 chunk 步数相同"的假设 曝光偏差缓解:将训练时的噪声条件与推理时对齐 实验结果 5 秒视频 2.61 秒生成(31 FPS) 相比原始模型 277.3 倍加速 运动连贯性和长序列质量显著优于图像蒸馏方法 批判性点评 优势:277x 是本周最震撼的加速数字;流式生成对实时应用极其重要 局限:目前仅适用于自回归视频模型;生成质量与原始多步模型仍有差距;FPS 数字的分辨率条件未详细说明 创新性评分:4/5 论文 9:FrameDiT — 帧级矩阵注意力 标题:FrameDiT: Diffusion Transformer with Frame-Level Matrix Attention for Efficient Video Generation 作者:Minh Khoa Le 等 日期:2026年3月10日 arXiv:2603.09721 关键词:帧级注意力 矩阵注意力 时空结构 Local Factorized 研究动机 现有方法面临 Full 3D Attention(强但贵)vs Local Factorized Attention(快但丢失全局信息)的两难。 方法原理 Matrix Attention:将整帧作为矩阵处理,通过矩阵原生操作生成 Q/K/V 帧间注意力:在帧级别而非 token 级别做跨帧注意力,保持全局时空结构 FrameDiT-H:混合 Matrix Attention + Local Factorized Attention,同时捕捉大运动和小运动 实验结果 多个视频生成 benchmark 上达到 SOTA 效率与 Local Factorized Attention 相当 批判性点评 帧级注意力的粒度介于 Full 3D 和 Local Factorized 之间,是一个有趣的中间地带 但"矩阵注意力"的具体实现细节(矩阵原生操作是什么?)缺乏清晰的数学定义 创新性评分:3/5 三、横向对比分析 3.1 方法分类体系 本周的 9 篇论文可以按 "是否需要训练" 和 "加速策略" 两个维度分类: 免训练 轻量微调 训练/蒸馏 ┌─────────┐ ┌─────────┐ ┌─────────┐ 稀疏注意力 │CalibAtt │ │ SALAD │ │ SLA │ │SVG-EAR │ │VMonarch │ │ │ ├─────────┤ ├─────────┤ ├─────────┤ 缓存+剪枝 │ SODA │ │ │ │ │ ├─────────┤ ├─────────┤ ├─────────┤ 蒸馏+压缩 │ │ │ │ │FastLight│ │ │ │ │ │DiagDist │ ├─────────┤ ├─────────┤ ├─────────┤ 结构化注意力 │ │ │ │ │FrameDiT │ └─────────┘ └─────────┘ └─────────┘ 3.2 性能对比 方法 注意力加速 端到端加速 需要训练? 测试模型 质量保持 CalibAtt - 1.58x 否 Wan 2.1 14B, Mochi ★★★★ SVG-EAR - 1.77-1.93x 否 Wan 2.2, HunyuanVideo ★★★★ SODA - 可控 否 DiT-XL, PixArt-α, OpenSora ★★★★★ VMonarch 5x - 轻量微调 VBench ★★★★ SALAD - 1.72x 2000样本 - ★★★★ SLA 13.7x 2.2x 少量微调 Wan 2.1 1.3B ★★★★★ FastLightGen - 显著 蒸馏 HunyuanVideo, WanX ★★★★ Diagonal Dist. - 277.3x 蒸馏 自回归模型 ★★★ FrameDiT ~FA级 ~FA级 训练 多个benchmark ★★★★ 3.3 技术路线演进 本周的论文清晰地展现了四条技术路线的演进: 路线 A:免训练稀疏注意力 核心思想:发现并利用注意力的天然稀疏性 演进:Token-level Top-K → Block-level 静态模式 (CalibAtt) → 误差感知动态路由 (SVG-EAR) 加速上限:~2x(受限于稀疏度无法无限提高) 路线 B:稀疏 + 线性注意力融合 核心思想:对不同重要性的注意力权重使用不同计算策略 演进:纯稀疏 / 纯线性 → 并行双分支 (SALAD) → 融合 kernel (SLA) → Monarch 结构化 (VMonarch) 加速上限:~2-5x(取决于 kernel 效率) 路线 C:缓存 + 剪枝 核心思想:利用扩散过程中相邻时间步的特征相似性 演进:均匀缓存 → 启发式组合 → 敏感度导向 DP 优化 (SODA) 加速上限:~2-3x(缓存复用比例有限) 路线 D:蒸馏 + 压缩 核心思想:用小模型/少步数逼近大模型/多步数 演进:步数蒸馏 → 参数剪枝 → 联合压缩 (FastLightGen) → 对角蒸馏 (Diagonal Distillation) 加速上限:100x+(但质量损失更大) 3.4 关键洞察与趋势 免训练方法的天花板在 ~2x:CalibAtt (1.58x) 和 SVG-EAR (1.93x) 代表了免训练稀疏注意力的当前上限。突破需要引入轻量训练。 稀疏 + 线性融合是最佳平衡点:SLA 通过自定义 kernel 实现 2.2x E2E 加速且质量无损,是目前注意力加速的最优解。ICLR 2026 Oral 的认可也说明了这一点。 蒸馏方法的加速比远超注意力优化:Diagonal Distillation 的 277x 说明,如果能接受一定质量损失,蒸馏是最强力的加速手段。但注意力优化的优势是"质量无损"。 多种方法可叠加:注意力优化 + 蒸馏可以叠加使用。CalibAtt 已在蒸馏模型上验证有效。理论上 SLA + 步数蒸馏可能实现 5-10x 无损加速。 Wan 和 HunyuanVideo 成为标准测试平台:本周几乎所有论文都在这两个模型上测试,说明它们已成为视频生成的事实标准。 从算法到系统的全栈优化:SODA 的序列并行推理提醒我们,纯算法优化之外,系统级优化(多 GPU 并行、算子融合等)同样重要。 四、总结与展望 本周最值得关注的 3 篇 SLA (ICLR 2026 Oral):稀疏-线性融合的里程碑工作,自定义 kernel 的工程深度令人印象深刻 SVG-EAR:误差感知路由的洞察非常深刻,免训练方法的新标杆 VMonarch:Monarch 矩阵的引入为结构化注意力开辟了全新方向 未来研究方向预判 注意力优化 + 蒸馏的联合框架:将 SLA/SVG-EAR 与 FastLightGen/Diagonal Distillation 结合 更大规模模型验证:SLA 仅在 1.3B 上测试,14B+ 模型上的表现待验证 长视频生成的特化优化:随着视频长度增长到分钟级,注意力优化的重要性进一步凸显 硬件协同设计:自定义 kernel(SLA)和结构化矩阵(VMonarch)需要与硬件特性深度适配 人工智能炼丹师 整理 | 2026-03-14

AIGC 周末专题深度解读:视频扩散 Transformer 高效推理 AIGC 周末专题深度解读:视频扩散 Transformer 高效推理 专题方向:视频 DiT 中的稀疏注意力、线性注意力与推理加速 覆盖时间:2026年3月2日 — 2026年3月13日 整理:人工智能炼丹师 日期:2026年3月14日(周六) 一、专题概览 本周是视频扩散 Transformer(Video DiT)高效推理方向的"论文爆发周"。短短一周内,arXiv 上出现了 9 篇 高度聚焦于视频 DiT 注意力加速与推理优化的论文,覆盖了从稀疏注意力、线性注意力、结构化注意力,到蒸馏压缩、缓存+剪枝、系统级并行优化的完整技术栈。 核心背景 当前主流视频生成模型(Wan 2.1/2.2、HunyuanVideo、Mochi 等)均采用 Diffusion Transformer(DiT)架构,其核心瓶颈在于 全注意力(Full 3D Attention)的 O(N²) 复杂度。一段 5 秒 720P 视频的 token 序列长度可达数十万,全注意力的计算量和显存占用极其惊人。因此,如何在保持生成质量的前提下大幅降低注意力计算成本,成为本周研究的核心主题。 本周论文全景 # 论文 方法类别 核心思路 加速比 提交日期 1 CalibAtt 稀疏注意力(免训练) 离线校准块级稀疏模式 1.58x E2E 3月5日 2 SVG-EAR 稀疏注意力 + 线性补偿(免训练) 误差感知路由 + 聚类质心补偿 1.77-1.93x 3月9日 3 SODA 缓存 + 剪枝(免训练) 敏感度导向的动态加速 SOTA fidelity 3月7日 4 FrameDiT 结构化注意力(需训练) 帧级矩阵注意力 ~Local FA 3月10日 5 VMonarch 结构化注意力(轻量微调) Monarch 矩阵分解 5x attn, 17.5x FLOPs↓ 1月29日 6 SALAD 稀疏 + 线性混合(轻量微调) 门控线性注意力并行分支 1.72x, 90%稀疏 1月23日 7 SLA 稀疏 + 线性融合(微调) 三级权重分类 + 自定义 kernel 2.2x E2E, 13.7x attn 2025.9 (ICLR'26) 8 FastLightGen 蒸馏 + 剪枝 步数+参数同时压缩 4步+30%剪枝 3月2日 9 Diagonal Distillation 自回归蒸馏 对角蒸馏 + 隐式光流 277.3x, 31 FPS 3月10日 二、重点论文深度解读 论文 1:CalibAtt — 校准稀疏注意力加速视频生成 标题:Accelerating Text-to-Video Generation with Calibrated Sparse Attention 作者:Shai Yehezkel, Shahar Yadin, Noam Elata 等 机构:以色列理工 日期:2026年3月5日 arXiv:2603.05503 关键词:稀疏注意力 免训练 离线校准 块级模式 Wan 2.1 Mochi 研究动机 视频 DiT 中的全注意力计算是推理速度的主要瓶颈。已有的稀疏注意力方法要么需要训练(如 SLA、SALAD),要么是在线动态判断每个 token 的重要性(开销大)。作者观察到一个关键现象:大量 token-to-token 连接在不同输入上一致地产生可忽略的注意力分数,且这些模式在不同查询间重复出现。 方法原理 CalibAtt 采用"离线校准 + 在线高效推理"的两阶段策略: 离线校准阶段:在少量参考视频上运行全注意力,统计每一层、每个注意力头、每个扩散时间步的块级(block-level)稀疏模式和重复模式 模式编译:将稳定的稀疏模式编译为优化的注意力操作(类似于"稀疏注意力的 JIT 编译") 在线推理:只计算被选中的输入相关连接,以硬件友好的方式跳过未选中的连接 核心创新 块级粒度:不做 token 级稀疏(开销大),而是以 token block 为单位,兼顾精度和效率 跨输入稳定性:发现稀疏模式对输入不敏感,可以离线固定 层-头-时间步三维校准:不同层/头/时间步的稀疏模式不同,细粒度适配 实验结果 在 Wan 2.1 14B、Mochi 1 及其蒸馏版本上测试 实现 1.58x 端到端加速 在视频生成质量和文本-视频对齐度上优于已有免训练方法 支持多种分辨率 技术脉络 Sparse VideoGen (2024) → Sparse VideoGen2 (2025.5) → CalibAtt (2026.3)。从在线动态稀疏 → 离线校准静态稀疏,核心洞察是"稀疏模式跨输入稳定"。 批判性点评 优势:完全免训练,直接即插即用;离线校准成本低;硬件友好 局限:1.58x 的加速比在本周论文中并不突出;块级粒度可能丢失细粒度信息;对新架构需要重新校准 创新性评分:3/5 — 洞察有价值但方法相对直接 论文 2:SVG-EAR — 无参数线性补偿的误差感知路由 标题:SVG-EAR: Parameter-Free Linear Compensation for Sparse Video Generation via Error-aware Routing 作者:Xuanyi Zhou, Qiuyang Mang, Shuo Yang 等 (UC Berkeley, Ion Stoica 组) 日期:2026年3月9日 arXiv:2603.08982 关键词:稀疏注意力 线性补偿 误差感知路由 聚类质心 免训练 Wan 2.2 HunyuanVideo 研究动机 现有稀疏注意力方法面临两难:(1) 直接丢弃被跳过的注意力块会丢失信息;(2) 用学习型预测器来近似它们又引入训练开销和分布偏移。能否在不训练的情况下恢复被跳过块的贡献? 方法原理 SVG-EAR 的核心洞察:经过语义聚类后,同一块内的 key 和 value 具有高度相似性,可以用少量聚类质心准确概括。 聚类质心补偿:对被跳过的注意力块,用 key/value 的聚类质心做线性(O(N))近似,恢复其对输出的贡献 误差感知路由:传统方法按注意力分数选择需要精确计算的块,但高注意力分数 ≠ 高近似误差。SVG-EAR 用一个轻量探测器估计每个块的补偿误差,选择"误差-成本比"最高的块做精确计算 理论保证:提供了注意力重建误差与聚类质量之间的理论上界 核心创新 误差感知 vs 分数感知:颠覆了传统"高注意力分数 = 重要"的假设,改为"高近似误差 = 需要精确计算" 无参数线性补偿:用聚类质心做 O(N) 补偿,不需要任何训练 帕累托最优:在所有免训练方法中建立了新的帕累托前沿 实验结果 Wan 2.2:1.77x 加速,PSNR 29.759 HunyuanVideo:1.93x 加速,PSNR 31.043 显著优于 Sparse VideoGen2 和 CalibAtt 技术脉络 Sparse VideoGen → SVG2 → SVG-EAR(同一系列的第三代,Ion Stoica / Berkeley 团队的持续推进) 批判性点评 优势:免训练、有理论保证、误差感知路由的思路很优雅 局限:聚类质心计算本身有开销;实际 wall-clock 加速受限于聚类效率;PSNR 不是视频生成的最佳指标 创新性评分:4/5 — 误差感知路由是本周最有洞察的方法论创新 论文 3:SODA — 敏感度导向的动态加速 标题:SODA: Sensitivity-Oriented Dynamic Acceleration for Diffusion Transformer 作者:Tong Shao, Yusen Fu 等 日期:2026年3月7日 arXiv:2603.07057 关键词:缓存 剪枝 敏感度分析 动态规划 免训练 DiT-XL PixArt-α OpenSora 研究动机 特征缓存(caching)和 token 剪枝(pruning)是两种互补的加速手段:缓存加速效率高但影响保真度,剪枝相反。现有方法用固定的启发式策略组合两者,无法捕捉模型对加速操作的细粒度敏感度变化。 方法原理 离线敏感度建模:构建跨时间步、层、模块的敏感度误差模型,量化每个计算单元对缓存/剪枝操作的敏感程度 动态规划优化缓存间隔:以敏感度误差为代价函数,用 DP 求解最优缓存时间点 自适应剪枝:在缓存复用阶段,根据 token 敏感度动态决定剪枝时机和比例 核心创新 敏感度误差建模:不是简单地均匀缓存/剪枝,而是"在最不敏感处缓存,在最不敏感的 token 处剪枝" DP 最优化:缓存间隔不再是超参数,而是通过动态规划自动求解 实验结果 在 DiT-XL/2、PixArt-α、OpenSora 上实现 SOTA 生成保真度 在可控加速比下保真度显著优于 PAB、∆-DiT 等基线 技术脉络 FasterCache (2024) → ∆-DiT (2024) → PAB → SODA (2026.3) 批判性点评 优势:缓存+剪枝的统一框架,敏感度建模理论扎实 局限:离线敏感度分析需要额外推理开销;DP 只优化缓存间隔,未联合优化剪枝策略;仅测试了较小的模型(DiT-XL/2),未在 Wan/HunyuanVideo 等大模型上验证 创新性评分:3.5/5 论文 4:VMonarch — Monarch 矩阵结构化注意力 标题:VMonarch: Efficient Video Diffusion Transformers with Structured Attention 作者:Cheng Liang, Haoxian Chen, Liang Hou 等 (南京大学 + 腾讯) 日期:2026年1月29日 arXiv:2601.22275 关键词:Monarch矩阵 结构化稀疏 交替最小化 FlashAttention 在线熵 5x加速 研究动机 视频 DiT 的注意力模式天然具有高度稀疏的时空结构,但现有稀疏方法(Top-K、局部窗口)要么不灵活,要么丢失全局信息。能否找到一种数学上优雅的方式来表示这些稀疏模式? 方法原理 VMonarch 将视频 DiT 的稀疏注意力模式建模为 Monarch 矩阵 —— 一类具有灵活稀疏性的结构化矩阵。 时空 Monarch 分解:将全注意力矩阵分解为帧内(空间)和帧间(时间)两组 Monarch 因子,分别捕捉空间和时间相关性 交替最小化:通过交替优化两组因子来逼近原始全注意力 重计算策略:解决交替最小化不稳定导致的伪影问题 在线熵算法:融入 FlashAttention 的在线熵计算,支持长序列高效更新 核心创新 Monarch 矩阵在视频 DiT 中的首次应用:优雅地统一了稀疏和结构化的优势 在线熵 + FlashAttention 融合:使得 Monarch 矩阵更新在长序列上也可行 实验结果 注意力 FLOPs 减少 17.5 倍 注意力计算加速 5 倍以上 在 VBench 上轻量微调后质量与全注意力相当 90% 稀疏度下超越所有 SOTA 稀疏注意力方法 技术脉络 Monarch Mixer (2023) → Monarch in LLM → VMonarch (视频 DiT 首次应用) 批判性点评 优势:数学上最优雅的方案;17.5x FLOPs 减少是本周最极端的数字;与 FlashAttention 兼容 局限:交替最小化的收敛性依赖初始化;需要轻量微调(非完全免训练);实际 wall-clock 加速(5x)远小于理论 FLOPs 减少(17.5x),说明实现上有瓶颈 创新性评分:4.5/5 — 本周最具理论深度的工作 论文 5:SLA — 稀疏-线性注意力融合 标题:SLA: Beyond Sparsity in Diffusion Transformers via Fine-Tunable Sparse-Linear Attention 作者:Jintao Zhang 等 (清华 + Berkeley) 日期:2025年9月28日(ICLR 2026 Oral) arXiv:2509.24006 关键词:稀疏注意力 线性注意力 融合 自定义GPU kernel 95%计算减少 ICLR 2026 研究动机 注意力权重可以分为两部分:少量大权重(高秩)和大量小权重(低秩)。这天然暗示:对大权重用稀疏注意力(O(N²) 但只算少量),对小权重用线性注意力(O(N))。 方法原理 三级分类:将注意力权重分为 Critical(O(N²) 精确计算)、Marginal(O(N) 线性注意力)、Negligible(跳过) 融合 GPU kernel:将稀疏和线性注意力的计算融合到单个 GPU kernel 中,支持前向和反向传播 轻量微调:仅需少量微调步就能适配 核心创新 稀疏+线性的系统性融合:不是简单的 fallback,而是基于权重分布的最优分配 自定义 GPU kernel:工程实现极其扎实,直接转化为实际加速 实验结果 注意力计算减少 95%(20 倍) 注意力加速 13.7 倍 端到端加速 2.2 倍(Wan 2.1-1.3B) 生成质量无损 技术脉络 稀疏注意力 + 线性注意力两条独立技术路线 → SLA 首次统一融合(ICLR 2026 Oral) 批判性点评 优势:ICLR 2026 Oral,学术认可度最高;2.2x E2E 加速是免训练之外的最佳实际数字;自定义 kernel 可直接落地 局限:需要微调(虽然很轻量);目前只在 1.3B 模型上测试,14B 模型的效果未知;kernel 需要针对不同硬件调优 创新性评分:4.5/5 论文 6:SALAD — 高稀疏度线性注意力微调 标题:SALAD: Achieve High-Sparsity Attention via Efficient Linear Attention Tuning for Video Diffusion Transformer 作者:Tongcheng Fang 等 (清华 + 腾讯) 日期:2026年1月23日 arXiv:2601.16515 关键词:线性注意力 门控机制 高稀疏度 轻量微调 2000样本 研究动机 免训练稀疏注意力受限于有限的稀疏度(通常 50-70%),而训练型方法需要大量数据和计算。能否用极轻量的微调达到极高稀疏度? 方法原理 双分支并行:在稀疏注意力旁边添加一个轻量线性注意力分支 输入依赖门控:用门控机制动态平衡两个分支的贡献 极轻量微调:仅需 2000 个视频样本和 1600 步训练 实验结果 90% 稀疏度,1.72x 推理加速 生成质量与全注意力基线相当 批判性点评 思路与 SLA 类似但更轻量;微调效率极高(2000 样本);但 1.72x 加速低于 SLA 的 2.2x 创新性评分:3.5/5 论文 7:FastLightGen — 步数 + 参数同时压缩 标题:FastLightGen: Fast and Light Video Generation with Fewer Steps and Parameters 作者:Shitong Shao, Yufei Gu, Zeke Xie 日期:2026年3月2日 arXiv:2603.01685 关键词:蒸馏 剪枝 步数压缩 参数压缩 HunyuanVideo WanX 研究动机 以往的加速研究要么减少采样步数(蒸馏),要么减少模型参数(剪枝),但从未同时压缩两者。 方法原理 FastLightGen 的核心:构建一个"最优教师模型",在协同框架中同时蒸馏步数和参数。 协同蒸馏框架:同时优化步数减少和参数剪枝 最优教师构建:教师模型本身经过优化,以最大化学生模型的性能 实验结果 4 步采样 + 30% 参数剪枝 = 最佳视觉质量(在约束推理预算下) 在 HunyuanVideo-ATI2V 和 WanX-TI2V 上优于所有竞争方法 批判性点评 首次探索步数+参数的联合压缩,填补了研究空白 但 30% 剪枝比较保守;缺少与纯蒸馏方法的详细对比 创新性评分:3.5/5 论文 8:Diagonal Distillation — 对角蒸馏实现流式视频生成 标题:Streaming Autoregressive Video Generation via Diagonal Distillation 作者:Jinxiu Liu 等 (HKUST, Ming-Hsuan Yang) 日期:2026年3月10日 arXiv:2603.09488 关键词:自回归 蒸馏 流式生成 光流建模 277x加速 31 FPS 研究动机 扩散蒸馏将多步模型压缩为少步变体,但现有方法主要针对图像设计,忽略了视频的时间依赖性,导致运动不连贯和长序列误差累积。 方法原理 对角蒸馏:不同于传统的逐 chunk 独立蒸馏,Diagonal Distillation 沿"视频 chunk × 去噪步"的对角线方向进行蒸馏 非对称生成策略:前面的 chunk 用更多步、后面的 chunk 用更少步。后面的 chunk 可以继承前面已充分处理的外观信息 隐式光流建模:在严格步数约束下保持运动质量 核心创新 对角蒸馏:沿时间-步数对角线操作,充分利用时间上下文 非对称步数分配:打破"每个 chunk 步数相同"的假设 曝光偏差缓解:将训练时的噪声条件与推理时对齐 实验结果 5 秒视频 2.61 秒生成(31 FPS) 相比原始模型 277.3 倍加速 运动连贯性和长序列质量显著优于图像蒸馏方法 批判性点评 优势:277x 是本周最震撼的加速数字;流式生成对实时应用极其重要 局限:目前仅适用于自回归视频模型;生成质量与原始多步模型仍有差距;FPS 数字的分辨率条件未详细说明 创新性评分:4/5 论文 9:FrameDiT — 帧级矩阵注意力 标题:FrameDiT: Diffusion Transformer with Frame-Level Matrix Attention for Efficient Video Generation 作者:Minh Khoa Le 等 日期:2026年3月10日 arXiv:2603.09721 关键词:帧级注意力 矩阵注意力 时空结构 Local Factorized 研究动机 现有方法面临 Full 3D Attention(强但贵)vs Local Factorized Attention(快但丢失全局信息)的两难。 方法原理 Matrix Attention:将整帧作为矩阵处理,通过矩阵原生操作生成 Q/K/V 帧间注意力:在帧级别而非 token 级别做跨帧注意力,保持全局时空结构 FrameDiT-H:混合 Matrix Attention + Local Factorized Attention,同时捕捉大运动和小运动 实验结果 多个视频生成 benchmark 上达到 SOTA 效率与 Local Factorized Attention 相当 批判性点评 帧级注意力的粒度介于 Full 3D 和 Local Factorized 之间,是一个有趣的中间地带 但"矩阵注意力"的具体实现细节(矩阵原生操作是什么?)缺乏清晰的数学定义 创新性评分:3/5 三、横向对比分析 3.1 方法分类体系 本周的 9 篇论文可以按 "是否需要训练" 和 "加速策略" 两个维度分类: 免训练 轻量微调 训练/蒸馏 ┌─────────┐ ┌─────────┐ ┌─────────┐ 稀疏注意力 │CalibAtt │ │ SALAD │ │ SLA │ │SVG-EAR │ │VMonarch │ │ │ ├─────────┤ ├─────────┤ ├─────────┤ 缓存+剪枝 │ SODA │ │ │ │ │ ├─────────┤ ├─────────┤ ├─────────┤ 蒸馏+压缩 │ │ │ │ │FastLight│ │ │ │ │ │DiagDist │ ├─────────┤ ├─────────┤ ├─────────┤ 结构化注意力 │ │ │ │ │FrameDiT │ └─────────┘ └─────────┘ └─────────┘ 3.2 性能对比 方法 注意力加速 端到端加速 需要训练? 测试模型 质量保持 CalibAtt - 1.58x 否 Wan 2.1 14B, Mochi ★★★★ SVG-EAR - 1.77-1.93x 否 Wan 2.2, HunyuanVideo ★★★★ SODA - 可控 否 DiT-XL, PixArt-α, OpenSora ★★★★★ VMonarch 5x - 轻量微调 VBench ★★★★ SALAD - 1.72x 2000样本 - ★★★★ SLA 13.7x 2.2x 少量微调 Wan 2.1 1.3B ★★★★★ FastLightGen - 显著 蒸馏 HunyuanVideo, WanX ★★★★ Diagonal Dist. - 277.3x 蒸馏 自回归模型 ★★★ FrameDiT ~FA级 ~FA级 训练 多个benchmark ★★★★ 3.3 技术路线演进 本周的论文清晰地展现了四条技术路线的演进: 路线 A:免训练稀疏注意力 核心思想:发现并利用注意力的天然稀疏性 演进:Token-level Top-K → Block-level 静态模式 (CalibAtt) → 误差感知动态路由 (SVG-EAR) 加速上限:~2x(受限于稀疏度无法无限提高) 路线 B:稀疏 + 线性注意力融合 核心思想:对不同重要性的注意力权重使用不同计算策略 演进:纯稀疏 / 纯线性 → 并行双分支 (SALAD) → 融合 kernel (SLA) → Monarch 结构化 (VMonarch) 加速上限:~2-5x(取决于 kernel 效率) 路线 C:缓存 + 剪枝 核心思想:利用扩散过程中相邻时间步的特征相似性 演进:均匀缓存 → 启发式组合 → 敏感度导向 DP 优化 (SODA) 加速上限:~2-3x(缓存复用比例有限) 路线 D:蒸馏 + 压缩 核心思想:用小模型/少步数逼近大模型/多步数 演进:步数蒸馏 → 参数剪枝 → 联合压缩 (FastLightGen) → 对角蒸馏 (Diagonal Distillation) 加速上限:100x+(但质量损失更大) 3.4 关键洞察与趋势 免训练方法的天花板在 ~2x:CalibAtt (1.58x) 和 SVG-EAR (1.93x) 代表了免训练稀疏注意力的当前上限。突破需要引入轻量训练。 稀疏 + 线性融合是最佳平衡点:SLA 通过自定义 kernel 实现 2.2x E2E 加速且质量无损,是目前注意力加速的最优解。ICLR 2026 Oral 的认可也说明了这一点。 蒸馏方法的加速比远超注意力优化:Diagonal Distillation 的 277x 说明,如果能接受一定质量损失,蒸馏是最强力的加速手段。但注意力优化的优势是"质量无损"。 多种方法可叠加:注意力优化 + 蒸馏可以叠加使用。CalibAtt 已在蒸馏模型上验证有效。理论上 SLA + 步数蒸馏可能实现 5-10x 无损加速。 Wan 和 HunyuanVideo 成为标准测试平台:本周几乎所有论文都在这两个模型上测试,说明它们已成为视频生成的事实标准。 从算法到系统的全栈优化:SODA 的序列并行推理提醒我们,纯算法优化之外,系统级优化(多 GPU 并行、算子融合等)同样重要。 四、总结与展望 本周最值得关注的 3 篇 SLA (ICLR 2026 Oral):稀疏-线性融合的里程碑工作,自定义 kernel 的工程深度令人印象深刻 SVG-EAR:误差感知路由的洞察非常深刻,免训练方法的新标杆 VMonarch:Monarch 矩阵的引入为结构化注意力开辟了全新方向 未来研究方向预判 注意力优化 + 蒸馏的联合框架:将 SLA/SVG-EAR 与 FastLightGen/Diagonal Distillation 结合 更大规模模型验证:SLA 仅在 1.3B 上测试,14B+ 模型上的表现待验证 长视频生成的特化优化:随着视频长度增长到分钟级,注意力优化的重要性进一步凸显 硬件协同设计:自定义 kernel(SLA)和结构化矩阵(VMonarch)需要与硬件特性深度适配 人工智能炼丹师 整理 | 2026-03-14