AIGC论文速读|2026-05-05|纯视觉流统一生成颠覆文本管线,1D-Token端到端FI…

今日核心看点

- 纯视觉流统一生成(FlowInOne)

- 端到端自回归FID 1.48(1D-Token)

- 隐空间压缩加速视频(LC-VAE)

- 两步跳跃Flow对齐(LeapAlign)

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇。

方向分布:

- 统一多模态生成 2 篇 (FlowInOne, UniVidX)

- 自回归图像生成与预训练 2 篇 (1D-Tokenizer, GenLIP)

- 推理加速 2 篇 (LC-VAE, DepthVAR)

- 后训练对齐 2 篇 (LeapAlign, PostTrain)

- 音视频生成与评测 2 篇 (Talker-T2AV, MOSAIC)

今日论文速览

1. FlowInOne: Unifying Multimodal Generation as Image-In, Image-Out Flow Matching

FlowInOne:纯视觉流统一多模态生成,消除跨模态对齐瓶颈 | Microsoft Research Asia | arXiv:2604.06757

关键词: 统一生成·流匹配·视觉提示·Image-In-Out·VisPrompt-5M

前序工作问题: 多模态生成长期被文本管线主导,语言驱动视觉但无法在视觉空间内推理创作,跨模态对齐与任务特定分支增加系统复杂度

贡献: 将所有模态(文本、布局、编辑指令)统一编码为视觉提示,用单一流匹配模型实现 Image-In Image-Out 管线,消除噪声调度和跨模态对齐,配套 VisPrompt-5M 数据集与 VP-Bench 基准

效果: 在文生图、布局引导编辑、视觉指令跟随等任务上全面超越开源模型和商业系统,建立视觉原生统一生成新范式

批判点评: 纯视觉流假设对高度抽象语义(如否定逻辑、数量推理)的编码能力有限;5M 数据集构建成本高且任务覆盖均匀性待验证

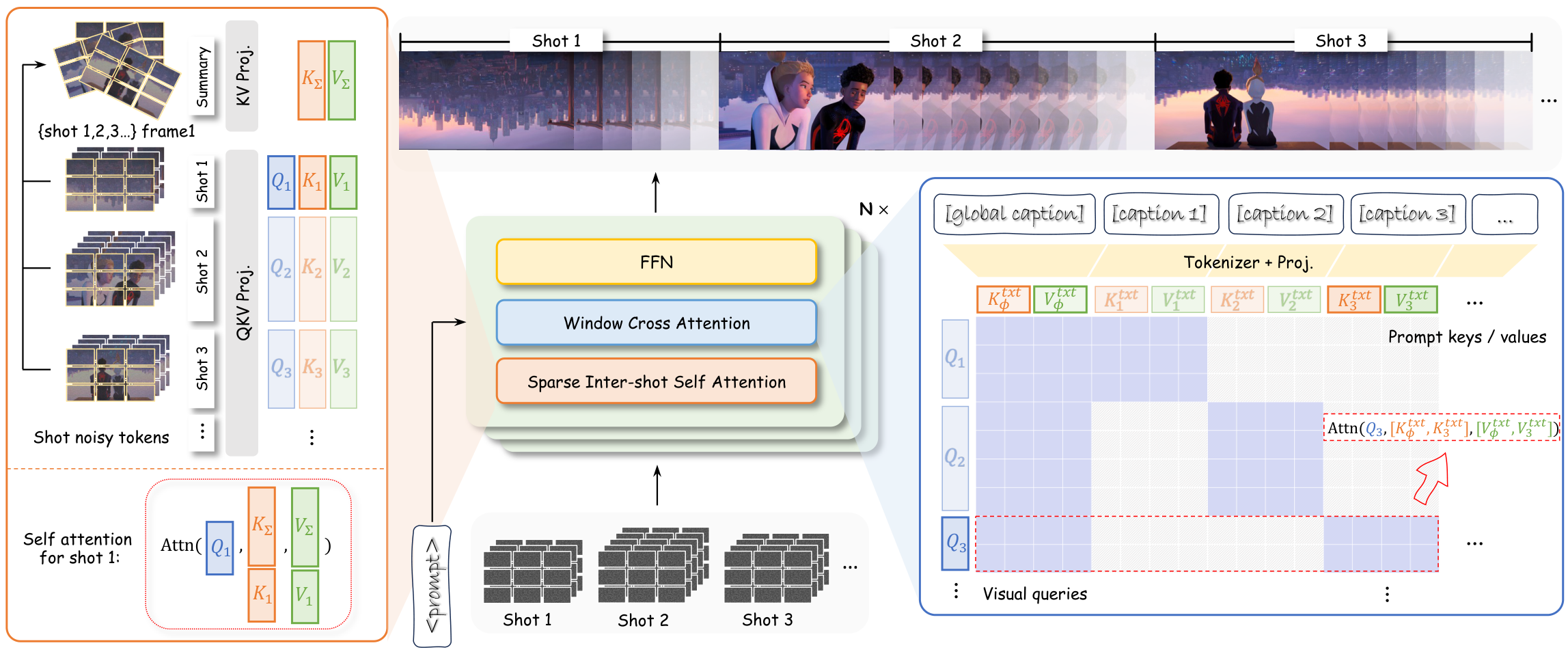

2. UniVidX: A Unified Multimodal Framework for Versatile Video Generation via Diffusion Priors

UniVidX:统一多模态视频生成框架,不足千条视频实现全向条件生成 | NJU / SIGGRAPH 2026 | arXiv:2605.00658

关键词: 视频生成·统一框架·随机掩码·门控LoRA·跨模态注意力

前序工作问题: 现有方法为每种模态组合训练独立模型,固定输入输出映射且忽略跨模态关联

贡献: 提出随机条件掩码 SCM、解耦门控 LoRA DGL 和跨模态自注意力 CMSA 三大设计,用不到 1000 条视频训练出支持 RGB/内秉图/RGBA 分层的全向条件生成

效果: 在深度/法线/反照率估计和视频分层任务上达到 SOTA,成功泛化到野外场景,被 SIGGRAPH 2026 接收

批判点评: 训练数据仅千条视频,复杂动态场景的泛化鲁棒性存疑;多模态同时生成的质量-一致性权衡未深入分析

3. End-to-End Autoregressive Image Generation with 1D Semantic Tokenizer

端到端训练 1D 语义 Tokenizer,FID 1.48 刷新自回归生图 SOTA | ByteDance Seed / ICML 2026 Spotlight | arXiv:2605.00503

关键词: 自回归生图·1D Tokenizer·端到端·视觉基础模型·FID 1.48

前序工作问题: 两阶段方法先训 Tokenizer 再训生成器,生成信号无法反馈到 Tokenizer,重建与生成目标脱节

贡献: 设计端到端管线联合优化 Tokenizer 与生成器,利用视觉基础模型提升 1D Tokenizer 语义表达能力,实现重建-生成信号直通

效果: ImageNet 256x256 无 guidance 达到 FID 1.48(SOTA),被 ICML 2026 选为 Spotlight

批判点评: 端到端训练需同步两个大模型,显存和训练稳定性要求高;仅在 ImageNet class-conditional 验证,开放域文生图能力未展示

4. GenLIP: Generative Language-Image Pre-training for Vision Transformers

GenLIP:ViT直接预测语言Token,极简生成式视觉预训练 | ByteDance | arXiv:2605.00809

关键词: 视觉预训练·生成式·ViT·语言建模·多模态

前序工作问题: 现有视觉预训练依赖对比学习的大批量构建或额外文本解码器,架构复杂且难以扩展

贡献: 让 ViT 用标准语言建模目标直接从视觉 Token 预测语言 Token,单一 Transformer 联合建模视觉与文本,无需对比批构建或额外解码器

效果: 在 8B 样本上训练即达到或超越强对比基线,多模态基准全面竞争力;续训多分辨率后在 OCR 和图表理解上进一步提升

批判点评: 生成式预训练对负样本信息的利用不如对比学习充分;8B 训练数据仍是较大规模,小数据场景表现未报告

5. LC-VAE: Latent-Compressed Variational Autoencoder for Video Diffusion Models

LC-VAE:高频裁剪代替通道压缩,解锁视频扩散生成质量 | CVPR 2026 Findings | arXiv:2604.16479

关键词: 视频VAE·隐空间压缩·高频裁剪·扩散收敛·通道冗余

前序工作问题: 视频 VAE 需大量隐通道保证重建质量,但过多通道反而阻碍扩散模型收敛并恶化生成性能

贡献: 提出隐空间高频分量移除策略替代直接减通道,在保持等效压缩比的前提下保留重建保真度,同时释放扩散模型收敛潜力

效果: 同等压缩比下视频重建质量超越强基线,扩散模型训练收敛更快且生成质量更高,被 CVPR 2026 接收

批判点评: 高频裁剪阈值的选取对不同视频类型(快速运动 vs 静态)敏感性未深入分析;仅在特定模型架构上验证

6. DepthVAR: Depth Adaptive Efficient Visual Autoregressive Modeling

DepthVAR:按 Token 自适应分配计算深度,VAR 加速 2.3-3.1x | CVPR 2026 Findings | arXiv:2604.17286

关键词: VAR加速·自适应深度·免训练·循环调度·图像生成

前序工作问题: VAR 对每个位置施加固定计算深度,存在显著深度冗余;现有频率图 Token 剪枝方法采用二值硬剪枝,无法提升质量

贡献: 提出从剪枝整个 Token 转向按 Token 自适应分配深度的范式,设计循环旋转调度器与动态推理流程,按处理深度比例混合输出编码

效果: 免训练实现 2.3x-3.1x 加速,质量损失极小且优于硬剪枝方案,被 CVPR 2026 Findings 接收

批判点评: 调度策略为启发式循环旋转,最优深度分配应可学习化;仅验证 VAR 架构,DiT 等其他范式适用性未探索

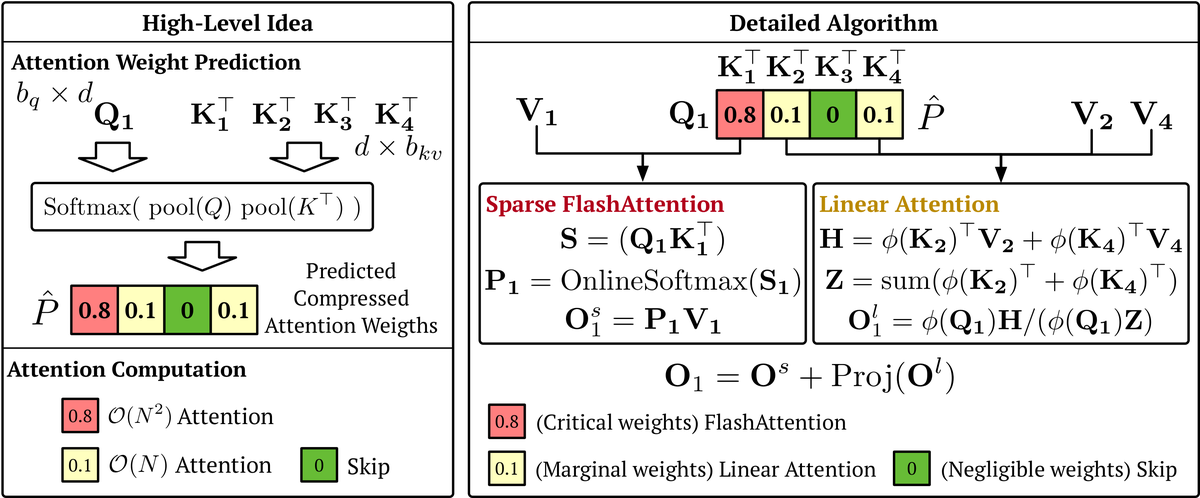

7. LeapAlign: Post-Training Flow Matching Models at Any Generation Step

LeapAlign:两步跳跃轨迹实现 Flow Matching 任意步对齐 | ANU / ByteDance Seed / CVPR 2026 | arXiv:2604.15311

关键词: 后训练·Flow Matching·奖励对齐·梯度稳定·Flux

前序工作问题: Flow Matching 长轨迹反传导致显存爆炸和梯度爆炸,且难以更新决定全局结构的早期步

贡献: 将长轨迹压缩为两步跳跃,每跳跨越多个 ODE 采样步一步预测未来隐变量;随机化起止时间步实现任意步更新,高权重分配给与长路径一致的轨迹

效果: 在 Flux 模型上全面超越 GRPO 和直接梯度方法,图像质量和文图对齐均达 SOTA,被 CVPR 2026 接收

批判点评: 两步跳跃近似引入轨迹偏差,对高步数采样的兼容性需进一步分析;仅在 Flux 单模型验证

8. A Systematic Post-Train Framework for Video Generation

视频生成系统化后训练:SFT+GRPO+提示增强四阶段管线 | Microsoft / HKU | arXiv:2604.25427

关键词: 后训练·视频扩散·GRPO·SFT·提示增强

前序工作问题: 视频扩散模型预训练性能与部署需求间存在巨大差距:提示敏感性高、时间不连贯、推理成本大

贡献: 提出四阶段后训练框架:SFT 转化为指令跟随策略→视频 GRPO 强化感知质量→提示增强器提升输入→推理优化降成本,形成统一可复制管线

效果: RLHF 阶段 GSB 指标提升 31%,提示增强再提 20%,视觉质量与动作连贯性显著增强同时保持语义对齐

批判点评: 文本对齐改善有限暴露当前文本-视频奖励模型瓶颈;四阶段训练流程复杂度高,各阶段超参互相耦合

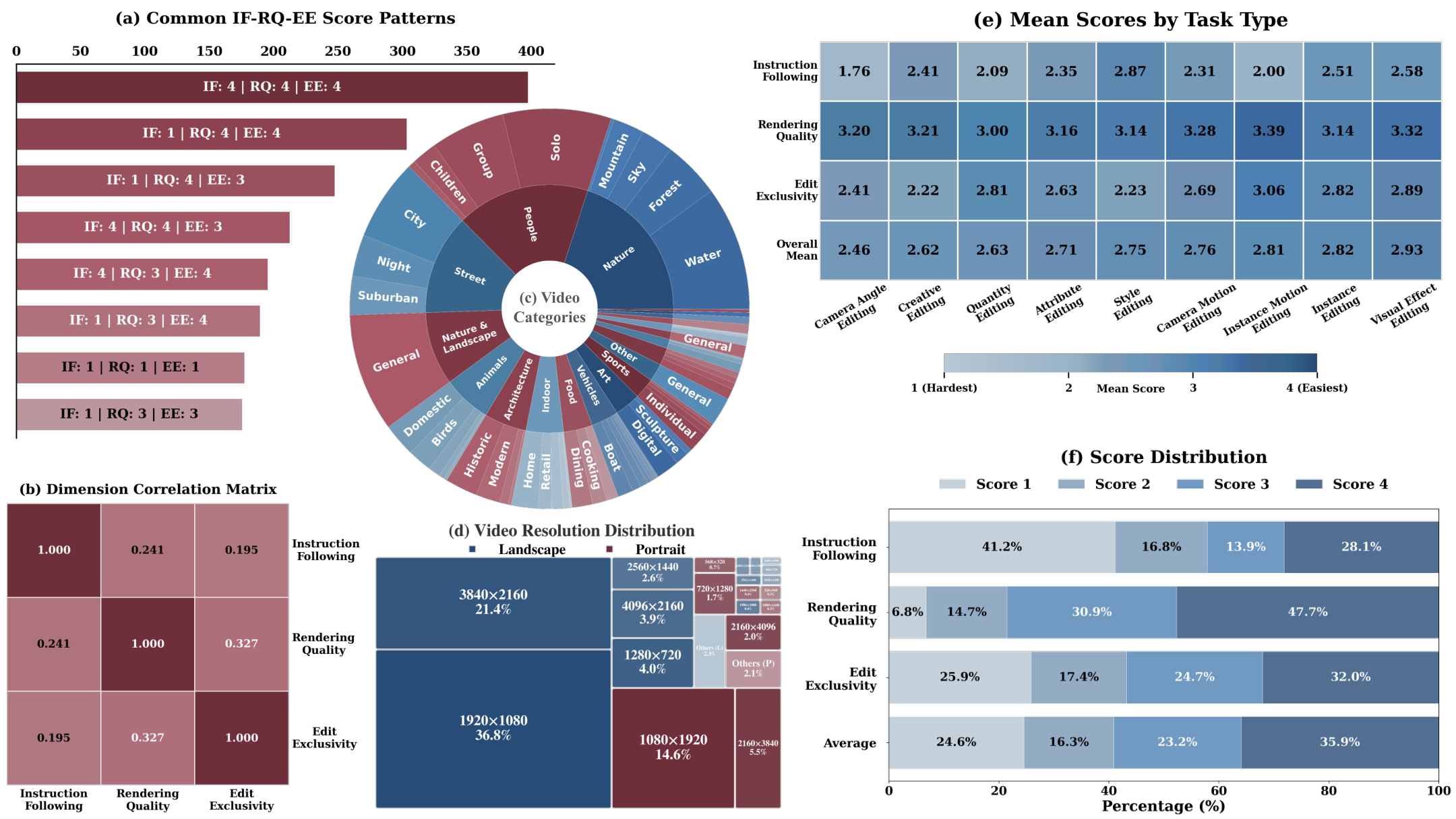

9. Talker-T2AV: Joint Talking Audio-Video Generation with Autoregressive Diffusion

Talker-T2AV:自回归扩散联合生成语音与肖像视频 | Unknown | arXiv:2604.23586

关键词: 音视频联合生成·自回归扩散·解耦解码·唇同步·肖像

前序工作问题: 现有联合音视频生成模型在全层级通过密集注意力耦合模态,高层语义与低层渲染纠缠导致效率低下且质量受限

贡献: 提出高层跨模态建模在共享骨干、低层精化在模态专属解码器的解耦架构;统一 Patch 级 Token 空间下自回归语言模型联合推理音视频,再由轻量 DiT 头解码为帧级隐变量

效果: 唇同步精度、视频质量、音频质量全面超越双分支基线,跨模态一致性强于级联管线

批判点评: 仅在说话人肖像场景验证,开放域音视频生成能力未测试;Patch 级 Token 量化损失对音质影响未量化

10. When Do Diffusion Models Learn to Generate Multiple Objects?

扩散模型何时学会多对象生成?MOSAIC 框架揭示数据本质 | ICML 2026 | arXiv:2605.00273

关键词: 多对象生成·组合泛化·数据分析·MOSAIC·扩散模型

前序工作问题: 文生图扩散模型在多对象生成上表现不可靠,失败根因不明确:是数据不足还是模型能力限制

贡献: 引入 MOSAIC 可控数据集生成框架,从概念泛化和组合泛化两个维度系统研究数据量与多对象生成能力的关系

效果: 发现场景复杂度比概念不均衡更关键,计数在低数据区极难学习,组合泛化随留出比例增加急剧退化;揭示需要更强归纳偏置

批判点评: 使用合成数据框架研究结论的真实世界迁移性有限;未提出具体解决方案仅停留在诊断层面

趋势观察

- 统一范式从文本主导走向视觉主导 — FlowInOne 将所有模态编码为视觉提示实现 Image-In Image-Out,UniVidX 用随机条件掩码实现全向生成,统一模型正式进入视觉原生时代

- VAE隐空间优化成为视频生成新瓶颈 — LC-VAE 发现过多隐通道反而阻碍扩散收敛,通过高频裁剪代替通道压缩解锁生成质量;DepthVAR 从Token深度冗余切入加速,压缩思路多元化

人工智能炼丹君 整理 | 2026-05-05

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描下方二维码关注

评论 (0)