AIGC每日速读|0429|Tuna-2像素嵌入干翻编码器,World-R1强化学习约束视频3D

今日核心看点

- 统一多模态

- 视频3D约束

- 图像编辑

- 音视频生成

- 推理加速

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇。

方向分布:

- 统一多模态生成与理解 (Tuna-2)

- 视频生成 3D 一致性 (World-R1)

- 图像编辑与 CoT 推理 (Meta-CoT)

- 联合音视频生成 (Talker-T2AV, Hallo-Live)

- 视频扩散推理加速 (FreqFormer, LIF-Pruning)

- AI 电影创作 (CineAGI)

- 3D 生成与编辑 (MetaEarth3D, Prox-E)

今日论文速览

1. Tuna-2:像素嵌入干翻视觉编码器,统一多模态理解与生成:提出 Tuna-2

Tuna-2: Pixel Embeddings Beat Vision Encoders for Multimodal Understanding and Generation | 2604.24763

关键词: 统一多模态·像素嵌入·端到端·无编码器·图像生成

前序工作问题: 现有统一多模态模型依赖预训练视觉编码器,理解和生成使用不同视觉表征,导致两任务不对齐且无法从原始像素端到端优化

贡献: 提出 Tuna-2,首个原生统一多模态模型,完全丢弃 VAE 和表征编码器,仅用简单 patch embedding 层直接从像素嵌入进行理解和生成,在多模态基准上达到 SOTA

效果: 在多模态基准上达到最优性能,证明像素空间统一建模可与隐空间方法全面竞争,尤其在细粒度视觉感知任务上编码器无关设计在大规模训练时表现更强

批判点评: 完全抛弃视觉编码器虽然简化架构,但预训练收敛速度更慢;论文缺少与最新 VAR/MAR 等离散生成方法的对比;像素空间直接操作在高分辨率图像上的计算开销未充分讨论

2. World-R1:用强化学习给视频生成「上3D约束」:提出 World-R1 框架

World-R1: Reinforcing 3D Constraints for Text-to-Video Generation | 2604.24764

关键词: 视频生成·3D一致性·强化学习·Flow-GRPO·世界模拟

前序工作问题: 视频基础模型虽然视觉效果出色但经常出现几何不一致,现有方法通过修改架构注入 3D 先验导致高计算成本和可扩展性受限

贡献: 提出 World-R1 框架,通过强化学习(Flow-GRPO)利用预训练 3D 基础模型和 VLM 的反馈来对齐视频生成与 3D 约束,无需修改底层架构;引入周期性解耦训练策略平衡刚性几何一致性与动态场景流畅性

效果: 显著增强 3D 一致性同时保持原始视觉质量,有效弥合视频生成与可扩展世界模拟之间的鸿沟

批判点评: 依赖预训练 3D 基础模型作为 reward 信号,其自身局限性会传导到训练结果;纯文本数据集用于世界模拟的泛化能力存疑;周期性解耦训练的超参数敏感性未充分分析

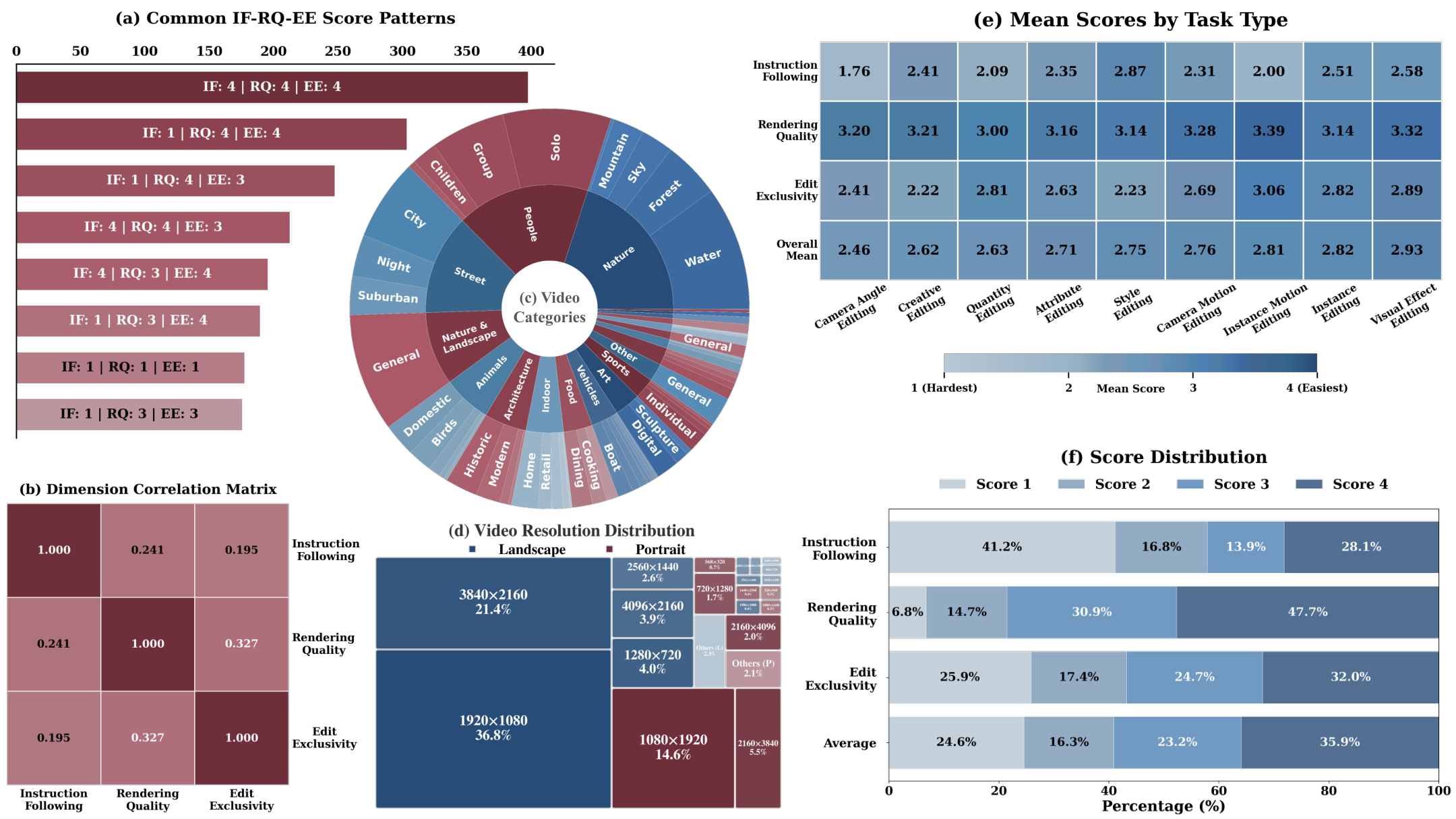

3. Meta-CoT:用元任务分解解锁图像编辑泛化力(CVPR 2026):提出 Meta-CoT 范式

Meta-CoT: Enhancing Granularity and Generalization in Image Editing | 2604.24625

关键词: 图像编辑·思维链·元任务·可分解性·泛化性

前序工作问题: 统一多模态模型通过 CoT 改善编辑表现,但何种 CoT 形式和训练策略能同时提升理解粒度和泛化能力仍未被充分探索

贡献: 提出 Meta-CoT 范式,将任意编辑操作分解为(任务、目标、所需理解能力)三元组;进一步将编辑任务归纳为 5 种基础元任务,仅训练这 5 种即可泛化到各种未见编辑任务;引入 CoT-Editing 一致性奖励确保编辑行为与推理过程对齐

效果: 在 21 种编辑任务上取得 15.8% 整体提升,仅训练少量元任务即可有效泛化到未见编辑任务

批判点评: 5 种元任务的定义存在主观性,不同任务分类体系可能产生不同结果;CoT 推理增加了推理时延,实际部署成本较高;对复杂多步骤编辑任务的级联误差积累缺乏分析

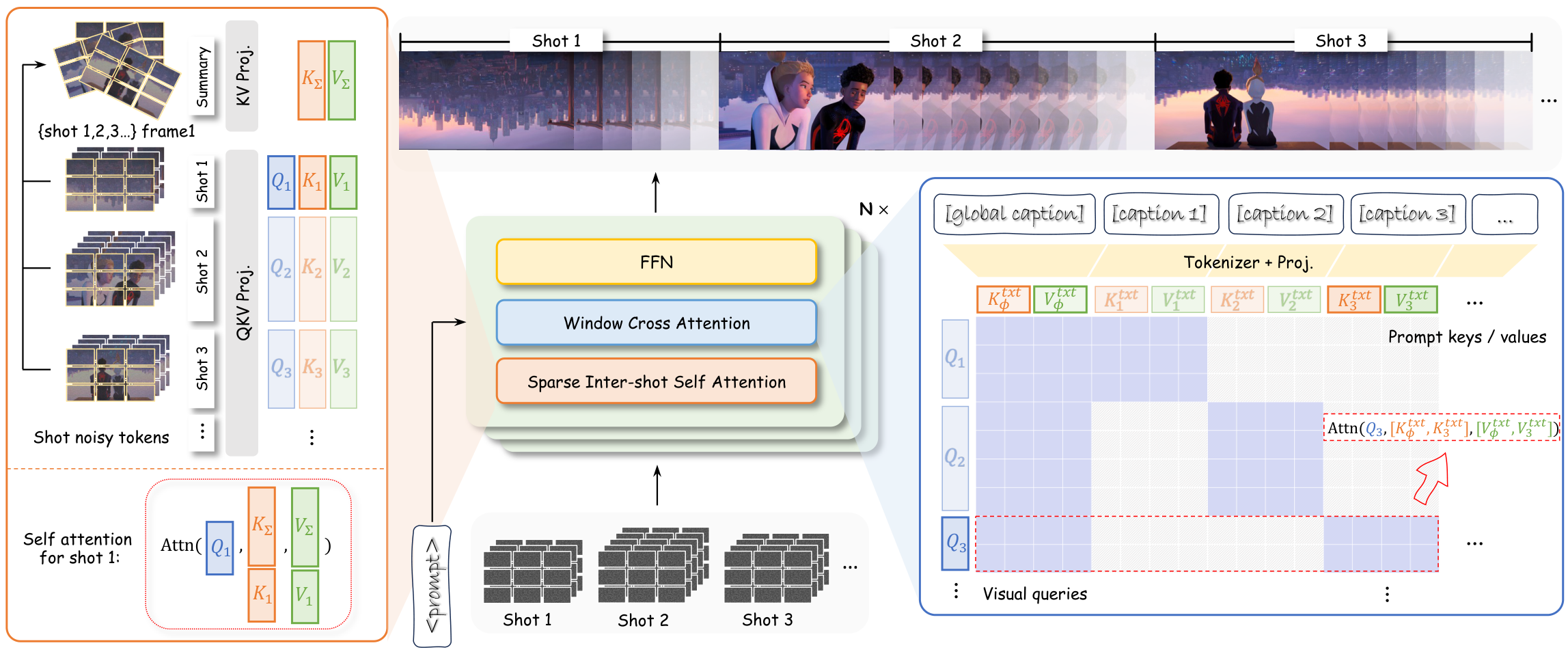

4. Talker-T2AV:自回归扩散解耦音视频联合生成:提出 Talker-T2AV

Talker-T2AV: Joint Talking Audio-Video Generation with Autoregressive Diffusion Modeling | 2604.23586

关键词: 音视频生成·自回归扩散·说话头合成·跨模态一致性·模态解耦

前序工作问题: 现有联合音视频扩散模型在去噪全程通过全局注意力耦合两种模态,将高层语义和低层信号细节完全纠缠,这对说话头合成是次优的——音频和面部运动虽语义相关,但低层渲染过程完全不同

贡献: 提出 Talker-T2AV,在共享自回归语言模型中进行高层跨模态推理,再由两个轻量级扩散 Transformer 头分别解码音视频隐变量,实现「高层共享、低层解耦」

效果: 在说话头基准上,唇音同步准确度、视频质量和音频质量均超越双分支基线,跨模态一致性优于级联管线

批判点评: 仅在说话头场景验证,对更广泛的音视频内容(如音乐视频、环境声)的泛化能力未知;自回归建模的累积误差问题在长时生成时可能加剧

5. Hallo-Live:首个实时流式音视频虚拟人生成框架:提出 Hallo-Live

Hallo-Live: Real-Time Streaming Joint Audio-Video Avatar Generation with Asynchronous Dual-Stream and Human-Centric Preference Distillation | 2604.23632

关键词: 实时生成·流式虚拟人·异步双流·偏好蒸馏·音视频同步

前序工作问题: 现有音视频扩散模型速度太慢无法满足交互需求,激进加速后生成质量又显著下降

贡献: 提出 Hallo-Live,结合异步双流扩散和人体中心偏好引导蒸馏;引入 Future-Expanding Attention 减少因果生成中的发音延迟;提出 HP-DMD 通过视觉保真度、语音自然度和音视频同步的奖励重加权训练样本

效果: 在 2 块 H200 GPU 上达到 20.38 FPS、0.94 秒延迟,比教师模型 Ovi 吞吐量提高 16 倍、延迟降低 99.3 倍,同时保持强生成质量

批判点评: 需要 2 块 H200 高端 GPU,硬件门槛极高;0.94 秒延迟对于实时对话仍然偏高;对非写实风格和多说话人场景的验证不够深入

6. FreqFormer:频域异构注意力加速长序列视频扩散:提出 FreqFormer

FreqFormer: Hierarchical Frequency-Domain Attention with Adaptive Spectral Routing for Long-Sequence Video Diffusion Transformers | 2604.22808

关键词: 视频扩散·频域注意力·稀疏注意力·自适应路由·推理加速

前序工作问题: 长序列视频扩散 Transformer 的自注意力计算量随 token 数二次增长,现有高效注意力方法使用单一近似而忽略视频特征的频谱结构

贡献: 提出 FreqFormer,将 token 特征按频谱分带:低频用密集全局注意力、中频用结构化块稀疏注意力、高频用滑动窗口局部注意力;轻量频谱路由网络根据层统计量和扩散时间步自适应分配注意力头

效果: 在 64K-1M token 仿真中,注意力 FLOPs 和 KV 相关显存流量大幅降低,同时保持硬件友好的注意力模式

批判点评: 仅有仿真数据而非实际训练结果,FLOPs 减少是否真正转化为端到端加速未验证;频域分解增加了预处理开销;频带边界的硬划分可能丢失跨频带信息

7. LIF-Pruning:帧间冗余剪枝加速视频生成 1.44 倍:借鉴传统视频压缩避免传输冗余帧数据的思路

Latent Inter-Frame Pruning: A Training-Free Method Bridging Traditional Video Compression and Modern Diffusion Transformers for Efficient Generation | 2604.23858

关键词: 视频生成加速·帧间冗余·隐空间剪枝·免训练·注意力恢复

前序工作问题: 视频生成计算昂贵、速度慢,无法满足实时应用需求;LDM 框架下编码的视频隐变量在时间轴上存在冗余

贡献: 借鉴传统视频压缩避免传输冗余帧数据的思路,提出隐空间帧间剪枝框架跳过重复隐 patch 的重计算;为弥合全序列训练与剪枝推理的差异引入注意力恢复机制

效果: 视频编辑吞吐量提升 1.44 倍,在 RTX 6000 上达到 12.44 FPS,同时保持视频质量

批判点评: 仅验证了视频编辑场景而非视频生成场景;1.44 倍加速相对温和;注意力恢复机制在复杂运动场景下的鲁棒性未充分验证

8. CineAGI:多智能体编排角色一致的电影创作:提出 CineAGI 层次化电影生成框架:多智能体叙事合成模块生成完整…

CineAGI: Character-Consistent Movie Creation through LLM-Orchestrated Multi-Modal Generation and Cross-Scene Integration | 2604.23579

关键词: 电影生成·多智能体·角色一致性·跨场景整合·音视觉同步

前序工作问题: 自动电影创作需要跨长序列协调多个角色、多种模态和叙事元素,现有端到端方法难以有效解决

贡献: 提出 CineAGI 层次化电影生成框架:多智能体叙事合成模块生成完整电影蓝图、解耦角色中心管线通过实例级跟踪维持身份一致性、层次化音视觉同步机制确保帧级对齐

效果: 整体一致性提升 40%,主体一致性提高 4.4%,美学质量提升 5.4%,角色一致性提高 28.7%

批判点评: 多智能体协调增加了系统复杂度和推理成本;角色一致性提升 4.4% 的绝对值偏小;缺少与最新商业视频生成模型(如 Sora、Kling)的对比

9. MetaEarth3D:首个行星级 3D 生成基础模型:将空间尺度作为基础模型新的扩展维度

MetaEarth3D: Unlocking World-scale 3D Generation with Spatially Scalable Generative Modeling | 2604.22828

关键词: 3D生成·行星级·空间可扩展·地球观测·基础模型

前序工作问题: 现有生成模型虽能产生逼真视觉内容,但空间尺度局限于有界环境,无法跨越数千公里建模大规模物理世界的空间结构

贡献: 将空间尺度作为基础模型新的扩展维度,提出 MetaEarth3D——首个能在行星尺度上保持空间一致性生成的基础模型,支持从大尺度地形到中等城市到街区级别的多层次 3D 场景生成

效果: 基于 1000 万全球分布真实图像训练,展现强视觉真实感和地理空间统计真实性,可作为超广域空间智能的生成式数据引擎

批判点评: 行星级声明宏大但实际展示以地球观测为主,对室内场景、人造环境等缺乏覆盖;1000 万训练图像相对行星尺度仍显稀疏;生成质量的定量评估标准不够标准化

10. Prox-E:基于几何原语的细粒度 3D 形状编辑(SIGGRAPH 2026):提出 Prox-E 免训练框架

Prox-E: Fine-Grained 3D Shape Editing via Primitive-Based Abstractions | 2604.23774

关键词: 3D编辑·几何原语·免训练·VLM·形状保真

前序工作问题: 基于 2D 图像编辑先验驱动的 3D 编辑方法在细粒度结构修改(如精确度量指令'加宽座位 1.5 倍')时经常失败,难以协调空间变换与原始身份保持

贡献: 提出 Prox-E 免训练框架,将输入 3D 形状抽象为紧凑几何原语集合,由预训练 VLM 编辑原语级变化,再引导 3D 生成模型实现细粒度局部修改同时保持未修改区域

效果: 在身份保持、形状质量和指令忠实度的平衡上持续优于现有 2D 驱动 3D 编辑器和训练式方法

批判点评: 几何原语抽象可能丢失复杂拓扑信息;对有机形状(如人体、动物)的原语分解可能不够自然;VLM 对精确度量编辑指令的理解能力仍有局限

趋势观察

- 统一多模态架构趋势 — Tuna-2 证明像素嵌入可完全替代视觉编码器,标志着统一多模态模型向更简洁的端到端架构演进

- 视频生成与世界模拟融合 — World-R1 用 RL 约束 3D 一致性,推动视频生成从纯视觉合成向物理世界模拟迈进

人工智能炼丹君 整理 | 2026-04-29

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描下方二维码关注

评论 (0)