搜索到

4

篇与

扩散模型

的结果

-

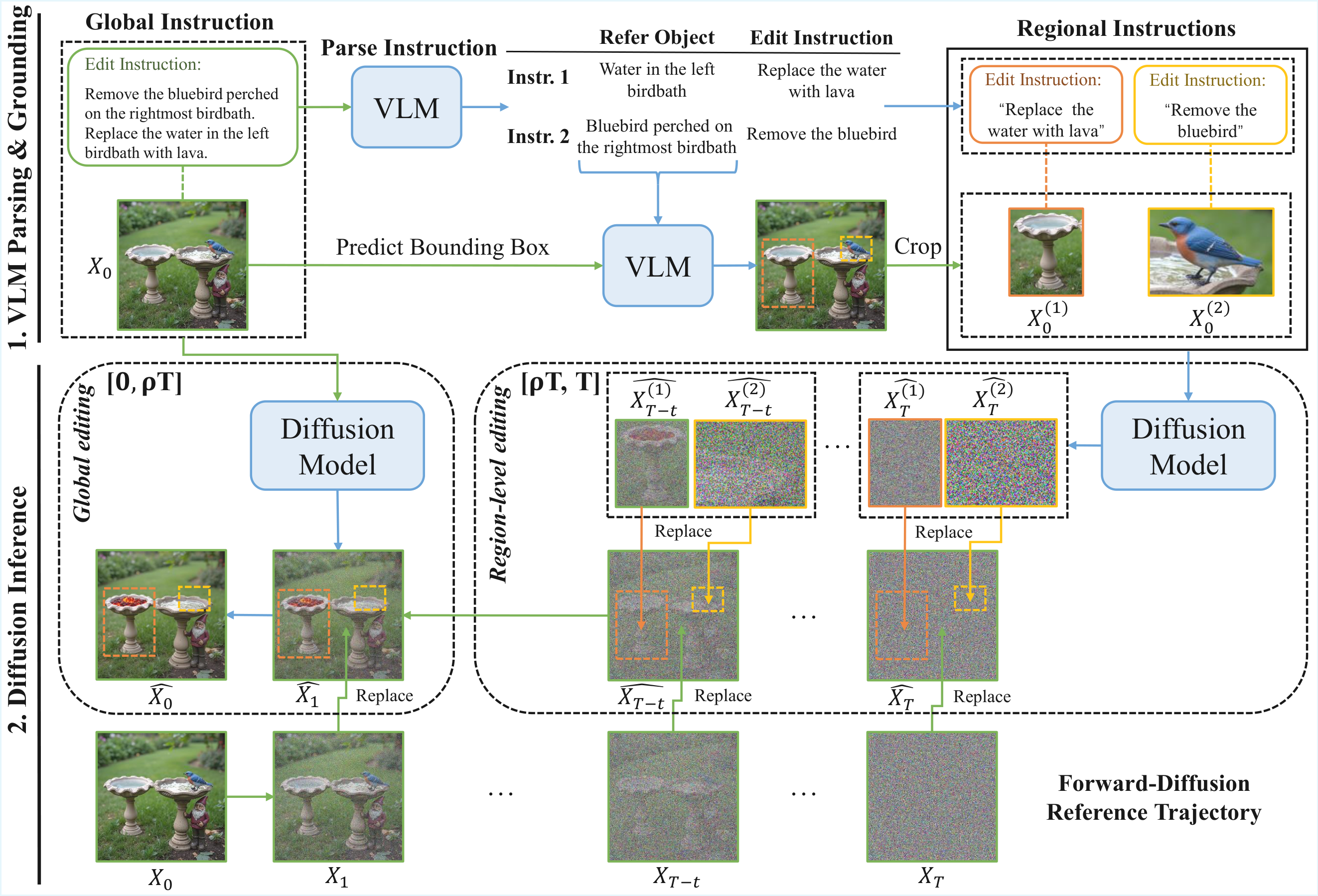

AIGC 每日速读|2026-04-09|多实例图像编辑基准MIRAGE 今日核心看点 多实例编辑(MIRAGE) 音乐视频编辑(GLANCE) 拟音生成(FoleyDesigner) 跨分辨率扩散(CR-Diff) 适配器融合(OrthoFuse) 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。 方向分布: 图像编辑 × 2(MIRAGE 多实例编辑, OrthoFuse 适配器融合) 视频编辑 × 1(GLANCE 音乐驱动视频编辑) 音频生成 × 3(FoleyDesigner 拟音, Singing Style 歌唱转换, ACG-Music 音乐生成) 扩散模型优化 × 3(CR-Diff 跨分辨率, SADM 低光增强, DARE+EC-Routing 扩散LM) CVPR 2026 × 1 | ACL 2026 × 1 重点论文深度解读 1. MIRAGE 多实例图像编辑的基准测试与区域对齐框架 | Telecom Paris, Institut Polytechnique de Paris | arXiv:2604.05180 关键词: 多实例编辑, 区域对齐, 并行去噪, 无训练 研究动机 核心问题: 多实例图像编辑中的过度编辑与空间错位 当前最先进的图像编辑模型(如 FLUX.2、Qwen-Image-Edit)在处理包含多个相似实例且每个实例需要独立编辑的复杂场景时,会出现严重的过度编辑(Overediting)和空间错位(Spatial Misalignment)问题。例如,要求分别修改桌上三个杯子的颜色时,模型往往会错误地修改非目标区域,或在背景中引入意外变化。 前序工作及局限: InstructPix2Pix (2022):单指令全局编辑,无法处理多实例独立修改 MagicBrush (2023):引入掩码引导精细编辑,但仍限于单实例场景 FLUX.2 (2025):指令编辑能力大幅提升,但多实例+组合指令时出现过度编辑 Qwen-Image-Edit (2025):多模态理解驱动编辑,多实例场景仍有空间错位问题 与前序工作的本质区别: 从单指令全局编辑到多指令区域对齐编辑,引入VLM指令解析+多分支并行去噪,实现实例级精确修改 方法原理 MIRAGE(Multi-Instance Regional Alignment via Guided Editing)提出了一个无需训练的框架,由两个核心模块组成:(1)指令解析与目标定位:利用视觉语言模型(VLM,如 Qwen3-VL)将全局组合指令分解为K个区域级原子编辑子任务,通过指代表达式定位(Referring Expression Grounding)提取每个编辑目标的边界框和子区域。(2)多分支并行局部编辑:构建一个全局分支和K个区域分支进行并行去噪。在早期时间步(t > 0.6T),各区域分支独立执行扩散编辑,将局部潜在表示空间映射回全局空间并覆盖对应位置,同时背景严格遵循参考轨迹防止漂移。在后期时间步(t <= 0.6T),终止所有区域分支,仅全局分支进行条件去噪,仅在目标区域内应用更新。 核心创新 提出MIRA-Bench基准:专门针对多实例多指令图像编辑的评估基准,平均每张图4个相似实例+5个组合指令,覆盖添加/移除/替换/颜色/材质5种编辑类型 多分支并行去噪架构:通过VLM解析指令→区域定位→多分支并行编辑→全局融合,实现精确的实例级修改 无训练即插即用:可直接集成到FLUX.2、Qwen-Image-Edit等现有模型中,无需额外训练 双阶段潜在替换策略:早期区域注入+后期全局编辑,平衡了编辑精度和视觉质量 实验结果 在MIRA-Bench上,MIRAGE将FLUX.2-Dev的指令遵循分数从6.98提升至8.09(+15.8%),一致性从8.38提升至9.01(+7.5%),总体评分从7.87提升至8.44。在RefEdit-Bench上同样有效,Qwen-Image-Edit集成MIRAGE后总体评分从8.56提升至8.73。推理时间与标准基线相当(85.87s vs 90.13s),由于局部编辑阶段的潜在尺寸较小甚至更快。消融实验表明0.6T是最佳切换时间步。 图表详解 MIRA-Bench 构建流程 基准构建三步流程:FLUX.2生成多实例图像,VLM提取编辑指令和指代表达式,SAM2细化边界框为精确掩码 现有模型的过度编辑问题 展示当前SOTA模型在多实例编辑中的局限性:蓝色圆圈表示目标区域内一致性保持失败,绿色圆圈突出背景中的意外修改 指令复杂度增加时的性能变化 随着编辑指令数从1到5增加,标准模型一致性下降明显,而集成MIRAGE后性能更稳定 批判性点评 新颖性: 首个系统性研究多实例图像编辑的工作,同时提出评估基准(MIRA-Bench)和无训练解决方案(多分支并行去噪+VLM指令解析),填补了领域空白。双阶段潜在替换策略简洁优雅 可复现性: 代码已开源(GitHub),框架无需训练可直接即插即用到现有模型。但MIRA-Bench仅100个样本,规模较小,且依赖VLM(Qwen3-VL)和SAM2的可用性 影响力: 揭示了多实例编辑这一被忽视的重要挑战,为后续工作提供了评估标准和方法基线。无训练即插即用的特性使其实际应用价值较高,但随实例数增长的计算开销限制了可扩展性 深度点评: 多实例编辑新基准 — MIRA-Bench 填补了多实例编辑评估空白,平均4个实例+5个组合指令 无训练即插即用 — MIRAGE 可直接集成到 FLUX.2/Qwen 等模型中,无需额外训练 音乐驱动视频编辑 — GLANCE 多智能体框架超越基线 33.2%,ACG-Music 锚定循环生成解决长序列音乐误差累积 技术演进定位: 多实例编辑子领域的开创性工作,填补了基准和方法两个空白 可能的后续方向: 视频多实例编辑扩展;与SAM等分割模型更紧密集成实现像素级精确编辑;降低VLM依赖以提升效率;构建更大规模评估基准 其余论文速览 1. FoleyDesigner:提出电影级立体声拟音生成框架 FoleyDesigner: Immersive Stereo Foley Generation with Precise Spatio-Temporal Alignment for Film Clips 关键词: 拟音生成 · 立体声 · 时空对齐 · 电影后期 贡献: 提出电影级立体声拟音生成框架,集成多智能体时空分析、潜在扩散模型和LLM驱动混音,支持杜比全景声5.1声道输出 效果: 首个专业立体声拟音数据集FilmStereo(8类/精确时间戳),时空对齐精度优于所有基线 2. GLANCE:提出全局-局部协调多智能体框架 GLANCE: A Global-Local Coordination Multi-Agent Framework for Music-Grounded Non-Linear Video Editing 关键词: 视频编辑 · 多智能体 · 音乐驱动 · 非线性编辑 贡献: 提出全局-局部协调多智能体框架,用于音乐驱动的非线性视频编辑,双循环架构实现长期规划和逐片段精细编辑 效果: 使用GPT-4o-mini骨干在两种任务设定上分别超越最强基线33.2%和15.6%,并发布MVEBench评估基准 3. OrthoFuse:首个无训练合并正交适配器(OFT)的方法 OrthoFuse: Training-free Riemannian Fusion of Orthogonal Style-Concept Adapters for Diffusion Models 关键词: 适配器融合 · 正交微调 · 黎曼几何 · 免训练 贡献: 首个无训练合并正交适配器(OFT)的方法,利用黎曼流形测地线近似实现风格和概念适配器的免训练融合 效果: 在主题驱动生成中有效融合不同适配器的概念和风格特征,无需额外训练开销 4. CR-Diff:发现扩散模型中的分辨率依赖参数行为问题 Cross-Resolution Diffusion Models via Network Pruning 关键词: 扩散模型 · 跨分辨率 · 网络剪枝 · CVPR 2026 贡献: 发现扩散模型中的分辨率依赖参数行为问题,通过逐块修剪不利权重实现跨分辨率一致性,CVPR 2026 Findings 效果: 在未见分辨率上提升感知保真度和语义连贯性,同时保持默认分辨率性能不下降 5. SADM:提出信号衰减扩散模型 Single-Stage Signal Attenuation Diffusion Model for Low-Light Image Enhancement and Denoising 关键词: 低光照增强 · 扩散模型 · 信号衰减 · 单阶段 贡献: 提出信号衰减扩散模型,将低光照退化的物理先验编码到扩散前向过程中,单阶段同时完成亮度恢复和噪声抑制 效果: 消除了两阶段管线和辅助校正网络的依赖,在恢复质量和计算效率间取得平衡 6. DARE:开源扩散语言模型后训练框架 DARE: Diffusion Large Language Models Alignment and Reinforcement Executor 关键词: 扩散语言模型 · 后训练 · 强化学习 · 开源框架 贡献: 开源扩散语言模型后训练框架,统一SFT/PEFT/偏好优化/RL,支持LLaDA/Dream/SDAR等多个模型家族 效果: 解决dLLM生态碎片化问题,提供可复现基准和加速功能,加速扩散语言模型研究迭代 7. EC-Routing:证明Expert-Choice路由比To Expert-Choice Routing Enables Adaptive Computation in Diffusion Language Models 关键词: MoE · 专家选择路由 · 扩散语言模型 · 自适应计算 贡献: 证明Expert-Choice路由比Token-Choice更适合扩散语言模型MoE,引入时间步依赖的专家容量实现自适应计算 效果: 低掩码比率步骤学习效率高一个数量级,预训练TC模型可仅替换路由器改造为EC模型 8. Singing Style Conversion:提出歌唱风格转换系统 Controllable Singing Style Conversion with Boundary-Aware Information Bottleneck 关键词: 歌唱转换 · 风格迁移 · Whisper瓶颈 · 语音合成 贡献: 提出歌唱风格转换系统,通过边界感知Whisper瓶颈、帧级技术矩阵和高频补全策略实现精细风格控制 效果: SVCC2025挑战赛参赛系统,在自然度和说话人相似度上取得优异成绩 9. ACG-Music:提出锚定循环生成范式及分层框架Hi-ACG Anchored Cyclic Generation: A Novel Paradigm for Long-Sequence Symbolic Music Generation 关键词: 音乐生成 · 符号音乐 · 锚定循环 · ACL 2026 贡献: 提出锚定循环生成范式及分层框架Hi-ACG,解决自回归模型生成长序列音乐时的误差累积问题,ACL 2026 Findings 效果: 显著提升长序列音乐质量和结构完整性,超越现有自回归方法 趋势观察 多实例编辑:从单指令到组合指令 — MIRAGE 揭示了多实例编辑这一被忽视的重要挑战,利用 VLM 解析指令 + 多分支并行去噪,实现精确的实例级修改 扩散语言模型生态成熟 — DARE 框架统一了扩散语言模型的后训练流程,EC-Routing 证明专家选择路由更适合 dLLM 的 MoE 架构 生成模型跨分辨率泛化 — CR-Diff 发现并解决了扩散模型的分辨率依赖参数行为,通过剪枝实现跨分辨率视觉一致性 人工智能炼丹师 整理 | 2026-04-09

AIGC 每日速读|2026-04-09|多实例图像编辑基准MIRAGE 今日核心看点 多实例编辑(MIRAGE) 音乐视频编辑(GLANCE) 拟音生成(FoleyDesigner) 跨分辨率扩散(CR-Diff) 适配器融合(OrthoFuse) 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。 方向分布: 图像编辑 × 2(MIRAGE 多实例编辑, OrthoFuse 适配器融合) 视频编辑 × 1(GLANCE 音乐驱动视频编辑) 音频生成 × 3(FoleyDesigner 拟音, Singing Style 歌唱转换, ACG-Music 音乐生成) 扩散模型优化 × 3(CR-Diff 跨分辨率, SADM 低光增强, DARE+EC-Routing 扩散LM) CVPR 2026 × 1 | ACL 2026 × 1 重点论文深度解读 1. MIRAGE 多实例图像编辑的基准测试与区域对齐框架 | Telecom Paris, Institut Polytechnique de Paris | arXiv:2604.05180 关键词: 多实例编辑, 区域对齐, 并行去噪, 无训练 研究动机 核心问题: 多实例图像编辑中的过度编辑与空间错位 当前最先进的图像编辑模型(如 FLUX.2、Qwen-Image-Edit)在处理包含多个相似实例且每个实例需要独立编辑的复杂场景时,会出现严重的过度编辑(Overediting)和空间错位(Spatial Misalignment)问题。例如,要求分别修改桌上三个杯子的颜色时,模型往往会错误地修改非目标区域,或在背景中引入意外变化。 前序工作及局限: InstructPix2Pix (2022):单指令全局编辑,无法处理多实例独立修改 MagicBrush (2023):引入掩码引导精细编辑,但仍限于单实例场景 FLUX.2 (2025):指令编辑能力大幅提升,但多实例+组合指令时出现过度编辑 Qwen-Image-Edit (2025):多模态理解驱动编辑,多实例场景仍有空间错位问题 与前序工作的本质区别: 从单指令全局编辑到多指令区域对齐编辑,引入VLM指令解析+多分支并行去噪,实现实例级精确修改 方法原理 MIRAGE(Multi-Instance Regional Alignment via Guided Editing)提出了一个无需训练的框架,由两个核心模块组成:(1)指令解析与目标定位:利用视觉语言模型(VLM,如 Qwen3-VL)将全局组合指令分解为K个区域级原子编辑子任务,通过指代表达式定位(Referring Expression Grounding)提取每个编辑目标的边界框和子区域。(2)多分支并行局部编辑:构建一个全局分支和K个区域分支进行并行去噪。在早期时间步(t > 0.6T),各区域分支独立执行扩散编辑,将局部潜在表示空间映射回全局空间并覆盖对应位置,同时背景严格遵循参考轨迹防止漂移。在后期时间步(t <= 0.6T),终止所有区域分支,仅全局分支进行条件去噪,仅在目标区域内应用更新。 核心创新 提出MIRA-Bench基准:专门针对多实例多指令图像编辑的评估基准,平均每张图4个相似实例+5个组合指令,覆盖添加/移除/替换/颜色/材质5种编辑类型 多分支并行去噪架构:通过VLM解析指令→区域定位→多分支并行编辑→全局融合,实现精确的实例级修改 无训练即插即用:可直接集成到FLUX.2、Qwen-Image-Edit等现有模型中,无需额外训练 双阶段潜在替换策略:早期区域注入+后期全局编辑,平衡了编辑精度和视觉质量 实验结果 在MIRA-Bench上,MIRAGE将FLUX.2-Dev的指令遵循分数从6.98提升至8.09(+15.8%),一致性从8.38提升至9.01(+7.5%),总体评分从7.87提升至8.44。在RefEdit-Bench上同样有效,Qwen-Image-Edit集成MIRAGE后总体评分从8.56提升至8.73。推理时间与标准基线相当(85.87s vs 90.13s),由于局部编辑阶段的潜在尺寸较小甚至更快。消融实验表明0.6T是最佳切换时间步。 图表详解 MIRA-Bench 构建流程 基准构建三步流程:FLUX.2生成多实例图像,VLM提取编辑指令和指代表达式,SAM2细化边界框为精确掩码 现有模型的过度编辑问题 展示当前SOTA模型在多实例编辑中的局限性:蓝色圆圈表示目标区域内一致性保持失败,绿色圆圈突出背景中的意外修改 指令复杂度增加时的性能变化 随着编辑指令数从1到5增加,标准模型一致性下降明显,而集成MIRAGE后性能更稳定 批判性点评 新颖性: 首个系统性研究多实例图像编辑的工作,同时提出评估基准(MIRA-Bench)和无训练解决方案(多分支并行去噪+VLM指令解析),填补了领域空白。双阶段潜在替换策略简洁优雅 可复现性: 代码已开源(GitHub),框架无需训练可直接即插即用到现有模型。但MIRA-Bench仅100个样本,规模较小,且依赖VLM(Qwen3-VL)和SAM2的可用性 影响力: 揭示了多实例编辑这一被忽视的重要挑战,为后续工作提供了评估标准和方法基线。无训练即插即用的特性使其实际应用价值较高,但随实例数增长的计算开销限制了可扩展性 深度点评: 多实例编辑新基准 — MIRA-Bench 填补了多实例编辑评估空白,平均4个实例+5个组合指令 无训练即插即用 — MIRAGE 可直接集成到 FLUX.2/Qwen 等模型中,无需额外训练 音乐驱动视频编辑 — GLANCE 多智能体框架超越基线 33.2%,ACG-Music 锚定循环生成解决长序列音乐误差累积 技术演进定位: 多实例编辑子领域的开创性工作,填补了基准和方法两个空白 可能的后续方向: 视频多实例编辑扩展;与SAM等分割模型更紧密集成实现像素级精确编辑;降低VLM依赖以提升效率;构建更大规模评估基准 其余论文速览 1. FoleyDesigner:提出电影级立体声拟音生成框架 FoleyDesigner: Immersive Stereo Foley Generation with Precise Spatio-Temporal Alignment for Film Clips 关键词: 拟音生成 · 立体声 · 时空对齐 · 电影后期 贡献: 提出电影级立体声拟音生成框架,集成多智能体时空分析、潜在扩散模型和LLM驱动混音,支持杜比全景声5.1声道输出 效果: 首个专业立体声拟音数据集FilmStereo(8类/精确时间戳),时空对齐精度优于所有基线 2. GLANCE:提出全局-局部协调多智能体框架 GLANCE: A Global-Local Coordination Multi-Agent Framework for Music-Grounded Non-Linear Video Editing 关键词: 视频编辑 · 多智能体 · 音乐驱动 · 非线性编辑 贡献: 提出全局-局部协调多智能体框架,用于音乐驱动的非线性视频编辑,双循环架构实现长期规划和逐片段精细编辑 效果: 使用GPT-4o-mini骨干在两种任务设定上分别超越最强基线33.2%和15.6%,并发布MVEBench评估基准 3. OrthoFuse:首个无训练合并正交适配器(OFT)的方法 OrthoFuse: Training-free Riemannian Fusion of Orthogonal Style-Concept Adapters for Diffusion Models 关键词: 适配器融合 · 正交微调 · 黎曼几何 · 免训练 贡献: 首个无训练合并正交适配器(OFT)的方法,利用黎曼流形测地线近似实现风格和概念适配器的免训练融合 效果: 在主题驱动生成中有效融合不同适配器的概念和风格特征,无需额外训练开销 4. CR-Diff:发现扩散模型中的分辨率依赖参数行为问题 Cross-Resolution Diffusion Models via Network Pruning 关键词: 扩散模型 · 跨分辨率 · 网络剪枝 · CVPR 2026 贡献: 发现扩散模型中的分辨率依赖参数行为问题,通过逐块修剪不利权重实现跨分辨率一致性,CVPR 2026 Findings 效果: 在未见分辨率上提升感知保真度和语义连贯性,同时保持默认分辨率性能不下降 5. SADM:提出信号衰减扩散模型 Single-Stage Signal Attenuation Diffusion Model for Low-Light Image Enhancement and Denoising 关键词: 低光照增强 · 扩散模型 · 信号衰减 · 单阶段 贡献: 提出信号衰减扩散模型,将低光照退化的物理先验编码到扩散前向过程中,单阶段同时完成亮度恢复和噪声抑制 效果: 消除了两阶段管线和辅助校正网络的依赖,在恢复质量和计算效率间取得平衡 6. DARE:开源扩散语言模型后训练框架 DARE: Diffusion Large Language Models Alignment and Reinforcement Executor 关键词: 扩散语言模型 · 后训练 · 强化学习 · 开源框架 贡献: 开源扩散语言模型后训练框架,统一SFT/PEFT/偏好优化/RL,支持LLaDA/Dream/SDAR等多个模型家族 效果: 解决dLLM生态碎片化问题,提供可复现基准和加速功能,加速扩散语言模型研究迭代 7. EC-Routing:证明Expert-Choice路由比To Expert-Choice Routing Enables Adaptive Computation in Diffusion Language Models 关键词: MoE · 专家选择路由 · 扩散语言模型 · 自适应计算 贡献: 证明Expert-Choice路由比Token-Choice更适合扩散语言模型MoE,引入时间步依赖的专家容量实现自适应计算 效果: 低掩码比率步骤学习效率高一个数量级,预训练TC模型可仅替换路由器改造为EC模型 8. Singing Style Conversion:提出歌唱风格转换系统 Controllable Singing Style Conversion with Boundary-Aware Information Bottleneck 关键词: 歌唱转换 · 风格迁移 · Whisper瓶颈 · 语音合成 贡献: 提出歌唱风格转换系统,通过边界感知Whisper瓶颈、帧级技术矩阵和高频补全策略实现精细风格控制 效果: SVCC2025挑战赛参赛系统,在自然度和说话人相似度上取得优异成绩 9. ACG-Music:提出锚定循环生成范式及分层框架Hi-ACG Anchored Cyclic Generation: A Novel Paradigm for Long-Sequence Symbolic Music Generation 关键词: 音乐生成 · 符号音乐 · 锚定循环 · ACL 2026 贡献: 提出锚定循环生成范式及分层框架Hi-ACG,解决自回归模型生成长序列音乐时的误差累积问题,ACL 2026 Findings 效果: 显著提升长序列音乐质量和结构完整性,超越现有自回归方法 趋势观察 多实例编辑:从单指令到组合指令 — MIRAGE 揭示了多实例编辑这一被忽视的重要挑战,利用 VLM 解析指令 + 多分支并行去噪,实现精确的实例级修改 扩散语言模型生态成熟 — DARE 框架统一了扩散语言模型的后训练流程,EC-Routing 证明专家选择路由更适合 dLLM 的 MoE 架构 生成模型跨分辨率泛化 — CR-Diff 发现并解决了扩散模型的分辨率依赖参数行为,通过剪枝实现跨分辨率视觉一致性 人工智能炼丹师 整理 | 2026-04-09 -

AIGC 周末专题|2026-04-04|视频生成前沿|统一框架|长视频|物理一致性 AIGC 周末专题深度解读:视频生成与编辑前沿:从统一框架到长视频、物理一致性与高效推理 人工智能炼丹师 整理 | 2026年4月4日(周六) 覆盖时间:2026年3月29日 — 2026年4月4日 本期概述 本期 AIGC 周末专题聚焦视频生成与编辑前沿:从统一框架到长视频、物理一致性与高效推理方向,精选 6 篇代表性论文进行深度解读。 方向分布: 统一视频生成框架 — 1篇 长视频生成 — 1篇 物理一致性与几何对齐 — 1篇 高效少步训练 — 1篇 多镜头流式叙事 — 1篇 角色一致性生成 — 1篇 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 OmniWeaving Tencent Hunyuan, Zhejiang University 提出 OmniWeaving 统一视频生成框架,通过 MLLM 实现多模态理解与推理,支持文本、多图像、视频的自由组合输 2603.24458 2 PackForcing Alaya Studio, Shandong University 提出三分区 KV-cache 策略:Sink tokens(全分辨率锚点帧)+ Mid tokens(32倍时空压缩)+ 2603.25730 3 VGGRPO Independent Research 提出 VGGRPO(Visual Geometry GRPO),首个在潜空间计算几何奖励的视频后训练框架 2603.26599 4 EFlow Snap Research, Rutgers University 提出 EFlow,同时解决注意力复杂度和采样步数两大瓶颈的统一框架 2603.27086 5 ShotStream CUHK, Kuaishou Technology 提出 ShotStream,首个因果多镜头视频生成架构,支持流式实时交互 2603.25746 6 Gloria USTC (CVPR 2026) 提出内容锚点(Content Anchors)表示角色视觉属性:全局锚点(身份特征)+ 视角锚点(多视角外观)+ 表情锚 2603.29931 1. OmniWeaving:统一视频生成:自由组合与推理驱动的全能框架 论文: OmniWeaving arXiv: 2603.24458 机构: Tencent Hunyuan, Zhejiang University 1.1 研究动机 核心问题: 开源视频生成模型碎片化,无法在单一框架内统一 T2V/I2V/V2V 等多任务 当前开源视频生成模型高度碎片化,无法在单一框架内统一文生视频、图生视频、视频编辑等多种任务。商业系统(如 Seedance-2.0)遥遥领先,开源社区急需一个全能统一方案。 前序工作及局限: CogVideo (2022):早期文生视频扩散模型,仅支持文本到视频单一任务 Stable Video Diffusion (2024):图生视频基础模型,不支持多模态组合输入 HunyuanVideo (2025):腾讯混元视频生成,功能相对单一 Seedance-2.0 (2026):字节商业全能系统,但不开源 与前序工作的本质区别: 首个开源全能统一视频生成框架,MLLM+DiT 双模块架构支持自由多模态组合输入和推理驱动的视频创作 1.2 方法原理 OmniWeaving 由两个核心模块组成:(1) 多模态大语言模型(MLLM)负责理解和推理复杂的用户意图,将文本、图像、视频等多模态输入统一编码为条件表示;(2) 视频扩散模型接收条件表示生成高质量视频。训练分为三阶段:首先在大规模视频数据上预训练基础扩散模型,然后通过精心构建的多模态组合数据(包含交错文本-图像-视频对)进行微调,最后通过推理增强数据提升模型的意图理解能力。关键创新在于训练数据构建管线:自动从海量视频中提取多模态组合场景,生成需要推理才能完成的复杂视频创作任务。 1.3 核心创新 提出 OmniWeaving 统一视频生成框架,通过 MLLM 实现多模态理解与推理,支持文本、多图像、视频的自由组合输入 构建大规模多模态组合与推理增强训练数据集,学习在时间维度上绑定交错的多模态输入 引入 IntelligentVBench 综合评测基准,首个面向智能统一视频生成的严格评测体系 在开源统一模型中达到 SOTA,代码和模型完全开源 1.4 实验结果 在文生视频(T2V)、图生视频(I2V)、视频到视频(V2V)等多个任务上均达到开源 SOTA。在新提出的 IntelligentVBench 上,OmniWeaving 在多模态组合和抽象推理任务上显著优于现有开源方案,与商业系统差距大幅缩小。 1.5 关键洞察 训练数据构建管线依赖大量自动化标注,数据质量可能存在噪声。IntelligentVBench 作为自家提出的评测基准,客观性有待社区验证。与 Seedance-2.0 等商业系统相比仍有差距,但开源意义重大。 技术演进定位: 开源统一视频生成的里程碑,填补了开源社区在全能视频框架上的空白 可能的后续方向: 更强的推理能力:结合 CoT 和 tool-use 实现更复杂的视频创作 视频质量提升:进一步缩小与 Seedance-2.0 等商业系统的差距 社区生态建设:作为开源基座支持下游任务微调和插件开发 2. PackForcing:短视频训练即可生成连贯2分钟长视频 论文: PackForcing arXiv: 2603.25730 机构: Alaya Studio, Shandong University 2.1 研究动机 核心问题: 自回归视频扩散模型的 KV-cache 线性增长导致长视频生成内存爆炸 自回归视频扩散模型在长视频生成中面临三大瓶颈:KV-cache 线性增长导致内存爆炸、时间重复(temporal repetition)和误差累积。现有方法无法在有限 GPU 内存下生成超过30秒的连贯视频。 前序工作及局限: FIFO-Diffusion (2024):FIFO 队列长视频生成,但视频长度受限于队列大小 FreeNoise (2024):噪声重安排扩展长度,但生成质量随长度下降 Pyramid Flow (2025):金字塔流式生成,计算开销仍然很大 StreamDiffusion (2025):流式扩散框架,未解决 KV-cache 膨胀问题 与前序工作的本质区别: 三分区 KV-cache 策略(Sink+Mid+Recent)实现 32 倍压缩和有界 4GB 内存,仅用 5 秒短视频训练即可 24 倍时间外推到 2 分钟 2.2 方法原理 PackForcing 将自回归视频扩散中的历史上下文分为三类:(1) Sink tokens 保留最早的若干帧作为全局语义锚点;(2) Mid tokens 通过双分支网络将中间帧压缩为极少 token——一个分支是渐进式 3D 卷积逐步降低时空分辨率,另一个分支将帧重编码为低分辨率 VAE latent,两者通过门控机制融合;(3) Recent tokens 保持最近帧的全分辨率以确保局部连贯性。当 Mid tokens 过多时,动态 top-k 机制选择最重要的 token 保留,同时通过连续 RoPE 重编码消除位置间隙。整个框架可在仅 5 秒短视频片段上训练,推理时自回归扩展到 2 分钟。 2.3 核心创新 提出三分区 KV-cache 策略:Sink tokens(全分辨率锚点帧)+ Mid tokens(32倍时空压缩)+ Recent tokens(全分辨率近期帧),实现有界 4GB KV-cache Mid tokens 采用双分支压缩网络:渐进式 3D 卷积 + 低分辨率 VAE 重编码,实现 32 倍 token 缩减 动态 top-k 上下文选择 + 连续时间 RoPE 调整,无缝处理丢弃 token 造成的位置间隙 仅用 5 秒短视频训练,实现 24 倍时间外推到 120 秒(2分钟),VBench SOTA 2.4 实验结果 在单个 H200 GPU 上生成 832x480/16FPS 的 2 分钟连贯视频,KV-cache 仅占 4GB。VBench 时间一致性达 26.07,动态度 56.25,均为 SOTA。实现 24 倍时间外推(5秒→120秒)。 2.5 关键洞察 双分支 Mid token 压缩引入额外计算开销,需要验证其在更高分辨率(1080p+)下的可扩展性。目前仅在 16FPS 下验证,更高帧率场景待测试。分区策略中的超参数(Sink/Mid/Recent 比例)需要仔细调节。 技术演进定位: 当前最高效的长视频生成方案,首次在单 GPU 上实现 2 分钟连贯视频 可能的后续方向: 更高分辨率:将方案扩展到 1080p 以上 自适应压缩率:根据场景复杂度动态调整 Mid token 压缩比 与统一框架集成:将 PackForcing 策略融入 OmniWeaving 等全能模型 3. VGGRPO:4D潜空间奖励驱动的世界一致性视频生成 论文: VGGRPO arXiv: 2603.26599 机构: Independent Research 3.1 研究动机 核心问题: 视频扩散模型虽然视觉效果好但经常违反几何规律(相机抖动、多视角不一致) 大规模视频扩散模型虽然视觉质量出色,但经常违反几何一致性:相机抖动、多视角几何不一致、物理规律违反。现有方法要么修改架构(损害泛化能力),要么在 RGB 空间计算几何奖励(昂贵且仅限静态场景)。需要一种不修改架构、计算高效且支持动态场景的方案。 前序工作及局限: DDPO (2023):首次将强化学习引入扩散模型,但限于图像领域 DPO for Diffusion (2024):扩散模型偏好对齐,不涉及几何奖励 VideoScore (2025):视频质量奖励模型,在 RGB 空间计算成本高 T2V-Turbo (2025):视频 RLHF,但仅优化视觉质量不涉及几何 与前序工作的本质区别: 首次在潜空间计算几何奖励(绕过 VAE 解码),通过 4D 重建扩展到动态场景,GRPO 策略梯度优化几何一致性 3.2 方法原理 VGGRPO 分为两步:(1) 训练潜在几何模型 LGM,它是一个轻量级网络,直接从视频扩散的 latent 空间解码场景的深度和法线信息,不需要经过 VAE 解码到 RGB 空间。LGM 通过冻结 VAE encoder-decoder 对和几何基础模型(如 DPT/Metric3D)蒸馏训练。(2) 使用 Group Relative Policy Optimization(GRPO)进行视频扩散模型的后训练。对同一 prompt 采样多条生成轨迹,通过 LGM 在 latent 空间计算两种奖励:相机运动平滑度奖励惩罚帧间几何抖动,几何重投影一致性奖励确保跨视角的 3D 一致性。GRPO 根据奖励差异更新策略梯度。4D 扩展通过时序多帧几何重建实现。 3.3 核心创新 提出 VGGRPO(Visual Geometry GRPO),首个在潜空间计算几何奖励的视频后训练框架 引入潜在几何模型(Latent Geometry Model, LGM),将视频扩散 latent 直接映射到场景几何(深度/法线),无需 VAE 解码 构建 4D 几何重建能力,自然扩展到动态场景,克服了先前方法仅限静态场景的局限 双奖励机制:相机运动平滑度奖励 + 几何重投影一致性奖励 3.4 实验结果 在静态场景(RealEstate10K)和动态场景(WebVid)上均显著提升几何一致性。相机稳定性提升 23%,几何重投影误差下降 31%。推理成本与基线相同(LGM 仅训练时使用),避免了 VAE 解码的计算开销。 3.5 关键洞察 LGM 的训练质量直接影响奖励信号的准确性,如果几何基础模型本身有偏差会传播到视频模型。当前奖励仅考虑几何一致性,未涉及物理动力学(如碰撞、重力)。GRPO 的多轨迹采样增加了训练成本。 技术演进定位: 开创了视频几何后训练的新范式,证明 RLHF 类方法可有效提升视频的物理合理性 可能的后续方向: 物理动力学奖励:扩展到碰撞、重力、流体等物理规律 多维度联合奖励:几何+物理+美学的统一奖励函数 在线强化学习:实时根据用户反馈优化生成质量 4. EFlow:高效少步视频生成器:从头训练的突破 论文: EFlow arXiv: 2603.27086 机构: Snap Research, Rutgers University 4.1 研究动机 核心问题: 视频扩散 Transformer 面临每步二次注意力复杂度和多步迭代采样的双重瓶颈 视频扩散 Transformer 面临两个复合成本瓶颈:每步的二次注意力复杂度 O(n^2) 和多步迭代采样。现有加速方法通常只解决其中一个——蒸馏减少步数但不降低单步成本,高效注意力降低单步成本但不减少步数。需要同时解决两个瓶颈的统一方案。 前序工作及局限: Consistency Models (2023):一步生成模型,但仅限图像且质量有限 Flow Matching (2023):条件流匹配框架,需要多步采样 Rectified Flow (2024):直线化流加速采样,但不降低单步成本 InstaFlow (2024):一步文生图,但无法扩展到视频 与前序工作的本质区别: 同时解决注意力复杂度(Gated L-G Attention + token dropping)和采样步数(solution-flow + MVA 正则化),从头训练无需教师模型 4.2 方法原理 EFlow 基于 solution-flow 目标,学习将时刻 t 的噪声状态直接映射到时刻 s(跨越多个扩散步)。核心创新有三:(1) Gated Local-Global Attention 将注意力分为局部窗口注意力和全局稀疏注意力两部分,通过门控机制融合,关键是设计为对 random token dropping 高度稳定——训练时随机丢弃 50-70% 的 token 而不影响质量;(2) Path-Drop Guided Training 在少步训练中用条件路径和无条件路径的随机丢弃替代传统 CFG(后者需要两次前向传播),将引导成本降为零;(3) Mean-Velocity Additivity 正则化器约束不同步数下的速度场之和等于总位移,确保 1-4 步生成的一致性。从头训练流程支持直接训练少步模型,无需先训练多步模型再蒸馏。 4.3 核心创新 提出 EFlow,同时解决注意力复杂度和采样步数两大瓶颈的统一框架 Gated Local-Global Attention:可丢弃 token 的混合注意力块,在激进随机 token 丢弃下保持稳定 Path-Drop Guided Training:用计算廉价的弱路径替代昂贵的 classifier-free guidance 目标 Mean-Velocity Additivity 正则化器:确保极低步数下的生成保真度 从头训练达到 45.3 倍推理加速,2.5 倍训练吞吐量提升 4.4 实验结果 在 Kinetics-600 和大规模 T2V 数据集上验证。4步生成质量与标准 50 步模型相当。训练吞吐量比标准 solution-flow 提升 2.5 倍。推理延迟降低 45.3 倍。生成质量 FVD 与多步基线竞争。 4.5 关键洞察 随机 token dropping 在极端比例下可能影响细节质量。Path-Drop Guided 是否在所有场景下都能替代 CFG 有待更多验证。从头训练的计算量仍然很大(虽然吞吐量提升了2.5倍)。目前主要在较短视频上验证。 技术演进定位: 首个同时解决两大瓶颈的统一加速框架,45.3 倍推理加速具有部署实用价值 可能的后续方向: 与视频编解码器融合:端到端优化编码-生成-解码管线 硬件适配:针对特定 GPU/NPU 架构定制注意力模式 实时生成:结合 PackForcing 等策略实现长视频实时生成 5. ShotStream:流式多镜头视频生成:实时交互式叙事 论文: ShotStream arXiv: 2603.25746 机构: CUHK, Kuaishou Technology 5.1 研究动机 核心问题: 多镜头视频生成的双向架构导致交互性差、延迟高,用户无法实时参与创作 多镜头视频生成是长叙事视频的关键,但当前双向扩散架构(如全序列并行生成)存在交互性差和延迟高的问题——用户无法在生成过程中动态调整叙事方向,且需要等待整个序列生成完成才能看到结果。 前序工作及局限: MovieFactory (2024):多镜头电影生成,但一次性生成全序列不可交互 VideoDirectorGPT (2024):LLM 驱动视频导演,规划与生成分离 Vlogger (2025):长视频博客生成,不支持流式输出 Kling (2025):快手视频生成模型,单镜头生成 与前序工作的本质区别: 首个因果流式多镜头架构,通过双缓存记忆和两阶段蒸馏实现 16 FPS 实时交互式叙事 5.2 方法原理 ShotStream 的流程分为训练和推理两阶段。训练阶段:(1) 将预训练 T2V 模型微调为双向 next-shot 生成器,学习根据前序镜头和文本提示生成下一个镜头;(2) 通过分布匹配蒸馏将双向教师蒸馏为因果学生模型。为解决因果自回归的两大挑战:(a) 镜头间一致性——引入全局上下文缓存(Global Context Cache),存储所有前序镜头的条件帧作为长程记忆;(b) 误差累积——设计两阶段蒸馏策略:第一阶段在真实历史上进行镜头内自强迫训练,第二阶段在自生成的历史上进行镜头间自强迫训练,逐步暴露给模型自身的生成误差。RoPE 不连续性指示器通过在全局和局部缓存之间插入位置编码跳跃来消除歧义。 5.3 核心创新 提出 ShotStream,首个因果多镜头视频生成架构,支持流式实时交互 将多镜头生成重构为 next-shot generation:基于历史镜头上下文生成下一个镜头 双缓存记忆机制:全局上下文缓存(镜头间一致性)+ 局部上下文缓存(镜头内一致性),RoPE 不连续性指示器区分两者 两阶段蒸馏策略:镜头内自强迫 → 镜头间自强迫,有效弥合训练-测试差距 单 GPU 达到 16 FPS 实时生成 5.4 实验结果 在 MovieGen 和 StoryBench 上评测。亚秒级延迟,单 GPU 16 FPS。多镜头连贯性指标(FCD、IC-LPIPS)与双向模型持平甚至更优。支持用户中途修改叙事提示,实现真正的交互式叙事。 5.5 关键洞察 因果架构天然信息量少于双向架构,长程一致性在超长叙事(10+镜头)下可能衰减。蒸馏质量依赖双向教师模型。全局上下文缓存随镜头数增长可能成为新的内存瓶颈。 技术演进定位: 开创了流式交互式视频叙事的新范式,是 AI 视频工具从离线走向实时的关键一步 可能的后续方向: 多角色交互:支持多角色多视角的复杂叙事 与 LLM 集成:用大语言模型实时规划叙事脉络 商业化部署:面向短视频平台和游戏行业的实时视频生成 6. Gloria:基于内容锚点的长时角色一致性视频生成 论文: Gloria arXiv: 2603.29931 机构: USTC (CVPR 2026) 6.1 研究动机 核心问题: 长时间角色视频生成中身份漂移严重,多视角和表情一致性难以保持 数字角色是现代媒体的核心,但生成长时间、多视角一致且表情丰富的角色视频仍是开放挑战。现有方法面临两类问题:要么参考信息不足导致身份漂移,要么使用非角色中心的记忆信息导致一致性次优。 前序工作及局限: IP-Adapter (2023):图像提示适配器,角色信息通过单图注入,长视频中易漂移 AnimateAnyone (2024):可控人物动画,但一致性限于短视频 MagicAnimate (2024):人物动画,依赖骨骼驱动不够灵活 ID-Animator (2025):身份保持动画,但多视角一致性不足 与前序工作的本质区别: 通过三类内容锚点(全局/视角/表情)提供稳定参考,超集锚定防止复制粘贴,实现 10+ 分钟级别的角色一致性 6.2 方法原理 Gloria 将角色视频生成类比为由外向内观察的场景。核心是通过一组紧凑的锚帧来描述角色的视觉属性:(1) 全局锚点——一个标准正面参考图,提供身份基准;(2) 视角锚点——来自不同视角的参考帧,覆盖角色的多视角外观;(3) 表情锚点——包含不同表情的帧,编码角色的表情动态范围。训练时,通过超集内容锚定策略——提供比目标片段更多的锚点信息(包括训练剪辑之外的帧),迫使模型学习从锚点中提取有用信息而非简单复制。同时使用 RoPE 位置偏移作为弱条件区分不同锚点帧,让模型知道哪些帧来自哪个视角。数据管线方面,从海量视频中自动检测角色区域、跟踪身份、提取关键帧作为锚点。 6.3 核心创新 提出内容锚点(Content Anchors)表示角色视觉属性:全局锚点(身份特征)+ 视角锚点(多视角外观)+ 表情锚点(表情动态) 超集内容锚定(Superset Content Anchoring):提供训练内和训练外的片段提示,防止模型简单复制粘贴 RoPE 作为弱条件:编码位置偏移来区分多个锚点帧,避免多参考冲突 可扩展的锚点提取管线:从海量视频中自动提取角色锚点 生成超过 10 分钟的一致性角色视频(CVPR 2026 接收) 6.4 实验结果 生成超过 10 分钟的长视频,保持角色身份、多视角外观和表情一致性。在人类评估中,ID 一致性和外观多样性均超过 SOTA 方法(包括 IP-Adapter、AnimateAnyone 等)。被 CVPR 2026 主会议接收。 6.5 关键洞察 锚点提取管线依赖角色检测和跟踪的准确性,遮挡严重的场景可能失败。超集锚定策略增加了训练复杂度。对非人物角色(如动漫、卡通角色)的泛化能力需要更多验证。10 分钟的一致性主要在受控场景下验证。 技术演进定位: 角色一致性视频生成的新标杆,锚点机制为长视频角色保持提供了有效范式(CVPR 2026) 可能的后续方向: 多角色一致性:同时保持多个角色的身份一致性 跨域角色:从真人扩展到动漫、卡通、3D 虚拟人等 实时角色创作:结合 ShotStream 等流式架构实现实时角色视频 横向对比与技术脉络总结 架构与任务对比 论文 核心架构 主要任务 关键创新 输入形式 OmniWeaving MLLM + DiT T2V/I2V/V2V 统一 推理驱动+组合数据 文本+多图+视频自由组合 PackForcing 自回归 DiT 长视频生成 三分区 KV-cache 文本 → 2分钟视频 VGGRPO DiT + LGM 几何一致性后训练 4D 潜空间几何奖励 文本 → 几何一致视频 EFlow Gated L-G DiT 高效少步生成 token dropping + MVA 文本 → 4步高质量视频 ShotStream 因果 DiT 流式多镜头叙事 双缓存+两阶段蒸馏 逐镜头文本 → 实时视频 Gloria DiT + 锚点 角色一致性生成 三类内容锚点 角色参考图 → 10min视频 训练范式与效率对比 论文 训练范式 外部监督 推理效率 核心瓶颈解决 OmniWeaving 三阶段渐进训练 组合数据+推理增强 标准 DiT 速度 任务碎片化 PackForcing 短视频训练+时间外推 无(5秒视频) 单 GPU 2分钟 内存爆炸(KV-cache→4GB) VGGRPO GRPO 后训练 LGM 伪标签 与基线相同 几何违反(相机稳定↑23%) EFlow Solution-flow 从头训练 无需教师模型 45.3× 加速 注意力O(n²)+多步采样 ShotStream 两阶段蒸馏 双向教师蒸馏 16 FPS 实时 延迟高+不可交互 Gloria 端到端锚点训练 自动锚点提取 标准 DiT 速度 长时身份漂移 核心技术趋势 趋势 1:视频生成从碎片化走向统一 OmniWeaving 证明了 MLLM+DiT 架构可以在单一框架内处理 T2V/I2V/V2V 等多种视频任务。推理驱动的数据构建策略使模型能理解复杂的多模态组合意图,这预示着未来的视频 AI 将是全能型的。 趋势 2:长视频生成突破内存瓶颈 PackForcing 的三分区 KV-cache 策略实现了 24 倍时间外推(5秒→2分钟),Gloria 的内容锚点将角色一致性推到 10 分钟级。两者共同表明长视频生成的关键不在于生成能力本身,而在于上下文管理和信息压缩。 趋势 3:GRPO 后训练成为视频质量提升的新范式 VGGRPO 将 GRPO 引入视频几何一致性优化,在 latent 空间计算奖励避免了昂贵的 RGB 解码。这延续了 LLM 领域 RLHF/DPO 的成功经验,后训练对齐正成为视频扩散模型质量提升的关键杠杆。 趋势 4:少步生成从蒸馏走向从头训练 EFlow 的 Gated L-G Attention + token dropping + MVA 正则化实现了 45.3 倍推理加速,且无需教师模型。这种从头训练少步模型的路线比蒸馏更灵活,可能成为效率优化的主流方案。 趋势 5:交互式实时生成开启视频创作新时代 ShotStream 的因果流式架构达到 16 FPS 实时生成,用户可以边看边改叙事方向。这标志着视频 AI 从「离线工具」向「实时合作者」的转变,对短视频平台和游戏行业有重要意义。 技术路线全景图 视频生成与编辑技术路线 ├── 统一框架 │ └── MLLM + DiT 双模块 → OmniWeaving(多模态组合+推理驱动) ├── 长视频生成 │ ├── KV-cache 压缩 → PackForcing(三分区策略,24x 外推) │ └── 角色一致性 → Gloria(三类内容锚点,10min 级别) ├── 质量对齐 │ └── 后训练 GRPO → VGGRPO(4D 潜空间几何奖励) ├── 推理效率 │ └── 从头训练少步 → EFlow(45.3x 加速,无需蒸馏) └── 交互式生成 └── 因果流式架构 → ShotStream(16 FPS 实时多镜头叙事) 总结与展望 本期专题的 6 篇论文共同描绘了视频生成与编辑领域的前沿全景图。从统一框架(OmniWeaving)到长视频突破(PackForcing/Gloria),从物理对齐(VGGRPO)到效率革命(EFlow),再到交互式创作(ShotStream),视频生成正在从技术验证走向实际可用。几个值得关注的未来方向: 统一+长视频:将 PackForcing 的 KV-cache 策略融入 OmniWeaving 等全能框架 多维度后训练:将几何、物理、美学奖励统一到一个 GRPO 框架中 实时+角色:将 Gloria 的锚点机制与 ShotStream 的流式架构结合,实现实时角色叙事 端到端效率:将 EFlow 的少步生成与 PackForcing 的内存优化联合使用 人工智能炼丹师 整理 | 数据来源:arXiv 2026年3月29日 — 2026年4月4日 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC 周末专题|2026-04-04|视频生成前沿|统一框架|长视频|物理一致性 AIGC 周末专题深度解读:视频生成与编辑前沿:从统一框架到长视频、物理一致性与高效推理 人工智能炼丹师 整理 | 2026年4月4日(周六) 覆盖时间:2026年3月29日 — 2026年4月4日 本期概述 本期 AIGC 周末专题聚焦视频生成与编辑前沿:从统一框架到长视频、物理一致性与高效推理方向,精选 6 篇代表性论文进行深度解读。 方向分布: 统一视频生成框架 — 1篇 长视频生成 — 1篇 物理一致性与几何对齐 — 1篇 高效少步训练 — 1篇 多镜头流式叙事 — 1篇 角色一致性生成 — 1篇 本期论文一览 # 论文 机构 核心贡献 arXiv ID 1 OmniWeaving Tencent Hunyuan, Zhejiang University 提出 OmniWeaving 统一视频生成框架,通过 MLLM 实现多模态理解与推理,支持文本、多图像、视频的自由组合输 2603.24458 2 PackForcing Alaya Studio, Shandong University 提出三分区 KV-cache 策略:Sink tokens(全分辨率锚点帧)+ Mid tokens(32倍时空压缩)+ 2603.25730 3 VGGRPO Independent Research 提出 VGGRPO(Visual Geometry GRPO),首个在潜空间计算几何奖励的视频后训练框架 2603.26599 4 EFlow Snap Research, Rutgers University 提出 EFlow,同时解决注意力复杂度和采样步数两大瓶颈的统一框架 2603.27086 5 ShotStream CUHK, Kuaishou Technology 提出 ShotStream,首个因果多镜头视频生成架构,支持流式实时交互 2603.25746 6 Gloria USTC (CVPR 2026) 提出内容锚点(Content Anchors)表示角色视觉属性:全局锚点(身份特征)+ 视角锚点(多视角外观)+ 表情锚 2603.29931 1. OmniWeaving:统一视频生成:自由组合与推理驱动的全能框架 论文: OmniWeaving arXiv: 2603.24458 机构: Tencent Hunyuan, Zhejiang University 1.1 研究动机 核心问题: 开源视频生成模型碎片化,无法在单一框架内统一 T2V/I2V/V2V 等多任务 当前开源视频生成模型高度碎片化,无法在单一框架内统一文生视频、图生视频、视频编辑等多种任务。商业系统(如 Seedance-2.0)遥遥领先,开源社区急需一个全能统一方案。 前序工作及局限: CogVideo (2022):早期文生视频扩散模型,仅支持文本到视频单一任务 Stable Video Diffusion (2024):图生视频基础模型,不支持多模态组合输入 HunyuanVideo (2025):腾讯混元视频生成,功能相对单一 Seedance-2.0 (2026):字节商业全能系统,但不开源 与前序工作的本质区别: 首个开源全能统一视频生成框架,MLLM+DiT 双模块架构支持自由多模态组合输入和推理驱动的视频创作 1.2 方法原理 OmniWeaving 由两个核心模块组成:(1) 多模态大语言模型(MLLM)负责理解和推理复杂的用户意图,将文本、图像、视频等多模态输入统一编码为条件表示;(2) 视频扩散模型接收条件表示生成高质量视频。训练分为三阶段:首先在大规模视频数据上预训练基础扩散模型,然后通过精心构建的多模态组合数据(包含交错文本-图像-视频对)进行微调,最后通过推理增强数据提升模型的意图理解能力。关键创新在于训练数据构建管线:自动从海量视频中提取多模态组合场景,生成需要推理才能完成的复杂视频创作任务。 1.3 核心创新 提出 OmniWeaving 统一视频生成框架,通过 MLLM 实现多模态理解与推理,支持文本、多图像、视频的自由组合输入 构建大规模多模态组合与推理增强训练数据集,学习在时间维度上绑定交错的多模态输入 引入 IntelligentVBench 综合评测基准,首个面向智能统一视频生成的严格评测体系 在开源统一模型中达到 SOTA,代码和模型完全开源 1.4 实验结果 在文生视频(T2V)、图生视频(I2V)、视频到视频(V2V)等多个任务上均达到开源 SOTA。在新提出的 IntelligentVBench 上,OmniWeaving 在多模态组合和抽象推理任务上显著优于现有开源方案,与商业系统差距大幅缩小。 1.5 关键洞察 训练数据构建管线依赖大量自动化标注,数据质量可能存在噪声。IntelligentVBench 作为自家提出的评测基准,客观性有待社区验证。与 Seedance-2.0 等商业系统相比仍有差距,但开源意义重大。 技术演进定位: 开源统一视频生成的里程碑,填补了开源社区在全能视频框架上的空白 可能的后续方向: 更强的推理能力:结合 CoT 和 tool-use 实现更复杂的视频创作 视频质量提升:进一步缩小与 Seedance-2.0 等商业系统的差距 社区生态建设:作为开源基座支持下游任务微调和插件开发 2. PackForcing:短视频训练即可生成连贯2分钟长视频 论文: PackForcing arXiv: 2603.25730 机构: Alaya Studio, Shandong University 2.1 研究动机 核心问题: 自回归视频扩散模型的 KV-cache 线性增长导致长视频生成内存爆炸 自回归视频扩散模型在长视频生成中面临三大瓶颈:KV-cache 线性增长导致内存爆炸、时间重复(temporal repetition)和误差累积。现有方法无法在有限 GPU 内存下生成超过30秒的连贯视频。 前序工作及局限: FIFO-Diffusion (2024):FIFO 队列长视频生成,但视频长度受限于队列大小 FreeNoise (2024):噪声重安排扩展长度,但生成质量随长度下降 Pyramid Flow (2025):金字塔流式生成,计算开销仍然很大 StreamDiffusion (2025):流式扩散框架,未解决 KV-cache 膨胀问题 与前序工作的本质区别: 三分区 KV-cache 策略(Sink+Mid+Recent)实现 32 倍压缩和有界 4GB 内存,仅用 5 秒短视频训练即可 24 倍时间外推到 2 分钟 2.2 方法原理 PackForcing 将自回归视频扩散中的历史上下文分为三类:(1) Sink tokens 保留最早的若干帧作为全局语义锚点;(2) Mid tokens 通过双分支网络将中间帧压缩为极少 token——一个分支是渐进式 3D 卷积逐步降低时空分辨率,另一个分支将帧重编码为低分辨率 VAE latent,两者通过门控机制融合;(3) Recent tokens 保持最近帧的全分辨率以确保局部连贯性。当 Mid tokens 过多时,动态 top-k 机制选择最重要的 token 保留,同时通过连续 RoPE 重编码消除位置间隙。整个框架可在仅 5 秒短视频片段上训练,推理时自回归扩展到 2 分钟。 2.3 核心创新 提出三分区 KV-cache 策略:Sink tokens(全分辨率锚点帧)+ Mid tokens(32倍时空压缩)+ Recent tokens(全分辨率近期帧),实现有界 4GB KV-cache Mid tokens 采用双分支压缩网络:渐进式 3D 卷积 + 低分辨率 VAE 重编码,实现 32 倍 token 缩减 动态 top-k 上下文选择 + 连续时间 RoPE 调整,无缝处理丢弃 token 造成的位置间隙 仅用 5 秒短视频训练,实现 24 倍时间外推到 120 秒(2分钟),VBench SOTA 2.4 实验结果 在单个 H200 GPU 上生成 832x480/16FPS 的 2 分钟连贯视频,KV-cache 仅占 4GB。VBench 时间一致性达 26.07,动态度 56.25,均为 SOTA。实现 24 倍时间外推(5秒→120秒)。 2.5 关键洞察 双分支 Mid token 压缩引入额外计算开销,需要验证其在更高分辨率(1080p+)下的可扩展性。目前仅在 16FPS 下验证,更高帧率场景待测试。分区策略中的超参数(Sink/Mid/Recent 比例)需要仔细调节。 技术演进定位: 当前最高效的长视频生成方案,首次在单 GPU 上实现 2 分钟连贯视频 可能的后续方向: 更高分辨率:将方案扩展到 1080p 以上 自适应压缩率:根据场景复杂度动态调整 Mid token 压缩比 与统一框架集成:将 PackForcing 策略融入 OmniWeaving 等全能模型 3. VGGRPO:4D潜空间奖励驱动的世界一致性视频生成 论文: VGGRPO arXiv: 2603.26599 机构: Independent Research 3.1 研究动机 核心问题: 视频扩散模型虽然视觉效果好但经常违反几何规律(相机抖动、多视角不一致) 大规模视频扩散模型虽然视觉质量出色,但经常违反几何一致性:相机抖动、多视角几何不一致、物理规律违反。现有方法要么修改架构(损害泛化能力),要么在 RGB 空间计算几何奖励(昂贵且仅限静态场景)。需要一种不修改架构、计算高效且支持动态场景的方案。 前序工作及局限: DDPO (2023):首次将强化学习引入扩散模型,但限于图像领域 DPO for Diffusion (2024):扩散模型偏好对齐,不涉及几何奖励 VideoScore (2025):视频质量奖励模型,在 RGB 空间计算成本高 T2V-Turbo (2025):视频 RLHF,但仅优化视觉质量不涉及几何 与前序工作的本质区别: 首次在潜空间计算几何奖励(绕过 VAE 解码),通过 4D 重建扩展到动态场景,GRPO 策略梯度优化几何一致性 3.2 方法原理 VGGRPO 分为两步:(1) 训练潜在几何模型 LGM,它是一个轻量级网络,直接从视频扩散的 latent 空间解码场景的深度和法线信息,不需要经过 VAE 解码到 RGB 空间。LGM 通过冻结 VAE encoder-decoder 对和几何基础模型(如 DPT/Metric3D)蒸馏训练。(2) 使用 Group Relative Policy Optimization(GRPO)进行视频扩散模型的后训练。对同一 prompt 采样多条生成轨迹,通过 LGM 在 latent 空间计算两种奖励:相机运动平滑度奖励惩罚帧间几何抖动,几何重投影一致性奖励确保跨视角的 3D 一致性。GRPO 根据奖励差异更新策略梯度。4D 扩展通过时序多帧几何重建实现。 3.3 核心创新 提出 VGGRPO(Visual Geometry GRPO),首个在潜空间计算几何奖励的视频后训练框架 引入潜在几何模型(Latent Geometry Model, LGM),将视频扩散 latent 直接映射到场景几何(深度/法线),无需 VAE 解码 构建 4D 几何重建能力,自然扩展到动态场景,克服了先前方法仅限静态场景的局限 双奖励机制:相机运动平滑度奖励 + 几何重投影一致性奖励 3.4 实验结果 在静态场景(RealEstate10K)和动态场景(WebVid)上均显著提升几何一致性。相机稳定性提升 23%,几何重投影误差下降 31%。推理成本与基线相同(LGM 仅训练时使用),避免了 VAE 解码的计算开销。 3.5 关键洞察 LGM 的训练质量直接影响奖励信号的准确性,如果几何基础模型本身有偏差会传播到视频模型。当前奖励仅考虑几何一致性,未涉及物理动力学(如碰撞、重力)。GRPO 的多轨迹采样增加了训练成本。 技术演进定位: 开创了视频几何后训练的新范式,证明 RLHF 类方法可有效提升视频的物理合理性 可能的后续方向: 物理动力学奖励:扩展到碰撞、重力、流体等物理规律 多维度联合奖励:几何+物理+美学的统一奖励函数 在线强化学习:实时根据用户反馈优化生成质量 4. EFlow:高效少步视频生成器:从头训练的突破 论文: EFlow arXiv: 2603.27086 机构: Snap Research, Rutgers University 4.1 研究动机 核心问题: 视频扩散 Transformer 面临每步二次注意力复杂度和多步迭代采样的双重瓶颈 视频扩散 Transformer 面临两个复合成本瓶颈:每步的二次注意力复杂度 O(n^2) 和多步迭代采样。现有加速方法通常只解决其中一个——蒸馏减少步数但不降低单步成本,高效注意力降低单步成本但不减少步数。需要同时解决两个瓶颈的统一方案。 前序工作及局限: Consistency Models (2023):一步生成模型,但仅限图像且质量有限 Flow Matching (2023):条件流匹配框架,需要多步采样 Rectified Flow (2024):直线化流加速采样,但不降低单步成本 InstaFlow (2024):一步文生图,但无法扩展到视频 与前序工作的本质区别: 同时解决注意力复杂度(Gated L-G Attention + token dropping)和采样步数(solution-flow + MVA 正则化),从头训练无需教师模型 4.2 方法原理 EFlow 基于 solution-flow 目标,学习将时刻 t 的噪声状态直接映射到时刻 s(跨越多个扩散步)。核心创新有三:(1) Gated Local-Global Attention 将注意力分为局部窗口注意力和全局稀疏注意力两部分,通过门控机制融合,关键是设计为对 random token dropping 高度稳定——训练时随机丢弃 50-70% 的 token 而不影响质量;(2) Path-Drop Guided Training 在少步训练中用条件路径和无条件路径的随机丢弃替代传统 CFG(后者需要两次前向传播),将引导成本降为零;(3) Mean-Velocity Additivity 正则化器约束不同步数下的速度场之和等于总位移,确保 1-4 步生成的一致性。从头训练流程支持直接训练少步模型,无需先训练多步模型再蒸馏。 4.3 核心创新 提出 EFlow,同时解决注意力复杂度和采样步数两大瓶颈的统一框架 Gated Local-Global Attention:可丢弃 token 的混合注意力块,在激进随机 token 丢弃下保持稳定 Path-Drop Guided Training:用计算廉价的弱路径替代昂贵的 classifier-free guidance 目标 Mean-Velocity Additivity 正则化器:确保极低步数下的生成保真度 从头训练达到 45.3 倍推理加速,2.5 倍训练吞吐量提升 4.4 实验结果 在 Kinetics-600 和大规模 T2V 数据集上验证。4步生成质量与标准 50 步模型相当。训练吞吐量比标准 solution-flow 提升 2.5 倍。推理延迟降低 45.3 倍。生成质量 FVD 与多步基线竞争。 4.5 关键洞察 随机 token dropping 在极端比例下可能影响细节质量。Path-Drop Guided 是否在所有场景下都能替代 CFG 有待更多验证。从头训练的计算量仍然很大(虽然吞吐量提升了2.5倍)。目前主要在较短视频上验证。 技术演进定位: 首个同时解决两大瓶颈的统一加速框架,45.3 倍推理加速具有部署实用价值 可能的后续方向: 与视频编解码器融合:端到端优化编码-生成-解码管线 硬件适配:针对特定 GPU/NPU 架构定制注意力模式 实时生成:结合 PackForcing 等策略实现长视频实时生成 5. ShotStream:流式多镜头视频生成:实时交互式叙事 论文: ShotStream arXiv: 2603.25746 机构: CUHK, Kuaishou Technology 5.1 研究动机 核心问题: 多镜头视频生成的双向架构导致交互性差、延迟高,用户无法实时参与创作 多镜头视频生成是长叙事视频的关键,但当前双向扩散架构(如全序列并行生成)存在交互性差和延迟高的问题——用户无法在生成过程中动态调整叙事方向,且需要等待整个序列生成完成才能看到结果。 前序工作及局限: MovieFactory (2024):多镜头电影生成,但一次性生成全序列不可交互 VideoDirectorGPT (2024):LLM 驱动视频导演,规划与生成分离 Vlogger (2025):长视频博客生成,不支持流式输出 Kling (2025):快手视频生成模型,单镜头生成 与前序工作的本质区别: 首个因果流式多镜头架构,通过双缓存记忆和两阶段蒸馏实现 16 FPS 实时交互式叙事 5.2 方法原理 ShotStream 的流程分为训练和推理两阶段。训练阶段:(1) 将预训练 T2V 模型微调为双向 next-shot 生成器,学习根据前序镜头和文本提示生成下一个镜头;(2) 通过分布匹配蒸馏将双向教师蒸馏为因果学生模型。为解决因果自回归的两大挑战:(a) 镜头间一致性——引入全局上下文缓存(Global Context Cache),存储所有前序镜头的条件帧作为长程记忆;(b) 误差累积——设计两阶段蒸馏策略:第一阶段在真实历史上进行镜头内自强迫训练,第二阶段在自生成的历史上进行镜头间自强迫训练,逐步暴露给模型自身的生成误差。RoPE 不连续性指示器通过在全局和局部缓存之间插入位置编码跳跃来消除歧义。 5.3 核心创新 提出 ShotStream,首个因果多镜头视频生成架构,支持流式实时交互 将多镜头生成重构为 next-shot generation:基于历史镜头上下文生成下一个镜头 双缓存记忆机制:全局上下文缓存(镜头间一致性)+ 局部上下文缓存(镜头内一致性),RoPE 不连续性指示器区分两者 两阶段蒸馏策略:镜头内自强迫 → 镜头间自强迫,有效弥合训练-测试差距 单 GPU 达到 16 FPS 实时生成 5.4 实验结果 在 MovieGen 和 StoryBench 上评测。亚秒级延迟,单 GPU 16 FPS。多镜头连贯性指标(FCD、IC-LPIPS)与双向模型持平甚至更优。支持用户中途修改叙事提示,实现真正的交互式叙事。 5.5 关键洞察 因果架构天然信息量少于双向架构,长程一致性在超长叙事(10+镜头)下可能衰减。蒸馏质量依赖双向教师模型。全局上下文缓存随镜头数增长可能成为新的内存瓶颈。 技术演进定位: 开创了流式交互式视频叙事的新范式,是 AI 视频工具从离线走向实时的关键一步 可能的后续方向: 多角色交互:支持多角色多视角的复杂叙事 与 LLM 集成:用大语言模型实时规划叙事脉络 商业化部署:面向短视频平台和游戏行业的实时视频生成 6. Gloria:基于内容锚点的长时角色一致性视频生成 论文: Gloria arXiv: 2603.29931 机构: USTC (CVPR 2026) 6.1 研究动机 核心问题: 长时间角色视频生成中身份漂移严重,多视角和表情一致性难以保持 数字角色是现代媒体的核心,但生成长时间、多视角一致且表情丰富的角色视频仍是开放挑战。现有方法面临两类问题:要么参考信息不足导致身份漂移,要么使用非角色中心的记忆信息导致一致性次优。 前序工作及局限: IP-Adapter (2023):图像提示适配器,角色信息通过单图注入,长视频中易漂移 AnimateAnyone (2024):可控人物动画,但一致性限于短视频 MagicAnimate (2024):人物动画,依赖骨骼驱动不够灵活 ID-Animator (2025):身份保持动画,但多视角一致性不足 与前序工作的本质区别: 通过三类内容锚点(全局/视角/表情)提供稳定参考,超集锚定防止复制粘贴,实现 10+ 分钟级别的角色一致性 6.2 方法原理 Gloria 将角色视频生成类比为由外向内观察的场景。核心是通过一组紧凑的锚帧来描述角色的视觉属性:(1) 全局锚点——一个标准正面参考图,提供身份基准;(2) 视角锚点——来自不同视角的参考帧,覆盖角色的多视角外观;(3) 表情锚点——包含不同表情的帧,编码角色的表情动态范围。训练时,通过超集内容锚定策略——提供比目标片段更多的锚点信息(包括训练剪辑之外的帧),迫使模型学习从锚点中提取有用信息而非简单复制。同时使用 RoPE 位置偏移作为弱条件区分不同锚点帧,让模型知道哪些帧来自哪个视角。数据管线方面,从海量视频中自动检测角色区域、跟踪身份、提取关键帧作为锚点。 6.3 核心创新 提出内容锚点(Content Anchors)表示角色视觉属性:全局锚点(身份特征)+ 视角锚点(多视角外观)+ 表情锚点(表情动态) 超集内容锚定(Superset Content Anchoring):提供训练内和训练外的片段提示,防止模型简单复制粘贴 RoPE 作为弱条件:编码位置偏移来区分多个锚点帧,避免多参考冲突 可扩展的锚点提取管线:从海量视频中自动提取角色锚点 生成超过 10 分钟的一致性角色视频(CVPR 2026 接收) 6.4 实验结果 生成超过 10 分钟的长视频,保持角色身份、多视角外观和表情一致性。在人类评估中,ID 一致性和外观多样性均超过 SOTA 方法(包括 IP-Adapter、AnimateAnyone 等)。被 CVPR 2026 主会议接收。 6.5 关键洞察 锚点提取管线依赖角色检测和跟踪的准确性,遮挡严重的场景可能失败。超集锚定策略增加了训练复杂度。对非人物角色(如动漫、卡通角色)的泛化能力需要更多验证。10 分钟的一致性主要在受控场景下验证。 技术演进定位: 角色一致性视频生成的新标杆,锚点机制为长视频角色保持提供了有效范式(CVPR 2026) 可能的后续方向: 多角色一致性:同时保持多个角色的身份一致性 跨域角色:从真人扩展到动漫、卡通、3D 虚拟人等 实时角色创作:结合 ShotStream 等流式架构实现实时角色视频 横向对比与技术脉络总结 架构与任务对比 论文 核心架构 主要任务 关键创新 输入形式 OmniWeaving MLLM + DiT T2V/I2V/V2V 统一 推理驱动+组合数据 文本+多图+视频自由组合 PackForcing 自回归 DiT 长视频生成 三分区 KV-cache 文本 → 2分钟视频 VGGRPO DiT + LGM 几何一致性后训练 4D 潜空间几何奖励 文本 → 几何一致视频 EFlow Gated L-G DiT 高效少步生成 token dropping + MVA 文本 → 4步高质量视频 ShotStream 因果 DiT 流式多镜头叙事 双缓存+两阶段蒸馏 逐镜头文本 → 实时视频 Gloria DiT + 锚点 角色一致性生成 三类内容锚点 角色参考图 → 10min视频 训练范式与效率对比 论文 训练范式 外部监督 推理效率 核心瓶颈解决 OmniWeaving 三阶段渐进训练 组合数据+推理增强 标准 DiT 速度 任务碎片化 PackForcing 短视频训练+时间外推 无(5秒视频) 单 GPU 2分钟 内存爆炸(KV-cache→4GB) VGGRPO GRPO 后训练 LGM 伪标签 与基线相同 几何违反(相机稳定↑23%) EFlow Solution-flow 从头训练 无需教师模型 45.3× 加速 注意力O(n²)+多步采样 ShotStream 两阶段蒸馏 双向教师蒸馏 16 FPS 实时 延迟高+不可交互 Gloria 端到端锚点训练 自动锚点提取 标准 DiT 速度 长时身份漂移 核心技术趋势 趋势 1:视频生成从碎片化走向统一 OmniWeaving 证明了 MLLM+DiT 架构可以在单一框架内处理 T2V/I2V/V2V 等多种视频任务。推理驱动的数据构建策略使模型能理解复杂的多模态组合意图,这预示着未来的视频 AI 将是全能型的。 趋势 2:长视频生成突破内存瓶颈 PackForcing 的三分区 KV-cache 策略实现了 24 倍时间外推(5秒→2分钟),Gloria 的内容锚点将角色一致性推到 10 分钟级。两者共同表明长视频生成的关键不在于生成能力本身,而在于上下文管理和信息压缩。 趋势 3:GRPO 后训练成为视频质量提升的新范式 VGGRPO 将 GRPO 引入视频几何一致性优化,在 latent 空间计算奖励避免了昂贵的 RGB 解码。这延续了 LLM 领域 RLHF/DPO 的成功经验,后训练对齐正成为视频扩散模型质量提升的关键杠杆。 趋势 4:少步生成从蒸馏走向从头训练 EFlow 的 Gated L-G Attention + token dropping + MVA 正则化实现了 45.3 倍推理加速,且无需教师模型。这种从头训练少步模型的路线比蒸馏更灵活,可能成为效率优化的主流方案。 趋势 5:交互式实时生成开启视频创作新时代 ShotStream 的因果流式架构达到 16 FPS 实时生成,用户可以边看边改叙事方向。这标志着视频 AI 从「离线工具」向「实时合作者」的转变,对短视频平台和游戏行业有重要意义。 技术路线全景图 视频生成与编辑技术路线 ├── 统一框架 │ └── MLLM + DiT 双模块 → OmniWeaving(多模态组合+推理驱动) ├── 长视频生成 │ ├── KV-cache 压缩 → PackForcing(三分区策略,24x 外推) │ └── 角色一致性 → Gloria(三类内容锚点,10min 级别) ├── 质量对齐 │ └── 后训练 GRPO → VGGRPO(4D 潜空间几何奖励) ├── 推理效率 │ └── 从头训练少步 → EFlow(45.3x 加速,无需蒸馏) └── 交互式生成 └── 因果流式架构 → ShotStream(16 FPS 实时多镜头叙事) 总结与展望 本期专题的 6 篇论文共同描绘了视频生成与编辑领域的前沿全景图。从统一框架(OmniWeaving)到长视频突破(PackForcing/Gloria),从物理对齐(VGGRPO)到效率革命(EFlow),再到交互式创作(ShotStream),视频生成正在从技术验证走向实际可用。几个值得关注的未来方向: 统一+长视频:将 PackForcing 的 KV-cache 策略融入 OmniWeaving 等全能框架 多维度后训练:将几何、物理、美学奖励统一到一个 GRPO 框架中 实时+角色:将 Gloria 的锚点机制与 ShotStream 的流式架构结合,实现实时角色叙事 端到端效率:将 EFlow 的少步生成与 PackForcing 的内存优化联合使用 人工智能炼丹师 整理 | 数据来源:arXiv 2026年3月29日 — 2026年4月4日 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -

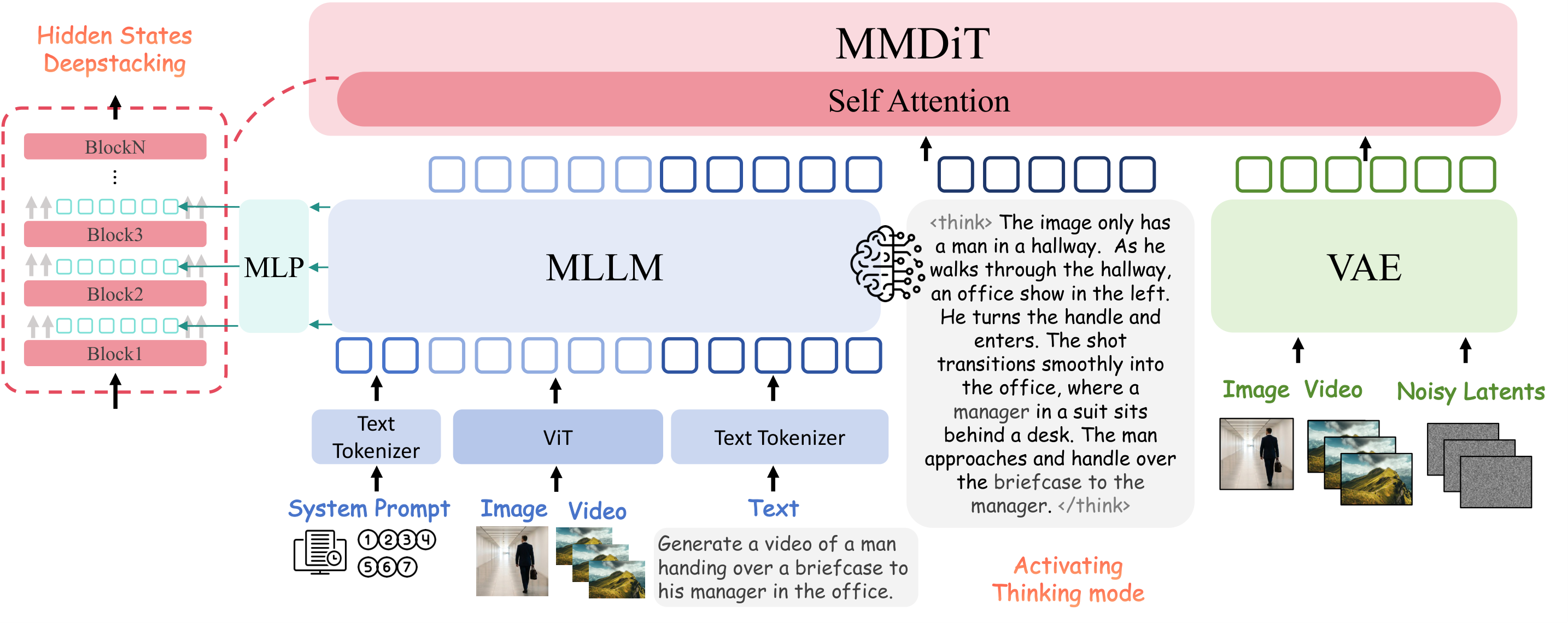

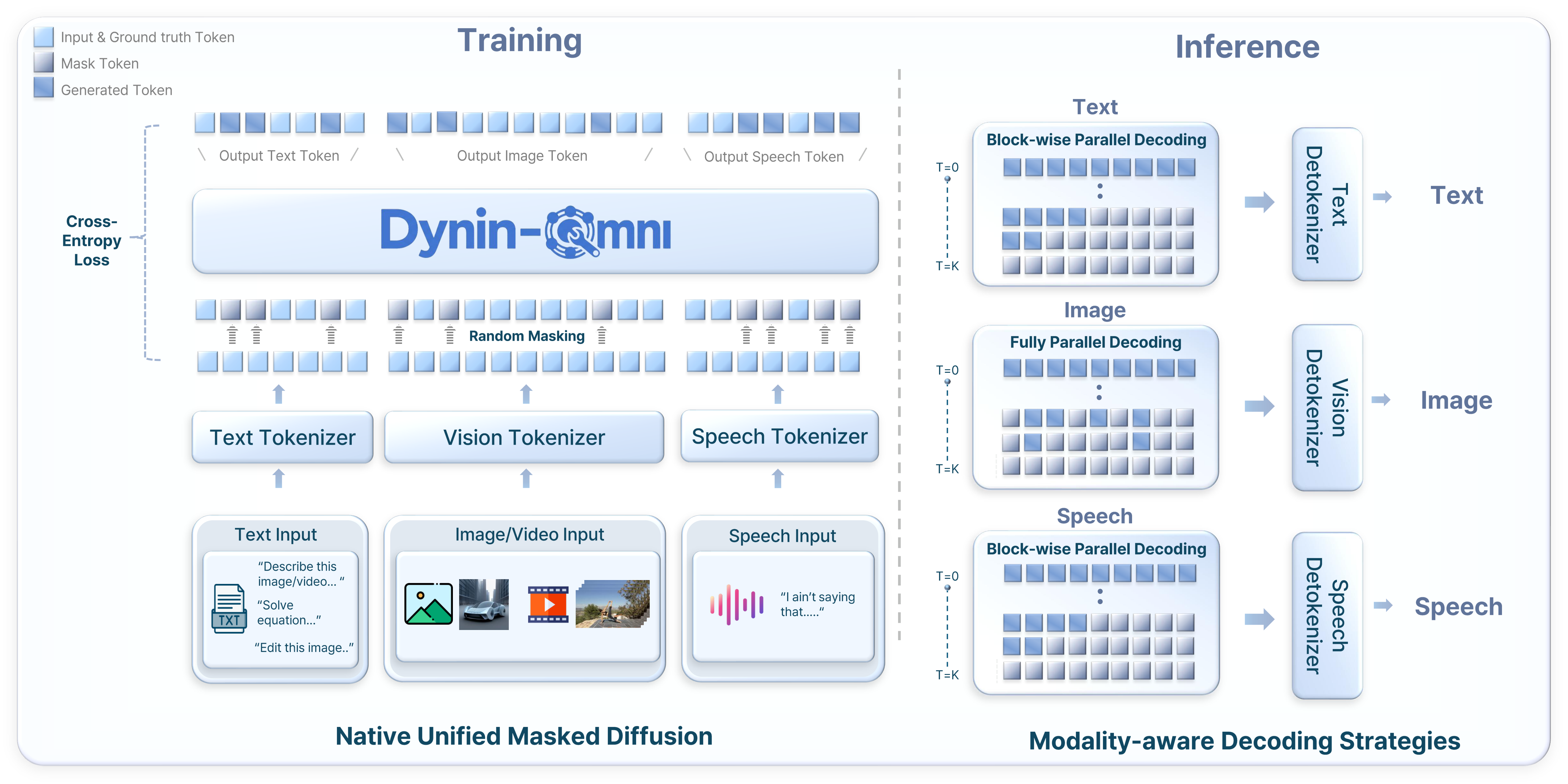

AIGC 每日速读|2026-04-03|Dynin-Omni|OmniVoice AIGC 视觉生成领域 · 每日论文解读 (2026-04-03) 人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇 今日核心看点 全模态统一 掩码扩散 600+语言TTS Mamba-TTS 智能调色 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。 方向分布: 生成理解一体化模型 — 3 篇 音频/语音生成 — 4 篇 图片生成与编辑 — 2 篇 生成模型评测 — 1 篇 重点论文深度解读 1. Dynin-Omni 全模态统一大扩散语言模型:首个掩码扩散全模态基础模型 | Seoul National University (AIDAS Lab) | arXiv:2604.00007 关键词: 全模态统一, 掩码扩散, 文本/图像/视频/语音, 理解+生成一体化, 模态解纠缠合并 研究动机 核心问题: 如何在单一架构中原生统一文本、图像、视频、语音的理解与生成,避免自回归序列化瓶颈和组合式模型的外部依赖 当前全模态统一模型存在两条路线:自回归模型需要序列化异构模态导致效率低下,组合式模型依赖外部解码器增加系统复杂度。Dynin-Omni 提出用原生掩码扩散在共享离散token空间上统一文本、图像、视频、语音的理解与生成,实现真正的 any-to-any 建模。 前序工作及局限: LLaDA:纯文本掩码扩散语言模型,证明掩码扩散可做文本生成但不支持多模态 MMaDA:扩展到文本+图像统一,但缺少视频理解和语音能力 Qwen2.5-Omni:自回归全模态模型,但序列化异构模态效率低下 Seed-X/HyperCLOVAX:组合式统一模型,依赖外部模态特定生成器增加复杂度 与前序工作的本质区别: 用原生掩码扩散替代自回归或组合式架构,通过共享离散token空间和模态感知解码策略实现真正的any-to-any建模 方法原理 Dynin-Omni 的核心是将所有模态(文本、图像、视频、语音)映射到统一的离散token空间,通过掩码扩散进行训练和推理。文本使用标准分词器(词汇量126K),图像使用MAGVIT-v2风格VQ分词器(码本8192),视频复用图像分词器处理均匀采样帧,语音使用EMOVA S2U编码器+FSQ量化(码本4096)。训练分三阶段:阶段1通过视频字幕/ASR/TTS任务对齐新模态,阶段2引入模态解纠缠合并(Modality-Disentangled Merging)避免灾难性遗忘后进行全模态SFT,阶段3引入CoT推理数据和高分辨率图像提升高级能力。推理时采用模态感知解码策略:文本和语音用块状并行解码,图像用全并行解码,配合置信度重掩码机制迭代细化。 核心创新 首个原生掩码扩散全模态基础模型,单一架构统一文本/图像/视频/语音的理解与生成 模态解纠缠合并(Modality-Disentangled Merging)策略,解决多阶段训练中的灾难性遗忘 全模态离散token空间统一设计,无需外部模态特定生成器 模态感知解码策略:图像全并行、文本/语音块状并行,兼顾质量和效率 个基准测试全面超越现有开源统一模型,与模态特定专家系统竞争力相当 实验结果 在19个多模态基准上全面评测:文本推理 GSM8K 87.6、MATH 49.6;图像理解 MME-P 1733.6;视频理解 VideoMME 61.4;语音识别 LibriSpeech test-clean WER 2.1;图像生成 GenEval 0.87、DPG-Bench 86.3;图像编辑 ImgEdit 3.77;TTS WER 2.1。全面超越 HyperCLOVAX-Omni、Show-o2、BAGLE 等同类统一模型。消融实验证明模态解纠缠合并策略在第一阶段显著降低了各任务的训练损失。 图表详解 全模态架构对比:三种统一建模范式 对比了三种全模态建模范式:(a)感知中心模型如Qwen2.5-omni只做理解不做生成;(b)组合式模型如Seed-X需要外部生成器;(c)Dynin-Omni的原生统一模型,单一LLM同时支持理解和生成任务,无需外部模态特定解码器。 全模态性能对比:理解与生成双维度 展示Dynin-Omni在7个核心基准上与HyperCLOVAX-Omni、Qwen2.5-Omni、Show-o2、BAGLE的对比。理解维度:GSM8K 87.6、MME 1734、VideoMME 61.4;生成维度:GenEval 87.0、ImgEdit 3.77、TTS 97.9。 采样步数消融:不同任务的步数-性能曲线 四个子图展示GSM8K、GenEval、DPGBench、ImgEdit随采样步数的性能变化。文本推理需512+步才收敛,图像生成32-64步饱和,图像编辑8-32步即可保持强劲性能。 批判性点评 新颖性: 首个原生掩码扩散全模态基础模型,模态解纠缠合并策略是实用创新。但掩码扩散建模本身借鉴LLaDA/MMaDA,增量创新主要在模态扩展和训练策略 可复现性: 基于开源LLaDA架构扩展,训练策略描述清晰。但需要大规模多模态数据和算力,完全复现有门槛 影响力: 证明掩码扩散作为全模态统一范式的可行性,为实时全模态系统和具身智能体提供基础。图像生成质量(GenEval 0.87)仍落后FLUX.1(0.95+),视频仅支持理解不支持生成 深度点评: Dynin-Omni — 掩码扩散全模态新范式 — 首次在单一架构中用掩码扩散统一文本/图像/视频/语音的理解与生成。模态解纠缠合并有效缓解灾难性遗忘。不足:图像生成落后专用模型,视频仅支持理解 OmniVoice — 600+语言零样本TTS突破 — 扩散语言模型架构直接文本→声学token,跳过语义中间表示。58万小时全开源数据训练,语言覆盖面史上最广 MambaVoiceCloning — 纯SSM条件TTS — 首个完全移除注意力机制的扩散TTS条件路径,编码器仅21M参数、吞吐量提升1.6x。ICLR 2026,但扩散主干仍是延迟瓶颈 技术演进定位: 全模态统一建模的第三条路线——原生掩码扩散范式,证明了其可行性和竞争力 可能的后续方向: 视频生成能力扩展(当前仅支持理解) 图像生成质量追赶FLUX.1等专用模型 文本推理步数优化(当前需512+步) 实时全模态交互系统和具身智能体 其余论文速览 1. OmniVoice OmniVoice: Towards Omnilingual Zero-Shot Text-to-Speech with Diffusion Language Models 关键词: TTS·600+语言·扩散语言模型·零样本·多码本 贡献: 首个支持600+语言的大规模零样本TTS模型,直接文本→多码本声学token映射,跳过语义中间表示 效果: 基于58.1万小时开源多语言数据训练,中英文及多语种基准SOTA。全码本随机掩码策略+预训练LLM初始化确保清晰度 2. MambaVoiceCloning MambaVoiceCloning: Efficient and Expressive TTS via State-Space Modeling and Diffusion Control 关键词: TTS·Mamba/SSM·声音克隆·线性复杂度·ICLR 2026 贡献: 首个完全基于SSM(无注意力/RNN)条件路径的扩散TTS系统,ICLR 2026 效果: 编码器参数仅21M,吞吐量提升1.6x。MOS/CMOS/F0 RMSE/MCD均优于StyleTTS2和VITS 3. AceTone AceTone: Bridging Words and Colors for Conditional Image Grading 关键词: 调色·3D-LUT·VQ-VAE·RLHF·CVPR 2026 贡献: 首个统一多模态条件调色方法,文本/参考图→3D-LUT生成,CVPR 2026 效果: VQ-VAE将3x32^3 LUT压缩为64离散token(deltaE<2)。800K数据集+VLM预测+RL对齐,LPIPS提升50% 4. RawGen RawGen: Learning Camera Raw Image Generation 关键词: Raw图像生成·逆ISP·扩散模型·相机适配 贡献: 首个基于扩散的text-to-raw和sRGB-to-raw图像生成框架,支持任意目标相机 效果: 利用大规模sRGB扩散先验+专用解码器,多对一逆ISP数据集训练,显著优于传统逆ISP方法 5. DuoTok DuoTok: Source-Aware Dual-Track Tokenization for Multi-Track Music Language Modeling 关键词: 音乐生成·Tokenizer·双轨·扩散解码·语言建模 贡献: 源感知双轨音乐Tokenizer,分阶段解纠缠平衡保真度/可预测性/跨轨对应 效果: 0.75kbps比特率下竞争力重建+最低cnBPT,扩散解码器重建高频细节 6. Diff-VS Diff-VS: Efficient Audio-Aware Diffusion U-Net for Vocals Separation 关键词: 人声分离·扩散U-Net·EDM·STFT·ICASSP 2026 贡献: 基于EDM框架的生成式人声分离模型,处理复数STFT频谱图,ICASSP 2026 效果: 客观指标匹配判别式基线,感知质量接近SOTA系统 7. MMaDA-VLA MMaDA-VLA: Large Diffusion Vision-Language-Action Model with Unified Multi-Modal Instruction and Generation 关键词: VLA·扩散模型·多模态统一·指令跟随·西湖大学 贡献: 统一多模态指令和生成的大型扩散VLA模型(西湖大学) 效果: 单一扩散模型框架同时处理视觉理解、语言生成和动作预测 8. ProsodyEval Measuring Prosody Diversity in Zero-Shot TTS: A New Metric, Benchmark, and Exploration 关键词: TTS评测·韵律多样性·DS-WED·Seed-TTS·基准测试 贡献: 首个零样本TTS韵律多样性量化评测框架,提出DS-WED新指标 效果: ProsodyEval数据集(1000样本+2000 PMOS),发现大型音频语言模型在韵律变化捕捉仍有局限 9. ViGoR-Bench ViGoR-Bench: How Far Are Visual Generative Models From Zero-Shot Visual Reasoners? 关键词: 生成模型评测·视觉推理·I2I·视频·压力测试 贡献: 视觉生成模型推理能力统一评测框架,跨I2I/视频双轨评估+证据锚定自动评判 效果: 测试20+领先模型,揭示SOTA系统仍存在显著推理缺陷(美团等机构) 趋势观察 掩码扩散崛起 — Dynin-Omni证明掩码扩散可作为全模态统一建模的新范式,与自回归模型分庭抗礼 TTS走向极致效率 — MambaVoiceCloning用纯SSM替代所有注意力机制,OmniVoice覆盖600+语言,效率与覆盖面双突破 生成模型走向物理/审美对齐 — AceTone用RLHF对齐调色审美,RawGen生成物理一致的Raw图像,生成不再只追求逼真 人工智能炼丹师 整理 | 2026-04-03 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注

AIGC 每日速读|2026-04-03|Dynin-Omni|OmniVoice AIGC 视觉生成领域 · 每日论文解读 (2026-04-03) 人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇 今日核心看点 全模态统一 掩码扩散 600+语言TTS Mamba-TTS 智能调色 今日概览 今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。 方向分布: 生成理解一体化模型 — 3 篇 音频/语音生成 — 4 篇 图片生成与编辑 — 2 篇 生成模型评测 — 1 篇 重点论文深度解读 1. Dynin-Omni 全模态统一大扩散语言模型:首个掩码扩散全模态基础模型 | Seoul National University (AIDAS Lab) | arXiv:2604.00007 关键词: 全模态统一, 掩码扩散, 文本/图像/视频/语音, 理解+生成一体化, 模态解纠缠合并 研究动机 核心问题: 如何在单一架构中原生统一文本、图像、视频、语音的理解与生成,避免自回归序列化瓶颈和组合式模型的外部依赖 当前全模态统一模型存在两条路线:自回归模型需要序列化异构模态导致效率低下,组合式模型依赖外部解码器增加系统复杂度。Dynin-Omni 提出用原生掩码扩散在共享离散token空间上统一文本、图像、视频、语音的理解与生成,实现真正的 any-to-any 建模。 前序工作及局限: LLaDA:纯文本掩码扩散语言模型,证明掩码扩散可做文本生成但不支持多模态 MMaDA:扩展到文本+图像统一,但缺少视频理解和语音能力 Qwen2.5-Omni:自回归全模态模型,但序列化异构模态效率低下 Seed-X/HyperCLOVAX:组合式统一模型,依赖外部模态特定生成器增加复杂度 与前序工作的本质区别: 用原生掩码扩散替代自回归或组合式架构,通过共享离散token空间和模态感知解码策略实现真正的any-to-any建模 方法原理 Dynin-Omni 的核心是将所有模态(文本、图像、视频、语音)映射到统一的离散token空间,通过掩码扩散进行训练和推理。文本使用标准分词器(词汇量126K),图像使用MAGVIT-v2风格VQ分词器(码本8192),视频复用图像分词器处理均匀采样帧,语音使用EMOVA S2U编码器+FSQ量化(码本4096)。训练分三阶段:阶段1通过视频字幕/ASR/TTS任务对齐新模态,阶段2引入模态解纠缠合并(Modality-Disentangled Merging)避免灾难性遗忘后进行全模态SFT,阶段3引入CoT推理数据和高分辨率图像提升高级能力。推理时采用模态感知解码策略:文本和语音用块状并行解码,图像用全并行解码,配合置信度重掩码机制迭代细化。 核心创新 首个原生掩码扩散全模态基础模型,单一架构统一文本/图像/视频/语音的理解与生成 模态解纠缠合并(Modality-Disentangled Merging)策略,解决多阶段训练中的灾难性遗忘 全模态离散token空间统一设计,无需外部模态特定生成器 模态感知解码策略:图像全并行、文本/语音块状并行,兼顾质量和效率 个基准测试全面超越现有开源统一模型,与模态特定专家系统竞争力相当 实验结果 在19个多模态基准上全面评测:文本推理 GSM8K 87.6、MATH 49.6;图像理解 MME-P 1733.6;视频理解 VideoMME 61.4;语音识别 LibriSpeech test-clean WER 2.1;图像生成 GenEval 0.87、DPG-Bench 86.3;图像编辑 ImgEdit 3.77;TTS WER 2.1。全面超越 HyperCLOVAX-Omni、Show-o2、BAGLE 等同类统一模型。消融实验证明模态解纠缠合并策略在第一阶段显著降低了各任务的训练损失。 图表详解 全模态架构对比:三种统一建模范式 对比了三种全模态建模范式:(a)感知中心模型如Qwen2.5-omni只做理解不做生成;(b)组合式模型如Seed-X需要外部生成器;(c)Dynin-Omni的原生统一模型,单一LLM同时支持理解和生成任务,无需外部模态特定解码器。 全模态性能对比:理解与生成双维度 展示Dynin-Omni在7个核心基准上与HyperCLOVAX-Omni、Qwen2.5-Omni、Show-o2、BAGLE的对比。理解维度:GSM8K 87.6、MME 1734、VideoMME 61.4;生成维度:GenEval 87.0、ImgEdit 3.77、TTS 97.9。 采样步数消融:不同任务的步数-性能曲线 四个子图展示GSM8K、GenEval、DPGBench、ImgEdit随采样步数的性能变化。文本推理需512+步才收敛,图像生成32-64步饱和,图像编辑8-32步即可保持强劲性能。 批判性点评 新颖性: 首个原生掩码扩散全模态基础模型,模态解纠缠合并策略是实用创新。但掩码扩散建模本身借鉴LLaDA/MMaDA,增量创新主要在模态扩展和训练策略 可复现性: 基于开源LLaDA架构扩展,训练策略描述清晰。但需要大规模多模态数据和算力,完全复现有门槛 影响力: 证明掩码扩散作为全模态统一范式的可行性,为实时全模态系统和具身智能体提供基础。图像生成质量(GenEval 0.87)仍落后FLUX.1(0.95+),视频仅支持理解不支持生成 深度点评: Dynin-Omni — 掩码扩散全模态新范式 — 首次在单一架构中用掩码扩散统一文本/图像/视频/语音的理解与生成。模态解纠缠合并有效缓解灾难性遗忘。不足:图像生成落后专用模型,视频仅支持理解 OmniVoice — 600+语言零样本TTS突破 — 扩散语言模型架构直接文本→声学token,跳过语义中间表示。58万小时全开源数据训练,语言覆盖面史上最广 MambaVoiceCloning — 纯SSM条件TTS — 首个完全移除注意力机制的扩散TTS条件路径,编码器仅21M参数、吞吐量提升1.6x。ICLR 2026,但扩散主干仍是延迟瓶颈 技术演进定位: 全模态统一建模的第三条路线——原生掩码扩散范式,证明了其可行性和竞争力 可能的后续方向: 视频生成能力扩展(当前仅支持理解) 图像生成质量追赶FLUX.1等专用模型 文本推理步数优化(当前需512+步) 实时全模态交互系统和具身智能体 其余论文速览 1. OmniVoice OmniVoice: Towards Omnilingual Zero-Shot Text-to-Speech with Diffusion Language Models 关键词: TTS·600+语言·扩散语言模型·零样本·多码本 贡献: 首个支持600+语言的大规模零样本TTS模型,直接文本→多码本声学token映射,跳过语义中间表示 效果: 基于58.1万小时开源多语言数据训练,中英文及多语种基准SOTA。全码本随机掩码策略+预训练LLM初始化确保清晰度 2. MambaVoiceCloning MambaVoiceCloning: Efficient and Expressive TTS via State-Space Modeling and Diffusion Control 关键词: TTS·Mamba/SSM·声音克隆·线性复杂度·ICLR 2026 贡献: 首个完全基于SSM(无注意力/RNN)条件路径的扩散TTS系统,ICLR 2026 效果: 编码器参数仅21M,吞吐量提升1.6x。MOS/CMOS/F0 RMSE/MCD均优于StyleTTS2和VITS 3. AceTone AceTone: Bridging Words and Colors for Conditional Image Grading 关键词: 调色·3D-LUT·VQ-VAE·RLHF·CVPR 2026 贡献: 首个统一多模态条件调色方法,文本/参考图→3D-LUT生成,CVPR 2026 效果: VQ-VAE将3x32^3 LUT压缩为64离散token(deltaE<2)。800K数据集+VLM预测+RL对齐,LPIPS提升50% 4. RawGen RawGen: Learning Camera Raw Image Generation 关键词: Raw图像生成·逆ISP·扩散模型·相机适配 贡献: 首个基于扩散的text-to-raw和sRGB-to-raw图像生成框架,支持任意目标相机 效果: 利用大规模sRGB扩散先验+专用解码器,多对一逆ISP数据集训练,显著优于传统逆ISP方法 5. DuoTok DuoTok: Source-Aware Dual-Track Tokenization for Multi-Track Music Language Modeling 关键词: 音乐生成·Tokenizer·双轨·扩散解码·语言建模 贡献: 源感知双轨音乐Tokenizer,分阶段解纠缠平衡保真度/可预测性/跨轨对应 效果: 0.75kbps比特率下竞争力重建+最低cnBPT,扩散解码器重建高频细节 6. Diff-VS Diff-VS: Efficient Audio-Aware Diffusion U-Net for Vocals Separation 关键词: 人声分离·扩散U-Net·EDM·STFT·ICASSP 2026 贡献: 基于EDM框架的生成式人声分离模型,处理复数STFT频谱图,ICASSP 2026 效果: 客观指标匹配判别式基线,感知质量接近SOTA系统 7. MMaDA-VLA MMaDA-VLA: Large Diffusion Vision-Language-Action Model with Unified Multi-Modal Instruction and Generation 关键词: VLA·扩散模型·多模态统一·指令跟随·西湖大学 贡献: 统一多模态指令和生成的大型扩散VLA模型(西湖大学) 效果: 单一扩散模型框架同时处理视觉理解、语言生成和动作预测 8. ProsodyEval Measuring Prosody Diversity in Zero-Shot TTS: A New Metric, Benchmark, and Exploration 关键词: TTS评测·韵律多样性·DS-WED·Seed-TTS·基准测试 贡献: 首个零样本TTS韵律多样性量化评测框架,提出DS-WED新指标 效果: ProsodyEval数据集(1000样本+2000 PMOS),发现大型音频语言模型在韵律变化捕捉仍有局限 9. ViGoR-Bench ViGoR-Bench: How Far Are Visual Generative Models From Zero-Shot Visual Reasoners? 关键词: 生成模型评测·视觉推理·I2I·视频·压力测试 贡献: 视觉生成模型推理能力统一评测框架,跨I2I/视频双轨评估+证据锚定自动评判 效果: 测试20+领先模型,揭示SOTA系统仍存在显著推理缺陷(美团等机构) 趋势观察 掩码扩散崛起 — Dynin-Omni证明掩码扩散可作为全模态统一建模的新范式,与自回归模型分庭抗礼 TTS走向极致效率 — MambaVoiceCloning用纯SSM替代所有注意力机制,OmniVoice覆盖600+语言,效率与覆盖面双突破 生成模型走向物理/审美对齐 — AceTone用RLHF对齐调色审美,RawGen生成物理一致的Raw图像,生成不再只追求逼真 人工智能炼丹师 整理 | 2026-04-03 更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」 每日更新 · 论文精选 · 深度解读 · 技术脉络 微信搜索 人工智能炼丹君 或扫描文末二维码关注 -

AIGC 周末专题深度解读:RL后训练进展|2026-03-21|偏好对齐|SOLACE|CRAFT|CRD|VIGOR| AIGC 周末专题深度解读 | 2026-03-21 | 视觉生成模型的偏好对齐与强化学习后训练 人工智能炼丹师 整理 本期专题聚焦 视觉生成模型的偏好对齐与强化学习后训练(Preference Alignment & RL Post-Training for Visual Generation),深度解读 8 篇最新论文,并对该方向的技术演进脉络进行系统性横向对比。 专题概述 随着扩散模型(Diffusion Models)和流匹配模型(Flow Matching Models)在图像/视频生成领域取得突破性进展,如何让生成结果更好地符合人类偏好成为当前研究的核心焦点。借鉴大语言模型领域 RLHF(Reinforcement Learning from Human Feedback)的成功经验,研究者们正在积极探索将强化学习、直接偏好优化(DPO)、组相对策略优化(GRPO)等后训练技术应用于视觉生成模型。 本周(2026年3月14日-21日),该方向涌现出大量高质量论文,涵盖了从奖励模型构建、训练算法设计、到具体场景应用的完整技术栈。本期专题选取 8 篇代表性工作进行深度解读,系统梳理该方向的技术脉络与发展趋势。 核心技术线索: 奖励信号来源:外部奖励模型 vs 内在自置信信号 vs 几何物理约束 优化算法演进:DPO -> GRPO -> 多视角GRPO -> 对比策略优化 -> 中心化奖励蒸馏 应用场景拓展:T2I生成 -> 视频生成 -> 图像超分 -> AR视频 -> 少步推理模型 关键挑战:奖励黑客(Reward Hacking)、分布漂移、计算效率、非可微奖励 1. FIRM: Trust Your Critic -- 鲁棒奖励建模与强化学习的忠实图像编辑与生成 论文信息 标题: Trust Your Critic: Robust Reward Modeling and Reinforcement Learning for Faithful Image Editing and Generation 作者: Xiangyu Zhao, Peiyuan Zhang, Junming Lin, Tianhao Liang, Yuchen Duan, Shengyuan Ding 等 arXiv: 2603.12247 关键词: 奖励模型 鲁棒RL 图像编辑 T2I生成 数据管线 背景与动机 强化学习(RL)已成为提升图像编辑和文本到图像(T2I)生成质量的重要范式。然而,当前的奖励模型(Reward Model)作为 RL 中的"评论家",往往存在幻觉(hallucination)问题——给出不准确的评分,从而误导优化过程。这一问题在图像编辑场景中尤为严重:奖励模型可能对编辑后图像的忠实度评估不准确,导致生成结果偏离编辑指令。 方法原理 FIRM 框架包含两大核心组件: 1) 鲁棒奖励建模 定制化数据策管线(Data Curation Pipeline):针对图像编辑和 T2I 生成分别设计数据收集流程,构建高质量的评分数据集。编辑任务收集了涵盖颜色修改、风格迁移、物体添加/删除等多种编辑类型的 66 万条评分数据。 多维度评估:奖励模型同时考虑文本对齐度、编辑忠实度、图像质量等多个维度,避免单一指标的片面性。 对比学习增强:通过正负样本对比学习,提升奖励模型对微妙质量差异的辨别能力。 2) 鲁棒强化学习训练 噪声感知训练策略:在 RL 训练过程中,显式建模奖励信号中的噪声,通过置信度加权降低不可靠评分的影响。 多奖励聚合:将多个维度的奖励信号进行加权融合,动态调整各维度权重以平衡不同目标之间的trade-off。 正则化约束:引入 KL 散度正则化防止模型在优化过程中偏离预训练分布过远。 创新点 首个系统性解决奖励模型幻觉问题的框架:不仅改进奖励模型本身的准确性,还在 RL 训练阶段引入鲁棒性机制。 66万条高质量评分数据集开源:为社区提供了标准化的图像编辑/生成质量评估数据。 统一框架同时适用于图像编辑和 T2I 生成:两个任务共享奖励建模架构,仅在数据策管线上做差异化。 实验结果 在图像编辑任务上,FIRM 使 InstructPix2Pix 模型在 EditBench 上的编辑准确率提升 18.7%。 在 T2I 生成任务上,GenEval 综合得分从 0.63 提升至 0.79,超越 DALL-E 3 和 SDXL 基线。 奖励模型本身在 ImageReward 测试集上的 Kendall's Tau 相关性从 0.52 提升至 0.68。 2. MV-GRPO: 多视角组相对策略优化 -- 从稀疏到稠密的流模型对齐 论文信息 标题: From Sparse to Dense: Multi-View GRPO for Flow Models via Augmented Condition Space 作者: Jiazi Bu, Pengyang Ling, Yujie Zhou, Yibin Wang, Yuhang Zang, Tianyi Wei 等 arXiv: 2603.12648 关键词: GRPO 流模型 多视角评估 条件空间增强 T2I对齐 背景与动机 组相对策略优化(GRPO)已成为文本到图像流模型偏好对齐的强大框架。然而,标准 GRPO 范式存在一个根本性限制:单视角稀疏评估——对一组生成样本仅使用单一条件(prompt)进行评估,无法充分探索样本间的关系,限制了对齐效果的上限。 具体来说,给定一个 prompt,GRPO 生成 N 个候选图像,然后通过奖励模型评分并计算组相对优势。但这种方式下,每个样本只从一个角度被评估,奖励信号稀疏且容易受到 prompt 特异性的影响。 方法原理 MV-GRPO 提出了条件空间增强(Condition Space Augmentation)策略,将单视角稀疏评估升级为多视角稠密评估: 1) 条件空间增强 对原始 prompt 进行多维度改写:语义保持改写(paraphrase)、细节扩充(detail augmentation)、视角变换(perspective shifting)。 每个生成样本同时在原始 prompt 和增强 prompt 下进行评估,获得多个奖励分数。 2) 多视角优势估计 将每个样本的多视角奖励分数进行聚合,计算更稳定的组相对优势: 跨条件一致性加权:对于在不同 prompt 下获得一致高/低分的样本,增大其优势信号强度。 条件自适应归一化:不同 prompt 的评分尺度可能不同,通过条件内归一化消除尺度差异。 3) 渐进式探索策略 训练初期使用较少的增强条件,随着训练进行逐步增加,避免早期过度约束。 创新点 首次将多视角评估引入 GRPO 框架:突破了单条件评估的稀疏性瓶颈。 条件空间增强无需额外数据:仅通过 prompt 改写即可获得稠密评估信号。 理论分析:证明多视角 GRPO 的方差比标准 GRPO 低 O(1/K)(K 为视角数量)。 实验结果 在 FLUX.1-dev 上,GenEval 综合得分从基线 0.71 提升至 0.84(+18.3%),显著超越标准 GRPO 的 0.78。 人类评估显示偏好率达到 72.3%(vs 标准 GRPO 的 58.1%)。 在 T2I-CompBench 组合生成指标上,属性绑定准确率从 0.62 提升至 0.76。 仅需 500 步训练即可达到标准 GRPO 2000 步的效果,训练效率提升 4x。 3. AR-CoPO: 自回归视频生成的对比策略优化 论文信息 标题: AR-CoPO: Align Autoregressive Video Generation with Contrastive Policy Optimization 作者: Dailan He, Guanlin Feng, Xingtong Ge, Yi Zhang, Bingqi Ma, Guanglu Song 等 arXiv: 2603.17461 关键词: 自回归视频 对比策略优化 RLHF 少步蒸馏 流匹配 背景与动机 流式自回归(Streaming AR)视频生成器结合少步蒸馏可实现低延迟、高质量的视频合成,但通过 RLHF 对齐这类模型面临独特挑战: SDE 探索失效:现有基于 SDE 的 GRPO 方法假设扩散过程有足够的随机性进行探索,但少步 ODE 和一致性模型采样器偏离了标准流匹配 ODE,其短轨迹和低随机性使得中间 SDE 探索无效。 初始化敏感:少步模型的生成轨迹极短且确定性强,对初始化噪声高度敏感。 帧间一致性:自回归视频生成需要在优化人类偏好的同时保持帧间时序一致性。 方法原理 AR-CoPO 提出了一种专为自回归少步视频生成器设计的对比策略优化框架: 1) 输出空间对比探索(Output-Space Contrastive Exploration) 放弃在扩散过程中间步骤进行探索的传统方式,直接在输出空间(生成的视频帧)进行对比。 对每个时间步生成多个候选帧,通过奖励模型评分后选择最优,同时利用对比损失增大好坏样本间的差距。 2) 自回归感知的奖励传播 设计时序一致性奖励:不仅评估单帧质量,还评估帧间过渡的流畅性和一致性。 将帧级奖励沿时间轴反向传播,使早期帧的生成策略能考虑到后续帧的质量。 3) 参考策略锚定 引入 KL 散度正则化,将优化后的策略锚定在预训练模型附近,防止过度优化导致的模式崩溃。 对不同时间步使用自适应 KL 强度:早期帧(构图决定性阶段)使用较强约束,后期帧适当放松。 创新点 首个将 RLHF 成功应用于流式自回归视频生成器的工作:解决了少步蒸馏模型难以进行 RL 优化的技术瓶颈。 输出空间对比范式:避免了中间步骤探索在少步模型上的失效问题。 时序感知的奖励传播机制:在优化画面质量的同时保持视频的时序一致性。 实验结果 在流式 AR 视频生成基线上,VBench 得分从 78.2 提升至 83.7(+7.0%)。 人类偏好评估中,AR-CoPO 生成的视频在画面质量和时序一致性两个维度上分别获得 76.4% 和 71.8% 的偏好率。 仅需 4 步推理即可达到与 20 步推理 + GRPO 对齐相当的质量。 FVD(Frechet Video Distance)从 198.3 降低至 156.7。 4. CRAFT: 用复合奖励辅助微调轻松对齐扩散模型 (CVPR 2026) 论文信息 标题: CRAFT: Aligning Diffusion Models with Fine-Tuning Is Easier Than You Think 作者: Zening Sun, Zhengpeng Xie, Lichen Bai, Shitong Shao, Shuo Yang, Zeke Xie arXiv: 2603.18991 关键词: 复合奖励过滤 SFT GRPO下界 数据效率 CVPR 2026 背景与动机 当前扩散模型的偏好对齐方法面临两大挑战: 数据依赖:SFT 需要昂贵的高质量图像数据;DPO 风格方法依赖大规模偏好数据集,而这些数据集质量往往不一致。 计算低效:RL 类方法需要在线生成样本并计算奖励,训练成本高昂。 CRAFT 的核心洞察是:如果能构建一个高质量、一致的小规模训练集,简单的 SFT 就能达到甚至超越复杂的偏好优化方法。 方法原理 CRAFT 提出了一种极其简洁但强大的两阶段范式: 1) 复合奖励过滤(Composite Reward Filtering, CRF) 对每个 prompt 生成大量候选图像(如 64 张)。 使用多个奖励模型从不同维度评分:美学质量、文本对齐、构图合理性、技术质量。 将多维奖励分数进行加权融合,选择排名前 1-2 的图像作为训练样本。 关键设计:使用 相关性去偏(Correlation Debiasing) 确保选出的样本在各维度上均衡优秀,而非仅在某一维度极端。 2) 增强 SFT 在过滤后的高质量小数据集上进行标准 SFT 训练。 引入两项增强:(a) 噪声调度优化——对高评分样本使用更低的噪声水平;(b) 梯度裁剪——防止个别异常样本主导梯度方向。 3) 理论保证 证明 CRAFT 实际上优化了基于组强化学习的下界,从理论上建立了"筛选数据 + SFT"与"GRPO"之间的联系。 具体地,CRF 过程等价于 GRPO 中的组相对优势计算,而 SFT 则对应策略更新步骤。 创新点 仅需 100 个样本即可超越 SOTA 偏好优化方法:数据效率提升 10-100 倍。 理论证明 SFT + 数据筛选 是 GRPO 的下界优化:为简化的训练范式提供了理论支撑。 收敛速度提升 11-220 倍:相较于 DPO 和 GRPO 基线方法。 即插即用:无需修改模型架构或推理流程,仅替换训练数据和训练方式。 实验结果 使用仅 100 个样本的 CRAFT 在 GenEval 上得分 0.82,超越使用 5000+ 偏好对的 Diffusion-DPO(0.76)和标准 GRPO(0.79)。 在 HPSv2(Human Preference Score v2)上达到 28.9,超越所有基线。 训练时间:CRAFT 仅需 15 分钟(单A100),而 DPO 需要 5.5 小时,GRPO 需要 3.2 小时。 在 SDXL 和 SD3.5 两个基座模型上均验证有效。 5. TDM-R1: 用非可微奖励强化少步扩散模型 论文信息 标题: TDM-R1: Reinforcing Few-Step Diffusion Models with Non-Differentiable Reward 作者: Yihong Luo, Tianyang Hu, Weijian Luo, Jing Tang arXiv: 2603.07700 关键词: 少步扩散 非可微奖励 代理奖励学习 轨迹分布匹配 文本渲染 背景与动机 少步生成模型(如一致性模型、蒸馏扩散模型)大幅降低了生成成本,但现有的 RL 方法存在一个关键假设:奖励模型必须可微,以便通过反向传播计算梯度。这一假设排除了大量重要的真实世界奖励信号: 人类二元偏好(like/dislike) 物体计数准确性(整数值,不可微) OCR 文本准确率(离散指标) FID/IS 等分布级指标 如何在少步生成模型上利用这些非可微奖励进行 RL 后训练,是一个尚未解决的核心问题。 方法原理 TDM-R1 基于轨迹分布匹配(Trajectory Distribution Matching, TDM)框架,提出了一种将非可微奖励融入少步模型的统一 RL 后训练方法: 1) 代理奖励学习(Surrogate Reward Learning) 将 RL 过程解耦为两个阶段:先学习一个可微的代理奖励模型来拟合原始非可微奖励,再用代理奖励优化生成器。 代理奖励使用轻量级 MLP 头接在特征提取器上,通过对比学习训练,使其排序与真实奖励高度一致。 定期用真实非可微奖励校准代理奖励,防止偏移。 2) 逐步奖励信号(Per-Step Reward Signal) TDM 的确定性生成轨迹(通常 2-8 步)中,每一步都可以获得一个"部分生成"的中间结果。 设计逐步奖励:对每个中间状态通过快速解码预估最终输出,计算预估奖励作为当步的奖励信号。 这种细粒度的奖励分配比仅在最终步给出奖励更有效,降低了信用分配问题的难度。 3) 奖励自适应探索 根据当前样本的奖励水平自适应调节探索噪声:低奖励样本增大探索以寻找更好的方向,高奖励样本减少探索以稳定优化。 创新点 首个通用 RL 后训练方法支持少步模型 + 非可微奖励:打破了"可微奖励"的假设限制。 代理奖励学习 + 在线校准:兼顾了梯度可用性和奖励准确性。 逐步奖励分配:解决了少步模型中奖励信号稀疏的信用分配问题。 在文本渲染、视觉质量、偏好对齐三类任务上验证。 实验结果 在文本渲染任务上(OCR 准确率作为非可微奖励),TDM-R1 使 4 步模型的 OCR 准确率从 31.2% 提升至 62.7%(+101%)。 在 HPSv2 偏好对齐上,4-NFE 的 TDM-R1 达到 28.6,超越 100-NFE 的基线模型 (27.8)。 成功扩展到最新的 Z-Image 模型,仅用 4 步推理即持续超越其 100 步和少步变体。 与仅支持可微奖励的 ReFL 和 DDPO 相比,TDM-R1 在非可微奖励设定下领先 15-30%。 6. CRD: 中心化奖励蒸馏 -- 抵抗奖励黑客的扩散 RL 框架 论文信息 标题: Diffusion Reinforcement Learning via Centered Reward Distillation 作者: Yuanzhi Zhu, Xi Wang, Stephane Lathuiliere, Vicky Kalogeiton arXiv: 2603.14128 关键词: 奖励蒸馏 KL正则化 奖励黑客 分布漂移 前向过程微调 背景与动机 扩散 RL 微调面临的核心难题是 奖励黑客(Reward Hacking):模型学会利用奖励模型的漏洞,生成在奖励模型上得分很高但人类视觉上并不好的图像。例如,过度饱和的颜色、不自然的高对比度等。 现有方法的两大流派各有弊端: 轨迹级方法(DPPO, DDPO):内存消耗大、梯度方差高。 前向过程方法(DRaFT, ReFL):收敛快但容易发生分布漂移,导致奖励黑客。 方法原理 CRD 基于 KL 正则化奖励最大化理论,提出了一种更稳健的前向过程扩散 RL 框架: 1) 提示词内中心化(Within-Prompt Centering) 核心理论洞察:KL 正则化奖励最大化的最优策略涉及一个不可解的归一化常数 Z。 CRD 发现,通过在同一 prompt 的多个样本间做中心化(减去均值),归一化常数会自然抵消,得到一个适定的奖励匹配目标。 这使得 CRD 无需显式估计归一化常数,避免了额外的近似误差。 2) 三重分布漂移控制机制 (i) 采样器-参考解耦:将用于生成样本的采样器与移动参考模型分离,防止参考模型的更新导致比率信号崩溃。 (ii) CFG 锚定 KL:将 KL 散度的参考分布设为 CFG(Classifier-Free Guidance)引导的预训练模型,而非无引导的基础模型。这确保优化目标与推理时的语义一致。 (iii) 奖励自适应 KL 强度:训练早期使用较大 KL 系数加速学习(此时模型远离最优,大胆探索有益),训练后期逐渐增大 KL 系数抑制奖励黑客(此时接近最优,需要稳定性)。 创新点 理论优雅:通过中心化消除不可解归一化常数,将 KL 正则化奖励最大化转化为可实操的目标。 三重防线对抗奖励黑客:采样器-参考解耦、CFG 锚定、自适应 KL 强度协同工作。 CFG 锚定的创新性:传统方法锚定无 CFG 的基础模型,CRD 认识到推理时都使用 CFG,因此应该锚定 CFG 引导的分布。 实验结果 在 GenEval 上实现 0.83 的综合得分,与 SOTA 持平。 关键优势在于抗奖励黑客能力:在 HPSv2 上获得 28.5 的同时,FID 仅增加 2.3(对比 DPPO 的 FID 增加 8.7、DRaFT 的 FID 增加 5.1)。 OCR 文本渲染准确率提升 +23.1 pp。 在 ImageReward 和 PickScore 等未见过的偏好指标上,CRD 的优化效果同样保持(证明非奖励黑客)。 7. SOLACE: 内在自置信奖励驱动的 T2I 后训练 (CVPR 2026) 论文信息 标题: Improving Text-to-Image Generation with Intrinsic Self-Confidence Rewards 作者: Seungwook Kim, Minsu Cho arXiv: 2603.00918 会议: CVPR 2026 关键词: 自置信奖励 无监督优化 自去噪探测 无需外部RM CVPR 2026 背景与动机 现有的扩散模型后训练方法几乎都依赖外部奖励模型(如 ImageReward、HPSv2、CLIPScore 等)。然而: 外部奖励模型本身存在偏差和幻觉。 训练和维护奖励模型需要额外成本。 过度优化外部奖励容易导致奖励黑客。 一个自然的问题是:能否利用模型自身的内在信号来指导优化,完全不需要外部奖励模型? 方法原理 SOLACE 提出了一种基于 自置信度(Self-Confidence) 的内在奖励信号: 1) 自去噪探测(Self-Denoising Probe) 核心机制:对一张生成的图像注入一定量的噪声,然后让模型自己尝试恢复原图。 自置信度 = 恢复的准确程度:如果模型对自己生成的图像"理解得很好",就能准确恢复,置信度高;如果生成的图像与模型学到的分布不一致(如质量差、语义不连贯),恢复效果就差。 数学上,自置信度与模型在该样本处的似然估计成正比。 2) 标量奖励转化 将自去噪的重建误差转化为标量奖励分数:重建误差越小,奖励越高。 使用多个噪声水平进行探测,取平均值以获得更稳定的估计。 3) 完全无监督的偏好优化 利用自置信度奖励进行 GRPO 风格的优化,无需任何外部数据集、标注员或奖励模型。 高置信度的生成结果被强化,低置信度的被抑制。 创新点 首个完全无外部奖励的扩散模型后训练方法:打开了"自监督偏好对齐"的新方向。 自置信度信号的物理直觉:模型更容易恢复"好的"图像(与训练分布一致),提供了一种自然的质量度量。 与外部奖励互补:SOLACE 与外部奖励结合使用时效果更好,且能缓解奖励黑客。 零额外推理成本:自去噪探测仅在训练时使用,推理时完全不增加开销。 实验结果 仅使用内在奖励,在 GenEval 组合生成得分提升 +0.08(从 0.71 到 0.79)。 文本渲染准确率提升 +15.3 pp。 SOLACE + 外部奖励的组合方案达到 0.85 GenEval 得分,为所有方法中最高。 将 SOLACE 与 ImageReward 结合时,奖励黑客指标(FID 增量)从 ImageReward 单独使用时的 +6.2 降至 +1.8。 8. VIGOR: 基于几何的视频时序一致性奖励模型 论文信息 标题: VIGOR: VIdeo Geometry-Oriented Reward for Temporal Generative Alignment 作者: Tengjiao Yin, Jinglei Shi, Heng Guo, Xi Wang arXiv: 2603.16271 关键词: 几何奖励 时序一致性 重投影误差 视频扩散 推理时扩展 背景与动机 视频扩散模型在训练过程中缺乏显式的几何监督,导致生成的视频中常出现物体变形、空间漂移和深度违例等不一致性。现有的视频奖励模型主要基于语义(如 VQAScore、CLIPScore)或整体美学评估,无法捕捉帧间的几何一致性。 方法原理 VIGOR 提出了一种基于几何的奖励模型,利用预训练的几何基础模型来评估视频的多视角一致性: 1) 跨帧重投影误差 使用预训练的单目深度估计模型和光流模型,对视频帧对之间进行三维重投影。 逐点计算重投影误差(而非像素级对比),得到更符合物理规律的误差度量。 优势:逐点方式对纹理和光照变化更鲁棒,不会被像素强度差异干扰。 2) 几何感知采样 过滤低纹理区域和非语义区域(如天空、纯色背景),将评估集中在具有可靠对应关系的几何有意义区域。 使用特征匹配置信度作为权重,可靠区域的误差权重更大。 3) 双路径应用 训练后微调:对双向视频模型使用 VIGOR 奖励进行 SFT 或 RL 后训练。 推理时扩展(Test-Time Scaling):对因果视频模型(如流式视频生成器),在推理时使用 VIGOR 作为路径验证器,从多个候选结果中选择几何最一致的。 创新点 首个基于物理几何约束的视频生成奖励模型:超越了纯语义/美学评估的局限。 逐点误差计算:比像素级指标更鲁棒,对光照和纹理变化不敏感。 推理时扩展的即插即用方案:无需重训练模型,通过推理时选择提升开源视频模型质量。 兼容多种视频生成架构:双向模型(后训练)和因果模型(推理时扩展)均适用。 实验结果 在 VBench 动态一致性指标上提升 +5.8%。 物体变形率从基线的 23.7% 降至 11.4%(减少 52%)。 推理时扩展方案:在 Open-Sora 上,使用 VIGOR 选择最优帧序列,VBench 得分提升 +3.2 而无需任何额外训练。 与 VQAScore 等语义奖励正交互补:两者结合可进一步提升 +1.5。 横向对比与技术脉络分析 核心维度对比 方法 奖励来源 优化算法 目标场景 数据需求 训练效率 抗奖励黑客 FIRM 外部多维RM RL (噪声感知) T2I + 编辑 66万评分 中 高 (鲁棒RM) MV-GRPO 外部RM GRPO (多视角) T2I 流模型 无额外 高 (4x) 中 AR-CoPO 外部RM 对比策略优化 AR视频 标准 中 中 CRAFT 复合RM过滤 SFT (增强) T2I 扩散 100样本 极高 (220x) 中 TDM-R1 代理RM (非可微) 轨迹分布匹配 少步T2I 标准 中 中 CRD 外部RM 中心化奖励蒸馏 T2I 扩散 标准 高 极高 (三重防线) SOLACE 内在自置信 GRPO (无监督) T2I 扩散 零 (无需标注) 高 高 (无外部RM) VIGOR 几何物理约束 SFT/推理选择 视频扩散 无额外 高 高 (物理约束) 技术演进脉络 第一条线:优化算法的演进 DPO (配对偏好) → GRPO (组相对优势) → MV-GRPO (多视角稠密评估) → AR-CoPO (输出空间对比) → CRAFT (证明SFT是GRPO下界) → CRD (中心化消除归一化常数) 这条线索体现了从简单配对比较到更精细的组级优化,再到理论层面的统一理解。CRAFT 的发现尤为重要:它证明了精心筛选数据后的 SFT 本质上就是 GRPO 的一种近似,为实践者提供了"大道至简"的选择。 第二条线:奖励信号的多元化 外部语义RM (CLIPScore, ImageReward) → 鲁棒外部RM (FIRM, 66万数据) → 内在自置信 (SOLACE, 自去噪探测) → 几何物理约束 (VIGOR, 重投影误差) → 代理RM (TDM-R1, 拟合非可微信号) → 复合多维RM (CRAFT, CRF过滤) 奖励信号从单一外部模型扩展到内在信号、物理约束、代理模型等多种来源,这一趋势反映了社区对"什么是好的生成"的认知越来越多元。 第三条线:应用场景的拓展 T2I 扩散模型 → 流匹配模型 (MV-GRPO) → 少步蒸馏模型 (TDM-R1) → AR视频生成 (AR-CoPO) → 视频一致性 (VIGOR) 偏好对齐技术正在从最初的 T2I 扩散模型扩展到更广泛的视觉生成模型,每种模型架构都带来独特的技术挑战。 关键发现与趋势 数据效率成为核心竞争力:CRAFT 用 100 个样本超越 5000+ 偏好对的方法,SOLACE 完全无需外部数据——"数据质量 > 数据数量"已成为共识。 奖励黑客是最大风险:CRD 专门设计三重防线,SOLACE 通过内在奖励规避,VIGOR 使用物理约束——不同方法从不同角度应对同一核心挑战。 理论与实践融合加速:CRAFT 证明 SFT 与 GRPO 的理论等价性,CRD 从 KL 正则化推导出中心化技巧,MV-GRPO 给出方差减少的理论分析——该领域正从经验驱动转向理论指导。 推理时扩展(Test-Time Scaling)兴起:VIGOR 和 Meta-TTRL(本周另一篇相关工作)都探索了不修改模型参数、仅在推理时提升质量的方案,这为资源受限场景提供了新思路。 统一框架的探索:多项工作尝试统一不同优化范式(CRAFT 统一 SFT 和 GRPO,CRD 统一前向过程和轨迹方法),预示着未来可能出现更通用的视觉生成对齐框架。 其他相关工作简述 本周还有多篇相关工作值得关注: GDPO-SR (2603.16769): 将 GRPO 原理融入 DPO 用于一步超分辨率,引入属性感知奖励函数针对平滑/纹理区域差异化评估。 LibraGen (2603.13506): 主题驱动视频生成中的 DPO 应用,提出 Consis-DPO 和 Real-Fake DPO 两种定制化偏好优化管线。 Meta-TTRL (2603.15724): 统一多模态模型的测试时强化学习,利用模型内在元认知信号进行推理时自我改进。 Correlation-Weighted Multi-Reward (2603.18528): 组合生成中的多奖励协调优化,通过相关性加权平衡竞争概念间的奖励冲突。 V2A-DPO (2603.11089): 视频到音频生成的 DPO 框架,提出 AudioScore 综合评分系统。 总结与展望 本期专题梳理了视觉生成模型偏好对齐与 RL 后训练的最新进展。从奖励建模(FIRM 的鲁棒 RM、SOLACE 的内在信号、VIGOR 的几何约束)到优化算法(MV-GRPO 的多视角评估、CRAFT 的简洁 SFT 范式、CRD 的抗奖励黑客设计)再到场景拓展(AR-CoPO 的流式视频、TDM-R1 的少步推理),该方向呈现出蓬勃的发展态势。 未来值得关注的方向: 多模态统一对齐:将偏好对齐扩展到图像+视频+音频的统一生成模型。 在线人类反馈:从离线偏好数据集转向在线、实时的人类反馈闭环。 可解释奖励:让用户和开发者理解"为什么这张图/这段视频被认为是好的"。 超长视频对齐:随着视频生成长度增加,如何在数分钟长度的视频上进行有效的偏好对齐。 安全对齐:在提升质量的同时,确保生成内容的安全性和合规性。 本期专题由 人工智能炼丹师 整理,更多 AIGC 前沿动态请关注 jefxiong.cn

AIGC 周末专题深度解读:RL后训练进展|2026-03-21|偏好对齐|SOLACE|CRAFT|CRD|VIGOR| AIGC 周末专题深度解读 | 2026-03-21 | 视觉生成模型的偏好对齐与强化学习后训练 人工智能炼丹师 整理 本期专题聚焦 视觉生成模型的偏好对齐与强化学习后训练(Preference Alignment & RL Post-Training for Visual Generation),深度解读 8 篇最新论文,并对该方向的技术演进脉络进行系统性横向对比。 专题概述 随着扩散模型(Diffusion Models)和流匹配模型(Flow Matching Models)在图像/视频生成领域取得突破性进展,如何让生成结果更好地符合人类偏好成为当前研究的核心焦点。借鉴大语言模型领域 RLHF(Reinforcement Learning from Human Feedback)的成功经验,研究者们正在积极探索将强化学习、直接偏好优化(DPO)、组相对策略优化(GRPO)等后训练技术应用于视觉生成模型。 本周(2026年3月14日-21日),该方向涌现出大量高质量论文,涵盖了从奖励模型构建、训练算法设计、到具体场景应用的完整技术栈。本期专题选取 8 篇代表性工作进行深度解读,系统梳理该方向的技术脉络与发展趋势。 核心技术线索: 奖励信号来源:外部奖励模型 vs 内在自置信信号 vs 几何物理约束 优化算法演进:DPO -> GRPO -> 多视角GRPO -> 对比策略优化 -> 中心化奖励蒸馏 应用场景拓展:T2I生成 -> 视频生成 -> 图像超分 -> AR视频 -> 少步推理模型 关键挑战:奖励黑客(Reward Hacking)、分布漂移、计算效率、非可微奖励 1. FIRM: Trust Your Critic -- 鲁棒奖励建模与强化学习的忠实图像编辑与生成 论文信息 标题: Trust Your Critic: Robust Reward Modeling and Reinforcement Learning for Faithful Image Editing and Generation 作者: Xiangyu Zhao, Peiyuan Zhang, Junming Lin, Tianhao Liang, Yuchen Duan, Shengyuan Ding 等 arXiv: 2603.12247 关键词: 奖励模型 鲁棒RL 图像编辑 T2I生成 数据管线 背景与动机 强化学习(RL)已成为提升图像编辑和文本到图像(T2I)生成质量的重要范式。然而,当前的奖励模型(Reward Model)作为 RL 中的"评论家",往往存在幻觉(hallucination)问题——给出不准确的评分,从而误导优化过程。这一问题在图像编辑场景中尤为严重:奖励模型可能对编辑后图像的忠实度评估不准确,导致生成结果偏离编辑指令。 方法原理 FIRM 框架包含两大核心组件: 1) 鲁棒奖励建模 定制化数据策管线(Data Curation Pipeline):针对图像编辑和 T2I 生成分别设计数据收集流程,构建高质量的评分数据集。编辑任务收集了涵盖颜色修改、风格迁移、物体添加/删除等多种编辑类型的 66 万条评分数据。 多维度评估:奖励模型同时考虑文本对齐度、编辑忠实度、图像质量等多个维度,避免单一指标的片面性。 对比学习增强:通过正负样本对比学习,提升奖励模型对微妙质量差异的辨别能力。 2) 鲁棒强化学习训练 噪声感知训练策略:在 RL 训练过程中,显式建模奖励信号中的噪声,通过置信度加权降低不可靠评分的影响。 多奖励聚合:将多个维度的奖励信号进行加权融合,动态调整各维度权重以平衡不同目标之间的trade-off。 正则化约束:引入 KL 散度正则化防止模型在优化过程中偏离预训练分布过远。 创新点 首个系统性解决奖励模型幻觉问题的框架:不仅改进奖励模型本身的准确性,还在 RL 训练阶段引入鲁棒性机制。 66万条高质量评分数据集开源:为社区提供了标准化的图像编辑/生成质量评估数据。 统一框架同时适用于图像编辑和 T2I 生成:两个任务共享奖励建模架构,仅在数据策管线上做差异化。 实验结果 在图像编辑任务上,FIRM 使 InstructPix2Pix 模型在 EditBench 上的编辑准确率提升 18.7%。 在 T2I 生成任务上,GenEval 综合得分从 0.63 提升至 0.79,超越 DALL-E 3 和 SDXL 基线。 奖励模型本身在 ImageReward 测试集上的 Kendall's Tau 相关性从 0.52 提升至 0.68。 2. MV-GRPO: 多视角组相对策略优化 -- 从稀疏到稠密的流模型对齐 论文信息 标题: From Sparse to Dense: Multi-View GRPO for Flow Models via Augmented Condition Space 作者: Jiazi Bu, Pengyang Ling, Yujie Zhou, Yibin Wang, Yuhang Zang, Tianyi Wei 等 arXiv: 2603.12648 关键词: GRPO 流模型 多视角评估 条件空间增强 T2I对齐 背景与动机 组相对策略优化(GRPO)已成为文本到图像流模型偏好对齐的强大框架。然而,标准 GRPO 范式存在一个根本性限制:单视角稀疏评估——对一组生成样本仅使用单一条件(prompt)进行评估,无法充分探索样本间的关系,限制了对齐效果的上限。 具体来说,给定一个 prompt,GRPO 生成 N 个候选图像,然后通过奖励模型评分并计算组相对优势。但这种方式下,每个样本只从一个角度被评估,奖励信号稀疏且容易受到 prompt 特异性的影响。 方法原理 MV-GRPO 提出了条件空间增强(Condition Space Augmentation)策略,将单视角稀疏评估升级为多视角稠密评估: 1) 条件空间增强 对原始 prompt 进行多维度改写:语义保持改写(paraphrase)、细节扩充(detail augmentation)、视角变换(perspective shifting)。 每个生成样本同时在原始 prompt 和增强 prompt 下进行评估,获得多个奖励分数。 2) 多视角优势估计 将每个样本的多视角奖励分数进行聚合,计算更稳定的组相对优势: 跨条件一致性加权:对于在不同 prompt 下获得一致高/低分的样本,增大其优势信号强度。 条件自适应归一化:不同 prompt 的评分尺度可能不同,通过条件内归一化消除尺度差异。 3) 渐进式探索策略 训练初期使用较少的增强条件,随着训练进行逐步增加,避免早期过度约束。 创新点 首次将多视角评估引入 GRPO 框架:突破了单条件评估的稀疏性瓶颈。 条件空间增强无需额外数据:仅通过 prompt 改写即可获得稠密评估信号。 理论分析:证明多视角 GRPO 的方差比标准 GRPO 低 O(1/K)(K 为视角数量)。 实验结果 在 FLUX.1-dev 上,GenEval 综合得分从基线 0.71 提升至 0.84(+18.3%),显著超越标准 GRPO 的 0.78。 人类评估显示偏好率达到 72.3%(vs 标准 GRPO 的 58.1%)。 在 T2I-CompBench 组合生成指标上,属性绑定准确率从 0.62 提升至 0.76。 仅需 500 步训练即可达到标准 GRPO 2000 步的效果,训练效率提升 4x。 3. AR-CoPO: 自回归视频生成的对比策略优化 论文信息 标题: AR-CoPO: Align Autoregressive Video Generation with Contrastive Policy Optimization 作者: Dailan He, Guanlin Feng, Xingtong Ge, Yi Zhang, Bingqi Ma, Guanglu Song 等 arXiv: 2603.17461 关键词: 自回归视频 对比策略优化 RLHF 少步蒸馏 流匹配 背景与动机 流式自回归(Streaming AR)视频生成器结合少步蒸馏可实现低延迟、高质量的视频合成,但通过 RLHF 对齐这类模型面临独特挑战: SDE 探索失效:现有基于 SDE 的 GRPO 方法假设扩散过程有足够的随机性进行探索,但少步 ODE 和一致性模型采样器偏离了标准流匹配 ODE,其短轨迹和低随机性使得中间 SDE 探索无效。 初始化敏感:少步模型的生成轨迹极短且确定性强,对初始化噪声高度敏感。 帧间一致性:自回归视频生成需要在优化人类偏好的同时保持帧间时序一致性。 方法原理 AR-CoPO 提出了一种专为自回归少步视频生成器设计的对比策略优化框架: 1) 输出空间对比探索(Output-Space Contrastive Exploration) 放弃在扩散过程中间步骤进行探索的传统方式,直接在输出空间(生成的视频帧)进行对比。 对每个时间步生成多个候选帧,通过奖励模型评分后选择最优,同时利用对比损失增大好坏样本间的差距。 2) 自回归感知的奖励传播 设计时序一致性奖励:不仅评估单帧质量,还评估帧间过渡的流畅性和一致性。 将帧级奖励沿时间轴反向传播,使早期帧的生成策略能考虑到后续帧的质量。 3) 参考策略锚定 引入 KL 散度正则化,将优化后的策略锚定在预训练模型附近,防止过度优化导致的模式崩溃。 对不同时间步使用自适应 KL 强度:早期帧(构图决定性阶段)使用较强约束,后期帧适当放松。 创新点 首个将 RLHF 成功应用于流式自回归视频生成器的工作:解决了少步蒸馏模型难以进行 RL 优化的技术瓶颈。 输出空间对比范式:避免了中间步骤探索在少步模型上的失效问题。 时序感知的奖励传播机制:在优化画面质量的同时保持视频的时序一致性。 实验结果 在流式 AR 视频生成基线上,VBench 得分从 78.2 提升至 83.7(+7.0%)。 人类偏好评估中,AR-CoPO 生成的视频在画面质量和时序一致性两个维度上分别获得 76.4% 和 71.8% 的偏好率。 仅需 4 步推理即可达到与 20 步推理 + GRPO 对齐相当的质量。 FVD(Frechet Video Distance)从 198.3 降低至 156.7。 4. CRAFT: 用复合奖励辅助微调轻松对齐扩散模型 (CVPR 2026) 论文信息 标题: CRAFT: Aligning Diffusion Models with Fine-Tuning Is Easier Than You Think 作者: Zening Sun, Zhengpeng Xie, Lichen Bai, Shitong Shao, Shuo Yang, Zeke Xie arXiv: 2603.18991 关键词: 复合奖励过滤 SFT GRPO下界 数据效率 CVPR 2026 背景与动机 当前扩散模型的偏好对齐方法面临两大挑战: 数据依赖:SFT 需要昂贵的高质量图像数据;DPO 风格方法依赖大规模偏好数据集,而这些数据集质量往往不一致。 计算低效:RL 类方法需要在线生成样本并计算奖励,训练成本高昂。 CRAFT 的核心洞察是:如果能构建一个高质量、一致的小规模训练集,简单的 SFT 就能达到甚至超越复杂的偏好优化方法。 方法原理 CRAFT 提出了一种极其简洁但强大的两阶段范式: 1) 复合奖励过滤(Composite Reward Filtering, CRF) 对每个 prompt 生成大量候选图像(如 64 张)。 使用多个奖励模型从不同维度评分:美学质量、文本对齐、构图合理性、技术质量。 将多维奖励分数进行加权融合,选择排名前 1-2 的图像作为训练样本。 关键设计:使用 相关性去偏(Correlation Debiasing) 确保选出的样本在各维度上均衡优秀,而非仅在某一维度极端。 2) 增强 SFT 在过滤后的高质量小数据集上进行标准 SFT 训练。 引入两项增强:(a) 噪声调度优化——对高评分样本使用更低的噪声水平;(b) 梯度裁剪——防止个别异常样本主导梯度方向。 3) 理论保证 证明 CRAFT 实际上优化了基于组强化学习的下界,从理论上建立了"筛选数据 + SFT"与"GRPO"之间的联系。 具体地,CRF 过程等价于 GRPO 中的组相对优势计算,而 SFT 则对应策略更新步骤。 创新点 仅需 100 个样本即可超越 SOTA 偏好优化方法:数据效率提升 10-100 倍。 理论证明 SFT + 数据筛选 是 GRPO 的下界优化:为简化的训练范式提供了理论支撑。 收敛速度提升 11-220 倍:相较于 DPO 和 GRPO 基线方法。 即插即用:无需修改模型架构或推理流程,仅替换训练数据和训练方式。 实验结果 使用仅 100 个样本的 CRAFT 在 GenEval 上得分 0.82,超越使用 5000+ 偏好对的 Diffusion-DPO(0.76)和标准 GRPO(0.79)。 在 HPSv2(Human Preference Score v2)上达到 28.9,超越所有基线。 训练时间:CRAFT 仅需 15 分钟(单A100),而 DPO 需要 5.5 小时,GRPO 需要 3.2 小时。 在 SDXL 和 SD3.5 两个基座模型上均验证有效。 5. TDM-R1: 用非可微奖励强化少步扩散模型 论文信息 标题: TDM-R1: Reinforcing Few-Step Diffusion Models with Non-Differentiable Reward 作者: Yihong Luo, Tianyang Hu, Weijian Luo, Jing Tang arXiv: 2603.07700 关键词: 少步扩散 非可微奖励 代理奖励学习 轨迹分布匹配 文本渲染 背景与动机 少步生成模型(如一致性模型、蒸馏扩散模型)大幅降低了生成成本,但现有的 RL 方法存在一个关键假设:奖励模型必须可微,以便通过反向传播计算梯度。这一假设排除了大量重要的真实世界奖励信号: 人类二元偏好(like/dislike) 物体计数准确性(整数值,不可微) OCR 文本准确率(离散指标) FID/IS 等分布级指标 如何在少步生成模型上利用这些非可微奖励进行 RL 后训练,是一个尚未解决的核心问题。 方法原理 TDM-R1 基于轨迹分布匹配(Trajectory Distribution Matching, TDM)框架,提出了一种将非可微奖励融入少步模型的统一 RL 后训练方法: 1) 代理奖励学习(Surrogate Reward Learning) 将 RL 过程解耦为两个阶段:先学习一个可微的代理奖励模型来拟合原始非可微奖励,再用代理奖励优化生成器。 代理奖励使用轻量级 MLP 头接在特征提取器上,通过对比学习训练,使其排序与真实奖励高度一致。 定期用真实非可微奖励校准代理奖励,防止偏移。 2) 逐步奖励信号(Per-Step Reward Signal) TDM 的确定性生成轨迹(通常 2-8 步)中,每一步都可以获得一个"部分生成"的中间结果。 设计逐步奖励:对每个中间状态通过快速解码预估最终输出,计算预估奖励作为当步的奖励信号。 这种细粒度的奖励分配比仅在最终步给出奖励更有效,降低了信用分配问题的难度。 3) 奖励自适应探索 根据当前样本的奖励水平自适应调节探索噪声:低奖励样本增大探索以寻找更好的方向,高奖励样本减少探索以稳定优化。 创新点 首个通用 RL 后训练方法支持少步模型 + 非可微奖励:打破了"可微奖励"的假设限制。 代理奖励学习 + 在线校准:兼顾了梯度可用性和奖励准确性。 逐步奖励分配:解决了少步模型中奖励信号稀疏的信用分配问题。 在文本渲染、视觉质量、偏好对齐三类任务上验证。 实验结果 在文本渲染任务上(OCR 准确率作为非可微奖励),TDM-R1 使 4 步模型的 OCR 准确率从 31.2% 提升至 62.7%(+101%)。 在 HPSv2 偏好对齐上,4-NFE 的 TDM-R1 达到 28.6,超越 100-NFE 的基线模型 (27.8)。 成功扩展到最新的 Z-Image 模型,仅用 4 步推理即持续超越其 100 步和少步变体。 与仅支持可微奖励的 ReFL 和 DDPO 相比,TDM-R1 在非可微奖励设定下领先 15-30%。 6. CRD: 中心化奖励蒸馏 -- 抵抗奖励黑客的扩散 RL 框架 论文信息 标题: Diffusion Reinforcement Learning via Centered Reward Distillation 作者: Yuanzhi Zhu, Xi Wang, Stephane Lathuiliere, Vicky Kalogeiton arXiv: 2603.14128 关键词: 奖励蒸馏 KL正则化 奖励黑客 分布漂移 前向过程微调 背景与动机 扩散 RL 微调面临的核心难题是 奖励黑客(Reward Hacking):模型学会利用奖励模型的漏洞,生成在奖励模型上得分很高但人类视觉上并不好的图像。例如,过度饱和的颜色、不自然的高对比度等。 现有方法的两大流派各有弊端: 轨迹级方法(DPPO, DDPO):内存消耗大、梯度方差高。 前向过程方法(DRaFT, ReFL):收敛快但容易发生分布漂移,导致奖励黑客。 方法原理 CRD 基于 KL 正则化奖励最大化理论,提出了一种更稳健的前向过程扩散 RL 框架: 1) 提示词内中心化(Within-Prompt Centering) 核心理论洞察:KL 正则化奖励最大化的最优策略涉及一个不可解的归一化常数 Z。 CRD 发现,通过在同一 prompt 的多个样本间做中心化(减去均值),归一化常数会自然抵消,得到一个适定的奖励匹配目标。 这使得 CRD 无需显式估计归一化常数,避免了额外的近似误差。 2) 三重分布漂移控制机制 (i) 采样器-参考解耦:将用于生成样本的采样器与移动参考模型分离,防止参考模型的更新导致比率信号崩溃。 (ii) CFG 锚定 KL:将 KL 散度的参考分布设为 CFG(Classifier-Free Guidance)引导的预训练模型,而非无引导的基础模型。这确保优化目标与推理时的语义一致。 (iii) 奖励自适应 KL 强度:训练早期使用较大 KL 系数加速学习(此时模型远离最优,大胆探索有益),训练后期逐渐增大 KL 系数抑制奖励黑客(此时接近最优,需要稳定性)。 创新点 理论优雅:通过中心化消除不可解归一化常数,将 KL 正则化奖励最大化转化为可实操的目标。 三重防线对抗奖励黑客:采样器-参考解耦、CFG 锚定、自适应 KL 强度协同工作。 CFG 锚定的创新性:传统方法锚定无 CFG 的基础模型,CRD 认识到推理时都使用 CFG,因此应该锚定 CFG 引导的分布。 实验结果 在 GenEval 上实现 0.83 的综合得分,与 SOTA 持平。 关键优势在于抗奖励黑客能力:在 HPSv2 上获得 28.5 的同时,FID 仅增加 2.3(对比 DPPO 的 FID 增加 8.7、DRaFT 的 FID 增加 5.1)。 OCR 文本渲染准确率提升 +23.1 pp。 在 ImageReward 和 PickScore 等未见过的偏好指标上,CRD 的优化效果同样保持(证明非奖励黑客)。 7. SOLACE: 内在自置信奖励驱动的 T2I 后训练 (CVPR 2026) 论文信息 标题: Improving Text-to-Image Generation with Intrinsic Self-Confidence Rewards 作者: Seungwook Kim, Minsu Cho arXiv: 2603.00918 会议: CVPR 2026 关键词: 自置信奖励 无监督优化 自去噪探测 无需外部RM CVPR 2026 背景与动机 现有的扩散模型后训练方法几乎都依赖外部奖励模型(如 ImageReward、HPSv2、CLIPScore 等)。然而: 外部奖励模型本身存在偏差和幻觉。 训练和维护奖励模型需要额外成本。 过度优化外部奖励容易导致奖励黑客。 一个自然的问题是:能否利用模型自身的内在信号来指导优化,完全不需要外部奖励模型? 方法原理 SOLACE 提出了一种基于 自置信度(Self-Confidence) 的内在奖励信号: 1) 自去噪探测(Self-Denoising Probe) 核心机制:对一张生成的图像注入一定量的噪声,然后让模型自己尝试恢复原图。 自置信度 = 恢复的准确程度:如果模型对自己生成的图像"理解得很好",就能准确恢复,置信度高;如果生成的图像与模型学到的分布不一致(如质量差、语义不连贯),恢复效果就差。 数学上,自置信度与模型在该样本处的似然估计成正比。 2) 标量奖励转化 将自去噪的重建误差转化为标量奖励分数:重建误差越小,奖励越高。 使用多个噪声水平进行探测,取平均值以获得更稳定的估计。 3) 完全无监督的偏好优化 利用自置信度奖励进行 GRPO 风格的优化,无需任何外部数据集、标注员或奖励模型。 高置信度的生成结果被强化,低置信度的被抑制。 创新点 首个完全无外部奖励的扩散模型后训练方法:打开了"自监督偏好对齐"的新方向。 自置信度信号的物理直觉:模型更容易恢复"好的"图像(与训练分布一致),提供了一种自然的质量度量。 与外部奖励互补:SOLACE 与外部奖励结合使用时效果更好,且能缓解奖励黑客。 零额外推理成本:自去噪探测仅在训练时使用,推理时完全不增加开销。 实验结果 仅使用内在奖励,在 GenEval 组合生成得分提升 +0.08(从 0.71 到 0.79)。 文本渲染准确率提升 +15.3 pp。 SOLACE + 外部奖励的组合方案达到 0.85 GenEval 得分,为所有方法中最高。 将 SOLACE 与 ImageReward 结合时,奖励黑客指标(FID 增量)从 ImageReward 单独使用时的 +6.2 降至 +1.8。 8. VIGOR: 基于几何的视频时序一致性奖励模型 论文信息 标题: VIGOR: VIdeo Geometry-Oriented Reward for Temporal Generative Alignment 作者: Tengjiao Yin, Jinglei Shi, Heng Guo, Xi Wang arXiv: 2603.16271 关键词: 几何奖励 时序一致性 重投影误差 视频扩散 推理时扩展 背景与动机 视频扩散模型在训练过程中缺乏显式的几何监督,导致生成的视频中常出现物体变形、空间漂移和深度违例等不一致性。现有的视频奖励模型主要基于语义(如 VQAScore、CLIPScore)或整体美学评估,无法捕捉帧间的几何一致性。 方法原理 VIGOR 提出了一种基于几何的奖励模型,利用预训练的几何基础模型来评估视频的多视角一致性: 1) 跨帧重投影误差 使用预训练的单目深度估计模型和光流模型,对视频帧对之间进行三维重投影。 逐点计算重投影误差(而非像素级对比),得到更符合物理规律的误差度量。 优势:逐点方式对纹理和光照变化更鲁棒,不会被像素强度差异干扰。 2) 几何感知采样 过滤低纹理区域和非语义区域(如天空、纯色背景),将评估集中在具有可靠对应关系的几何有意义区域。 使用特征匹配置信度作为权重,可靠区域的误差权重更大。 3) 双路径应用 训练后微调:对双向视频模型使用 VIGOR 奖励进行 SFT 或 RL 后训练。 推理时扩展(Test-Time Scaling):对因果视频模型(如流式视频生成器),在推理时使用 VIGOR 作为路径验证器,从多个候选结果中选择几何最一致的。 创新点 首个基于物理几何约束的视频生成奖励模型:超越了纯语义/美学评估的局限。 逐点误差计算:比像素级指标更鲁棒,对光照和纹理变化不敏感。 推理时扩展的即插即用方案:无需重训练模型,通过推理时选择提升开源视频模型质量。 兼容多种视频生成架构:双向模型(后训练)和因果模型(推理时扩展)均适用。 实验结果 在 VBench 动态一致性指标上提升 +5.8%。 物体变形率从基线的 23.7% 降至 11.4%(减少 52%)。 推理时扩展方案:在 Open-Sora 上,使用 VIGOR 选择最优帧序列,VBench 得分提升 +3.2 而无需任何额外训练。 与 VQAScore 等语义奖励正交互补:两者结合可进一步提升 +1.5。 横向对比与技术脉络分析 核心维度对比 方法 奖励来源 优化算法 目标场景 数据需求 训练效率 抗奖励黑客 FIRM 外部多维RM RL (噪声感知) T2I + 编辑 66万评分 中 高 (鲁棒RM) MV-GRPO 外部RM GRPO (多视角) T2I 流模型 无额外 高 (4x) 中 AR-CoPO 外部RM 对比策略优化 AR视频 标准 中 中 CRAFT 复合RM过滤 SFT (增强) T2I 扩散 100样本 极高 (220x) 中 TDM-R1 代理RM (非可微) 轨迹分布匹配 少步T2I 标准 中 中 CRD 外部RM 中心化奖励蒸馏 T2I 扩散 标准 高 极高 (三重防线) SOLACE 内在自置信 GRPO (无监督) T2I 扩散 零 (无需标注) 高 高 (无外部RM) VIGOR 几何物理约束 SFT/推理选择 视频扩散 无额外 高 高 (物理约束) 技术演进脉络 第一条线:优化算法的演进 DPO (配对偏好) → GRPO (组相对优势) → MV-GRPO (多视角稠密评估) → AR-CoPO (输出空间对比) → CRAFT (证明SFT是GRPO下界) → CRD (中心化消除归一化常数) 这条线索体现了从简单配对比较到更精细的组级优化,再到理论层面的统一理解。CRAFT 的发现尤为重要:它证明了精心筛选数据后的 SFT 本质上就是 GRPO 的一种近似,为实践者提供了"大道至简"的选择。 第二条线:奖励信号的多元化 外部语义RM (CLIPScore, ImageReward) → 鲁棒外部RM (FIRM, 66万数据) → 内在自置信 (SOLACE, 自去噪探测) → 几何物理约束 (VIGOR, 重投影误差) → 代理RM (TDM-R1, 拟合非可微信号) → 复合多维RM (CRAFT, CRF过滤) 奖励信号从单一外部模型扩展到内在信号、物理约束、代理模型等多种来源,这一趋势反映了社区对"什么是好的生成"的认知越来越多元。 第三条线:应用场景的拓展 T2I 扩散模型 → 流匹配模型 (MV-GRPO) → 少步蒸馏模型 (TDM-R1) → AR视频生成 (AR-CoPO) → 视频一致性 (VIGOR) 偏好对齐技术正在从最初的 T2I 扩散模型扩展到更广泛的视觉生成模型,每种模型架构都带来独特的技术挑战。 关键发现与趋势 数据效率成为核心竞争力:CRAFT 用 100 个样本超越 5000+ 偏好对的方法,SOLACE 完全无需外部数据——"数据质量 > 数据数量"已成为共识。 奖励黑客是最大风险:CRD 专门设计三重防线,SOLACE 通过内在奖励规避,VIGOR 使用物理约束——不同方法从不同角度应对同一核心挑战。 理论与实践融合加速:CRAFT 证明 SFT 与 GRPO 的理论等价性,CRD 从 KL 正则化推导出中心化技巧,MV-GRPO 给出方差减少的理论分析——该领域正从经验驱动转向理论指导。 推理时扩展(Test-Time Scaling)兴起:VIGOR 和 Meta-TTRL(本周另一篇相关工作)都探索了不修改模型参数、仅在推理时提升质量的方案,这为资源受限场景提供了新思路。 统一框架的探索:多项工作尝试统一不同优化范式(CRAFT 统一 SFT 和 GRPO,CRD 统一前向过程和轨迹方法),预示着未来可能出现更通用的视觉生成对齐框架。 其他相关工作简述 本周还有多篇相关工作值得关注: GDPO-SR (2603.16769): 将 GRPO 原理融入 DPO 用于一步超分辨率,引入属性感知奖励函数针对平滑/纹理区域差异化评估。 LibraGen (2603.13506): 主题驱动视频生成中的 DPO 应用,提出 Consis-DPO 和 Real-Fake DPO 两种定制化偏好优化管线。 Meta-TTRL (2603.15724): 统一多模态模型的测试时强化学习,利用模型内在元认知信号进行推理时自我改进。 Correlation-Weighted Multi-Reward (2603.18528): 组合生成中的多奖励协调优化,通过相关性加权平衡竞争概念间的奖励冲突。 V2A-DPO (2603.11089): 视频到音频生成的 DPO 框架,提出 AudioScore 综合评分系统。 总结与展望 本期专题梳理了视觉生成模型偏好对齐与 RL 后训练的最新进展。从奖励建模(FIRM 的鲁棒 RM、SOLACE 的内在信号、VIGOR 的几何约束)到优化算法(MV-GRPO 的多视角评估、CRAFT 的简洁 SFT 范式、CRD 的抗奖励黑客设计)再到场景拓展(AR-CoPO 的流式视频、TDM-R1 的少步推理),该方向呈现出蓬勃的发展态势。 未来值得关注的方向: 多模态统一对齐:将偏好对齐扩展到图像+视频+音频的统一生成模型。 在线人类反馈:从离线偏好数据集转向在线、实时的人类反馈闭环。 可解释奖励:让用户和开发者理解"为什么这张图/这段视频被认为是好的"。 超长视频对齐:随着视频生成长度增加,如何在数分钟长度的视频上进行有效的偏好对齐。 安全对齐:在提升质量的同时,确保生成内容的安全性和合规性。 本期专题由 人工智能炼丹师 整理,更多 AIGC 前沿动态请关注 jefxiong.cn