AIGC 每日速读|2026-03-31|LLaDA-TTS|ShotStream

AIGC 视觉生成领域 · 每日论文解读 (2026-03-31)

人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇

今日核心看点

- LLaDA-TTS 掩码扩散2倍加速

- ShotStream 16FPS流式视频

- PackForcing 24倍时间外推

- HyDRA 混合记忆世界模型

- ViGoR 生成推理基准

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。

方向分布:

- 语音合成加速: LLaDA-TTS (掩码扩散TTS)

- 视频生成: ShotStream, PackForcing, DiReCT, HyDRA

- 生成评测: ViGoR-Bench, Identity Collapse

- 图像生成安全: NLCE (CVPR 2026)

- 细粒度生成: TaxaAdapter | 音频分离: AV-CASS

重点论文深度解读

1. LLaDA-TTS: Unifying Speech Synthesis and Zero-Shot Editing via Masked Diffusion Modeling

掩码扩散模型统一语音合成与零样本编辑——50小时微调实现2倍加速 | Unknown (TTS Research Lab) | arXiv:2603.26364

关键词: TTS, 掩码扩散, 零样本编辑, 并行生成, 语音合成

研究动机

核心问题: 自回归TTS推理速度受限于逐token生成,且不支持灵活的语音编辑

基于大语言模型的文本转语音(TTS)系统通过自回归(AR)解码实现了出色的自然度,但生成N个语音token需要N个顺序步骤,推理延迟与序列长度线性相关,严重限制了实时应用。AR解码的顺序依赖性是TTS系统部署的核心瓶颈。同时,现有TTS系统缺乏零样本语音编辑能力——无法对已生成的语音进行词级别的插入、删除和替换操作。这两个问题根源在于AR架构的单向注意力机制限制。

前序工作及局限:

- Tacotron (2017):seq2seq+注意力,质量不稳定,需要大量对齐数据

- FastSpeech (2019):非自回归+时长预测,速度快但韵律自然度不足

- VALL-E (2023):LLM codec token AR,首次实现零样本TTS但推理慢

- CosyVoice (2024-25):AR TTS自然度达到巅峰,但仍受限于逐token自回归生成

与前序工作的本质区别: LLaDA-TTS发现AR与掩码扩散仅是注意力掩码的差异,提出从AR预训练权重直接迁移到MDM的理论框架,仅需50小时微调即可获得2倍推理加速和零样本编辑能力

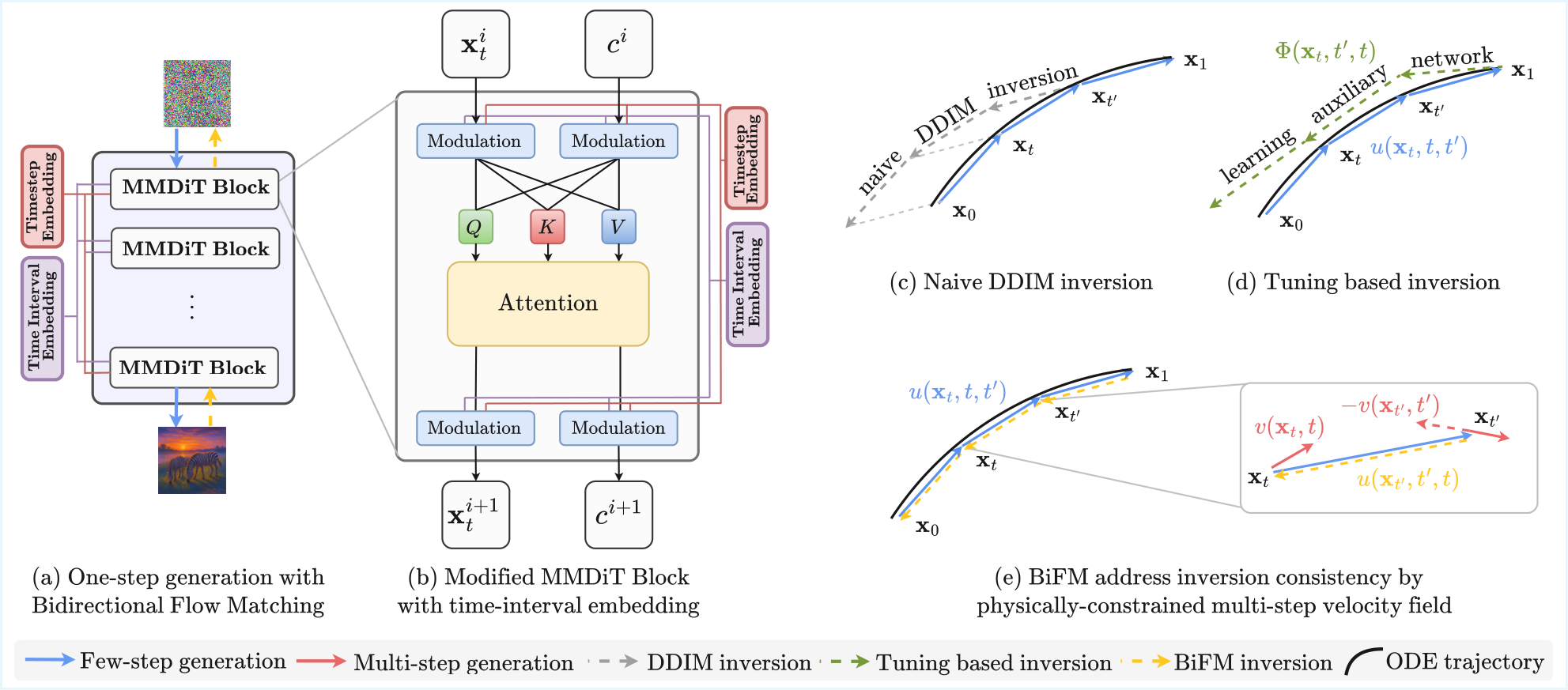

方法原理

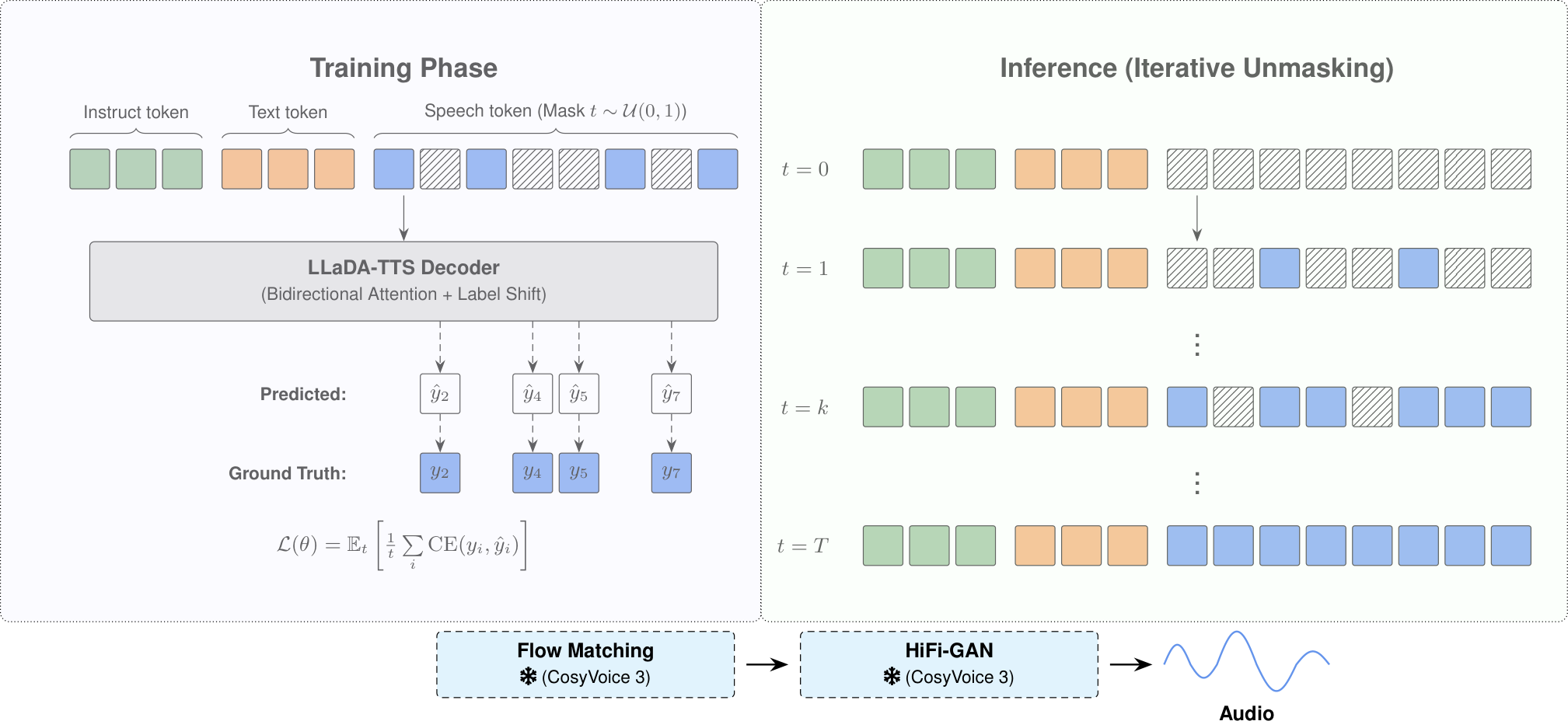

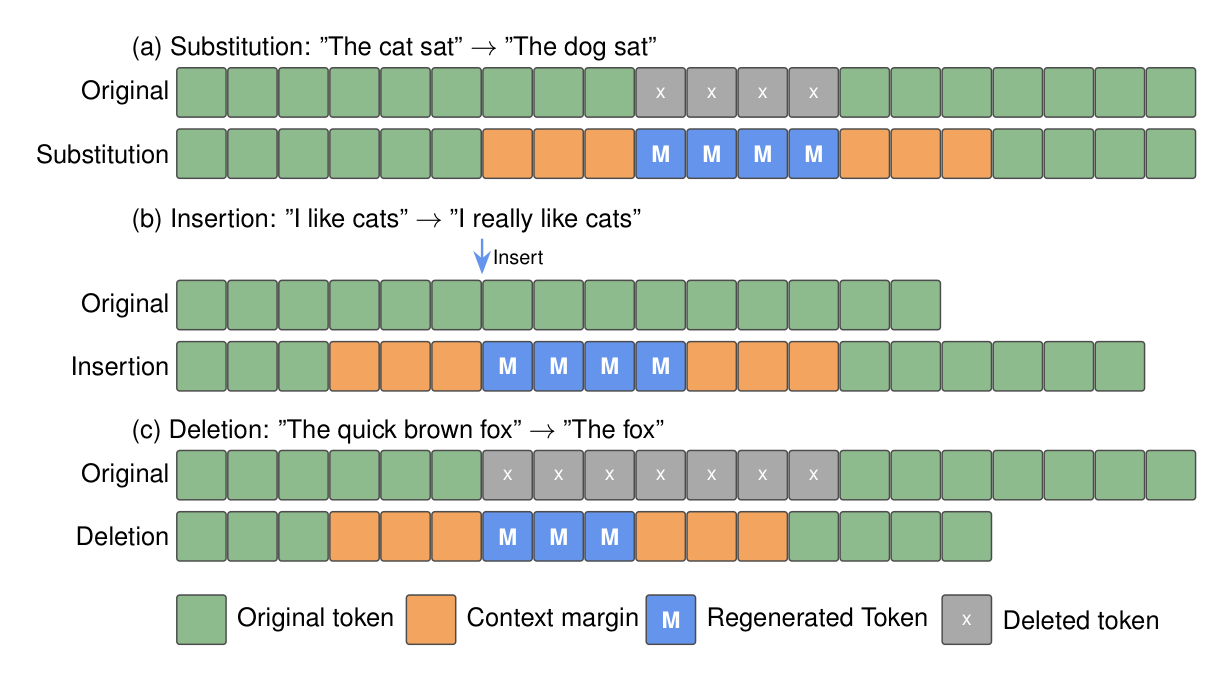

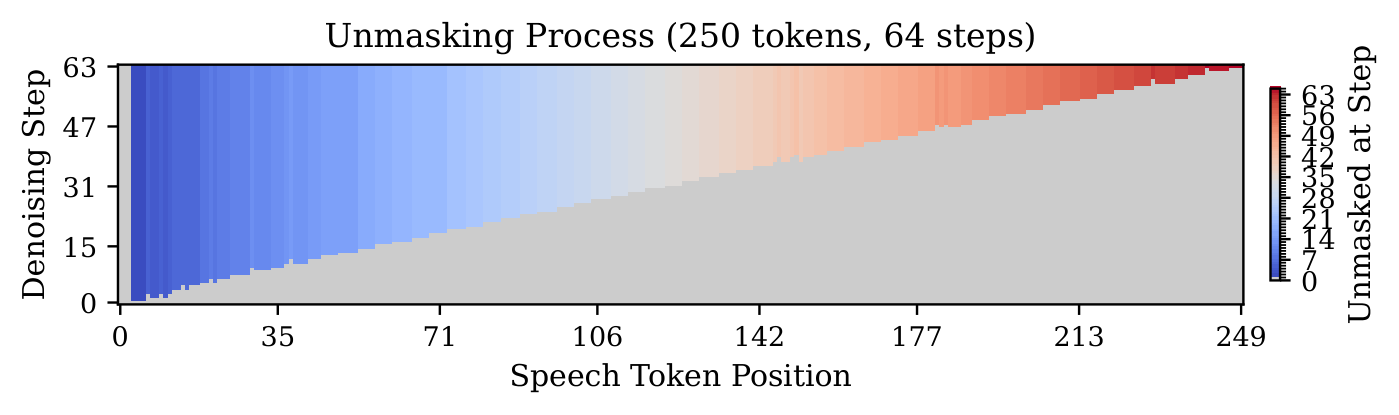

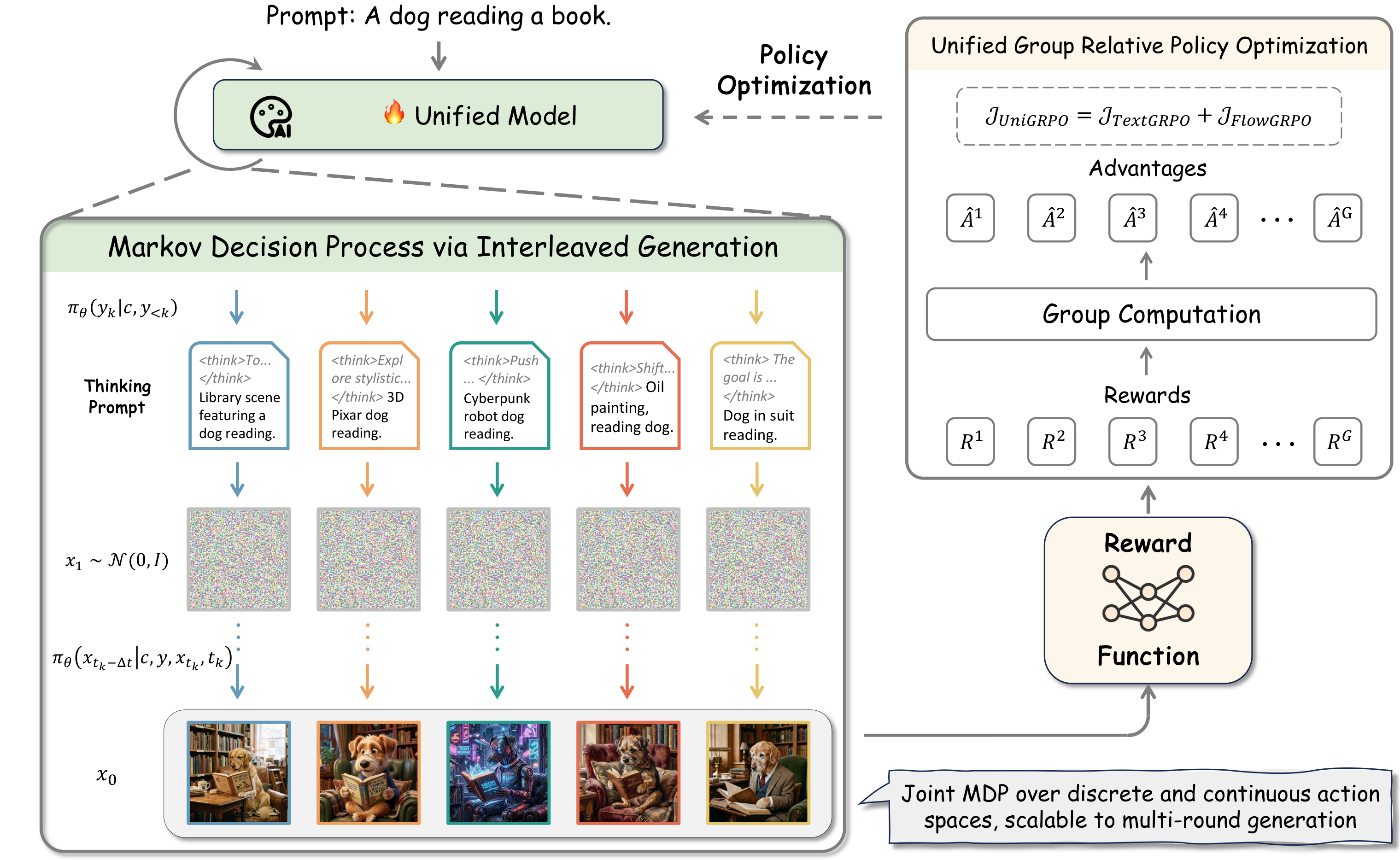

LLaDA-TTS将AR LLM中的自回归解码替换为掩码扩散模型(Masked Diffusion Model),在固定数量的并行步骤中完成生成,从而将推理延迟与序列长度解耦。核心创新点:(1) 仅使用50小时微调数据,通过双向注意力(bidirectional attention)将预训练的AR检查点迁移到掩码扩散范式;(2) 双向架构天然支持零样本语音编辑——包括词级插入、删除和替换,无需额外训练;(3) 该方法仅修改注意力掩码和训练目标,可无缝应用于任何基于LLM的AR TTS系统。理论上证明了AR预训练权重在声学token的局部性属性下,对双向掩码预测是接近最优的,解释了快速收敛。

核心创新

- 首次将掩码扩散模型引入LLM-based TTS,实现AR到并行生成的范式转换

- 仅50小时微调即可完成AR→掩码扩散迁移,极低成本

- 天然支持零样本语音编辑(插入/删除/替换),无需额外训练

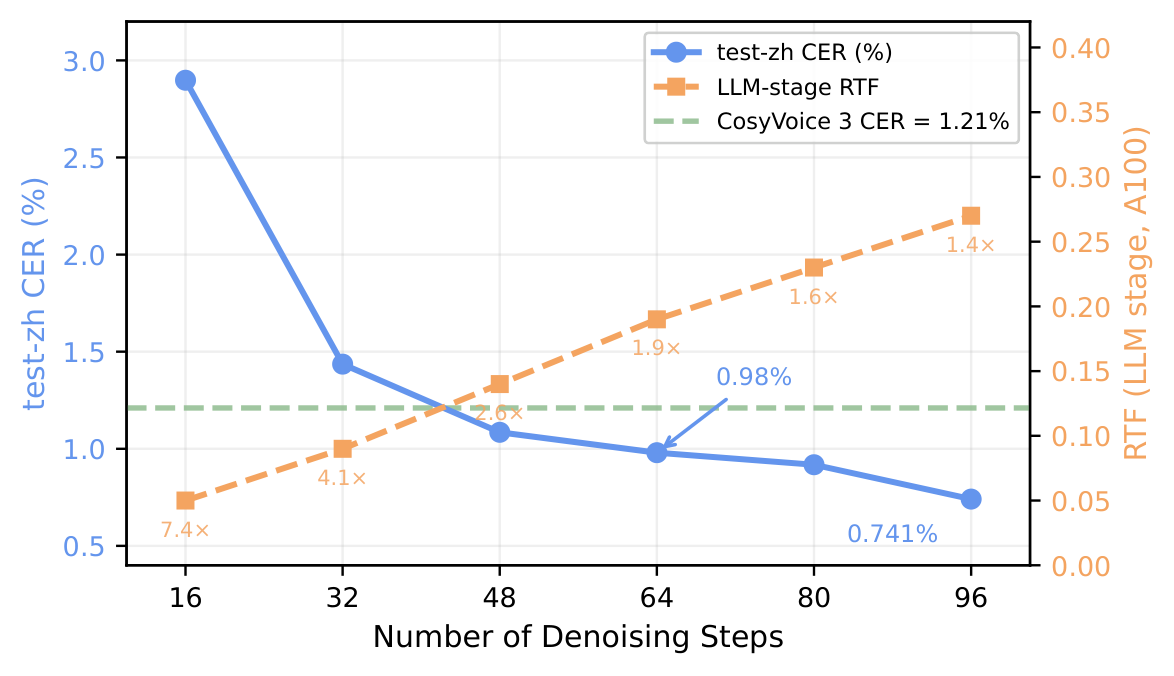

- 倍LLM阶段加速(无KV缓存下),在Seed-TTS-Eval上保持0.98% CER

- 理论证明AR权重对双向掩码预测的近似最优性

实验结果

- 在64步生成时,LLaDA-TTS在Seed-TTS-Eval上实现了0.98% CER(中文)和1.96% WER(英文),与CosyVoice 3基线性能相匹配。LLM阶段实现2倍加速,这是在没有KV缓存优化的情况下取得的显著提速。零样本语音编辑在词级插入、删除和替换任务上表现优异,无需任何额外训练数据。该方法具有通用性,可直接应用于CosyVoice等现有AR TTS系统。

图表详解

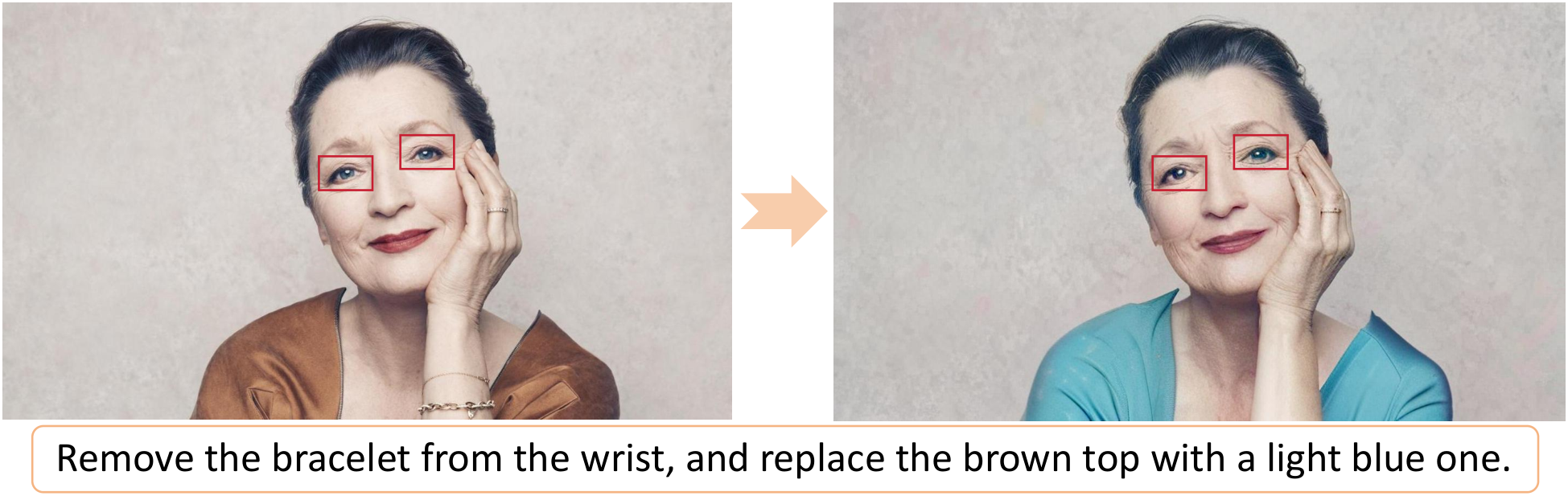

零样本语音编辑示意

LLaDA-TTS的零样本语音编辑能力示意:双向注意力架构天然支持在给定上下文中进行掩码区域的重新生成。通过在目标位置设置掩码,模型可以利用前后双向上下文信息生成新的语音token,从而实现词级别的插入(在指定位置插入新词)、删除(掩码后重新生成跳过目标词)和替换(掩码目标词后用新词重新生成)。

实验结果对比

在Seed-TTS-Eval基准上的性能对比。LLaDA-TTS在64步生成时达到中文CER 0.98%和英文WER 1.96%,与原始CosyVoice 3 AR基线持平。但在LLM阶段实现了显著的2倍加速——这是在没有KV缓存(AR系统严重依赖的优化)的情况下取得的。同时展示了不同步数下的质量-速度权衡曲线。

批判性点评

- 新颖性: 核心贡献是发现AR与掩码扩散只是注意力掩码的差异,提出从AR权重直接迁移到MDM的理论框架,并证明AR预训练权重对MDM是最优初始化——这个洞察非常优雅且有理论支撑。

- 可复现性: 方法基于开源CosyVoice2架构,仅修改注意力掩码+50小时微调,复现门槛极低。但50小时精调数据的质量和配比未详细说明,可能影响复现一致性。

- 影响力: 如果64步推理能进一步压缩到8步以下,将真正改变TTS部署格局。当前方案更像一个优雅的过渡方案——AR的KV缓存优化也在快速推进,速度差距可能缩小。但'AR→MDM一键迁移'的范式价值超越单个应用。

深度点评:

- LLaDA-TTS: 掩码扩散 vs AR — 仅改注意力掩码+50小时微调实现2倍加速+零样本编辑,证明AR权重是MDM最优初始化。优雅但64步仍多于一步蒸馏方案。

- 视频生成进入系统工程阶段 — PackForcing三分区缓存32倍压缩、ShotStream流式蒸馏16FPS实时、DiReCT物理对比学习——从能生成到能部署的范式转变。

- ViGoR-Bench: 推理仍是短板 — 即便GPT-4o在视觉推理推理任务上仍大面积失败,证明当前MLLM的视觉推理能力被高估,需要更精细的benchmark推动进步。

技术演进定位: 处于AR TTS向并行生成范式过渡的关键节点——既保留了AR预训练的质量优势,又获得了扩散模型的并行性和可编辑性

可能的后续方向:

- 推理步数从64步压缩到8步以下(一步蒸馏)

- 与KV缓存优化的AR方案在更大规模数据上进行公平对比

- 扩展到多模态生成领域(音乐/音效/歌声合成)

- 探索掩码扩散在视觉和语言大模型中的迁移应用

其余论文 · 贡献与效果总结

| # | 论文 | 机构 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|---|

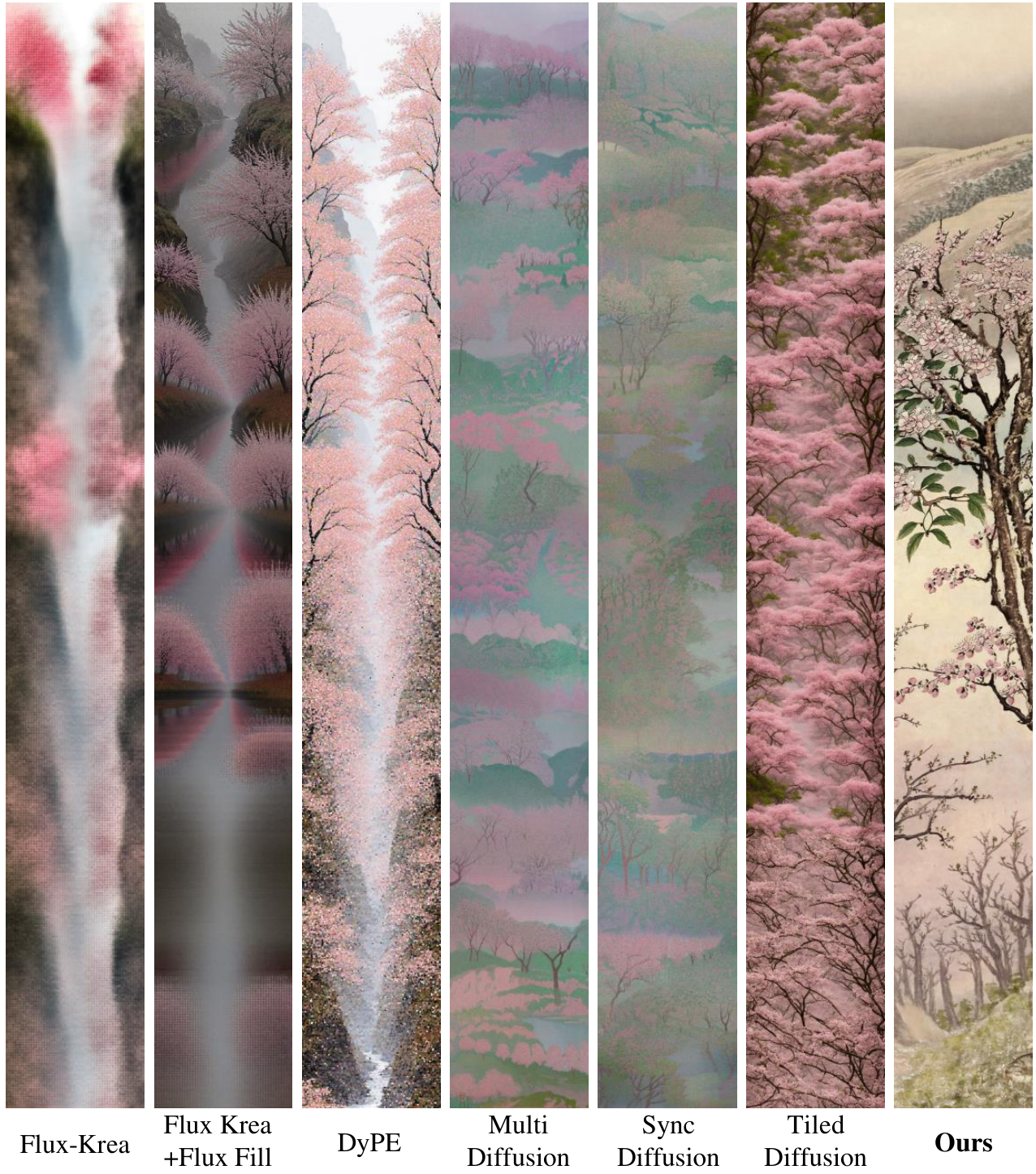

| 1 | ShotStream (ShotStream: Streaming Multi-Shot Video Generation for Interactive Storytelling) | Unknown | 流式视频生成·多镜头叙事·因果架构·蒸馏·实时 | 首个流式多镜头视频生成框架,通过因果架构实现交互式叙事。双缓存记忆(全局+局部)保持跨镜头一致性,两阶段蒸馏消除误差累积。 | 单GPU 16 FPS生成,亚秒延迟,质量匹配或超越更慢的双向模型。HF 110赞。 |

| 2 | PackForcing (PackForcing: Short Video Training Suffices for Long Video Sampling and Long Context Inference) | Shanda AI Research Tokyo | 长视频生成·KV缓存压缩·时间外推·自回归扩散·32倍压缩 | 提出三分区KV缓存策略(Sink/Mid/Recent tokens)实现分层上下文压缩,仅4GB有界KV缓存即可生成2分钟长视频。Mid tokens通过双分支网络实现32倍token压缩。 | 单H200 GPU生成2分钟832x480@16FPS视频,24倍时间外推(5s→120s)。VBench时间一致性26.07,动态度56.25,均为SOTA。 |

| 3 | DiReCT (DiReCT: Disentangled Regularization of Contrastive Trajectories for Physics-Refined Video Generation) | Ohio State University | 物理视频生成·对比流匹配·语义解纠缠·物理常识·后训练 | 揭示了对比流匹配中的语义-物理纠缠问题,提出宏观+微观双尺度对比正则化,LLM扰动构建物理困难负样本(运动学、力、材料、交互)。 | 应用于Wan 2.1-1.3B,VideoPhy物理常识得分比基线提高16.7%,比SFT提高11.3%,无额外训练时间。 |

| 4 | HyDRA (Out of Sight but Not Out of Mind: Hybrid Memory for Dynamic Video World Models) | HUST, Kuaishou | 视频世界模型·混合记忆·动态物体跟踪·视野外连续性·数据集 | 提出混合记忆范式,要求视频世界模型同时作为静态背景档案员和动态物体跟踪器。构建HM-World数据集(59K片段,17场景49主体),提出HyDRA时空相关检索架构。 | 动态物体一致性和整体生成质量显著优于SOTA。HF 133赞(当日最高)。 |

| 5 | ViGoR-Bench (ViGoR-Bench: How Far Are Visual Generative Models From Zero-Shot Visual Reasoners?) | Tsinghua University, Meituan | 生成评测·推理基准·跨模态·细粒度诊断·性能幻象 | 提出ViGoR统一评测框架,通过四大创新(跨模态覆盖、双轨评估、证据驱动自动评判、细粒度诊断)系统揭示生成模型的推理缺陷。 | 评测20+领先模型,发现即使SOTA系统仍存在显著推理缺陷。首次建立生成模型推理能力的系统性压力测试。 |

| 6 | Identity Collapse (When Identities Collapse: A Stress-Test Benchmark for Multi-Subject Personalization) | Unknown | 多主体个性化·身份崩溃·压力测试·SCR指标·CVPR 2026 | 揭示多主体个性化的可扩展性幻觉:模型在2-4主体时表现良好但6-10主体时灾难性崩溃。构建75提示压力测试基准,提出SCR(主体崩溃率)新指标。 | MOSAIC/XVerse/PSR等SOTA模型在10主体时SCR接近100%。CVPR 2026 Workshop。 |

| 7 | NLCE (Neighbor-Aware Localized Concept Erasure in Text-to-Image Diffusion Models) | Unknown | 概念擦除·免训练·邻近感知·扩散模型安全·CVPR 2026 | 提出邻近感知局部概念擦除(NLCE)三阶段免训练框架:频谱加权嵌入调制→注意力引导空间门控→空间门控硬擦除,在移除目标概念时保护邻近概念。 | 在Oxford Flowers/Stanford Dogs上擦除目标概念的同时更好保留相关类别。CVPR 2026。 |

| 8 | TaxaAdapter (TaxaAdapter: Vision Taxonomy Models are Key to Fine-grained Image Generation over the Tree of Life) | Ohio State University, MIT | 细粒度生成·视觉分类·BioCLIP·物种保真·适配器 | 将视觉分类模型(BioCLIP)嵌入注入冻结的T2I扩散模型,在保持姿势/风格文本控制的同时提升物种级保真度。引入MLLM-based形态一致性指标。 | 形态保真度和物种身份准确性始终优于基线。少样本和零样本物种生成均有效泛化。 |

| 9 | AV-CASS (Cinematic Audio Source Separation Using Visual Cues) | KAIST | 电影音频分离·视听生成·条件流匹配·CVPR 2026·跨模态 | 首个视听电影音频源分离(AV-CASS)框架,用条件流匹配将CASS表述为条件生成建模,设计双流视觉编码器(面部+场景)增强分离质量。 | 完全合成数据训练即可泛化到真实电影内容。CVPR 2026。 |

趋势观察

- TTS范式转换:AR→掩码扩散 — LLaDA-TTS仅修改注意力掩码即将AR TTS转为并行生成,50小时微调2倍加速。这预示着LLM-based TTS可能全面拥抱非自回归架构。

- 长视频生成突破KV缓存瓶颈 — PackForcing的三分区KV缓存+32倍压缩实现4GB有界内存生成2分钟视频,ShotStream的双缓存蒸馏实现16FPS流式多镜头。

- 物理一致性成为视频生成新战场 — DiReCT的宏微对比解纠缠和HyDRA的混合记忆都瞄准物理真实性——视频生成正从视觉质量转向物理合规。

- 生成评测进入深水区 — ViGoR-Bench揭示SOTA生成模型推理短板,Identity Collapse暴露多主体个性化的可扩展性幻觉。评测不再只看FID。

- 安全与可控性持续升温 — NLCE的邻近感知概念擦除(CVPR 2026)和AV-CASS的条件流匹配音频分离(CVPR 2026)表明安全可控是发表热点。

人工智能炼丹师 整理 | 2026-03-31

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描文末二维码关注

评论 (0)