AIGC 每日速读|2026-03-27|ScrollScape|OmniWeaving

AIGC 视觉生成领域 · 每日论文解读 (2026-03-27)

人工智能炼丹师 整理 | 共 10 篇论文 | 重点深度解读 1 篇

今日核心看点

- 32K超高分辨率图像生成 ScrollScape

- 统一视频生成 OmniWeaving

- 扩散加速 HetCache CVPR2026

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 10 篇,重点解读 1 篇。

方向分布:

- 图片生成与编辑: 4篇 (ScrollScape, DepthArb, HAM, GenMask)

- 视频生成与编辑: 3篇 (OmniWeaving, HetCache, Anti-I2V)

- 音频生成: 1篇 (ArrayDPS-Refine)

- 生成安全与检测: 1篇 (HAVIC)

- 交互运动生成: 1篇 (ViHOI)

含2篇CVPR 2026 (HetCache, HAM)

重点论文深度解读

1. ScrollScape

用视频扩散先验解锁32K超高分辨率图像生成 | Harbin Institute of Technology, Li Auto | arXiv:2603.24270

关键词: 32K图像生成, 视频扩散先验, 极端纵横比, 超分辨率

研究动机

核心问题: 极端纵横比下的超高分辨率图像生成面临物体重复和空间碎片化问题

当前扩散模型在生成常规尺寸图像时表现出色,但在极端纵横比(如8:1)的超高分辨率图像合成中,往往出现灾难性的结构失败——物体重复和空间碎片化。这根本原因在于静态文生图模型缺乏鲁棒的空间先验。ScrollScape 提出了一个全新范式:将超大画布的空间扩展映射到视频帧的时序演变,利用视频模型的时序一致性作为强大的全局约束。

前序工作及局限:

- MultiDiffusion:通过联合扩散过程实现全景图生成,但受限于局部一致性

- SyncDiffusion:同步多个扩散过程减少接缝,但仍有结构冗余

- DyPE:动态位置编码扩展生成尺寸,但在极端比例下效果有限

- Wan2.1:视频扩散模型,具有强大的时序一致性先验,但未被用于静态图像生成

与前序工作的本质区别: ScrollScape首次将空间扩展问题转化为视频时序问题,利用视频模型天然的时序一致性替代人工设计的空间融合策略。不同于MultiDiffusion等平铺融合方法,ScrollScape的全局坐标系统通过ScanPE实现端到端的结构约束。

方法原理

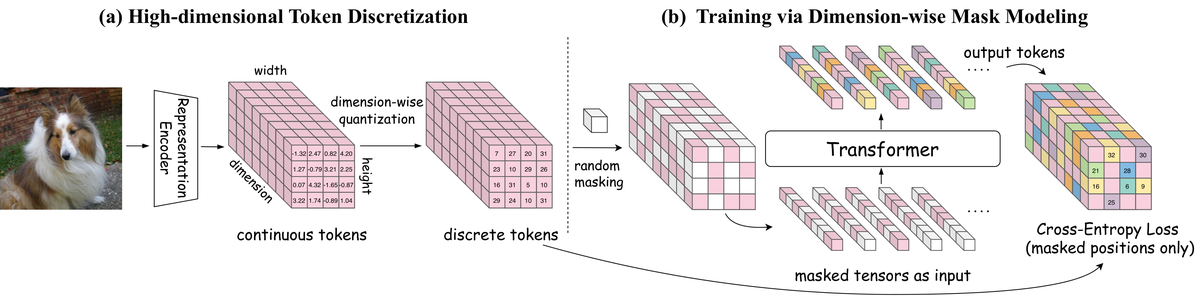

ScrollScape 框架包含三个核心创新:

1)扫描位置编码(ScanPE):将全局空间坐标分布到各帧,充当灵活的移动相机,支持线性和蛇形扫描模式

2)滚动超分辨率(ScrollSR):在潜在空间利用视频超分辨率扩散先验逐帧增强细节,绕过内存瓶颈

3)轨迹锚定分区(TAP):确保3D VAE解码器的解码状态与坐标系统对齐,消除帧间闪烁和边界伪影

4)中值共识选择(MCS)+加权融合:从每个时间块选择最具代表性的帧,通过距离权重融合生成无缝全景图

核心创新

- 首次将极端纵横比图像合成重新表述为连续视频生成过程

- 提出ScanPE扫描位置编码将空间扩展映射为时序演变

- 设计ScrollSR在潜在空间实现32K分辨率输出

- 引入TAP轨迹锚定分区消除3D VAE解码伪影

实验结果

- 在8:1纵横比评估中,ScrollScape 在所有指标上均优于基线:FID 214.7(最优)、CLIP 30.0(最优)、KID 2.0(最优)。用户研究中92%的评估员认为ScrollScape的结构连贯性优于DyPE,89%认为内容丰富度更好。消融实验证实ScanPE、TAP、ScrollSR每个组件都不可或缺。仅需3000张图像微调即可实现从传统卷轴到照片级全景的32K输出。

批判性点评

- 新颖性: 核心创新——将空间扩展映射为时序演变——极具新颖性和优雅性。ScanPE的数学形式简洁清晰,TAP和MCS的设计也有针对性。但ScrollSR模块本质是套用现有视频超分技术,原创性相对有限。整体框架对Wan2.1的依赖较强,换用其他视频扩散模型的效果未验证。

- 可复现性: 基于开源Wan2.1-T2V-1.3B,训练仅需2×A100+3K图像数据集,推理单张A100(80GB)可完成。训练成本极低,但代码尚未开源。方法描述详细,公式完整,理论上可独立复现。

- 影响力: 为超高分辨率图像生成提供了全新且优雅的范式,对数字长卷、全景摄影、游戏地图等应用有直接实用价值。视频扩散先验→空间扩展的跨界思路可能启发更多创新工作。但单张A100推理32K的效率和质量在商业场景中是否足够仍需验证。

深度点评:

- 创新亮点:空间→时序的范式转换 — 将32K图像生成重新表述为视频扫描是极具想象力的创新。ScanPE用移动相机隐喻优雅解决了全局坐标一致性问题。

- 局限:数据和场景覆盖不足 — 仅3000张训练数据且集中在风景/山水画类型。人物、城市等复杂场景能力未验证。8:1评估协议的合理性也值得讨论。

- 工程价值:极低训练成本 — 2×A100训练+单卡推理32K,训练数据仅3K张。极低的资源门槛使其适合学术实验室和创业团队。

技术演进定位: 处于图像生成与视频生成的交叉点,开创了用视频先验赋能图像合成的新范式。在超高分辨率生成领域具有里程碑意义。

可能的后续方向:

- 扩展到任意纵横比和非矩形画布(如环形全景、球面映射)

- 结合更强大的视频扩散模型(如Sora类模型)提升质量

- 探索交互式32K内容生成(用户可编辑局部区域)

- 将视频-图像范式迁移到3D场景和纹理生成

其余论文 · 贡献与效果总结

| # | 论文 | 机构 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|---|

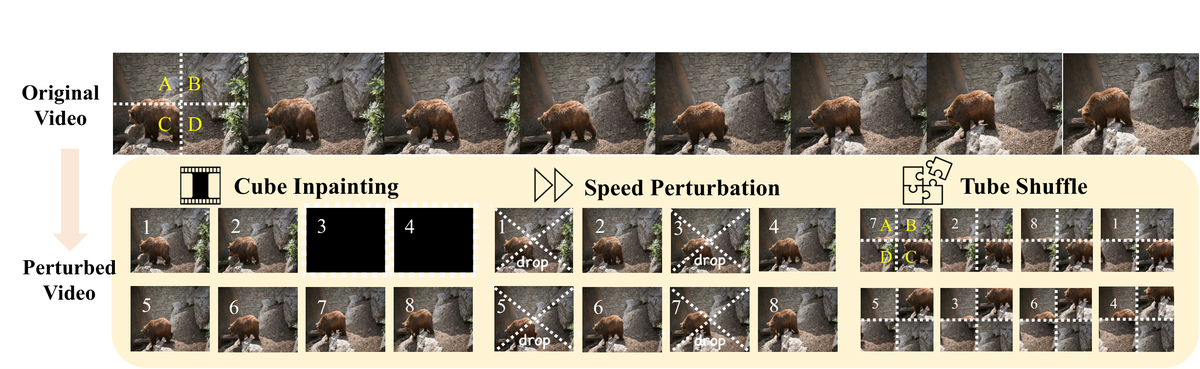

| 1 | OmniWeaving (OmniWeaving: Towards Unified Video Generation with Free-form Composition and Reasoning) | Zhejiang University, Tencent Hunyuan, NTU | 统一视频生成·推理增强·MLLM·腾讯混元 | 提出统一视频生成模型OmniWeaving,采用MLLM+MMDiT+VAE架构,通过激活思维模式实现推理增强视频生成,并引入IntelligentVBench评测基准。在开源统一模型中达到SOTA。 | 在IntelligentVBench上,开启思维模式的OmniWeaving在Implicit I2V和Compositional MI2V指标上分别达到3.93和4.31(AVG),显著超越VACE-LTX和VINO等基线。 |

| 2 | HetCache (Accelerating Diffusion-based Video Editing via Heterogeneous Caching (CVPR 2026)) | NTU, SJTU, PolyU HK | 视频编辑加速·异构缓存·DiT·CVPR2026 | 提出免训练扩散加速框架HetCache,通过将DiT中的时空Token分为上下文Token和生成Token并选择性缓存,实现了2.67倍延迟加速和FLOPs削减。 | 实现2.67x延迟加速和FLOPs削减,编辑质量几乎无损。已被CVPR 2026接收。 |

| 3 | HAM (HAM: A Training-Free Style Transfer Approach via Heterogeneous Attention Modulation (CVPR 2026)) | Hangzhou Dianzi University | 风格迁移·注意力调制·免训练·CVPR2026 | 提出免训练风格迁移方法HAM,通过全局注意力调节(GAR)和局部注意力移植(LAT)两种异构注意力调制策略,解决扩散模型风格迁移中的风格-内容平衡难题。 | 在多项定量指标上达到SOTA性能,成功在保持内容身份的同时捕获复杂风格参考。已被CVPR 2026接收。 |

| 4 | DepthArb (DepthArb: Training-Free Depth-Arbitrated Generation for Occlusion-Robust Image Synthesis) | Xi'an Jiaotong University | 遮挡生成·深度仲裁·免训练·组合生成 | 提出免训练框架DepthArb,通过注意力仲裁调制(AAM)和空间紧凑性控制(SCC)两种机制解决文生图模型的遮挡关系歧义问题,并引入OcclBench评测基准。 | 在遮挡准确性和视觉保真度上一致超越SOTA基线,作为即插即用方法可无缝增强扩散模型的组合能力。 |

| 5 | GenMask (GenMask: Adapting DiT for Segmentation via Direct Mask Generation) | Shanghai Jiao Tong University, Alibaba | DiT分割·生成式分割·掩码生成·统一架构 | 提出GenMask,首次让DiT直接在RGB空间生成黑白分割掩码和彩色图像,发现VAE对二值掩码的潜在表示具有独特的噪声鲁棒性和线性可分特征,设计了针对性的时间步采样策略。 | 在referring和reasoning分割基准上达到SOTA性能,完全保持DiT原始架构不变。 |

| 6 | Anti-I2V (Anti-I2V: Safeguarding your photos from malicious image-to-video generation) | VinAI Research | 对抗防御·图转视频·安全保护·DiT防御 | 提出Anti-I2V防御框架,在LAB和频域空间操作对抗噪声,保护照片免受恶意图像转视频模型的滥用,首次系统性针对DiT架构的视频扩散模型进行防御。 | 在多种视频扩散模型上展现SOTA防御效果,有效降低生成视频的时序一致性和保真度。 |

| 7 | HAVIC (Leave No Stone Unturned: Uncovering Holistic Audio-Visual Intrinsic Coherence for Deepfake Detection) | Harbin Institute of Technology | 深伪检测·音视频一致性·跨模态·数据集 | 提出HAVIC深度伪造检测器,基于音视频固有一致性先验(模态内结构一致性+跨模态微观/宏观一致性),并发布HiFi-AVDF高保真音视频深度伪造数据集。 | 在最具挑战的跨数据集场景中,AP和AUC分别提升9.39%和9.37%,显著超越现有SOTA方法。 |

| 8 | ArrayDPS-Refine (ArrayDPS-Refine: Generative Refinement of Discriminative Multi-Channel Speech Enhancement) | Meta Reality Labs | 语音增强·扩散先验·多通道·免训练 | 提出ArrayDPS-Refine,利用干净语音扩散先验来精炼判别式多通道语音增强模型的输出。无需重训练,阵列无关,可直接提升任意判别式模型的性能。 | 一致性提升多种判别式模型(含波形域和STFT域SOTA模型)的语音增强性能。 |

| 9 | ViHOI (ViHOI: Human-Object Interaction Synthesis with Visual Priors) | South China University of Technology | 人物交互·视觉先验·运动生成·VLM | 提出ViHOI框架,从2D图像中提取交互先验来增强3D人物-物体交互运动生成,利用VLM作为先验提取引擎,设计Q-Former适配器压缩高维特征为紧凑先验Token。 | 在多个基准上达到SOTA,展现优越的泛化能力(可推广到未见物体和交互类别)。 |

趋势观察

- 视频先验赋能图像生成 — ScrollScape将超大画布生成转化为视频扫描任务,利用视频模型的时序一致性保证空间结构完整性,开辟了图像-视频范式互通的新方向。

- 统一视频生成模型的推理增强 — OmniWeaving通过激活MLLM的思维模式,让视频生成模型具备推理能力,从被动特征提取升级为主动意图推断,是多模态理解与生成深度融合的代表。

- 免训练方法持续升温 — HetCache、HAM、DepthArb等多篇论文均采用免训练策略,通过精巧的注意力操控实现特定目标,反映了社区对即插即用、低成本方案的强烈需求。

- 扩散模型安全与对抗 — Anti-I2V和HAVIC分别从防御和检测角度应对扩散模型滥用问题,DiT架构的对抗鲁棒性成为新的研究热点。

- 生成模型架构的跨界适配 — GenMask让DiT直接生成分割掩码,ScrollScape用视频模型做图片,展示了生成架构的通用性远超原始设计意图。

人工智能炼丹师 整理 | 2026-03-27

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描文末二维码关注

评论 (0)