AIGC 每日速读|2026-03-24|CubiD高维离散扩散|扩散通用加速|FoleyDirector V2A|

AIGC 视觉生成领域 · 每日论文解读 (2026-03-24)

人工智能炼丹师 整理 | 共 12 篇论文 | 重点深度解读 3 篇

今日核心看点

- 高维离散扩散

- 统一生成理解

- 通用扩散加速

- V2A时序控制

- 个性化视频生成

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 12 篇,重点解读 3 篇。

方向分布:

- 图像生成与编辑 — 4 篇(CubiD、妆容迁移、I2I整流流、统一多模态)

- 视频生成 — 2 篇(LumosX 个性化、MME-CoF-Pro 评测)

- 音频生成 — 3 篇(FoleyDirector V2A、Borderless Long Speech、MOSS-TTSD)

- 生成模型加速 — 1 篇(时间步感知块掩码)

- 评测与质量评估 — 2 篇(TATAR 统一IQA+IAA、PGD-EIQA 去偏)

含 2 篇 CVPR 2026 + 1 篇 ICLR 2026

重点论文深度解读

1. CubiD: Cubic Discrete Diffusion for High-Dim Tokens

首个高维离散扩散生成 | HKU + Google + ByteDance | arXiv:2603.19232

关键词: 离散扩散, 高维表示, 统一生成理解, ImageNet SOTA

研究动机

离散 Token 视觉生成因能与语言模型共享统一的 Token 预测范式而备受关注,但当前方法局限于低维潜在 Token(通常 8-32 维),牺牲了对理解任务至关重要的语义丰富性。高维预训练表示(768-1024 维)理论上可弥补这一鸿沟,然而其离散化生成面临根本性挑战——维度爆炸导致码本大小和生成步数均不可控。

方法原理

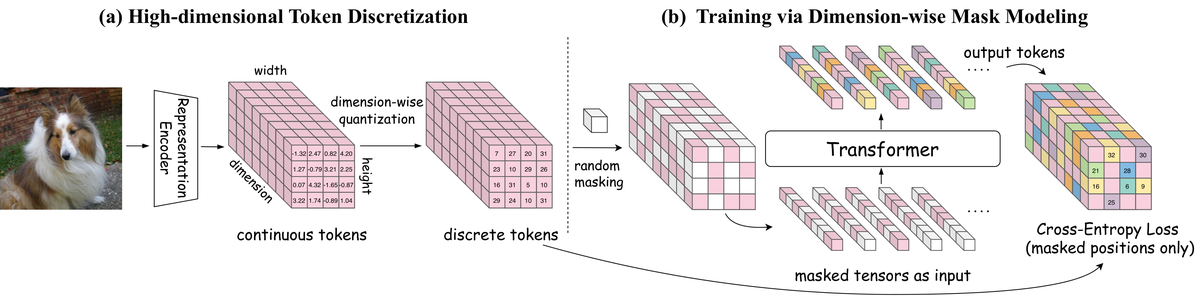

CubiD 提出在高维离散表示上进行「细粒度掩码扩散」。核心思想是:对高维离散表示的任意维度、任意位置都可以独立掩码和预测。具体包括:(1) 将预训练的 768/1024 维连续表示通过残差向量量化离散化;(2) 在扩散过程中,每个空间位置的每个维度都可被独立掩码,模型从部分观测中预测缺失维度;(3) 这使模型能学习空间位置内部和跨位置的丰富关联,且生成步数固定为 T(T 远小于 h×w×d),不随维度增长;(4) 从 900M 扩展到 3.7B 参数展现出强 Scaling 行为。

核心创新

- 首个面向高维(768-1024维)表示的离散扩散生成模型

- 细粒度维度级掩码策略:任意维度任意位置可独立掩码预测

- 生成步数与特征维度解耦(T << h×w×d)

- 验证离散化 Token 同时支持理解和生成任务

- M-3.7B 参数强 Scaling 行为

实验结果

- ImageNet-256 上达到离散生成方法 SOTA,从 900M 到 3.7B 展现强 Scaling 行为。关键验证:离散化后的 Token 保留了原始表示的理解能力,证明同一组离散 Token 可同时服务于理解和生成任务。代码已开源。

方法流程

- 预训练表示 — 768/1024维连续特征(如DINOv2/CLIP)

- 残差向量量化 — RVQ离散化为高维Token序列

- 细粒度维度掩码 — 任意位置任意维度独立掩码

- 条件扩散预测 — 从部分观测预测缺失维度

- 位置内+跨位置关联 — 同时建模局部和全局依赖

- 固定T步生成 — 步数与维度解耦 T<<hwd

技术脉络

核心问题: 离散 Token 生成局限于低维(8-32维),无法利用高维预训练表示

前序工作及局限:

- MaskGIT (Chang 2022):掩码图像建模范式,但限于低维 VQ-VAE Token

- MAGVIT-v2 (Yu 2024):改进离散 Tokenizer,仍为 32 维以下

- MAR (Li 2024):掩码自回归模型,连续/离散混合但维度受限

- LlamaGen (Sun 2024):用 LLM 架构做视觉生成,仍依赖低维码本

与前序工作的本质区别: CubiD 首次突破维度限制,在 768-1024 维上实现细粒度维度级掩码扩散,且生成步数不随维度增长

技术演进定位: 开辟了「高维离散扩散」新赛道,为 vision-language 统一架构提供了新范式

可能的后续方向:

- 更高分辨率(512+)的高维离散生成

- 视频领域的高维离散扩散

- 与 LLM 的原生融合统一架构

批判性点评

- 实验评估: 在 ImageNet-256 上对比了多种离散生成方法,展示了 Scaling 行为。但缺少 FID/IS 等具体数值对比表,也未在 T2I 场景下与 SDXL/DALL-E 3 等连续方法直接对比。

- 新颖性: 首次将离散扩散扩展到高维表示(768-1024维),维度级掩码策略新颖度高。但 RVQ 离散化本身是已有技术,核心贡献在于将掩码扩散泛化到高维。

- 可复现性: 代码已开源(GitHub),数据集为公开的 ImageNet。但 3.7B 模型的训练成本可能限制社区复现。

- 影响力: 可能推动统一 vision-language 架构的发展。如果高维离散 Token 真正兼顾理解和生成,将对多模态基础模型产生深远影响。

2. Timestep-Aware Block Masking for Diffusion Acceleration

架构无关扩散加速 | 武汉大学 | arXiv:2603.19939

关键词: 扩散加速, 块掩码, 架构无关, 特征复用

研究动机

扩散概率模型在图像生成方面取得了巨大成功,但迭代去噪的特性导致推理延迟较高。现有加速方法要么需要全链反向传播(内存开销大),要么绑定特定架构。如何实现一种内存高效、架构无关的扩散加速方法是核心问题。

方法原理

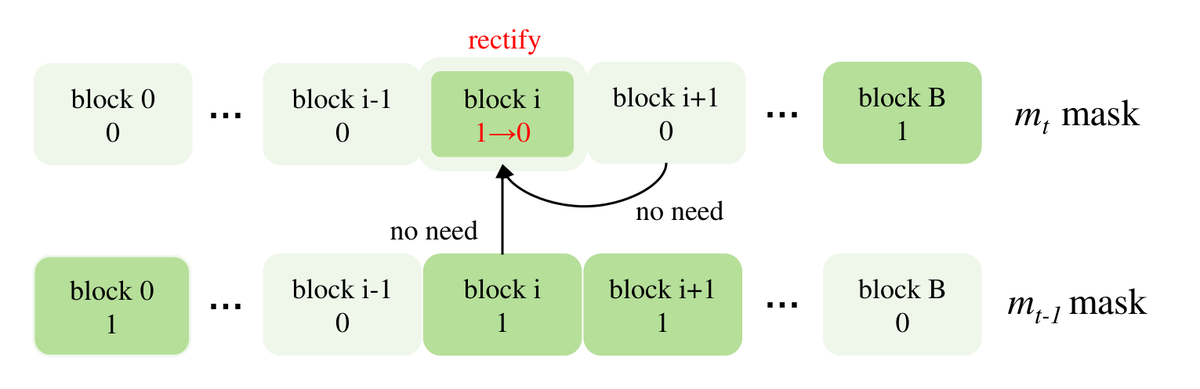

提出时间步感知块掩码(Timestep-Aware Block Masking)框架。核心思路:对预训练扩散模型的计算图进行逐时间步优化。(1) 学习时间步特异性掩码(per-timestep masks),在每个推理阶段动态决定哪些 Block 执行完整计算、哪些通过特征复用绕过;(2) 独立优化每个时间步的掩码(而非全链反向传播),确保内存高效训练;(3) 引入时间步感知损失缩放机制,在敏感的去噪阶段优先保证特征保真度;(4) 辅以知识引导的掩码修正策略,修剪冗余的时空依赖关系。

核心创新

- 架构无关:同一框架适用于 DDPM、LDM、DiT、PixArt 四种主流架构

- 逐时间步独立优化掩码,避免全链反向传播的高内存开销

- 时间步感知损失缩放:敏感阶段保真度优先

- 知识引导掩码修正:智能修剪冗余时空依赖

实验结果

- 在 DDPM、LDM、DiT 和 PixArt 四种架构上均展示了显著的效率提升。将去噪过程视为一系列优化的计算路径,在采样速度和生成质量之间实现了优越的平衡。代码将公开发布。

方法流程

- 预训练扩散模型 — 支持DDPM/LDM/DiT/PixArt

- 逐时间步掩码学习 — 独立优化每步的Block选择

- 损失缩放机制 — 敏感阶段高权重保真度优先

- 掩码修正策略 — 知识引导修剪冗余依赖

- 动态Block跳过 — 低贡献Block特征复用

- 加速推理输出 — 速度-质量最优平衡

技术脉络

核心问题: 扩散模型推理慢,现有加速方法绑定特定架构或需高内存全链优化

前序工作及局限:

- DDIM (Song 2021):减少采样步数的非马尔可夫加速

- DPM-Solver (Lu 2022):高阶 ODE 求解器加速采样

- DeepCache (Ma 2024):缓存 U-Net 特征跨步复用,绑定 U-Net 架构

- Token Merging (Bolya 2023):合并冗余 Token 减少计算量

与前序工作的本质区别: Timestep-Aware Block Masking 是架构无关的:同一框架直接适用于 DDPM/LDM/DiT/PixArt,且通过逐步独立优化避免全链反向传播的内存瓶颈

技术演进定位: 在扩散加速领域建立了首个「架构无关」通用框架的先例

可能的后续方向:

- 与步数蒸馏方法结合实现多维加速

- 扩展到视频扩散模型

- 在移动端部署场景的适配

批判性点评

- 实验评估: 覆盖 DDPM/LDM/DiT/PixArt 四种架构,实验全面性好。但缺少与 DeepCache、FORA 等最新 cache 方法的定量对比。加速比和质量损失的 trade-off 曲线有待补充。

- 新颖性: 逐时间步独立优化掩码思路清晰,时间步感知损失缩放有理论依据。但 Block 跳过/特征复用的整体思路与 Token Merging、DeepCache 类似,差异化主要在于掩码学习策略。

- 可复现性: 代码承诺公开但尚未发布。方法依赖少量校准数据训练掩码,流程相对简单可复现。

- 影响力: 架构无关的特性使其具有广泛适用性。若能在实际产品级部署中验证(如 SDXL/Flux),工程价值将非常高。

3. FoleyDirector: Fine-Grained V2A Temporal Control

细粒度 V2A 时序控制 | CVPR 2026 | arXiv:2603.19857

关键词: V2A, 时序控制, DiT音频, CVPR 2026

研究动机

视频到音频(V2A)方法已能合成高质量音频,但在多事件场景或视觉线索不足时(小区域、画外音、遮挡物体),细粒度时序控制仍是难题。现有方法无法精确指定每个时间段应生成什么声音,限制了创作灵活性。

方法原理

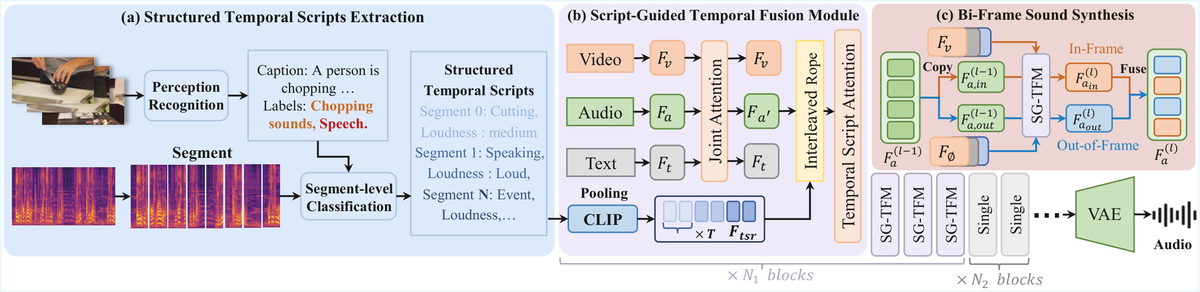

FoleyDirector 是首个在 DiT 基架构上实现精确时序引导的 V2A 生成框架。核心创新包括:(1) 结构化时序脚本(STS):将音频描述分解为对应短时间片段的字幕集合,提供丰富的时序信息;(2) 脚本引导时序融合模块:使用 Temporal Script Attention 将 STS 特征与视频特征连贯融合;(3) 双帧声音合成(Bi-Frame Sound Synthesis):并行生成画面内和画面外音频,处理复杂多事件场景;(4) 构建 DirectorSound 数据集和 DirectorBench 评测基准。

核心创新

- 首个在 DiT 基 V2A 模型上实现精确时序引导

- 结构化时序脚本(STS)提供细粒度音频描述

- 双帧声音合成:画内+画外音频并行生成

- DirectorSound 数据集 + DirectorBench 评测

实验结果

- 实验表明 FoleyDirector 在保持高音频保真度的同时大幅提升了时序可控性。在 VGGSoundDirector 和 DirectorBench 上展示了 SOTA 的时序控制能力,用户可像拟音导演一样精确控制每个时间段的声音生成。CVPR 2026 接收。

方法流程

- 输入视频+时序脚本 — 视频帧序列+STS结构化字幕

- 视觉特征提取 — 编码视频帧的视觉信息

- STS时序编码 — 结构化脚本→时间段级嵌入

- Script-Guided融合 — Temporal Script Attention

- 双帧声音合成 — 画内+画外音频并行生成

- 高保真时序音频 — 精确对齐的多事件音频输出

技术脉络

核心问题: V2A 生成缺乏细粒度时序控制,多事件场景和画外音难以处理

前序工作及局限:

- SpecVQGAN (Iashin 2023):音频频谱 VQ-GAN 生成,无时序控制

- Diff-Foley (Luo 2024):扩散模型 V2A,但仅全局条件控制

- Frieren (Wang 2024):V2A 扩散模型,改善音频-视频同步

- AC-Foley (2025):参考音频引导 V2A,但缺乏精确时间段控制

与前序工作的本质区别: FoleyDirector 通过结构化时序脚本(STS)首次在 DiT 基 V2A 模型上实现时间段级精确控制,并创新性地并行生成画内和画外音频

技术演进定位: 将 V2A 从「全局条件生成」推进到「导演级时序控制」,显著拓展了实用价值

可能的后续方向:

- 与视频生成模型联合训练实现端到端 V2AV

- 交互式拟音编辑工具

- 扩展到音乐配乐的时序控制

批判性点评

- 实验评估: 构建了 DirectorSound 数据集和 DirectorBench 评测基准,评估维度全面。CVPR 2026 接收说明同行认可度高。但 V2A 领域尚缺乏统一公认的客观指标。

- 新颖性: 首次在 DiT 基 V2A 模型上实现精确时序引导,STS 设计优雅。双帧声音合成(画内+画外)是实际应用中的重要创新。但依赖结构化文本输入增加了使用门槛。

- 可复现性: 提出了新数据集但未明确是否公开。方法依赖预训练 DiT V2A 基模型,复现需要一定基础设施。

- 影响力: 对影视后期制作和自动配音有直接应用价值。STS 理念可泛化到其他时序生成任务(如音乐生成、视频编辑)。

批判性点评精选

1. 高维离散 = 统一架构?

CubiD 验证高维离散 Token 兼顾理解和生成,但 3.7B 模型的训练成本和实际 T2I 质量仍有待验证

2. 架构无关的代价

Block Masking 覆盖四种架构值得称赞,但每种架构的最优掩码配置不同,通用性是否以牺牲极致性能为代价?

3. 时序脚本的使用门槛

FoleyDirector 的 STS 需要手工编写结构化脚本,大规模自动化场景下的可用性值得关注

其余论文 · 贡献与效果总结

| # | 论文 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|

| 1 | LumosX (Relate Any Identities with Their Attributes for Personalized Video Generation) | 个性化视频生成 · 身份对齐 · ICLR 2026 | 提出关系自注意力和关系交叉注意力机制,在多对象个性化视频生成中实现精确的身份-属性对齐。通过 MLLM 推断对象间依赖关系,强化群组内聚性和跨对象分离。ICLR 2026。 | 在多对象个性化视频生成基准上达到 SOTA,身份一致性和语义对齐显著优于现有方法 |

| 2 | Borderless Long Speech (Borderless Long Speech Synthesis) | 长语音合成 · 多说话人 · Agentic TTS | 提出无边界长语音合成框架,支持多说话人对话(最多5人)、零样本语音克隆、长达60分钟单次合成。创新的 Global-Sentence-Token 多级标注体系和 Chain-of-Thought 推理增强复杂条件下的指令遵循。 | 支持60分钟单次合成、5人多方对话,原生 Agentic 设计实现从 Text2Speech 到无边界长语音合成的范式扩展 |

| 3 | MOSS-TTSD (Text to Spoken Dialogue Generation) | 对话合成 · 多方语音 · 复旦 | 首个面向对话场景的语音合成模型,支持多语言(中英文)、多方对话(最多5人)、零样本语音克隆。增强长上下文建模实现 60 分钟单次生成。提出 TTSD-eval 客观评测框架。复旦大学团队。 | 在对话合成的说话人归属准确率和相似度上超越开源和商业基线,支持播客、动态解说等应用场景 |

| 4 | FRAM (Diffusion-Based Makeup Transfer with Facial Region-Aware Makeup Features) | 妆容迁移 · 区域感知 · CVPR 2026 | 提出面部区域感知妆容特征(FRAM):通过 GPT-o3 合成标注数据微调妆容 CLIP 编码器,使用可学习 Token 查询区域级妆容特征。ControlNet Union 同时编码源图像及 3D 网格实现身份保持。CVPR 2026。 | 在区域可控性和妆容迁移质量上验证了显著优势,支持眼妆/唇妆等细粒度区域独立编辑 |

| 5 | I2I-RFR (Improving Image-to-Image Translation via a Rectified Flow Reformulation) | 整流流 · I2I翻译 · 即插即用 | 将标准 I2I 回归网络重新表述为连续时间传输模型:仅扩展输入通道+简单 t 重加权损失,诱导整流流解释,推理时通过 ODE 渐进细化(仅需3步)。无需蒸馏即可显著提升感知质量。 | 在多个 I2I 翻译和视频恢复任务上普遍提升性能,尤其在感知质量和细节保留方面收益明显 |

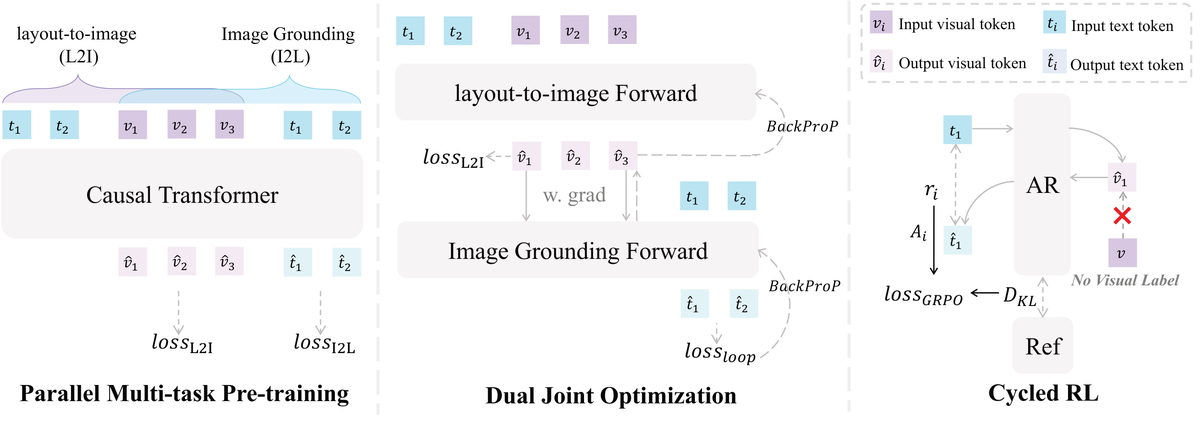

| 6 | SeGroS (Enhancing Alignment for Unified Multimodal Models via Semantically-Grounded Supervision) | 统一多模态 · 对齐增强 · 语义监督 | 解决统一多模态模型(UMM)中粒度不匹配和监督冗余问题。提出视觉定位图构建互补监督信号:语义视觉提示补偿文本稀疏性 + 语义定位的损坏输入将重建损失限制在核心文本对齐区域。 | 在 GenEval/DPGBench/CompBench 上显著提升 UMM 的生成保真度和跨模态对齐 |

| 7 | TATAR (One Model, Two Minds: Task-Conditioned Reasoning for Unified IQA and Aesthetic Assessment) | 统一IQA+IAA · 非对称奖励 · GRPO | 揭示统一 IQA 和 IAA 中的「推理不匹配」和「优化不匹配」。提出 TATAR 框架:快慢任务推理构建 + 两阶段 SFT+GRPO 学习 + 非对称奖励(IQA 高斯整形/IAA 瑟斯顿排名)。 | 8个基准上均优于统一基线,与特定任务专用模型竞争力相当,美学评估训练更稳定 |

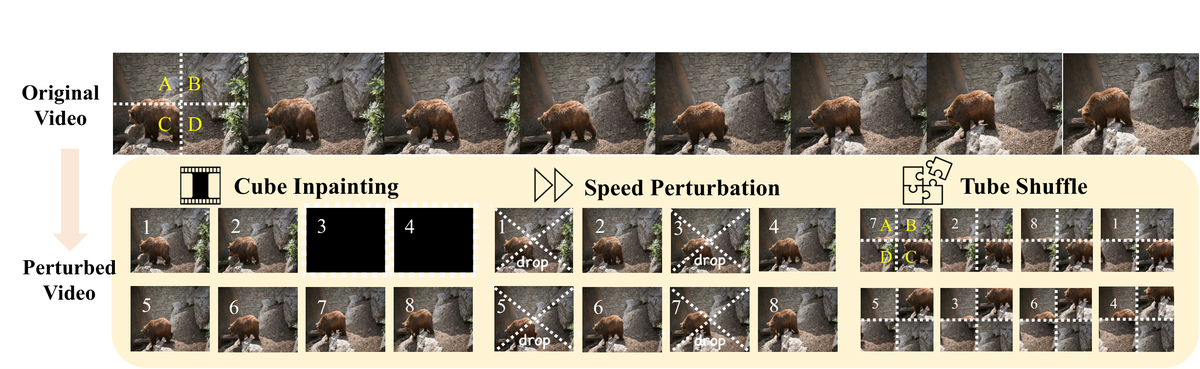

| 8 | MME-CoF-Pro (Evaluating Reasoning Coherence in Video Generative Models) | 视频生成评测 · 推理连贯性 · Benchmark | 提出视频生成模型推理连贯性评测基准:303 样本/16 类别,从视觉逻辑到科学推理。引入「推理分数」评估中间步骤,三种设置(无提示/文本/视觉)控制研究。评测 7 个模型揭示推理连贯性与生成质量解耦。 | 发现视频生成模型推理连贯性较弱且与质量解耦;文本提示虽提高正确性但引入幻觉;视觉提示在细粒度感知上仍困难 |

| 9 | PGD-EIQA (Preference-Guided Debiasing for No-Reference Enhancement Image Quality Assessment) | 图像质量评估 · 去偏 · 偏好引导 | 通过监督对比学习构建连续增强偏好嵌入空间,估计并去除质量表示中的增强诱导干扰,使模型关注算法不变的感知质量线索。两阶段训练:偏好空间学习 → 去偏质量预测。 | 在公共 EIQA 基准上有效缓解算法诱导偏差,跨增强算法泛化能力显著优于现有方法 |

趋势观察

- 离散表示生成 — 高维 Token 离散扩散首次突破,统一理解+生成成为新范式

- 扩散加速通用化 — 架构无关加速框架覆盖 DDPM/LDM/DiT/PixArt 全系列

- 音频生成精细化 — V2A 和对话 TTS 均走向细粒度时序控制和长上下文建模

人工智能炼丹师 整理 | 2026-03-24

评论 (0)