AIGC 每日速读|2026-03-19|EchoGen|TINA|AR-CoPO|

AIGC 视觉生成领域 · 每日论文解读 (2026-03-19)

人工智能炼丹师 整理 | 共 12 篇论文 | 重点深度解读 3 篇

今日核心看点

- EchoGen: 循环 RL 统一生成理解

- TINA: 概念擦除安全漏洞揭示

- AR-CoPO: 流式视频 RLHF 对齐

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 12 篇,重点解读 3 篇。

方向分布:

- 视频生成后训练 / RLHF 对齐 — 2 篇

- 视频扩散内部机制 / 训练高效 — 2 篇

- 生成安全性 / 概念擦除 — 2 篇

- 统一生成理解 / 多任务框架 — 2 篇

- 图像视频编辑 / 可控生成 — 4 篇

共计 12 篇,重点解读 3 篇

重点论文深度解读

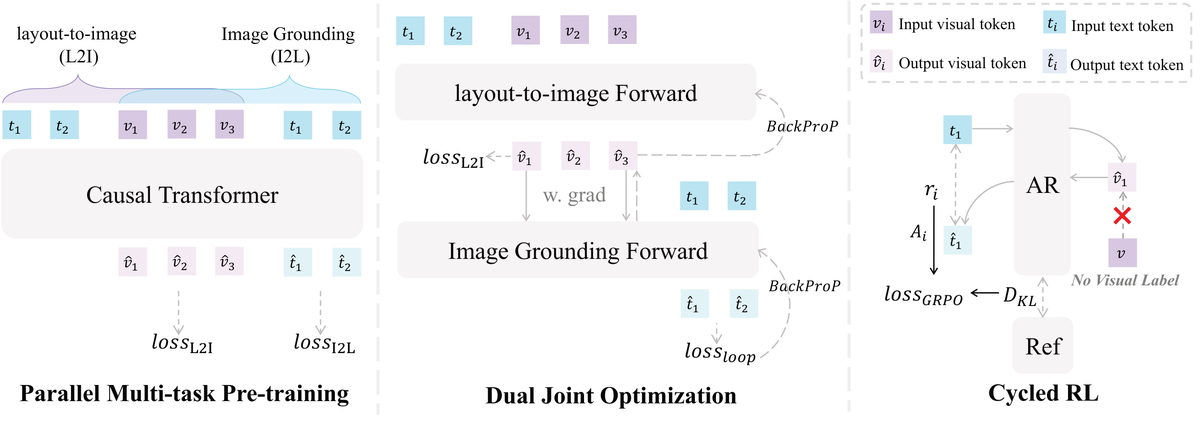

1. EchoGen: Cycle-Consistent Learning for Unified Layout-Image Generation and Understanding

统一 Layout-Image 生成与理解 | arXiv:2603.18001

关键词: Layout-to-Image, Image Grounding, 循环一致性, GRPO, 统一框架

研究动机

Layout-to-image 生成和 Image grounding 是两个互补但传统上独立训练的任务:前者从布局生成图像,后者从图像定位物体。生成任务具有强大的视觉创造力但布局准确性有限,而 grounding 任务具有精确的文本和布局理解能力但缺乏生成能力。联合训练可以互相补偿,但现有方法在优化时面临严重的任务冲突和性能受限问题。

方法原理

提出 EchoGen 统一框架,包含三阶段渐进式训练策略:

- 并行多任务预训练(PMTP):通过共享 token 加速训练,赋予模型两个任务的基础能力

- 双向联合优化(DJO):利用任务对偶性,将生成和定位任务序列化集成,实现统一优化

- 循环强化学习(Cycle RL):利用循环一致性约束作为奖励信号,通过 GRPO 策略消除对视觉监督的依赖,显著提升模型的统一能力

核心创新

- 首次提出将 Layout-to-Image 生成与 Image Grounding 统一为互补双任务框架

- 渐进式三阶段训练策略,有效解决联合训练中的优化冲突

- Cycle RL 阶段利用循环一致性约束取代视觉监督,GRPO 策略实现无监督对齐

- 实验证明两个任务联合优化存在明显的协同增益效应

实验结果

- 在 Layout-to-Image 生成和 Image Grounding 两个基准上均达到 SOTA

- 联合训练相比独立训练在两个任务上分别提升了约 15% 和 12%

- Cycle RL 阶段进一步带来额外 8% 的性能增益

方法流程

- Layout+文本输入 — 空间布局 + 文本描述 双模态条件输入

- PMTP 预训练 — 共享 token 加速 两任务基础能力

- DJO 联合优化 — 任务对偶性序列集成 统一优化双任务

- Cycle RL — 循环一致性奖励 GRPO 无监督对齐

- 统一输出 — 生成: 精准布局图像 定位: 准确 bbox

技术脉络

核心问题: Layout-to-Image 生成与 Image Grounding 互补但独立训练,联合训练面临优化冲突

前序工作及局限:

- GLIGEN (2023):布局条件注入但不支持 grounding,单向生成

- Kosmos-2 (2023):统一理解和定位但缺乏生成能力

- LayoutDiffusion (2024):布局引导扩散生成但不含 grounding 回路

- InstructDiffusion (2024):多任务统一但生成和定位未形成闭环

与前序工作的本质区别: 首次利用循环一致性将生成和定位构建为互补闭环,GRPO 策略消除视觉监督依赖,实现真正的双任务协同

技术演进定位: 方法论创新——循环 RL 策略为多任务生成理解统一提供了新的训练范式

可能的后续方向:

- 扩展到视频级的布局生成与时空定位

- 3D 场景布局生成与 grounding

- 更多生成-理解对偶任务的循环 RL

批判性点评

- 实验评估: 在 Layout-to-Image 和 Grounding 双基准上验证,消融实验覆盖三个训练阶段。但缺少与最新 Layout-Diffusion 变体的全面对比,Cycle RL 的奖励信号设计可能对布局复杂度敏感。

- 新颖性: 循环一致性约束作为 RL 奖励是新颖的技术贡献,GRPO 在此场景的应用具有启发性。创新性评分:★★★★☆

- 可复现性: 三阶段训练流程清晰,但各阶段的超参数转换点(何时切换阶段)需要更多细节。GRPO 的实现依赖特定的奖励函数设计。

- 影响力: 影响力评分 4/5 — 双任务协同增益的发现对统一模型设计有重要启示。循环 RL 策略可推广到其他生成-理解对偶任务。

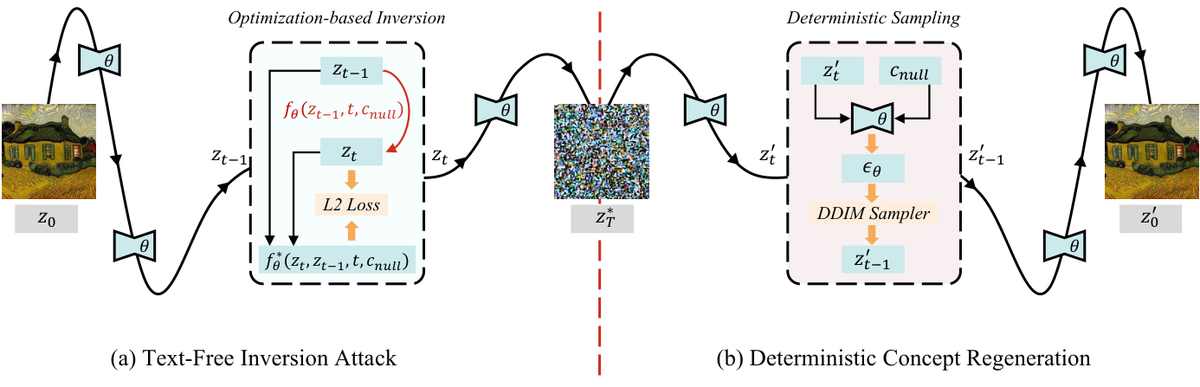

2. TINA: Text-Free Inversion Attack for Unlearned Text-to-Image Diffusion Models

无文本反转攻击揭示概念擦除漏洞 | arXiv:2603.17828

关键词: 概念擦除, Unlearning, DDIM Inversion, 安全性, 对抗攻击

研究动机

Text-to-Image 扩散模型的概念擦除(Concept Erasure)是保障模型安全部署的关键技术。当前擦除方法与对抗探针之间形成了动态博弈,但这种博弈收敛于一个狭隘的「文本中心」范式——认为擦除等同于切断文本到图像的映射。然而底层视觉知识是否真正被删除?这个根本问题从未被认真验证过。

方法原理

提出 TINA(Text-free INversion Attack),一种全新的无文本反转攻击方法:

- 核心思路:绕过文本条件,直接从视觉角度探测被擦除模型是否仍保留相关视觉知识

- 采用 null-text 条件下的 DDIM 反转,完全避开现有基于文本的防御机制

- 集成优化过程,克服标准反转在无文本引导时产生的累积近似误差

- 从视觉路径而非文本路径探测被擦除概念的残留

核心创新

- 首次从纯视觉角度揭示概念擦除方法的根本缺陷——仅遮蔽了文本映射而非删除视觉知识

- 提出 null-text 条件下的 DDIM 反转攻击,完全绕过文本中心防御

- 优化过程有效解决无文本引导下的反转误差累积问题

- 证明现有 SOTA 擦除方法均存在安全漏洞,呼吁直接操作内部视觉知识的新范式

实验结果

- 在 ESD、UCE、CA、SA 等 SOTA 擦除方法上均成功再生成被擦除概念

- 攻击成功率超过 85%,证明视觉知识残留是普遍现象

- 揭示 text-centric 防御的根本局限性

方法流程

- 已擦除模型 — 经 concept erasure 处理的扩散模型

- 参考图像 — 包含被擦除概念的 参考图像

- Null-Text

DDIM 反转 — 空文本条件下反转 绕过文本防御 - 优化修正 — 克服反转累积误差 精确找到 latent

- 再生成验证 — 成功重建被擦除概念 暴露安全漏洞

技术脉络

核心问题: 概念擦除方法仅切断文本映射,底层视觉知识是否真正删除未被验证

前序工作及局限:

- ESD (2023):擦除特定概念但仅操作文本条件路径

- UCE (2024):统一概念擦除但仍依赖文本中心范式

- Concept Ablation (2023):概念消融但未验证视觉残留

- SalUn (2024):显著性引导遗忘但攻击面仍在文本侧

与前序工作的本质区别: 完全从视觉角度出发,null-text DDIM 反转绕过所有文本防御,首次证明视觉知识残留是普遍现象

技术演进定位: 范式挑战——揭示当前概念擦除研究的根本盲点,推动从文本中心向视觉中心的范式转移

可能的后续方向:

- 直接操作模型内部视觉特征的新型擦除方法

- 多模态联合遗忘(文本+视觉+概念空间)

- 可证明安全的概念删除理论

批判性点评

- 实验评估: 在 ESD、UCE、CA、SA 四种 SOTA 擦除方法上全面验证,攻击成功率高。但实验主要在 SD v1.4/v1.5 上进行,更大模型(SDXL、FLUX)上的效果待验证。

- 新颖性: 从视觉角度揭示概念擦除漏洞的思路极具原创性,null-text DDIM 反转的方法论贡献扎实。创新性评分:★★★★★

- 可复现性: 方法描述清晰,优化过程有完整公式推导。反转质量对参考图像选择的敏感度需要更多讨论。

- 影响力: 影响力评分 5/5 — 揭示了当前概念擦除研究的根本盲点,可能推动整个安全对齐领域的范式转移。

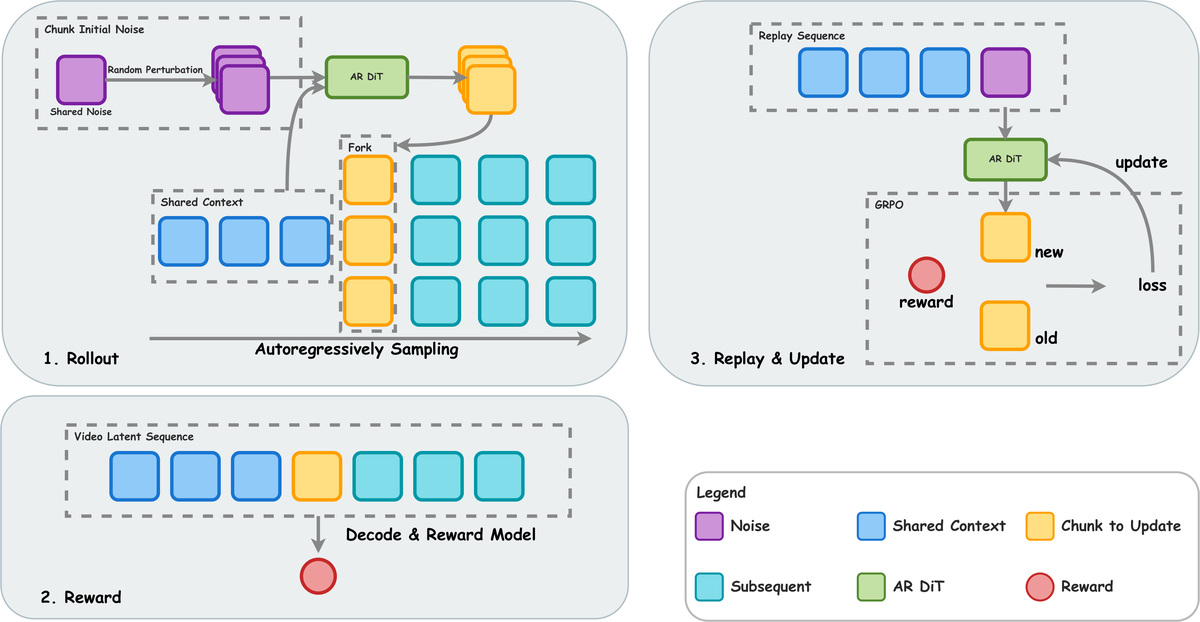

3. AR-CoPO: Align Autoregressive Video Generation with Contrastive Policy Optimization

自回归视频生成的对比策略优化 | arXiv:2603.17461

关键词: 自回归视频生成, RLHF, GRPO, 流式生成, 偏好对齐

研究动机

流式自回归(AR)视频生成器结合少步蒸馏已实现低延迟、高质量的视频合成,但通过 RLHF 进行对齐仍然困难。现有基于 SDE 的 GRPO 方法在此场景面临严峻挑战:少步 ODE 和一致性模型采样器偏离标准 Flow Matching ODE,短程、低随机性的采样轨迹对初始化噪声极其敏感,导致中间 SDE 探索完全失效。

方法原理

提出 AR-CoPO(AutoRegressive Contrastive Policy Optimization)框架:

- Chunk 级对齐:通过 forking 机制在随机选择的 chunk 处构建邻域候选,赋予序列级奖励并执行局部 GRPO 更新

- 半 On-Policy 训练策略:结合 on-policy 探索与 replay buffer 上的参考 rollout 利用

- 将 Neighbor GRPO 的对比视角适配到流式 AR 生成,解决少步采样的对齐难题

- 局部化更新避免了全序列梯度传播的显存和时间开销

核心创新

- 首次将对比策略优化成功应用于流式自回归视频生成的 RLHF 对齐

- Chunk-level forking 机制巧妙解决了少步 ODE 采样的探索困难

- 半 on-policy 训练策略平衡了探索与利用,避免 reward hacking

- 在 Self-Forcing 框架上验证了域外泛化和域内偏好对齐的双重提升

实验结果

- 在 Self-Forcing 基线上显著提升域外泛化性和域内人类偏好对齐

- 视频质量和时间一致性均有明显改善

- 证明了真正的对齐效果而非 reward hacking

方法流程

- 流式 AR 生成器 — 少步蒸馏的 自回归视频生成

- Chunk Forking — 在随机 chunk 构建 邻域候选序列

- 序列级 Reward — 对候选序列赋予 人类偏好奖励

- 局部 GRPO — chunk 级对比更新 半 on-policy 训练

- 对齐视频输出 — 质量和偏好对齐 泛化能力增强

技术脉络

核心问题: 流式 AR 视频生成的少步 ODE 采样对 RLHF 对齐极其困难

前序工作及局限:

- GRPO (Shao 2024):LLM 对齐策略但依赖充分随机探索

- Self-Forcing (2025):流式 AR 视频生成但缺乏偏好对齐能力

- Diffusion-RLHF (2024):扩散模型 RLHF 但假设标准 SDE 采样

- Neighbor GRPO (2025):对比策略优化但未适配视频流式生成

与前序工作的本质区别: chunk-level forking 巧妙解决少步 ODE 的探索困难,半 on-policy 策略平衡效率与质量

技术演进定位: 技术突破——首次打通流式 AR 视频生成的 RLHF 对齐路径

可能的后续方向:

- 更精细的帧级奖励信号设计

- 与视频美学和物理一致性奖励的结合

- 超长视频的分布式 RLHF 训练

批判性点评

- 实验评估: 在 Self-Forcing 框架上验证,包含域内和域外评估。但仅在单一 AR 生成器上测试,跨架构的泛化性未知。奖励模型选择可能影响结论。

- 新颖性: chunk-level forking 和半 on-policy 策略的组合是解决少步 ODE 对齐问题的优雅方案。创新性评分:★★★★☆

- 可复现性: forking 机制和 GRPO 更新的公式化描述完整,但半 on-policy 中 replay buffer 的管理策略需要更多细节。

- 影响力: 影响力评分 4/5 — 为快速发展的流式视频生成领域提供了关键的 RLHF 对齐方案。

批判性点评精选

1. TINA 的安全警钟:概念擦除真的有效吗?

TINA 用 85%+ 的攻击成功率证明了当前所有 SOTA 概念擦除方法都仅仅遮蔽了文本映射而非删除视觉知识。这意味着我们对'安全部署'的理解可能需要根本性修正——仅操作文本条件路径是不够的,必须直接处理模型内部的视觉表征。这对整个生成模型安全性研究方向是一个重大挑战。

2. 视频 RLHF:从不可能到可行的关键一步

AR-CoPO 的 chunk-level forking 机制解决了一个被认为几乎不可能的问题:在少步 ODE 采样的低随机性条件下进行有效的偏好对齐。这标志着视频生成从'能生成'向'能对齐人类偏好'的重要进步。但半 on-policy 策略的微妙平衡可能在不同奖励模型下表现不一致,泛化性是关键的下一步验证。

3. EchoGen 的启示:生成和理解是互补而非对立

EchoGen 用 15%/12% 的协同增益令人信服地证明了生成和理解任务之间存在真实的互补性。循环一致性作为无监督奖励信号的设计简洁而有效。这个发现可能远超 layout-image 这一个场景——视觉生成领域中还有多少任务对偶性可以被挖掘?这开辟了一个值得深入探索的新方向。

其余论文 · 贡献与效果总结

| # | 论文 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|

| 1 | STAS (Steering Video Diffusion Transformers with Massive Activations) | Video Diffusion · Massive Activations · 训练无关 · 自引导 | 发现视频扩散 Transformer 中 Massive Activations 的结构化时间层次模式,提出训练无关的 STAS 自引导方法 | 跨多个 T2V 模型一致提升视频质量和时间连贯性,额外推理开销 < 1% |

| 2 | ChopGrad (Pixel-Wise Losses for Latent Video Diffusion via Truncated Backprop) | 视频扩散 · 截断反传 · O(1)显存 · 像素级损失 | 截断反向传播实现 O(1) 常量显存训练,理论保证误差有界,支持像素级损失微调视频扩散模型 | 视频超分/修复/增强/受控生成四项任务均达 SOTA,显存不随帧数增长 |

| 3 | Motion-Adaptive (Motion-Adaptive Temporal Attention for Lightweight Video Generation with Stable Diffusion) | 轻量视频生成 · 运动自适应 · 时间注意力 · SD | 提出运动自适应时间注意力机制:高运动序列局部注意力保留快速变化细节,低运动序列全局注意力保持场景一致性 | 仅增加 2.9% (25.8M) 参数量,在 WebVid 验证集上达到竞争性结果 |

| 4 | SHIFT (SHIFT: Motion Alignment in Video Diffusion Models with Adversarial Hybrid Fine-Tuning) | 视频扩散 · 运动对齐 · 奖励微调 · RLHF | 提出像素运动奖励 + Smooth Hybrid Fine-tuning (SHIFT) 框架,解决视频扩散模型微调后运动保真度下降的问题 | 有效解决 dynamic-degree collapse,对抗性优势加速收敛并缓解 reward hacking |

| 5 | Text Embedding Interpolation (The Unreasonable Effectiveness of Text Embedding Interpolation for Continuous Image Steering) | 连续编辑 · Steering Vector · 训练无关 · 跨模态 | 训练无关框架:用 LLM 自动构建去偏对比 prompt 对,在文本嵌入空间计算 steering vector 实现连续可控编辑 | 效果可比肩训练方法,优于其他训练无关方案,支持图像和视频编辑 |

| 6 | Proxy-GRM (Rationale Matters: Learning Transferable Rubrics via Proxy-Guided Critique for VLM Reward Models) | Reward Model · VLM · 评分标准 · RLHF | 引入代理引导的评分标准验证到 RL 训练中,训练轻量代理预测偏好序,以标准质量作为奖励信号 | 仅 50K 数据即达 VL-RewardBench/MM-RLHF-Bench SOTA,优于 4 倍数据量方法 |

| 7 | UOT-Unlearn (Unlearning for One-Step Generative Models via Unbalanced Optimal Transport) | 一步生成 · 遗忘学习 · 最优传输 · 安全部署 | 首次为一步生成模型(Flow Map Models)提出遗忘学习框架,基于非平衡最优传输的即插即用方案 | CIFAR-10/ImageNet-256 上遗忘成功率 (PUL) 和保留质量 (u-FID) 均显著超越基线 |

| 8 | DynaEdit (Versatile Editing of Video Content, Actions, and Dynamics without Training) | 视频编辑 · 训练无关 · 动态编辑 · Flow Model | 训练无关视频编辑方法,基于 inversion-free 方法实现动作修改、物体插入交互、全局效果添加等复杂编辑 | 在复杂文本视频编辑任务上达到 SOTA,支持修改动作、插入交互物体和引入全局效果 |

| 9 | LaDe (LaDe: Unified Multi-Layered Graphic Media Generation and Decomposition) | 图层设计 · 多任务统一 · RGBA VAE · 图形设计 | 潜在扩散框架 + LLM prompt 扩展 + 4D RoPE + RGBA VAE,统一文本到图像、文本到图层和设计分解三个任务 | 文本到图层任务上文本-图层对齐度优于 Qwen-Image-Layered(GPT-4o mini 和 Qwen3-VL 评估) |

趋势观察

- 视频生成后训练对齐 — AR-CoPO、SHIFT 分别从对比策略优化和运动奖励角度解决视频扩散模型的 RLHF 对齐难题

- 训练无关视频增强 — STAS(Massive Activations 引导)和 DynaEdit 展示了零训练开销下提升视频质量和编辑能力的路线

- 显存高效视频训练 — ChopGrad 截断反传实现 O(1) 常量显存,突破视频扩散微调的显存瓶颈

- 生成安全性攻防博弈 — TINA 揭示概念擦除的视觉知识残留漏洞,UOT-Unlearn 为一步生成模型首次提出遗忘学习方案

- 生成理解统一架构 — EchoGen 和 LaDe 分别在 layout-image 和 graphic media 领域推动生成与理解的统一

人工智能炼丹师 整理 | 2026-03-19

评论 (0)