AIGC生成 每日热点论文速读@20260316

AIGC 视觉生成领域 · 每日论文解读 (2026-03-16)

人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇

今日核心看点

- DiT 弹性加速 ELIT: FID +35%

- 多主体视频定制 + 全方位运动控制

- 视觉生成 RLHF: 66 万评分数据开源

- 电影级多镜头相机控制 ShotVerse

- 扩散模型内源思维链推理 92.1%

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。

方向分布:

- 扩散模型理论与加速 — 3 篇

- 文本到图像 / 评测 — 2 篇

- 图像编辑 — 1 篇

- 3D 生成与重建 — 4 篇

- 多模态 / 智能体 — 2 篇

顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇

重点论文深度解读

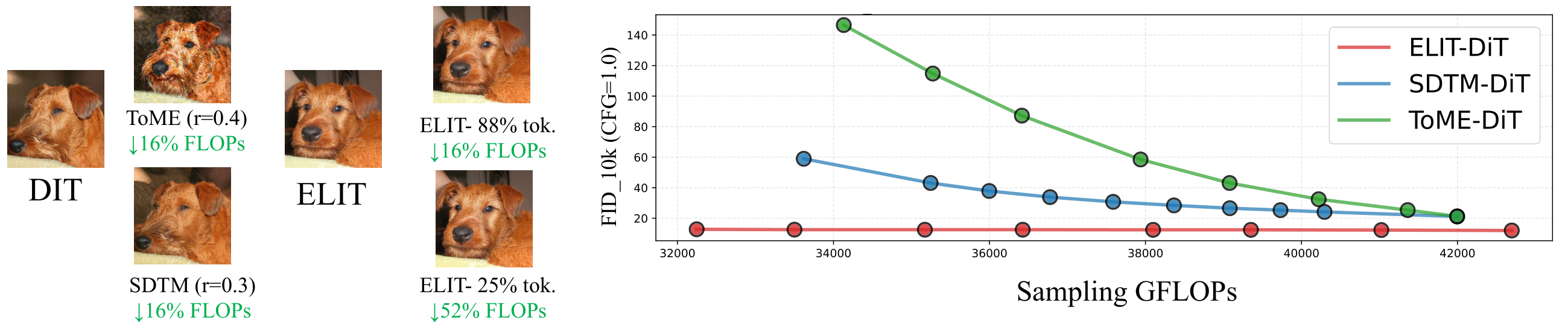

1. ELIT: Elastic Latent Interfaces for Diffusion Transformers

弹性潜在接口 | Snap Research | DiT 通用加速 | arXiv:2603.12245

关键词: DiT 加速, 弹性推理, 跨架构通用, Snap Research

研究动机

Diffusion Transformer (DiT) 的计算量与图像分辨率强绑定,无法灵活地在延迟与质量之间做权衡。更关键的是,DiT 对所有空间位置均匀分配计算资源,忽视了不同区域的重要性差异,导致大量算力浪费在低信息量区域。

方法原理

提出 ELIT (Elastic Latent Interface Transformer):在 DiT 架构中插入一组可学习的、长度可变的潜在 Token 序列作为「潜在接口」。标准 Transformer 块在这组潜在 Token 上运算,而非直接处理空间 Token。通过轻量的 Read/Write 跨注意力层在空间 Token 和潜在 Token 之间传递信息,并自动优先处理重要区域。训练时随机丢弃尾部潜在 Token,迫使模型学会按重要性排序表示——前部 Token 编码全局结构,后部 Token 负责细节精修。推理时可动态调整潜在 Token 数量以匹配算力预算。

核心创新

- 即插即用:仅增加两个跨注意力层,不修改 DiT 主体和 rectified flow 训练目标

- 重要性排序表示:通过尾部 Token 随机丢弃训练,自动学习全局到细节的分层编码

- 跨架构通用:兼容 DiT、U-ViT、HDiT、MM-DiT 四种主流架构

- 动态推理预算:同一个模型适配从低算力到高算力的多种部署场景

实验结果

- ImageNet-1K 512px: FID 提升 35.3%, FDD 提升 39.6%

- 跨架构验证: DiT, U-ViT, HDiT, MM-DiT 均有一致增益

- 算力节省: 潜在 Token 数减半时质量仅微降,实现接近 2x 加速

方法流程

- 输入空间 Token — 图像/视频的空间特征序列

- Read Cross-Attn — 空间 Token -> 潜在 Token 自动聚焦重要区域

- 潜在 Token 序列 — 可变长度 重要性排序

- DiT Transformer 块 — 标准 Self-Attention + FFN

- Write Cross-Attn — 潜在 Token -> 空间 Token 信息回写

- 弹性输出 — 根据算力预算截断尾部

技术脉络

核心问题: DiT 计算量与分辨率强绑定,无法灵活权衡延迟与质量

前序工作及局限:

- Token Merging:合并相似 token 但损失信息

- JiT:动态跳过但仍在空间 token 上运算

- Perceiver:潜在 token 但未针对扩散优化

- DiTFastAttn:固定模式稀疏化

与前序工作的本质区别: 将空间 token 和计算完全解耦,通过可学习潜在接口实现按重要性排序的信息压缩

技术演进定位: 范式创新——从在空间 token 上省计算转变为在潜在接口上做计算

可能的后续方向:

- 与 token 合并/跳过组合

- 视频 DiT 时空弹性接口

- 与 KV 缓存压缩联合优化

批判性点评

- 实验评估: 跨 4 种 DiT 架构验证扎实。但缺少真实 T2I 模型端到端评估。

- 新颖性: 潜在接口+重要性排序+弹性推理是扎实新贡献。创新性:4/5

- 可复现性: 方法清晰架构改动最小。

- 影响力: 影响力 5/5 — 一个模型多预算对工业部署极有价值。

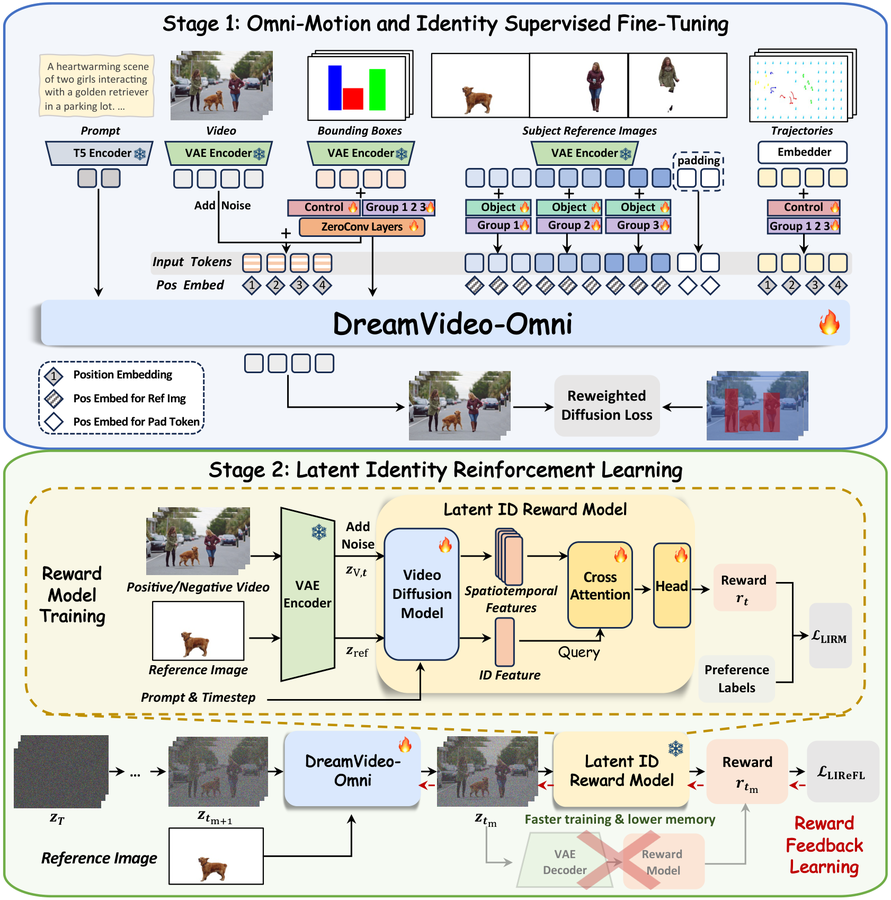

2. DreamVideo-Omni: Multi-Subject Video Customization with Omni-Motion Control

全方位运动控制视频定制 | 潜在身份强化学习 | arXiv:2603.12257

关键词: 视频定制, 多主体, 运动控制, 身份RL

研究动机

大规模视频扩散模型已能生成高质量视频,但同时精确控制多个主体的身份和多粒度运动仍然是重大挑战。现有方法要么运动粒度有限、要么身份退化严重。

方法原理

提出 DreamVideo-Omni 统一框架,采用渐进式两阶段训练。第一阶段:集成全面控制信号,引入条件感知 3D 旋转位置嵌入协调异构输入,分层运动注入策略增强全局运动引导,分组与角色嵌入将运动信号锚定到特定身份。第二阶段:设计潜在身份奖励反馈学习范式,在预训练视频扩散骨干上训练潜在身份奖励模型,在潜在空间提供运动感知的身份奖励。

核心创新

- 首个统一框架同时实现多主体身份定制 + 全方位运动控制

- 条件感知 3D RoPE:解决异构控制信号的空间对齐问题

- 分组与角色嵌入:显式解纠缠复杂场景中多主体的运动信号

- 潜在身份奖励学习:在潜在空间中构建运动感知的身份 RM

实验结果

- 多主体身份保持: 超越所有现有基线

- 运动控制精度: 全局、局部、相机三粒度均达到 SOTA

- 新基准 DreamOmni Bench: 专门评估多主体+全方位运动控制

方法流程

- 多模态输入 — 主体图像 + 文本 + 运动轨迹

- 3D RoPE 编码 — 条件感知旋转位置嵌入

- 分组角色嵌入 — 运动信号锚定到特定身份

- 分层运动注入 — 全局+局部+相机分层控制

- 视频扩散去噪 — DiT 多粒度条件引导

- 身份奖励 RL — 潜在空间身份 RM 优化

技术脉络

核心问题: 多主体身份保持和多粒度运动控制难以兼顾

前序工作及局限:

- DreamBooth:仅单主体

- AnimateDiff:运动粒度有限

- MotionCtrl:身份保持弱

- IP-Adapter:多主体时身份混淆

与前序工作的本质区别: 统一多主体身份、全局运动、局部动态、相机控制,用潜在身份奖励 RL 解决身份退化

技术演进定位: 集大成者——统一视频定制分散的研究方向

可能的后续方向:

- 5+主体可扩展性

- 3D 感知运动控制融合

- 长视频身份一致性

批判性点评

- 实验评估: DreamOmni Bench 是重要贡献。RL 训练稳定性需更多消融。

- 新颖性: 统一多个控制维度是工程突破。创新性:4/5

- 可复现性: 框架复杂度较高,复现门槛不低。

- 影响力: 影响力 4/5 — 方向正确但框架复杂度可能限制采用。

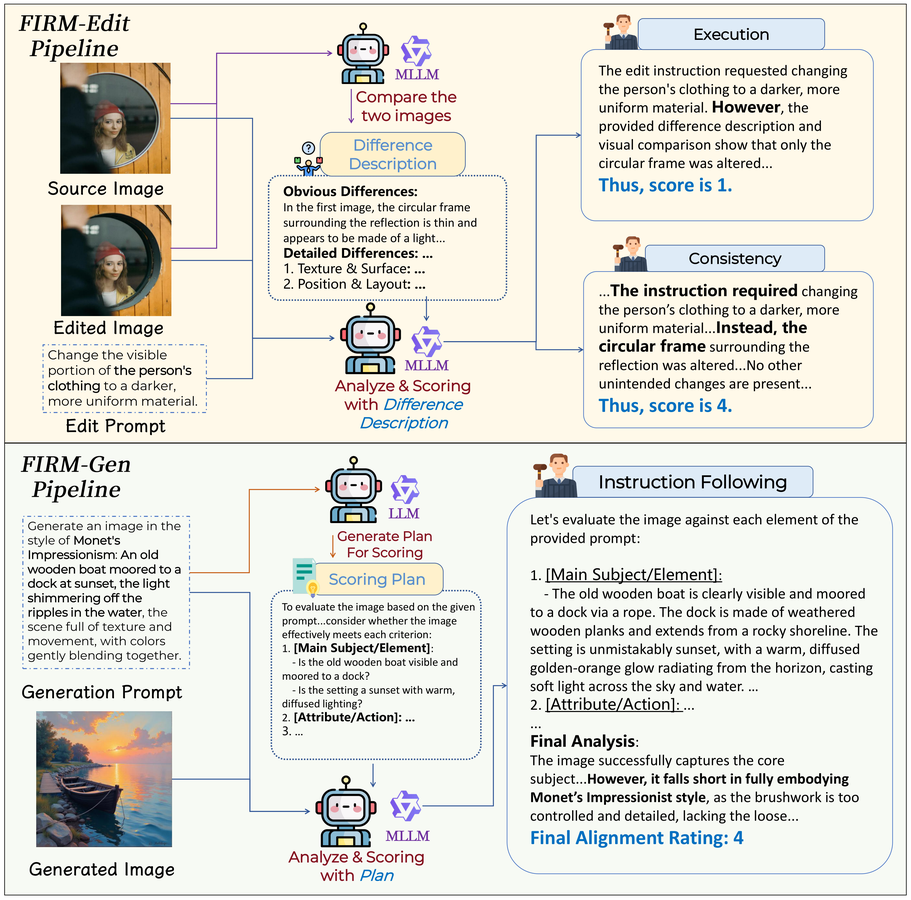

3. FIRM: Faithful Image Reward Modeling for Editing and Generation

鲁棒奖励模型 | FIRM-Edit-370K | 全套开源 | arXiv:2603.12247

关键词: 奖励模型, 图像编辑, RLHF, Benchmark

研究动机

RL 正成为提升图像编辑和 T2I 生成的主要范式,但当前奖励模型存在严重的幻觉问题,给出噪声评分从根本上误导优化方向。

方法原理

提出 FIRM 框架:定制化数据策划管道构建高质量评分数据集(Edit-370K + Gen-293K),训练专业化奖励模型(Edit-8B + Gen-8B)。设计 Base-and-Bonus 奖励策略——编辑用一致性调制执行 CME,生成用质量调制对齐 QMA——平衡竞争目标。提出 FIRM-Bench 综合评测基准。

核心创新

- 首个专门针对编辑和生成的大规模奖励模型框架

- FIRM-Edit-370K + FIRM-Gen-293K: 共 66 万高质量评分数据

- Base-and-Bonus 奖励策略: CME 和 QMA 平衡竞争目标

- 全套开源: 数据集、模型、代码均公开

实验结果

- FIRM-Edit-8B: 与人类判断对齐度显著超越现有指标

- FIRM-Qwen-Edit: 编辑性能突破性提升

- FIRM-SD3.5: 生成保真度和指令遵循新标准

- 数据集+模型+代码: 全部开源

方法流程

- 数据策划管道 — 编辑: 执行+一致性; 生成: 指令遵循

- FIRM 数据集 — Edit-370K + Gen-293K

- 专业化 RM 训练 — Edit-8B + Gen-8B

- Base-and-Bonus — CME + QMA 策略

- RL 微调 — 可靠 Critic 引导优化

- 高保真输出 — FIRM-Qwen-Edit / SD3.5

技术脉络

核心问题: RL 优化时奖励模型幻觉导致噪声评分误导优化

前序工作及局限:

- ImageReward:通用偏好不专门针对编辑

- HPS v2:未拆分编辑vs生成

- DDPO:使用通用奖励

- InstructPix2Pix:无专门 Critic

与前序工作的本质区别: 首次为编辑和生成分别构建大规模评分数据集和专业化奖励模型

技术演进定位: 基础设施建设——为扩散模型 RL 提供可靠 Critic

可能的后续方向:

- 视频编辑/生成 RM

- 多轮交互编辑序列化奖励

- 跨模型迁移性

批判性点评

- 实验评估: 66 万数据集规模可观,FIRM-Bench 设计系统性强。

- 新颖性: 可靠 Critic 比聪明 Policy 更重要的洞察深刻。创新性:4/5

- 可复现性: 全套开源,可复现性极佳。

- 影响力: 影响力 5/5 — 可能成为扩散模型 RLHF 基础设施。

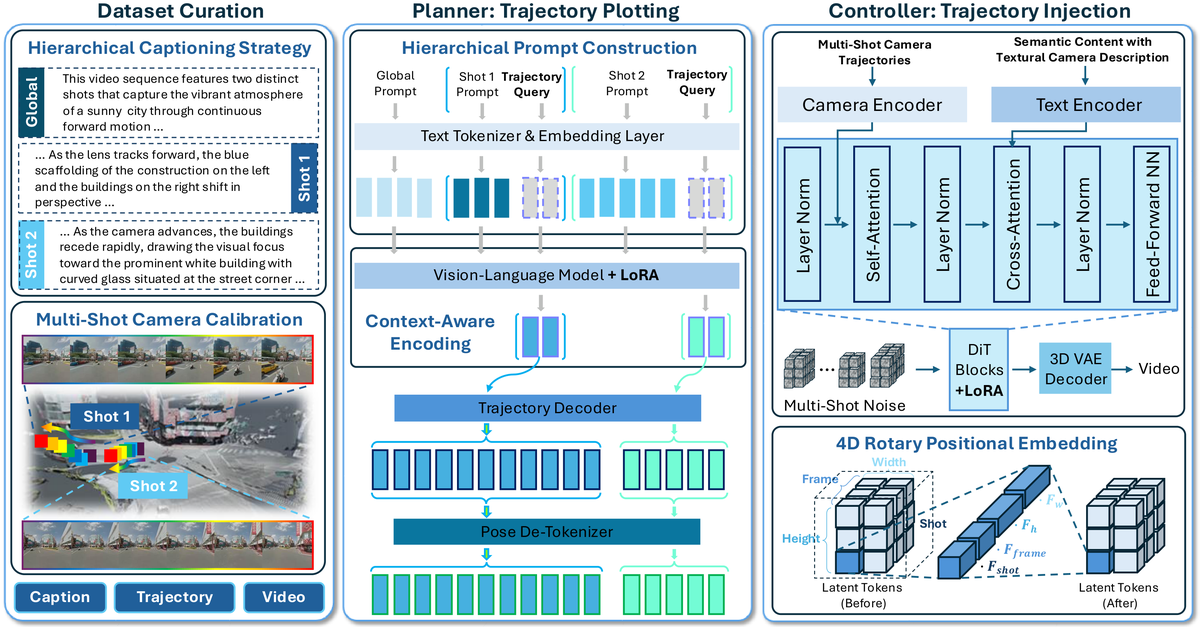

4. ShotVerse: Cinematic Camera Control for Multi-Shot Video

电影级多镜头视频创作 | Plan-then-Control | arXiv:2603.11421

关键词: 多镜头视频, 相机控制, VLM 规划, 数据驱动

研究动机

文本驱动视频生成在多镜头场景中的相机控制仍是关键瓶颈:隐式文本提示缺乏精确性,显式轨迹条件带来巨大手动开销且执行常失败。

方法原理

提出以数据为核心的范式:对齐的 (Caption,Trajectory,Video) 三元组构成联合分布。构建 Plan-then-Control 框架:VLM 规划器从文本生成全局对齐轨迹,控制器通过相机适配器渲染多镜头视频。核心是自动化多镜头相机校准管线和 ShotVerse-Bench 数据集。

核心创新

- Plan-then-Control 解耦: VLM 规划 + 控制器渲染

- 自动化多镜头相机校准: 统一全局坐标系

- ShotVerse-Bench: 高保真电影数据集 + 三轨评测

- 跨镜头一致性: 相机准确+视觉连贯

实验结果

- 相机轨迹准确性: 显著超越文本控制和手动轨迹基线

- 跨镜头一致性: 多镜头间视觉连贯达到电影级标准

- 用户研究: 电影美学评分大幅领先

方法流程

- 文本脚本输入 — 自然语言描述场景和相机意图

- VLM 规划器 — 空间先验推理 生成全局轨迹

- 多镜头校准 — 单镜头轨迹对齐到全局坐标系

- 相机适配器 — 轨迹条件注入视频生成模型

- 多镜头渲染 — 跨镜头一致的电影级画面

技术脉络

核心问题: 多镜头视频相机控制缺少文本自然表达和精确控制之间的桥梁

前序工作及局限:

- CameraCtrl:仅单镜头

- MotionCtrl:无跨镜头一致性

- Animate-A-Story:相机控制弱

- Direct-a-Video:仅单镜头

与前序工作的本质区别: 数据驱动的联合分布学习,VLM 规划+控制器执行,实现端到端多镜头视频管线

技术演进定位: 应用创新——首次解决多镜头电影级相机控制

可能的后续方向:

- 10+镜头一致性

- 渲染引擎集成

- 导演意图交互精调

批判性点评

- 实验评估: 三轨评测协议有价值。与单镜头方法缺少直接对比。

- 新颖性: Plan-then-Control 简洁优雅。创新性:3/5

- 可复现性: 工程复杂度较高。

- 影响力: 影响力 4/5 — 多镜头控制是走向影视级应用的关键。

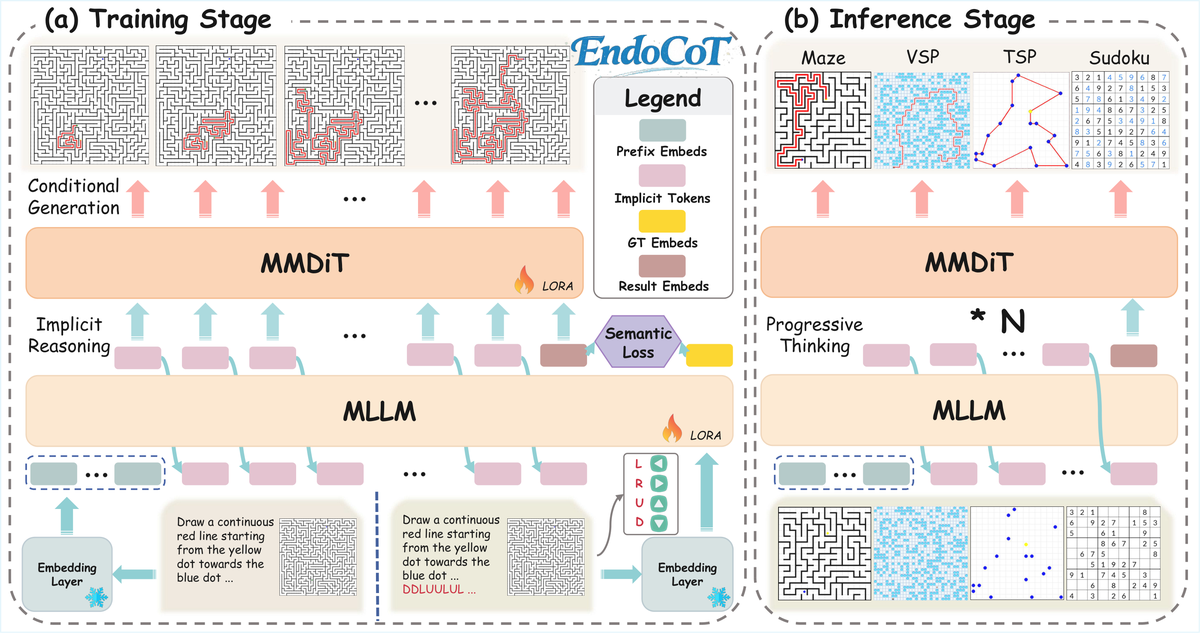

5. EndoCoT: Endogenous Chain-of-Thought Reasoning in Diffusion Models

扩散模型内生思维链 | MLLM+DiT 深度推理 | arXiv:2603.12252

关键词: 思维链, 扩散模型, 空间推理, MLLM+DiT

研究动机

MLLM 作为扩散框架的文本编码器时,单步编码无法激活思维链过程推理深度不足,且解码过程中引导固定不变。

方法原理

提出 EndoCoT 框架:迭代思维引导模块在潜在空间中迭代优化思维状态,激活 MLLM 推理潜力并桥接到 DiT 去噪过程。终端思维锚定模块将最终状态与真实答案对齐,确保推理不漂移。两个组件让 MLLM 提供精心推理的引导,DiT 逐步执行复杂任务。

核心创新

- 首次在扩散模型中实现内源性思维链推理

- 迭代思维引导模块: 在潜在空间逐步精炼推理状态

- 终端思维锚定: 推理轨迹与真实答案对齐防止漂移

- MLLM+DiT 渐进式推理引导: 复杂任务逐步分解

实验结果

- 整体平均准确率: 92.1%, 超越最强基线 8.3 个百分点

- Maze/TSP/VSP/Sudoku 等复杂推理均达 SOTA

- 23 页论文 18 张图: 全面消融实验

方法流程

- 复杂指令输入 — 迷宫/TSP/数独等推理任务

- MLLM 编码器 — 初始编码 激活推理起点

- 迭代思维引导 — 潜在空间逐步精炼推理

- 终端思维锚定 — 与真实答案对齐防漂移

- DiT 渐进去噪 — 推理引导的逐步去噪

- 推理一致输出 — 高质量生成结果

技术脉络

核心问题: MLLM 编码器单步编码推理深度不足,解码过程引导固定

前序工作及局限:

- DALL-E 3:T5 编码无推理

- RPG:外部推理非内源

- LLM Blueprint:与去噪过程脱耦

- PixArt-alpha:无迭代推理

与前序工作的本质区别: 将 CoT 从外部规划内化到去噪过程中,MLLM 成为迭代推理器而非一次性编码器

技术演进定位: 范式转换——从外部推理+内部生成转为内源性推理-生成一体化

可能的后续方向:

- 通用 T2I 组合推理

- 推理步数自适应

- 与 o1 推理模型结合

批判性点评

- 实验评估: 92.1% 准确率令人印象深刻但在逻辑推理任务而非典型视觉生成。

- 新颖性: CoT 内化到去噪过程是概念重大创新。创新性:5/5

- 可复现性: 实现复杂度较高。

- 影响力: 影响力 4/5 — 如能推广到通用 T2I 将是变革性的。

批判性点评精选

1. DiT 加速:从 Token 级优化到架构级解耦

ELIT 将 DiT 加速从 token 粒度提升到架构级别。关键问题:在 FLUX/SD3 上是否仍成立?

2. 视觉生成 RLHF 时代正式开启

FIRM 66 万评分数据+全套开源,标志扩散模型从探索期进入基础设施建设期。

3. 思维链内化:扩散模型的慢思考能力

EndoCoT 让扩散模型拥有类似 o1 的推理能力,92.1% 证明方向可行。

其余论文 · 贡献与效果总结

| # | 论文 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|

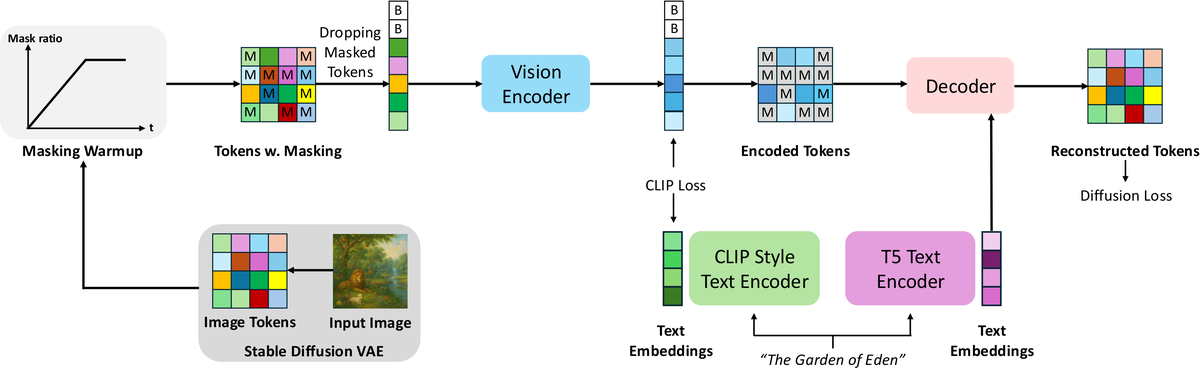

| 1 | EVATok (Adaptive Length Video Tokenization for AR Generation) | 视频 Token . AR 生成 . CVPR 2026 | 自适应长度视频 Tokenizer,轻量路由器预测最优 Token 分配 | UCF-101 SOTA,Token 节省 24.4%+ (CVPR 2026) |

| 2 | MOG (Manifold-Optimal Guidance for Diffusion Models) | CFG 改进 . 黎曼几何 . 无训练 | 黎曼流形局部最优控制修复 CFG 离流形漂移,Auto-MOG 动态校准 | 消除 CFG 过饱和,几乎零额外开销 |

| 3 | WeEdit (Glyph-Guided Text-centric Image Editing) | 文本编辑 . 字形引导 . 多语言 | HTML 管道生成 33 万训练对(15 种语言),字形引导 SFT + 多目标 RL | 文本编辑准确率超越所有开源模型 |

| 4 | SoulX-LiveAct (Hour-Scale Real-Time Human Animation) | 实时动画 . AR 扩散 . 无限视频 | Neighbor Forcing(扩散步对齐) + ConvKV 固定内存无限视频 | 小时级 20FPS 实时(2x H100),唇形/情感 SOTA |

| 5 | PROMO (Promptable Virtual Try-On with Flow Matching DiT) | 虚拟试穿 . Flow Matching . DiT | VTON 重定义为结构化编辑,FM-DiT + 潜在多模态条件 + 自参考加速 | 保真度超所有 VTON 方法,速度质量最优 |

| 6 | CEI-3D (Collaborative Explicit-Implicit 3D Editing) | 3D 编辑 . SDF+点 . 属性解耦 | 隐式 SDF + 显式处理点协作,物理属性解耦独立控制 | 比 SOTA 更逼真精细,编辑时间更短 |

| 7 | OSCBench (Object State Change in T2V Generation) | T2V 评测 . 状态变化 . Benchmark | 首个评估 T2V 中对象状态变化的基准,组织为常规/新颖/组合场景 | 揭示当前 T2V 在状态变化上的重大不足 |

| 8 | Coarse-Guided VG (Visual Generation via h-Transform Sampling) | 引导采样 . h-Transform . 无训练 | h-Transform 约束扩散采样,噪声感知调度平衡引导与质量 | 多种图像视频任务验证有效 |

趋势观察

- DiT 效率革命从 token 级走向架构级 — ELIT 的潜在接口方案预示着 DiT 加速的新范式

- 视频定制进入多主体+全方位运动时代 — DreamVideo-Omni 统一了身份、运动、相机三个维度

- 扩散模型 RLHF 基础设施加速完善 — FIRM 66 万评分数据+专业化 RM 开源

- 多镜头视频创作工具链逐步成形 — ShotVerse 的 Plan-then-Control 让电影级创作更近

- 扩散模型的推理能力被正式重视 — EndoCoT 将 CoT 内化到去噪过程,开辟新方向

人工智能炼丹师 整理 | 2026-03-16

评论 (0)