AIGC生成 每日热点论文速读@20260318

AIGC 视觉生成领域 · 每日论文解读 (2026-03-18)

人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇

今日核心看点

- Tri-Prompting 统一控制

- Anchor Forcing 流式视频

- VeloEdit 速度场编辑

- COT-FM 最优传输

- LADR 扩散LLM加速

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。

方向分布:

- 扩散模型理论与加速 — 3 篇

- 文本到图像 / 评测 — 2 篇

- 图像编辑 — 1 篇

- 3D 生成与重建 — 4 篇

- 多模态 / 智能体 — 2 篇

顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇

重点论文深度解读

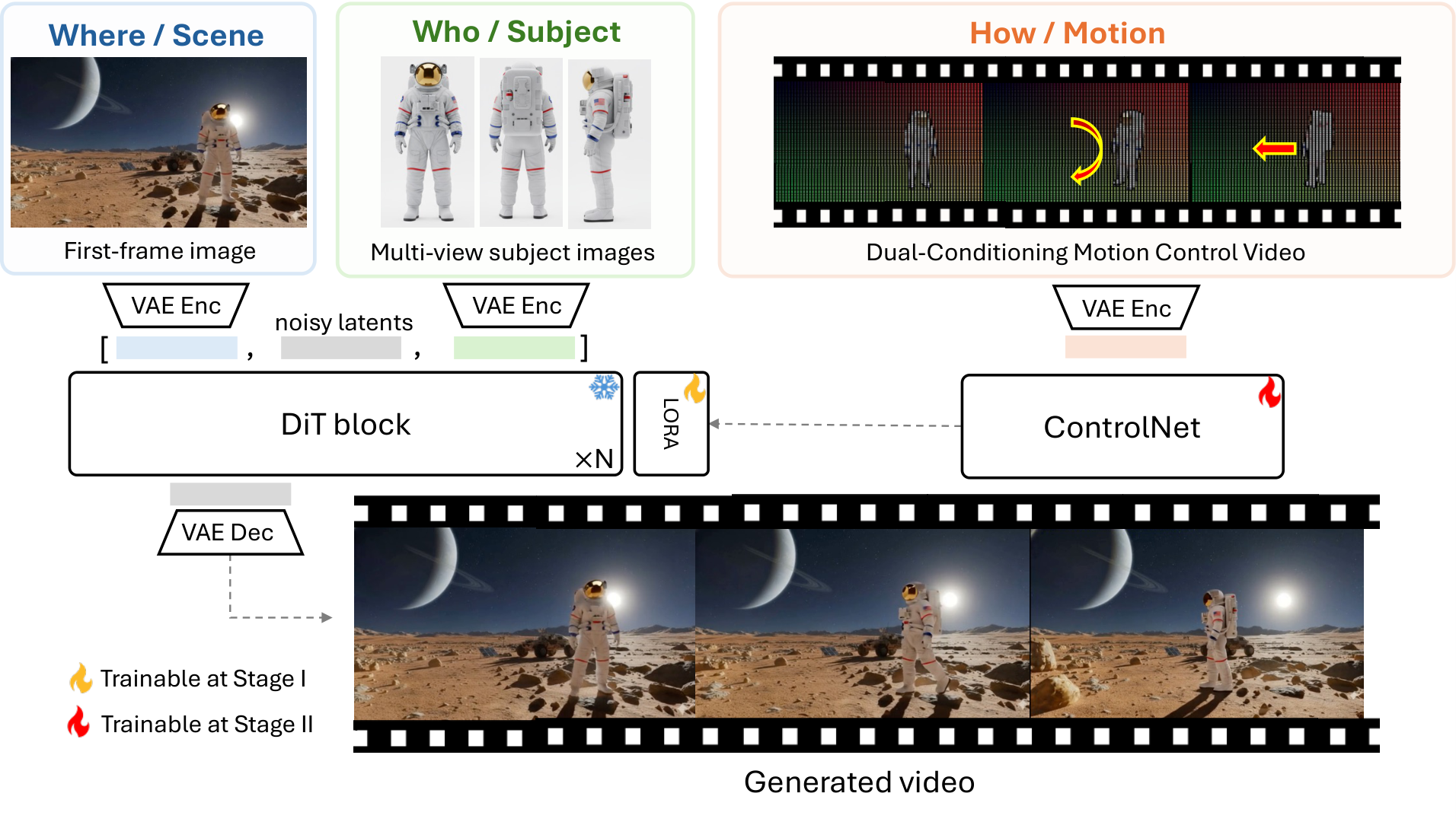

1. Tri-Prompting: Video Diffusion with Unified Control over Scene, Subject, and Motion

场景/主体/运动统一控制 | Adobe Research | arXiv:2603.15614

关键词: 视频扩散, 统一控制, 多视图主体, 3D感知, Adobe

研究动机

当前视频扩散模型在视觉质量上取得了显著进步,但精细控制仍是关键瓶颈。AI视频创作者需要三种关键控制:场景构图、多视图主体定制、和相机/物体运动调整。现有方法通常孤立处理这些维度,缺乏统一架构支持多维联合控制。

方法原理

提出 Tri-Prompting 统一框架和两阶段训练范式,集成场景构图、多视图主体一致性和运动控制。核心是双条件运动模块:使用 3D 跟踪点控制背景场景,使用下采样 RGB 线索控制前景主体。进一步提出推理时 ControlNet 尺度调度策略,平衡可控性与视觉真实感。支持 3D 感知主体插入任意场景、操纵图像中已有主体等全新工作流。

核心创新

- 首个统一场景/主体/运动三维控制的视频扩散框架

- 双条件运动模块:3D 跟踪点(背景)+ 下采样 RGB(前景)

- 推理时 ControlNet 尺度调度,平衡可控性与真实感

- 支持 3D 感知主体插入等全新创作工作流

实验结果

- 多视图主体身份保持、3D 一致性和运动准确性显著优于 Phantom 和 DaS 等专用方法

- 支持场景+主体+运动的联合精细控制

方法流程

- 场景 Prompt — 文本描述 + 场景参考图

- 多视图主体输入 — 多角度主体参考图像

- 3D 跟踪点提取 — 背景场景运动轨迹

- 双条件运动模块 — 3D点→背景控制 RGB↓→前景主体控制

- ControlNet 尺度调度 — 动态平衡可控性/真实感

- 统一控制视频输出 — 场景+主体+运动联合控制

技术脉络

核心问题: 视频扩散模型缺乏对场景、主体和运动的统一精细控制

前序工作及局限:

- AnimateDiff (2023):支持运动控制但不处理主体定制

- DreamVideo-Omni (2026):多主体定制但需逐一微调,未统一场景控制

- MotionCtrl (2024):相机运动控制精准但不支持主体定制

- Phantom (2025):多视图主体生成但3D一致性有限

与前序工作的本质区别: 首次统一场景构图+多视图主体+运动控制三维度,双条件运动模块分别用3D跟踪点和下采样RGB控制前景背景

技术演进定位: 范式统一——从孤立控制到三维联合控制,为AI视频创作提供完整控制栈

可能的后续方向:

- 更多控制维度的统一(光照、风格)

- 实时交互式控制

- 与大语言模型的控制意图理解结合

批判性点评

- 实验评估: 与 Phantom 和 DaS 等多个专用基线全面对比,多视图主体身份、3D一致性和运动准确性三个维度均领先。消融实验验证了双条件模块和尺度调度的必要性。

- 新颖性: 三维统一控制是视频生成的重要里程碑,但Adobe闭源可能限制学术影响。创新性:★★★★★

- 可复现性: 代码未开源,项目页面已上线。Adobe内部实现可能难以完全复现。

- 影响力: 影响力 5/5 -- 定义了视频精细控制的完整框架,产业价值极高。

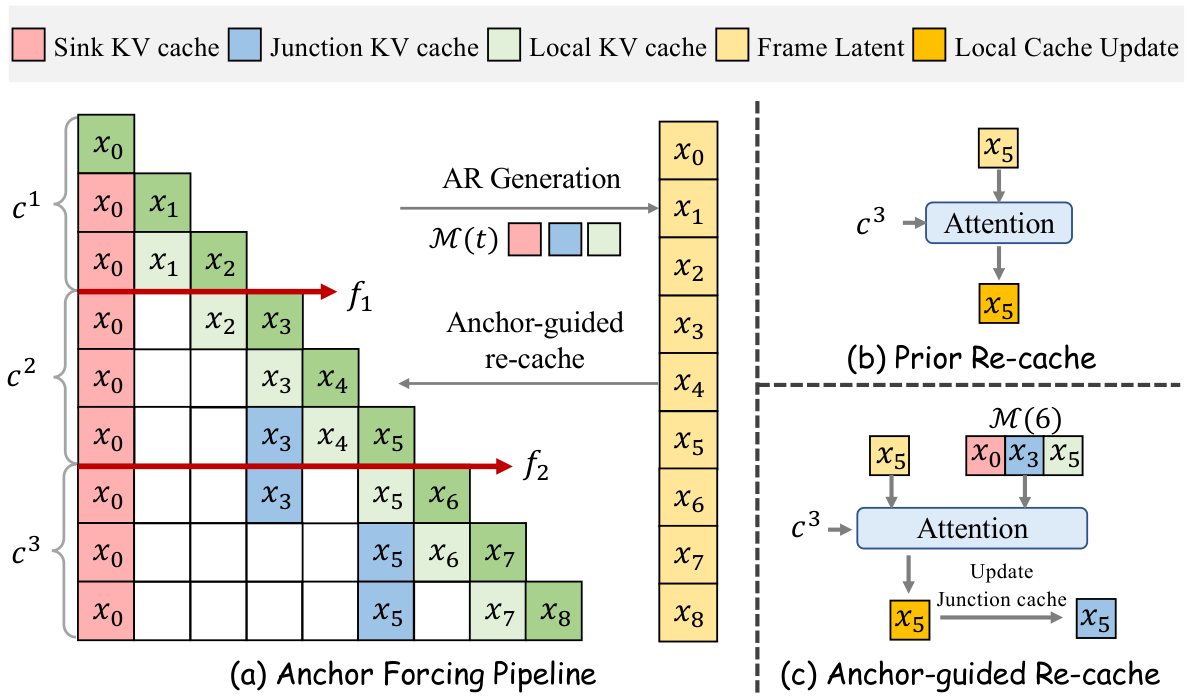

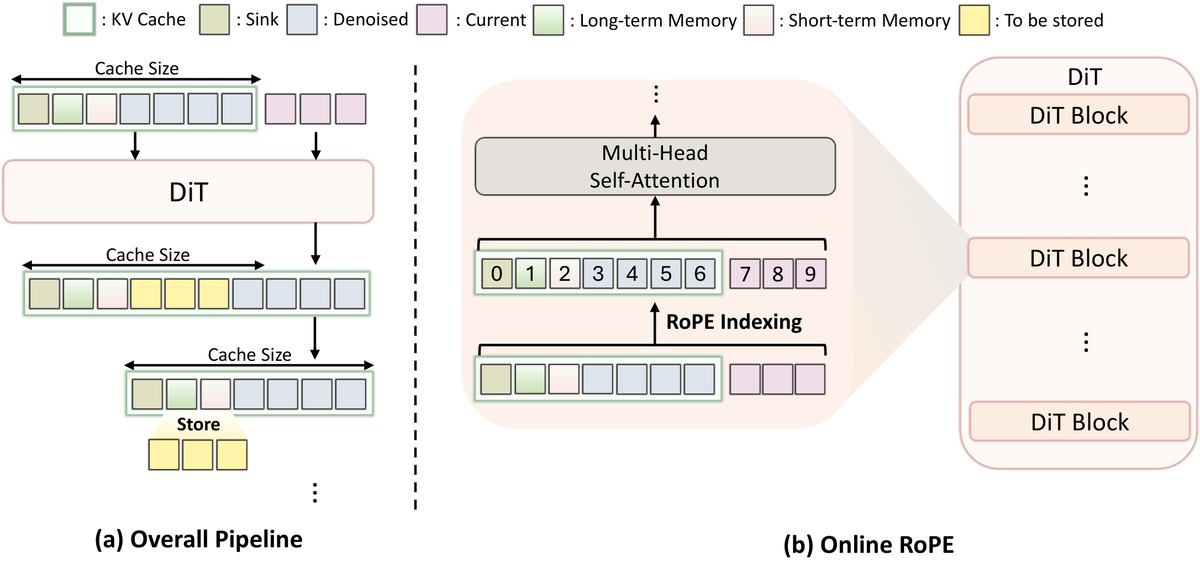

2. Anchor Forcing: Anchor Memory and Tri-Region RoPE for Interactive Streaming Video Diffusion

交互式流式视频扩散 | 锚点记忆+三区域RoPE | arXiv:2603.13405

关键词: 流式视频, 交互式生成, 锚点记忆, 三区域RoPE, 长视频

研究动机

交互式长视频生成需要支持提示词切换以引入新主体或事件,同时在扩展范围内保持感知保真度和连贯运动。现有蒸馏流式视频扩散模型通过滚动 KV 缓存实现长程生成,但存在两个核心失败模式:提示词切换时缓存维护无法同时保留语义上下文和近期潜在线索;蒸馏过程中无界时间索引导致位置分布偏移。

方法原理

提出 Anchor Forcing 缓存中心框架。第一,锚点引导重缓存机制:在锚点缓存中存储 KV 状态,每次提示词切换时从锚点热启动重缓存,减少切换后的证据损失并稳定感知质量。第二,三区域 RoPE:设计区域特定的参考原点,配合 RoPE 重对齐蒸馏,将无界流式索引与预训练 RoPE 体制协调,更好地保留运动先验。

核心创新

- 识别交互式流式生成的两个特有失败模式

- 锚点引导重缓存:KV 状态锚点存储 + 热启动,提升切换边界质量

- 三区域 RoPE + 重对齐蒸馏:解决无界索引的位置分布偏移

- 与 MemRoPE 思路互补,但专注交互式场景

实验结果

- 长视频交互式设置中,感知质量和运动指标均优于现有流式基线

- 支持多次提示词切换且质量不退化

方法流程

- 提示词 P₁ — 初始场景描述

- 流式去噪 + KV缓存 — 蒸馏的视频扩散模型 滚动 KV 缓存

- 锚点缓存存储 — 定期存储 KV 状态 到锚点缓存

- 提示词切换 P₂ — 用户输入新提示词 引入新主体/事件

- 锚点热启动重缓存 — 从锚点缓存恢复 减少边界质量损失

- 三区域 RoPE — 区域特定参考原点 保留运动先验

技术脉络

核心问题: 交互式长视频生成中提示词切换导致质量退化和运动失真

前序工作及局限:

- MemRoPE (2026-03-17):记忆令牌解决长程上下文,但非交互式设计

- StreamDiffusion (2024):实时帧流式,但不支持提示词切换

- Attention Sink (2024):静态锚点,提示词切换时信息丢失

- DistillVideo (2025):蒸馏流式模型,但RoPE位置漂移未解决

与前序工作的本质区别: 锚点引导重缓存热启动解决切换边界问题,三区域RoPE重对齐解决无界索引的位置分布偏移

技术演进定位: 关键补全——与MemRoPE互补,一个解决长程记忆一个解决交互切换,共同构建流式视频基础设施

可能的后续方向:

- 与MemRoPE的整合方案

- 多人协作交互式视频编辑

- 基于Anchor的视频分支/合并

批判性点评

- 实验评估: 在长视频交互式设置中全面评估,支持多次提示词切换。与现有流式基线对比感知质量和运动指标均提升。但缺少与MemRoPE的直接对比。

- 新颖性: 锚点缓存和三区域RoPE是流式视频的基础设施级创新。创新性:★★★★☆

- 可复现性: 项目页面已上线,方法描述详细。

- 影响力: 影响力 4/5 -- 与MemRoPE互补,共同构建流式视频生成基础设施。

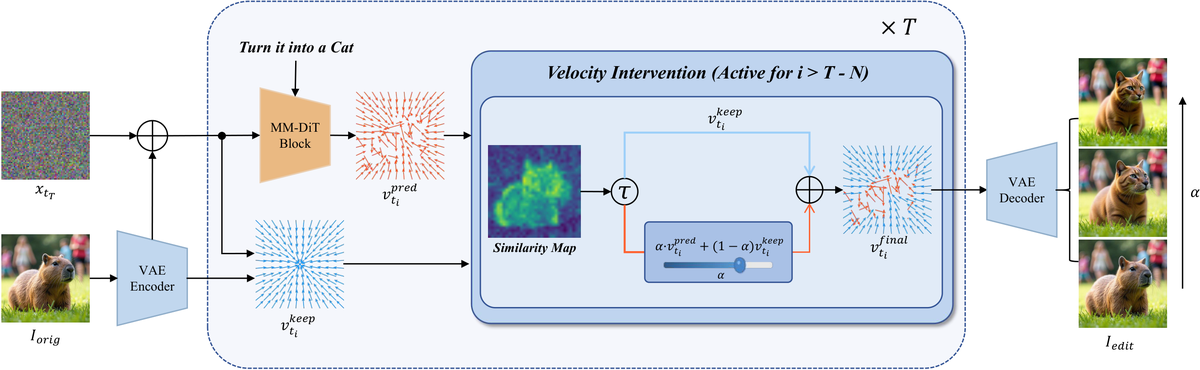

3. VeloEdit: Training-Free Consistent and Continuous Instruction-Based Image Editing via Velocity Field Decomposition

无训练速度场分解图像编辑 | Flux.1 Kontext | arXiv:2603.13388

关键词: 图像编辑, 无训练, 速度场分解, Flow Matching, 连续控制

研究动机

基于指令的图像编辑旨在根据文本指令修改源内容。然而,基于 Flow Matching 的现有方法常因去噪重建误差导致非编辑区域漂移,难以保持一致性。此外,它们通常缺乏对编辑强度的细粒度控制。

方法原理

提出 VeloEdit:一种无训练方法,通过量化保持源内容的速度场与驱动目标编辑的速度场之间的差异,动态识别编辑区域。基于此分区,在保留区域用源恢复速度替代编辑速度以强制一致性,在目标区域通过速度插值实现编辑强度的连续调制。直接操作速度场,不依赖复杂注意力操纵或辅助可训练模块。

核心创新

- 首次通过速度场差异量化实现动态编辑区域识别

- 保留区域速度替代 + 编辑区域速度插值的双策略

- 编辑强度连续可调,无需重新训练

- 在 Flux.1 Kontext 和 Qwen-Image-Edit 上验证

实验结果

- 在 Flux.1 Kontext 和 Qwen-Image-Edit 上,视觉一致性和编辑连续性显著提升

- 额外计算开销可忽略

- 代码已开源

方法流程

- 源图像 + 指令 — 输入图像和编辑指令

- Flow Matching 前向 — 计算源保持速度场 v_src 和编辑目标速度场 v_edit

- 速度差异量化 — ||v_edit - v_src|| 差异图 动态识别编辑区域

- 区域分区 — 保留区域 ↔ 编辑区域 基于差异阈值划分

- 速度场替代/插值 — 保留区域: v_src 替代 编辑区域: 插值调控强度

- 一致编辑输出 — 非编辑区域完美保持 编辑强度连续可调

技术脉络

核心问题: Flow Matching时代图像编辑的区域一致性和强度控制困难

前序工作及局限:

- InstructPix2Pix (2023):指令编辑但基于U-Net,不适用于FM架构

- RF-Edit (2024):FM编辑但全图重建,非编辑区域漂移

- FlowEdit (2025):FM注入编辑,但缺乏连续强度控制

- TurboEdit (2025):加速编辑但牺牲一致性

与前序工作的本质区别: 直接操作速度场而非注意力,通过v_edit与v_src差异量化实现动态区域识别和连续强度插值

技术演进定位: 新范式——速度场分解是FM时代原生编辑方法,比移植U-Net时代注意力操纵更自然

可能的后续方向:

- 视频FM编辑的速度场分解

- 多指令组合编辑

- 3D一致性速度场编辑

批判性点评

- 实验评估: 在 Flux.1 Kontext 和 Qwen-Image-Edit 两个最新模型上验证,视觉一致性和编辑连续性显著提升。但仅在图像编辑测试,未扩展到视频。

- 新颖性: 速度场分解是FM时代原生的编辑方法论,简洁优雅。创新性:★★★★☆

- 可复现性: 代码已开源,直接可复现。

- 影响力: 影响力 4/5 -- FM编辑的范式性方法,预计会被广泛采用。

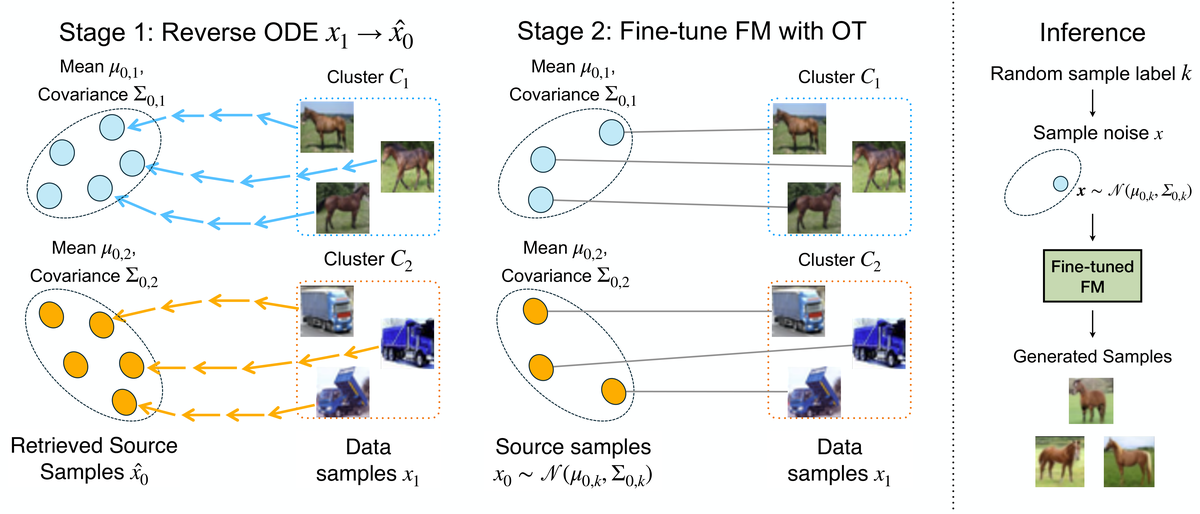

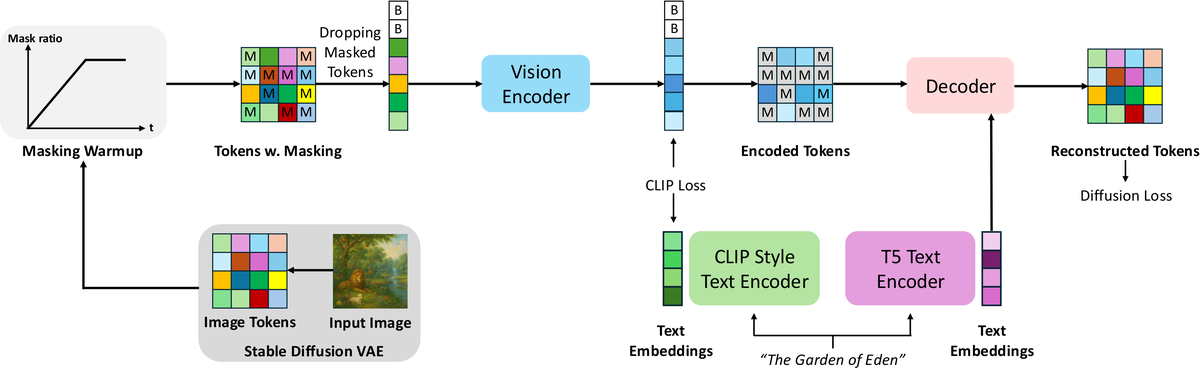

4. COT-FM: Cluster-wise Optimal Transport Flow Matching

聚类最优传输 Flow Matching | CVPR 2026 | arXiv:2603.13395

关键词: Flow Matching, 最优传输, 加速采样, CVPR 2026, 即插即用

研究动机

Flow Matching 模型由于随机或批级耦合常产生弯曲轨迹,增加离散化误差并降低样本质量。如何让生成轨迹更直从而减少采样步数,是加速 FM 的核心问题。

方法原理

提出 COT-FM 通用框架,通过聚类目标样本并为每个聚类分配专用源分布(通过反转预训练 FM 模型获得)来重塑概率路径。这种分而治之策略产生更精确的局部传输和显著更直的向量场,且不改变模型架构。作为即插即用方法,可直接应用于任何预训练 FM 模型。

核心创新

- 聚类级最优传输重塑 FM 概率路径,轨迹更直

- 即插即用,不改变模型架构

- 同时加速采样并提升生成质量

- 通用性:2D 数据、图像生成、机器人操作均有效

实验结果

- 2D 数据集、图像生成基准和机器人操作任务上

- 一致地加速采样并提升生成质量

- CVPR 2026 接收

方法流程

- 目标数据 X₁ — 训练数据集

- K-means 聚类 — 将目标样本分为 K 个簇

- 反转 FM 获取源 — 对每个簇反转预训练 FM 获得专用源分布

- 局部传输优化 — 簇内 OT 耦合 比全局耦合更精确

- 更直的向量场 — 离散化误差↓ 采样质量↑

- 加速高质量生成 — 更少步数达到同等质量

技术脉络

核心问题: Flow Matching的随机耦合导致弯曲轨迹和采样质量损失

前序工作及局限:

- Rectified Flow (2023):直化轨迹但需重训练

- Consistency Models (2023):单步生成但质量有损

- SGA (2026-03-12):从几何角度分析FM,但未优化传输路径

- OT-CFM (2023):批级最优传输,但粒度粗

与前序工作的本质区别: 聚类级分而治之策略,为每个簇反转FM获取专用源分布,实现比全局OT更精确的局部传输

技术演进定位: 方法论创新——CVPR 2026 接收,聚类OT是FM加速的第三条路线(与蒸馏、直化互补)

可能的后续方向:

- 层次聚类的多尺度OT

- 与蒸馏方法的联合

- 视频FM的时序聚类OT

批判性点评

- 实验评估: 在2D数据、图像生成和机器人操作三个完全不同的领域验证通用性。CVPR 2026 接收。但图像生成基准的提升幅度需关注。

- 新颖性: 聚类OT重塑概率路径简洁有力,即插即用特性极好。创新性:★★★★☆

- 可复现性: 方法论清晰,可复现性高。

- 影响力: 影响力 4/5 -- FM加速的新路线,CVPR 2026 认可。

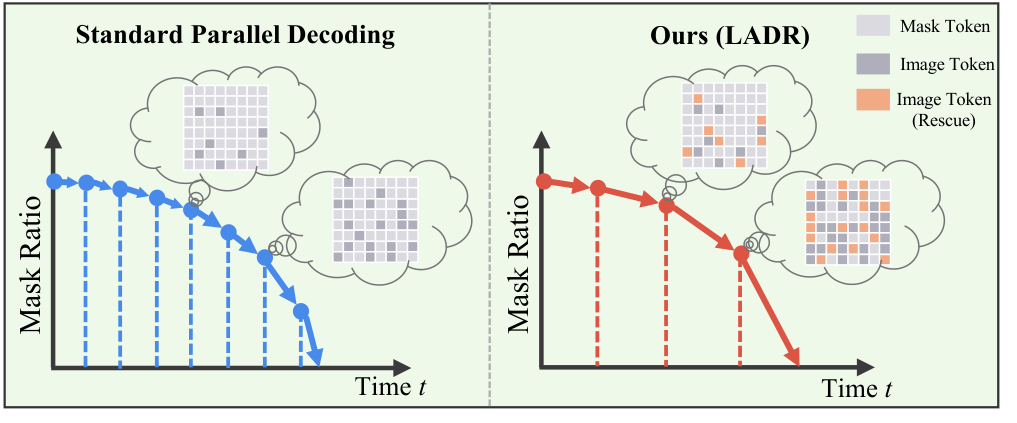

5. LADR: Locality-Aware Dynamic Rescue for Efficient Text-to-Image Generation with Diffusion Large Language Models

扩散语言模型高效文生图 | 4x 加速 | arXiv:2603.13450

关键词: 扩散LLM, 高效推理, 局部感知, 4x加速, 无训练

研究动机

离散扩散语言模型已成为统一多模态生成的引人注目范式,但迭代解码导致高推理延迟。现有加速策略要么需要昂贵重训练,要么未能利用视觉数据固有的 2D 空间冗余性。

方法原理

提出 LADR(局部感知动态拯救),利用图像的空间马尔可夫性质加速推理。优先恢复'生成前沿'处的标记(与已观察像素空间相邻的区域),最大化信息增益。集成形态学邻居识别定位候选标记、有界风险过滤防止错误传播、流形一致逆调度加速掩码密度与扩散轨迹对齐。

核心创新

- 首次将空间马尔可夫性质引入扩散 LLM 推理加速

- 生成前沿优先恢复策略,最大化信息增益

- 形态学邻居识别 + 有界风险过滤 + 流形逆调度三模块

- 无训练,保持甚至增强生成保真度

实验结果

- 四个 T2I 基准上实现约 4x 加速

- 保持甚至增强生成保真度

- 空间推理任务尤其突出

方法流程

- 文本 Prompt — 输入文本描述

- 扩散 LLM 解码 — 离散扩散语言模型 迭代去掩码解码

- 生成前沿检测 — 形态学邻居识别 已恢复像素的空间邻域

- 优先恢复前沿 — 仅恢复信息增益最大的 前沿 token

- 有界风险过滤 — 防止错误传播 确保质量不退化

- 4x 加速输出 — 高保真图像 推理时间减少 75%

技术脉络

核心问题: 离散扩散语言模型的迭代解码导致T2I推理极慢

前序工作及局限:

- Show-o (2024):统一理解和生成的扩散LLM,但推理慢

- Emu3 (2024):自回归视觉生成LLM,延迟高

- DART (2025):非自回归token生成,但未利用2D空间结构

- AccelAes (2026-03-17):DiT美学加速,但针对连续扩散非离散LLM

与前序工作的本质区别: 首次利用图像空间马尔可夫性质,生成前沿优先恢复最大化信息增益,4x加速无质量损失

技术演进定位: 实用突破——扩散LLM从理论演示走向实际部署,4x加速是关键里程碑

可能的后续方向:

- 与Flash Attention的联合加速

- 视频扩散LLM的时空马尔可夫加速

- 动态分辨率的自适应前沿

批判性点评

- 实验评估: 四个T2I基准全面验证,4x加速数据可靠。空间推理任务甚至质量提升是亮点。但仅在T2I上验证,未扩展到T2V。

- 新颖性: 空间马尔可夫性质的发现和利用是精彩的洞察。创新性:★★★★★

- 可复现性: 方法描述清晰,无训练方法易于复现。

- 影响力: 影响力 5/5 -- 扩散LLM部署的关键里程碑。

批判性点评精选

1. 视频精细控制进入统一时代

Tri-Prompting 和 Anchor Forcing 代表视频生成控制的两个关键方向:前者统一了场景/主体/运动三维度的精细控制,后者解决了交互式流式生成的边界质量问题。结合昨天的 MemRoPE,我们看到一个完整的流式视频控制栈正在形成:MemRoPE 负责长程记忆,Anchor Forcing 负责交互切换,Tri-Prompting 负责精细控制。

2. Flow Matching 生态正在快速成熟

VeloEdit 的速度场分解和 COT-FM 的聚类最优传输分别从编辑和采样两个角度深化 Flow Matching 生态。VeloEdit 表明 FM 的速度场可以直接操作来实现编辑(比移植注意力操纵更自然),COT-FM 则为 FM 加速开辟了蒸馏和直化之外的第三条路线。FM 正从'替代扩散'走向'建立自己的方法论体系'。

3. 扩散 LLM 的部署瓶颈正在被突破

LADR 的 4x 无训练加速表明离散扩散 LLM 的推理效率问题正被认真对待。空间马尔可夫性质是一个精彩的发现——图像 token 的空间局部性可以被利用来避免冗余恢复。这与 DiT 连续扩散的加速(JiT、AccelAes)形成互补,两条技术路线共同推动视觉生成模型的实际部署。

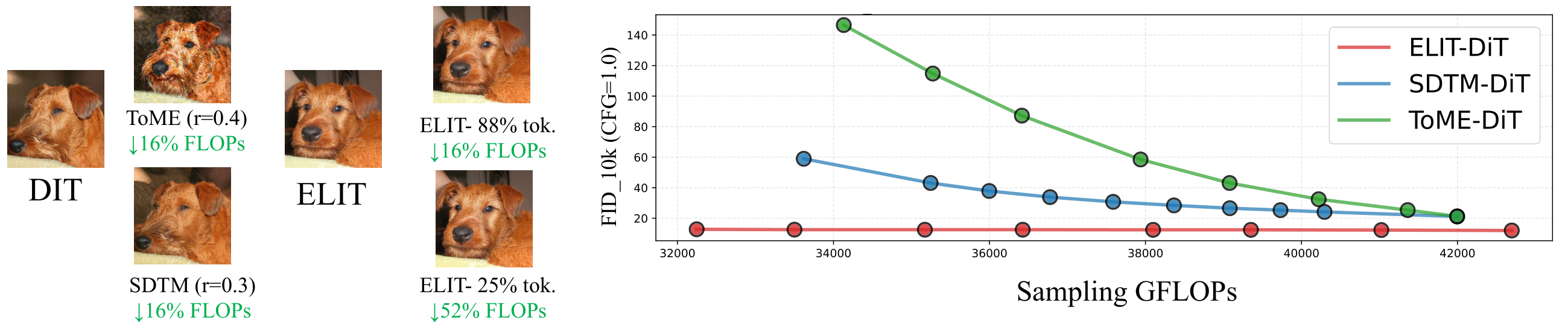

其余论文 · 贡献与效果总结

| # | 论文 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|

| 1 | LibraGen (Playing a Balance Game in Subject-Driven Video Generation) | 主体驱动 . S2V . DPO . 平衡博弈 | 将S2V视为平衡博弈,Consis-DPO + Real-Fake DPO + 时间依赖动态CFG | 仅千量级数据超越开源和商业S2V模型 |

| 2 | NumColor (Precise Numeric Color Control in Text-to-Image Generation) | 精确颜色 . 数字控制 . Lab空间 . 零样本 | Color Token Aggregator + 6707个可学习ColorBook嵌入,CIE Lab空间映射 | 数字颜色准确度提升4-9x,零样本迁移5个模型 |

| 3 | EVD (Event-Driven Video Generation) | 事件驱动 . 交互幻觉 . 门控采样 . DiT | 事件头预测token级活动,事件门控采样减少交互幻觉 | 状态持久/空间准确/支撑关系/接触稳定全面改善 |

| 4 | FlashMotion (Few-Step Controllable Video Generation with Trajectory Guidance (CVPR 2026)) | 轨迹引导 . 少步生成 . CVPR 2026 . 蒸馏 | 轨迹适配器+联合蒸馏实现少步可控视频生成 | CVPR 2026,代码已开源 |

| 5 | GlyphPrinter (Region-Grouped DPO for Glyph-Accurate Visual Text Rendering (CVPR 2026)) | 文本渲染 . DPO . 字形准确 . CVPR 2026 | 区域分组DPO文本渲染,无需显式奖励模型 | CVPR 2026,字形准确渲染SOTA |

| 6 | Spectrum Matching (A Unified Perspective for Superior Diffusability in Latent Diffusion) | VAE . 扩散性 . 频谱匹配 . 潜在扩散 | 频谱匹配假说统一理解VAE在潜在扩散中的可学习性 | 两个实用方法显著提升VAE扩散性 |

| 7 | SERUM (Simple Efficient Robust Unifying Marking for Diffusion Image Gen (ICLR 2026)) | 水印 . 扩散标记 . ICLR 2026 . 鲁棒 | 初始噪声中添加水印噪声,训练轻量检测器 | ICLR 2026,1% FPR下最高TPR,支持多用户 |

| 8 | DC-Diffusion (High-Fidelity T2I from VLM via Distribution-Conditioned Diffusion Decoding) | VLM . 扩散解码 . 分布条件 . 高保真 | Logit-to-Code分布映射将VLM token logits转连续条件信号 | 仅ImageNet-1K短训练即提升VLM视觉保真度 |

趋势观察

- 视频生成精细控制 — Tri-Prompting/Anchor Forcing/LibraGen 分别从场景-主体-运动联合控制/交互式流式/主体定制三个维度推进

- Flow Matching 理论深化 — COT-FM 和 Spectrum Matching 分别从传输路径优化和 VAE 扩散性角度深化 FM 基础

- 扩散 LLM 走向实用 — LADR 4x 加速表明离散扩散 LLM 的推理效率瓶颈正在被攻克

- 无训练编辑方法涌现 — VeloEdit 速度场分解代表 Flow Matching 时代编辑方法的新范式

- 生成内容安全与可控 — SERUM 水印 + NumColor 精确颜色 + EVD 事件驱动,多维度提升生成可控性

人工智能炼丹师 整理 | 2026-03-18

评论 (0)