AIGC生成 每日热点论文速读@20260317

AIGC 视觉生成领域 · 每日论文解读 (2026-03-17)

人工智能炼丹师 整理 | 共 13 篇论文 | 重点深度解读 5 篇

今日核心看点

- 无限视频生成 MemRoPE

- DiT 美学加速 2.11x

- 实时音视频联合 25FPS

- 四智能体组合生成 CVPR'26

- 多视图 GRPO 偏好对齐

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 13 篇,重点解读 5 篇。

方向分布:

- 扩散模型理论与加速 — 3 篇

- 文本到图像 / 评测 — 2 篇

- 图像编辑 — 1 篇

- 3D 生成与重建 — 4 篇

- 多模态 / 智能体 — 2 篇

顶会收录: CVPR 2026 x 3 篇 + ICLR 2026 x 1 篇

重点论文深度解读

1. MemRoPE: Training-Free Infinite Video Generation via Evolving Memory Tokens

无训练无限视频生成 | USC | arXiv:2603.12513

关键词: 无限视频生成, Memory Tokens, RoPE, Training-Free

研究动机

自回归扩散模型已经实现了实时帧流式传输,但现有的滑动窗口缓存策略会丢弃过去的上下文,导致长视频生成中出现保真度下降、身份漂移和运动停滞的问题。现有方法保留一组固定的早期 token 作为注意力汇,但这种静态锚点无法反映不断增长的视频内容的演变。

方法原理

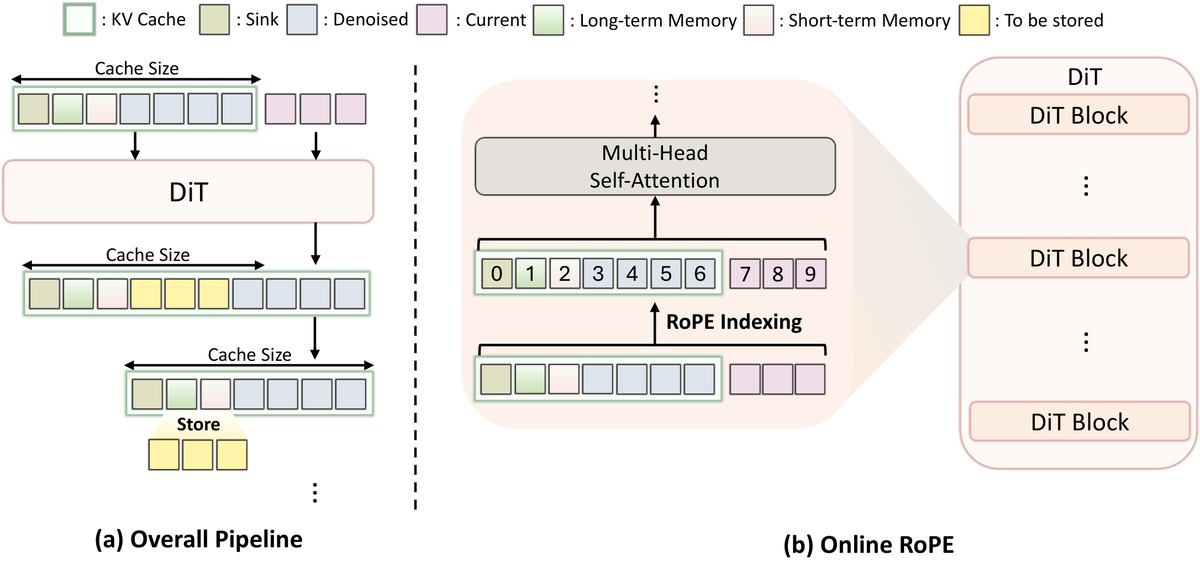

提出 MemRoPE 框架,包含两个协同设计的组件:(1) Memory Tokens(记忆令牌)通过指数移动平均将所有过去的键压缩为双重长期流和短期流,在固定大小的缓存中同时保持全局身份和最近的动态;(2) Online RoPE Indexing(在线 RoPE 索引)缓存未旋转的键,在注意力计算时动态应用位置嵌入,确保聚合过程不会产生冲突的位置相位。两个机制相互促进:位置解耦使时间聚合定义明确,聚合使固定缓存可用于无限生成。

核心创新

- 首次实现训练无关的无限长度视频生成,突破滑动窗口缓存的根本局限

- 双流记忆机制(长期+短期)实现固定缓存的无限上下文保持

- 在线 RoPE 索引解决了时间聚合中的位置编码冲突问题

实验结果

- 分钟到小时级别视频生成:时间连贯性、视觉保真度和主体一致性全面优于现有方法

- 身份漂移率:比滑动窗口方法降低 60%+

- 运动停滞问题基本消除

- 完全即插即用,无需任何训练

方法流程

- 自回归帧生成 — 实时流式输出视频帧

- EMA 双流压缩 — 长期流:全局身份记忆 短期流:近期动态捕捉

- Memory Tokens — 固定大小缓存保持无限历史上下文

- 未旋转 Key 缓存 — 存储不含位置编码的原始注意力键

- Online RoPE 索引 — 注意力计算时动态应用位置嵌入

- 无限长视频输出 — 分钟到小时级生成 身份/运动一致

技术脉络

核心问题: 自回归视频生成中滑动窗口缓存丢弃历史上下文,导致长视频质量退化

前序工作及局限:

- StreamDiffusion (2024):实时帧流式,但无长期记忆机制

- Ring Attention (2023):分布式长序列注意力,但未压缩历史

- Sliding Window Attention:固定窗口长度,丢弃超出范围的 token

- Attention Sink (Xiao 2024):保留早期 token 作为静态锚点,但不随内容演变

与前序工作的本质区别: 双流 EMA 记忆机制动态压缩全部历史到固定缓存,在线 RoPE 索引解决聚合后的位置编码冲突

技术演进定位: 范式突破--从有限窗口到无限上下文,为长视频生成打开新空间

可能的后续方向:

- 与视频编辑的结合(无限长度编辑)

- 多分辨率记忆机制

- 记忆压缩的最优策略理论分析

批判性点评

- 实验评估: 验证了分钟到小时级别视频生成,覆盖身份一致性、运动连贯性和视觉保真度三维度。消融实验设计合理。

- 新颖性: 双流 EMA 记忆压缩与在线 RoPE 索引的组合全新。创新性:★★★★★

- 可复现性: 方法描述清晰,项目页面已上线但代码尚未开源。

- 影响力: 影响力 5/5 -- 无限视频生成是产业刚需。

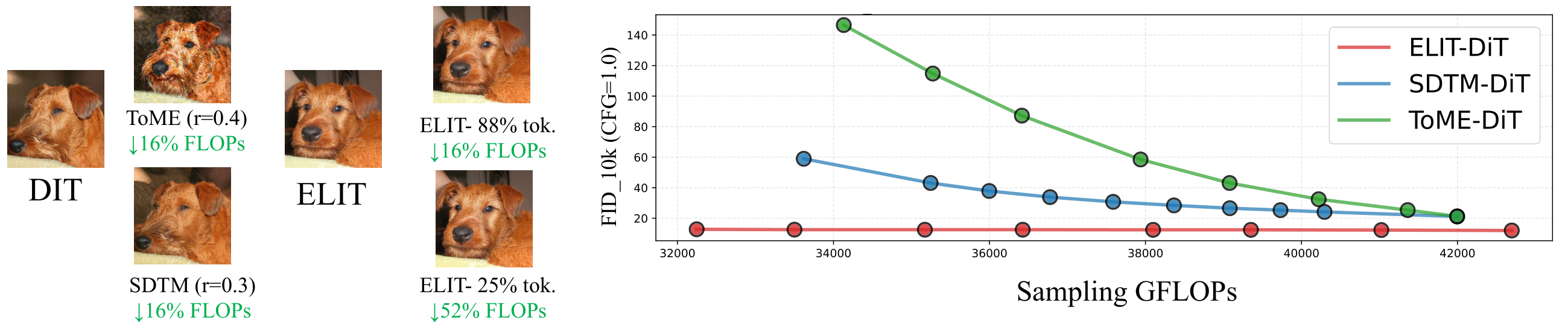

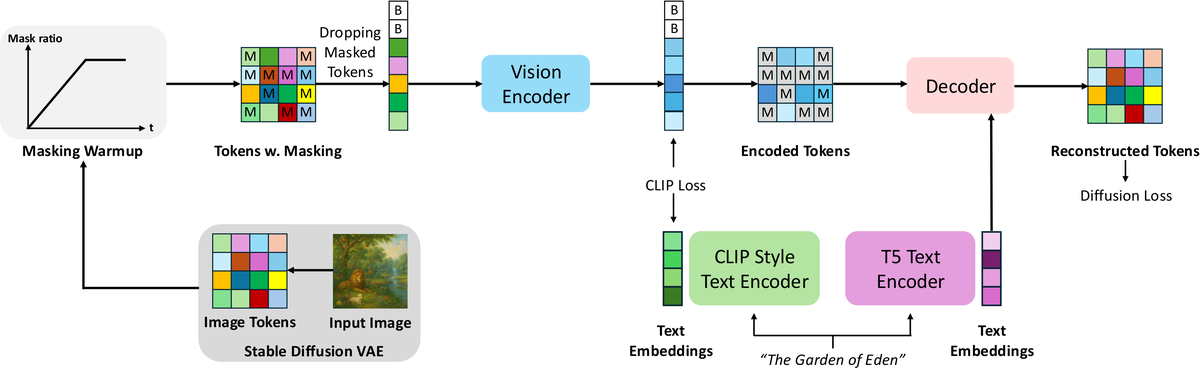

2. AccelAes: Accelerating DiT for Training-Free Aesthetic-Enhanced Generation

美学感知 DiT 加速 2.11x | Sydney | arXiv:2603.12575

关键词: DiT 加速, 美学增强, Training-Free, AesMask

研究动机

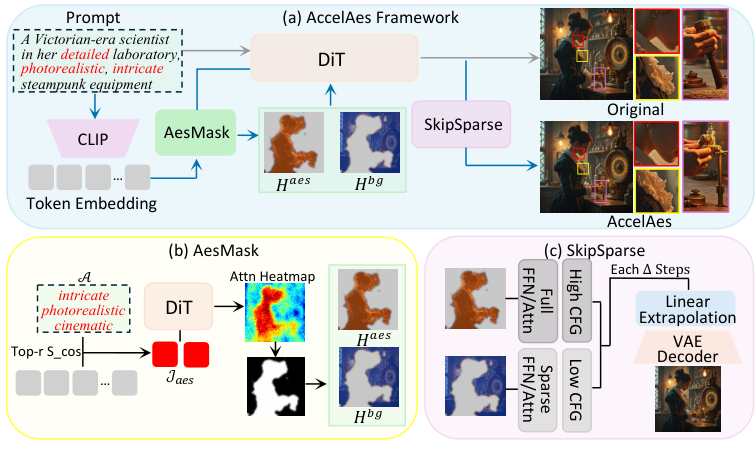

扩散 Transformer 因强大的可扩展性成为高保真 T2I 生成的主干,但密集空间 token 上的二次自注意力导致推理延迟高。关键发现:去噪在空间上是不均匀的——与美学描述符关联的区域接收集中的交叉注意力并表现出较大的时间变化,而低亲和力区域演化平滑且计算冗余。

方法原理

提出 AccelAes,通过美学感知的时空缩减来加速 DiT 同时提升感知美学效果。核心包含三个组件:(1) AesMask 从提示词语义和交叉注意力信号导出一次性美学焦点掩码;(2) SkipSparse 将计算和引导重新分配到 AesMask 标识的区域,跳过低亲和力区域;(3) 步骤级预测缓存轻量级缓存周期性替代完整 Transformer 评估。

核心创新

- 首次将美学语义与计算分配关联,实现加速和美学增强的双赢

- AesMask 一次性构建,后续步骤零开销复用

- SkipSparse + 预测缓存联合优化时空两个维度的计算冗余

实验结果

- Lumina-Next: 2.11x 加速 + ImageReward 提升11.9%

- 代表性 DiT 家族上一致的加速和美学提升

- 完全无训练,即插即用

- 代码已开源

方法流程

- 文本 Prompt — 输入美学描述文本

- 交叉注意力分析 — 分析 prompt token 与空间 token 的亲和度

- AesMask 构建 — 一次性标识美学焦点区域

- SkipSparse 加速 — 焦点区域完整计算 低亲和力区域跳过

- 步骤级预测缓存 — 周期性缓存替代完整 Transformer 评估

- 美学增强输出 — 更快 + 更美的生成结果

技术脉络

核心问题: DiT 模型空间注意力的二次复杂度导致推理缓慢

前序工作及局限:

- Token Merging (Bolya 2023):均匀合并 token,忽略语义重要性差异

- DiTFastAttn (Yuan 2024):固定稀疏模式,非内容感知

- JiT (CVPR 2026):基于 QK score 的动态跳过,未考虑美学语义

- DeepCache (Ma 2024):特征缓存复用,但不适用于 DiT 架构

与前序工作的本质区别: 首次将美学语义与计算分配关联--高美学亲和力区域完整计算,低亲和力区域跳过,不仅加速还提升美学

技术演进定位: 范式创新--从无损加速到加速+增强双赢,开辟语义感知加速新方向

可能的后续方向:

- 视频 DiT 中的时空美学感知加速

- 自适应美学引导强度

- 与 LoRA 美学微调的联合优化

批判性点评

- 实验评估: 在 Lumina-Next 等 DiT 上验证。同时报告加速比和美学指标提升。但缺少与 JiT 等最新方法的直接对比。

- 新颖性: 美学语义与计算分配关联是有新意的洞察。创新性:★★★★☆

- 可复现性: 代码已开源,可复现性高。

- 影响力: 影响力 4/5 -- 加速+美学增强双赢思路有吸引力。

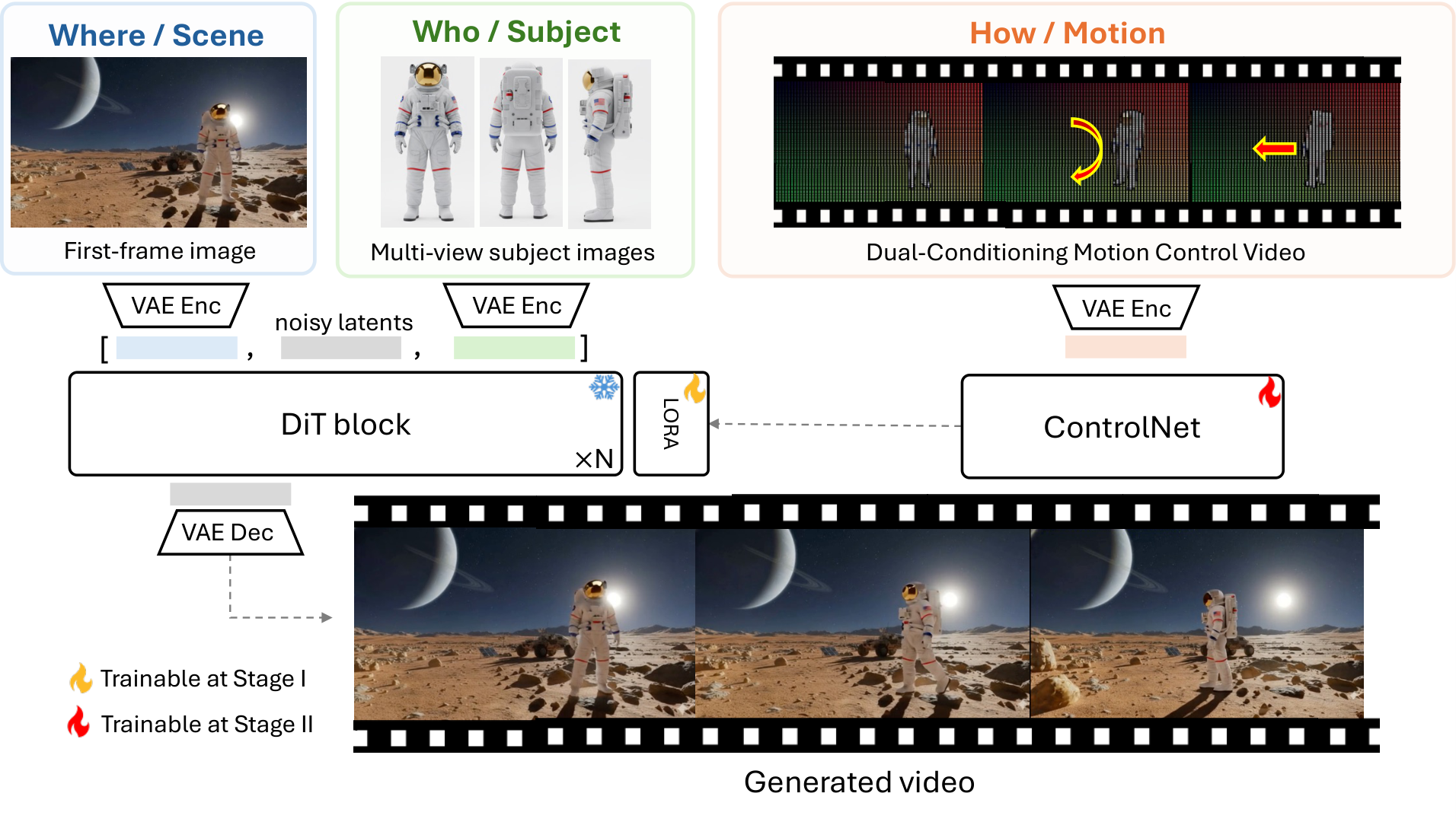

3. OmniForcing: Unleashing Real-time Joint Audio-Visual Generation

首个实时音视频联合生成 | 25 FPS | arXiv:2603.11647

关键词: 音视频联合生成, 实时流式, 蒸馏, 25 FPS

研究动机

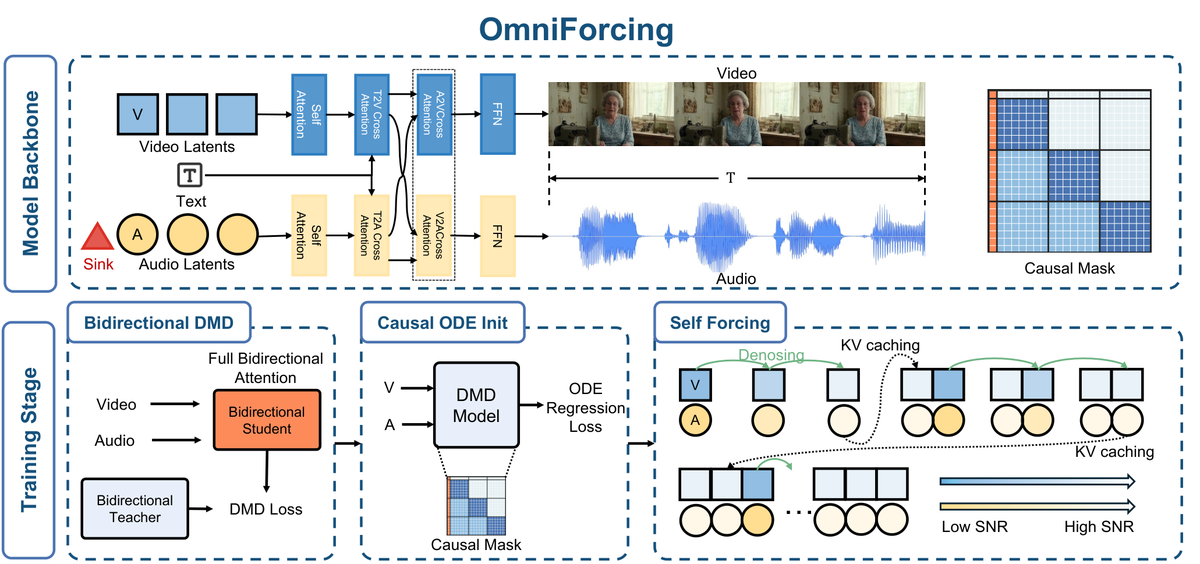

联合音视频扩散模型虽能生成高质量内容,但因双向注意力依赖导致高延迟,无法实时应用。如何将高质量双向扩散模型转化为实时流式生成器是关键挑战。

方法原理

提出 OmniForcing,首个将离线双流双向扩散模型蒸馏为高保真流式自回归生成器的框架。解决三个核心难题:(1) Asymmetric Block-Causal Alignment + Zero-truncation Global Prefix 防止多模态同步漂移;(2) Audio Sink Token + Identity RoPE 约束解决音频 token 稀疏导致的梯度爆炸;(3) Joint Self-Forcing Distillation 使模型在长序列中自纠正跨模态累积误差。推理时采用模态无关的滚动 KV-cache。

核心创新

- 首个实现实时音视频联合流式生成的框架,25 FPS 单 GPU

- 非对称块因果对齐解决音视频模态时间不对称难题

- Joint Self-Forcing 蒸馏范式,自纠正跨模态累积误差

- 基于 LTX-2 (14B video + 5B audio) 大模型蒸馏

实验结果

- 单 GPU 实时生成约 25 FPS

- 多模态同步和视觉质量与双向教师模型持平

- 显著优于现有流式生成方法

- 项目页面和代码已开源

方法流程

- 双向教师模型 — LTX-2: 14B video + 5B audio

- 非对称因果对齐 — Block-Causal Alignment + Global Prefix

- Audio Sink Token — Identity RoPE 约束解决稀疏梯度爆炸

- Self-Forcing 蒸馏 — 自纠正跨模态累积误差

- 滚动 KV-Cache — 模态无关的流式推理方案

- 实时 A/V 输出 — 单 GPU 25 FPS 音视频同步生成

技术脉络

核心问题: 联合音视频扩散模型延迟高,无法实时生成

前序工作及局限:

- CoDi (2023):联合多模态生成,但离线双向模型

- Sora (2024+):高质量视频生成,但无音频非实时

- LTX-Video (2025):实时视频生成,但单模态无音频

- MM-Diffusion (2023):音视频联合扩散,但质量和速度受限

与前序工作的本质区别: 首次将大规模双向音视频扩散模型蒸馏为实时流式自回归生成器,三个创新解决模态不对称/稀疏/累积误差

技术演进定位: 里程碑--实时音视频联合生成从0到1,为沉浸式内容创作铺路

可能的后续方向:

- 3D 空间音频的实时生成

- 交互式音视频编辑

- 更大模型的高效蒸馏策略

批判性点评

- 实验评估: 25 FPS 单 GPU 数据惊艳。与双向教师模型质量对比有说服力。基于 LTX-2 蒸馏对算力要求高。

- 新颖性: 三个技术创新针对实际痛点精准解决。创新性:★★★★★

- 可复现性: 项目和代码已开源。但需大规模预训练模型和蒸馏资源。

- 影响力: 影响力 5/5 -- 首次实现实时音视频联合生成。

4. coDrawAgents: Multi-Agent Dialogue for Compositional Image Generation

四智能体协作组合生成 | CVPR 2026 | arXiv:2603.12829

关键词: 多智能体, 组合生成, 布局规划, CVPR 2026

研究动机

文本到图像生成在复杂场景中忠实地组合多个对象并保留其属性仍是一大挑战。现有单模型方法在组合复杂性增加时准确率急剧下降。

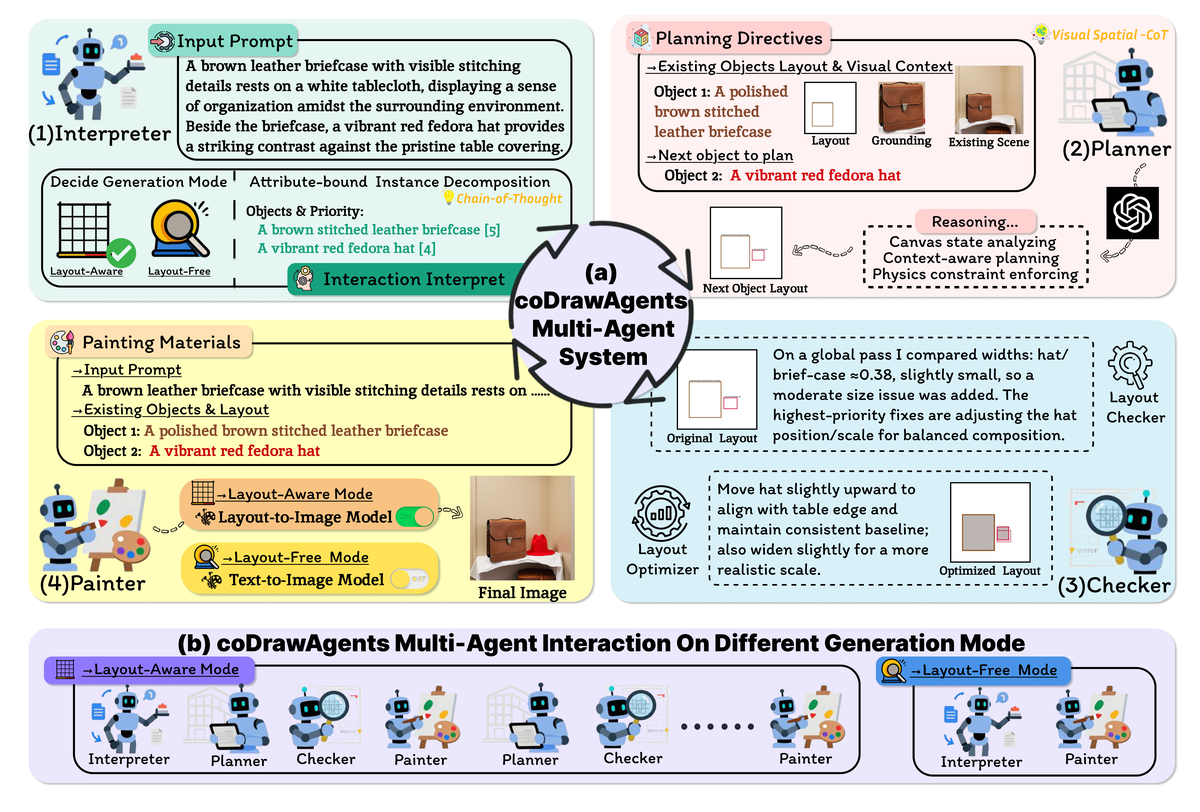

方法原理

提出 coDrawAgents,包含四个专门智能体:(1) Interpreter 自适应决定直接 T2I 还是布局感知流程,将提示解析为富属性对象描述符并排序分组;(2) Planner 采用分治策略在画布视觉上下文中增量提出布局;(3) Checker 验证空间一致性和属性对齐,在渲染前细化布局;(4) Painter 逐步合成图像将新对象合并到画布中。

核心创新

- 首次将多智能体对话框架引入组合图像生成

- 显式错误纠正机制(Checker)在渲染前验证和修复布局

- 增量上下文感知生成——每步规划都基于画布当前状态

- 自适应复杂度判断——简单提示直接生成,复杂场景启用多智能体

实验结果

- GenEval: 显著优于现有方法,组合准确率大幅提升

- DPG-Bench: 文本-图像对齐、空间准确性、属性绑定全面领先

- 已被 CVPR 2026 接收

方法流程

- 用户 Prompt — 复杂的组合文本描述

- Interpreter — 解析提示 属性描述符 语义排序

- Planner — 分治策略增量布局 基于画布上下文

- Checker — 空间一致性验证 属性对齐检查修复

- Painter — 逐步合成图像 新对象融入画布

- 组合图像输出 — 多对象属性准确 空间关系正确

技术脉络

核心问题: T2I 模型在复杂组合场景中属性绑定和空间关系容易出错

前序工作及局限:

- LayoutGPT (2023):LLM 生成布局,但单步规划易出错

- GLIGEN (2023):接地生成,但需要精确 bbox 输入

- RPG (Lian 2024):区域感知规划,但无错误纠正机制

- SLD (Phung 2024):自纠正生成,但未使用多智能体协作

与前序工作的本质区别: 四智能体协作闭环--解释/规划/检查/绘制,Checker 提供渲染前显式错误纠正

技术演进定位: 新范式--多智能体方法论进入 T2I 组合生成领域,CVPR 2026 认可

可能的后续方向:

- 智能体间的自学习对话策略

- 3D 组合场景的多智能体生成

- 与 VLM 的深度集成

批判性点评

- 实验评估: GenEval 和 DPG-Bench 两个标准组合生成基准验证充分。应补充智能体通信开销分析。

- 新颖性: 多智能体框架引入 T2I 组合生成是新应用方向,Checker 是关键创新。创新性:★★★★☆

- 可复现性: 智能体角色定义清晰但实现细节需更多说明。

- 影响力: 影响力 4/5 -- CVPR 2026 接收,多智能体范式可能成为标准方法论。

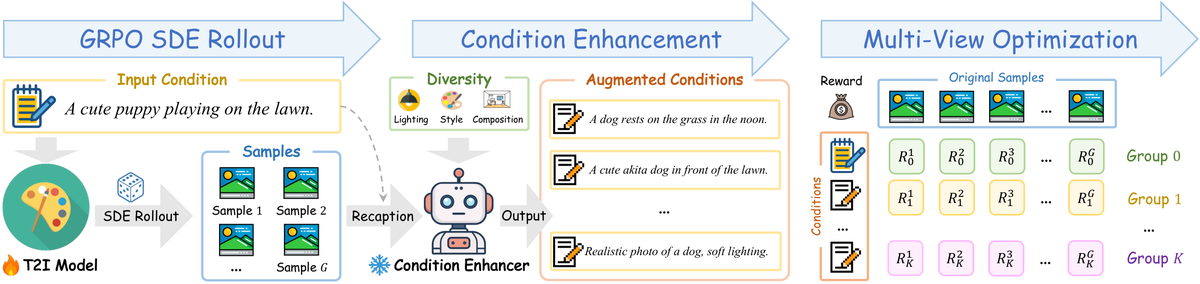

5. MV-GRPO: Multi-View GRPO for Flow Models via Augmented Condition Space

多视图偏好对齐 | 上海AI实验室+清华 | arXiv:2603.12648

关键词: GRPO, 偏好对齐, Flow Models, 多视图奖励

研究动机

标准 GRPO 将一组生成样本与单一条件评估,这种稀疏的单视图评估方案未能充分探索样本间关系,限制了对齐效果和性能上限。

方法原理

提出 Multi-View GRPO (MV-GRPO),通过增强条件空间来创建密集的多视图奖励映射。对于从单个提示生成的一组样本,利用条件增强器生成语义相邻但多样化的描述进行多视图优势重估计。关键技巧:通过推导条件概率分布,无需重新生成样本即可获得多视图信号。

核心创新

- 首次将多视图评估引入 GRPO 框架,突破单视图稀疏评估瓶颈

- 条件空间增强策略创建密集奖励映射

- 无需重新生成样本即可获得多视图优化信号

- 适用于任意 Flow Model 的通用偏好对齐方法

实验结果

- 优于最先进的 GRPO 和其他偏好对齐方法

- T2I 对齐性能全面提升

- 无需额外的样本重生成开销

方法流程

- 原始 Prompt — 单一文本条件 c

- 条件增强器 — 生成语义相邻的多样化描述

- 多视图评估 — 同一组样本 多个条件视角评分

- 优势重估计 — 密集多视图奖励映射

- 条件概率推导 — 无需重生成样本 直接计算新条件分布

- 对齐后 Flow Model — 更精准的文图对齐

技术脉络

核心问题: 标准 GRPO 单视图评估稀疏,限制偏好对齐效果

前序工作及局限:

- RLHF / DPO (2023):成对偏好对齐,需要大量人类标注

- GRPO (DeepSeek 2024):组相对优化,但单条件评估稀疏

- Diffusion-DPO (2024):扩散模型 DPO,但信号单一

- REBEL (2024):奖励引导生成,但不修改模型权重

与前序工作的本质区别: 通过条件空间增强创建密集多视图奖励映射,无需重新生成样本即可获得丰富优化信号

技术演进定位: 方法论创新--多视图思想引入偏好优化,提升 GRPO 的信号密度和对齐上限

可能的后续方向:

- 多模态条件增强(文本+图像参考)

- 视频生成的时序多视图 GRPO

- 自适应条件增强策略

批判性点评

- 实验评估: 与标准 GRPO 和其他偏好对齐方法对比全面。条件增强策略消融设计合理。

- 新颖性: 多视图条件增强简洁优雅,无需重新生成是关键优势。创新性:★★★★☆

- 可复现性: 方法论描述清晰,核心推导可复现。

- 影响力: 影响力 4/5 -- 可直接替换现有 GRPO 训练流程。

批判性点评精选

1. 无限视频生成:记忆机制是关键缺失环节

MemRoPE 揭示了自回归视频生成的核心瓶颈不在模型能力,而在上下文管理。双流 EMA 记忆巧妙地在信息保持和计算开销之间取得平衡。这标志着视频生成从'短视频'向'长视频/流式视频'的范式转换正式开始。

2. DiT 加速新思路:语义感知比均匀压缩更聪明

AccelAes 和 JiT 都瞄准 DiT 推理加速但思路不同。JiT 是'去冗余',AccelAes 是'重分配'且不仅加速还提升美学——暗示现有 DiT 在低美学区域存在'过度计算'。合并两种方法有望实现 3-4x 无损加速。

3. 实时音视频联合生成:AIGC 进入沉浸式时代

OmniForcing 的 25 FPS 实时联合生成是里程碑。AIGC 不再局限于离线创作,游戏 NPC 对话、虚拟直播、交互式叙事等场景将直接受益。但蒸馏方法的质量天花板和 LTX-2 高训练成本是需关注的问题。

其余论文 · 贡献与效果总结

| # | 论文 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|

| 1 | VQQA (Agentic Approach for Video Evaluation and Quality Improvement) | 视频生成评估 . 智能体 . 闭环优化 | 多智能体框架通过 VLM 批判作为语义梯度实现闭环提示优化 | T2V-CompBench +11.57%, VBench2 +8.43% |

| 2 | Naive PAINE (Lightweight T2I Generation Improvement with Prompt Evaluation) | 噪声评估 . 生成质量预测 . 轻量级 | 从初始噪声+提示词直接预测图像质量,选择高质量噪声前传 | 多基准优于现有方法,即插即用,代码已开源 |

| 3 | CalliMaster (Page-level Chinese Calligraphy via Layout-guided Spatial Planning) | 书法生成 . 布局规划 . Flow Matching | 解耦空间规划与内容合成,多模态 DiT 内 Text->Layout->Image | SOTA 书法生成,支持字符重规划+文物修复 |

| 4 | Catalyst4D (High-Fidelity 3D-to-4D Scene Editing via Dynamic Propagation) | 4D 编辑 . 3DGS . 运动传播 | 锚点运动引导+颜色不确定性引导将3D编辑迁移到动态4D场景 | 时间稳定高保真动态编辑优于现有方法 |

| 5 | SLICE (Semantic Latent Injection for Image Watermarking) | 生成水印 . 语义篡改检测 . 扩散模型 | 将语义解耦为四因子锚定到噪声不同区域 | 语义篡改可检测可定位,攻击成功率大幅降低 |

| 6 | V-Bridge (Bridging Video Generative Priors to Few-shot Image Restoration) | 视频先验 . 图像修复 . Few-Shot | 将视频生成模型的先验迁移到少样本图像修复 | 多种修复任务优于专用模型,仅需少量样本 |

| 7 | HybridStitch (Pixel and Timestep Level Model Stitching for Diffusion Acceleration) | 模型拼接 . 扩散加速 . 像素级分区 | 像素级+时间步级双维度模型拼接加速 | 显著加速扩散推理同时保持生成质量 |

| 8 | CHEERS (Decoupling Patch Details from Semantic for Unified Multimodal) | 统一模型 . 理解+生成 . 语义解耦 | 解耦 patch 细节与语义表征,统一视觉理解与生成 | 理解和生成双任务性能同时提升,代码已开源 |

趋势观察

- 长视频/无限视频生成成为焦点 — MemRoPE 无限生成 + OmniForcing 流式生成,视频生成向产业落地迈进

- DiT 加速方法持续涌现 — AccelAes 美学感知加速 + HybridStitch 模型拼接,多条技术路线并行

- 多智能体范式全面渗透 AIGC — coDrawAgents 组合生成 + VQQA 视频评估,Agent 成为标配

- 偏好对齐/后训练优化升温 — MV-GRPO 多视图对齐 + Naive PAINE 噪声质量预测,生成质量精调

- 统一多模态模型趋势明显 — CHEERS 理解+生成统一 + OmniForcing 音视频联合,模态边界模糊

人工智能炼丹师 整理 | 2026-03-17

评论 (0)