AIGC 每日速读|2026-03-26

AIGC 视觉生成领域 · 每日论文解读 (2026-03-26)

人工智能炼丹师 整理 | 共 12 篇论文 | 重点深度解读 3 篇

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 12 篇,重点解读 3 篇。

方向分布:

- 生成理解一体化: 1 篇 (UniGRPO 统一 GRPO 框架)

- 视频生成: 4 篇 (ViBe 超高分辨率 + RealMaster 渲染提升 + InterDyad 语音到视频 + FG-Portrait 肖像动画)

- 图像编辑: 3 篇 (InverFill 少步修复 + GroupEditing 多图编辑 + Dress-ED 试穿编辑)

- 图像生成: 1 篇 (Zero-Shot Personalization 零样本个性化)

- 评测方法: 2 篇 (MuQ-Eval 音乐质量 + Q-Tacit 图像质量)

- 推理加速: 1 篇 (VHS 潜在验证器)

CVPR 2026 × 3 篇 (InverFill, GroupEditing, FG-Portrait)

重点论文深度解读

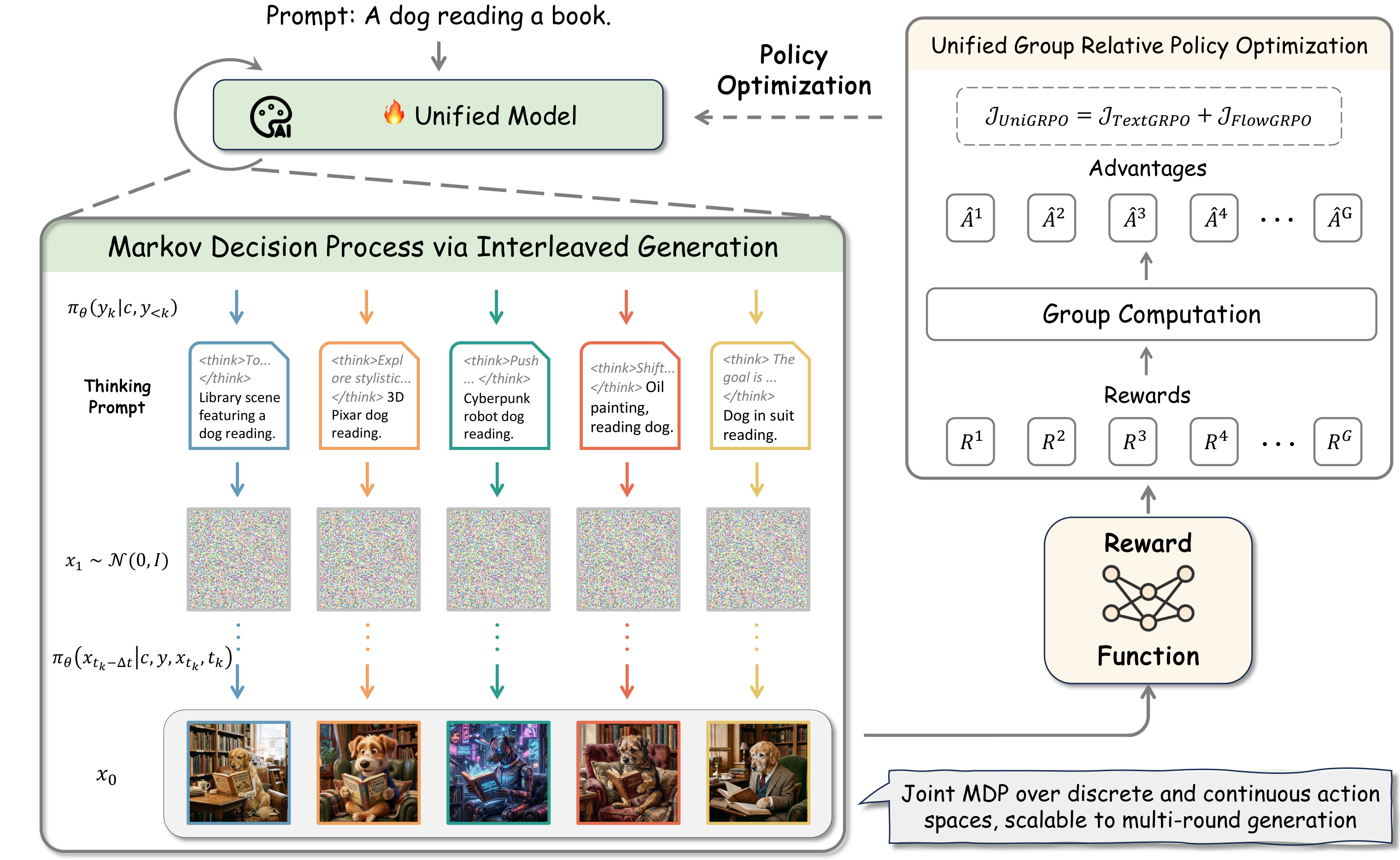

1. UniGRPO: Unified Policy Optimization for Reasoning-Driven Visual Generation

统一推理驱动视觉生成 | Shanghai AI Lab / The University of Sydney | arXiv:2603.23500

关键词: 统一生成模型, GRPO, FlowGRPO, 推理驱动生成, 强化学习

研究动机

统一生成模型(交错文本和图像生成)已成为多模态AI的重要范式,但如何有效地进行后训练优化以同时提升推理和视觉生成质量仍是开放挑战。现有的强化学习方法要么只针对文本推理,要么只针对视觉生成,缺乏统一的优化框架来联合优化两种模态。

方法原理

提出 UniGRPO,将交错生成建模为具有稀疏终端奖励的马尔可夫决策过程,联合优化文本推理和视觉生成策略。无缝集成文本推理的标准 GRPO 和视觉合成的 FlowGRPO。引入两个关键改进:(1) 消除 Classifier-Free Guidance 以维持线性非分支轨迹,使框架可扩展到多轮交互和条件生成(如编辑);(2) 用速度场上的 MSE 惩罚替代标准潜在 KL 惩罚,提供更稳健的正则化信号来缓解奖励黑客攻击。

核心创新

- 首个统一优化文本推理和视觉生成的强化学习框架

- 消除 CFG 实现线性非分支轨迹,支持多轮交互和编辑等复杂场景

- 速度场 MSE 惩罚替代 KL 散度,更有效缓解奖励黑客攻击

- 极简设计理念,为未来交错模型后训练提供可扩展基线

实验结果

- 统一训练配方显著增强了推理驱动的图像生成质量,为完全交错模型的后训练提供了稳健且可扩展的基线方案。

方法流程

- 交错输入 — 文本提示 + 推理扩展

- 文本GRPO — 优化推理链质量

- FlowGRPO — 优化视觉生成质量 无CFG线性轨迹

- MSE惩罚 — 速度场正则化 防奖励黑客

- 联合输出 — 高质量推理+图像

技术脉络

核心问题: 如何统一优化交错文本推理和视觉生成

前序工作及局限:

- GRPO (DeepSeek 2024):文本推理的群组相对策略优化

- FlowGRPO (2025):Flow Matching 模型的策略优化

与前序工作的本质区别: UniGRPO 首次将两者无缝集成,消除 CFG 实现线性轨迹,速度场 MSE 替代 KL 惩罚

技术演进定位: 统一生成模型后训练优化的开拓性基线工作

可能的后续方向:

- 多轮交错生成优化

- 视频+音频的统一生成优化

- 更高效的奖励信号设计

批判性点评

- 新颖性: 极简设计理念值得赞赏——无缝集成已有 GRPO 和 FlowGRPO,速度场 MSE 惩罚替代 KL 散度是巧妙的工程创新。但理论贡献有限。

- 可复现性: 消除 CFG 的决策对不同模型架构的通用性需要更多验证,且实验对比基线不够全面。

- 影响力: 为统一模型后训练提供了重要基线,但能否成为标准范式还取决于多轮场景下的表现。

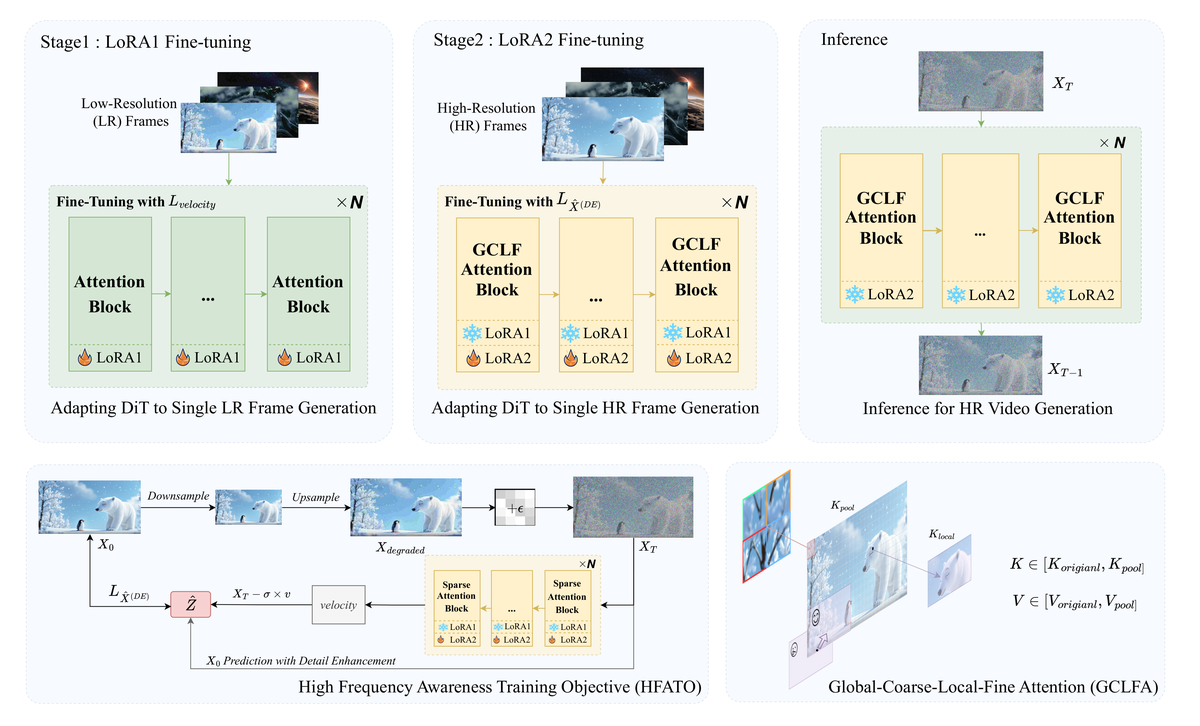

2. ViBe: Ultra-High-Resolution Video Synthesis Born from Pure Images

纯图像驱动超高分辨率视频合成 | SJTU | arXiv:2603.23326

关键词: 超高分辨率, 视频合成, Relay LoRA, 高频感知, 纯图像训练

研究动机

基于 Transformer 的视频扩散模型依赖 3D 空间-时间注意力,其二次方复杂度使得超高分辨率视频的端到端训练成本极高。直接用高分辨率图像微调视频模型会因图像-视频模态差距引入明显噪声。如何在不使用任何视频训练数据的情况下,让预训练的视频扩散模型生成超高分辨率视频?

方法原理

提出纯图像适应框架,通过 Relay LoRA 两阶段策略升级视频 DiT。第一阶段:用低分辨率图像将视频扩散模型适应到图像域,弥合模态差距。第二阶段:用高分辨率图像进一步适应以获得空间外推能力。推理时仅保留高分辨率适应,保持视频生成模态。另外提出高频感知训练目标(HF-ATO),通过专用重建损失显式鼓励模型从退化潜在表示中恢复高频细节。

核心创新

- 首个纯图像适应实现超高分辨率视频合成的框架,无需任何视频训练数据

- Relay LoRA 两阶段策略解耦模态对齐和空间外推

- 高频感知训练目标(HF-ATO)增强细粒度细节合成

- VBench 基准超越基于高分辨率视频训练的 SOTA 模型 0.8 分

实验结果

- 在 VBench 基准上超越此前最先进的高分辨率视频训练模型 0.8 分,生成的超高分辨率视频具有丰富的视觉细节。代码即将开源。

方法流程

- 预训练Video DiT — 原始分辨率视频模型

- Stage 1: 模态对齐 — 低分辨率图像 LoRA 弥合图像-视频差距

- Stage 2: 空间外推 — 高分辨率图像 LoRA 获取超分能力

- HF-ATO — 高频感知训练目标 恢复细节

- 超高分辨率视频 — 无需视频训练数据

技术脉络

核心问题: 如何在不使用视频数据的情况下实现超高分辨率视频合成

前序工作及局限:

- Video DiT (Sora 2024):大规模视频扩散 Transformer 预训练

- LoRA (Hu et al. 2022):低秩适应微调方法

与前序工作的本质区别: ViBe 提出 Relay LoRA 两阶段策略解耦模态对齐和空间外推,HF-ATO 恢复高频细节

技术演进定位: 挑战了视频训练的必要性,开辟了纯图像数据提升视频质量的新路径

可能的后续方向:

- 更高分辨率(8K+)视频生成

- 纯图像训练的长视频一致性改进

- 与视频训练的融合策略

批判性点评

- 新颖性: Relay LoRA 两阶段策略巧妙解耦了模态对齐和空间外推,HF-ATO 训练目标是重要的技术贡献。核心洞察(图像训练可替代视频训练)具有深远影响。

- 可复现性: 方法简洁清晰,但高分辨率图像数据的质量和规模对结果的影响需要更多消融实验。

- 影响力: 如果确实不需要视频数据就能生成超高分辨率视频,将大幅降低视频生成的训练成本,具有很高的实用价值。

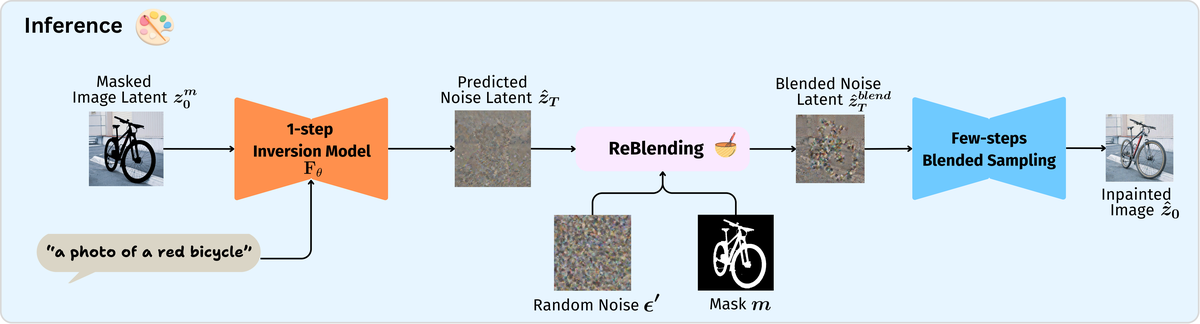

3. InverFill: One-Step Inversion for Enhanced Few-Step Diffusion Inpainting

一步逆变换加速少步扩散修复 | VinAI Research | CVPR 2026 | arXiv:2603.23463

关键词: 图像修复, 少步扩散, 一步逆变换, 语义对齐噪声, CVPR 2026

研究动机

基于扩散的图像修复模型虽然实现了照片级真实感,但需要大量采样步骤。少步文本到图像模型提供更快生成速度,但直接用于修复会导致背景和修复区域之间的协调性差和伪影。问题根源在于随机高斯噪声初始化,在低函数评估次数下会导致语义错位和保真度降低。

方法原理

提出 InverFill,一种专为修复定制的一步逆变换方法。将输入掩码图像的语义信息注入到初始噪声中,实现高保真少步修复。利用少步 T2I 模型在混合采样管线中处理,以语义对齐噪声作为输入。不需要训练修复模型,不需要真实图像监督,只增加极小推理开销。

核心创新

- 一步逆变换将掩码图像语义注入初始噪声,解决少步扩散修复的语义错位问题

- 无需训练专门的修复模型,直接利用少步 T2I 模型

- 混合采样管线在低 NFE 下匹配专门修复模型的质量

- CVPR 2026 主会议论文,即插即用,不需要真实图像监督

实验结果

- 持续提升基线少步模型表现,改善图像质量和文本连贯性,在低 NFE 下甚至匹配专门的修复模型,无需昂贵的重训练或迭代优化。

方法流程

- 掩码图像 — 待修复区域+已知背景

- 一步逆变换 — 提取语义信息 注入初始噪声

- 语义对齐噪声 — 替代随机高斯噪声

- 混合采样管线 — 少步T2I模型生成

- 高保真修复 — 2-4步即达到高质量

技术脉络

核心问题: 如何在极少采样步数下实现高质量图像修复

前序工作及局限:

- Blended Diffusion (Avrahami 2022):混合扩散采样修复

- LCM (Luo 2023):潜在一致性模型实现少步生成

与前序工作的本质区别: InverFill 通过一步逆变换将掩码图像语义注入噪声,解决少步下的语义错位

技术演进定位: 少步扩散修复的即插即用加速方案,CVPR 2026

可能的后续方向:

- 视频修复的少步化

- 与 Turbo/Lightning 模型的深度集成

- 实时交互式修复应用

批判性点评

- 新颖性: 将修复问题归因于噪声初始化的分析精准,一步逆变换方案简洁有效。即插即用、无需训练是重要的实用优势。

- 可复现性: 方法描述清晰,推理开销极小,非常适合实际部署。代码承诺开源。

- 影响力: 直接提升现有少步模型的修复能力,为快速修复应用提供了低成本解决方案。

批判性点评精选

1. 统一RL框架成为多模态后训练新标配?

UniGRPO 的极简集成策略展示了一条清晰的技术路线:在统一模型中,针对不同模态使用各自成熟的优化方法,通过共享奖励信号统一训练。这种模块化思路可能比重新设计全新算法更实用。

2. 视频训练数据的必要性被动摇

ViBe 证明了纯图像数据+精心设计的适应策略就能超越用视频数据训练的模型。这一发现可能引发对数据策略的重新思考:高质量图像数据的价值可能被低估了。

3. 噪声初始化:被忽视的性能瓶颈

InverFill 揭示了少步扩散中一个长期被忽视的问题——随机噪声初始化是质量下降的根本原因。这一洞察可能推动更多研究关注「智能初始化」而非仅仅关注采样策略。

其余论文 · 贡献与效果总结

| # | 论文 | 机构 | 关键词 | 主要贡献 | 效果 |

|---|---|---|---|---|---|

| 1 | Group Editing (Edit Multiple Images in One Go) | 多图编辑 · 几何对应 · CVPR 2026 | 利用 VGGT 几何对应和伪视频时序先验实现多图一致性编辑,构建大规模 GroupEditData 数据集,CVPR 2026 论文。 | 首次实现多视图一致性编辑,在多图编辑质量和一致性上显著超越现有方法 | |

| 2 | Dress-ED (Instruction-Guided Editing for Virtual Try-On and Try-Off) | 虚拟试穿 · 服装编辑 · 大规模基准 | 首个统一虚拟试穿、脱衣和文本引导服装编辑的大规模基准(146K 四元组),含多模态扩散基线框架。 | 提供 146K 高质量四元组数据集,多模态扩散基线在三项任务上达到强性能 | |

| 3 | VHS (Tiny Inference-Time Scaling with Latent Verifiers) | 推理加速 · 潜在验证器 · DiT | 直接在 DiT 中间隐藏状态上操作轻量验证器进行推理时缩放,无需完整解码即可评估生成质量。 | 减少 63% 推理时间和 51% FLOPs,GenEval 提升 2.7%,高效推理时质量筛选 | |

| 4 | FG-Portrait (3D Flow Guided Editable Portrait Animation) | 肖像动画 · 3D 流引导 · CVPR 2026 | 引入 3D 流作为几何驱动运动对应,通过深度引导采样和 3D 流编码实现高保真可编辑肖像动画,CVPR 2026。 | 在肖像动画质量和可编辑性上超越现有方法,支持表情/头部姿态精细控制 | |

| 5 | InterDyad (Interactive Dyadic Speech-to-Video Generation) | 语音到视频 · 双人交互 · MLLM | 基于 MLLM 提取语言意图和角色感知双高斯引导,实现交互式双人语音到视频生成的自然动力学合成。 | 首次实现双人交互式语音到视频生成,自然对话动力学模拟逼真 | |

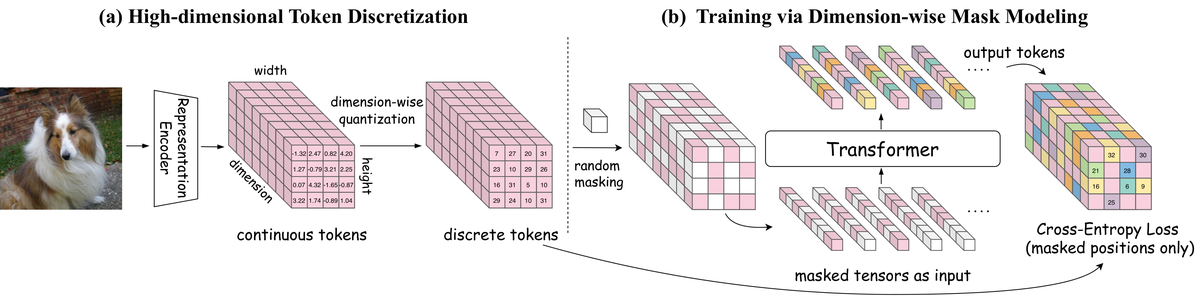

| 6 | Zero-Shot Personalization (Personalization of Objects via Textual Inversion) | 零样本个性化 · 文本逆变换 · 免训练 | 学习网络预测物体专属文本逆变换嵌入,单次前向实现任意物体的零样本个性化生成,首个通用免训练方案。 | 单次前向即可实现高质量个性化生成,无需每个物体微调,通用性强 | |

| 7 | MuQ-Eval (Open-Source Per-Sample Quality Metric for AI Music Generation) | 音乐质量评估 · 开源指标 · MuQ | 开源的逐样本 AI 音乐质量评估指标,基于冻结 MuQ-310M 特征实现高精度质量评分。 | 系统级 SRCC=0.957,单曲级 SRCC=0.838,为 AI 音乐评估提供标准工具 | |

| 8 | Q-Tacit (Image Quality Assessment via Latent Visual Reasoning) | 图像质量评估 · 潜在推理 · 结构化先验 | 提出潜在质量空间推理新范式,注入结构化视觉质量先验并校准推理轨迹,用更少 token 实现强 IQA 性能。 | 用更少 token 达到 SOTA 级图像质量评估性能,推理效率显著提升 | |

| 9 | RealMaster (Lifting Rendered Scenes into Photorealistic Video) | 渲染转真实 · 视频扩散 · IC-LoRA | 利用视频扩散模型将 3D 引擎渲染视频提升为逼真视频,通过锚点传播和 IC-LoRA 保持完整几何对齐。 | 将合成渲染视频转化为逼真视频,保持完整几何对齐和时间一致性 |

趋势观察

- 统一生成+推理 — UniGRPO 将 GRPO 扩展到交错文本-图像生成的联合优化,推理驱动生成成为新趋势

- 无视频训练的视频升级 — ViBe 仅用图像数据实现超高分辨率视频合成,挑战了视频训练的必要性

- 少步扩散实用化 — InverFill 通过语义噪声注入让 2-4 步修复达到专用模型水平,少步推理持续成熟

人工智能炼丹师 整理 | 2026-03-26

评论 (0)