AIGC周末专题|2026-05-09|视频编辑告别文字描述:参考图一贴 精准改到位

AIGC 周末专题深度解读:视频参考编辑模型:从数据工程到统一架构的范式演进

人工智能炼丹君 整理 | 2026年5月9日(周六)

覆盖时间:2025-02 ~ 2026-05

本期概述

本期 AIGC 周末专题聚焦视频参考编辑模型:从数据工程到统一架构的范式演进方向,精选 8 篇代表性论文进行深度解读。

方向分布:

- 参考引导视频编辑 2 篇 2 篇 (Kiwi-Edit, LIVE)

- 统一视频编辑框架 3 篇 3 篇 (VACE, UniVideo, EditVerse)

- 大规模编辑数据集 3 篇 3 篇 (Ditto, OpenVE-3M, Señorita-2M)

含 ICLR 2026 × 1

技术路线与时间线

文本指令编辑(2023.01 — 2024.06)

描述:InstructPix2Pix 开创指令驱动图像编辑范式,后续工作尝试扩展到视频。

关键节点:

- 2023.01:InstructPix2Pix:文本指令图像编辑开山作

- 2023.08:IP-Adapter:图像参考注入扩散模型

- 2024.06:InsV2V/Emu Edit:首批视频编辑尝试

数据工程爆发(2025.02 — 2025.12)

描述:从十万级到百万级,合成数据 pipeline 成为视频编辑的核心驱动力。

关键节点:

- 2025.02:Señorita-2M:专家模型合成 200 万编辑对

- 2025.10:Ditto-1M:合成四元组百万级 scaling 验证

- 2025.12:OpenVE-3M:300 万对 8 类编辑数据集

统一架构竞赛(2025.03 — 2025.10)️

描述:VACE/UniVideo/EditVerse 三条路线同时验证统一建模的可行性。

关键节点:

- 2025.03:VACE:VCU 条件解耦统一 12+ 任务

- 2025.09:EditVerse:ICL 序列化统一图像+视频编辑

- 2025.10:UniVideo:双流架构理解+生成+编辑三合一(ICLR 2026)

参考引导精准化(2026.03 — 2026.05)

描述:参考图像取代纯文本成为精确视频编辑的核心范式。

关键节点:

- 2026.03:Kiwi-Edit:MLLM+DiT 双连接器 + 47.7 万四元组

- 2026.04:LIVE:图像编辑先验→视频的高效知识迁移

1. Kiwi-Edit:参考引导的通用视频编辑:MLLM + DiT 双连接器架构 + 47.7 万参考编辑四元组数据集

论文: Kiwi-Edit:参考引导的通用视频编辑

arXiv: 2603.02175

机构: National University of Singapore, Show Lab

1.1 研究动机

核心问题: 纯文本指令在描述精确视觉细节时固有模糊性,无法精确表达纹理/身份/风格

纯文本指令在描述精确视觉细节(如特定纹理、身份外观、风格参考)时存在固有模糊性——'把头发变成金色波浪卷'无法传达具体的色调和卷度。参考图像能提供精确的视觉规范,但训练参考引导视频编辑需要(源视频、指令、参考图像、目标视频)四元组数据,现有数据集均无此格式。Kiwi-Edit 从数据和模型两端同时突破这一瓶颈。

前序工作及局限:

- InstructPix2Pix:仅支持文本指令,视觉细节描述受限

- IP-Adapter:图像参考但限于图像域,未扩展到视频

与前序工作的本质区别: Kiwi-Edit 首次构建 47.7 万参考引导视频编辑四元组 + MLLM-DiT 双连接器架构

1.2 方法原理

Kiwi-Edit 解决参考引导视频编辑的两个核心瓶颈:(1) 数据稀缺——训练需要(源视频、指令、参考图像、目标视频)四元组,现有数据集均不提供此格式;(2) 多模态融合——需同时理解文本指令的编辑意图和参考图像的视觉细节。

数据方面:设计 4 阶段可扩展 pipeline,从 370 万现有编辑对出发,通过 EditScore 质量过滤 → 指令感知分割 → 参考图像合成 → 语义验证去重,最终产出 47.7 万高质量四元组 RefVIE 数据集,覆盖局部编辑/背景替换/风格迁移等多种任务。

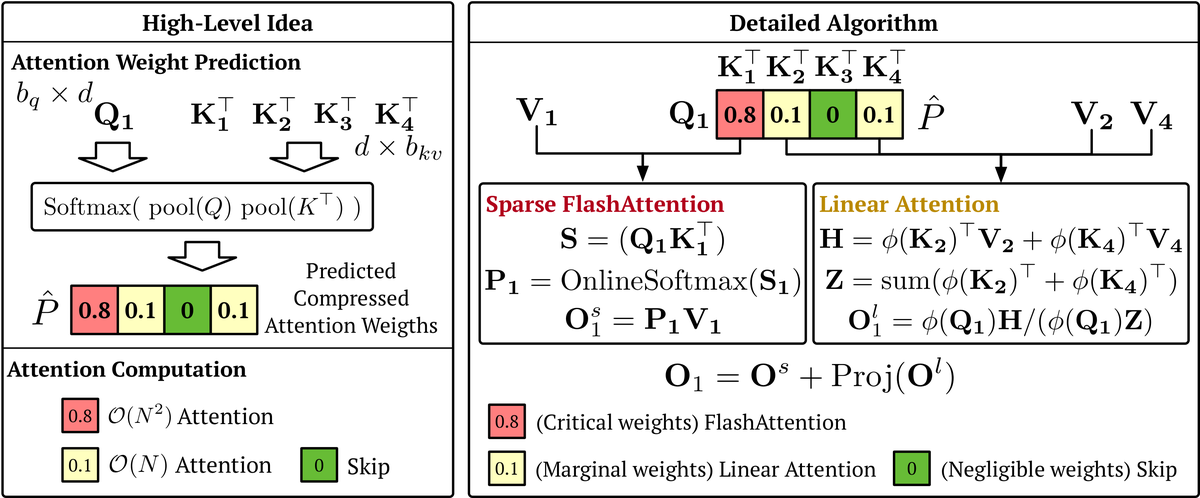

模型方面:采用冻结 MLLM + DiT 架构。MLLM 处理交错的源视频帧、文本指令和参考图像序列;通过双连接器注入 DiT——Query Connector 用 learnable query 蒸馏编辑意图投影到 DiT 条件空间,Latent Connector 提取参考图像视觉特征供 DiT 精确复现参考外观。三阶段训练:先图像编辑 → 图像+指令视频 → 参考视频编辑。基于 Wan-TI2V-5B 骨干。

1.3 核心创新

- 首个系统性解决参考引导视频编辑数据稀缺问题的工作:设计可扩展数据生成 pipeline 将现有编辑对转化为高质量四元组,构建 47.7 万 RefVIE 数据集;提出 MLLM+DiT 双连接器架构(Query Connector + Latent Connector)统一处理指令+参考双模态条件

1.4 实验结果

- 在多个基准上全面超越现有方法(VIVA、InsV2V、Ditto、VACE 等)。参考引导编辑效果大幅优于纯文本引导:身份保持、纹理复现、风格迁移精度显著提升。数据集、模型权重和 Hugging Face Demo 全部开源。

1.5 关键洞察

[{'point': '参考图像合成质量上限', 'detail': '参考图像由图像生成模型合成,其质量和多样性受限于图像模型能力'}, {'point': '四元组数据的领域偏差', 'detail': '从现有编辑对转化而来,可能继承上游数据集的场景偏差(如 Pexels 风格偏好)'}, {'point': '参考 vs 指令冲突处理', 'detail': '当参考图像与文本指令存在矛盾时模型行为未充分讨论'}]

技术演进定位: 参考引导视频编辑的完整数据+模型范式奠基者

可能的后续方向:

- 多参考协同编辑

- 视频级参考(video-to-video reference)

2. VACE:统一视频创作与编辑全能框架:阿里通义实验室基于 Wan 架构的多任务统一视频生成编辑引擎

论文: VACE:统一视频创作与编辑全能框架

arXiv: 2503.07598

机构: Tongyi Lab, Alibaba Group

2.1 研究动机

核心问题: 视频创编任务碎片化,不同任务需部署不同模型,成本高且难以组合

当前视频创编任务高度碎片化——修复需要 A 模型、控制生成需要 B 模型、参考生成又需要 C 模型。部署 12+ 个专用模型成本极高,且不同模型无法组合使用(如'深度控制+参考引导+修复'这种多条件联合场景)。VACE 提出:能否设计一个统一条件接口,让一个模型支持所有任务及其任意组合?

前序工作及局限:

- ControlNet:单一控制条件单一模型

- InstructPix2Pix:仅支持文本编辑单一范式

与前序工作的本质区别: VACE 通过 VCU + Concept Decoupling 支持 12+ 任务统一和运行时任意组合

2.2 方法原理

VACE 解决视频合成任务碎片化问题——不同任务(编辑、参考生成、控制生成等)需要不同模型和接口。核心设计:(1) Video Condition Unit (VCU) 作为统一条件接口,将文本、图像、视频帧、分割掩码等条件编码为统一格式注入 DiT;(2) Concept Decoupling 策略:训练时将控制条件与自然视频解耦,使模型区分'什么是要保留的内容'和'什么是控制信号';(3) Context Adapter 为每种任务学习轻量级概念注入器,以最小参数开销支持新任务扩展。

基于 Wan2.1 和 LTX-Video 两种架构验证。构建包含 12 种子任务的大规模训练集(含参考引导生成、视频修复、深度/姿态/草图控制等),支持运行时任意组合(如深度控制+参考引导+修复)。发布包含 480 个样本的多任务基准。

2.3 核心创新

- 首个基于视频 DiT 架构的全能视频创编模型:通过 Video Condition Unit (VCU) 接口统一文本/图像/视频/掩码等多模态输入,Concept Decoupling 策略分离自然视频与控制信号,Context Adapter 注入任务概念,支持 12+ 种子任务和任意组合

2.4 实验结果

- 在 12 种子任务上均达到与专用任务模型可比甚至超越的效果。任务组合泛化能力突出:支持长视频重渲染、多条件融合等复杂应用。部署成本大幅降低(一个模型替代 12+ 专用模型)。已集成到阿里通义视频产品线。

2.5 关键洞察

[{'point': '任务组合的质量退化', 'detail': '组合越多任务,每个子任务的控制精度可能下降'}, {'point': 'Context Adapter 参数共享限制', 'detail': '轻量级适配器是否能充分表达高度异构的任务语义存疑'}, {'point': '闭源+开源双版本差异', 'detail': '阿里内部版本与开源版本能力差距未透明化'}]

技术演进定位: 视频 DiT 全能统一框架的工业化标杆

可能的后续方向:

- 自动任务路由

- 百种子任务 scaling

3. UniVideo:统一视频理解、生成与编辑:快手可灵+滑铁卢大学的双流 MLLM-DiT 视频全能模型

论文: UniVideo:统一视频理解、生成与编辑

arXiv: 2510.08377

机构: University of Waterloo, Kling Team (Kuaishou)

3.1 研究动机

核心问题: 视频理解、生成、编辑作为独立子系统无法协同,用户需切换多个工具

视频理解(描述/问答)、生成(文/图生视频)和编辑(局部/全局修改)被视为三个独立问题,用户需切换不同工具完成一个完整的创作流程。更关键的是,这种割裂导致能力之间无法互助——理解能力无法辅助更精准的编辑,编辑能力也无法增强生成的可控性。UniVideo 提出用双流架构将三者统一,使能力间产生协同效应。

前序工作及局限:

- Emu Edit:仅编辑无理解

- VideoChat:仅理解无生成

与前序工作的本质区别: UniVideo 双流 MLLM+DiT 实现三合一,且支持零样本任务组合泛化

3.2 方法原理

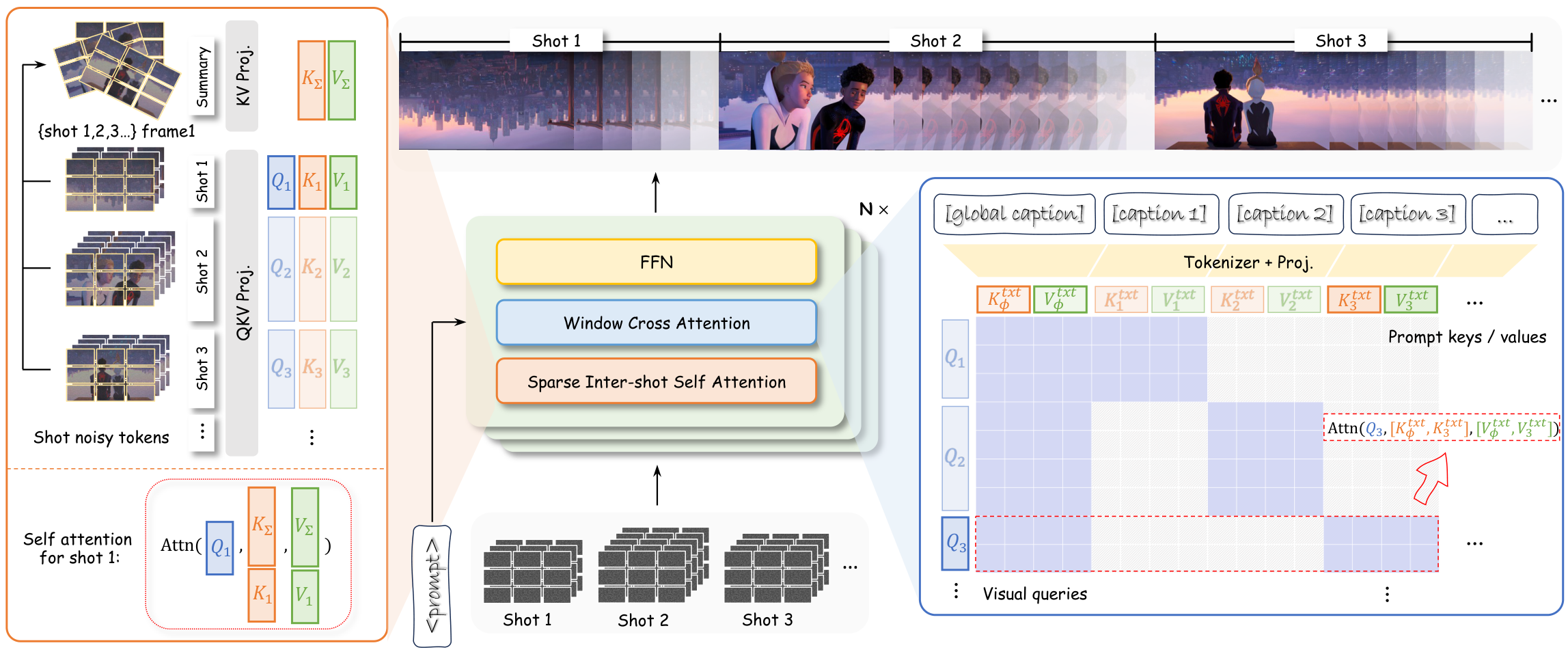

UniVideo 统一视频三大核心能力。架构设计:双流模型——(1) MLLM 流(基于 Qwen2.5-VL)负责多模态指令的理解和推理,保持文本生成能力;(2) MM-DiT 流(基于 HunyuanVideo)负责高质量视频合成。MLLM 解释复杂指令后将语义条件传递给 DiT,实现精确的意图驱动生成。

关键优势:(1) 无掩码编辑——仅根据指令编辑,无需显式掩码输入指示编辑区域,是唯一实现此能力的方法;(2) 任务组合泛化——无需额外设计即可将图像编辑数据的能力迁移到视频(如环境变换、材质替换等从未在视频上训练的编辑);(3) 视觉提示生成——MLLM 解释视觉提示引导 DiT 合成保持一致性的视频。ICLR 2026 接收。

3.3 核心创新

- 首个在统一框架下同时支持视频理解(问答/描述)、生成(文/图生视频)和编辑(指令/上下文编辑)的多模态模型:双流架构将 MLLM 指令理解与 MM-DiT 视觉生成解耦,无需任务特定设计即可泛化到未见任务组合

3.4 实验结果

- 在文/图生视频、上下文视频生成、上下文视频编辑等多个 benchmark 上达到或超越SOTA专用模型。特别是在无掩码编辑设置下(更具挑战性),在所有指标上实现优越或竞争性能。代码和模型权重已开源。

3.5 关键洞察

[{'point': '双流训练的计算开销', 'detail': '同时训练 MLLM + HunyuanVideo 的 GPU 资源需求极高,复现门槛高'}, {'point': '编辑精度 vs 统一性权衡', 'detail': '统一模型在精细局部编辑上是否能匹配专用编辑模型待更深入评估'}, {'point': '视频理解能力的量化验证', 'detail': '理解任务的评估深度相对生成/编辑较浅'}]

技术演进定位: 首个视频三能力统一模型,ICLR 2026

可能的后续方向:

- 实时推理

- 长视频闭环

4. Ditto:合成数据扩展的指令视频编辑:港科大+蚂蚁集团的高质量百万级合成数据驱动视频编辑刷新 SOTA

论文: Ditto:合成数据扩展的指令视频编辑

arXiv: 2510.15742

机构: HKUST, Ant Group, Zhejiang University, Northeastern University

4.1 研究动机

核心问题: 视频编辑训练数据规模小、质量低,严重制约模型性能天花板

视频编辑模型的性能瓶颈到底在架构还是数据?现有视频编辑数据集规模小(InsV2V 约 40 万对且质量参差)、覆盖编辑类型少、指令质量低。模型架构已进化到 CogVideoX/HunyuanVideo 等强基座,但缺乏高质量大规模训练数据限制了它们的编辑能力。Ditto 从数据 scaling 角度验证:高质量合成数据的规模是视频编辑的真正天花板。

前序工作及局限:

- InsV2V:40 万对但质量参差

- InstructPix2Pix:仅图像编辑数据,无法直接用于视频

与前序工作的本质区别: Ditto 系统验证合成数据 scaling 对视频编辑有效性,百万级数据持续带来性能提升

4.2 方法原理

Ditto 从数据 scaling 角度突破视频编辑瓶颈。核心洞察:指令视频编辑的主要瓶颈不在模型架构,而在训练数据的规模和质量。

数据合成 pipeline:(1) 使用 Qwen2-VL 对源视频生成密集描述(semantic anchor);(2) 两步提示策略生成多样化编辑指令(先描述再指令);(3) 用强图像编辑模型编辑关键帧;(4) 利用深度图和结构条件,通过 I2V 模型从编辑后关键帧生成完整编辑视频。严格质量过滤确保数据高保真。

模型训练:基于 CogVideoX 架构,先在图像编辑数据预训练获得基础编辑能力,再在 Ditto-1M 视频数据微调。实验表明数据量从 100K → 1M 持续带来性能提升。

4.3 核心创新

- 首次系统性验证高质量合成数据对指令视频编辑的 scaling 效果:设计两阶段数据合成 pipeline(VLM 密集描述 → 编辑指令生成 → 关键帧编辑 → 视频传播),构建百万级 Ditto-1M 数据集,训练的 Ditto 模型全面超越所有 baseline

4.4 实验结果

- 在自动指标(CLIP-T、CLIP-F、VLM score)和人类评估上全面超越 TokenFlow、InsV2V、InsViE 等所有基线。特别是文本对齐度和编辑准确性显著领先。验证了合成数据 scaling 对视频编辑的有效性。模型权重已开源。

4.5 关键洞察

[{'point': '合成数据的天花板', 'detail': '合成数据终究受限于上游图像编辑模型能力,复杂物理效果难以合成'}, {'point': 'I2V 传播的时序退化', 'detail': '从单帧编辑传播到视频可能引入累积误差和时序不一致'}, {'point': 'CogVideoX 基座的分辨率限制', 'detail': '基于 CogVideoX 限制了输出分辨率和时长'}]

技术演进定位: 数据 scaling 驱动视频编辑的典范工作

可能的后续方向:

- 千万级数据 scaling

- 实时视频编辑的数据蒸馏

5. EditVerse:统一图像视频编辑的 ICL 框架:Adobe 首个将图像和视频编辑统一为 In-Context Learning 的全能模型

论文: EditVerse:统一图像视频编辑的 ICL 框架

arXiv: 2509.20360

机构: Adobe Research, CUHK, Johns Hopkins University

5.1 研究动机

核心问题: 图像编辑和视频编辑分别建模,不同编辑任务需不同条件接口设计

图像编辑和视频编辑本质上共享相同的操作语义(风格迁移、局部替换、背景更换等),但现有方法将两者分别建模,导致图像编辑的丰富知识无法直接迁移到视频。此外,不同编辑任务需要不同的条件接口设计,每增加一种任务就需要修改架构。EditVerse 提出将所有编辑统一为 In-Context Learning 问题——通过输入-输出示例对直接'教'模型如何编辑,无需任务特定设计。

前序工作及局限:

- Painter:统一视觉任务但限于图像

- InstructPix2Pix:单一条件接口无法泛化

与前序工作的本质区别: EditVerse 将所有编辑统一为 ICL 序列化问题,通过输入-输出示例对实现零任务特定设计

5.2 方法原理

EditVerse 的核心洞察是将所有编辑和生成任务视为序列到序列的 In-Context Learning 问题。(1) 交错序列设计:将文本 token、图像 patch、视频帧统一编码为同一序列空间中的 token,使模型通过自注意力自然学习跨模态关系;(2) 4D 位置编码:在空间 2D + 时间 1D 基础上加入模态维度,支持任意分辨率、帧率和模态混合输入;(3) 数据策略:精心设计 pipeline 策划 23.2 万高质量视频编辑样本,结合大规模图像编辑和视频生成数据联合训练;(4) EditVerseBench:首个覆盖多种编辑类型和分辨率的指令视频编辑评测基准。

模型在 20+ 编辑任务上超越所有开源方法,展现出强大的举一反三(emergent)能力——能处理训练未见的编辑类型组合。

5.3 核心创新

- 首个将图像和视频的生成+编辑统一为 In-Context Learning 序列化建模的框架:交错序列设计将文本/图像/视频转为统一 token 表示,4D 位置编码支持任意分辨率和时长,23.2 万高质量视频编辑样本 + EditVerseBench 评测基准

5.4 实验结果

- 在 EditVerseBench 和多个公开基准上超越所有开源方法和部分商业模型。展现强大的 emergent 能力:训练未见的编辑任务组合(如风格迁移+局部替换)也能高质量完成。跨模态迁移有效——图像编辑能力自动提升视频编辑质量。

5.5 关键洞察

[{'point': 'ICL 序列长度限制', 'detail': '统一序列化导致长视频的 token 数量爆炸,推理效率受限'}, {'point': 'Adobe 闭源生态', 'detail': '模型未完全开源,社区复现和对比验证困难'}, {'point': '视频编辑数据规模相对小', 'detail': '23.2 万视频编辑样本相比 Ditto/OpenVE 的百万级偏少'}]

技术演进定位: ICL 统一编辑范式的开拓者

可能的后续方向:

- ICL + 参考引导结合

- 更长视频的高效序列化

6. LIVE:图像编辑先验驱动的视频编辑:帧级 Token 噪声+课程学习实现图像→视频编辑的高效知识迁移

论文: LIVE:图像编辑先验驱动的视频编辑

arXiv: 2604.17021

机构: Kuaishou, Nankai University

6.1 研究动机

核心问题: 视频编辑数据稀缺而图像编辑数据丰富,但直接用图像数据训练视频模型导致静态偏置

图像编辑领域数据极为丰富(数千万对+数百种编辑类型),而视频编辑数据规模小(百万级)且任务覆盖有限。能否将图像编辑的丰富知识低成本迁移到视频域?挑战在于简单地将图像数据复制为伪视频会引入严重的静态偏置——模型学会输出静态画面而非动态视频。LIVE 通过 Frame-wise Token Noise 巧妙打破这一偏置。

前序工作及局限:

- Ditto:纯视频数据驱动,未利用图像编辑知识

- EditVerse:ICL 统一但仍需大量视频数据

与前序工作的本质区别: LIVE 通过 Frame-wise Token Noise 打破静态偏置,实现图像→视频编辑知识的高效迁移

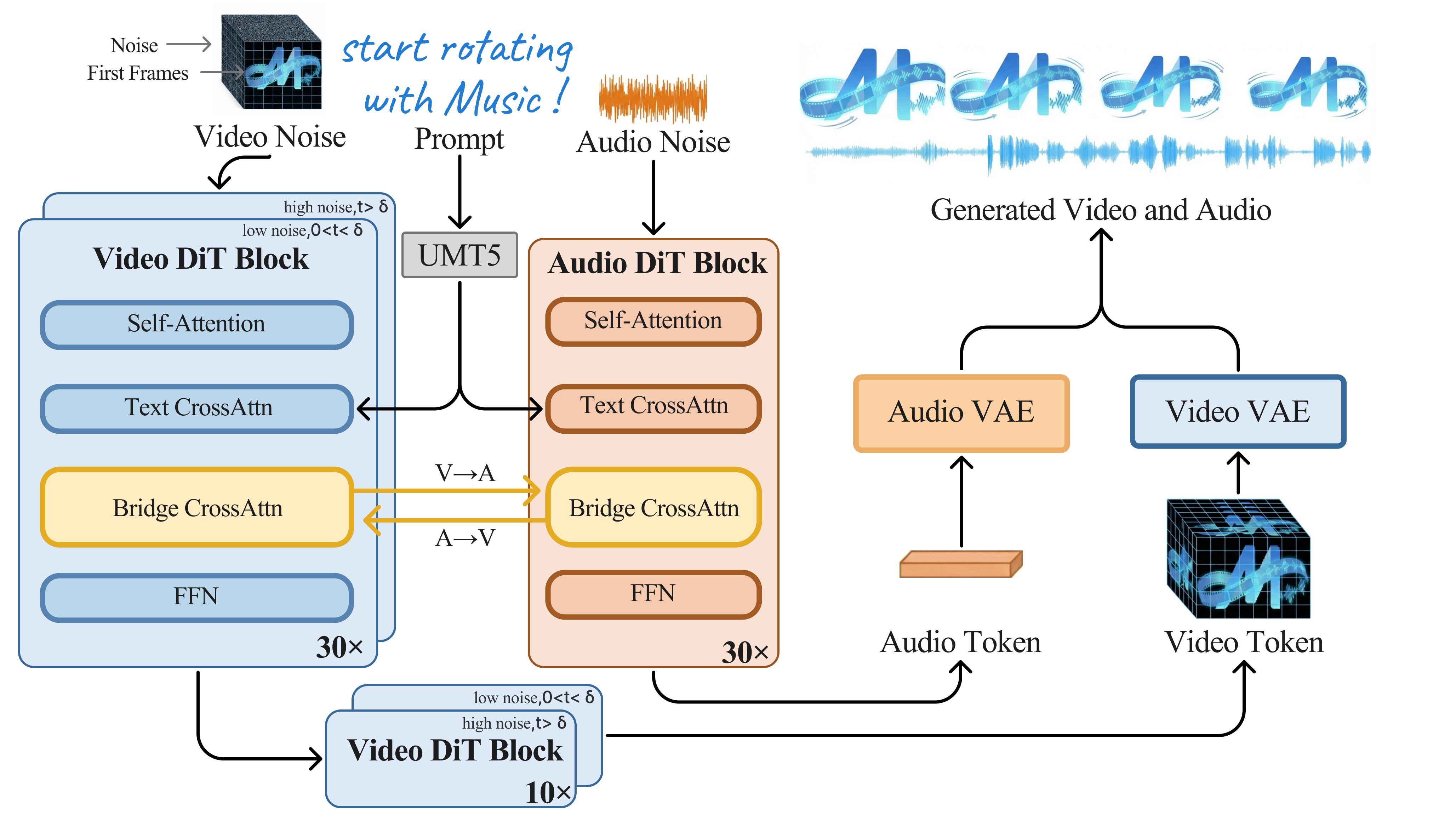

6.2 方法原理

LIVE 解决视频编辑的数据瓶颈:相比图像编辑数据的丰富多样,视频编辑数据规模小、任务类型少。核心方法:(1) Image Repeat 策略——将源图像和目标图像分别沿时间轴复制 T 次构成伪视频序列,统一数据格式;(2) Frame-wise Token Noise——为图像数据引入帧级 Token 噪声,让模型将静态图像编辑'推理'为动态视频变换,缓解静态偏置;(3) 两阶段课程学习——Stage 1 在清洗的公开数据集上建立基础能力,Stage 2 通过自动化 pipeline 扩展任务类型和多样性。

构建 LIVE-Bench 覆盖 60+ 种挑战性编辑任务(许多是图像编辑常见但视频数据稀缺的任务类型)。在 LIVE-Bench 和 EditVerseBench 上达到 SOTA。

6.3 核心创新

- 提出图像-视频联合训练框架 LIVE,通过帧级 Token 噪声策略和两阶段课程学习,将丰富的图像编辑数据的多样性迁移到视频编辑,用最小的视频标注成本实现 SOTA 视频编辑

6.4 实验结果

- 在 LIVE-Bench(60+ 任务)和 EditVerseBench 上均达到 SOTA。特别是在图像编辑常见但视频编辑稀缺的任务类型(如复杂材质变换、精细属性编辑)上优势显著。相比 Lucy Edit、Ditto 等方法,在 VLM 评估、时序一致性和编辑质量维度全面领先。

6.5 关键洞察

[{'point': '静态偏置的残留', 'detail': '尽管 Token 噪声缓解了静态偏置,复杂运动场景下可能仍存在时序不自然'}, {'point': '图像-视频 gap 的理论分析不足', 'detail': '为什么 Token 噪声能桥接两个域的理论解释相对直觉性'}, {'point': '依赖预训练视频生成模型', 'detail': '框架的上限受限于底层视频生成模型的能力'}]

技术演进定位: 图像→视频编辑知识迁移的首个系统性验证

可能的后续方向:

- 视频→视频的跨域迁移

- 图像编辑数据的主动筛选策略

7. OpenVE-3M:大规模高质量指令视频编辑数据集:浙大+字节跳动 300 万对数据 + 5B 参数 SOTA 编辑模型 + 统一评测基准

论文: OpenVE-3M:大规模高质量指令视频编辑数据集

arXiv: 2512.07826

机构: Zhejiang University, ByteDance

7.1 研究动机

核心问题: 现有视频编辑数据集规模不足(百万级)、类型单一、指令质量低且缺乏标准评测

现有视频编辑数据集存在三重短板:(1) 规模不足——最大的也仅百万级;(2) 类型单一——多数聚焦风格迁移和局部替换;(3) 指令质量低——平均指令仅 4 词,语义模糊。此外,缺乏标准化评测基准导致不同方法难以公平比较。OpenVE-3M 从数据规模、类型覆盖和评测基准三方面系统性补齐短板。

前序工作及局限:

- InsViE-1M:规模可观但类型有限

- Señorita-2M:200 万对但指令平均仅 4 词

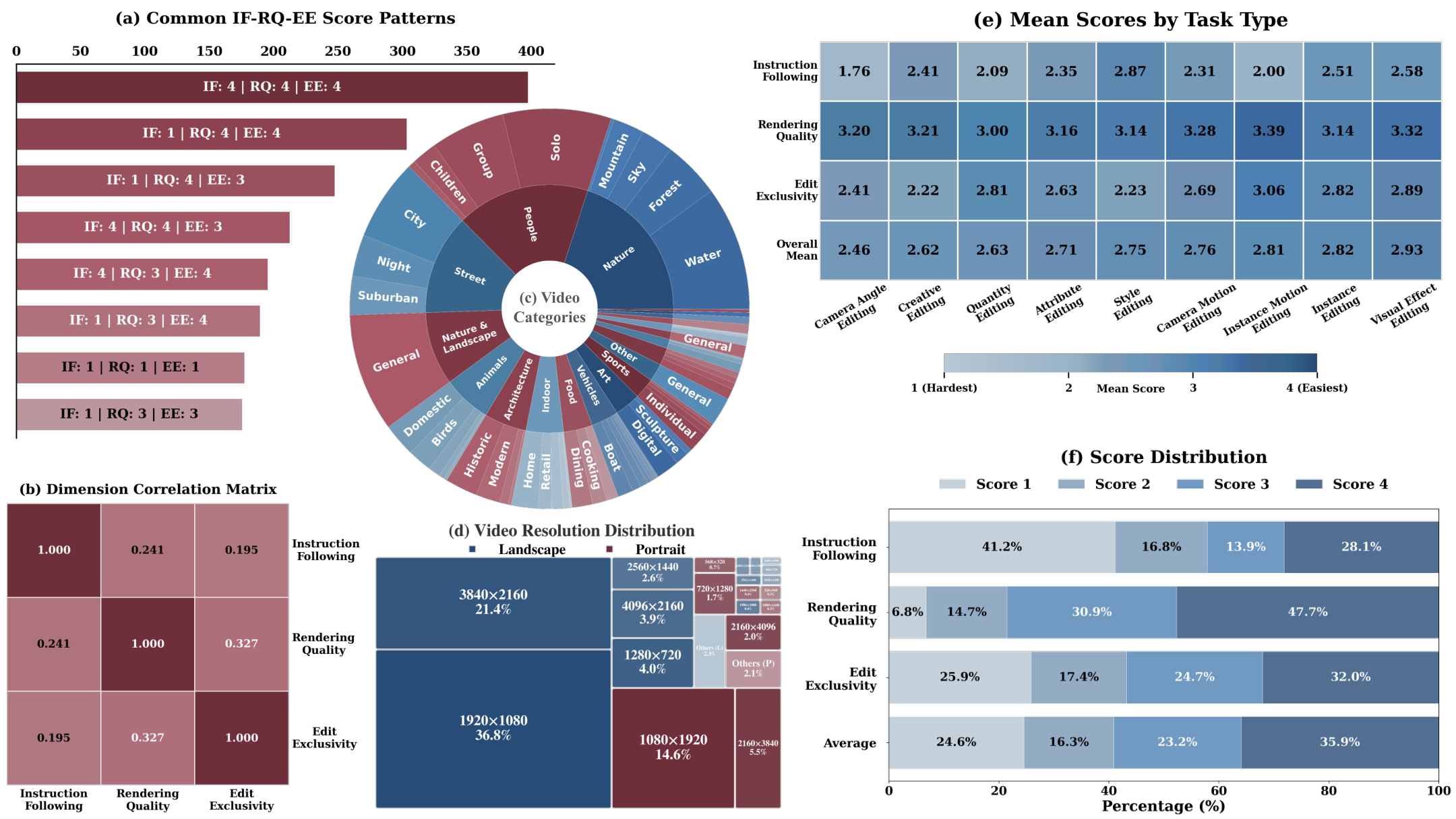

与前序工作的本质区别: OpenVE-3M 三维突破:300 万对 + 8 种编辑类型 + 详细指令 + OpenVE-Bench 标准评测

7.2 方法原理

OpenVE-3M 解决视频编辑数据的三重短板:规模不足、类型单一、指令质量低。(1) 数据构建:设计稳定的多类别数据合成 pipeline,将编辑分为空间对齐(Global Style、Background Change、Local Change/Remove/Add、Subtitles Edit)和非空间对齐(Camera Multi-Shot、Creative Edit)两大类 8 小类,利用视频生成模型、编辑模型和 CV 标注模型的组合确保多样性和质量;(2) 指令质量:平均指令长度远超 InsViE-1M/Señorita-2M(4 词),提供详细准确的编辑描述;(3) 评测:OpenVE-Bench 包含 431 对多任务样本,从视频质量、文本对齐、时序一致性三维度评估,与人类评价高度对齐。

OpenVE-Edit 仅 5B 参数,在 OpenVE-Bench 上超越所有开源模型(含 14B 量级),验证数据质量 > 模型规模。

7.3 核心创新

- 构建当前最大规模的指令视频编辑数据集 OpenVE-3M(300 万对、8 种编辑类型),配套 5B 参数 OpenVE-Edit 模型超越 14B 基线,并提出与人类评价高度对齐的 OpenVE-Bench 评测基准

7.4 实验结果

- OpenVE-Edit(5B)在 OpenVE-Bench 上全面超越现有所有开源视频编辑模型(含 14B 参数量级的模型)。数据集 3M 量级为当前最大。证明高质量+大规模+多类型数据集是视频编辑性能的核心驱动力。全套代码/数据/模型/评测开源。

7.5 关键洞察

[{'point': '合成数据偏差', 'detail': '数据由模型合成而非真实编辑对,可能存在系统性偏差'}, {'point': '5B 参数限制', 'detail': '更大参数模型(14B+)在 OpenVE-3M 上训练的性能天花板未探索'}, {'point': '非空间对齐编辑的评估难度', 'detail': 'Creative Edit 等创意性编辑的自动评估可靠性仍有挑战'}]

技术演进定位: 当前最大规模指令视频编辑数据集 + 5B 超越 14B 的验证

可能的后续方向:

- 10M+ 数据 scaling 验证

- 数据质量自动化评估体系

8. Señorita-2M:视频编辑专家模型驱动的 200 万编辑对数据集:港中文+清华+云天励飞联合打造 18 种编辑任务 200 万高质量视频对

论文: Señorita-2M:视频编辑专家模型驱动的 200 万编辑对数据集

arXiv: 2502.06734

机构: CUHK, PolyU, Tsinghua University, IntellifusionAI

8.1 研究动机

核心问题: 通用模型合成编辑数据质量不稳定,同一模型难以兼顾差异巨大的编辑类型

构建大规模视频编辑数据有两种思路:用通用模型(如 InstructPix2Pix + I2V)或用专用模型。通用模型合成的数据质量不稳定——同一个模型难以兼顾风格迁移、目标移除、文本修复等差异巨大的编辑类型。Señorita-2M 提出'专家模型合成'策略:训练 4 种专门的视频编辑专家,各司其职生成各自擅长类型的高质量数据,最终汇集成覆盖 18 种编辑任务的多样化数据集。

前序工作及局限:

- InstructPix2Pix 数据 pipeline:通用模型一刀切

- Ditto pipeline:合成质量受限于上游编辑模型

与前序工作的本质区别: Señorita-2M 训练 4 种专用编辑专家模型各司其职,产出 200 万对覆盖 18 种任务的高质量数据

8.2 方法原理

Señorita-2M 的核心创新在于用'专家模型合成'取代'通用模型合成'来构建编辑数据。(1) 训练 4 种专门的视频编辑专家:全局风格化器(ControlNet + CogVideoX,编辑首帧后视频传播)、局部风格化器(掩码引导局部区域精确编辑)、文本引导修复器、目标移除器(结合 Grounded-SAM2 实现精确分割+修复);(2) 从 Pexels 获取高质量源视频,专家模型分别生成各类编辑结果;(3) 多级质量过滤:CLIP 视觉编码器计算相似度 + 训练分类器识别编辑失败/文本错位/微小修改;(4) LLM 为每对生成清晰编辑指令。

最终产出 200 万对覆盖 18 种编辑任务的高质量数据集。实验表明在 Señorita-2M 上训练的编辑模型显著优于在其他数据集训练的同架构模型。

8.3 核心创新

- 首次训练专用视频编辑专家模型(Global/Local Stylizer、Text-guided Inpainter、Object Remover)合成高质量编辑对,构建 200 万对 18 种编辑任务的 Señorita-2M 数据集,为端到端视频编辑模型提供高质量训练数据

8.4 实验结果

- 在 Señorita-2M 上训练的端到端编辑模型在多个基准上显著超越同架构在其他数据集训练的模型。18 种编辑任务覆盖全面。数据集已开源(Hugging Face),是 Kiwi-Edit 等后续工作的核心数据来源之一。

8.5 关键洞察

[{'point': '专家模型的 CogVideoX 基座限制', 'detail': '专家模型基于 CogVideoX,其分辨率和运动质量限制了合成数据上限'}, {'point': '编辑类型的长尾不均衡', 'detail': '18 种类型中部分(如目标移除)样本可能远少于风格迁移'}, {'point': '跨域泛化验证不足', 'detail': 'Pexels 源视频偏向特定风格,在其他域(动画/医学/监控)的泛化未验证'}]

技术演进定位: 专家模型合成策略的开创者,成为多项下游工作的核心数据来源

可能的后续方向:

- 更强基座驱动的专家升级

- 自动化专家选择和质量评估

横向对比与技术脉络总结

横向对比:视频参考编辑模型技术路线对比

| 论文 | 核心范式 | 数据规模 | 编辑条件 | 是否统一多任务 | 基座模型 | 是否开源 |

|---|---|---|---|---|---|---|

| Kiwi-Edit | 参考引导编辑 | 47.7 万四元组 | 指令+参考图像 | 否(专注参考编辑) | Wan-TI2V-5B | ✓ |

| VACE | 条件解耦统一 | 大规模多任务 | VCU 统一接口 | ✓ 12+ 子任务 | Wan2.1 / LTX-Video | 部分开源 |

| UniVideo | 双流三合一 | 多任务联合 | MLLM 指令 | ✓ 理解+生成+编辑 | HunyuanVideo + Qwen2.5-VL | ✓ |

| Ditto | 数据 Scaling | 100 万合成对 | 文本指令 | 否(指令编辑) | CogVideoX | ✓ |

| EditVerse | ICL 序列化 | 23.2 万视频 | ICL 示例对 | ✓ 图像+视频统一 | 自研 DiT | 部分 |

| LIVE | 图像先验迁移 | 图像+视频混合 | 指令+参考 | 否(迁移学习) | 预训练视频 DiT | ✓ |

| OpenVE-3M | 多类型数据驱动 | 300 万对 | 文本指令 | 否(8 类编辑) | 5B 自研 | ✓ |

| Señorita-2M | 专家模型合成 | 200 万对 | 文本指令 | 否(18 类编辑) | CogVideoX + ControlNet | ✓ |

核心技术趋势

数据规模从十万级跃升至百万级成为视频编辑的核心驱动力

Ditto-1M、OpenVE-3M、Señorita-2M 三大数据集在一年内将训练数据推向数百万量级,证明数据工程是性能天花板的关键

参考引导正在取代纯文本指令成为精确视频编辑的核心范式

Kiwi-Edit 证明 MLLM+参考图像的双模态引导在精细控制上远超纯文本,并首次构建 47.7 万参考编辑四元组

统一建模从单任务走向全能:理解、生成、编辑一体化

VACE/UniVideo/EditVerse 三条路线同时验证统一架构的可行性,任务组合泛化成为新评测维度

图像编辑先验到视频的知识迁移成为低成本突破口

LIVE 通过帧复制+Token噪声+课程学习,用丰富的图像编辑数据显著提升视频编辑多样性

核心技术难点与开放问题

四大核心难点

1. 训练数据的结构性稀缺

参考引导视频编辑需要(源视频、文本指令、参考图像、目标视频)四元组数据,现实中几乎不存在自然数据。合成 pipeline 将数据从十万级推到百万级(Ditto-1M → OpenVE-3M → Señorita-2M),但合成质量终究受限于上游图像编辑模型和 I2V 模型的能力天花板,且编辑类型覆盖存在严重长尾效应。

2. 编辑意图的精准传达

纯文本指令在描述精确视觉细节时存在固有模糊性——'把头发变成金色波浪卷'无法传达具体色调和卷度。参考图像虽提供了精确视觉规范(Kiwi-Edit 证明精度提升一个量级),但引入了新问题:参考与指令冲突时如何仲裁?多模态条件的语义对齐?无掩码编辑的区域定位精度?

3. 统一架构的效率困境

VACE/UniVideo/EditVerse 三条统一路线验证了可行性,但均面临核心矛盾:多任务组合时单任务精度下降(VACE)、双流训练的极高 GPU 成本(UniVideo)、长视频 token 序列爆炸导致推理效率急剧下降(EditVerse)。一个模型能否真正做到'不牺牲精度的全能'仍是开放问题。

4. 时序一致性保障

从图像编辑到视频编辑的核心挑战在于时序维度:图像数据训练引入静态偏置(LIVE 用 Frame-wise Token Noise 缓解)、关键帧传播的累积误差(Ditto/Señorita 的 I2V 传播策略)、以及长视频中编辑一致性的不可避免衰减。当前方法在 4-8 秒视频上效果好,30 秒以上仍是空白。

尚未解决的关键问题

| 问题 | 紧迫度 | 描述 |

|---|---|---|

| 长视频编辑(>30s) | 短期 | 当前方法在 4-8 秒短视频上验证,长视频的一致性维护和计算效率仍无有效方案 |

| 实时交互式编辑 | 中期 | 推理一段 5 秒视频需数分钟,离实时编辑差距巨大,需推理加速/模型蒸馏突破 |

| 多参考协同引导 | 短期 | 用多张参考图分别控制不同属性(身份+风格+背景),目前仅 Kiwi-Edit 初步提出方向 |

| 物理真实性 | 长期 | 编辑后光影、遮挡、反射、阴影的物理正确性,当前无方法显式建模 |

| 视频级参考(Video-to-Video) | 中期 | 目前仅支持图像参考,用视频做参考(如风格迁移整段舞蹈)更自然但更困难 |

| 创意编辑的自动评估 | 长期 | OpenVE-Bench 等基准对'创意性'编辑的自动评估仍不可靠,缺乏与人类评价高度对齐的通用指标 |

人工智能炼丹君 整理 | 数据来源:arXiv 2025-02 ~ 2026-05

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描下方二维码关注

评论 (0)