AIGC 每日速读|2026-04-04|LatentUM潜空间统一

AIGC 视觉生成领域 · 每日论文解读 (2026-04-04)

人工智能炼丹师 整理 | 共 8 篇论文 | 重点深度解读 8 篇

今日核心看点

- 高效DiT架构(Efficient DiT)

- 潜空间统一模型(Unified Model)

- DiT多样性增强(Diversity)

- 端侧统一模型(On-Device)

- 全面评测基准(Benchmark)

- 动态视频生成(Video Gen)

- Sony音效基础模型(Audio Gen)

- 线性注意力加速(Linear Attention)

今日概览

今日 arXiv cs.CV 视觉生成相关论文共 8 篇,重点解读 8 篇。

方向分布:

- 高效生成架构 (3篇): 潜空间统一模型(LatentUM)、门控条件注入(GatedControl)、0.39B端侧统一模型(DreamLite) — 多Patch/端侧/线性注意力

- DiT多样性 (1篇): 上下文空间排斥(ContextRepulsion) — 让DiT生成更多样

- DiT高效架构 (1篇): 多Patch全局-局部(MPDiT) — 计算量减半性能不降

- 视频生成 (1篇): 合成运动数据(DynaVid) — 解决动态视频生成数据瓶颈

- 评测基准 (1篇): 3.6K条件集+20K标注(ImagenWorld) — 压力测试图像生成模型

- 音频生成 (1篇): Sony开源音效基础模型(Woosh) — 编解码+对齐+T2A+V2A完整方案

来源: arXiv 2026-03-29 ~ 2026-04-04

重点论文深度解读

1. LatentUM

潜空间统一模型:释放交错跨模态推理潜力 | 清华/上交 | Tsinghua University, Shanghai Jiao Tong University | arXiv:2604.02097

关键词: 统一模型, 潜空间, 跨模态推理, 视觉空间规划, 自反思生成

研究动机

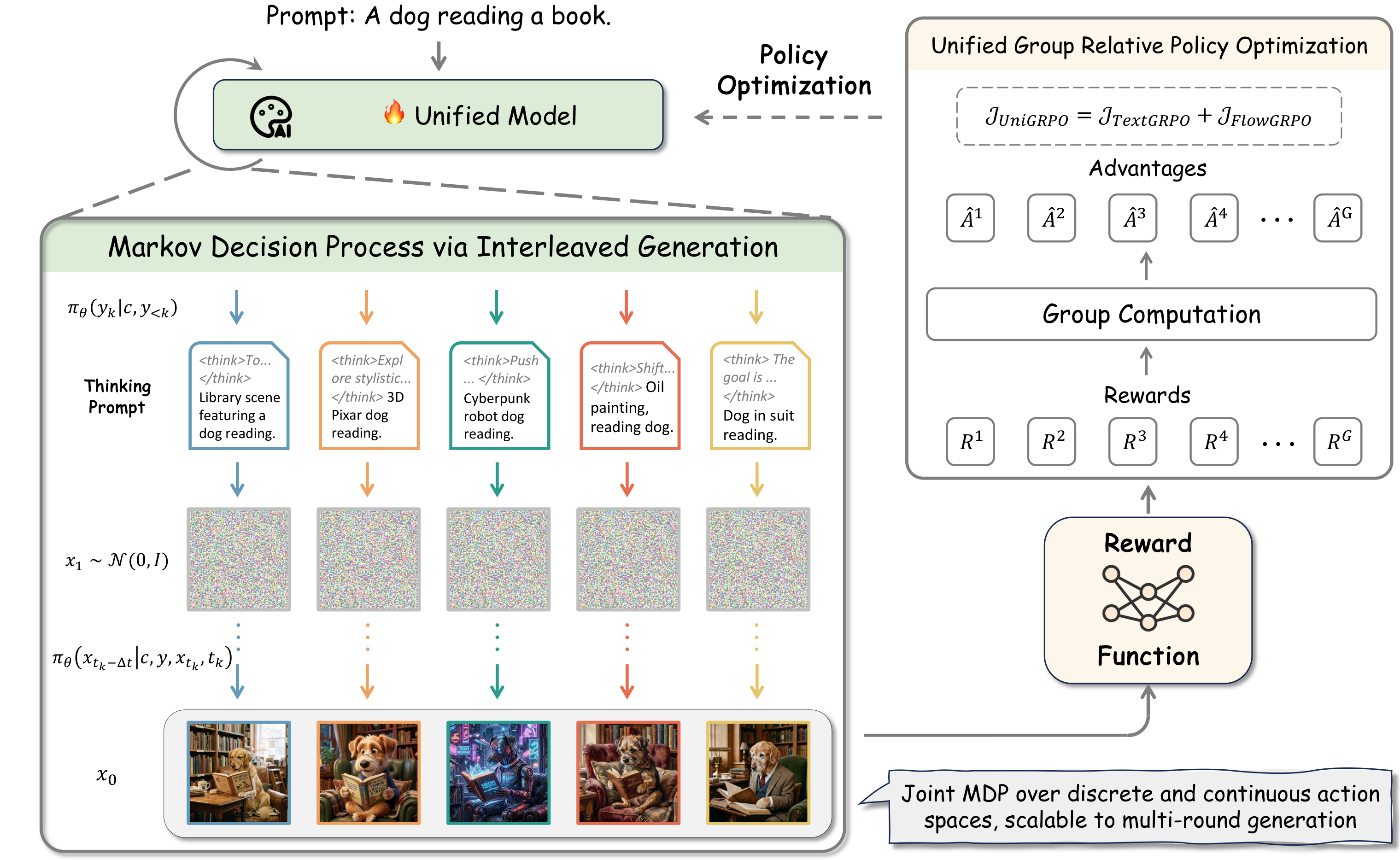

核心问题: 如何在统一多模态模型中消除像素空间中介,实现高效的交错跨模态推理

统一多模态模型(UMs)具有理解和生成异质模态内容的能力,但现有 UMs 面临关键瓶颈:视觉理解和生成使用不同的表示空间(如 CLIP 特征用于理解、VQGAN Token 用于生成),导致跨模态推理时必须经过像素空间解码作为中介,既低效又引入编解码器偏差(codec bias)。这严重限制了交错跨模态推理(interleaved cross-modal reasoning)的能力——例如需要密集视觉思考的理解任务、通过自反思改进生成、以及通过逐步动作干预建模物理世界动态等场景。

前序工作及局限:

- LLaVA/InternVL:纯理解模型,不支持生成

- Janus/SEED-X:引入生成但使用分离的视觉表示空间

- Show-o/Emu3:统一Token化但仍需像素中介

- Chameleon:统一离散Token但跨模态推理受限

与前序工作的本质区别: 提出共享语义潜空间,所有模态在同一表示中建模,消除像素空间解码中介

方法原理

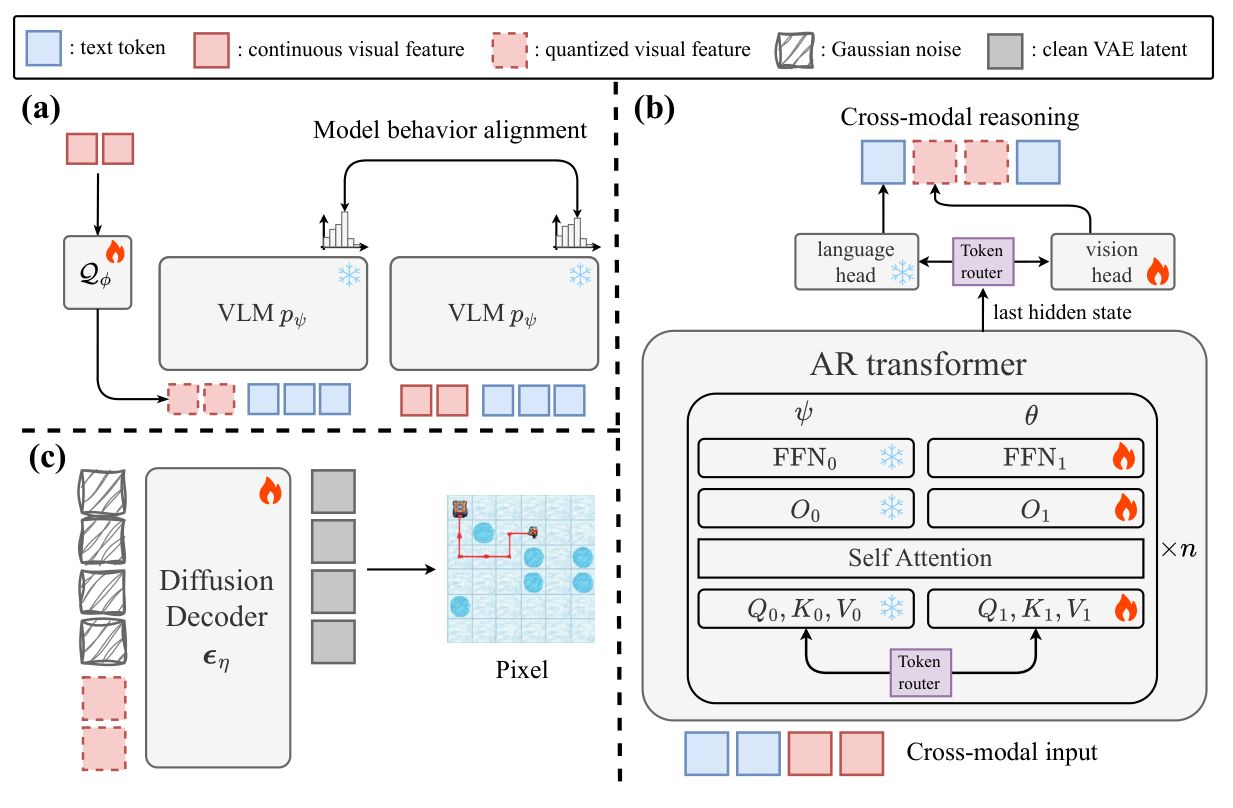

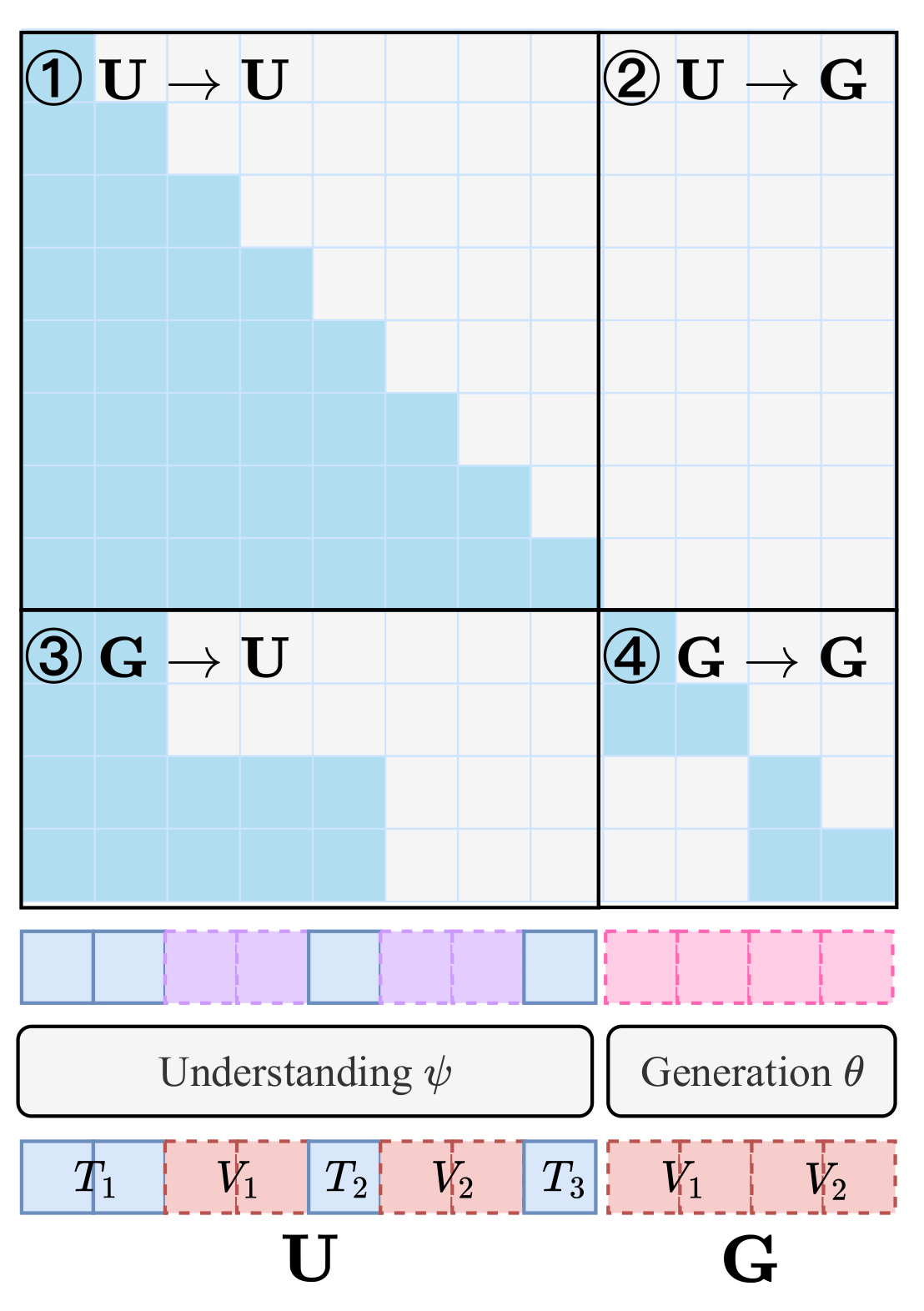

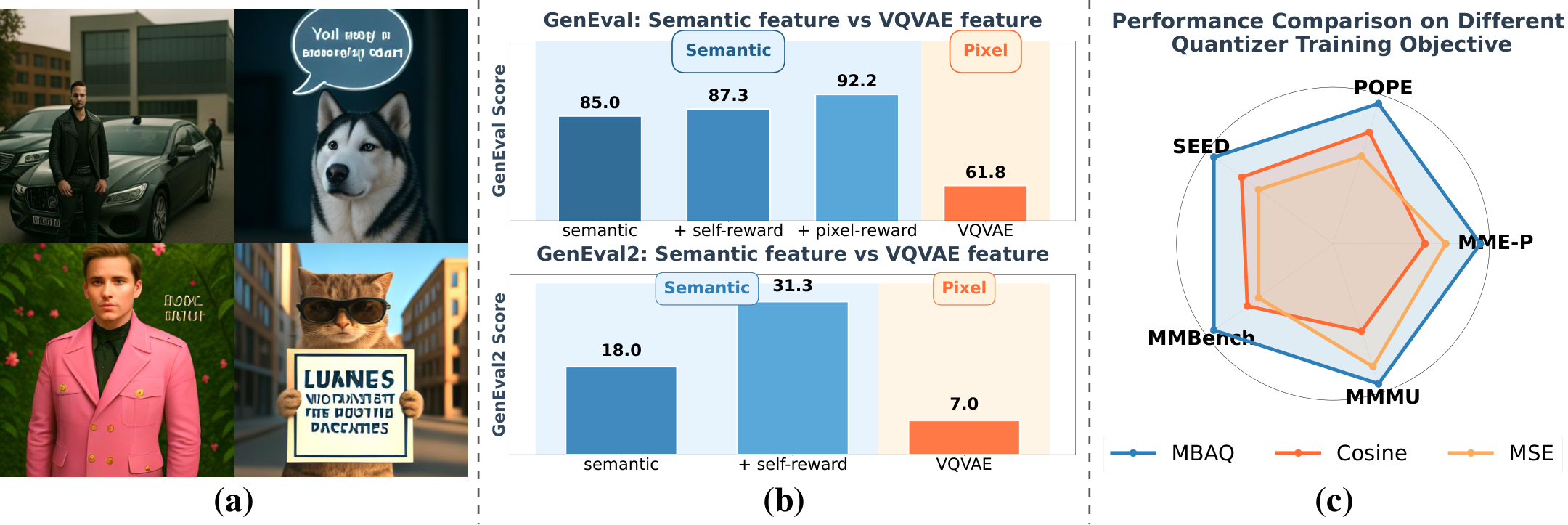

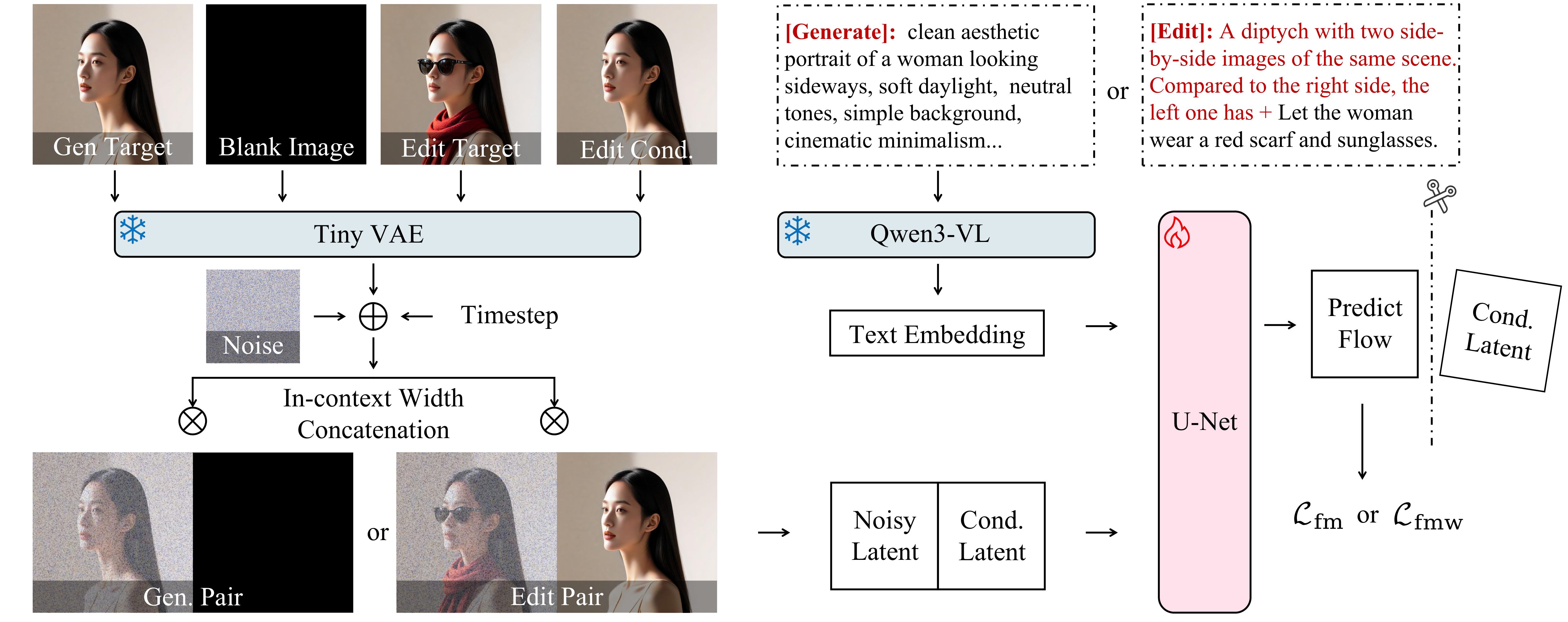

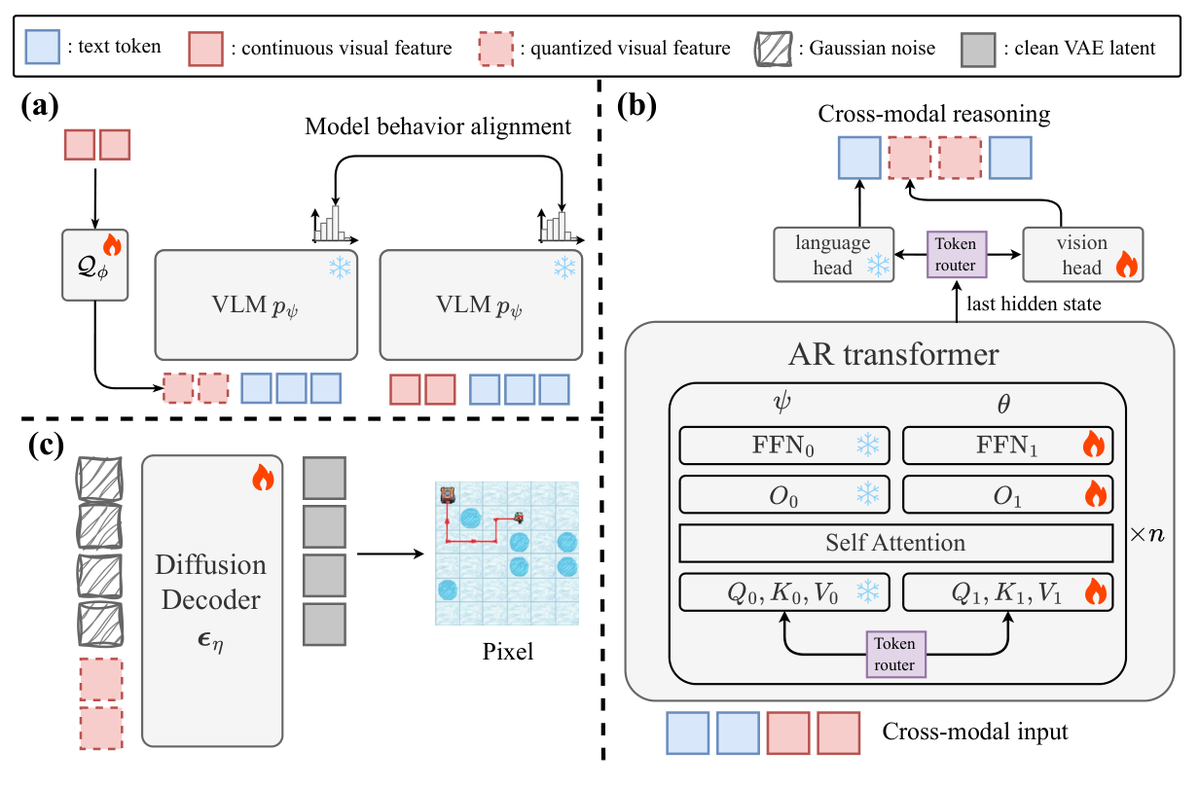

LatentUM 提出将所有模态统一到共享语义潜空间(shared semantic latent space)中表示,完全消除像素空间中介的需要。核心设计:(1) 共享潜空间表示:视觉理解和生成共用同一组潜向量,无需在两个不同的视觉编码器之间切换;(2) 交错生成与推理:模型可以在文本推理和视觉生成之间自由交替,每步的视觉输出直接作为下一步推理的输入,无需解码到像素再重新编码;(3) 自反思机制:模型能在潜空间中评估自己的生成结果,通过迭代优化提升视觉生成质量。这种设计不仅提高了计算效率,还大幅缓解了编解码器偏差,增强了跨模态对齐。

核心创新

- 首个将所有模态统一到共享语义潜空间的统一模型,消除像素空间中介

- 天然支持灵活的交错跨模态推理与生成

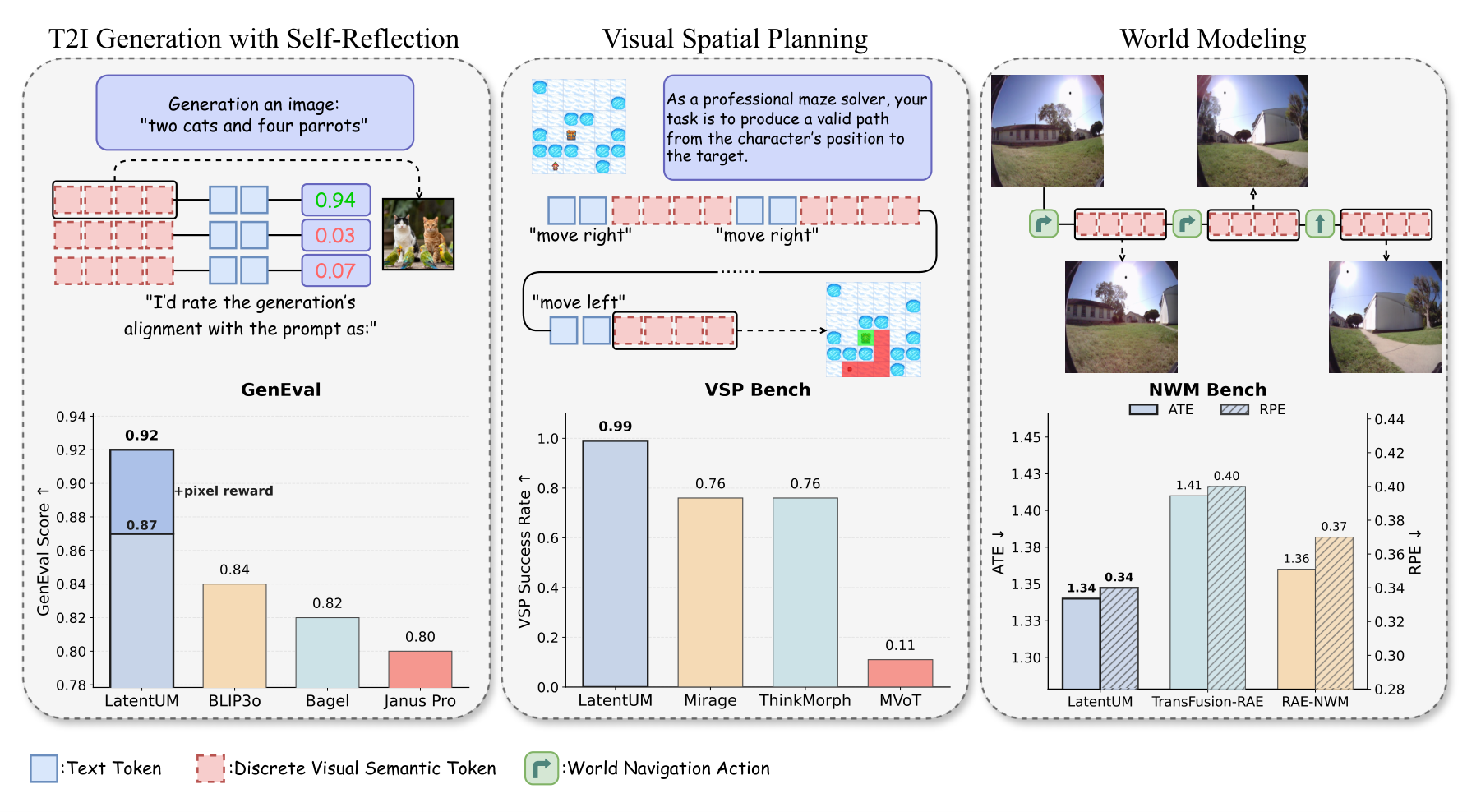

- 自反思机制:在潜空间中评估并迭代改进生成质量

- 大幅缓解编解码器偏差,增强跨模态对齐

- Visual Spatial Planning 基准 SOTA,支持世界建模

实验结果

- LatentUM 在 Visual Spatial Planning 基准上取得 SOTA 表现,证明了共享潜空间对空间推理的优势。通过自反思机制,视觉生成质量得到显著提升。世界建模任务中,模型能在共享语义潜空间内预测未来视觉状态,展现了统一表示的强大灵活性。与需要像素解码中介的现有 UMs 相比,LatentUM 在计算效率和跨模态一致性上均有明显优势。

图表详解

交错跨模态推理示例

展示 LatentUM 如何在文本推理和视觉生成之间自由交替。模型每一步的视觉输出直接作为下一步推理的输入,无需解码到像素再重新编码。图中对比了传统统一模型(需要像素中介)和 LatentUM(共享潜空间)的差异,清晰展示了潜空间融合带来的效率优势。

自反思机制效果对比

展示 LatentUM 的自反思机制如何提升视觉生成质量。通过在潜空间中评估自己的生成结果,模型可以迭代优化输出。图中对比了有无自反思机制下的生成效果,验证了潜空间评估和迭代改进的有效性。

批判性点评

- 新颖性: 共享语义潜空间消除像素中介是架构层面的重要创新。自反思机制设计精巧。但统一潜空间的思路在早期VQ-VAE工作中有萌芽

- 可复现性: 方法描述清晰,但训练细节和数据规模未完全披露,完全复现有难度

- 影响力: 为统一模型开辟了潜空间融合新范式,对后续交错推理研究有重要启发。但实际生成质量能否超越专用模型需更多验证

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 统一模型从表面统一到深层语义融合的关键一步

可能的后续方向:

- 扩展到更多模态

- 潜空间自反思的理论分析

- 工业级部署验证

2. ContextRepulsion

上下文空间排斥:让DiT生成更多样 | Tel Aviv University | Tel Aviv University | arXiv:2603.28762

关键词: 多样性, DiT, 文生图, 排斥机制, 注意力干预

研究动机

核心问题: 如何在不牺牲质量的前提下提升DiT生成的多样性

现代文生图(T2I)扩散模型在语义对齐上已达到很高水平,但一个普遍且被低估的问题是:对同一文本提示,模型倾向于收敛到一组狭窄的视觉解决方案——即典型性偏差(typicality bias)。这对需要丰富多样创意输出的应用场景(如设计、广告、艺术创作)构成严重限制。现有提升多样性的方法面临根本权衡:修改模型输入需要昂贵的优化来融入生成路径反馈;而直接干预已空间定型的中间潜变量则会破坏正在形成的视觉结构,产生伪影。

前序工作及局限:

- 随机种子变换:最基础的多样性来源,但效果有限

- CFG权重调整:权衡质量和多样性,但粗粒度

- Diverse Diffusion:轨迹空间排斥,但对Turbo模型失效

- 输入空间优化:需要昂贵的迭代优化

与前序工作的本质区别: 在注意力中间层的上下文空间施加排斥,找到了结构已建立但构图未固定的精准干预时机

方法原理

本文提出在上下文空间(Contextual Space)中施加排斥力来实现 Diffusion Transformer 的丰富多样性。核心创新在于干预多模态注意力通道:在 Transformer 的前向传播中,在文本条件已融合新兴图像结构但构图尚未固定的 block 之间注入即时排斥(on-the-fly repulsion)。具体来说,当生成多张图像时,通过在上下文表示(即注意力中间层的特征)之间施加排斥力,使不同图像的生成轨迹在语义层面相互远离,从而产生多样化的视觉输出。这种方法的关键优势在于:(1) 干预发生在结构已被初步确定但构图尚未固定的层,避免了低层干预造成的伪影;(2) 计算开销极小;(3) 甚至对 Turbo 和蒸馏模型等传统轨迹干预失效的模型也有效。

核心创新

- 首次在上下文空间(注意力中间层)施加排斥力提升生成多样性

- 精准时机干预:结构信息已建立但构图未固定时注入

- 计算开销极小,兼容 Turbo/蒸馏模型等快速推理范式

- 不牺牲视觉保真度和语义对齐

- 揭示了注意力空间中多样性控制的新维度

实验结果

- 在多种 DiT 模型上的实验表明,上下文空间排斥产生了显著更丰富的多样性,同时不牺牲视觉保真度和语义对齐。该方法在标准扩散模型和现代 Turbo/蒸馏模型上均有效——而传统的轨迹干预方法在后者上通常完全失败。计算开销仅增加少量,实际可用性极强。

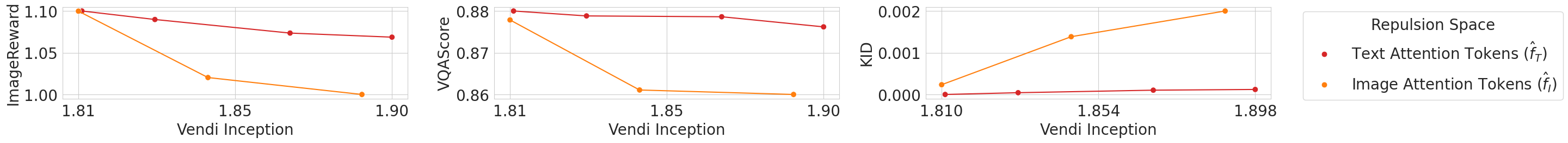

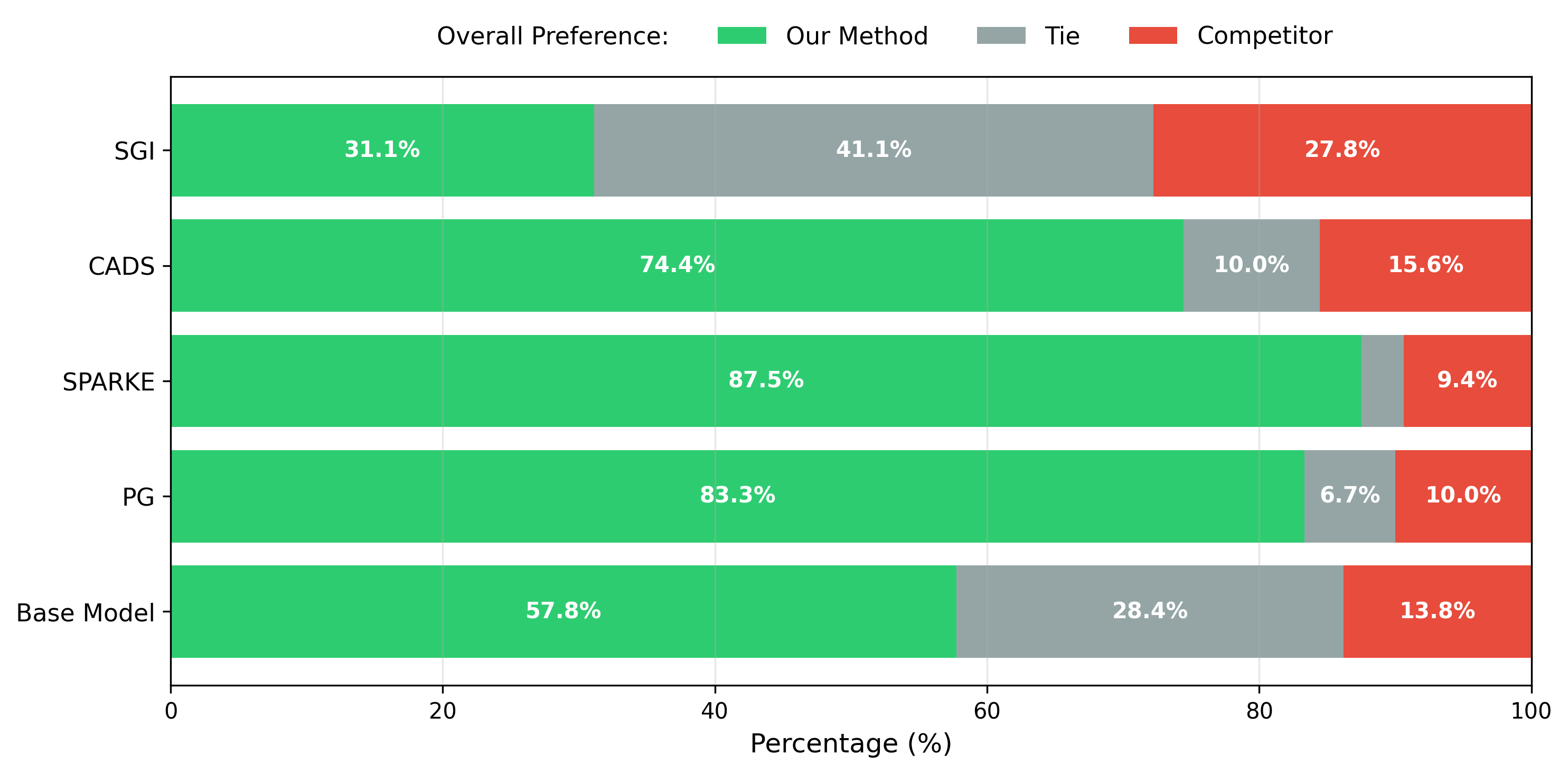

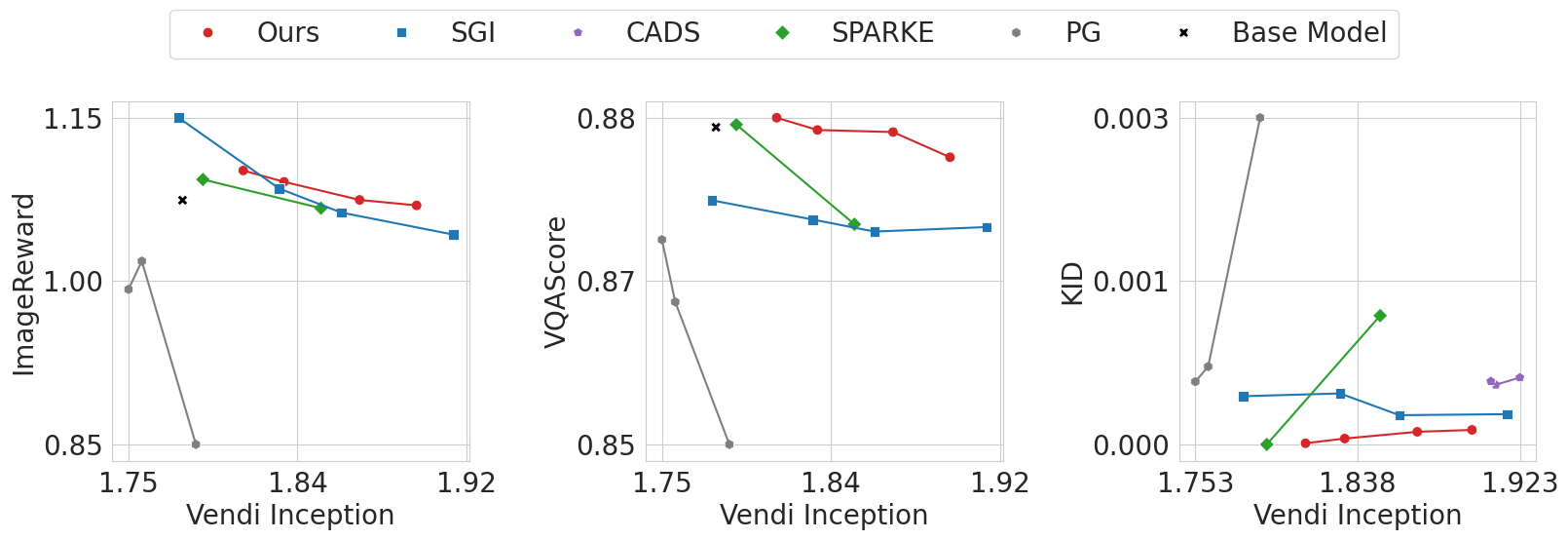

图表详解

用户研究:多样性偏好评估

用户研究结果展示了上下文空间排斥方法生成的图像在多样性方面的优势。参与者被要求比较使用 ContextRepulsion 和基线方法生成的图像组,结果显示用户更偏好具有丰富多样性的输出,同时不牺牲语义对齐和视觉保真度。

上下文空间排斥原理图

ContextRepulsion 的核心原理示意图:在 DiT 的上下文空间(注意力中间层)施加排斥力。图中展示了当并行生成多张图像时,通过在上下文表示之间施加排斥力,使不同图像的生成轨迹在语义层面相互远离,从而产生多样化的视觉输出。干预时机精准:结构已被初步确定但构图尚未固定的层。

批判性点评

- 新颖性: 上下文空间排斥是全新的干预方式。找到了注意力空间中多样性控制的精准时机。概念简洁而有效

- 可复现性: 方法原理清晰,实现简单,计算开销小,可复现性高

- 影响力: 揭示了被忽视的DiT典型性偏差问题,为创意应用提供了实用的多样性增强方案。但仍需验证在大规模工业场景中的稳定性

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 多样性控制从轨迹空间提升到特征空间的新维度

可能的后续方向:

- 与CFG组合使用

- 扩展到视频生成多样性

- 理论分析最优干预层

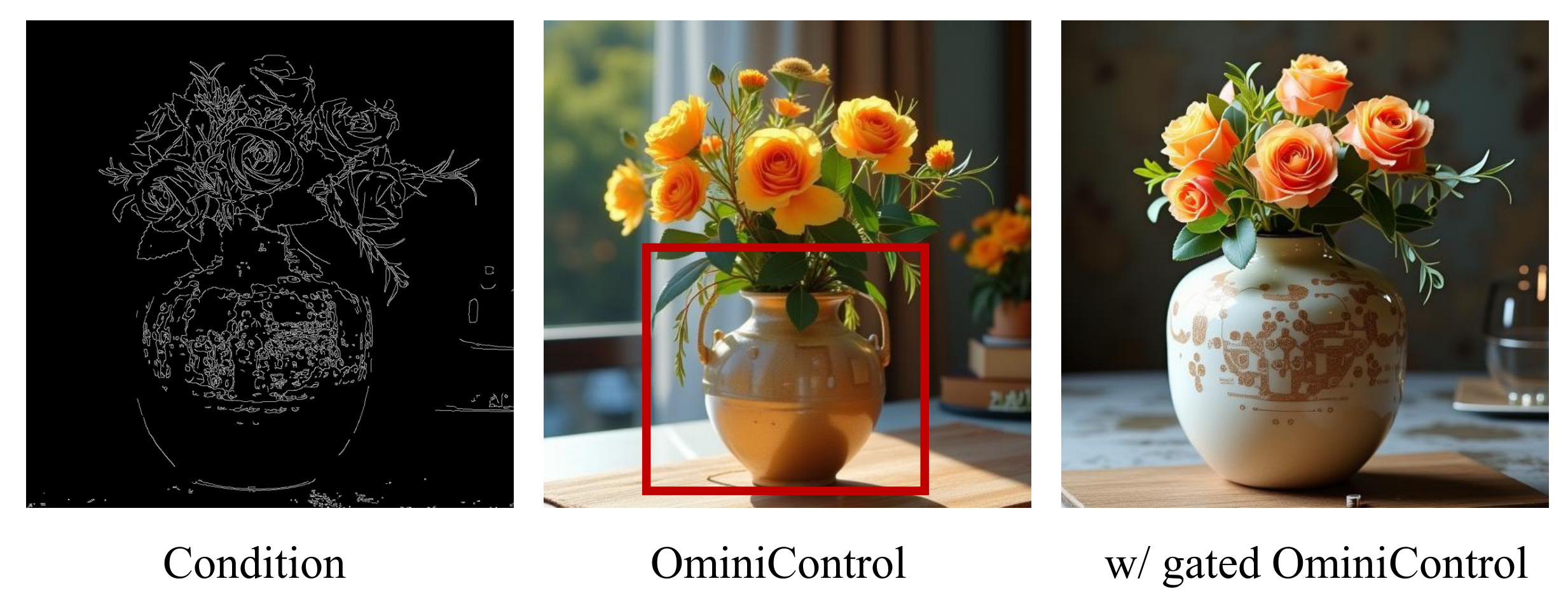

3. GatedControl

门控条件注入:线性注意力的可控扩散生成 | NUS | National University of Singapore | arXiv:2603.27666

关键词: 线性注意力, 可控生成, 端侧部署, SANA, 门控调制

研究动机

核心问题: 如何在线性注意力扩散模型上实现高效可控生成

基于扩散的可控视觉生成已取得显著进展,但这些模型通常需要部署在云端服务器上,引发用户数据隐私的严重担忧。要实现安全高效的端侧生成,线性注意力架构(如 SANA)是理想选择——它具备优越的可扩展性和效率。然而实验发现,现有的可控生成框架(如 ControlNet、OminiControl)在线性注意力模型上存在严重问题:要么缺乏灵活性,无法支持多种异构条件类型;要么收敛极慢。这揭示了一个被忽视的gap:可控生成方法主要为标准自注意力设计,未充分考虑线性注意力的特殊性。

前序工作及局限:

- ControlNet:旁路条件注入,但为标准注意力设计

- T2I-Adapter:轻量化适配器,但不支持非对齐条件

- IP-Adapter:参考图像条件注入

- OminiControl:统一多条件,但在线性注意力上收敛慢

与前序工作的本质区别: 用门控调制替代多模态注意力,双路管线分别处理对齐和非对齐条件

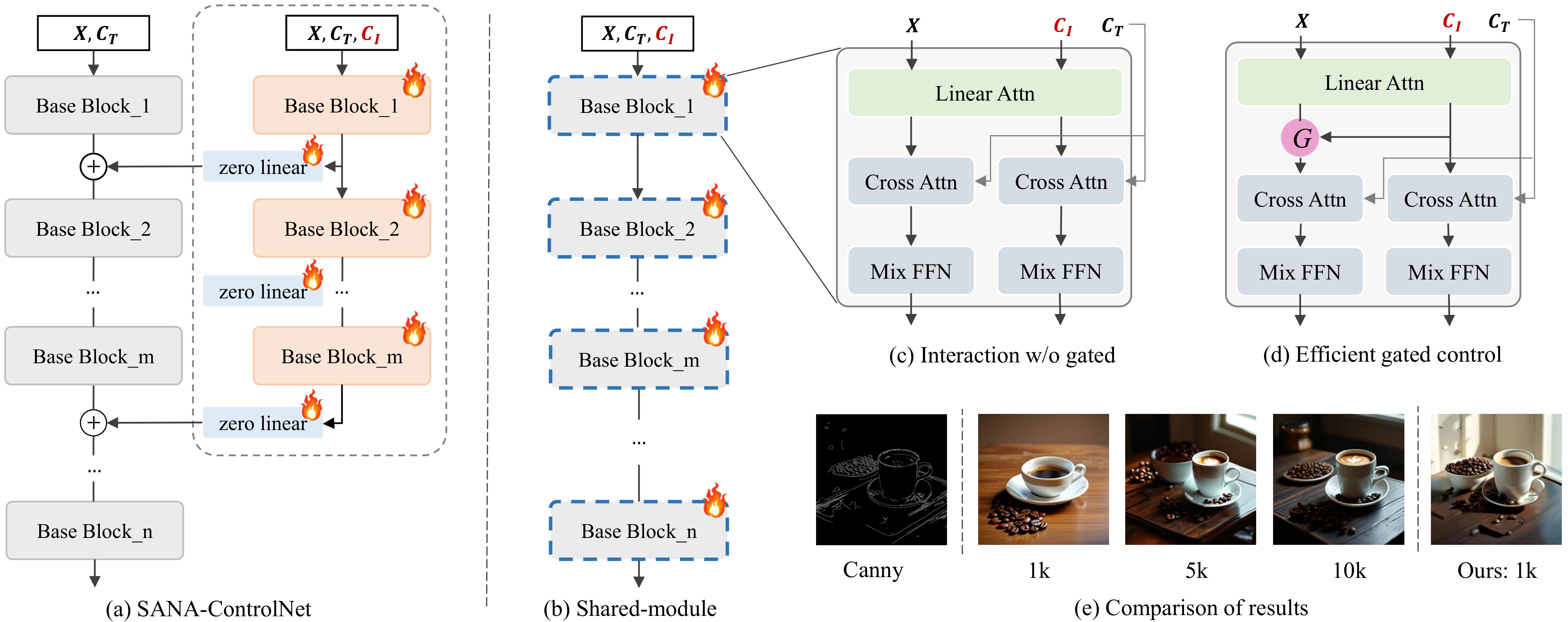

方法原理

本文提出专为线性注意力骨干(如 SANA)定制的可控扩散框架。核心是统一门控条件模块(unified gated conditioning module)工作在双路管线(dual-path pipeline)中:(1) 空间对齐条件路径:处理 depth map、edge map、segmentation 等空间对齐的控制信号;(2) 非对齐条件路径:处理参考图像、风格图等非空间对齐的控制信号。两条路径通过门控机制有效融合到线性注意力的扩散过程中。关键设计是门控调制(gated modulation)替代传统多模态注意力(multimodal attention),避免了线性注意力中跨模态注意力的低效问题。

核心创新

- 首个专为线性注意力扩散模型设计的可控生成框架

- 统一门控条件模块:双路管线处理空间对齐和非对齐条件

- 门控调制替代多模态注意力,更适合线性注意力的特性

- 单一模型动态适配多种条件类型

- 在端侧设备上实现可控生成,保护用户隐私

实验结果

- 在多个任务和基准上的大量实验表明,该方法基于线性注意力模型实现了 SOTA 可控生成性能,在保真度和可控性两方面均超越现有方法。具体而言,在深度条件、边缘条件、参考图像等多种控制信号下,生成质量与基于标准注意力的方法持平甚至更优,但推理效率显著提升,适合边缘设备部署。

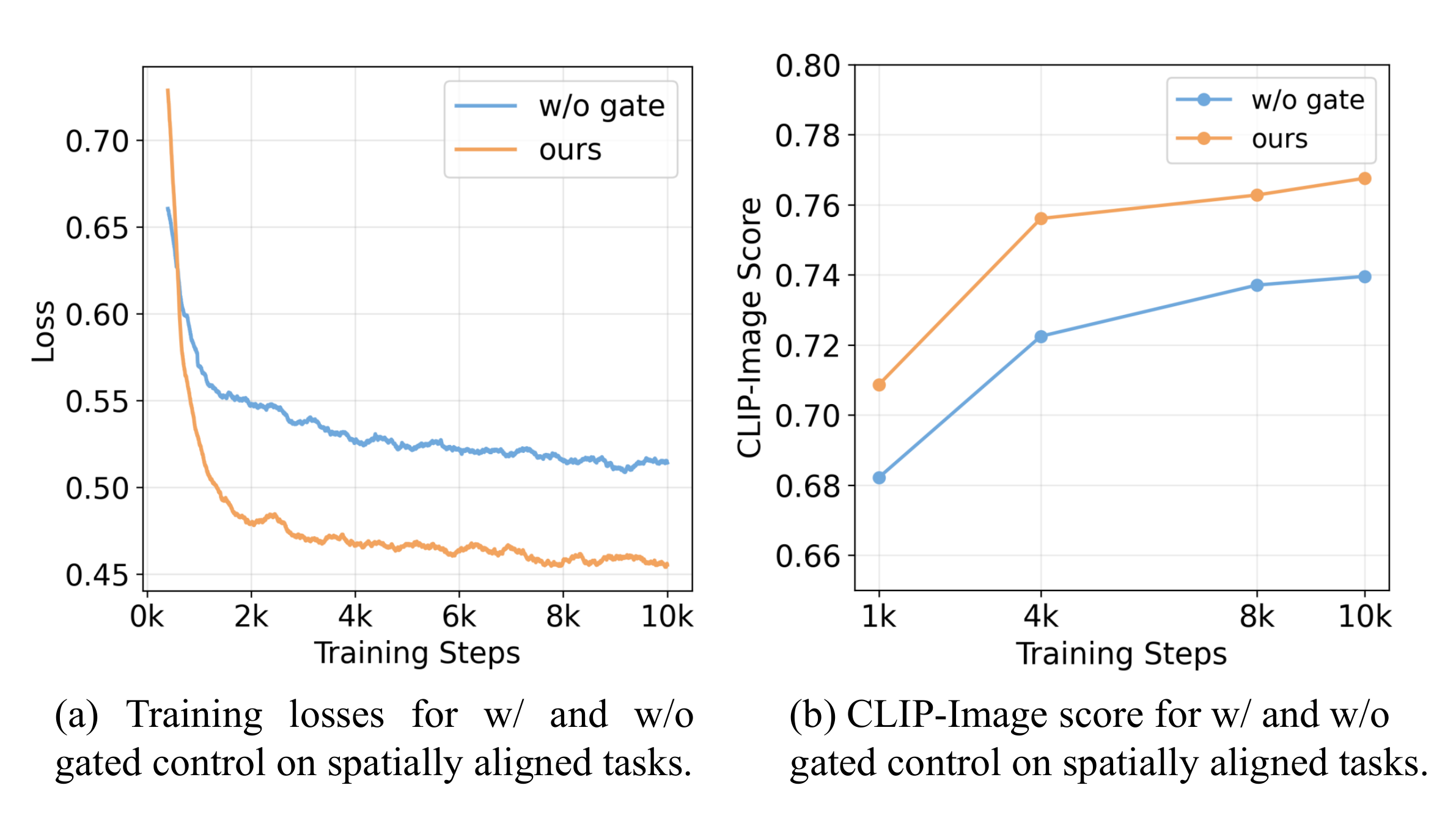

图表详解

GatedControl 门控条件模块架构

GatedControl 的核心架构:统一门控条件模块工作在双路管线中。空间对齐条件路径处理 depth map、edge map 等空间对齐信号;非对齐条件路径处理参考图像、风格图等非空间对齐信号。门控调制替代传统多模态注意力,更适合线性注意力的特性。

空间对齐条件消融实验

消融实验验证 GatedControl 在多种空间对齐条件下的性能。图中展示了深度条件、边缘条件、分割条件等不同控制信号下的生成效果对比。门控调制在线性注意力架构上的收敛速度和生成质量均优于传统多模态注意力方案。

批判性点评

- 新颖性: 首次为线性注意力定制可控生成方案,门控调制替代多模态注意力是务实的设计创新

- 可复现性: 基于SANA公开架构,方法描述清晰,可复现性较好

- 影响力: 打通了高效架构和可控生成的最后障碍,使端侧隐私保护的可控生成成为可能

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 首次将可控生成适配到线性注意力架构,打通端侧部署瓶颈

可能的后续方向:

- 与更多线性注意力架构组合

- 端侧实时可控生成产品化

- 更多条件类型扩展

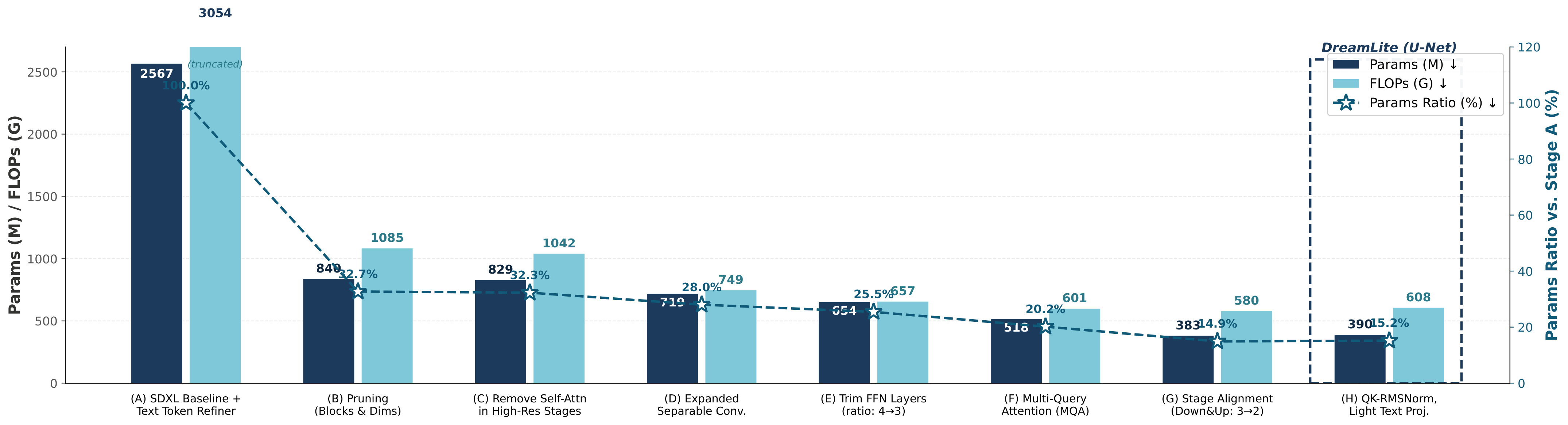

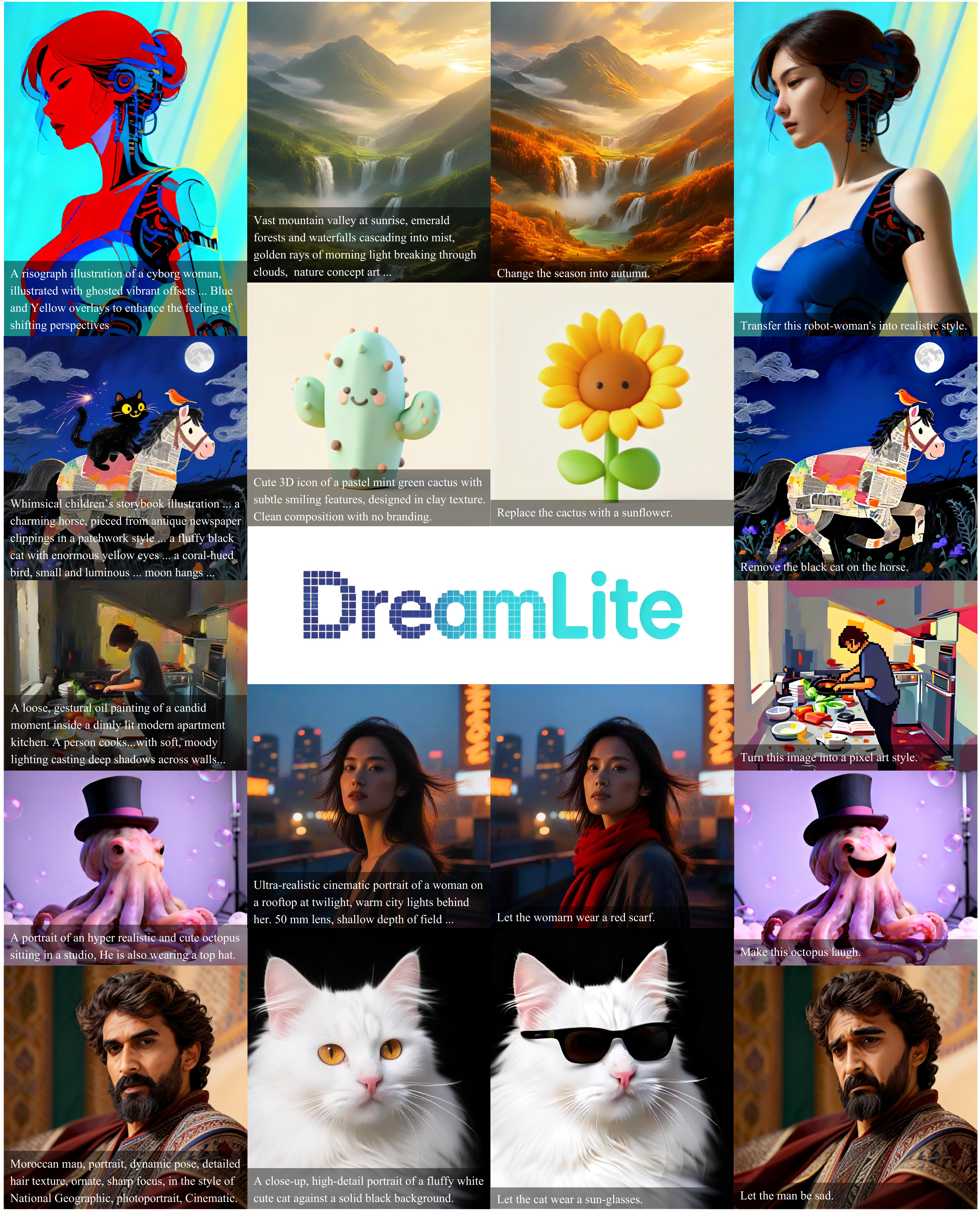

4. DreamLite

0.39B端侧统一模型:生成+编辑不到1秒 | Xiaomi | Xiaomi | arXiv:2603.28713

关键词: 端侧推理, 模型压缩, 统一模型, 步蒸馏, 强化学习

研究动机

核心问题: 如何在端侧设备上用单一紧凑模型同时支持图像生成和编辑

扩散模型在文生图和图像编辑上取得了显著进展,但通常需要数十亿参数,导致高延迟和部署困难。现有的端侧扩散模型虽然提升了效率,但几乎全部聚焦于文生图生成,缺乏对图像编辑的支持。这意味着用户需要同时安装两个独立模型才能完成生成和编辑——在存储和计算资源受限的移动设备上极不现实。

前序工作及局限:

- LCM:潜空间一致性步数压缩

- SDXL-Turbo:对抗蒸馏加速

- MobileDiffusion:移动架构优化,但只支持生成

- InstructPix2Pix:图像编辑,但参数量大无法端侧部署

与前序工作的本质区别: 剪枝U-Net + 上下文拼接统一格式 + 渐进预训练 + RL + 4步蒸馏

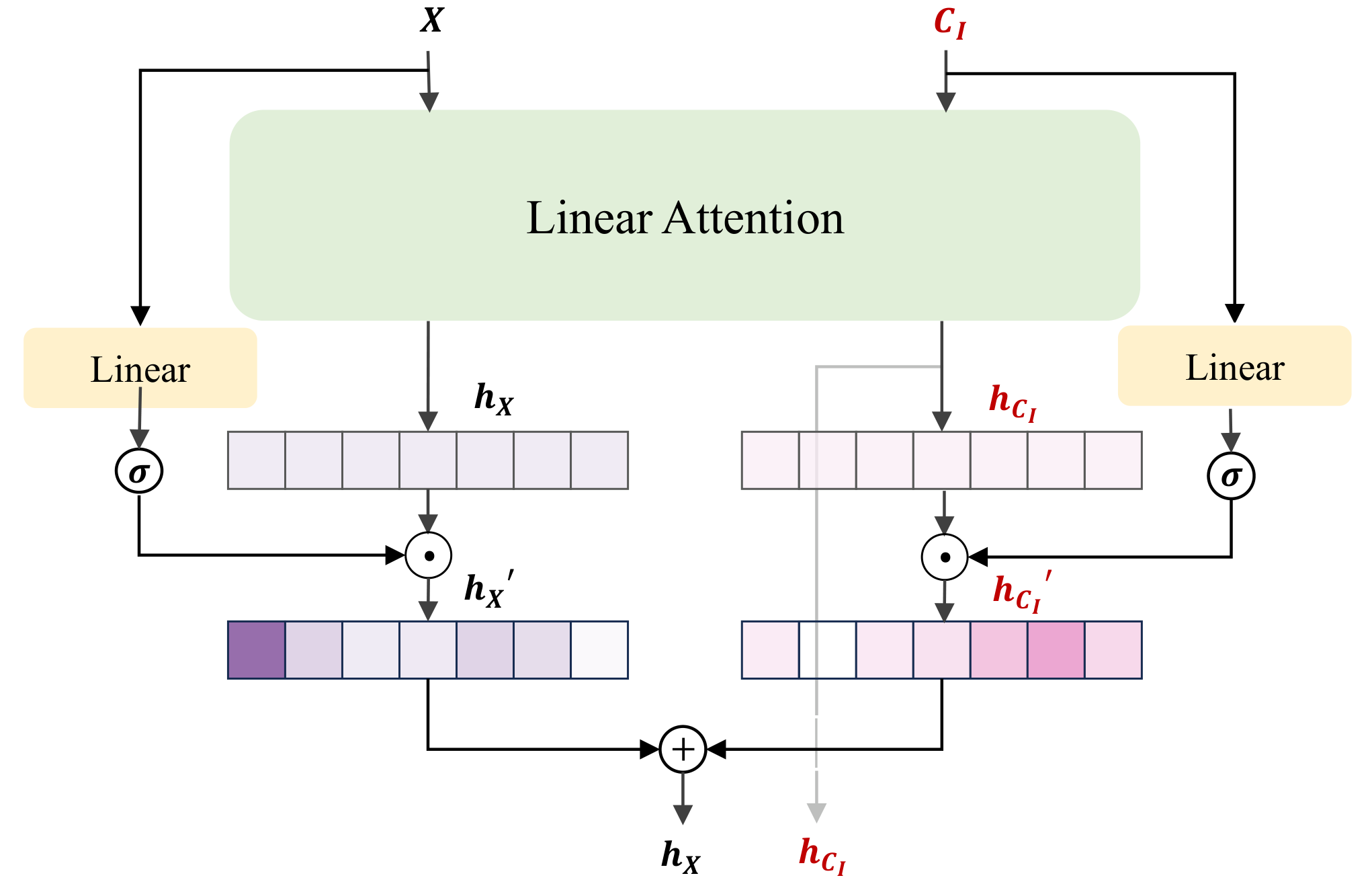

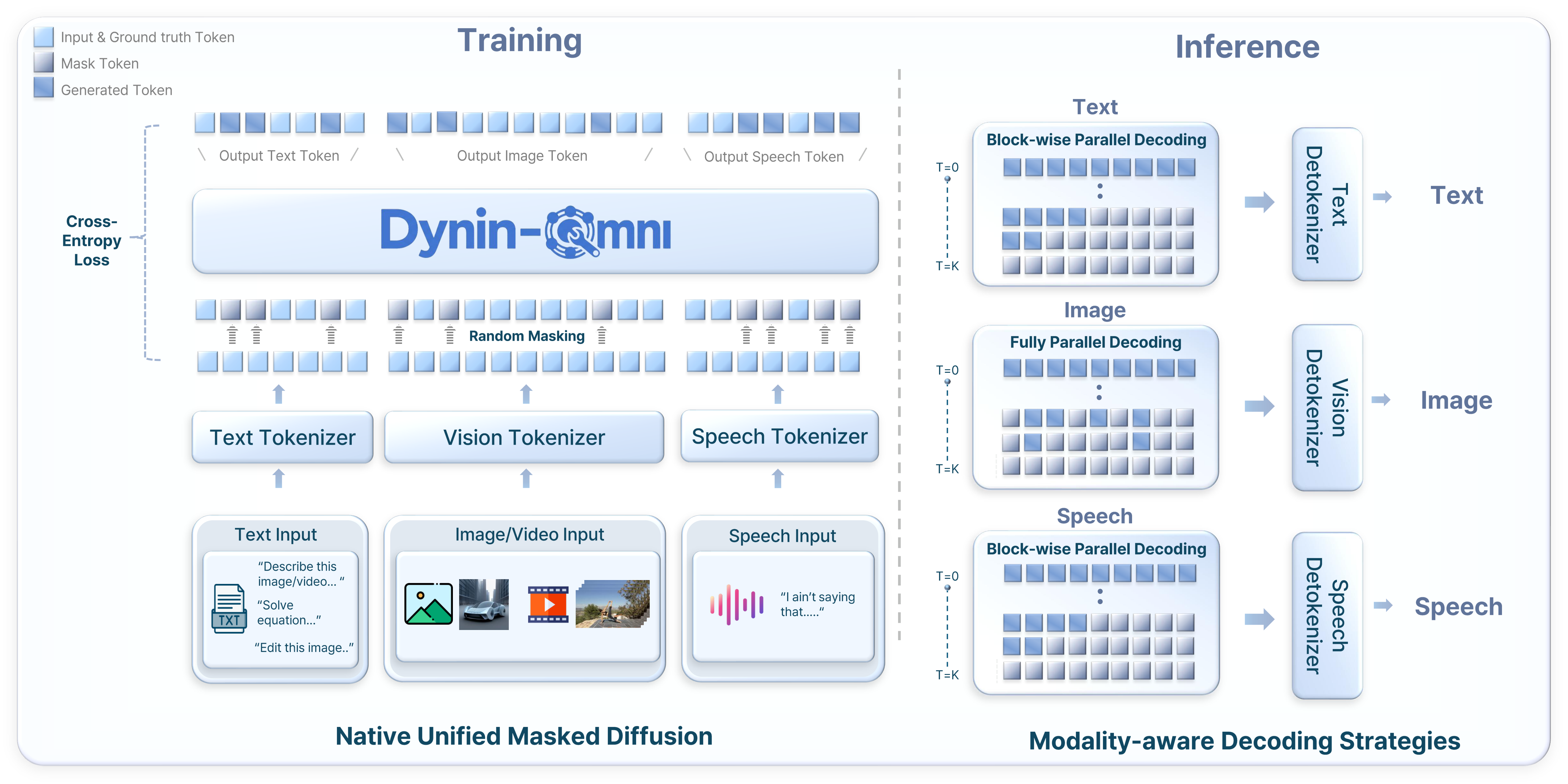

方法原理

DreamLite 是一个仅 0.39B 参数的紧凑统一端侧扩散模型,在单一网络中同时支持文生图生成和文本引导图像编辑。核心设计:(1) 基础架构:基于剪枝后的 mobile U-Net 骨干,通过上下文空间拼接(in-context spatial concatenation)统一条件输入——生成任务使用 (target | blank) 配置,编辑任务使用 (target | source) 配置;(2) 任务渐进联合预训练策略:按顺序依次训练 T2I → 编辑 → 联合任务,稳定紧凑模型的训练过程;(3) 高质量 SFT + 强化学习微调;(4) 步蒸馏将去噪步数压缩到仅 4 步,在小米 14 手机上生成/编辑 1024x1024 图像不到 1 秒。

核心创新

- 首个统一端侧扩散模型:0.39B 参数同时支持生成和编辑

- 上下文空间拼接:(target|blank)/(target|source) 统一条件格式

- 任务渐进联合预训练:T2I→编辑→联合,稳定小模型训练

- 步蒸馏:1024x1024 图像 <1s(小米 14)

- GenEval 0.72 + ImgEdit 4.11,超越现有端侧模型

实验结果

- DreamLite 在 GenEval 上取得 0.72 分(文生图),在 ImgEdit 上取得 4.11 分(图像编辑),超越所有现有端侧模型,并与多个服务器端模型保持竞争力。通过步蒸馏,去噪过程压缩到仅 4 步,在小米 14 手机上生成或编辑一张 1024x1024 图像耗时不到 1 秒。据作者所知,DreamLite 是第一个同时支持图像生成和编辑的统一端侧扩散模型。

图表详解

DreamLite 消融实验结果

消融实验验证 DreamLite 各组件的贡献。对比实验展示了渐进预训练、强化学习微调、步蒸馏等技术对最终性能的影响。DreamLite 在 GenEval 上取得 0.72 分(文生图),在 ImgEdit 上取得 4.11 分(图像编辑),超越所有现有端侧模型。

批判性点评

- 新颖性: 首个端侧统一生成+编辑模型。上下文拼接和渐进预训练是实用创新。RL微调进一步提升质量

- 可复现性: 架构和训练策略描述详细,但需要特定的剪枝基座和大规模数据,完全复现有门槛

- 影响力: 为移动AIGC应用开辟新可能,0.39B/<1s的指标具有工业级实用价值

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 端侧扩散模型从单纯加速到功能完备的里程碑

可能的后续方向:

- 支持更多编辑类型

- 视频生成能力

- 与LoRA等个性化技术结合

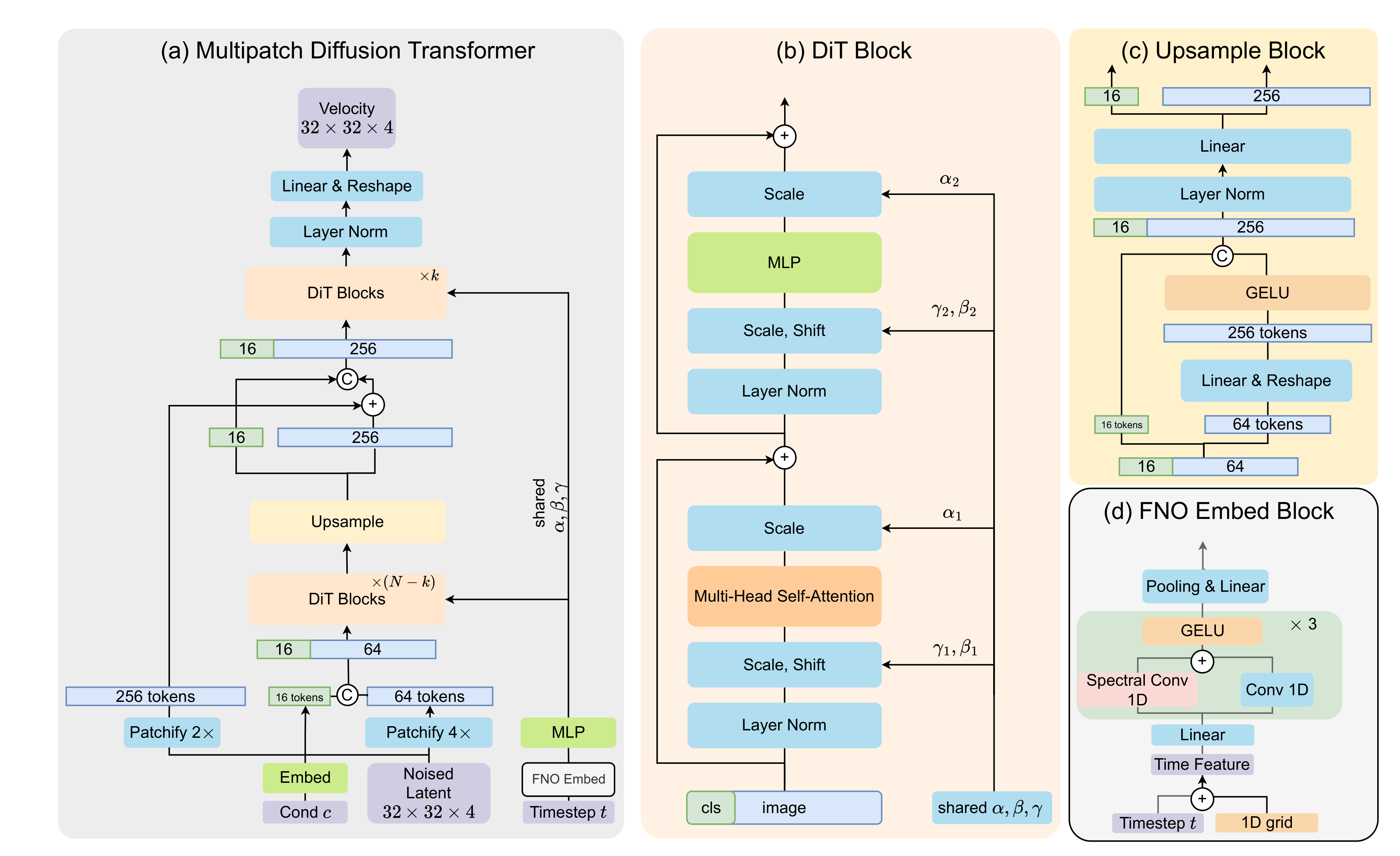

5. MPDiT

多Patch全局-局部DiT:计算量减半性能不降 | Rutgers | Rutgers University | arXiv:2603.26357

关键词: DiT, 多尺度Patch, 高效架构, Flow Matching, 全局到局部

研究动机

核心问题: 如何降低DiT的计算成本同时保持生成质量

Transformer 架构(尤其是 Diffusion Transformers / DiTs)因其优于卷积 UNet 的性能已成为扩散和 Flow Matching 模型的主流选择。然而,DiT 的各向同性设计(isotropic design)在每个 block 中处理相同数量的 patch 化 token,导致训练过程中计算量居高不下。这是 DiT 效率的核心瓶颈:浅层和深层使用相同分辨率的 token,浅层做粗粒度全局感知时浪费了计算,深层做细粒度局部细化时又受限于粗 token。

前序工作及局限:

- DiT:各向同性设计,每层token数相同

- U-ViT:引入skip connection但保持各向同性

- SiT:改进插值策略

- SANA:线性注意力降低单层复杂度

与前序工作的本质区别: 多Patch层级设计:早期粗patch全局感知,后期细patch局部精细化

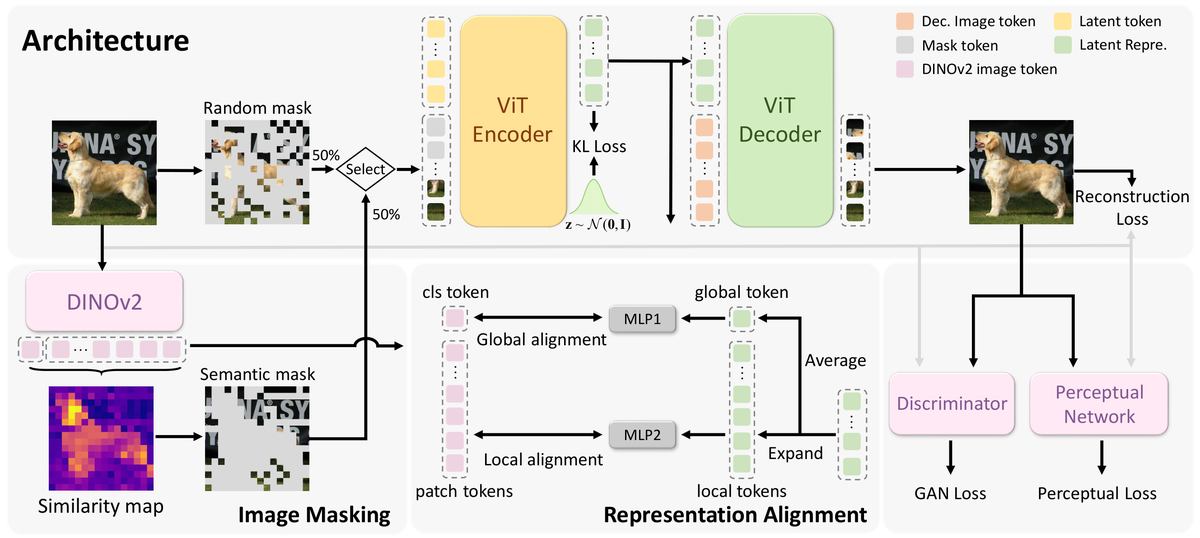

方法原理

MPDiT 引入多 Patch Transformer 设计:早期 block 操作更大的 patch(粗粒度)以高效捕获全局上下文,后期 block 使用更小的 patch(细粒度)精细化局部细节。这种从粗到细的层级设计理念类似于 CNN 中经典的金字塔结构,但首次系统应用于 DiT。同时还提出了改进的时间步和类别嵌入设计,加速训练收敛。整体架构在保持生成质量的同时,将计算量(GFLOPs)降低最多 50%。

核心创新

- 首个系统化的多 Patch DiT 架构:全局到局部的层级设计

- 早期粗 patch + 后期细 patch:计算量降低 50%

- 改进的时间步和类别嵌入设计,加速收敛

- 将 CNN 金字塔思想引入 Transformer 扩散模型

- 代码开源

实验结果

- 在 ImageNet 数据集上的大量实验验证了架构设计的有效性。MPDiT 在保持与标准 DiT 相当的生成质量的同时,计算量(GFLOPs)最多降低 50%。改进的嵌入设计进一步加速了训练收敛,使整体训练效率显著提升。代码已在 GitHub 开源。

图表详解

MPDiT 多Patch架构设计

MPDiT 的核心创新:多 Patch Transformer 设计。早期 block 操作更大的 patch(粗粒度)以高效捕获全局上下文,后期 block 使用更小的 patch(细粒度)精细化局部细节。这种从粗到细的层级设计理念类似于 CNN 中经典的金字塔结构,但首次系统应用于 DiT。

ImageNet 512x512 生成效果对比

ImageNet 数据集上的生成效果对比实验。MPDiT 在保持与标准 DiT 相当的生成质量的同时,计算量(GFLOPs)最多降低 50%。图中展示了不同分辨率下的 FID、IS 等指标对比,验证了多 Patch 设计的有效性。

MPDiT 系统架构图

MPDiT 的完整系统架构,展示了 patch 过渡机制和改进的时间步/类别嵌入设计。图中清晰说明了如何从大 patch token 重组为小 patch token,以及新的嵌入设计如何加速训练收敛。

批判性点评

- 新颖性: 多Patch层级设计思路源自CNN金字塔,首次系统应用于DiT。概念直观但工程实现需要仔细设计patch过渡

- 可复现性: 代码已开源,方法描述清晰,可复现性好

- 影响力: 为DiT效率优化提供了正交于注意力优化的新维度。50%计算降低有直接工业价值

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: DiT效率优化的正交维度——从token数量角度降低计算量

可能的后续方向:

- 与线性注意力组合

- 扩展到视频DiT

- 自适应patch大小

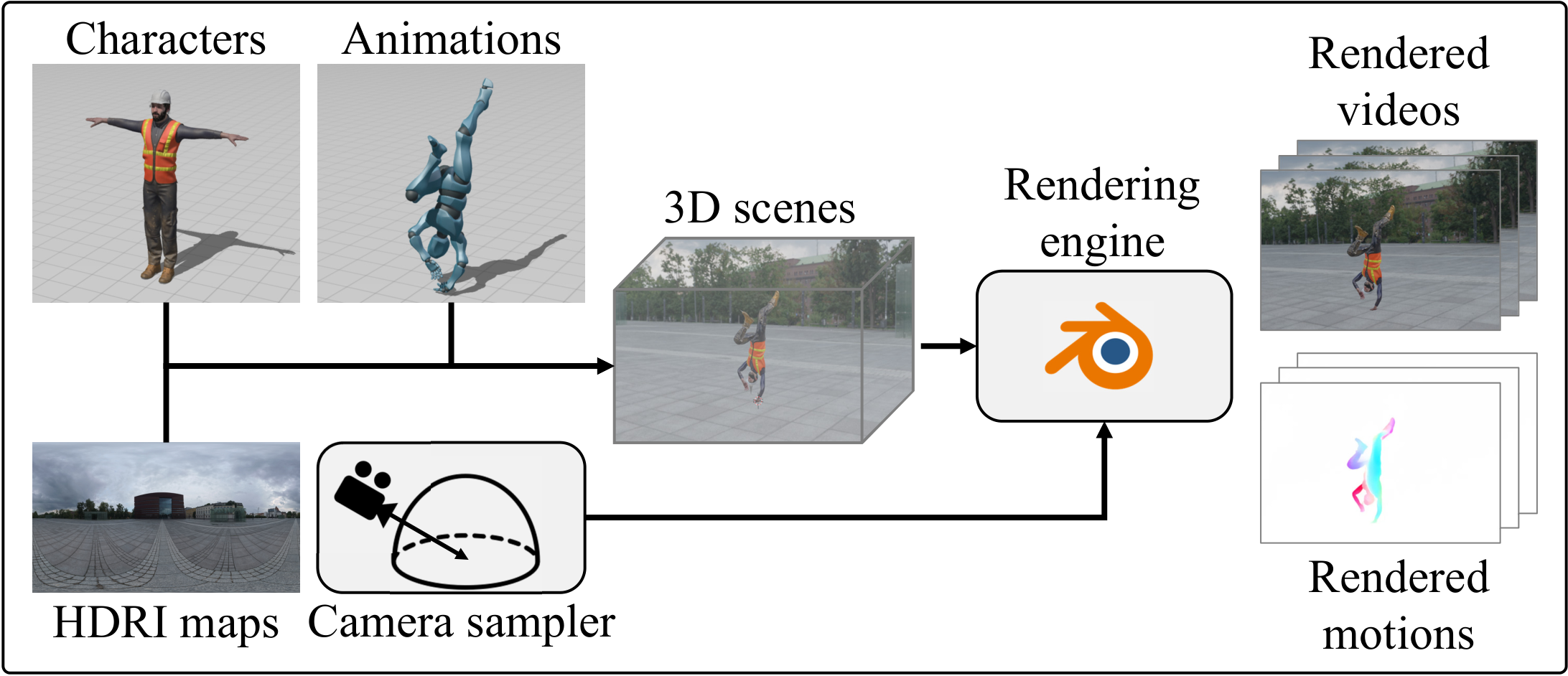

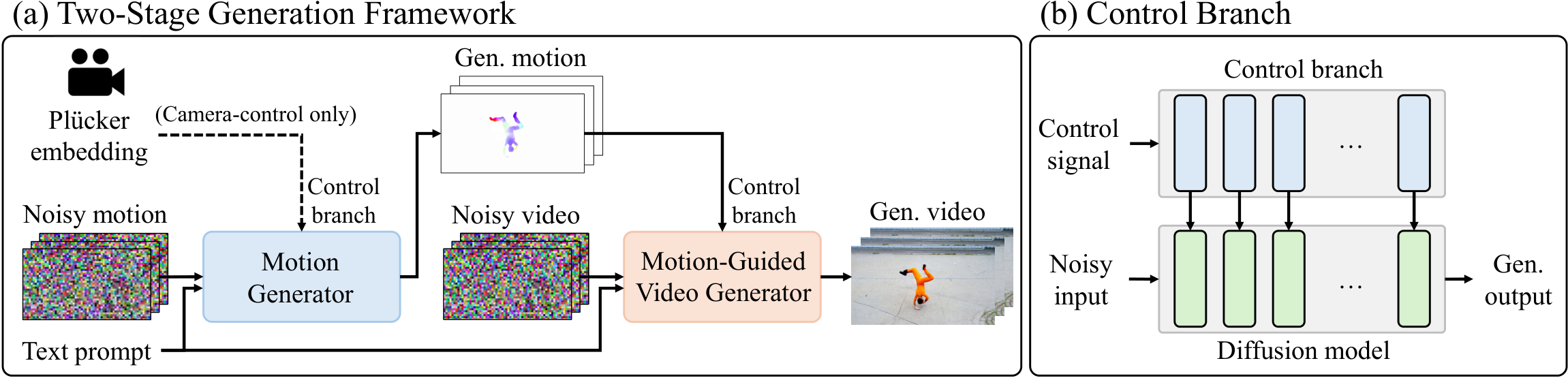

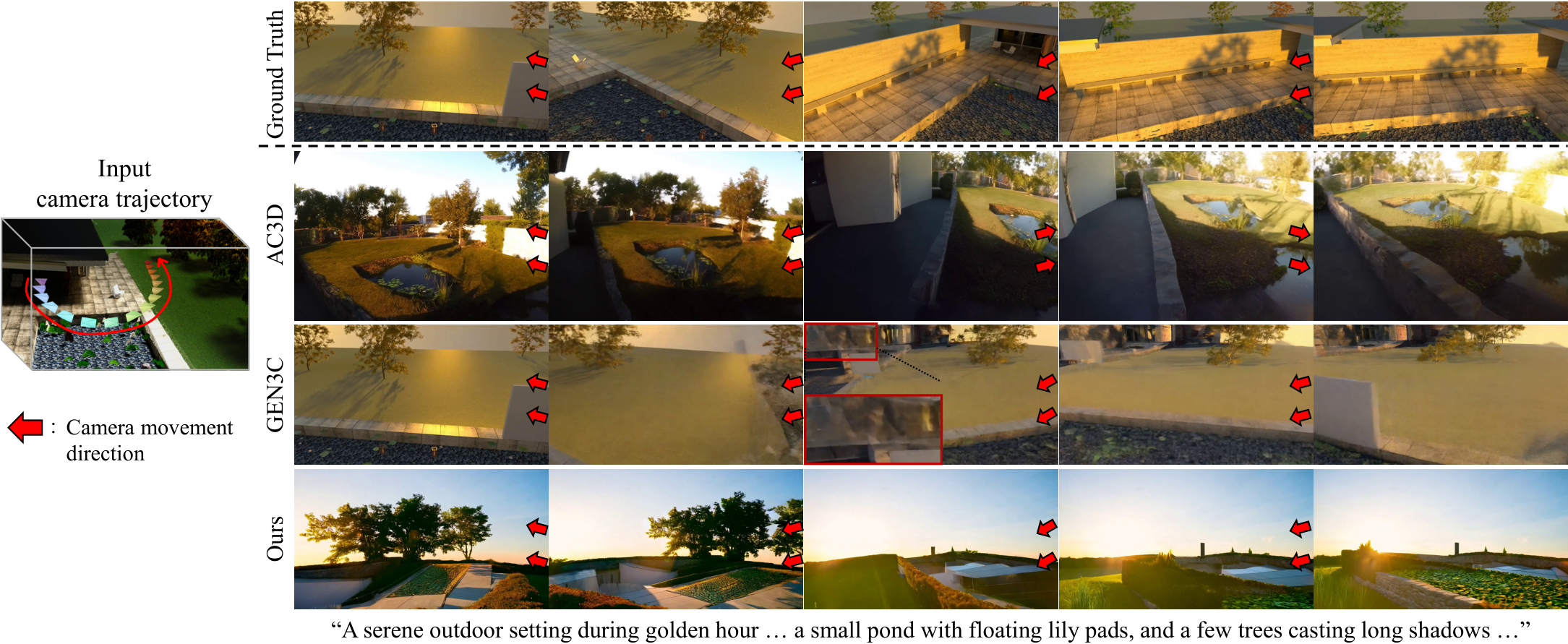

6. DynaVid

合成运动数据学习动态视频生成 | POSTECH/Microsoft | POSTECH, Microsoft Research Asia | arXiv:2604.01666

关键词: 视频生成, 合成数据, 光流, 动态运动, 运动控制

研究动机

核心问题: 如何解决视频生成中高动态运动训练数据的稀缺问题

尽管视频扩散模型取得了长足进步,但在合成涉及高动态运动或需要精细运动控制的真实视频时仍然力不从心。核心限制在于:常用训练数据集中严重缺乏此类样本——真实世界的高动态运动视频(如剧烈人体运动、极端相机运动)极为稀缺,且难以标注精细的运动控制信号。

前序工作及局限:

- 文本驱动视频生成:运动控制力有限

- 运动向量/轨迹控制:显式控制但受限于真实数据分布

- 合成视频训练:引入域差距(不自然外观)

- 光流预测:用于视频理解但未用于生成训练

与前序工作的本质区别: 用合成光流而非合成视频训练,运动与外观解耦避免域差距

方法原理

DynaVid 提出利用合成运动数据训练视频生成模型的框架。核心思路:(1) 运动以光流(optical flow)形式表示,通过计算机图形管线渲染合成——合成光流仅编码运动信息,与外观解耦,避免模型学到合成视频的不自然外观;(2) 两阶段生成框架:运动生成器先合成光流运动,运动引导的视频生成器再根据光流生成视频帧;(3) 这种解耦设计使模型能从合成数据学习动态运动模式,同时从真实视频保留视觉真实感。在两个具有挑战性的场景上验证:剧烈人体运动生成和极端相机运动控制。

核心创新

- 首次利用合成光流数据训练视频扩散模型的动态运动生成

- 运动-外观解耦:合成光流仅编码运动,避免学到不自然外观

- 两阶段框架:运动生成→运动引导视频生成

- 解决了高动态运动视频数据稀缺的根本问题

- 支持剧烈人体运动和极端相机运动两种场景

实验结果

- 在剧烈人体运动生成和极端相机运动控制两个挑战性场景上的大量实验表明,DynaVid 显著提升了动态运动生成的真实感和可控性。与仅使用真实数据训练的基线相比,合成运动数据带来了明显的性能提升,验证了运动-外观解耦策略的有效性。

图表详解

DynaVid 消融实验结果

消融实验验证 DynaVid 合成运动数据的贡献。对比实验展示了仅使用真实数据训练 vs. 结合合成光流训练的性能差异。在剧烈人体运动生成和极端相机运动控制两个挑战性场景上,合成运动数据带来了明显的性能提升。

批判性点评

- 新颖性: 合成光流数据训练视频扩散模型的思路新颖,运动-外观解耦避免了域差距问题

- 可复现性: 两阶段框架清晰,但CG管线的运动数据生成细节不够详尽

- 影响力: 解决了高动态视频数据稀缺的根本问题。合成运动数据策略可推广到其他运动密集场景

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 利用合成数据增强视频生成动态性的新范式

可能的后续方向:

- 更多运动类型覆盖

- 与3D运动表示结合

- 扩展到长视频生成

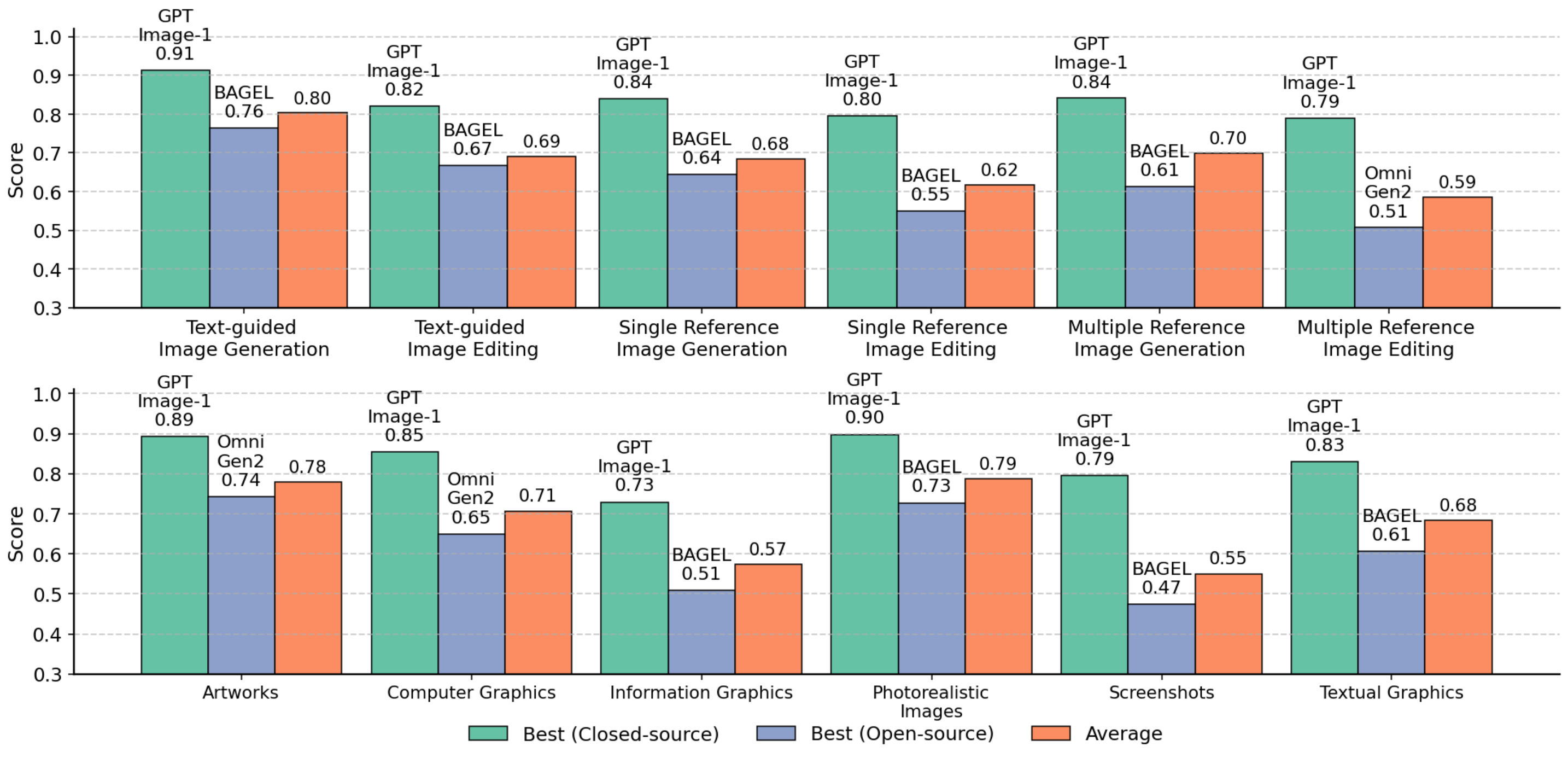

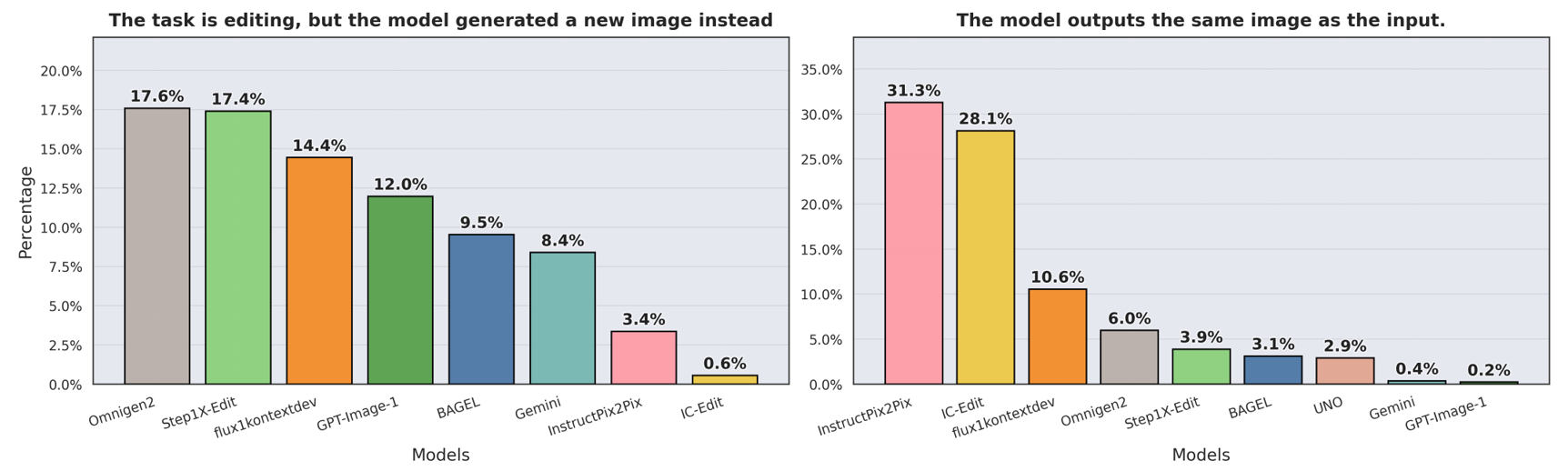

7. ImagenWorld

3.6K条件集+20K标注:压力测试图像生成模型 | Waterloo | University of Waterloo | arXiv:2603.27862

关键词: 评测基准, 人类评估, 可解释评测, 多任务, 图像生成

研究动机

核心问题: 如何构建全面且可解释的图像生成评测基准

扩散、自回归和混合模型已实现了高质量图像合成,但现有评测基准存在严重不足:要么聚焦孤立任务,要么仅覆盖狭窄领域,要么只提供不透明的分数而无法解释失败模式。缺乏一个全面的、可解释的评测体系来系统性压力测试图像生成模型在真实世界开放式任务上的表现。

前序工作及局限:

- FID/IS:统计指标,不可解释

- CLIP Score:语义对齐评估,但粗粒度

- GenEval/T2I-CompBench:组合性评测,但任务/域覆盖有限

- DPG-Bench:密集提示评测,但缺少编辑任务

与前序工作的本质区别: 3.6K条件集×6任务×6域 + 20K细粒度人类标注 + 可解释错误归因

方法原理

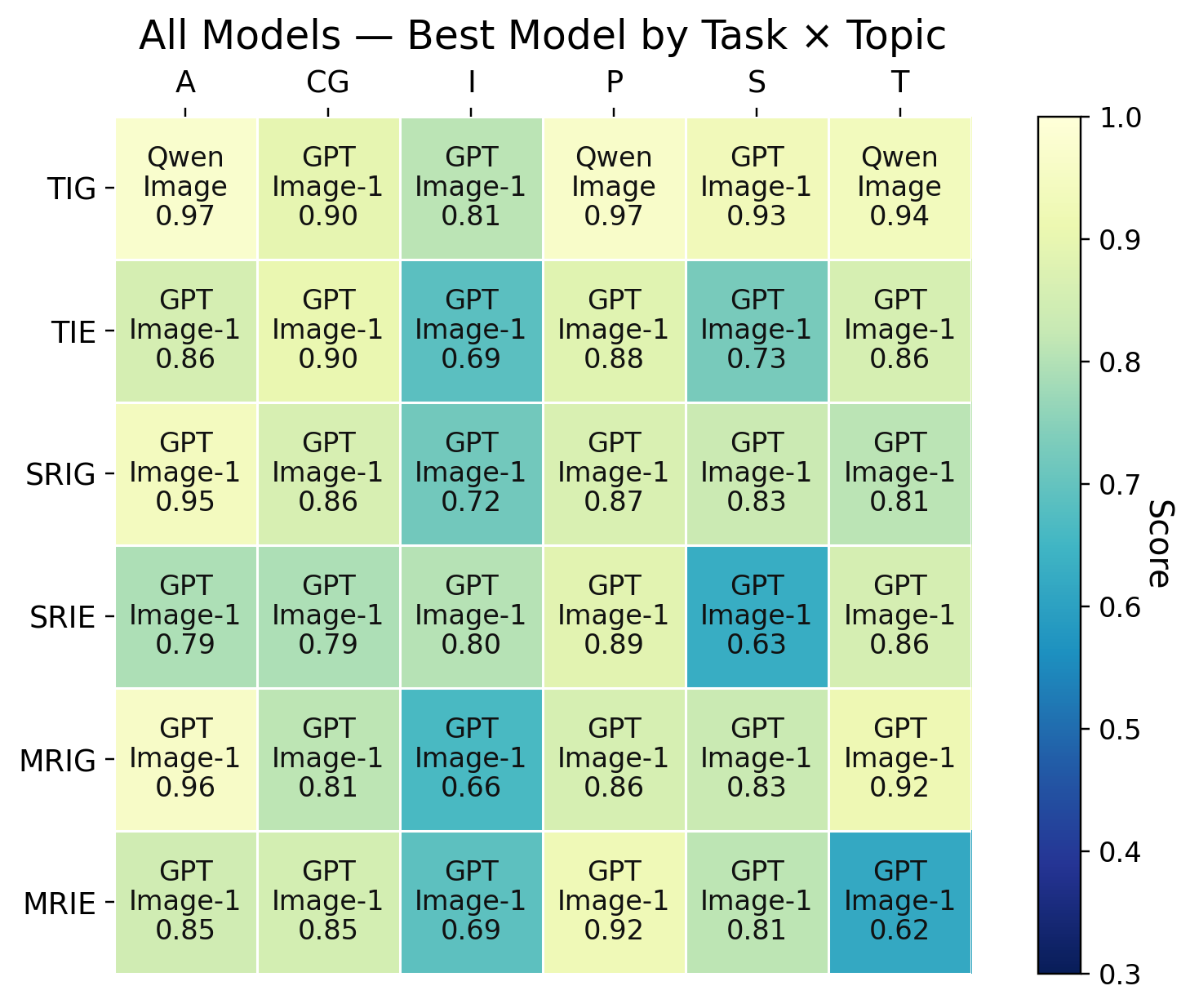

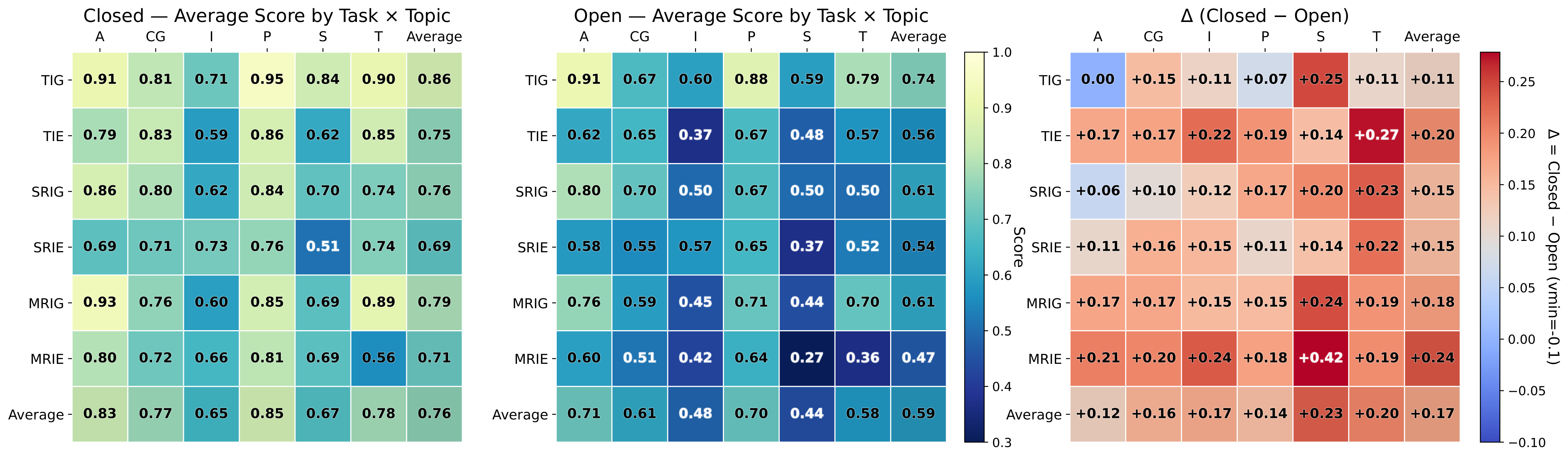

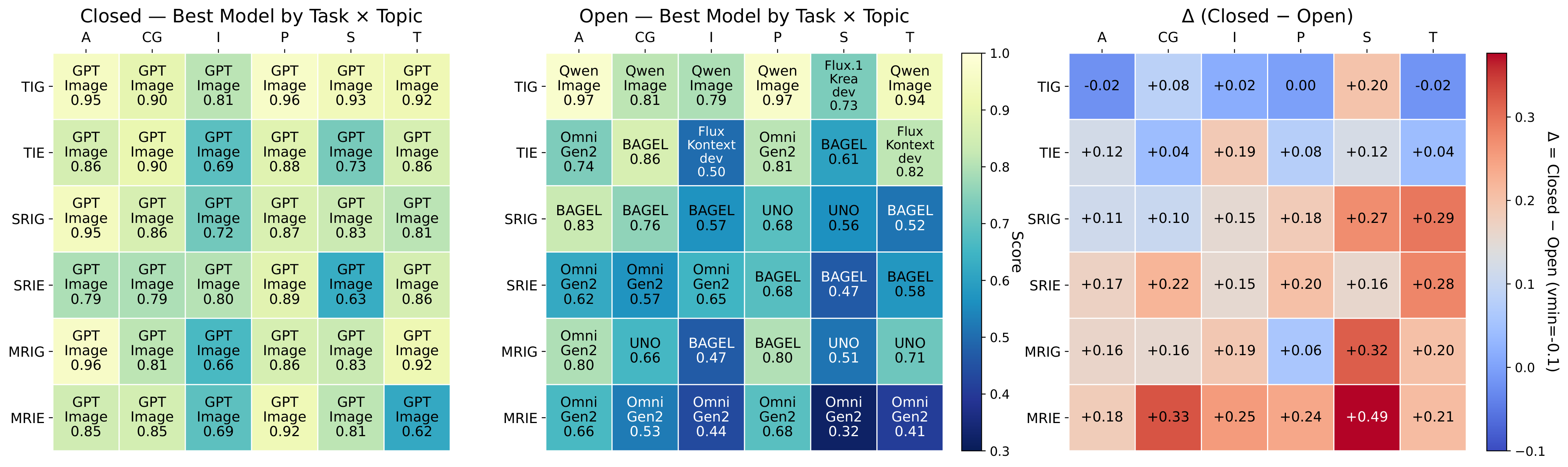

ImagenWorld 构建了一个包含 3.6K 条件集的评测基准,横跨六大核心任务(生成和编辑,含单/多参考)和六大主题域(艺术品、照片级真实、信息图表、文字图形、计算机图形、截图)。配套 20K 细粒度人类标注和可解释评测方案——标注局部化的目标级和区域级错误类型,补充自动化 VLM 指标。对 14 个模型的大规模评估揭示了关键洞察:(1) 编辑任务(尤其是局部编辑)显著难于生成任务;(2) 模型在艺术和照片级场景中表现优秀,但在符号密集和文字密集域(截图、信息图表)中挣扎;(3) 闭源系统总体领先,但定向数据策展(如 Qwen-Image)缩小了文字密集场景的差距;(4) VLM 指标最高达 Kendall 精度 0.79,但无法做到细粒度可解释错误归因。

核心创新

- K 条件集×6 任务×6 域的全面覆盖

- K 细粒度人类标注+可解释错误归因方案

- 个模型的大规模对比评估

- 首次系统揭示生成模型在文字/符号域的短板

- 同时作为评测基准和诊断工具

实验结果

- 14 个模型的评估揭示了多个重要洞察:编辑任务(尤其局部编辑)显著难于生成;模型在艺术和照片级场景优秀但在文字/符号域挣扎;闭源系统总体领先;VLM 指标(最高 Kendall 0.79)接近人类排序但无法做到细粒度可解释归因。ImagenWorld 同时作为严格基准和诊断工具,推动鲁棒图像生成的发展。

图表详解

ImagenWorld 标注界面

ImagenWorld 的细粒度人类标注界面,支持目标级和区域级错误类型标注。标注者可以在图像上框选特定区域,标注具体的错误类型(如文本错误、结构错误、语义错误等),实现局部化错误归因而不仅仅是给出一个总分。

ImagenWorld 评测框架架构

ImagenWorld 的评测框架架构,横跨六大核心任务(生成和编辑,含单/多参考)和六大主题域(艺术品、照片级真实、信息图表、文字图形、计算机图形、截图)。框架支持 VLM 自动评测和人类细粒度标注两种模式。

14 模型性能热力图

14 个图像生成模型在 ImagenWorld 基准上的性能热力图。图中清晰展示了各模型在不同任务和领域上的表现差异。关键洞察:编辑任务(尤其是局部编辑)显著难于生成任务;模型在艺术和照片级场景优秀但在文字/符号域挣扎。

批判性点评

- 新颖性: 可解释评测方案(局部化错误归因)是主要创新点。全面覆盖的多任务多域设计也是亮点

- 可复现性: 基准和标注已公开,VLM评测流程可复现

- 影响力: 为图像生成评测树立了新标准。揭示了模型在文字/符号域的短板,指导未来研究方向

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 图像生成评测从粗粒度分数走向细粒度可解释诊断

可能的后续方向:

- 扩展到视频生成评测

- 自动可解释评测

- 持续更新模型排行榜

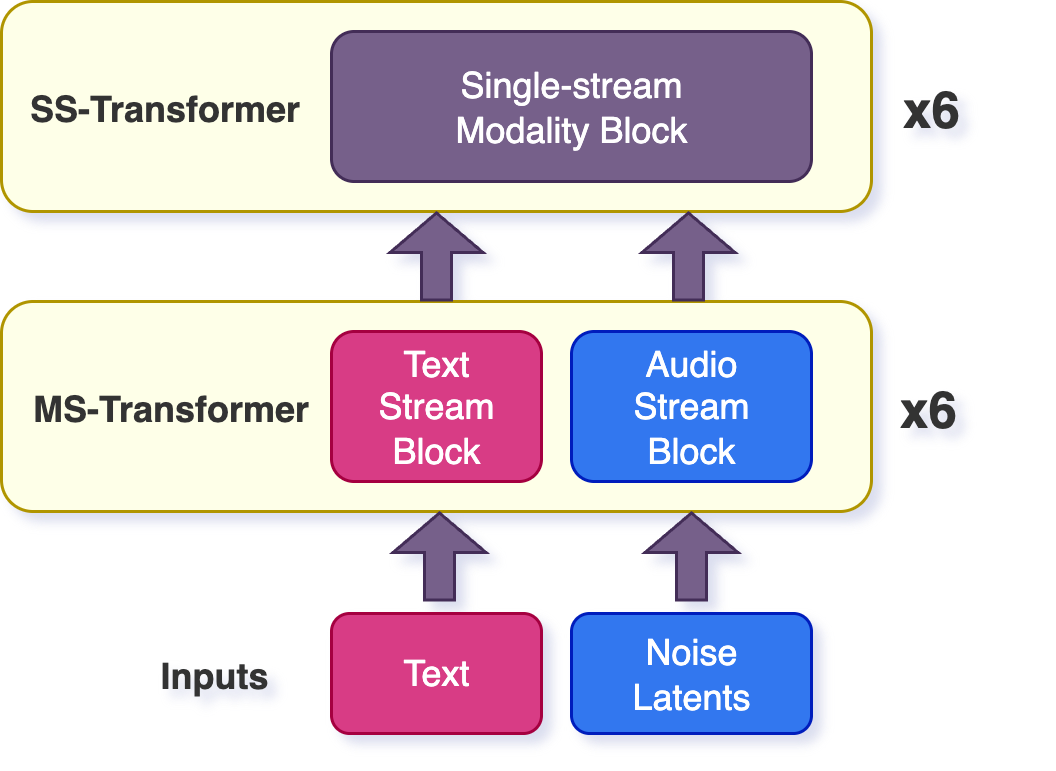

8. Woosh

Sony AI开源音效基础模型 | Sony Research | Sony AI, Sony Research | arXiv:2604.01929

关键词: 音效生成, 基础模型, Text-to-Audio, Video-to-Audio, 开源

研究动机

核心问题: 如何为音频AIGC社区提供完整的开源基础模型

音频研究社区依赖开源生成模型作为构建新方法和建立基线的基础工具。然而,现有的开源音频生成模型(如 StableAudio-Open、TangoFlux)在音效(sound effects)领域的表现仍有提升空间,且缺乏全栈的音频编解码器、文本-音频对齐模型和生成模型的统一开源方案。

前序工作及局限:

- AudioLDM:首次将扩散引入音频生成

- MusicGen:聚焦音乐生成

- StableAudio-Open:开源音频生成基础

- TangoFlux:更高效的音频生成架构

与前序工作的本质区别: 首个涵盖编解码器+对齐模型+T2A+V2A的四组件完整开源方案

方法原理

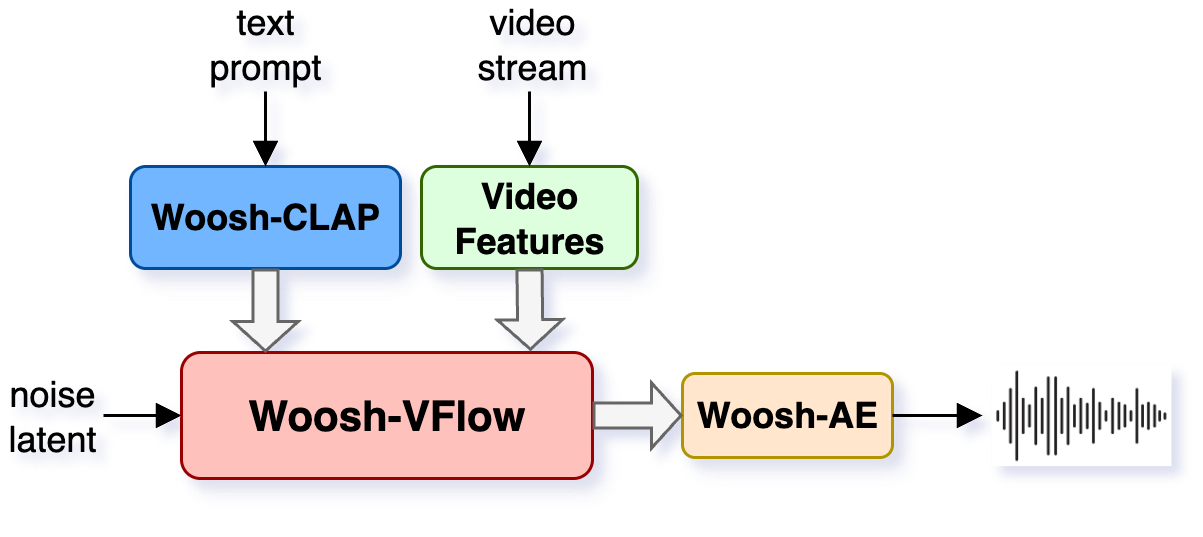

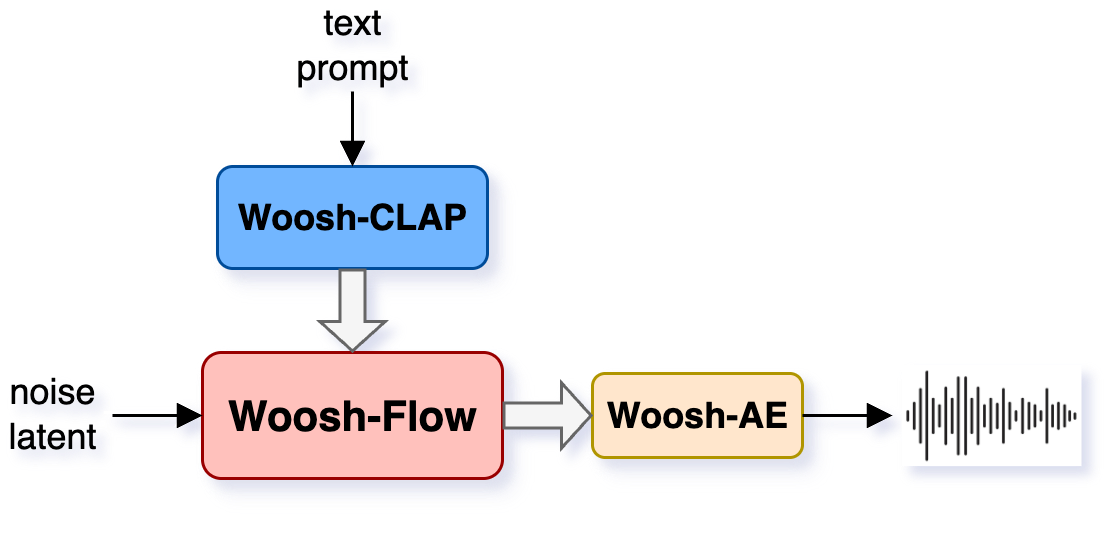

Woosh 是 Sony AI 公开发布的音效基础模型,提供完整的四组件开源方案:(1) 高质量音频编码器/解码器模型——将音频映射到潜空间再重建;(2) 文本-音频对齐模型——用于条件生成的语义对齐;(3) 文本到音频(T2A)生成模型——基于扩散的音效合成;(4) 视频到音频(V2A)生成模型——根据视频内容自动生成匹配的音效。还提供了蒸馏版本的 T2A 和 V2A 模型,支持低资源设备和快速推理。

核心创新

- 完整四组件开源音效基础模型(编解码器+对齐+T2A+V2A)

- 专门优化音效领域(非音乐/语音通用模型)

- 蒸馏版本支持低资源快速推理

- T2A + V2A 双模态生成能力

- 评估表明与 StableAudio-Open 和 TangoFlux 竞争或更优

实验结果

- 在公开和私有数据上的评估显示,Woosh 的每个组件与现有开源替代方案(如 StableAudio-Open 和 TangoFlux)相比均具有竞争力或更优。推理代码和模型权重已在 GitHub 开源,demo 样本可在项目页面试听。

图表详解

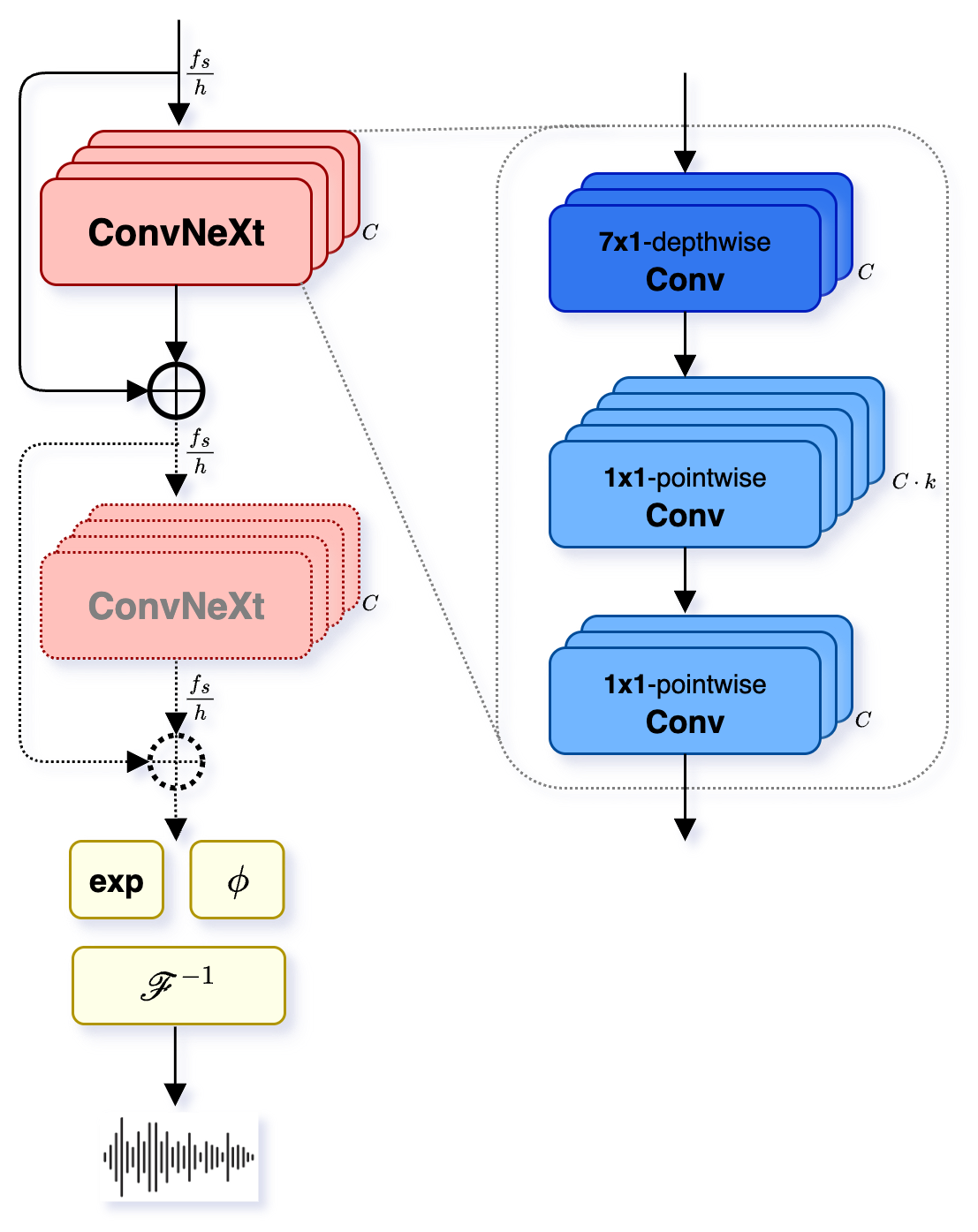

CLAP 文本-音频对齐模型

Woosh 提供的文本-音频对齐模型架构,基于 CLAP(Contrastive Language-Audio Pretraining)实现。该模型将文本描述和音频映射到同一语义空间,为条件生成提供语义对齐基础。支持文本描述驱动的音效合成。

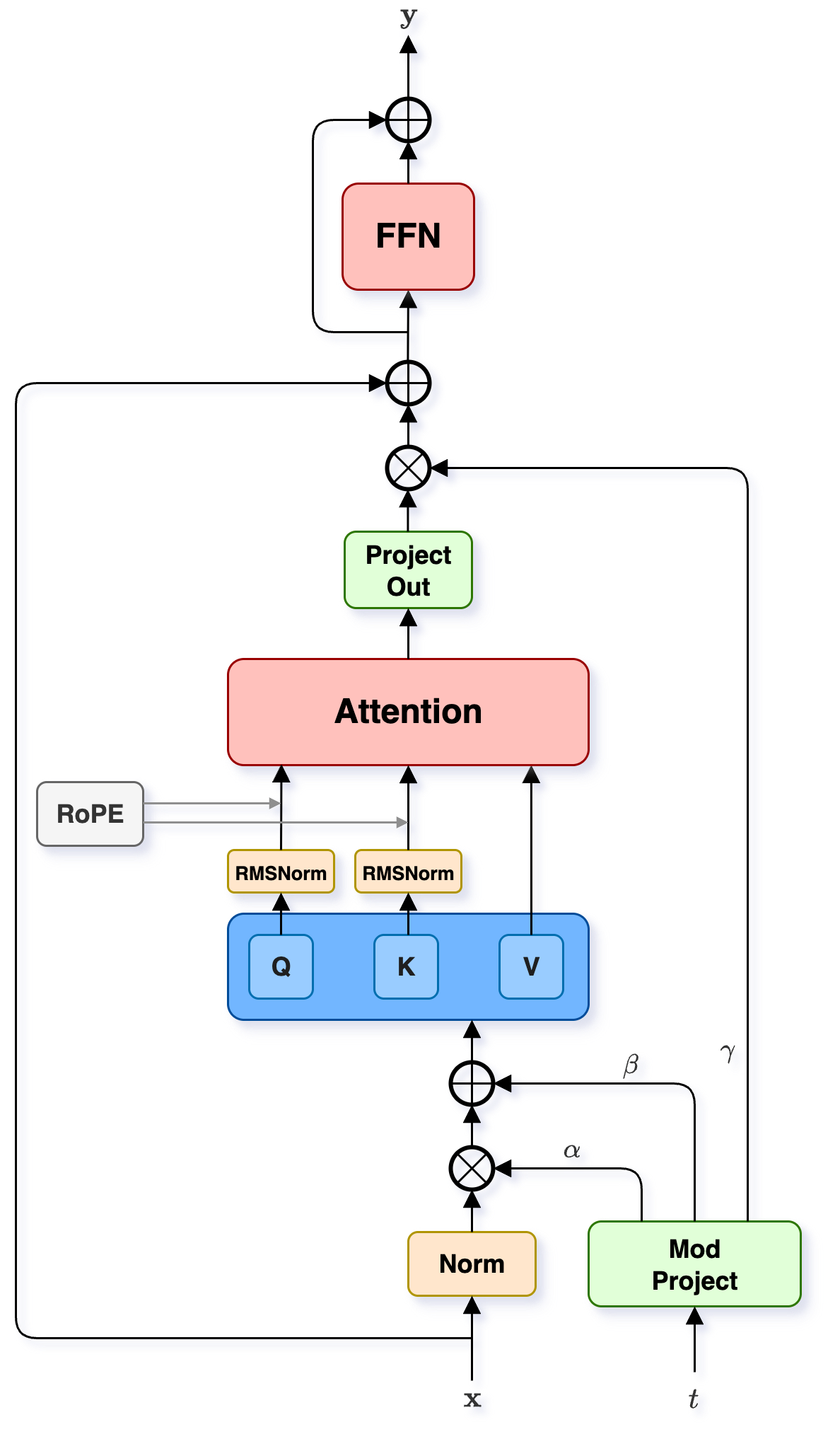

MMMSSFlux 音效生成架构

Woosh 的核心生成模型 MMMSSFlux 的架构设计。基于扩散模型的音效合成架构,支持文本到音频(T2A)生成。图中展示了多流处理机制和扩散去噪过程,专门针对音效领域优化。

多流处理机制详解

MMMSSFlux 的多流处理机制详解。图中展示了如何并行处理不同类型的音频特征,通过多流架构提升音效生成的质量和多样性。蒸馏版本支持低资源设备快速推理。

批判性点评

- 新颖性: 首个涵盖编解码+对齐+T2A+V2A的完整开源音效方案。蒸馏版本实用价值高。但各组件单独看增量创新有限

- 可复现性: 代码和权重已开源,可复现性好

- 影响力: 为音频AIGC社区提供了最完整的开源基础设施,有助于推动该领域研究加速

深度点评:

- LatentUM — 潜空间统一新范式 — 消除像素中介的共享语义潜空间设计最具前瞻性。自反思机制在潜空间中迭代优化生成,开辟了统一模型的新路径。不足:评测基准覆盖有限

- DreamLite — 端侧AIGC里程碑 — 0.39B参数、4步推理、不到1秒。首个同时支持生成和编辑的端侧模型,渐进预训练+RL微调的训练策略值得借鉴

- ContextRepulsion — 被低估的多样性问题 — DiT的典型性偏差终于在注意力空间获得优雅解决。计算开销极小,甚至对Turbo/蒸馏模型有效。简洁而强大

技术演进定位: 音频AIGC从单一模型走向完整生态的重要一步

可能的后续方向:

- 更高质量的长音频生成

- 交互式音效编辑

- 与视觉生成的跨模态协同

其余论文速览

趋势观察

- 高效架构成为主旋律 — MPDiT的多Patch设计降低50%计算量,DreamLite实现0.39B端侧部署,GatedControl将可控生成带到线性注意力——从云端到端侧的效率革命正在加速

- 统一模型走向潜空间融合 — LatentUM消除像素空间中介,在共享潜空间中实现跨模态推理——这标志着统一模型从表面统一到深层融合的范式转变

- 评测方法论升级 — ImagenWorld的3.6K条件集+20K人类标注+可解释错误归因,代表了从单一分数到诊断式评测的转变

- 音频生成进入基础模型时代 — Woosh提供了首个完整的四组件开源音效基础模型,音频AIGC正在复制视觉AIGC的开源生态路径

人工智能炼丹师 整理 | 2026-04-04

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描文末二维码关注

评论 (0)