AIGC 每日速读|2026-05-11|CDM连续蒸馏无需GAN·SwiftI2V单卡4090…

AIGC 每日速读|2026-05-11

今日 AIGC 论文速览

10 篇论文 | 方向分布:推理加速与蒸馏 3 篇 (CDM, SwiftI2V, FreqFormer)·奖励模型与RL对齐 2 篇 (MARBLE, DeScore)·统一多模态生成 3 篇 (Cola DLM, MMCORE, Omni-Diffusion)·音频生成 1 篇 (UniSonate)·视频编辑 1 篇 (Sparkle)

1. CDM:连续时间分布匹配实现少步高保真扩散蒸馏

Continuous-Time Distribution Matching for Few-Step Diffusion Distillation | Alibaba | arXiv: 2605.06376

关键词:蒸馏加速·连续时间优化·Flow匹配·SD3·少步生成

前序工作问题:DMD等离散时间蒸馏方法仅在固定锚点执行分布匹配,导致模式寻求偏差、视觉伪影和过度平滑,需复杂辅助模块(GAN/Reward Model)修复保真度。

贡献:提出CDM框架,首次将分布匹配蒸馏从离散锚点迁移到连续时间优化——随机长度动态调度在采样轨迹任意点执行匹配,连续时间对齐目标在学生速度场外推的偏轨潜变量上进行主动匹配。

效果:在SD3-Medium和Longcat-Image上实现少步生成高竞争力视觉保真度,无需GAN/Reward等复杂辅助目标,代码已开源。

批判点评:实验仅覆盖图像生成,未验证视频等长序列场景;与一致性蒸馏方法的公平对比需更多消融。

2. SwiftI2V:条件分段生成实现2K高分辨率图生视频202倍加速

SwiftI2V: Efficient High-Resolution Image-to-Video Generation via Conditional Segment-wise Generation | arXiv: 2605.06356

关键词:图生视频·2K高分辨率·分段生成·效率优化·NeurIPS 2026

前序工作问题:2K分辨率I2V生成中,端到端模型内存和延迟极高;级联低分辨率+通用超分方案因超分阶段未显式条件于输入图像,导致细节幻觉和结构漂移。

贡献:提出SwiftI2V框架——先生成低分辨率运动参考降低token开销,再通过强图像条件的2K合成恢复细节;引入条件分段生成(CSG)逐段合成限制token预算,双向上下文交互保证跨段连贯性。

效果:在VBench-I2V 2K分辨率上达到端到端基线可比性能,总GPU时间减少202倍;支持单卡H800或消费级RTX 4090实现实用2K I2V生成。

批判点评:仅针对I2V场景设计,T2V是否适用未讨论;分段边界可能引入不可见的时序不连续性。

3. MARBLE:梯度空间多维奖励平衡的扩散强化学习

MARBLE: Multi-Aspect Reward Balance for Diffusion RL | Zhejiang University | arXiv: 2605.06507

关键词:扩散RL·多维奖励·梯度平衡·QP优化·SD3.5

前序工作问题:RL微调扩散模型时需同时优化多维评价标准,但朴素加权求和因样本级不匹配(专家样本对某些维度无信息)导致监督稀释,各维度梯度冲突。

贡献:提出MARBLE梯度空间优化框架——维护独立advantage估计器、计算每维度策略梯度、通过二次规划(QP)协调为统一更新方向;摊销公式利用DiffusionNFT损失仿射结构将反向传播成本降至近单奖励水平。

效果:在SD3.5 Medium上同时提升5个奖励维度,将加权求和下80%小批次梯度余弦为负的最差维度转为一致正向,训练速度仅降0.97倍。

批判点评:QP求解引入额外假设(梯度方向可协调),极端冲突场景下是否退化为顺序训练待验证。

4. Cola DLM:层次连续潜空间扩散语言模型挑战自回归范式

Continuous Latent Diffusion Language Model | ByteDance Seed | arXiv: 2605.06548

关键词:扩散语言模型·连续潜空间·DiT·非自回归·统一多模态

前序工作问题:大语言模型绑定于固定左到右自回归序列,难以同时实现生成效率、可扩展表征学习和全局语义建模。

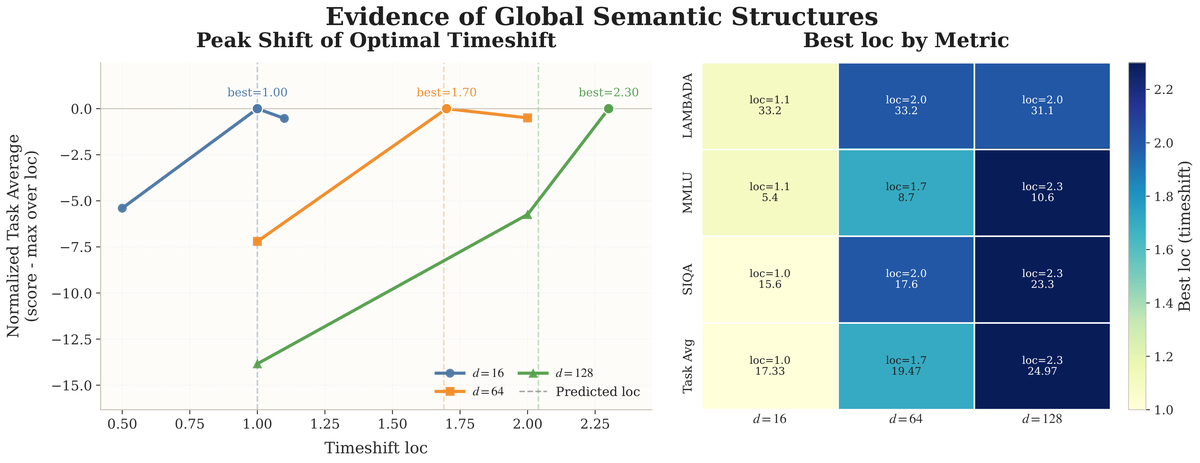

贡献:提出Cola DLM层次潜扩散语言模型——Text VAE学习稳定文本-潜变量映射,块因果DiT建模连续潜空间全局语义先验,条件解码输出文本;从马尔可夫路径统一视角将扩散过程定义为潜先验传输而非token级观测恢复。

效果:在8个基准、~2B参数规模下表现对标自回归和LLaDA基线,扩展至~2000 EFLOPs展现强扩展行为;天然支持离散文本与连续模态的统一建模。

批判点评:99页论文信息量大但核心对比中仍未在主流LLM基准上超越同规模AR模型,实用性待观察。

5. Sparkle:解耦引导实现高质量视频背景替换数据集与模型

Sparkle: Realizing Lively Instruction-Guided Video Background Replacement via Decoupled Guidance | Show Lab | arXiv: 2605.06535

关键词:视频编辑·背景替换·数据集·解耦引导·开源

前序工作问题:视频背景替换需合成全新时序一致场景并保持前景-背景交互,但高质量训练数据极度稀缺;现有开源数据集(OpenVE-3M)常生成静态、不自然背景。

贡献:设计前景/背景解耦引导+严格质量过滤的可扩展数据合成管线;构建Sparkle数据集(~140K视频对, 5类背景主题)和Sparkle-Bench最大背景替换评测基准。

效果:在OpenVE-Bench和Sparkle-Bench上显著超越所有现有基线(包括Kiwi-Edit);数据集、基准和模型完全开源。

批判点评:仅聚焦背景替换单一编辑类型,与通用视频编辑模型的集成路径未明确。

6. DeScore:解耦推理与评分的视频奖励模型

Think, then Score: Decoupled Reasoning and Scoring for Video Reward Modeling | arXiv: 2605.05922

关键词:视频奖励模型·思维链·解耦推理·强化学习·后训练

前序工作问题:判别式RM无显式推理易走捷径依赖海量数据扩展泛化;生成式CoT-RM推理与评分耦合导致优化瓶颈和训练不稳定。

贡献:提出DeScore"先想后评"范式——MLLM先生成显式CoT推理,专用判别模块(可学习查询token+回归头)独立输出奖励;两阶段训练——判别冷启动(随机掩码)+双目标RL(独立优化CoT质量和校准奖励)。

效果:在视频奖励建模多场景评估中展现更强泛化能力和可解释性,高质量推理直接转化为更优模型性能。

批判点评:两阶段训练增加调参复杂度;CoT生成的额外推理开销在大规模RLHF中是否成为瓶颈需实测。

7. MMCORE:VLM语义嵌入驱动的统一多模态生成编辑框架

MMCORE: MultiModal COnnection with Representation Aligned Latent Embeddings | ByteDance | arXiv: 2604.19902

关键词:多模态生成·VLM·扩散模型·图像编辑·空间推理

前序工作问题:统一多模态生成/编辑需深度融合自回归与扩散模型或从头训练,计算开销极高。

贡献:提出MMCORE框架——利用预训练VLM通过可学习查询token预测语义视觉嵌入作为扩散模型条件信号,无需深度融合或从头训练即可将VLM理解推理能力迁移至视觉生成。

效果:在文生图和单/多图编辑基准上一致超越SOTA基线,展现空间推理、视觉定位等复杂多模态理解能力。

批判点评:依赖预训练VLM的质量上限,极细粒度编辑(如精确像素控制)可能受限于语义嵌入粒度。

8. UniSonate:文本指令统一语音、音乐与音效生成

UniSonate: A Unified Model for Speech, Music, and Sound Effect Generation with Text Instructions | ACL 2026 Oral | arXiv: 2604.22209

关键词:统一音频生成·Flow Matching·MM-DiT·动态注入·ACL 2026 Oral

前序工作问题:音频生成碎片化为TTS/TTM/TTA三类独立任务,各自异构控制范式难以统一;结构化语义表征(语音/音乐)与非结构化声学纹理(音效)存在本质不协调。

贡献:提出UniSonate统一Flow Matching框架——标准化无参考自然语言指令接口;动态token注入机制将非结构化音效投射到结构化时域潜空间,在音素驱动MM-DiT中实现精确时长控制;多阶段课程学习缓解跨模态优化冲突。

效果:指令式TTS WER 1.47%、TTM SongEval Coherence 3.18均达SOTA,TTA保持竞争力;联合训练正迁移显著提升单任务结构连贯性和韵律表现力。

批判点评:统一模型在极端边界条件(超长音乐、复杂多说话人对话)下的稳定性未充分验证。

9. Omni-Diffusion:掩码离散扩散统一文本/语音/图像多模态理解与生成

Omni-Diffusion: Unified Multimodal Understanding and Generation with Masked Discrete Diffusion | NJU / Tencent Youtu Lab | arXiv: 2603.06577

关键词:离散扩散·统一多模态·任意到任意·掩码建模·基础模型

前序工作问题:现有MLLM主要采用自回归架构,在多模态统一系统的高效架构替代方案探索上存在巨大空间。

贡献:提出Omni-Diffusion——首个完全基于掩码离散扩散模型的任意到任意多模态语言模型:统一掩码离散扩散直接捕获离散多模态token联合分布,支持文本、语音和图像的双模态及多模态复杂场景。

效果:在多样化基准上超越或持平现有处理两种及以上模态的多模态系统,验证扩散模型作为下一代多模态基础模型骨干的巨大潜力。

批判点评:作为首个探索性工作,模型规模和训练数据量可能限制其在开放域的泛化表现。

10. FreqFormer:频域异构注意力自适应路由加速长视频扩散Transformer

FreqFormer: Hierarchical Frequency-Domain Attention with Adaptive Spectral Routing for Long-Sequence Video Diffusion Transformers | arXiv: 2604.22808

关键词:视频DiT加速·频域分解·异构注意力·自适应路由·长序列

前序工作问题:长序列视频扩散Transformer面临二次方自注意力成本主导运行时间和内存,现有高效注意力方法全局使用单一近似忽略视频特征的频谱结构。

贡献:提出FreqFormer频域异构注意力框架——按频带分配不同算子:低频用压缩全局注意力、中频用结构化块稀疏注意力、高频用滑动窗口局部注意力;轻量频谱路由网络根据层统计和去噪步长动态分配计算(早期偏全局结构,后期偏细节)。

效果:模拟实验在64K-1M token范围内显著降低注意力FLOPs和KV内存流量,同时保持硬件友好计算模式。

批判点评:目前仅有模拟/理论分析,缺乏在实际视频生成模型(如HunyuanVideo/Wan2.1)上的端到端实验验证。

人工智能炼丹君 整理 | 2026-05-11

更多 AIGC 论文解读,关注微信公众号「人工智能炼丹君」

每日更新 · 论文精选 · 深度解读 · 技术脉络

微信搜索 人工智能炼丹君 或扫描下方二维码关注

评论 (0)